La croissance rapide des grands modèles de langage (LLM) nécessite des outils d'évaluation précis pour garantir l'exactitude, la conformité et les performances. Cet article explore les meilleures plateformes d'évaluation LLM pour 2026, en se concentrant sur leur capacité à rationaliser les tests, à surveiller la production et à intégrer le feedback humain. Voici ce que vous devez savoir :

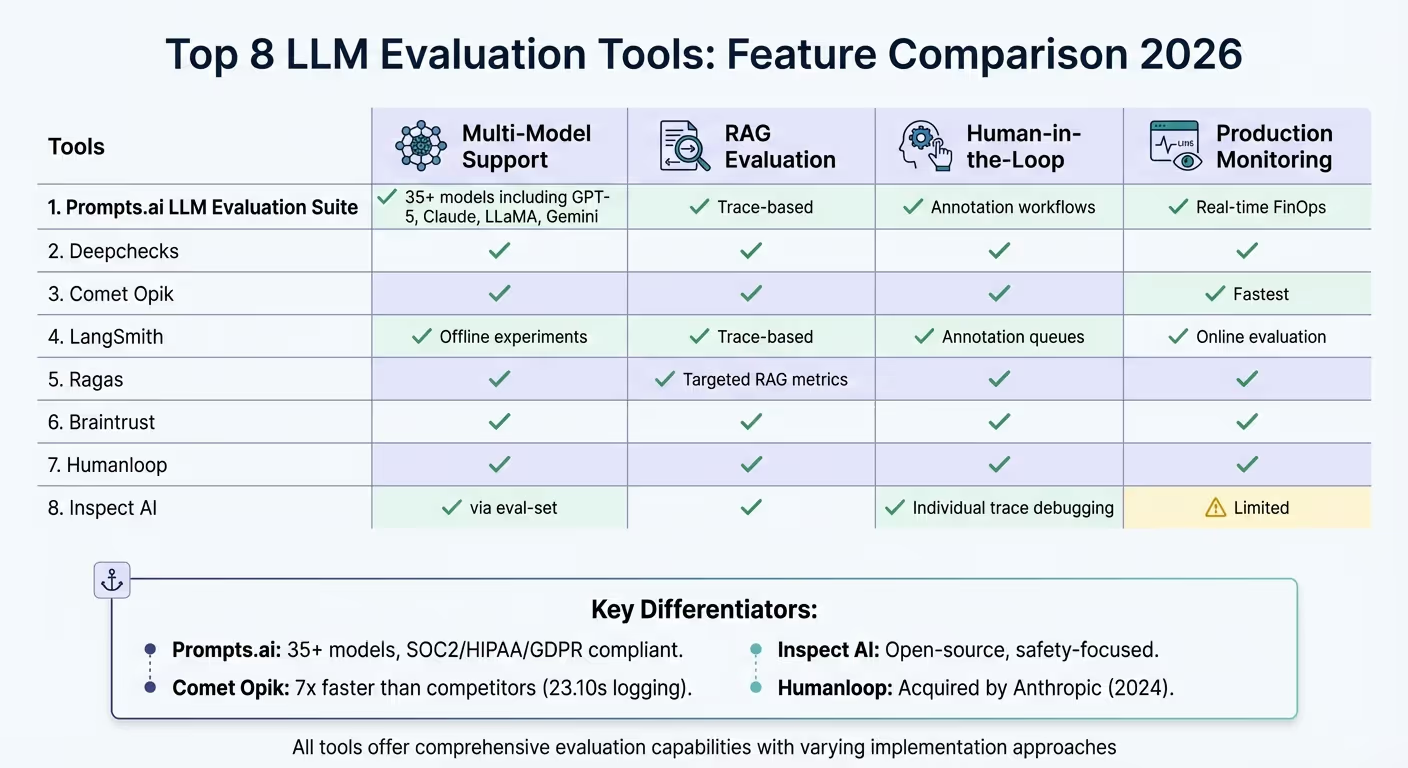

Chaque outil répond différemment aux défis de variabilité et d'évaluation du LLM, en proposant des fonctionnalités telles que la notation automatisée, des flux de travail humains et la surveillance de la conformité. Vous trouverez ci-dessous une comparaison rapide de leurs principales fonctionnalités.

Ces outils permettent aux équipes de valider efficacement les LLM, garantissant ainsi des systèmes d'IA fiables et conformes pour des secteurs tels que la santé, la finance et au-delà.

Comparaison des outils d'évaluation LLM : caractéristiques et capacités 2026

La suite d'évaluation Prompts.ai LLM répond à un défi majeur : comparer et valider les modèles d'IA tout au long du processus de développement. Fonctionnant selon le principe directeur selon lequel « l'ingénierie d'évaluation représente la moitié du défi », cette suite rationalise les opérations en regroupant plus de 35 LLM de premier plan dans une interface unique et facile à utiliser. Dites adieu à jongler entre plusieurs tableaux de bord et clés d'API : cette plateforme simplifie tout.

Grâce à sa comparaison de modèles côte à côte, la suite vous permet de tester des instructions identiques sur des fournisseurs tels que GPT-5, Claude, LLama et Gemini en temps réel. Le Dérogations du moteur cette fonctionnalité offre de la précision en vous permettant de modifier les pipelines d'évaluation, en ajustant des paramètres tels que la température ou les limites symboliques pour chaque exécution. Pendant ce temps, Générateur visuel de pipelines - un outil convivial de type tableur, qui permet aux ingénieurs comme aux experts du domaine de créer des tests A/B complexes sans écrire une seule ligne de code.

Pour les systèmes de génération augmentée par extraction (RAG), la plateforme garantit la précision en validant les réponses par rapport à des « ensembles de données dorés » prédéfinis. Il utilise également des techniques LLM-as-a-Judge pour vérifier la factualité et la pertinence dans le contexte donné. La suite comprend plus de 20 types de colonnes pour l'évaluation, allant des comparaisons de chaînes de base aux webhooks personnalisés et aux extraits de code, permettant une logique d'évaluation personnalisée pour les besoins propriétaires.

Comprenant que les métriques ne peuvent à elles seules saisir les nuances d'un langage, la suite intègre une colonne « HUMAINE » pour la notation manuelle. Les réviseurs peuvent fournir des notes numériques, des commentaires détaillés ou utiliser des curseurs pour évaluer des éléments subjectifs tels que le ton ou la cohérence de la marque. Pour l'évaluation des chatbots, le simulateur de conversation prend en charge jusqu'à 150 tours de conversation, combinant des contrôles automatisés avec une supervision humaine pour garantir des performances de dialogue multi-tours de haute qualité.

La suite Évaluations nocturnes échantillons de fonctionnalités, demandes de production pour identifier les problèmes de performance ou la dérive du modèle, en temps réel Slack des alertes qui vous tiennent au courant. Son intégration CI/CD garantit qu'aucune nouvelle version rapide n'est déployée sans répondre aux critères de qualité. Pour les secteurs soumis à des réglementations strictes, la plateforme est certifiée SOC2 Type 2, GDPR, HIPAA et CCPA, et propose un BaaS pour les soins de santé. En outre, il fournit une comptabilité des jetons en temps réel et des analyses des coûts pour gérer l'utilisation élevée de jetons typique des flux de travail RAG. Des pistes d'audit complètes renforcent la conformité réglementaire et les examens internes.

Deepchecks relève le défi de l'évaluation de grands modèles de langage (LLM) en proposant des comparaisons côte à côte des versions des modèles, des instructions, des agents et des systèmes d'IA. Il intègre des modèles intégrés, des bases de données vectorielles et des méthodes de récupération dans un flux de travail unifié, rationalisant ainsi le processus d'évaluation. Cette approche ouvre la voie à des méthodes avancées pour évaluer plusieurs modèles.

Deepchecks est conçu pour gérer la variabilité des performances LLM grâce à son support multimodèle robuste. En s'appuyant sur des modèles linguistiques de petite taille (SLM) et des pipelines Mixture of Experts (MoE), il agit comme un annotateur intelligent, fournissant une notation objective. Ce système garantit des mesures de performance cohérentes entre les différents fournisseurs de LLM. Les utilisateurs peuvent également créer des évaluateurs sans code à l'aide d'un raisonnement en chaîne de pensée pour analyser des segments de flux de travail spécifiques. Deepchecks s'intègre parfaitement à AWS SageMaker et est membre fondateur de LLMOPS.space, une communauté mondiale pour les praticiens du LLM.

La plateforme est spécialisée dans l'évaluation des systèmes de génération augmentée par extraction (RAG) en évaluant l'ancrage et la pertinence de la récupération. Sa fonction Golden Set Management permet de créer des ensembles de tests cohérents pour comparer différentes versions de modèles.

Deepchecks associe une notation automatique à des modifications manuelles, permettant aux experts d'affiner les ensembles de données fiables sur le terrain. Son interface sans code permet aux professionnels non techniques de définir des critères d'évaluation adaptés aux besoins spécifiques de l'entreprise.

Deepchecks garantit des flux de production fluides en surveillant les problèmes tels que les hallucinations, les contenus préjudiciables et les pannes de pipeline. Il respecte également des normes de conformité strictes, notamment SOC2 Type 2, le RGPD et la HIPAA. Les options de déploiement sont flexibles, allant du SaaS multi-tenant au SaaS à locataire unique, en passant par le Custom On-Prem et AWS Zero-Friction On-Prem, répondant aux exigences de résidence des données. Pour les organisations ayant des besoins de sécurité élevés, telles que celles qui utilisent AWS GovCloud, la plateforme propose des outils d'analyse des causes profondes pour identifier les points faibles et résoudre les étapes qui ont échoué dans les applications LLM.

La comète Opik se distingue par sa rapidité et sa capacité d'adaptation dans l'évaluation de grands modèles de langage (LLM). Il enregistre les traces et les intervalles en seulement 23,10 secondes et fournit des résultats d'évaluation en un temps impressionnant de 0,34 seconde. Cela le rend presque sept fois plus rapide que Arize Phénix et quatorze fois plus rapide que Langfuse. Leonardo Gonzalez, vice-président du Centre d'excellence en intelligence artificielle de Trilogie, a salué son efficacité :

« Opik a traité les interactions et fourni des métriques presque instantanément après la journalisation, soit un délai remarquablement rapide ».

La rapidité d'Opik est égalée par sa large compatibilité avec les principaux modèles. Il s'intègre parfaitement à des plateformes telles que IA ouverte, Anthropic, Bedrock et Prédibase. C'est Terrain de jeu rapide permet aux utilisateurs de tester des modèles côte à côte, de modifier des paramètres tels que la température et de changer de modèle pour comparer les performances en temps réel. En outre, Opik prend en charge Jurys LLM, permettant à plusieurs modèles d'évaluer les résultats indépendamment et de combiner leurs partitions en une seule partition d'ensemble. Sa plateforme mère, Comet-ML, a obtenu plus de 14 000 étoiles sur GitHub, ce qui témoigne de sa popularité auprès des développeurs.

Opik excelle dans l'évaluation des systèmes RAG (Retrieval-Augmented Generation), en proposant des mesures spécialisées pour détecter les hallucinations, évaluer la pertinence des réponses et mesurer la précision et le rappel du contexte. La plateforme suit automatiquement l'intégralité du pipeline LLM, ce qui permet aux développeurs de déboguer plus facilement des composants dans des configurations RAG ou multi-agents complexes. Il s'intègre également au framework Ragas. Opik a récemment élargi sa bibliothèque pour inclure 37 nouveaux indicateurs, tels que BertScore et l'analyse des sentiments.

Bien que les mesures automatisées constituent un atout clé, Opik donne également la priorité aux commentaires des experts. C'est Files d'annotations permettre la révision et la notation manuelles des traces par des experts. Le Scores de feedback à valeurs multiples Cette fonctionnalité permet aux membres de l'équipe de noter indépendamment la même trace, minimisant ainsi les biais et améliorant la précision de l'évaluation. Ces scores manuels sont combinés à des mesures automatisées pour créer une boucle de rétroaction continue permettant d'affiner les performances du modèle.

Opik's Règles d'évaluation en ligne proposent des options d'échantillonnage configurables (10 % à 100 %) et incluent des fonctionnalités telles que la rédaction des informations personnelles. Alertes en temps réel via Slack et Tâche du téléavertisseur informer les équipes des dépassements de coûts, des problèmes de latence ou des erreurs. En tant que plateforme open source, Opik propose un niveau gratuit généreux sans avoir besoin de carte de crédit. Pour les entreprises, il offre des fonctionnalités supplémentaires d'évolutivité et de conformité adaptées aux besoins du secteur.

LangSmith s'intègre parfaitement à Chaîne Lang écosystème tout en restant suffisamment flexible pour fonctionner avec d'autres frameworks. Il capture traces imbriquées à travers des flux de travail complexes, permettant aux développeurs d'identifier et de résoudre les problèmes dans des domaines tels que la récupération, les appels d'outils ou la génération.

LangSmith's Terrain de jeu rapide permet aux développeurs de tester plusieurs LLM, tels qu'OpenAI et Anthropic, côte à côte. Cette fonctionnalité facilite la pondération de facteurs tels que la qualité, le coût et la latence. Avec ses Analyse comparative des expériences outil, les utilisateurs peuvent exécuter différents modèles ou demander des versions sur le même ensemble de données organisé, offrant une comparaison claire des résultats. La plateforme prend également en charge évaluateurs de comparaison par paires, où un LLM en tant que juge ou un évaluateur humain note les résultats de deux modèles dans le cadre d'une évaluation en tête-à-tête. En outre, le open evals Le package permet aux équipes de concevoir des évaluateurs indépendants des modèles utilisant différents modèles pour évaluer les performances des applications, garantissant ainsi une flexibilité lors de la collaboration avec différents fournisseurs.

LangSmith va au-delà des simples comparaisons de modèles en proposant des outils avancés pour évaluer les systèmes RAG.

LangSmith fournit des informations détaillées sur les systèmes RAG en suivant chaque étape du processus de récupération. Les équipes peuvent mesurer pertinence de la récupération (si les bons documents ont été identifiés) et précision de la réponse (dans quelle mesure les réponses sont-elles complètes et correctes). En utilisant une approche basée sur les traces, LangSmith identifie exactement la panne d'un flux de travail, éliminant ainsi les conjectures liées au débogage de pipelines de récupération complexes.

Outre ses évaluations détaillées, la plateforme propose un suivi robuste de la production pour garantir le bon fonctionnement des opérations.

LangSmith's Files d'annotations mettez en place des flux de travail structurés permettant aux experts en la matière d'examiner, de noter et d'annoter les réponses aux candidatures. Comme le souligne LangChain :

« Le feedback humain fournit souvent l'évaluation la plus précieuse, en particulier en ce qui concerne les dimensions subjectives de la qualité ».

Lorsque des évaluateurs automatisés ou des commentaires d'utilisateurs signalent des traces de production, celles-ci sont transmises à des experts pour examen. Les traces annotées sont ensuite transformées en ensembles de données « de référence » pour des tests futurs, améliorant ainsi les capacités du système au fil du temps.

LangSmith surveille des indicateurs clés tels que la latence au niveau des demandes, l'utilisation des jetons et l'attribution des coûts en temps réel. C'est Évaluateurs en ligne permettez aux équipes d'échantillonner des portions spécifiques du trafic, telles que 10 %, afin d'équilibrer visibilité et coût, en prenant en charge jusqu'à 500 fils évalués simultanément dans un délai de cinq minutes. Ce suivi en temps réel garantit une résolution rapide et efficace des problèmes de production.

La plateforme répond aux normes de sécurité de niveau entreprise, en maintenant Conformité aux normes HIPAA, SOC 2 Type 2 et RGPD. Les contrôles automatisés, notamment les filtres de sécurité, la validation des formats et les heuristiques de qualité, ajoutent une couche de protection supplémentaire. Les alertes de base relatives aux erreurs et aux pics de latence aident les équipes à réagir rapidement aux incidents. LangSmith utilise un modèle de tarification par trace, avec un niveau gratuit disponible, bien que les coûts puissent augmenter de manière significative en cas de volumes de production élevés.

Ragas, créée en 2023, se concentre sur l'évaluation des pipelines RAG (Retrieval-Augmented Generation). Né de recherches sur les méthodes d'évaluation sans référence publiées plus tôt cette année-là, il sépare l'analyse des performances des composants du retriever et du générateur. Cette distinction aide les équipes à déterminer si les problèmes sont dus à une récupération de données erronée ou à des hallucinations dans le modèle linguistique, conformément au thème plus large des outils spécialisés d'évaluation.

Ragas propose des métriques ciblées pour les processus de récupération et de génération. Pour la récupération, il mesure :

Du côté des générations, il évalue :

Cette approche granulaire simplifie le débogage des flux de travail RAG complexes. Par exemple, lors d'un indice de référence d'août 2025, la précision d'un modèle est passée de 50 % à 90 % après avoir résolu des problèmes tels que l'empilement de règles non respecté et les conditions aux limites.

À l'aide d'un « LLM en tant que juge » méthodologie, Ragas génère des scores quantitatifs, minimisant ainsi le besoin d'étiquettes manuelles de vérité sur le terrain. Il prend également en charge la génération de données de test synthétiques, avec des recommandations pour commencer avec 20 à 30 échantillons et augmenter jusqu'à 50 à 100 pour des résultats plus fiables.

Ragas s'intègre parfaitement à divers fournisseurs de LLM, notamment OpenAI, Anthropic (Claude), Google (Gemini) et des modèles locaux via Ollama. Il garantit la reproductibilité en permettant aux équipes de verrouiller des versions de modèles spécifiques (par exemple, « gpt-4o-2024-08-06 ») lors de l'analyse comparative, même lorsque les fournisseurs mettent à jour leurs modèles. De plus, l'outil est hautement extensible, permettant des mesures personnalisées via des décorateurs tels que @discrete_metric, qui peut être utilisé pour des tâches telles que la validation JSON.

Bien que Ragas mette l'accent sur les métriques automatisées, il intègre une supervision humaine pour une fiabilité accrue. Le framework comprend une interface utilisateur pour l'annotation des métriques, permettant aux utilisateurs d'ajouter notations_de notation pour tester des ensembles de données et définir des critères d'évaluation spécifiques à l'homme. Chaque évaluation comprend également un raison_score champ de transparence et d'auditabilité. Comme le dit la documentation Ragas :

« Ragas est une bibliothèque qui vous aide à passer des « tests d'ambiance » à des boucles d'évaluation systématiques pour vos applications d'IA ».

Cette combinaison de notation automatique et de saisie humaine garantit un suivi rigoureux des performances, même dans des environnements dynamiques.

Ragas étend ses capacités à la surveillance de la production en s'intégrant à des plateformes d'observabilité telles que Langfuse et Arize. Cela permet de comptabiliser en temps réel les traces de production. Ses indicateurs sans référence, tels que Fidélité pour détecter les hallucinations, sont particulièrement utiles en direct où les réponses factuelles ne sont pas toujours disponibles. Le cadre prend également en charge l'intégration dans les pipelines CI/CD, permettant une évaluation continue pour garantir que les mises à jour répondent aux normes de performance et de sécurité. Les équipes peuvent choisir de noter chaque trace ou de recourir à un échantillonnage périodique par lots pour équilibrer les coûts tout en conservant une vue d'ensemble du comportement du modèle.

Braintrust intègre l'évaluation et le suivi de la production directement dans les flux de travail d'ingénierie standard, garantissant ainsi un processus fluide et efficace.

Le Playground basé sur le Web de Braintrust permet aux équipes de comparer des modèles côte à côte, ce qui facilite les décisions fondées sur les données. Avec le Playground, les utilisateurs peuvent affiner les instructions, passer d'un modèle à l'autre et effectuer des évaluations de manière fluide. Les comparaisons côte à côte mettent en évidence les performances du modèle sur des instructions identiques, offrant ainsi des informations claires. Intégrée à GitHub Actions, la plateforme effectue des évaluations automatiquement à chaque validation, compare les résultats aux valeurs de référence et empêche les fusions en cas de baisse de qualité. Braintrust inclut plus de 25 indicateurs intégrés pour mesurer des indicateurs clés tels que la factualité, la pertinence et la sécurité, tout en permettant la création de marqueurs personnalisés, que ce soit par le biais de code ou en utilisant un LLM-as-a-Judge. Outre les mesures automatisées, la plateforme met l'accent sur l'importance des avis d'experts.

Pour intégrer l'expertise humaine, Braintrust propose son flux de travail « Annoter ». Cela permet aux équipes de mettre en place des processus de révision, d'appliquer des étiquettes et d'affiner les résultats des modèles. Son interface sans code permet aux chefs de produit et aux experts du domaine de prototyper des instructions et d'examiner les résultats en toute simplicité. En combinant la notation automatique avec le feedback humain, la plateforme capture les subtilités que les algorithmes peuvent ignorer. En outre, l'agent d'intelligence artificielle « Loop » identifie les modèles de défaillance et fournit des informations à partir des journaux de production. Cette intégration de l'apport humain reflète les principes du développement moderne axé sur l'évaluation. Lee Weisberger d'Airtable a partagé :

« Chaque nouveau projet d'IA commence par des évaluations dans Braintrust. Cela change la donne. »

Braintrust étend ses capacités aux environnements de production en direct, en évaluant en permanence le trafic à l'aide des mêmes indicateurs de qualité appliqués pendant le développement. Il suit en détail l'utilisation des jetons (par utilisateur, fonctionnalité et conversation) afin de détecter rapidement les tendances coûteuses, aidant ainsi les équipes à gérer efficacement les budgets. La plateforme offre également des performances exceptionnelles, offrant une recherche en texte intégral 23,9 fois plus rapide (401 ms contre 9 587 ms) et une latence d'écriture 2,55 fois plus rapide. Sarah Sachs, responsable de l'ingénierie chez Notion, a fait remarquer :

« Brainstore a complètement changé la façon dont notre équipe interagit avec les journaux. Nous avons pu découvrir des informations en effectuant des recherches en quelques secondes, ce qui prendrait auparavant des heures. »

Pour les organisations ayant des besoins stricts en matière de souveraineté des données, Braintrust propose des options d'auto-hébergement et est certifiée SOC 2 Type II, garantissant conformité et sécurité.

Remarque : Les fonctionnalités autonomes de Humanloop reflètent les capacités de la plateforme avant son acquisition par Anthropic fin 2024. Ces fonctionnalités antérieures ont façonné les approches d'évaluation intégrée observées aujourd'hui, mettant en évidence la progression des pratiques de développement axées sur l'évaluation.

Humanloop a comblé le fossé entre les ingénieurs et les collaborateurs non techniques en proposant un espace de travail partagé où les chefs de produit, les équipes juridiques et les experts en la matière pouvaient participer activement à une ingénierie et à une évaluation rapides, sans avoir besoin de feuilles de calcul encombrantes. Vous trouverez ci-dessous un aperçu de la manière dont Humanloop a rationalisé les flux de travail d'évaluation.

Humanloop a permis aux équipes de comparer différents modèles de base côte à côte à l'aide d'un seul ensemble de données. Cela comprenait des modèles d'OpenAI (GPT-4o, GPT-4O-Mini), le Claude 3.5 Sonnet d'Anthropic, Google et des options open source telles que Mistral. Les diagrammes en araignée ont fourni une visualisation claire des compromis entre des facteurs tels que le coût, la latence et la satisfaction des utilisateurs. Par exemple, une évaluation a démontré que le GPT-4o offrait une plus grande satisfaction des utilisateurs, mais à un coût plus élevé et à une vitesse plus lente. En outre, la fonction de mise en cache des journaux de la plateforme a permis aux équipes de réutiliser les journaux pour des ensembles de données et des instructions spécifiques, réduisant ainsi le temps et les dépenses liés aux évaluations. Cette fonctionnalité a permis de relever les défis posés par les performances variables des grands modèles de langage, un problème courant dans les cadres d'évaluation modernes.

Pour les cas d'utilisation de la génération augmentée par extraction (RAG), Humanloop a proposé des modèles prédéfinis. Ces modèles incluaient des évaluateurs de l'IA en tant que juge conçus pour vérifier l'exactitude des faits et garantir la pertinence du contexte.

L'interface de la plateforme a permis aux experts de consulter les journaux, de fournir des commentaires binaires, catégoriques ou textuels et d'ajouter des notes de notation pour affiner les critères d'évaluation. Les équipes ont indiqué économiser 6 à 8 heures d'ingénierie par semaine grâce à ces flux de travail rationalisés. Humanloop a pris en charge à la fois les tests hors ligne pour l'analyse comparative des nouvelles versions et la surveillance en ligne pour l'examen des données de production en direct.

Humanloop a également excellé dans le suivi de la production, en intégrant des évaluations dans les pipelines CI/CD pour détecter les régressions avant le déploiement. Des évaluateurs en ligne automatisés surveillaient les journaux de production en direct, suivaient les tendances des performances et déclenchaient des alertes en cas de baisse des performances. Daniele Alfarone, directeur principal de l'ingénierie chez Dixa, a souligné l'importance de la plateforme :

« Nous ne prenons aucune nouvelle décision de déploiement de LLM avant d'avoir d'abord évalué de nouveaux modèles via Humanloop. L'équipe dispose d'indicateurs de performance en matière d'évaluation qui lui donnent confiance. »

La plate-forme a également pris en charge une sécurité de niveau professionnel avec le contrôle des versions, la conformité SOC-2 et des options d'auto-hébergement.

Créé par le UK AI Security Institute, Inspect AI adopte une approche axée sur la recherche pour évaluer les grands modèles de langage (LLM), en mettant l'accent sur la sûreté et la sécurité. Sa licence open source MIT garantit l'accessibilité aux équipes qui se consacrent à des tests de développement approfondis. Le cadre comprend plus de 100 évaluations prédéfinies, couvrant des domaines tels que le codage, le raisonnement, les tâches agentiques et la compréhension multimodale.

Avec le ensemble d'évaluation commande, Inspect AI permet aux utilisateurs d'exécuter une seule tâche d'évaluation sur plusieurs modèles simultanément, en tirant parti de l'exécution parallèle pour gagner du temps sur l'analyse comparative. Il prend en charge une gamme de fournisseurs, notamment OpenAI, Anthropic, Google, Mistral, Visage étreignant, et des modèles locaux via VllM ou Ollama. En ajoutant le nom du fournisseur à l'ID du modèle, les utilisateurs peuvent comparer les performances, la vitesse et les coûts entre différents fournisseurs d'inférence. Politiques de sélection automatisées, telles que : le plus rapide ou : le moins cher, rationalisez davantage les évaluations en acheminant les tâches vers le fournisseur le plus efficace en fonction du débit et des coûts. Par exemple, dans un indice de référence, le gpt-oss-120b le modèle a démontré une précision variable, avec un score hyperbolique de 0,84, tandis que Groq et Sambanova ont tous deux obtenu un score de 0,80. Cette capacité de comparaison multimodèle est renforcée par une supervision humaine pour garantir une validation précise des performances.

Outre les benchmarks automatisés, Inspect AI intègre l'évaluation humaine pour établir des références de performance par rapport aux capacités humaines sur les tâches de calcul. Son solveur d'agents facilite ce processus, tandis que la fonction d'approbation des outils permet aux humains de revoir et d'approuver les appels d'outils effectués par les modèles lors des évaluations. Pour obtenir des informations en temps réel, l'outil Web Inspect View et l'extension VS Code fournissent une visualisation des trajectoires d'évaluation, permettant ainsi l'analyse manuelle des erreurs et le débogage. Le UK AI Security Institute souligne la capacité d'adaptation du framework :

« Inspect peut être utilisé pour un large éventail d'évaluations qui mesurent le codage, les tâches agentiques, le raisonnement, les connaissances, le comportement et la compréhension multimodale ».

Bien que principalement conçu pour les tests et le développement, Inspect AI excelle également en matière de sécurité et de conformité. Son système de sandboxing, compatible avec Docker, Kubernetes, Modal et Proxmox - permet au code généré par un modèle non fiable de s'exécuter dans des environnements isolés. Dans le même temps, elle nécessite une autorisation humaine pour les appels d'outils critiques, une fonctionnalité essentielle pour évaluer les flux de travail des agences dans des scénarios à enjeux élevés. Ces mesures reflètent l'importance accordée par la plateforme à des tests sécurisés et fiables, conformément aux meilleures pratiques du secteur en matière de sûreté et de sécurité de l'IA.

Choisissez le meilleur outil d'évaluation LLM en évaluant les fonctionnalités essentielles telles que la compatibilité multimodèle, l'évaluation RAG, les flux de travail intégrés et le suivi de la production.

Vous trouverez ci-dessous une ventilation de ces fonctionnalités sur les différentes plateformes :

Bien que la plupart des outils prennent en charge les quatre fonctionnalités, leurs méthodes de mise en œuvre diffèrent. Par exemple, Inspectez l'IA se concentre sur la révision manuelle avec le débogage des traces individuelles, ce qui le rend plus adapté aux tests de développement tout en offrant une surveillance limitée de la production.

Choisir le bon outil d'évaluation LLM en 2026 ne consiste pas à rechercher l'option la plus riche en fonctionnalités, mais à aligner les fonctionnalités de l'outil sur votre flux de travail unique. Que vous vous concentriez sur les pipelines CI/CD avec intégration native de Pytest, les systèmes de production nécessitant une surveillance en temps réel ou les applications RAG nécessitant une analyse basée sur les traces, l'outil idéal doit s'intégrer parfaitement à votre infrastructure existante. L'accent mis sur les fonctionnalités personnalisées souligne l'importance croissante de l'évaluation basée sur des métriques.

Le passage des évaluations subjectives à des mesures basées sur les données n'est plus facultatif, mais essentiel pour les environnements de production. OpenAI souligne ce point :

« Si vous construisez avec des LLM, créer des évaluations de haute qualité est l'une des choses les plus efficaces que vous puissiez faire ».

Cette approche garantit que la notation automatique devient à la fois évolutive et fiable lorsqu'elle est associée à une supervision experte.

L'interopérabilité et la conformité sont également devenues non négociables. Les outils qui prennent en charge plusieurs backends d'inférence permettent de tester les performances de diverses configurations matérielles, tandis que les benchmarks de sécurité et les cadres de modération intégrés aident les équipes à répondre aux exigences réglementaires de 2026. Ces mesures de protection sont essentielles pour résoudre des problèmes tels que les préjugés, la toxicité et les problèmes de confidentialité. En adoptant une stratégie d'évaluation continue, les organisations peuvent passer des tests isolés à un processus plus dynamique d'amélioration continue des modèles.

Comme nous l'avons vu, la rédaction de tests ciblés à chaque étape, plutôt que d'attendre la fin du déploiement, permet d'obtenir de meilleurs résultats. Les équipes qui enregistrent les données de développement peuvent identifier les cas limites, utiliser des comparaisons par paires pour une notation LLM-as-a-Judge plus cohérente et créer des boucles de feedback qui transforment les traces d'échec en de précieux ensembles de données de test. Ce « volant de données » transforme l'évaluation d'une tâche ponctuelle en un cycle continu d'amélioration.

L'évaluation RAG (Retrieval-Augmented Generation) joue un rôle crucial dans la compréhension du processus en deux étapes qui sous-tend de nombreuses applications de grands modèles linguistiques (LLM). Ce processus implique de récupérer des informations pertinentes à partir d'une base de connaissances externe, puis de générer des réponses en fonction de ce contexte. En évaluant indépendamment le récupérateur et le générateur, l'évaluation RAG permet d'identifier plus facilement les problèmes, qu'il s'agisse d'informations non pertinentes récupérées ou d'inexactitudes dans la sortie générée. Cette approche simplifie à la fois le débogage et la mise au point.

Des indicateurs tels que pertinence, fidélité, précision, et se rappeler sont essentiels pour garantir que les données récupérées soutiennent la réponse finale et que le modèle représente fidèlement les informations. Ce niveau d'évaluation est particulièrement important pour les tâches qui exigent des connaissances actuelles ou spécialisées, telles que la recherche juridique, le service client ou l'analyse scientifique.

En fin de compte, l'évaluation RAG fournit une compréhension détaillée des performances d'un LLM, garantissant ainsi que les flux de travail produisent des résultats précis et fiables, un facteur essentiel pour déployer avec succès l'IA dans des scénarios pratiques et à enjeux élevés.

Les flux de travail HUMAIN-IN-the-LOOP (HITL) apportent un équilibre précieux à l'évaluation des grands modèles de langage (LLM) en combinant des outils automatisés avec des connaissances humaines d'experts. Bien que les mesures automatisées soient idéales pour détecter rapidement les erreurs évidentes, elles sont souvent insuffisantes lorsqu'il s'agit d'évaluer des aspects plus nuancés, tels que l'exactitude des faits, les problèmes de sécurité ou les performances d'un modèle dans des domaines spécifiques. Des évaluateurs humains interviennent pour combler ces lacunes en proposant des évaluations détaillées et de haute qualité qui aident à établir des points de référence plus fiables et à affiner les critères utilisés pour l'évaluation.

Ces flux de travail sont généralement intégrés aux processus de test et de développement, ce qui permet aux équipes de tester les LLM sur des ensembles de données soigneusement sélectionnés et de découvrir les problèmes potentiels avant le déploiement. Cette combinaison d'automatisation et de contributions d'experts accélère non seulement le processus d'amélioration des modèles, mais garantit également que les évaluations reflètent des scénarios pratiques et réels. Dans des domaines à enjeux élevés tels que les soins de santé, l'implication d'experts est particulièrement cruciale pour garantir que les modèles répondent à des normes strictes en matière de précision, de sécurité et de responsabilité éthique.

Le support multimodèle joue un rôle clé en permettant aux praticiens d'évaluer et de comparer divers grands modèles de langage (LLM) provenant de différents fournisseurs ou architectures au sein d'un cadre unique et unifié. Cette configuration garantit des conditions de test cohérentes et des analyses comparatives reproductibles, offrant aux utilisateurs une compréhension claire des performances des différents modèles lorsqu'ils sont évalués dans des circonstances identiques.

En facilitant les comparaisons côte à côte, l'assistance multimodèle fournit des informations plus détaillées sur les points forts, les limites et l'adéquation de chaque modèle à des tâches spécifiques. Cette approche fournit aux professionnels de l'apprentissage automatique les informations dont ils ont besoin pour prendre des décisions plus intelligentes et rationaliser efficacement leurs flux de travail d'IA.