يتطلب النمو السريع لنماذج اللغات الكبيرة (LLMs) أدوات تقييم دقيقة لضمان الدقة والامتثال والأداء. تستكشف هذه المقالة أفضل منصات تقييم LLM لعام 2026، مع التركيز على قدرتها على تبسيط الاختبار ومراقبة الإنتاج ودمج الملاحظات البشرية. إليك ما تحتاج إلى معرفته:

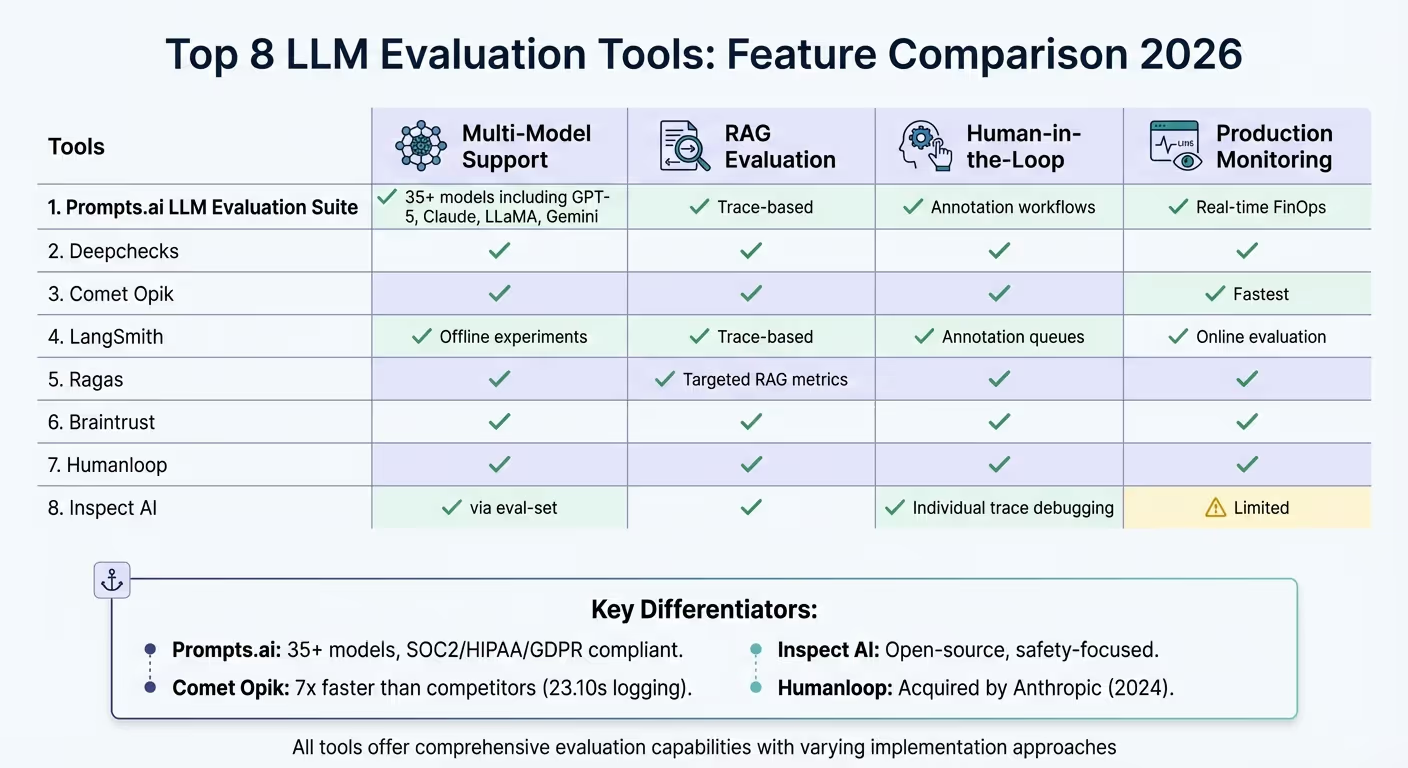

تتناول كل أداة تقلبات LLM وتحديات التقييم بشكل مختلف، وتقدم ميزات مثل التسجيل الآلي، وسير عمل الإنسان في الحلقة، ومراقبة الامتثال. فيما يلي مقارنة سريعة لقدراتهم الرئيسية.

تعمل هذه الأدوات على تمكين الفرق من التحقق من LLMs بشكل فعال، مما يضمن أنظمة ذكاء اصطناعي موثوقة ومتوافقة لصناعات مثل الرعاية الصحية والتمويل وما بعدها.

مقارنة أدوات تقييم LLM: الميزات والقدرات 2026

يعالج برنامج Prompts.ai LLM Evaluation Suite تحديًا كبيرًا: مقارنة نماذج الذكاء الاصطناعي والتحقق منها طوال عملية التطوير بأكملها. تعمل هذه المجموعة وفقًا للمبدأ التوجيهي القائل بأن «هندسة التقييم هي نصف التحدي»، وتبسط العمليات من خلال دمج أكثر من 35 شركة LLM رائدة في واجهة واحدة سهلة الاستخدام. قل وداعًا للتلاعب بالعديد من لوحات المعلومات ومفاتيح واجهة برمجة التطبيقات - تعمل هذه المنصة على تبسيط كل شيء.

من خلال مقارنة النماذج جنبًا إلى جنب، تتيح لك المجموعة اختبار المطالبات المتطابقة عبر مقدمي الخدمات مثل GPT-5 و Claude و Llama و Gemini في الوقت الفعلي. ال تجاوزات المحرك توفر الميزة الدقة من خلال السماح لك بتعديل خطوط أنابيب التقييم وتعديل المعلمات مثل درجة الحرارة أو حدود الرمز المميز لكل تشغيل. وفي الوقت نفسه، فإن منشئ خطوط الأنابيب المرئية - أداة سهلة الاستخدام على غرار جداول البيانات - تتيح للمهندسين وخبراء المجال على حد سواء إنشاء اختبارات A/B معقدة دون كتابة سطر واحد من التعليمات البرمجية.

بالنسبة لأنظمة الجيل المعزز للاسترداد (RAG)، تضمن المنصة الدقة من خلال التحقق من صحة الردود مقابل «مجموعات البيانات الذهبية» المحددة مسبقًا. كما أنها تستخدم تقنيات LLM-as-a-Judge للتحقق من الواقعية والأهمية في سياق معين. تتضمن المجموعة أكثر من 20 نوعًا من الأعمدة للتقييم، بدءًا من مقارنات السلاسل الأساسية وخطافات الويب المخصصة ومقتطفات التعليمات البرمجية، مما يتيح منطق التقييم المخصص لاحتياجات الملكية.

وإدراكًا أن المقاييس وحدها لا يمكنها التقاط الفروق الدقيقة في اللغة، فإن المجموعة تتضمن عمود «HUMAN» للتقدير اليدوي. يمكن للمراجعين تقديم درجات رقمية أو ملاحظات مفصلة أو استخدام أشرطة التمرير لتقييم العناصر الذاتية مثل النغمة أو اتساق العلامة التجارية. بالنسبة لتقييم روبوتات المحادثة، يدعم محاكي المحادثة ما يصل إلى 150 دورة محادثة، ويجمع بين الفحوصات الآلية والإشراف البشري لضمان أداء حوار عالي الجودة ومتعدد الأدوار.

ذا سويت التقييمات الليلية نماذج مميزة لطلبات الإنتاج لتحديد مشكلات الأداء أو انحراف النموذج، في الوقت الفعلي سلاك تنبيهات تبقيك على اطلاع. يضمن تكامل CI/CD الخاص به عدم نشر أي إصدار سريع جديد دون تلبية معايير الجودة. بالنسبة للصناعات ذات اللوائح الصارمة، تم اعتماد المنصة للامتثال لـ SOC2 Type 2 و GDPR و HIPAA و CCPA، وتقدم BaaS للرعاية الصحية. بالإضافة إلى ذلك، فإنه يوفر محاسبة الرموز في الوقت الفعلي وتحليلات التكلفة لإدارة الاستخدام العالي للرموز النموذجية لسير عمل RAG. تدعم مسارات التدقيق الشاملة أيضًا الامتثال التنظيمي والمراجعات الداخلية.

تعالج Deepchecks التحدي المتمثل في تقييم نماذج اللغات الكبيرة (LLMs) من خلال تقديم مقارنات جنبًا إلى جنب لإصدارات النماذج والمطالبات والوكلاء وأنظمة الذكاء الاصطناعي. إنه يدمج نماذج التضمين وقواعد بيانات المتجهات وطرق الاسترجاع في سير عمل موحد، مما يبسط عملية التقييم. يفتح هذا النهج الأبواب لطرق متقدمة لتقييم نماذج متعددة.

تم تصميم Deepchecks للتعامل مع التباين في أداء LLM من خلال دعمها القوي متعدد النماذج. ومن خلال الاستفادة من نماذج اللغات الصغيرة (SLMs) وخطوط أنابيب مزيج الخبراء (MoE)، فإنها تعمل كمعلق ذكي، مما يوفر نقاطًا موضوعية. يضمن هذا النظام مقاييس أداء متسقة عبر مختلف مزودي LLM. يمكن للمستخدمين أيضًا إنشاء مقيّمين بدون تعليمات برمجية باستخدام منطق سلسلة الأفكار لتحليل مقاطع سير العمل المحددة. تم دمج Deepchecks بسلاسة مع AWS إيج ميكر وهو عضو مؤسس لـ إل إم بي إس سبيس، مجتمع عالمي لممارسي LLM.

تتخصص المنصة في تقييم أنظمة الجيل المعزز للاسترجاع (RAG) من خلال تقييم مدى ملاءمة التأريض والاسترجاع. تساعد ميزة Golden Set Management في إنشاء مجموعات اختبار متسقة لقياس إصدارات النماذج المختلفة.

تجمع Deepchecks بين التسجيل الآلي والتجاوزات اليدوية، مما يسمح للخبراء بتحسين مجموعات بيانات الحقيقة الأساسية. تعمل واجهته الخالية من التعليمات البرمجية على تمكين المهنيين غير التقنيين من تحديد معايير التقييم المصممة خصيصًا لاحتياجات العمل المحددة.

تضمن Deepchecks سير العمل السلس للإنتاج من خلال مراقبة مشكلات مثل الهلوسة والمحتوى الضار وفشل خطوط الأنابيب. كما أنها تلتزم بمعايير الامتثال الصارمة، بما في ذلك SOC2 Type 2 و GDPR و HIPAA. تتسم خيارات النشر بالمرونة، بدءًا من SaaS متعددة المستأجرين إلى SaaS للمستأجر الفردي، وCustom On-Prem، وAWS Zero-Friction On-Prem، مما يلبي متطلبات وضع البيانات. للمؤسسات ذات الاحتياجات الأمنية العالية، مثل تلك التي تستخدم سحابة AWS الحكومية، توفر المنصة أدوات تحليل الأسباب الجذرية لتحديد نقاط الضعف واستكشاف الخطوات الفاشلة في تطبيقات LLM وإصلاحها.

تتميز Comet Opik بسرعتها وقدرتها على التكيف في تقييم نماذج اللغات الكبيرة (LLMs). يقوم بتسجيل الآثار والتمدد في 23.10 ثانية فقط ويقدم نتائج التقييم في 0.34 ثانية مثيرة للإعجاب. هذا يجعله أسرع بسبع مرات تقريبًا من أريز فينيكس وأسرع بأربعة عشر مرة من لانغفيوز. ليوناردو جونزاليس، نائب رئيس مركز التميز للذكاء الاصطناعي في ثلاثية، أشادت بكفاءتها:

«عالجت Opik التفاعلات وقدمت المقاييس على الفور تقريبًا بعد التسجيل - وهو تحول سريع بشكل ملحوظ».

تتوافق سرعة Opik مع توافقها الواسع مع الموديلات الرائدة. يتكامل بسلاسة مع منصات مثل أوبن إيه آي، أنثروبيك، بيدروك، و بريديباس. إنها ملعب برومبون يسمح للمستخدمين باختبار النماذج جنبًا إلى جنب، وتعديل المعلمات مثل درجة الحرارة، وتبديل النماذج لمقارنات الأداء في الوقت الفعلي. بالإضافة إلى ذلك، يدعم Opik لجنة تحكيم LLM، مما يتيح لنماذج متعددة تقييم المخرجات بشكل مستقل ودمج درجاتها في مجموع نقاط واحد. حصلت منصتها الأم، Comet-ML، على أكثر من 14000 نجمة على GitHub، مما يسلط الضوء على شعبيتها بين المطورين.

تتفوق Opik في تقييم أنظمة الجيل المعزز للاسترجاع (RAG)، حيث تقدم مقاييس متخصصة للكشف عن الهلوسة، وتقييم مدى ملاءمة الإجابة، وقياس دقة السياق والتذكر. يتتبع النظام الأساسي تلقائيًا خط أنابيب LLM بالكامل، مما يسهل على المطورين تصحيح أخطاء المكونات في إعدادات RAG المعقدة أو إعدادات الوكلاء المتعددين. كما أنه يتكامل مع إطار Ragas. في الآونة الأخيرة، وسعت Opik مكتبتها لتشمل 37 مقياسًا جديدًا، مثل BertScore وتحليل المشاعر.

في حين أن المقاييس الآلية هي نقطة قوة أساسية، فإن Opik تعطي الأولوية أيضًا لمدخلات الخبراء. إنها قوائم انتظار التعليقات التوضيحية تمكين المراجعة اليدوية وتسجيل الآثار من قبل الخبراء. ال درجات التعليقات متعددة القيم تسمح الميزة لأعضاء الفريق بتسجيل نفس التتبع بشكل مستقل، مما يقلل من التحيز ويعزز دقة التقييم. يتم دمج هذه الدرجات اليدوية مع المقاييس الآلية لإنشاء حلقة ملاحظات مستمرة لتحسين أداء النموذج.

شركة أوبيك قواعد التقييم عبر الإنترنت تقدم خيارات أخذ العينات القابلة للتكوين (10٪ -100٪) وتتضمن ميزات مثل تنقيح معلومات تحديد الهوية الشخصية. تنبيهات في الوقت الحقيقي عبر Slack و واجب جهاز الاستدعاء قم بإخطار الفرق بتجاوزات التكلفة أو مشكلات وقت الاستجابة أو الأخطاء. كمنصة مفتوحة المصدر، توفر Opik فئة مجانية سخية دون الحاجة إلى بطاقة ائتمان. بالنسبة للمؤسسات، فإنه يوفر ميزات قابلية التوسع والتوافق الإضافية المصممة خصيصًا لاحتياجات الصناعة.

يتكامل LangSmith بسلاسة مع لانج تشين النظام البيئي مع الحفاظ على المرونة الكافية للعمل مع الأطر الأخرى. إنه يلتقط آثار متداخلة عبر عمليات سير العمل المعقدة، مما يسمح للمطورين بتحديد المشكلات وإصلاحها في مجالات مثل الاسترجاع أو استدعاء الأدوات أو الإنشاء.

شركة لانج سميث ملعب برومبون يمكّن المطورين من اختبار العديد من LLMs، مثل OpenAI و Anthropic، جنبًا إلى جنب. تعمل هذه الميزة على تسهيل تقييم عوامل مثل الجودة والتكلفة ووقت الاستجابة. مع تقييم التجربة أداة، يمكن للمستخدمين تشغيل نماذج مختلفة أو إصدارات سريعة مقابل نفس مجموعة البيانات المنسقة، مما يوفر مقارنة واضحة للنتائج. تدعم المنصة أيضًا مقيّمو المقارنة الزوجية، حيث يقوم إما خبير LLM-AS-a-Judge أو مراجع بشري بتسجيل مخرجات من نموذجين في تقييم مباشر. بالإضافة إلى ذلك، فإن الفتحات تسمح الحزمة للفرق بتصميم مقيّمين حياديين للنماذج باستخدام نماذج مختلفة لتقييم أداء التطبيق، مما يضمن المرونة عند العمل مع مزودين مختلفين.

يتجاوز LangSmith مقارنات النماذج البسيطة، حيث يقدم أدوات متقدمة لتقييم أنظمة RAG.

يوفر LangSmith رؤى مفصلة حول أنظمة RAG من خلال تتبع كل خطوة من خطوات عملية الاسترجاع. يمكن للفرق القياس أهمية الاسترجاع (ما إذا تم تحديد المستندات الصحيحة) و دقة الإجابة (مدى اكتمال الردود وصحتها). باستخدام نهج قائم على التتبع، يحدد LangSmith بالضبط أين ينهار سير العمل، ويزيل التخمين من تصحيح خطوط أنابيب الاسترجاع المعقدة.

بالإضافة إلى التقييمات التفصيلية، توفر المنصة مراقبة قوية للإنتاج لضمان عمليات سلسة.

شركة لانج سميث قوائم انتظار التعليقات التوضيحية تمكين عمليات سير العمل المنظمة حيث يمكن لخبراء الموضوع مراجعة ردود التطبيق وتسجيلها والتعليق عليها. كما يسلط لانجتشين الضوء على:

«غالبًا ما توفر التغذية الراجعة البشرية التقييم الأكثر قيمة، خاصة لأبعاد الجودة الذاتية».

عندما يقوم المُقيِّمون الآليون أو تعليقات المستخدمين بالإبلاغ عن آثار الإنتاج، يتم توجيهها إلى الخبراء لمراجعتها. ثم يتم تحويل الآثار المشروحة إلى مجموعات بيانات «المعيار الذهبي» للاختبار المستقبلي، مما يعزز قدرات النظام بمرور الوقت.

تراقب LangSmith المقاييس الرئيسية مثل وقت الاستجابة على مستوى الطلب واستخدام الرمز المميز وإسناد التكلفة في الوقت الفعلي. إنها المقيّمون عبر الإنترنت السماح للفرق بأخذ عينات من أجزاء محددة من حركة المرور، مثل 10٪، لموازنة الرؤية مع التكلفة، ودعم ما يصل إلى 500 سلسلة تم تقييمها في وقت واحد خلال نافذة مدتها خمس دقائق. يضمن هذا التتبع في الوقت الفعلي معالجة مشكلات الإنتاج بسرعة وكفاءة.

تلبي المنصة معايير الأمان على مستوى المؤسسة، وتحافظ على التوافق مع معايير HIPAA وSOC 2 من النوع 2 واللائحة العامة لحماية البيانات. تضيف عمليات الفحص الآلية، بما في ذلك فلاتر الأمان والتحقق من التنسيق واستدلال الجودة، طبقة إضافية من الحماية. تساعد التنبيهات الأساسية للأخطاء وتصاعد وقت الاستجابة الفرق على الاستجابة الفورية للحوادث. يستخدم LangSmith نموذج التسعير لكل تتبع، مع توفر فئة مجانية، على الرغم من أن التكاليف يمكن أن ترتفع بشكل كبير بالنسبة لأحجام الإنتاج العالية.

تركز شركة Ragas، التي تأسست في عام 2023، على تقييم خطوط أنابيب RAG (الجيل المعزز للاسترجاع). تم إنشاؤه من خلال بحث حول طرق التقييم غير المرجعية نُشر في وقت سابق من ذلك العام، وهو يفصل بين تحليل أداء مكونات المسترد والمولد. يساعد هذا التمييز الفرق على تحديد ما إذا كانت المشكلات تنشأ عن استرجاع البيانات المعيبة أو الهلوسة في نموذج اللغة، بما يتماشى مع الموضوع الأوسع للأدوات المتخصصة للتقييم.

تقدم Ragas مقاييس مستهدفة لكل من عمليات الاسترجاع والتوليد. بالنسبة للاسترجاع، فإنه يقيس:

على جانب الجيل، يقوم بتقييم:

يعمل هذا النهج الدقيق على تبسيط عملية تصحيح أخطاء سير عمل RAG المعقدة. على سبيل المثال، في معيار أغسطس 2025، قفزت دقة النموذج من 50٪ إلى 90٪ بعد معالجة مشكلات مثل تكديس القواعد الفائتة وشروط الحدود.

استخدام «ماجستير في القانون كقاضي» المنهجية، تقوم Ragas بتوليد درجات كمية، مما يقلل من الحاجة إلى ملصقات الحقيقة الأرضية اليدوية. كما أنه يدعم توليد بيانات الاختبارات الاصطناعية، مع توصيات للبدء بـ 20-30 عينة وتوسيع النطاق حتى 50-100 للحصول على نتائج أكثر موثوقية.

يتكامل Ragas بسلاسة مع العديد من مزودي LLM، بما في ذلك OpenAI و Anthropic (Claude) و Google (Gemini) والنماذج المحلية عبر Ollama. إنه يضمن إمكانية التكرار من خلال السماح للفرق بقفل إصدارات نموذجية معينة (على سبيل المثال، «gpt-4o-2024-08-06") أثناء القياس، حتى عندما يقوم مقدمو الخدمة بتحديث نماذجهم. بالإضافة إلى ذلك، فإن الأداة قابلة للتوسعة بدرجة كبيرة، مما يتيح المقاييس المخصصة من خلال مصممي الديكور مثل @discrete_metric، والتي يمكن استخدامها لمهام مثل التحقق من JSON.

على الرغم من أن Ragas تؤكد على المقاييس الآلية، إلا أنها تتضمن الإشراف البشري لمزيد من الموثوقية. يتضمن الإطار واجهة مستخدم للتعليق التوضيحي المتري، مما يسمح للمستخدمين بالإضافة ملاحظات التقدير لاختبار مجموعات البيانات وتحديد معايير التقييم الخاصة بالإنسان. يتضمن كل تقييم أيضًا سبب النتيجة مجال للشفافية وقابلية التدقيق. كما تقول وثائق Ragas:

«Ragas هي مكتبة تساعدك على الانتقال من» فحوصات الحالة «إلى حلقات التقييم المنهجية لتطبيقات الذكاء الاصطناعي الخاصة بك».

يضمن هذا المزيج من التسجيل الآلي والمدخلات البشرية مراقبة الأداء الصارمة، حتى في البيئات الديناميكية.

تعمل Ragas على توسيع قدراتها لتشمل مراقبة الإنتاج من خلال التكامل مع منصات المراقبة مثل Langfuse و Arize. وهذا يسمح بتسجيل آثار الإنتاج في الوقت الفعلي. مقاييسها الخالية من المراجع، مثل الإخلاص للكشف عن الهلوسة، تكون مفيدة بشكل خاص في البيئات الحية حيث لا تتوفر إجابات الحقيقة الأساسية دائمًا. يدعم الإطار أيضًا التكامل في خطوط أنابيب CI/CD، مما يتيح التقييم المستمر لضمان تلبية التحديثات لمعايير الأداء والسلامة. يمكن للفرق اختيار تسجيل كل أثر أو استخدام أخذ عينات دفعية دورية لموازنة التكاليف مع الحفاظ على نظرة ثاقبة لسلوك النموذج.

تمزج Braintrust التقييم ومراقبة الإنتاج مباشرة في تدفقات العمل الهندسية القياسية، مما يضمن عملية سلسة وفعالة.

يعمل ملعب Braintrust المستند إلى الويب على تمكين الفرق من مقارنة النماذج جنبًا إلى جنب، مما يجعل القرارات القائمة على البيانات أسهل. باستخدام Playground، يمكن للمستخدمين ضبط المطالبات والتبديل بين النماذج وإجراء التقييمات بسلاسة. تسلط المقارنات جنبًا إلى جنب الضوء على أداء النموذج بناءً على مطالبات متطابقة، مما يوفر رؤى واضحة. تتكامل المنصة مع إجراءات GitHub، وتقوم بتشغيل التقييمات تلقائيًا مع كل التزام، ومقارنة النتائج بخطوط الأساس ومنع عمليات الدمج في حالة انخفاض الجودة. يتضمن Braintrust أكثر من 25 هدافًا مدمجًا لقياس المقاييس الرئيسية مثل الواقعية والملاءمة والسلامة، مع السماح أيضًا بتحديد درجات مخصصة - سواء من خلال التعليمات البرمجية أو من خلال الاستفادة من LLM-as-a-judge. إلى جانب المقاييس الآلية، تؤكد المنصة على أهمية مراجعات الخبراء.

لدمج الخبرة البشرية، تتميز Braintrust بسير عمل «Annotate» الخاص بها. يتيح ذلك للفرق إعداد عمليات المراجعة وتطبيق الملصقات وتحسين مخرجات النموذج. تسمح واجهته الخالية من التعليمات البرمجية لمديري المنتجات وخبراء المجال بوضع نماذج أولية للمطالبات ومراجعة النتائج بسهولة. من خلال الجمع بين التسجيل الآلي والملاحظات البشرية، تلتقط المنصة التفاصيل الدقيقة التي قد تغفلها الخوارزميات. بالإضافة إلى ذلك، يحدد عامل الذكاء الاصطناعي «Loop» أنماط الفشل ويعرض الرؤى من سجلات الإنتاج. يعكس هذا التكامل للمدخلات البشرية مبادئ التنمية الحديثة القائمة على التقييم. شارك لي ويسبرغر من Airtable:

«يبدأ كل مشروع جديد للذكاء الاصطناعي بالتقييم في Braintrust - إنه يغير قواعد اللعبة.»

تعمل Braintrust على توسيع قدراتها لتشمل بيئات الإنتاج الحية، وتقييم حركة المرور باستمرار باستخدام نفس مقاييس الجودة المطبقة أثناء التطوير. يتتبع استخدام الرمز المميز بالتفصيل - حسب المستخدم والميزة والمحادثة - لاكتشاف الأنماط المكلفة مبكرًا، مما يساعد الفرق على إدارة الميزانيات بفعالية. توفر المنصة أيضًا أداءً استثنائيًا، حيث توفر بحثًا أسرع عن النص الكامل بمعدل 23.9 مرة (401 مللي ثانية مقابل 9587 مللي ثانية) ووقت استجابة أسرع للكتابة بمقدار 2.55 مرة. سارة ساكس، رائدة الهندسة في الفكرة، لاحظ:

«لقد غيرت Brainstore تمامًا كيفية تفاعل فريقنا مع السجلات. لقد تمكنا من اكتشاف الإحصاءات من خلال إجراء عمليات بحث في ثوانٍ كانت تستغرق ساعات في السابق».

بالنسبة للمؤسسات ذات الاحتياجات الصارمة لسيادة البيانات، توفر Braintrust خيارات الاستضافة الذاتية وهي حاصلة على شهادة SOC 2 Type II، مما يضمن الامتثال والأمان.

ملاحظة: تعكس الميزات المستقلة لـ Humanloop قدرات المنصة قبل الاستحواذ عليها من قبل Anthropic في أواخر عام 2024. وقد شكلت هذه الوظائف السابقة نهج التقييم المتكامل التي نراها اليوم، مما يسلط الضوء على تطور ممارسات التنمية القائمة على التقييم.

قامت Humanloop بسد الفجوة بين المهندسين والمتعاونين غير التقنيين، حيث قدمت مساحة عمل مشتركة حيث يمكن لمديري المنتجات والفرق القانونية والخبراء المتخصصين المشاركة بنشاط في الهندسة والتقييم الفوريين - دون الحاجة إلى جداول بيانات مرهقة. فيما يلي نظرة فاحصة على كيفية تبسيط Humanloop لسير عمل التقييم.

سمحت Humanloop للفرق بمقارنة النماذج الأساسية المختلفة جنبًا إلى جنب باستخدام مجموعة بيانات واحدة. وشمل ذلك نماذج من OpenAI (GPT-4o و GPT-4O-mini)، وكلود 3.5 سونيت من أنثروبيك، وجوجل، وخيارات المصدر المفتوح مثل الميسترال ريح شمالية. قدمت مخططات Spider تصورًا واضحًا للمقايضات بين عوامل مثل التكلفة ووقت الاستجابة ورضا المستخدم. على سبيل المثال، وثق أحد التقييمات أن GPT-4o يوفر مستوى أعلى من رضا المستخدمين ولكن بتكلفة أعلى وسرعة أبطأ. بالإضافة إلى ذلك، مكنت ميزة التخزين المؤقت للسجلات في المنصة الفرق من إعادة استخدام السجلات لمجموعات بيانات ومطالبات محددة، مما أدى إلى تقليل الوقت والنفقات أثناء التقييمات. تناولت هذه الميزة التحديات التي يطرحها الأداء المتغير لنماذج اللغات الكبيرة، وهي مشكلة شائعة في أطر التقييم الحديثة.

بالنسبة لحالات استخدام الجيل المعزز للاسترداد (RAG)، قدمت Humanloop قوالب مبنية مسبقًا. تضمنت هذه النماذج مقيّمي الذكاء الاصطناعي كقاضٍ مصممون للتحقق من الدقة الواقعية وضمان ملاءمة السياق.

مكنت واجهة المنصة الخبراء من مراجعة السجلات وتقديم ملاحظات ثنائية أو فئوية أو نصية وإضافة ملاحظات الدرجات لتحسين معايير التقييم. أبلغت الفرق عن توفير 6-8 ساعات هندسية كل أسبوع بفضل تدفقات العمل المبسطة هذه. دعمت Humanloop كلاً من الاختبار دون اتصال بالإنترنت لقياس الإصدارات الجديدة والمراقبة عبر الإنترنت لمراجعة بيانات الإنتاج المباشر.

تفوقت Humanloop أيضًا في مراقبة الإنتاج، ودمج التقييمات في خطوط أنابيب CI/CD لاكتشاف الانحدارات قبل النشر. قام المُقيِّمون الآليون عبر الإنترنت بمراقبة سجلات الإنتاج المباشر وتتبع اتجاهات الأداء وإطلاق التنبيهات لأي انخفاضات في الأداء. دانييلي ألفاروني، المدير الأول للهندسة في ديكسا، شددت على أهمية المنصة:

«نحن لا نتخذ أي قرارات جديدة لنشر LLM قبل تقييم النماذج الجديدة عبر Humanloop أولاً. يمتلك الفريق مقاييس أداء التقييم التي تمنحهم الثقة.»

كما دعمت المنصة الأمان على مستوى المؤسسات من خلال التحكم في الإصدار والتوافق مع SOC-2 وخيارات الاستضافة الذاتية.

يتبع Inspect AI، الذي أنشأه معهد أمن الذكاء الاصطناعي في المملكة المتحدة، نهجًا قائمًا على البحث لتقييم نماذج اللغات الكبيرة (LLMs)، مع التركيز على السلامة والأمن. يضمن ترخيص MIT مفتوح المصدر إمكانية الوصول للفرق المخصصة لاختبار التطوير الشامل. يتضمن الإطار أكثر من 100 تقييم تم إنشاؤه مسبقًا، ويغطي مجالات مثل الترميز والتفكير والمهام الوكيلة والفهم متعدد الوسائط.

مع مجموعة متساوية يسمح الأمر، Inspect AI للمستخدمين بتشغيل مهمة تقييم واحدة عبر نماذج متعددة في وقت واحد، مع الاستفادة من التنفيذ المتوازي لتوفير الوقت في قياس الأداء. وهو يدعم مجموعة من مقدمي الخدمات، بما في ذلك OpenAI، وأنثروبيك، وجوجل، وميسترال، وجه معانق، والنماذج المحلية عبر VLLM أو أوباما. من خلال إلحاق اسم الموفر بمعرف النموذج، يمكن للمستخدمين مقارنة الأداء والسرعة والتكلفة عبر موفري الاستدلال المختلفين. سياسات الاختيار الآلي، مثل :أسرع أو :أرخص، يعمل على زيادة تبسيط التقييمات من خلال توجيه المهام إلى المزود الأكثر كفاءة استنادًا إلى الإنتاجية والتكلفة. على سبيل المثال، في معيار واحد، gpt-oss-120b أظهر النموذج دقة متفاوتة، حيث سجل كل من Hyperbolic 0.84، بينما سجل كل من Groq و Sambanova 0.80. يتم تعزيز قدرة المقارنة متعددة النماذج هذه من خلال الإشراف البشري لضمان التحقق الدقيق من الأداء.

بالإضافة إلى المعايير الآلية، يدمج Inspect AI التقييم البشري لإنشاء خطوط أساس للأداء مقابل القدرات البشرية في المهام الحسابية. تعمل أداة حل العوامل الخاصة بها على تسهيل هذه العملية، بينما تسمح ميزة الموافقة على الأدوات للبشر بمراجعة مكالمات الأدوات التي تجريها النماذج أثناء التقييمات والموافقة عليها. للحصول على رؤى في الوقت الفعلي، توفر أداة الويب Inspect View وVS Code Extension تصورًا لمسارات التقييم، مما يتيح تحليل الأخطاء اليدوي وتصحيح الأخطاء. يسلط معهد أمن الذكاء الاصطناعي في المملكة المتحدة الضوء على قدرة الإطار على التكيف:

«يمكن استخدام الفحص لمجموعة واسعة من التقييمات التي تقيس الترميز والمهام الوكيلة والمنطق والمعرفة والسلوك والفهم متعدد الوسائط».

على الرغم من أنها مصممة بشكل أساسي للاختبار والتطوير، إلا أن Inspect AI تتفوق أيضًا في السلامة والامتثال. نظام ساندبوكسينغ الخاص به - متوافق مع عامل ميناء، كوبيرنيتيس، مودال، و بروكسموإكس - يسمح بتشغيل التعليمات البرمجية غير الموثوق بها التي تم إنشاؤها بواسطة النموذج في بيئات معزولة. في الوقت نفسه، يتطلب الأمر إذنًا بشريًا لاستدعاءات الأدوات الهامة، وهي ميزة أساسية لتقييم سير عمل الوكيل في السيناريوهات عالية المخاطر. وتعكس هذه الإجراءات تركيز المنصة القوي على الاختبارات الآمنة والموثوقة، بما يتماشى مع أفضل الممارسات الصناعية لسلامة وأمن الذكاء الاصطناعي.

اختر أفضل أداة تقييم LLM من خلال تقييم الميزات الأساسية مثل التوافق متعدد النماذج وتقييم RAG وسير عمل الإنسان في الحلقة ومراقبة الإنتاج.

فيما يلي تفصيل لهذه الإمكانات عبر منصات مختلفة:

في حين أن معظم الأدوات تدعم جميع القدرات الأربعة، تختلف طرق تنفيذها. على سبيل المثال، افحص الذكاء الاصطناعي يركز على المراجعة اليدوية مع تصحيح أخطاء التتبع الفردي، مما يجعله أكثر ملاءمة لاختبار التطوير ولكنه يوفر مراقبة محدودة للإنتاج.

لا يتعلق اختيار أداة تقييم LLM المناسبة في عام 2026 بمطاردة الخيار الأكثر كثافة بالميزات - بل يتعلق بمواءمة إمكانيات الأداة مع سير العمل الفريد الخاص بك. سواء كان تركيزك على خطوط أنابيب CI/CD مع تكامل Pytest الأصلي، أو أنظمة الإنتاج التي تتطلب المراقبة في الوقت الفعلي، أو تطبيقات RAG التي تحتاج إلى تحليل قائم على التتبع، يجب أن تتكامل الأداة المثالية بسلاسة مع البنية التحتية الحالية لديك. يؤكد هذا التركيز على الوظائف المصممة على الأهمية المتزايدة للتقييم القائم على المقاييس.

لم يعد تحول الصناعة من التقييمات الذاتية إلى المقاييس القائمة على البيانات اختياريًا - إنه ضروري لبيئات الإنتاج. يسلط OpenAI الضوء على هذه النقطة:

«إذا كنت تقوم بالبناء باستخدام LLMs، فإن إنشاء تقييمات عالية الجودة هو أحد أكثر الأشياء تأثيرًا التي يمكنك القيام بها».

يضمن هذا النهج أن يصبح التسجيل الآلي قابلاً للتطوير ويمكن الاعتماد عليه عند دمجه مع إشراف الخبراء.

كما أصبحت قابلية التشغيل البيني والامتثال غير قابلة للتفاوض. تسمح الأدوات التي تدعم الخلفيات الاستدلالية المتعددة باختبار الأداء عبر إعدادات الأجهزة المتنوعة، بينما تساعد معايير السلامة المضمنة وأطر الإشراف الفرق على تلبية المتطلبات التنظيمية لعام 2026. هذه الضمانات ضرورية لمعالجة قضايا مثل التحيز والسمية ومخاوف الخصوصية. من خلال اعتماد استراتيجية التقييم المستمر، يمكن للمؤسسات التحول من الاختبار المعزول إلى عملية أكثر ديناميكية للتحسين المستمر للنموذج.

كما تمت مناقشته، فإن كتابة اختبارات محددة النطاق في كل مرحلة - بدلاً من الانتظار حتى ما بعد النشر - تؤدي إلى نتائج أفضل. يمكن للفرق التي تسجل بيانات التطوير تحديد الحالات المتطورة، واستخدام المقارنات الزوجية للحصول على درجات أكثر اتساقًا في LLM-as-a-judge، وإنشاء حلقات التغذية الراجعة التي تحول الآثار الفاشلة إلى مجموعات بيانات اختبار قيمة. تعمل «دولاب الموازنة» هذا على تحويل التقييم من مهمة لمرة واحدة إلى دورة مستمرة من التحسين.

يلعب تقييم RAG (الجيل المعزز للاسترجاع) دورًا مهمًا في فهم العملية المكونة من خطوتين وراء العديد من تطبيقات نماذج اللغة الكبيرة (LLM). تتضمن هذه العملية استرداد المعلومات ذات الصلة من قاعدة معارف خارجية ثم توليد ردود بناءً على هذا السياق. من خلال تقييم المسترد والمولد بشكل مستقل، فإن تقييم RAG يجعل من السهل تحديد المشكلات، سواء كانت معلومات غير ذات صلة يتم استردادها أو عدم دقة في المخرجات الناتجة. يعمل هذا الأسلوب على تبسيط كل من التصحيح والضبط الدقيق.

مقاييس مثل الصلة، الإخلاص، الدقة، و تذكر هي المفتاح لضمان أن البيانات المستردة تدعم الاستجابة النهائية وأن النموذج يمثل المعلومات بدقة. هذا المستوى من التقييم مهم بشكل خاص للمهام التي تتطلب معرفة حالية أو متخصصة، مثل البحث القانوني أو خدمة العملاء أو التحليل العلمي.

في نهاية المطاف، يوفر تقييم RAG فهمًا تفصيليًا لمدى جودة أداء LLM، مما يضمن أن سير العمل ينتج نتائج دقيقة ويمكن الاعتماد عليها - وهو عامل أساسي لنشر الذكاء الاصطناعي بنجاح في سيناريوهات عملية عالية المخاطر.

توفر عمليات سير عمل Human-in-the-Loop (HITL) توازنًا قيمًا لتقييم نماذج اللغات الكبيرة (LLMs) من خلال مزج الأدوات الآلية مع الرؤى البشرية الخبيرة. على الرغم من أن المقاييس الآلية رائعة لاكتشاف الأخطاء الواضحة بسرعة، إلا أنها غالبًا ما تفشل عندما يتعلق الأمر بتقييم الجوانب الأكثر دقة، مثل الدقة الواقعية أو مخاوف السلامة أو مدى جودة أداء النموذج في مجالات محددة. يتدخل المراجعون البشريون لمعالجة هذه الثغرات، ويقدمون تقييمات مفصلة وعالية الجودة تساعد في وضع معايير أكثر موثوقية وتحسين المعايير المستخدمة للتقييم.

عادةً ما يتم تضمين عمليات سير العمل هذه في عمليات الاختبار والتطوير، مما يمكّن الفرق من اختبار LLMs على مجموعات بيانات مختارة بعناية والكشف عن المشكلات المحتملة قبل النشر. لا يؤدي هذا المزيج من الأتمتة ومدخلات الخبراء إلى تسريع عملية تحسين النماذج فحسب، بل يضمن أيضًا أن التقييمات تعكس سيناريوهات عملية في العالم الحقيقي. في المجالات عالية المخاطر مثل الرعاية الصحية، تعد مشاركة الخبراء أمرًا بالغ الأهمية لضمان تلبية النماذج للمعايير الصارمة للدقة والسلامة والمسؤولية الأخلاقية.

يلعب الدعم متعدد النماذج دورًا رئيسيًا في تمكين الممارسين من تقييم ومقارنة نماذج اللغات الكبيرة المختلفة (LLMs) من مختلف مقدمي الخدمات أو البنى ضمن إطار واحد وموحد. يضمن هذا الإعداد ظروف اختبار متسقة وقياسات قابلة للتكرار، مما يوفر للمستخدمين فهمًا واضحًا لكيفية أداء النماذج المختلفة عند تقييمها في ظل ظروف مماثلة.

من خلال تسهيل المقارنات جنبًا إلى جنب، يوفر الدعم متعدد النماذج رؤى أعمق حول نقاط القوة والقيود والملاءمة لكل نموذج لمهام محددة. يعمل هذا النهج على تزويد محترفي التعلم الآلي بالمعلومات التي يحتاجون إليها لاتخاذ قرارات أكثر ذكاءً وتبسيط سير عمل الذكاء الاصطناعي بكفاءة.