बड़े भाषा मॉडल (एलएलएम) का तेजी से विकास सटीकता, अनुपालन और प्रदर्शन सुनिश्चित करने के लिए सटीक मूल्यांकन उपकरणों की मांग करता है। यह लेख 2026 के लिए शीर्ष एलएलएम मूल्यांकन प्लेटफार्मों की खोज करता है, जो परीक्षण को कारगर बनाने, उत्पादन की निगरानी करने और मानव प्रतिक्रिया को एकीकृत करने की उनकी क्षमता पर ध्यान केंद्रित करता है। यहां बताया गया है कि आपको क्या जानना चाहिए:

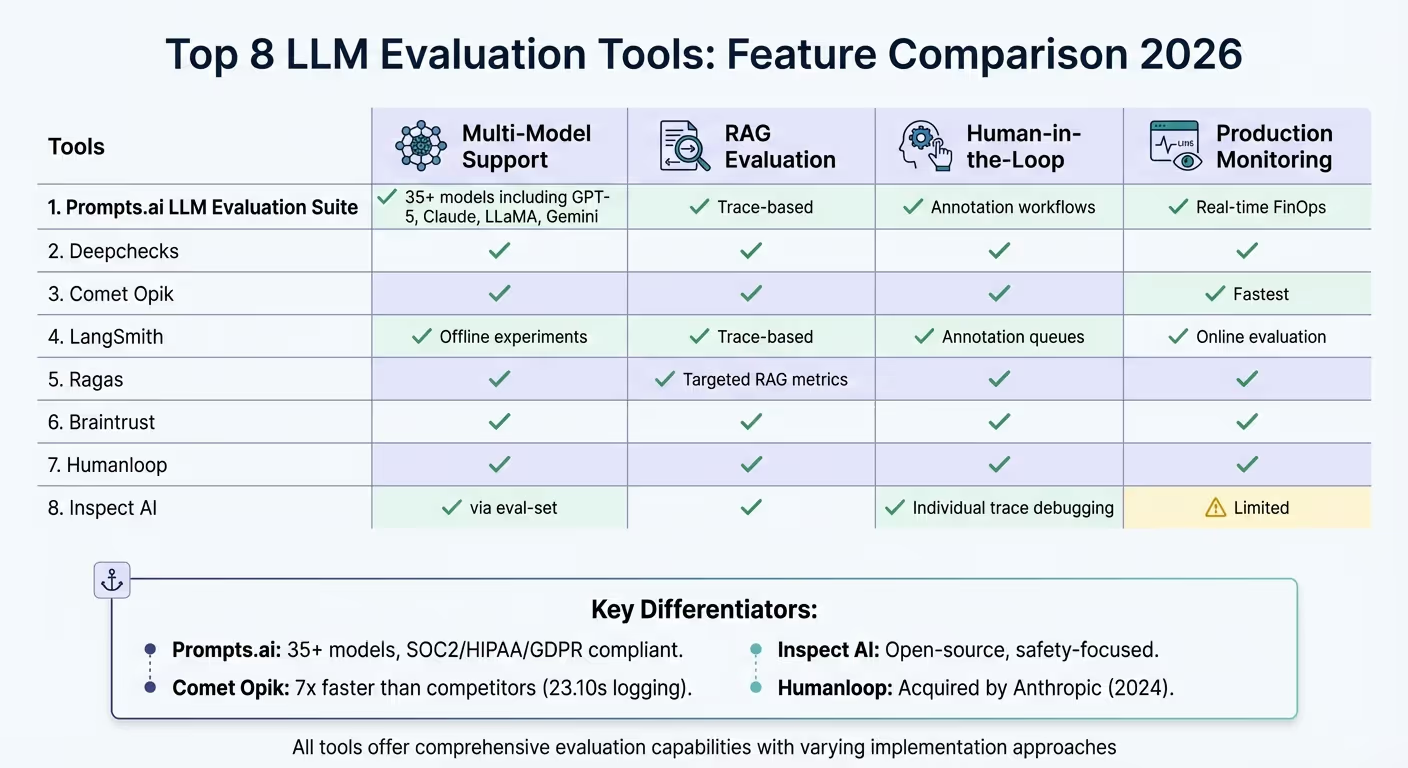

प्रत्येक उपकरण एलएलएम परिवर्तनशीलता और मूल्यांकन चुनौतियों को अलग तरह से संबोधित करता है, स्वचालित स्कोरिंग, मानव-इन-द-लूप वर्कफ़्लोज़ और अनुपालन निगरानी जैसी सुविधाएँ प्रदान करता है। नीचे उनकी प्रमुख क्षमताओं की त्वरित तुलना की गई है।

ये उपकरण एलएलएम को प्रभावी ढंग से मान्य करने के लिए टीमों को सशक्त बनाते हैं, जिससे स्वास्थ्य सेवा, वित्त और उससे आगे के उद्योगों के लिए विश्वसनीय और अनुरूप एआई सिस्टम सुनिश्चित होते हैं।

एलएलएम मूल्यांकन उपकरण तुलना: सुविधाएँ और क्षमताएं 2026

Prompts.ai LLM इवैल्यूएशन सूट एक महत्वपूर्ण चुनौती का समाधान करता है: संपूर्ण विकास प्रक्रिया के दौरान AI मॉडल की तुलना करना और उन्हें मान्य करना। “मूल्यांकन इंजीनियरिंग आधी चुनौती है” के मार्गदर्शक सिद्धांत के तहत काम करते हुए, यह सूट 35 से अधिक प्रमुख एलएलएम को एकल, उपयोग में आसान इंटरफ़ेस में समेकित करके संचालन को सुव्यवस्थित करता है। कई डैशबोर्ड और API कुंजियों को जोड़ने को अलविदा कहें - यह प्लेटफ़ॉर्म हर चीज़ को सरल बनाता है।

इसकी साइड-बाय-साइड मॉडल तुलना के साथ, सुइट आपको वास्तविक समय में GPT-5, क्लाउड, लामा और जेमिनी जैसे प्रदाताओं के समान संकेतों का परीक्षण करने की अनुमति देता है। द इंजन ओवरराइड यह सुविधा आपको मूल्यांकन पाइपलाइनों में बदलाव करने, प्रत्येक रन के लिए तापमान या टोकन सीमा जैसे मापदंडों को समायोजित करने की सुविधा देकर सटीकता प्रदान करती है। इस बीच, विजुअल पाइपलाइन बिल्डर - उपयोगकर्ता के अनुकूल, स्प्रेडशीट-स्टाइल टूल - इंजीनियरों और डोमेन विशेषज्ञों के लिए समान रूप से कोड की एक पंक्ति लिखे बिना जटिल A/B परीक्षण बनाना संभव बनाता है।

पुनर्प्राप्ति-संवर्धित पीढ़ी (RAG) सिस्टम के लिए, प्लेटफ़ॉर्म पूर्वनिर्धारित “गोल्डन डेटासेट” के खिलाफ प्रतिक्रियाओं को मान्य करके सटीकता सुनिश्चित करता है। यह दिए गए संदर्भ में तथ्यात्मकता और प्रासंगिकता को सत्यापित करने के लिए एलएलएम-ए-जज तकनीकों का भी उपयोग करता है। सुइट में मूल्यांकन के लिए 20 से अधिक कॉलम प्रकार शामिल हैं, जिनमें मूल स्ट्रिंग तुलनाओं से लेकर कस्टम वेबहुक और कोड स्निपेट शामिल हैं, जो मालिकाना जरूरतों के लिए अनुकूलित मूल्यांकन तर्क को सक्षम करते हैं।

यह समझते हुए कि अकेले मेट्रिक्स भाषा की बारीकियों को कैप्चर नहीं कर सकते हैं, सुइट में मैन्युअल ग्रेडिंग के लिए “HUMAN” कॉलम शामिल है। समीक्षक संख्यात्मक स्कोर, विस्तृत फ़ीडबैक प्रदान कर सकते हैं या टोन या ब्रांड स्थिरता जैसे व्यक्तिपरक तत्वों का आकलन करने के लिए स्लाइडर्स का उपयोग कर सकते हैं। चैटबॉट मूल्यांकन के लिए, वार्तालाप सिम्युलेटर 150 वार्तालाप टर्न तक का समर्थन करता है, जिसमें उच्च-गुणवत्ता, मल्टी-टर्न संवाद प्रदर्शन सुनिश्चित करने के लिए मानव निरीक्षण के साथ स्वचालित चेक का संयोजन होता है।

सुइट का रात्रिकालीन मूल्यांकन रीयल-टाइम के साथ प्रदर्शन समस्याओं या मॉडल ड्रिफ्ट की पहचान करने के लिए फ़ीचर नमूना उत्पादन अनुरोध स्लैक आपको सूचित रखने के लिए अलर्ट। इसका CI/CD इंटीग्रेशन यह सुनिश्चित करता है कि क्वालिटी बेंचमार्क को पूरा किए बिना कोई नया प्रॉम्प्ट वर्जन तैनात न किया जाए। सख्त नियमों वाले उद्योगों के लिए, प्लेटफ़ॉर्म SOC2 टाइप 2, GDPR, HIPAA और CCPA अनुपालन के लिए प्रमाणित है, और स्वास्थ्य सेवा के लिए BaaS प्रदान करता है। इसके अतिरिक्त, यह RAG वर्कफ़्लो के विशिष्ट उच्च टोकन उपयोग को प्रबंधित करने के लिए रीयल-टाइम टोकन अकाउंटिंग और लागत विश्लेषण प्रदान करता है। व्यापक ऑडिट ट्रेल्स विनियामक अनुपालन और आंतरिक समीक्षाओं का और समर्थन करते हैं।

Deepchecks मॉडल संस्करणों, संकेतों, एजेंटों और AI सिस्टम की साथ-साथ तुलना करके बड़े भाषा मॉडल (LLM) का मूल्यांकन करने की चुनौती से निपटता है। यह मूल्यांकन प्रक्रिया को सुव्यवस्थित करते हुए एम्बेडिंग मॉडल, वेक्टर डेटाबेस और पुनर्प्राप्ति विधियों को एकीकृत वर्कफ़्लो में एकीकृत करता है। यह दृष्टिकोण कई मॉडलों का आकलन करने के लिए उन्नत तरीकों के द्वार खोलता है।

Deepcheck को अपने मजबूत मल्टी-मॉडल समर्थन के माध्यम से LLM प्रदर्शन में परिवर्तनशीलता को संभालने के लिए डिज़ाइन किया गया है। छोटे भाषा मॉडल (SLM) और विशेषज्ञों के मिश्रण (MoE) पाइपलाइनों का लाभ उठाकर, यह एक बुद्धिमान एनोटेटर के रूप में कार्य करता है, जो वस्तुनिष्ठ स्कोरिंग प्रदान करता है। यह प्रणाली विभिन्न एलएलएम प्रदाताओं के बीच लगातार प्रदर्शन मेट्रिक्स सुनिश्चित करती है। उपयोगकर्ता विशिष्ट वर्कफ़्लो सेगमेंट का विश्लेषण करने के लिए चेन-ऑफ-थॉट रीजनिंग के साथ नो-कोड मूल्यांकनकर्ता भी बना सकते हैं। Deepcheck को मूल रूप से इसके साथ एकीकृत किया गया है एडब्ल्यूएस सेजमेकर और के संस्थापक सदस्य हैं एलएलएमओपीएस. स्पेस, एलएलएम चिकित्सकों के लिए एक वैश्विक समुदाय।

प्लेटफ़ॉर्म ग्राउंडेडनेस और रिट्रीवल प्रासंगिकता का आकलन करके रिट्रीवल-ऑगमेंटेड जेनरेशन (RAG) सिस्टम का मूल्यांकन करने में माहिर है। इसका गोल्डन सेट मैनेजमेंट फीचर विभिन्न मॉडल संस्करणों को बेंचमार्क करने के लिए लगातार टेस्ट सेट बनाने में मदद करता है।

Deepcheck मैन्युअल ओवरराइड के साथ स्वचालित स्कोरिंग को जोड़ती है, जिससे विशेषज्ञ ग्राउंड ट्रुथ डेटासेट को परिष्कृत कर सकते हैं। इसका नो-कोड इंटरफ़ेस गैर-तकनीकी पेशेवरों को विशिष्ट व्यावसायिक आवश्यकताओं के अनुरूप मूल्यांकन मानदंडों को परिभाषित करने का अधिकार देता है।

डीपचेक मतिभ्रम, हानिकारक सामग्री और पाइपलाइन विफलताओं जैसे मुद्दों की निगरानी करके सुचारू उत्पादन कार्यप्रवाह सुनिश्चित करता है। यह सख्त अनुपालन मानकों का भी पालन करता है, जिसमें SOC2 टाइप 2, GDPR और HIPAA शामिल हैं। परिनियोजन विकल्प लचीले होते हैं, जिनमें मल्टी-टेनेंट SaaS से लेकर सिंगल-टेनेंट SaaS, कस्टम ऑन-प्रेम और AWS ज़ीरो-फ्रिक्शन ऑन-प्रेम शामिल हैं, जो डेटा रेजीडेंसी आवश्यकताओं को पूरा करते हैं। उच्च सुरक्षा आवश्यकताओं वाले संगठनों के लिए, जैसे कि उपयोग करने वाले संगठनों के लिए एडब्ल्यूएस गोवक्लाउड, प्लेटफ़ॉर्म कमजोर बिंदुओं की पहचान करने और एलएलएम अनुप्रयोगों में असफल चरणों का निवारण करने के लिए मूल कारण विश्लेषण उपकरण प्रदान करता है।

धूमकेतु ओपिक बड़े भाषा मॉडल (एलएलएम) के मूल्यांकन में अपनी गति और अनुकूलन क्षमता के लिए सबसे अलग है। यह केवल 23.10 सेकंड में ट्रेस और स्पैन को लॉग करता है और प्रभावशाली 0.34 सेकंड में मूल्यांकन परिणाम देता है। यह इसे इससे लगभग सात गुना तेज बनाता है अराइज़ फ़ीनिक्स और उससे चौदह गुना तेज लैंगफ्यूज। लियोनार्डो गोंज़ालेज़, एआई सेंटर ऑफ़ एक्सीलेंस के वीपी त्रयी, इसकी दक्षता की प्रशंसा की:

“ओपिक ने इंटरैक्शन को प्रोसेस किया और लॉगिंग के लगभग तुरंत बाद मेट्रिक्स डिलीवर किए - एक उल्लेखनीय तेज़ टर्नअराउंड"।

ओपिक की गति प्रमुख मॉडलों के साथ इसकी व्यापक संगतता से मेल खाती है। यह जैसे प्लेटफार्मों के साथ सहजता से एकीकृत होता है ओपनएआई, एंथ्रोपिक, बेडरॉक, और प्रेडीबेस। यह है प्रॉम्प्ट प्लेग्राउंड उपयोगकर्ताओं को एक साथ मॉडल का परीक्षण करने, तापमान जैसे मापदंडों में बदलाव करने और रीयल-टाइम प्रदर्शन तुलना के लिए मॉडल स्विच करने की अनुमति देता है। इसके अतिरिक्त, ओपिक सपोर्ट करता है एलएलएम ज्यूरी, कई मॉडलों को स्वतंत्र रूप से आउटपुट का मूल्यांकन करने और उनके स्कोर को एक एकल एन्सेम्बल स्कोर में संयोजित करने में सक्षम बनाता है। इसके पैरेंट प्लेटफॉर्म, Comet-ML ने GitHub पर 14,000 से अधिक स्टार हासिल किए हैं, जो डेवलपर्स के बीच इसकी लोकप्रियता को उजागर करता है।

ओपिक रिट्रीवल-ऑगमेंटेड जेनरेशन (RAG) सिस्टम का मूल्यांकन करने, मतिभ्रम का पता लगाने, उत्तर प्रासंगिकता का आकलन करने और संदर्भ सटीकता और याद को मापने के लिए विशेष मेट्रिक्स की पेशकश करने में उत्कृष्टता प्राप्त करता है। प्लेटफ़ॉर्म स्वचालित रूप से संपूर्ण LLM पाइपलाइन का पता लगाता है, जिससे डेवलपर्स के लिए जटिल RAG या मल्टी-एजेंट सेटअप में घटकों को डीबग करना आसान हो जाता है। यह रागास फ्रेमवर्क के साथ भी एकीकृत है। हाल ही में, ओपिक ने अपनी लाइब्रेरी का विस्तार करते हुए 37 नए मेट्रिक्स, जैसे कि बर्टस्कोर और सेंटीमेंट एनालिसिस को शामिल किया।

जबकि स्वचालित मेट्रिक्स एक महत्वपूर्ण ताकत हैं, ओपिक विशेषज्ञ इनपुट को भी प्राथमिकता देता है। यह है एनोटेशन कतारें विशेषज्ञों द्वारा मैन्युअल समीक्षा और निशान के स्कोरिंग को सक्षम करें। द मल्टी-वैल्यू फ़ीडबैक स्कोर सुविधा टीम के सदस्यों को स्वतंत्र रूप से एक ही ट्रेस स्कोर करने, पूर्वाग्रह को कम करने और मूल्यांकन सटीकता को बढ़ाने की अनुमति देती है। मॉडल के प्रदर्शन को परिष्कृत करने के लिए निरंतर फीडबैक लूप बनाने के लिए इन मैनुअल स्कोर को स्वचालित मेट्रिक्स के साथ जोड़ा जाता है।

ओपिक ऑनलाइन मूल्यांकन नियम कॉन्फ़िगर करने योग्य नमूना विकल्प (10%-100%) प्रदान करें और इसमें PII रिडक्शन जैसी सुविधाएँ शामिल हैं। स्लैक के माध्यम से रियल-टाइम अलर्ट और पेजर ड्यूटी लागत में वृद्धि, विलंबता समस्याओं या त्रुटियों के बारे में टीमों को सूचित करें। एक ओपन-सोर्स प्लेटफ़ॉर्म के रूप में, ओपिक क्रेडिट कार्ड की आवश्यकता के बिना एक उदार फ्री टियर प्रदान करता है। उद्यमों के लिए, यह उद्योग की जरूरतों के अनुरूप अतिरिक्त मापनीयता और अनुपालन सुविधाएँ प्रदान करता है।

लैंगस्मिथ मूल रूप से इसके साथ एकीकृत होता है लैंग चैन पारिस्थितिकी तंत्र अन्य ढांचे के साथ काम करने के लिए पर्याप्त लचीला रहते हुए भी। यह कैप्चर करता है नेस्टेड निशान जटिल वर्कफ़्लो में, जिससे डेवलपर पुनर्प्राप्ति, टूल कॉल या जनरेशन जैसे क्षेत्रों में समस्याओं की पहचान कर सकते हैं और उन्हें ठीक कर सकते हैं।

लैंगस्मिथ की प्रॉम्प्ट प्लेग्राउंड डेवलपर्स को एक साथ कई एलएलएम, जैसे कि ओपनएआई और एंथ्रोपिक का परीक्षण करने में सक्षम बनाता है। इस सुविधा से गुणवत्ता, लागत और विलंबता जैसे कारकों को तौलना आसान हो जाता है। इसके साथ प्रयोग बेंचमार्किंग उपकरण, उपयोगकर्ता परिणामों की स्पष्ट तुलना की पेशकश करते हुए, एक ही क्यूरेट किए गए डेटासेट के विरुद्ध विभिन्न मॉडल या प्रॉम्प्ट संस्करण चला सकते हैं। प्लेटफ़ॉर्म भी सपोर्ट करता है जोड़ीदार तुलनात्मक मूल्यांकनकर्ता, जहां या तो एलएलएम-ए-जज या मानव समीक्षक सिर-टू-हेड मूल्यांकन में दो मॉडलों से आउटपुट स्कोर करते हैं। इसके अतिरिक्त, ओपनवैल्स पैकेज टीमों को विभिन्न प्रदाताओं के साथ काम करते समय लचीलापन सुनिश्चित करने, अनुप्रयोग प्रदर्शन का आकलन करने के लिए विभिन्न मॉडलों का उपयोग करके मॉडल-अज्ञेय मूल्यांकनकर्ताओं को डिज़ाइन करने की अनुमति देता है।

लैंगस्मिथ सरल मॉडल तुलनाओं से परे है, जो आरएजी सिस्टम के मूल्यांकन के लिए उन्नत उपकरण प्रदान करता है।

LangSmith पुनर्प्राप्ति प्रक्रिया के हर चरण को ट्रैक करके RAG सिस्टम में विस्तृत जानकारी प्रदान करता है। टीमें माप सकती हैं पुनर्प्राप्ति प्रासंगिकता (क्या सही दस्तावेज़ों की पहचान की गई थी) और उत्तर सटीकता (प्रतिक्रियाएँ कितनी पूर्ण और सही हैं)। ट्रेस-आधारित दृष्टिकोण का उपयोग करके, लैंगस्मिथ ठीक उसी जगह को इंगित करता है जहां वर्कफ़्लो टूट जाता है, जटिल पुनर्प्राप्ति पाइपलाइनों को डीबग करने से अनुमान को हटा देता है।

इसके विस्तृत मूल्यांकन के अलावा, प्लेटफ़ॉर्म सुचारू संचालन सुनिश्चित करने के लिए मजबूत उत्पादन निगरानी प्रदान करता है।

लैंगस्मिथ की एनोटेशन कतारें स्ट्रक्चर्ड वर्कफ़्लो चालू करें, जहां विषय-वस्तु विशेषज्ञ ऐप्लिकेशन के जवाबों की समीक्षा कर सकते हैं, स्कोर कर सकते हैं और उन्हें एनोटेट कर सकते हैं। जैसा कि लैंगचैन हाइलाइट्स करता है:

“मानव प्रतिक्रिया अक्सर सबसे मूल्यवान मूल्यांकन प्रदान करती है, विशेष रूप से व्यक्तिपरक गुणवत्ता आयामों के लिए"।

जब स्वचालित मूल्यांकनकर्ता या यूज़र फ़ीडबैक फ्लैग उत्पादन निशान बनाते हैं, तो इन्हें समीक्षा के लिए विशेषज्ञों के पास भेजा जाता है। एनोटेट किए गए निशान फिर भविष्य के परीक्षण के लिए “गोल्ड स्टैंडर्ड” डेटासेट में तब्दील हो जाते हैं, जिससे समय के साथ सिस्टम की क्षमताओं में वृद्धि होती है।

लैंगस्मिथ वास्तविक समय में अनुरोध-स्तरीय विलंबता, टोकन उपयोग और लागत एट्रिब्यूशन जैसे प्रमुख मैट्रिक्स की निगरानी करता है। यह है ऑनलाइन इवैलुएटर्स टीमों को ट्रैफ़िक के विशिष्ट भागों का नमूना लेने की अनुमति दें, जैसे कि 10%, लागत के साथ दृश्यता को संतुलित करने के लिए, पांच मिनट की विंडो के भीतर एक साथ मूल्यांकन किए गए 500 थ्रेड तक का समर्थन करते हैं। यह रीयल-टाइम ट्रैकिंग सुनिश्चित करती है कि उत्पादन के मुद्दों को जल्दी और कुशलता से संबोधित किया जाए।

प्लेटफ़ॉर्म एंटरप्राइज़-ग्रेड सुरक्षा मानकों को पूरा करता है, बनाए रखता है HIPAA, SOC 2 टाइप 2, और GDPR अनुपालन। स्वचालित जांच, जिसमें सुरक्षा फ़िल्टर, फ़ॉर्मेट सत्यापन, और क्वालिटी ह्युरिस्टिक्स शामिल हैं, सुरक्षा की एक अतिरिक्त परत जोड़ते हैं। त्रुटियों के लिए मूलभूत अलर्ट और लेटेंसी स्पाइक्स टीमों को घटनाओं पर तुरंत प्रतिक्रिया देने में मदद करते हैं। लैंगस्मिथ एक प्रति-ट्रेस मूल्य निर्धारण मॉडल का उपयोग करता है, जिसमें एक निःशुल्क टियर उपलब्ध होता है, हालांकि उच्च उत्पादन वॉल्यूम के लिए लागत में उल्लेखनीय वृद्धि हो सकती है।

2023 में स्थापित रागास, RAG (रिट्रीवल-ऑगमेंटेड जेनरेशन) पाइपलाइनों का मूल्यांकन करने पर केंद्रित है। उस वर्ष की शुरुआत में प्रकाशित संदर्भहीन मूल्यांकन विधियों पर शोध से जन्मा, यह रिट्रीवर और जनरेटर घटकों के प्रदर्शन विश्लेषण को अलग करता है। यह अंतर टीमों को यह पहचानने में मदद करता है कि मूल्यांकन के लिए विशिष्ट उपकरणों के व्यापक विषय के साथ संरेखित भाषा मॉडल में त्रुटिपूर्ण डेटा पुनर्प्राप्ति या मतिभ्रम से समस्याएँ उत्पन्न होती हैं या नहीं।

रागास पुनर्प्राप्ति और उत्पादन प्रक्रियाओं दोनों के लिए लक्षित मेट्रिक्स प्रदान करता है। पुनर्प्राप्ति के लिए, यह निम्नलिखित उपाय करता है:

पीढ़ी की ओर से, यह मूल्यांकन करता है:

यह बारीक दृष्टिकोण जटिल RAG वर्कफ़्लो के लिए डिबगिंग को सरल बनाता है। उदाहरण के लिए, अगस्त 2025 के बेंचमार्क में, मिस्ड रूल स्टैकिंग और सीमा स्थितियों जैसे मुद्दों को संबोधित करने के बाद एक मॉडल की सटीकता 50% से बढ़कर 90% हो गई।

एक का उपयोग करना “एलएलएम-ए-ए-जज” कार्यप्रणाली, रागास मात्रात्मक स्कोर उत्पन्न करता है, जिससे मैनुअल ग्राउंड-ट्रुथ लेबल की आवश्यकता कम हो जाती है। यह सिंथेटिक टेस्ट डेटा जनरेशन का भी समर्थन करता है, जिसमें 20—30 नमूनों से शुरू करने और अधिक भरोसेमंद परिणामों के लिए इसे 50-100 तक स्केल करने की सिफारिशें दी जाती हैं।

रागास विभिन्न एलएलएम प्रदाताओं के साथ मूल रूप से एकीकृत होता है, जिसमें ओपनएआई, एंथ्रोपिक (क्लाउड), गूगल (जेमिनी) और ओलामा के माध्यम से स्थानीय मॉडल शामिल हैं। यह बेंचमार्किंग के दौरान टीमों को विशिष्ट मॉडल संस्करणों (जैसे, “gpt-4o-2024-08-06") को लॉक करने की अनुमति देकर प्रजनन क्षमता सुनिश्चित करता है, भले ही प्रदाता अपने मॉडल अपडेट करते हैं। इसके अतिरिक्त, टूल अत्यधिक एक्स्टेंसिबल है, जो डेकोरेटर्स के माध्यम से कस्टम मेट्रिक्स को सक्षम करता है जैसे @discrete_metric, जिसका उपयोग JSON सत्यापन जैसे कार्यों के लिए किया जा सकता है।

हालांकि रागास स्वचालित मेट्रिक्स पर जोर देता है, लेकिन इसमें अतिरिक्त विश्वसनीयता के लिए मानवीय निरीक्षण शामिल है। फ्रेमवर्क में मीट्रिक एनोटेशन के लिए एक उपयोगकर्ता इंटरफ़ेस शामिल है, जिससे उपयोगकर्ता जोड़ सकते हैं ग्रेडिंग_नोट्स डेटासेट का परीक्षण करने और मानव-विशिष्ट मूल्यांकन मानदंडों को परिभाषित करने के लिए प्रत्येक मूल्यांकन में एक भी शामिल होता है स्कोर_रीज़न पारदर्शिता और ऑडिटेबिलिटी के लिए क्षेत्र। जैसा कि रागास दस्तावेज़ीकरण में कहा गया है:

“रागास एक लाइब्रेरी है जो आपको अपने AI अनुप्रयोगों के लिए 'वाइब चेक' से व्यवस्थित मूल्यांकन लूप की ओर बढ़ने में मदद करती है"।

स्वचालित स्कोरिंग और मानव इनपुट का यह संयोजन गतिशील वातावरण में भी कठोर प्रदर्शन निगरानी सुनिश्चित करता है।

रागास लैंगफ्यूज और एरीज़ जैसे ऑब्जर्वेबिलिटी प्लेटफॉर्म के साथ एकीकृत करके उत्पादन निगरानी तक अपनी क्षमताओं का विस्तार करता है। इससे प्रोडक्शन ट्रैस को रियल-टाइम स्कोरिंग किया जा सकता है। यह संदर्भ-मुक्त मेट्रिक्स है, जैसे कि वफ़ादारी मतिभ्रम का पता लगाने के लिए, लाइव सेटिंग्स में विशेष रूप से उपयोगी होते हैं, जहां जमीनी सच्चाई के जवाब हमेशा उपलब्ध नहीं होते हैं। फ्रेमवर्क CI/CD पाइपलाइनों में एकीकरण का भी समर्थन करता है, जिससे यह सुनिश्चित करने के लिए निरंतर मूल्यांकन किया जा सकता है कि अपडेट प्रदर्शन और सुरक्षा मानकों को पूरा करते हैं। मॉडल व्यवहार के बारे में जानकारी बनाए रखते हुए टीमें हर ट्रेस को स्कोर करने या लागतों को संतुलित करने के लिए आवधिक बैच सैंपलिंग का उपयोग करने का विकल्प चुन सकती हैं।

ब्रेनट्रस्ट मूल्यांकन और उत्पादन निगरानी को सीधे मानक इंजीनियरिंग वर्कफ़्लो में मिलाता है, जिससे एक सहज और कुशल प्रक्रिया सुनिश्चित होती है।

ब्रेनट्रस्ट का वेब-आधारित प्लेग्राउंड टीमों को मॉडल की साथ-साथ तुलना करने का अधिकार देता है, जिससे डेटा-संचालित निर्णय आसान हो जाते हैं। प्लेग्राउंड के साथ, यूज़र प्रॉम्प्ट को फाइन-ट्यून कर सकते हैं, मॉडल के बीच स्विच कर सकते हैं और निर्बाध रूप से मूल्यांकन कर सकते हैं। अगल-बगल तुलनाएं समान संकेतों पर मॉडल के प्रदर्शन को उजागर करती हैं, जिससे स्पष्ट जानकारी मिलती है। GitHub Actions के साथ एकीकृत, प्लेटफ़ॉर्म प्रत्येक कमिट के साथ स्वचालित रूप से मूल्यांकन चलाता है, परिणामों की तुलना बेसलाइन से करता है और गुणवत्ता में गिरावट आने पर मर्ज को रोकता है। ब्रेनट्रस्ट में तथ्यात्मकता, प्रासंगिकता और सुरक्षा जैसे प्रमुख मैट्रिक्स को मापने के लिए 25 से अधिक बिल्ट-इन स्कोरर शामिल हैं, साथ ही कस्टम स्कोरर के लिए भी अनुमति देते हैं - चाहे कोड के माध्यम से या एलएलएम-ए-ए-जज का लाभ उठाकर। स्वचालित मेट्रिक्स के साथ, प्लेटफ़ॉर्म विशेषज्ञ समीक्षाओं के महत्व पर ज़ोर देता है।

मानव विशेषज्ञता को शामिल करने के लिए, ब्रेनट्रस्ट अपने “एनोटेट” वर्कफ़्लो को पेश करता है। यह टीमों को समीक्षा प्रक्रिया सेट करने, लेबल लागू करने और मॉडल आउटपुट को परिष्कृत करने में सक्षम बनाता है। इसका नो-कोड इंटरफ़ेस उत्पाद प्रबंधकों और डोमेन विशेषज्ञों को प्रॉम्प्ट का प्रोटोटाइप बनाने और परिणामों की आसानी से समीक्षा करने की अनुमति देता है। स्वचालित स्कोरिंग को मानवीय फ़ीडबैक के साथ जोड़कर, प्लेटफ़ॉर्म उन बारीकियों को कैप्चर करता है जिन्हें एल्गोरिदम अनदेखा कर सकते हैं। इसके अतिरिक्त, “लूप” AI एजेंट उत्पादन लॉग से विफलता के पैटर्न और सतहों की जानकारी की पहचान करता है। मानव इनपुट का यह एकीकरण आधुनिक मूल्यांकन-संचालित विकास के सिद्धांतों को दर्शाता है। एयरटेबल से ली वीसबर्गर ने साझा किया:

“हर नया AI प्रोजेक्ट ब्रेनट्रस्ट में इवल्स के साथ शुरू होता है - यह एक गेम चेंजर है।”

ब्रेनट्रस्ट अपनी क्षमताओं को लाइव उत्पादन वातावरण तक बढ़ाता है, विकास के दौरान लागू समान गुणवत्ता वाले मेट्रिक्स का उपयोग करके ट्रैफ़िक का लगातार मूल्यांकन करता है। यह महंगे पैटर्न का जल्द पता लगाने के लिए, टीमों को बजट को प्रभावी ढंग से प्रबंधित करने में मदद करने के लिए - उपयोगकर्ता, सुविधा और बातचीत द्वारा - टोकन के उपयोग को विस्तार से ट्रैक करता है। प्लेटफ़ॉर्म असाधारण प्रदर्शन भी प्रदान करता है, जो 23.9 गुना तेज़ पूर्ण-पाठ खोज (401 एमएस बनाम 9,587 एमएस) और 2.55 गुना तेज़ लेखन विलंबता प्रदान करता है। सारा सैक्स, इंजीनियरिंग लीड एट धारणा, टिप्पणी की:

“ब्रेनस्टोर ने पूरी तरह से बदल दिया है कि हमारी टीम लॉग के साथ कैसे इंटरैक्ट करती है। हम कुछ ही सेकंड में खोज चलाकर जानकारी प्राप्त कर पाए हैं, जिसमें पहले घंटों लग जाते थे.”

सख्त डेटा संप्रभुता आवश्यकताओं वाले संगठनों के लिए, ब्रेनट्रस्ट सेल्फ-होस्टिंग विकल्प प्रदान करता है और अनुपालन और सुरक्षा सुनिश्चित करने के लिए SOC 2 टाइप II प्रमाणित है।

ध्यान दें: ह्यूमनलूप की स्टैंडअलोन विशेषताएं 2024 के अंत में एंथ्रोपिक द्वारा इसके अधिग्रहण से पहले प्लेटफ़ॉर्म की क्षमताओं को दर्शाती हैं। पहले की इन कार्यक्षमताओं ने आज देखे गए एकीकृत मूल्यांकन दृष्टिकोणों को आकार दिया है, जो मूल्यांकन-संचालित विकास प्रथाओं की प्रगति को उजागर करते हैं।

ह्यूमनलूप ने इंजीनियरों और गैर-तकनीकी सहयोगियों के बीच की खाई को पाटा, एक साझा कार्यक्षेत्र की पेशकश की, जहां उत्पाद प्रबंधक, कानूनी टीम और विषय विशेषज्ञ बोझिल स्प्रेडशीट की आवश्यकता के बिना त्वरित इंजीनियरिंग और मूल्यांकन में सक्रिय रूप से संलग्न हो सकते हैं। ह्यूमनलूप ने मूल्यांकन वर्कफ़्लो को कैसे सुव्यवस्थित किया, इस पर करीब से नज़र डाली गई है।

ह्यूमनलूप ने टीमों को एकल डेटासेट का उपयोग करके विभिन्न बेस मॉडल की साथ-साथ तुलना करने की अनुमति दी। इसमें OpenAI (GPT-4o, GPT-4O-mini), Anthropic's Claude 3.5 Sonnet, Google के मॉडल और ओपन-सोर्स विकल्प जैसे ओपन-सोर्स विकल्प शामिल थे मिस्ट्रल। स्पाइडर प्लॉट ने लागत, विलंबता और उपयोगकर्ता संतुष्टि जैसे कारकों के बीच ट्रेड-ऑफ का स्पष्ट दृश्य प्रदान किया। उदाहरण के लिए, एक मूल्यांकन में GPT-4o का दस्तावेजीकरण किया गया था, जो उच्च लागत और धीमी गति पर उच्च उपयोगकर्ता संतुष्टि प्रदान करता है। इसके अतिरिक्त, प्लेटफ़ॉर्म की लॉग कैशिंग सुविधा ने टीमों को विशिष्ट डेटासेट और प्रॉम्प्ट के लिए लॉग का पुन: उपयोग करने में सक्षम बनाया, जिससे मूल्यांकन के दौरान समय और खर्च दोनों में कटौती हुई। इस सुविधा ने बड़े भाषा मॉडल के परिवर्तनशील प्रदर्शन से उत्पन्न चुनौतियों का सामना किया, जो आधुनिक मूल्यांकन ढांचे में एक आम समस्या है।

पुनर्प्राप्ति-संवर्धित पीढ़ी (RAG) उपयोग के मामलों के लिए, Humanloop ने पूर्व-निर्मित टेम्पलेट की पेशकश की। इन टेम्प्लेट में एआई-एज़-ए-जज मूल्यांकनकर्ता शामिल थे जिन्हें तथ्यात्मक सटीकता को सत्यापित करने और संदर्भ की प्रासंगिकता सुनिश्चित करने के लिए डिज़ाइन किया गया था।

प्लेटफ़ॉर्म के इंटरफ़ेस ने विशेषज्ञों को लॉग की समीक्षा करने, द्विआधारी, श्रेणीबद्ध या पाठ्य फ़ीडबैक प्रदान करने और मूल्यांकन मानदंडों को परिष्कृत करने के लिए ग्रेडिंग नोट्स जोड़ने का अधिकार दिया। इन सुव्यवस्थित वर्कफ़्लो की बदौलत टीमों ने हर सप्ताह 6-8 इंजीनियरिंग घंटे बचाने की सूचना दी। Humanloop ने नए संस्करणों को बेंचमार्क करने के लिए ऑफ़लाइन परीक्षण और लाइव प्रोडक्शन डेटा की समीक्षा के लिए ऑनलाइन निगरानी दोनों का समर्थन किया।

ह्यूमनलूप ने उत्पादन निगरानी में भी उत्कृष्ट प्रदर्शन किया, तैनाती से पहले प्रतिगमन को पकड़ने के लिए मूल्यांकन को CI/CD पाइपलाइनों में एकीकृत किया। स्वचालित ऑनलाइन मूल्यांकनकर्ताओं ने लाइव प्रोडक्शन लॉग की निगरानी की, प्रदर्शन के रुझान पर नज़र रखी और किसी भी प्रदर्शन में गिरावट के लिए अलर्ट ट्रिगर किए। डेनियल अल्फारोन, सीनियर डायरेक्टर ऑफ इंजीनियरिंग डिक्सा, मंच के महत्व पर जोर दिया:

“हम पहले ह्यूमनलूप के माध्यम से नए मॉडल का मूल्यांकन करने से पहले कोई नया एलएलएम परिनियोजन निर्णय नहीं लेते हैं। टीम के पास मूल्यांकन प्रदर्शन मेट्रिक्स हैं जो उन्हें आत्मविश्वास देते हैं।”

प्लेटफ़ॉर्म ने संस्करण नियंत्रण, SOC-2 अनुपालन और सेल्फ-होस्टिंग विकल्पों के साथ एंटरप्राइज़-ग्रेड सुरक्षा का भी समर्थन किया।

यूके एआई सिक्योरिटी इंस्टीट्यूट द्वारा बनाया गया, इंस्पेक्ट एआई सुरक्षा और सुरक्षा पर जोर देते हुए बड़े भाषा मॉडल (एलएलएम) का मूल्यांकन करने के लिए एक शोध-संचालित दृष्टिकोण अपनाता है। इसका ओपन-सोर्स MIT लाइसेंस संपूर्ण विकास परीक्षण के लिए समर्पित टीमों के लिए सुलभता सुनिश्चित करता है। फ्रेमवर्क में 100 से अधिक पूर्व-निर्मित मूल्यांकन शामिल हैं, जिसमें कोडिंग, रीजनिंग, एजेंटिक कार्य और मल्टीमॉडल समझ जैसे क्षेत्र शामिल हैं।

के साथ एवल-सेट कमांड, इंस्पेक्ट एआई उपयोगकर्ताओं को बेंचमार्किंग पर समय बचाने के लिए समानांतर निष्पादन का लाभ उठाते हुए, एक साथ कई मॉडलों में एक ही मूल्यांकन कार्य चलाने की अनुमति देता है। यह कई प्रदाताओं का समर्थन करता है, जिनमें OpenAI, Anthropic, Google, Mistral शामिल हैं, हगिंग फेस, और स्थानीय मॉडल के माध्यम से वीएलएलएम या ओलामा। मॉडल आईडी में प्रदाता का नाम जोड़कर, यूज़र अलग-अलग अनुमान प्रदाताओं के प्रदर्शन, गति और लागत की तुलना कर सकते हैं। स्वचालित चयन नीतियां, जैसे कि :सबसे तेज़ या :सबसे सस्ता, थ्रूपुट और लागत के आधार पर सबसे कुशल प्रदाता को कार्यों को रूट करके मूल्यांकन को और सुव्यवस्थित करें। उदाहरण के लिए, एक बेंचमार्क में, जीपीटी-ओएसएस-120b मॉडल ने अलग-अलग सटीकता का प्रदर्शन किया, जिसमें हाइपरबोलिक स्कोरिंग 0.84 थी, जबकि ग्रोक और सांबानोवा दोनों ने 0.80 रन बनाए। सटीक प्रदर्शन सत्यापन सुनिश्चित करने के लिए इस मल्टी-मॉडल तुलना क्षमता को मानवीय निरीक्षण से बल मिलता है।

स्वचालित बेंचमार्क के अलावा, Inspect AI कम्प्यूटेशनल कार्यों पर मानव क्षमताओं के खिलाफ प्रदर्शन आधार रेखा स्थापित करने के लिए मानव मूल्यांकन को एकीकृत करता है। इसका एजेंट सॉल्वर इस प्रक्रिया को सुविधाजनक बनाता है, जबकि टूल अनुमोदन सुविधा मनुष्यों को मूल्यांकन के दौरान मॉडल द्वारा किए गए टूल कॉल की समीक्षा करने और उन्हें मंजूरी देने की अनुमति देती है। रीयल-टाइम जानकारी के लिए, इंस्पेक्ट व्यू वेब टूल और वीएस कोड एक्सटेंशन मूल्यांकन ट्रैजेक्टरीज का विज़ुअलाइज़ेशन प्रदान करते हैं, जिससे मैन्युअल त्रुटि विश्लेषण और डिबगिंग सक्षम होती है। UK AI सुरक्षा संस्थान फ्रेमवर्क की अनुकूलन क्षमता पर प्रकाश डालता है:

“निरीक्षण का उपयोग मूल्यांकन की एक विस्तृत श्रृंखला के लिए किया जा सकता है जो कोडिंग, एजेंट कार्यों, तर्क, ज्ञान, व्यवहार और बहु-मोडल समझ को मापते हैं"।

हालांकि मुख्य रूप से परीक्षण और विकास के लिए डिज़ाइन किया गया है, Inspect AI सुरक्षा और अनुपालन में भी उत्कृष्ट है। इसका सैंडबॉक्सिंग सिस्टम - इसके साथ संगत है डॉकर, कुबेरनेट्स, मोडल, और प्रॉक्समॉक्स - अविश्वसनीय मॉडल-जनरेटेड कोड को अलग-अलग वातावरण में चलाने की अनुमति देता है। साथ ही, इसके लिए महत्वपूर्ण टूल कॉल के लिए मानव प्राधिकरण की आवश्यकता होती है, जो हाई-स्टेक परिदृश्यों में एजेंट वर्कफ़्लो का आकलन करने के लिए एक आवश्यक विशेषता है। ये उपाय AI सुरक्षा और सुरक्षा के लिए उद्योग की सर्वोत्तम प्रथाओं के अनुरूप, सुरक्षित और विश्वसनीय परीक्षण पर प्लेटफ़ॉर्म के मज़बूत फोकस को दर्शाते हैं।

मल्टी-मॉडल संगतता, आरएजी मूल्यांकन, मानव-इन-द-लूप वर्कफ़्लोज़ और उत्पादन निगरानी जैसी आवश्यक विशेषताओं का आकलन करके सर्वश्रेष्ठ एलएलएम मूल्यांकन उपकरण चुनें।

नीचे विभिन्न प्लेटफार्मों पर इन क्षमताओं का विवरण दिया गया है:

जबकि अधिकांश उपकरण सभी चार क्षमताओं का समर्थन करते हैं, उनके कार्यान्वयन के तरीके अलग-अलग होते हैं। उदाहरण के लिए, AI का निरीक्षण करें व्यक्तिगत ट्रेस डिबगिंग के साथ मैन्युअल समीक्षा पर ध्यान केंद्रित करता है, जो इसे विकास परीक्षण के लिए अधिक उपयुक्त बनाता है लेकिन सीमित उत्पादन निगरानी प्रदान करता है।

2026 में सही LLM मूल्यांकन उपकरण चुनना सबसे अधिक फीचर-भारी विकल्प का पीछा करने के बारे में नहीं है - यह आपके अद्वितीय वर्कफ़्लो के साथ टूल की क्षमताओं को संरेखित करने के बारे में है। चाहे आपका ध्यान मूल पाइटेस्ट इंटीग्रेशन वाली CI/CD पाइपलाइनों पर हो, रीयल-टाइम मॉनिटरिंग की आवश्यकता वाले प्रोडक्शन सिस्टम या ट्रेस-आधारित विश्लेषण की आवश्यकता वाले RAG अनुप्रयोगों पर हो, आदर्श टूल को आपके मौजूदा इन्फ्रास्ट्रक्चर के साथ आसानी से एकीकृत करना चाहिए। अनुकूलित कार्यक्षमता पर यह जोर मीट्रिक-आधारित मूल्यांकन के बढ़ते महत्व को रेखांकित करता है।

उद्योग का व्यक्तिपरक आकलन से डेटा-संचालित मेट्रिक्स में बदलाव अब वैकल्पिक नहीं है - यह उत्पादन वातावरण के लिए आवश्यक है। OpenAI इस बिंदु पर प्रकाश डालता है:

“यदि आप एलएलएम के साथ निर्माण कर रहे हैं, तो उच्च गुणवत्ता वाले ईवल बनाना आपके द्वारा किए जा सकने वाले सबसे प्रभावशाली कामों में से एक है"।

यह दृष्टिकोण सुनिश्चित करता है कि विशेषज्ञ निरीक्षण के साथ संयुक्त होने पर स्वचालित स्कोरिंग स्केलेबल और भरोसेमंद दोनों हो जाए।

इंटरऑपरेबिलिटी और अनुपालन भी गैर-परक्राम्य हो गए हैं। कई अनुमान बैकएंड का समर्थन करने वाले टूल विभिन्न हार्डवेयर सेटअपों में प्रदर्शन परीक्षण की अनुमति देते हैं, जबकि अंतर्निहित सुरक्षा बेंचमार्क और मॉडरेशन फ्रेमवर्क टीमों को 2026 विनियामक आवश्यकताओं को पूरा करने में मदद करते हैं। ये सुरक्षा उपाय पूर्वाग्रह, विषाक्तता और गोपनीयता संबंधी चिंताओं जैसे मुद्दों को हल करने के लिए महत्वपूर्ण हैं। एक सतत मूल्यांकन रणनीति अपनाकर, संगठन अलग-अलग परीक्षण से चल रहे मॉडल सुधार की अधिक गतिशील प्रक्रिया में स्थानांतरित हो सकते हैं।

जैसा कि चर्चा की गई है, हर चरण में स्कोप्ड टेस्ट लिखना - तैनाती के बाद तक इंतजार करने के बजाय - बेहतर परिणाम देता है। डेवलपमेंट डेटा लॉग करने वाली टीमें एज केस की पहचान कर सकती हैं, अधिक सुसंगत एलएलएम-ए-जज स्कोरिंग के लिए जोड़ीदार तुलनाओं का उपयोग कर सकती हैं, और फ़ीडबैक लूप बना सकती हैं, जो असफल निशान को मूल्यवान परीक्षण डेटासेट में बदल देते हैं। यह “डेटा फ़्लाईव्हील” मूल्यांकन को एक बार के कार्य से सुधार के निरंतर चक्र में बदल देता है।

RAG (रिट्रीवल-ऑगमेंटेड जेनरेशन) मूल्यांकन कई बड़े भाषा मॉडल (LLM) अनुप्रयोगों के पीछे की दो-चरणीय प्रक्रिया को समझने में महत्वपूर्ण भूमिका निभाता है। इस प्रक्रिया में बाहरी ज्ञान के आधार से प्रासंगिक जानकारी प्राप्त करना और फिर उस संदर्भ के आधार पर प्रतिक्रियाएँ उत्पन्न करना शामिल है। रिट्रीवर और जनरेटर का स्वतंत्र रूप से आकलन करके, RAG मूल्यांकन से समस्याओं को इंगित करना आसान हो जाता है, चाहे वह अप्रासंगिक जानकारी पुनर्प्राप्त की जा रही हो या जेनरेट किए गए आउटपुट में त्रुटियां हों। यह दृष्टिकोण डिबगिंग और फाइन-ट्यूनिंग दोनों को सरल बनाता है।

मेट्रिक्स जैसे प्रासंगिकता, भक्ति, यथार्थता, और याद करते हैं यह सुनिश्चित करने के लिए महत्वपूर्ण हैं कि पुनर्प्राप्त किया गया डेटा अंतिम प्रतिक्रिया का समर्थन करता है और यह कि मॉडल जानकारी का सटीक रूप से प्रतिनिधित्व करता है। मूल्यांकन का यह स्तर उन कार्यों के लिए विशेष रूप से महत्वपूर्ण है जो वर्तमान या विशिष्ट ज्ञान की मांग करते हैं, जैसे कि कानूनी शोध, ग्राहक सेवा, या वैज्ञानिक विश्लेषण।

अंततः, RAG मूल्यांकन इस बात की विस्तृत समझ प्रदान करता है कि LLM कितना अच्छा प्रदर्शन करता है, यह सुनिश्चित करता है कि वर्कफ़्लो सटीक और भरोसेमंद परिणाम उत्पन्न करें - व्यावहारिक, उच्च-दांव परिदृश्यों में AI को सफलतापूर्वक लागू करने के लिए एक आवश्यक कारक।

ह्यूमन-इन-द-लूप (HITL) वर्कफ़्लो विशेषज्ञ मानव अंतर्दृष्टि के साथ स्वचालित टूल को मिलाकर बड़े भाषा मॉडल (LLM) का मूल्यांकन करने के लिए एक मूल्यवान संतुलन लाते हैं। हालांकि स्वचालित मेट्रिक्स स्पष्ट त्रुटियों को तुरंत पहचानने के लिए बहुत अच्छे होते हैं, लेकिन जब अधिक सूक्ष्म पहलुओं का आकलन करने की बात आती है, जैसे कि तथ्यात्मक सटीकता, सुरक्षा चिंताएं, या विशिष्ट डोमेन में मॉडल कितना अच्छा प्रदर्शन करता है, तो वे अक्सर कम पड़ जाते हैं। मानव समीक्षक इन कमियों को दूर करने के लिए कदम उठाते हैं, विस्तृत, उच्च-गुणवत्ता वाले मूल्यांकन प्रदान करते हैं, जो अधिक विश्वसनीय बेंचमार्क स्थापित करने और मूल्यांकन के लिए उपयोग किए जाने वाले मानदंडों को परिष्कृत करने में मदद करते हैं।

इन वर्कफ़्लो को आमतौर पर परीक्षण और विकास प्रक्रियाओं में एम्बेड किया जाता है, जिससे टीमें सावधानीपूर्वक चुने गए डेटासेट पर एलएलएम का परीक्षण कर सकती हैं और तैनाती से पहले संभावित समस्याओं को उजागर कर सकती हैं। स्वचालन और विशेषज्ञ इनपुट का यह संयोजन न केवल मॉडल को बेहतर बनाने की प्रक्रिया को गति देता है, बल्कि यह भी सुनिश्चित करता है कि मूल्यांकन व्यावहारिक, वास्तविक दुनिया के परिदृश्यों को प्रतिबिंबित करें। स्वास्थ्य देखभाल जैसे उच्च दांव वाले क्षेत्रों में, यह सुनिश्चित करने के लिए विशेषज्ञ की भागीदारी विशेष रूप से महत्वपूर्ण है कि मॉडल सटीकता, सुरक्षा और नैतिक जिम्मेदारी के लिए कड़े मानकों को पूरा करते हैं।

मल्टी-मॉडल समर्थन एक एकल, एकीकृत ढांचे के भीतर विभिन्न प्रदाताओं या आर्किटेक्चर से विभिन्न बड़े भाषा मॉडल (एलएलएम) का आकलन और तुलना करने के लिए चिकित्सकों को सशक्त बनाने में महत्वपूर्ण भूमिका निभाता है। यह सेटअप लगातार परीक्षण स्थितियों और प्रतिलिपि प्रस्तुत करने योग्य बेंचमार्किंग को सुनिश्चित करता है, जिससे उपयोगकर्ताओं को यह स्पष्ट समझ मिलती है कि समान परिस्थितियों में मूल्यांकन किए जाने पर विभिन्न मॉडल कैसा प्रदर्शन करते हैं।

अगल-बगल तुलनाओं की सुविधा प्रदान करके, मल्टी-मॉडल समर्थन प्रत्येक मॉडल की ताकत, सीमाओं और विशिष्ट कार्यों के लिए उपयुक्तता के बारे में गहरी जानकारी प्रदान करता है। यह दृष्टिकोण मशीन लर्निंग पेशेवरों को बेहतर निर्णय लेने और उनके AI वर्कफ़्लो को कुशलतापूर्वक कारगर बनाने के लिए आवश्यक जानकारी से लैस करता है।