El rápido crecimiento de los grandes modelos lingüísticos (LLM) exige herramientas de evaluación precisas para garantizar la precisión, el cumplimiento y el rendimiento. Este artículo explora las principales plataformas de evaluación de LLM para 2026, centrándose en su capacidad para optimizar las pruebas, supervisar la producción e integrar la retroalimentación humana. Esto es lo que necesita saber:

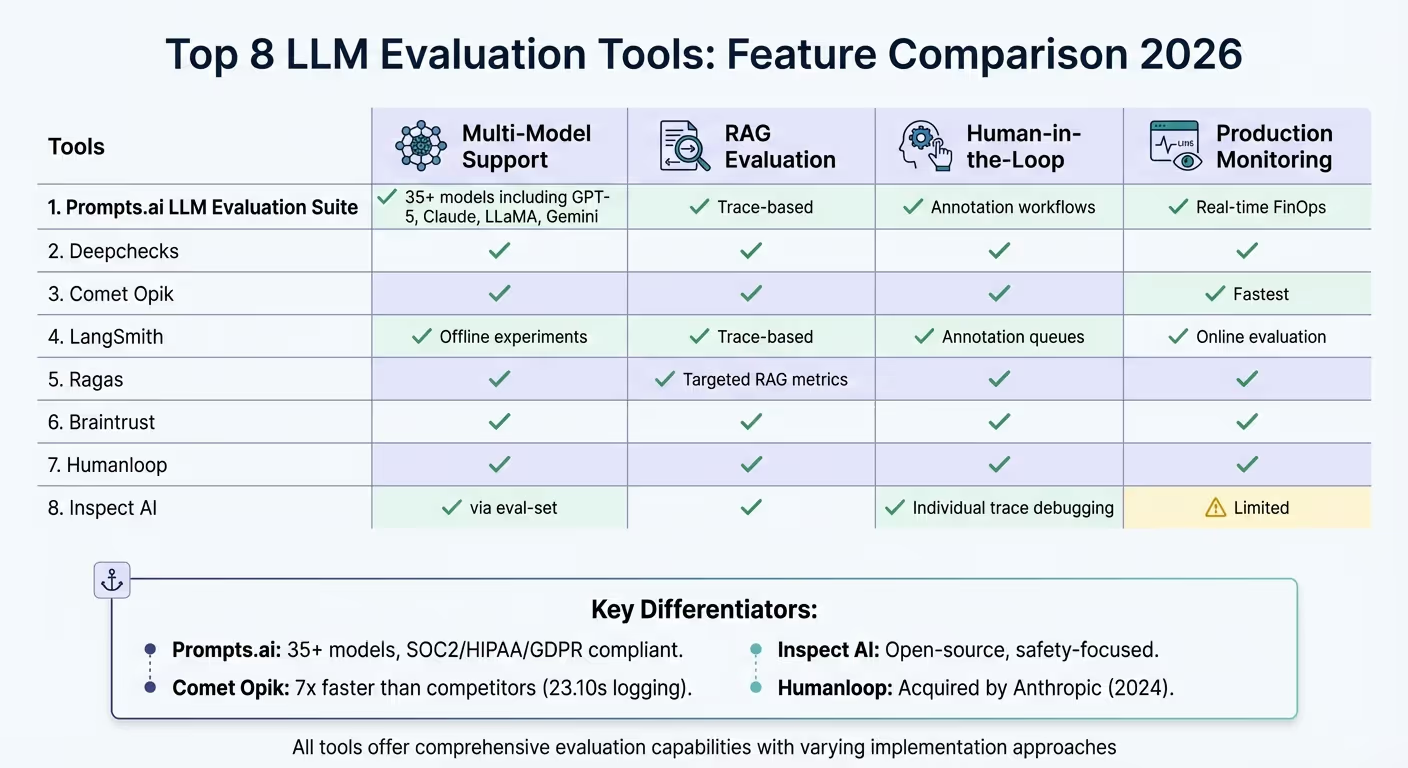

Cada herramienta aborda los desafíos de evaluación y variabilidad de la LLM de manera diferente, y ofrece funciones como la puntuación automatizada, los flujos de trabajo continuos y la supervisión del cumplimiento. A continuación se muestra una comparación rápida de sus principales capacidades.

Estas herramientas permiten a los equipos validar los LLM de manera efectiva, garantizando sistemas de IA confiables y compatibles para industrias como la atención médica, las finanzas y más.

Comparación de herramientas de evaluación de LLM: características y capacidades 2026

La suite de evaluación LLM de Prompts.ai aborda un desafío fundamental: comparar y validar los modelos de IA a lo largo de todo el proceso de desarrollo. Basándose en el principio rector de que «la ingeniería de evaluación es la mitad del desafío», esta suite agiliza las operaciones al consolidar más de 35 LLM líderes en una sola interfaz fácil de usar. Olvídese de tener que hacer malabares con varios paneles de control y claves de API: esta plataforma lo simplifica todo.

Con su comparación de modelos en paralelo, la suite le permite probar indicaciones idénticas en proveedores como GPT-5, Claude, LLama y Gemini en tiempo real. El Anulaciones del motor La función ofrece precisión al permitirle modificar las canalizaciones de evaluación y ajustar parámetros como la temperatura o los límites de fichas para cada ejecución. Mientras tanto, el Constructor de oleoductos visuales - una herramienta fácil de usar, similar a una hoja de cálculo, que permite tanto a los ingenieros como a los expertos en la materia crear intrincadas pruebas A/B sin escribir una sola línea de código.

Para los sistemas de generación aumentada por recuperación (RAG), la plataforma garantiza la precisión al validar las respuestas con «conjuntos de datos dorados» predefinidos. También emplea técnicas de LLM como juez para verificar la factibilidad y la relevancia en un contexto determinado. La suite incluye más de 20 tipos de columnas para la evaluación, que van desde comparaciones básicas de cadenas hasta webhooks y fragmentos de código personalizados, lo que permite una lógica de evaluación personalizada para las necesidades de los propietarios.

Al comprender que las métricas por sí solas no pueden captar los matices del lenguaje, la suite incorpora una columna «HUMANA» para la calificación manual. Los revisores pueden proporcionar puntuaciones numéricas, comentarios detallados o utilizar controles deslizantes para evaluar elementos subjetivos, como el tono o la coherencia de la marca. Para la evaluación de los chatbots, el simulador de conversación admite hasta 150 turnos de conversación y combina las comprobaciones automáticas con la supervisión humana para garantizar un rendimiento de diálogo de alta calidad en varios turnos.

La suite Evaluaciones nocturnas muestra las solicitudes de producción para identificar problemas de rendimiento o desviaciones del modelo, en tiempo real Slack alertas que lo mantienen informado. Su integración de CI/CD garantiza que no se implemente ninguna nueva versión rápida sin cumplir con los parámetros de calidad. Para los sectores con normativas estrictas, la plataforma cuenta con la certificación SOC2 de tipo 2, el RGPD, la HIPAA y la CCPA, y ofrece BaaS para el sector sanitario. Además, proporciona análisis de costos y contabilidad de tokens en tiempo real para gestionar el elevado uso de tokens típico de los flujos de trabajo de RAG. Los exhaustivos registros de auditoría respaldan aún más el cumplimiento normativo y las revisiones internas.

Deepchecks aborda el desafío de evaluar modelos de grandes lenguajes (LLM) al ofrecer comparaciones paralelas de las versiones de los modelos, las indicaciones, los agentes y los sistemas de IA. Integra modelos de incrustación, bases de datos vectoriales y métodos de recuperación en un flujo de trabajo unificado, lo que agiliza el proceso de evaluación. Este enfoque abre las puertas a métodos avanzados para evaluar varios modelos.

Deepchecks está diseñado para gestionar la variabilidad en el rendimiento de la LLM a través de su sólido soporte multimodelo. Al aprovechar los modelos de lenguaje pequeño (SLM) y los procesos de mezcla de expertos (MoE), actúa como un anotador inteligente que proporciona una puntuación objetiva. Este sistema garantiza métricas de rendimiento consistentes en varios proveedores de LLM. Los usuarios también pueden crear evaluadores sin código con un razonamiento basado en la cadena de pensamiento para analizar segmentos específicos del flujo de trabajo. Deepchecks se integra perfectamente con AWS SageMaker y es miembro fundador de Llmops.space, una comunidad global para profesionales de LLM.

La plataforma se especializa en evaluar los sistemas de generación aumentada de recuperación (RAG) mediante la evaluación de la fundamentación y la relevancia de la recuperación. Su función Golden Set Management ayuda a crear conjuntos de pruebas consistentes para comparar diferentes versiones de modelos.

Deepchecks combina la puntuación automatizada con las anulaciones manuales, lo que permite a los expertos refinar los conjuntos de datos básicos. Su interfaz sin código permite a los profesionales sin conocimientos técnicos definir criterios de evaluación adaptados a las necesidades empresariales específicas.

Deepchecks garantiza flujos de trabajo de producción fluidos al monitorear problemas como las alucinaciones, el contenido dañino y las fallas en las canalizaciones. También cumple con estrictos estándares de cumplimiento, incluidos el SOC2 de tipo 2, el GDPR y la HIPAA. Las opciones de implementación son flexibles y van desde el SaaS para varios inquilinos hasta el SaaS para un solo inquilino, el personalizado local y el AWS Zero-Friction on Prem, para satisfacer los requisitos de residencia de los datos. Para organizaciones con necesidades de alta seguridad, como las que utilizan AWS GovCloud, la plataforma ofrece herramientas de análisis de la causa raíz para identificar los puntos débiles y solucionar los pasos fallidos en las aplicaciones de LLM.

El cometa Opik destaca por su rapidez y adaptabilidad en la evaluación de grandes modelos lingüísticos (LLM). Registra las trazas y los intervalos en solo 23,10 segundos y ofrece resultados de evaluación en unos impresionantes 0,34 segundos. Esto lo hace casi siete veces más rápido que Arize Phoenix y catorce veces más rápido que Langfuse. Leonardo Gonzalez, vicepresidente del Centro de Excelencia en Inteligencia Artificial de Trilogía, elogió su eficacia:

«Opik procesó las interacciones y entregó las métricas casi al instante después del registro, lo que supuso un tiempo de respuesta extraordinariamente rápido».

La velocidad de Opik se corresponde con su amplia compatibilidad con los principales modelos. Se integra perfectamente con plataformas como IA abierta, Anthropic, Bedrock y Predibase. Es Prompt Playground permite a los usuarios probar los modelos uno al lado del otro, modificar parámetros como la temperatura y cambiar de modelo para comparar el rendimiento en tiempo real. Además, Opik admite Jurados de LLM, lo que permite que varios modelos evalúen los resultados de forma independiente y combinen sus partituras en una sola partitura de conjunto. Su plataforma principal, Comet-ML, ha obtenido más de 14 000 estrellas en GitHub, lo que destaca su popularidad entre los desarrolladores.

Opik se destaca en la evaluación de los sistemas de generación aumentada por recuperación (RAG), ya que ofrece métricas especializadas para detectar alucinaciones, evaluar la relevancia de las respuestas y medir la precisión y el recuerdo del contexto. La plataforma rastrea automáticamente todo el proceso de LLM, lo que facilita a los desarrolladores la depuración de componentes en configuraciones complejas de RAG o de múltiples agentes. También se integra con el marco de Ragas. Recientemente, Opik amplió su biblioteca para incluir 37 métricas nuevas, como el BertScore y el análisis de opiniones.

Si bien las métricas automatizadas son una fortaleza clave, Opik también prioriza las aportaciones de los expertos. Es Colas de anotación permiten la revisión manual y la puntuación de las trazas por parte de expertos. El Puntuaciones de comentarios de varios valores La función permite a los miembros del equipo puntuar de forma independiente la misma puntuación, lo que minimiza el sesgo y mejora la precisión de la evaluación. Estas puntuaciones manuales se combinan con métricas automatizadas para crear un ciclo de retroalimentación continuo que permita refinar el rendimiento del modelo.

Opik's Reglas de evaluación en línea ofrecen opciones de muestreo configurables (10%-100%) e incluyen funciones como la redacción de PII. Alertas en tiempo real a través de Slack y Pager Duty notifique a los equipos sobre los sobrecostos, los problemas de latencia o los errores. Como plataforma de código abierto, Opik ofrece una generosa capa gratuita sin necesidad de una tarjeta de crédito. Para las empresas, ofrece funciones adicionales de escalabilidad y cumplimiento adaptadas a las necesidades del sector.

LangSmith se integra perfectamente con Cadena LANG ecosistema sin dejar de ser lo suficientemente flexible como para funcionar con otros marcos. Captura trazas anidadas en flujos de trabajo complejos, lo que permite a los desarrolladores identificar y solucionar problemas en áreas como la recuperación, las llamadas a herramientas o la generación.

De Lang Smith Prompt Playground permite a los desarrolladores probar varios LLM, como OpenAI y Anthropic, uno al lado del otro. Esta función facilita la evaluación de factores como la calidad, el coste y la latencia. Con su Evaluación comparativa de experimentos herramienta, los usuarios pueden ejecutar diferentes modelos o versiones rápidas en el mismo conjunto de datos seleccionado, lo que ofrece una comparación clara de los resultados. La plataforma también admite evaluadores de comparación por pares, en el que un juez de LLM o un revisor humano puntúa los resultados de dos modelos en una evaluación directa. Además, el abrir las votaciones El paquete permite a los equipos diseñar evaluadores independientes del modelo utilizando varios modelos para evaluar el rendimiento de las aplicaciones, lo que garantiza la flexibilidad al trabajar con diferentes proveedores.

LangSmith va más allá de las simples comparaciones de modelos y ofrece herramientas avanzadas para evaluar los sistemas RAG.

LangSmith proporciona información detallada sobre los sistemas RAG mediante el seguimiento de cada paso del proceso de recuperación. Los equipos pueden medir relevancia de recuperación (si se identificaron los documentos correctos) y precisión de respuesta (qué tan completas y correctas son las respuestas). Al utilizar un enfoque basado en el rastreo, LangSmith señala exactamente dónde se interrumpe un flujo de trabajo, lo que elimina las conjeturas a la hora de depurar procesos de recuperación complejos.

Además de sus evaluaciones detalladas, la plataforma ofrece una sólida supervisión de la producción para garantizar un funcionamiento fluido.

De Lang Smith Colas de anotación habilite flujos de trabajo estructurados en los que los expertos en la materia puedan revisar, puntuar y anotar las respuestas de las solicitudes. Como destaca LangChain:

«La retroalimentación humana a menudo proporciona la evaluación más valiosa, particularmente en lo que respecta a las dimensiones de calidad subjetiva».

Cuando los evaluadores automatizados o los comentarios de los usuarios marcan los rastros de producción, estos se envían a los expertos para que los revisen. Luego, los rastros anotados se transforman en conjuntos de datos «estándar» para realizar pruebas futuras, lo que mejora las capacidades del sistema con el tiempo.

LangSmith monitorea métricas clave como la latencia a nivel de solicitud, el uso de tokens y la atribución de costos en tiempo real. Es Evaluadores en línea permiten a los equipos tomar muestras de partes específicas del tráfico, como el 10%, para equilibrar la visibilidad con el costo, ya que admiten hasta 500 subprocesos evaluados simultáneamente en un período de cinco minutos. Este seguimiento en tiempo real garantiza que los problemas de producción se aborden de forma rápida y eficiente.

La plataforma cumple con los estándares de seguridad de nivel empresarial y mantiene Cumplimiento de HIPAA, SOC 2 tipo 2 y GDPR. Las comprobaciones automatizadas, que incluyen los filtros de seguridad, la validación de formatos y la heurística de calidad, añaden una capa adicional de protección. Las alertas básicas de errores y picos de latencia ayudan a los equipos a responder rápidamente a los incidentes. LangSmith utiliza un modelo de precios por rastreo, con una capa gratuita disponible, aunque los costos pueden aumentar significativamente si los volúmenes de producción son altos.

Ragas, fundada en 2023, se centra en evaluar las canalizaciones de RAG (generación aumentada por recuperación). Fruto de una investigación sobre métodos de evaluación sin referencias publicada a principios de ese año, separa el análisis del rendimiento de los componentes del generador del retriever. Esta distinción ayuda a los equipos a identificar si los problemas se deben a errores en la recuperación de datos o a alucinaciones en el modelo lingüístico, lo que coincide con el tema más amplio de las herramientas especializadas de evaluación.

Ragas ofrece métricas específicas para los procesos de recuperación y generación. Para la recuperación, mide:

Desde el punto de vista de la generación, evalúa:

Este enfoque granular simplifica la depuración de flujos de trabajo RAG complejos. Por ejemplo, en un índice de referencia de agosto de 2025, la precisión de un modelo pasó del 50 al 90% después de abordar problemas como el incumplimiento de las reglas y las condiciones límite.

Uso de un «LLM como juez» metodología, Ragas genera puntajes cuantitativos, lo que minimiza la necesidad de etiquetas manuales de verdad básica. También permite la generación de datos de pruebas sintéticas, con recomendaciones para empezar con 20 a 30 muestras y ampliarlas hasta 50 o 100 para obtener resultados más fiables.

Ragas se integra perfectamente con varios proveedores de LLM, incluidos OpenAI, Anthropic (Claude), Google (Gemini) y modelos locales a través de Ollama. Garantiza la reproducibilidad al permitir a los equipos bloquear versiones específicas del modelo (por ejemplo, «gpt-4o-2024-08-06") durante la evaluación comparativa, incluso cuando los proveedores actualizan sus modelos. Además, la herramienta es altamente ampliable, lo que permite personalizar las métricas a través de decoradores como @discrete_metric, que se puede usar para tareas como la validación de JSON.

Si bien Ragas hace hincapié en las métricas automatizadas, incorpora la supervisión humana para aumentar la confiabilidad. El marco incluye una interfaz de usuario para la anotación métrica, que permite a los usuarios agregar notas de calificación para probar conjuntos de datos y definir criterios de evaluación específicos para personas. Cada evaluación también incluye un razón_puntuación campo de la transparencia y la auditabilidad. Como dice la documentación de Ragas:

«Ragas es una biblioteca que le ayuda a pasar de las «comprobaciones de vibraciones» a los ciclos de evaluación sistemáticos para sus aplicaciones de IA».

Esta combinación de puntuación automatizada y participación humana garantiza una supervisión rigurosa del rendimiento, incluso en entornos dinámicos.

Ragas amplía sus capacidades al monitoreo de la producción al integrarse con plataformas de observabilidad como Langfuse y Arize. Esto permite la puntuación en tiempo real de los rastros de producción. Sus métricas sin referencias, como Fidelidad para detectar alucinaciones, son particularmente útiles en entornos en vivo donde las respuestas a la verdad básica no siempre están disponibles. El marco también admite la integración en las canalizaciones de CI/CD, lo que permite una evaluación continua para garantizar que las actualizaciones cumplan con los estándares de rendimiento y seguridad. Los equipos pueden optar por puntuar cada rastreo o utilizar un muestreo periódico por lotes para equilibrar los costos y, al mismo tiempo, mantener una visión del comportamiento del modelo.

Braintrust combina la evaluación y la supervisión de la producción directamente en los flujos de trabajo de ingeniería estándar, lo que garantiza un proceso fluido y eficiente.

Playground, de Braintrust, basado en la web, permite a los equipos comparar modelos en paralelo, lo que facilita las decisiones basadas en datos. Con Playground, los usuarios pueden ajustar las instrucciones, cambiar de modelo y realizar evaluaciones sin problemas. Las comparaciones paralelas destacan el rendimiento de los modelos con indicaciones idénticas, lo que ofrece información clara. Integrada con GitHub Actions, la plataforma ejecuta evaluaciones automáticamente con cada confirmación, comparando los resultados con las líneas de base y evitando las fusiones si la calidad disminuye. Braintrust incluye más de 25 calificadores integrados para medir métricas clave, como la factibilidad, la relevancia y la seguridad, y también permite obtener puntajes personalizados, ya sea mediante código o utilizando un LLM como juez. Además de las métricas automatizadas, la plataforma hace hincapié en la importancia de las opiniones de los expertos.

Para incorporar la experiencia humana, Braintrust presenta su flujo de trabajo «Anotate». Esto permite a los equipos configurar procesos de revisión, aplicar etiquetas y refinar los resultados de los modelos. Su interfaz sin código permite a los administradores de productos y a los expertos en dominios crear prototipos de las instrucciones y revisar los resultados con facilidad. Al combinar la puntuación automática con la retroalimentación humana, la plataforma capta sutilezas que los algoritmos podrían pasar por alto. Además, el agente de IA «Loop» identifica los patrones de error y extrae información de los registros de producción. Esta integración de las aportaciones humanas refleja los principios del desarrollo moderno basado en la evaluación. Lee Weisberger de Airtable compartió:

«Cada nuevo proyecto de IA comienza con evaluaciones en Braintrust, lo que supone un punto de inflexión».

Braintrust amplía sus capacidades a entornos de producción en vivo, evaluando continuamente el tráfico utilizando las mismas métricas de calidad aplicadas durante el desarrollo. Realiza un seguimiento detallado del uso de los tokens (por usuario, función y conversación) para detectar patrones costosos de forma temprana, lo que ayuda a los equipos a gestionar los presupuestos de forma eficaz. La plataforma también ofrece un rendimiento excepcional, ya que ofrece una búsqueda de texto completo 23,9 veces más rápida (401 ms frente a 9.587 ms) y una latencia de escritura 2,55 veces más rápida. Sarah Sachs, jefa de ingeniería de Noción, comentó:

«Brainstore ha cambiado por completo la forma en que nuestro equipo interactúa con los registros. Hemos podido descubrir información realizando búsquedas en segundos, lo que antes tardaba horas».

Para las organizaciones con necesidades estrictas de soberanía de datos, Braintrust ofrece opciones de autoalojamiento y cuenta con la certificación SOC 2 de tipo II, lo que garantiza el cumplimiento y la seguridad.

Nota: Las funciones independientes de Humanloop reflejan las capacidades de la plataforma antes de que Anthropic la adquiriera a finales de 2024. Estas funcionalidades anteriores han dado forma a los enfoques de evaluación integrados que se utilizan en la actualidad, destacando la progresión de las prácticas de desarrollo impulsadas por la evaluación.

Humanloop cerró la brecha entre los ingenieros y los colaboradores no técnicos, ofreciendo un espacio de trabajo compartido donde los gerentes de producto, los equipos legales y los expertos en la materia podían participar activamente en la ingeniería y la evaluación rápidas, sin necesidad de hojas de cálculo engorrosas. A continuación se muestra con más detalle cómo Humanloop simplificó los flujos de trabajo de evaluación.

Humanloop permitió a los equipos comparar varios modelos base uno al lado del otro utilizando un único conjunto de datos. Esto incluía modelos de OpenAI (GPT-4o, GPT-4o-mini), el Claude 3.5 Sonnet de Anthropic, Google y opciones de código abierto como Mistral. Los gráficos de arañas proporcionaron una visualización clara de las compensaciones entre factores como el costo, la latencia y la satisfacción del usuario. Por ejemplo, una evaluación documentó que el GPT-4o ofrecía una mayor satisfacción de los usuarios, pero a un costo mayor y a una velocidad más lenta. Además, la función de almacenamiento en caché de registros de la plataforma permitía a los equipos reutilizar los registros para conjuntos de datos y solicitudes específicos, lo que reducía el tiempo y los gastos durante las evaluaciones. Esta función abordó los desafíos que planteaba el rendimiento variable de los modelos lingüísticos de gran tamaño, un problema común en los marcos de evaluación modernos.

Para los casos de uso de generación aumentada por recuperación (RAG), Humanloop ofreció plantillas prediseñadas. Estas plantillas incluían evaluadores basados en la inteligencia artificial como juez, diseñados para verificar la exactitud de los hechos y garantizar la relevancia del contexto.

La interfaz de la plataforma permitió a los expertos revisar los registros, proporcionar comentarios binarios, categóricos o textuales y agregar notas de calificación para refinar los criterios de evaluación. Los equipos informaron que ahorraron entre 6 y 8 horas de ingeniería cada semana gracias a estos flujos de trabajo simplificados. Humanloop apoyó tanto las pruebas offline para comparar las nuevas versiones como la monitorización online para revisar los datos de producción en directo.

Humanloop también se destacó en la supervisión de la producción, al integrar las evaluaciones en los procesos de CI/CD para detectar las regresiones antes de la implementación. Los evaluadores en línea automatizados supervisaron los registros de producción en tiempo real, rastrearon las tendencias de rendimiento y activaron alertas para detectar cualquier caída en el rendimiento. Daniele Alfarone, director sénior de ingeniería de Dixa, hizo hincapié en la importancia de la plataforma:

«No tomamos ninguna decisión nueva de despliegue de LLM antes de evaluar primero los nuevos modelos a través de Humanloop. El equipo cuenta con métricas de rendimiento en materia de evaluación que les dan confianza».

La plataforma también era compatible con la seguridad de nivel empresarial con opciones de control de versiones, cumplimiento de SOC-2 y alojamiento automático.

Creado por el Instituto de Seguridad de la Inteligencia Artificial del Reino Unido, Inspect AI adopta un enfoque basado en la investigación para evaluar los grandes modelos lingüísticos (LLM), haciendo hincapié en la seguridad y la protección. Su licencia MIT de código abierto garantiza la accesibilidad para los equipos dedicados a realizar pruebas de desarrollo exhaustivas. El marco incluye más de 100 evaluaciones prediseñadas, que abarcan áreas como la codificación, el razonamiento, las tareas de agencia y la comprensión multimodal.

Con el conjunto de evaluación comando, Inspect AI permite a los usuarios ejecutar una sola tarea de evaluación en varios modelos simultáneamente, aprovechando la ejecución paralela para ahorrar tiempo en la evaluación comparativa. Es compatible con una variedad de proveedores, incluidos OpenAI, Anthropic, Google, Mistral, Cara abrazada, y modelos locales a través de VLLM o Ollama. Al agregar el nombre del proveedor al ID del modelo, los usuarios pueden comparar el rendimiento, la velocidad y el costo entre diferentes proveedores de inferencias. Políticas de selección automatizadas, como : más rápido o : más barato, agiliza aún más las evaluaciones al redirigir las tareas al proveedor más eficiente en función del rendimiento y el costo. Por ejemplo, en un punto de referencia, el gpt-oss-120b El modelo demostró una precisión variable, con una puntuación de 0.84 en Hyperbolic, mientras que Groq y Sambanova obtuvieron una puntuación de 0.80. Esta capacidad de comparación entre varios modelos se ve reforzada por la supervisión humana para garantizar una validación precisa del rendimiento.

Además de los puntos de referencia automatizados, Inspect AI integra la evaluación humana para establecer puntos de referencia de rendimiento en comparación con las capacidades humanas en las tareas computacionales. Su solucionador de agentes facilita este proceso, mientras que la función de aprobación de herramientas permite a los humanos revisar y aprobar las llamadas que realizan las modelos a las herramientas durante las evaluaciones. Para obtener información en tiempo real, la herramienta web Inspect View y la extensión VS Code permiten visualizar las trayectorias de evaluación, lo que permite analizar y depurar errores de forma manual. El Instituto de Seguridad de la Inteligencia Artificial del Reino Unido destaca la adaptabilidad del marco:

«Inspect se puede utilizar para una amplia gama de evaluaciones que miden la codificación, las tareas de agencia, el razonamiento, el conocimiento, el comportamiento y la comprensión multimodal».

Aunque está diseñado principalmente para pruebas y desarrollo, Inspect AI también sobresale en seguridad y cumplimiento. Su sistema de sandboxing, compatible con Estibador, Kubernetes, Modal y Proxmox - permite que el código generado por modelos no confiables se ejecute en entornos aislados. Al mismo tiempo, requiere autorización humana para utilizar herramientas críticas, una característica esencial para evaluar los flujos de trabajo de las agencias en escenarios de alto riesgo. Estas medidas reflejan el fuerte enfoque de la plataforma en las pruebas seguras y confiables, alineándose con las mejores prácticas del sector en materia de seguridad y protección de la IA.

Elija la mejor herramienta de evaluación de LLM evaluando características esenciales como la compatibilidad multimodelo, la evaluación RAG, los flujos de trabajo interconectados entre humanos y la supervisión de la producción.

A continuación se muestra un desglose de estas capacidades en varias plataformas:

Si bien la mayoría de las herramientas admiten las cuatro capacidades, sus métodos de implementación son diferentes. Por ejemplo, Inspeccione la IA se centra en la revisión manual con depuración de trazas individuales, lo que lo hace más adecuado para las pruebas de desarrollo, pero ofrece una supervisión de producción limitada.

Elegir la herramienta de evaluación de LLM adecuada en 2026 no consiste en buscar la opción con más funciones, sino en alinear las capacidades de la herramienta con su flujo de trabajo único. Ya sea que se centre en las canalizaciones de CI/CD con una integración nativa de Pytest, en los sistemas de producción que requieren supervisión en tiempo real o en las aplicaciones RAG que necesitan un análisis basado en el rastreo, la herramienta ideal debería integrarse sin problemas con su infraestructura actual. Este énfasis en la funcionalidad personalizada subraya la creciente importancia de la evaluación basada en métricas.

El cambio de la industria de las evaluaciones subjetivas a las métricas basadas en datos ya no es opcional, sino esencial para los entornos de producción. OpenAI destaca este punto:

«Si estás construyendo con LLM, crear evaluaciones de alta calidad es una de las cosas más impactantes que puedes hacer».

Este enfoque garantiza que la puntuación automatizada sea escalable y confiable cuando se combina con la supervisión de expertos.

La interoperabilidad y el cumplimiento también se han vuelto innegociables. Las herramientas que admiten múltiples sistemas de inferencia permiten realizar pruebas de rendimiento en diversas configuraciones de hardware, mientras que los marcos de referencia de seguridad y moderación integrados ayudan a los equipos a cumplir los requisitos reglamentarios de 2026. Estas medidas de protección son fundamentales para abordar cuestiones como los prejuicios, la toxicidad y los problemas de privacidad. Al adoptar una estrategia de evaluación continua, las organizaciones pueden pasar de las pruebas aisladas a un proceso más dinámico de mejora continua del modelo.

Como se mencionó, escribir pruebas con alcance en cada etapa, en lugar de esperar hasta después de la implementación, genera mejores resultados. Los equipos que registran los datos de desarrollo pueden identificar los casos extremos, utilizar comparaciones por pares para obtener una puntuación más uniforme durante la maestría como juez y crear circuitos de retroalimentación que convierten las pruebas fallidas en valiosos conjuntos de datos de prueba. Este «círculo vicioso de datos» transforma la evaluación, que deja de ser una tarea puntual, para convertirse en un ciclo continuo de mejora.

La evaluación RAG (Retrieval-Augmented Generation) desempeña un papel crucial en la comprensión del proceso de dos pasos detrás de muchas aplicaciones de modelos de lenguaje grandes (LLM). Este proceso implica recuperar información relevante de una base de conocimientos externa y luego generar respuestas basadas en ese contexto. Al evaluar el recuperador y el generador de forma independiente, la evaluación RAG facilita la identificación de los problemas, ya sea que se trate de información irrelevante que se está recuperando o de inexactitudes en el resultado generado. Este enfoque simplifica tanto la depuración como el ajuste.

Métricas como pertinencia, fidelidad, precisión, y recordar son clave para garantizar que los datos recuperados respalden la respuesta final y que el modelo represente la información con precisión. Este nivel de evaluación es especialmente importante para las tareas que exigen conocimientos actuales o especializados, como la investigación legal, el servicio al cliente o el análisis científico.

En última instancia, la evaluación RAG proporciona una comprensión detallada del rendimiento de un LLM, lo que garantiza que los flujos de trabajo produzcan resultados precisos y confiables, un factor esencial para implementar con éxito la IA en escenarios prácticos y de alto riesgo.

Los flujos de trabajo Human-in-the-Loop (HITL) aportan un valioso equilibrio a la evaluación de grandes modelos lingüísticos (LLM) al combinar herramientas automatizadas con conocimientos humanos expertos. Si bien las métricas automatizadas son excelentes para detectar rápidamente los errores obvios, a menudo no son suficientes cuando se trata de evaluar aspectos más matizados, como la precisión de los hechos, los problemas de seguridad o el rendimiento de un modelo en dominios específicos. Los revisores humanos intervienen para abordar estas brechas, ofreciendo evaluaciones detalladas y de alta calidad que ayudan a establecer puntos de referencia más confiables y a refinar los criterios utilizados para la evaluación.

Estos flujos de trabajo suelen estar integrados en los procesos de prueba y desarrollo, lo que permite a los equipos probar los LLM en conjuntos de datos cuidadosamente seleccionados y descubrir posibles problemas antes de la implementación. Esta combinación de automatización y aportaciones de expertos no solo acelera el proceso de mejora de los modelos, sino que también garantiza que las evaluaciones reflejen escenarios prácticos del mundo real. En áreas de alto riesgo, como la atención médica, la participación de los expertos es especialmente crucial para garantizar que los modelos cumplan con los estrictos estándares de precisión, seguridad y responsabilidad ética.

El soporte multimodelo desempeña un papel clave a la hora de permitir a los profesionales evaluar y comparar varios modelos de grandes lenguajes (LLM) de diferentes proveedores o arquitecturas dentro de un marco único y unificado. Esta configuración garantiza condiciones de prueba uniformes y una evaluación comparativa reproducible, lo que ofrece a los usuarios una comprensión clara del rendimiento de los diferentes modelos cuando se evalúan en circunstancias idénticas.

Al facilitar las comparaciones paralelas, el soporte multimodelo ofrece una visión más profunda de los puntos fuertes, las limitaciones y la idoneidad de cada modelo para tareas específicas. Este enfoque proporciona a los profesionales del aprendizaje automático la información que necesitan para tomar decisiones más inteligentes y optimizar sus flujos de trabajo de IA de manera eficiente.