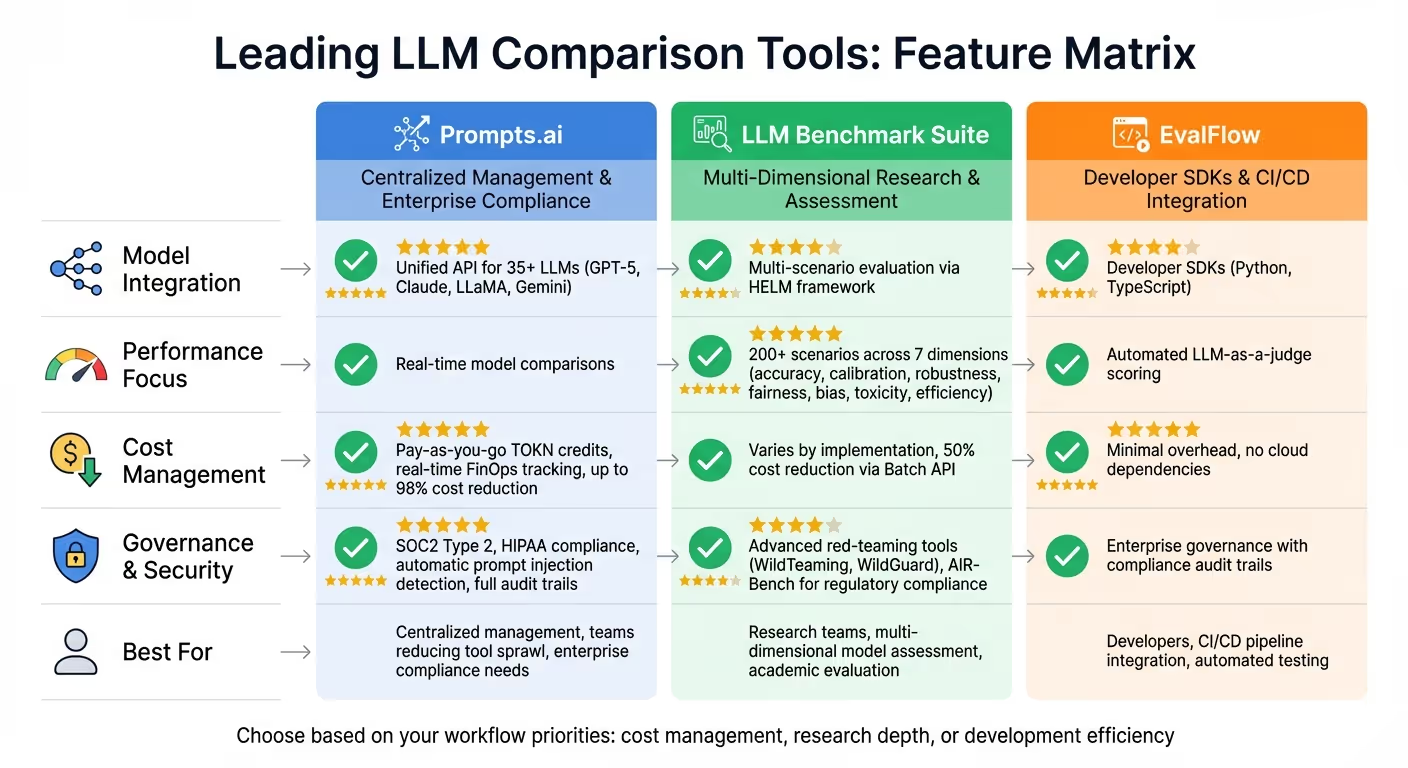

Choisir le bon modèle de langage de grande taille (LLM) peut être une tâche ardue compte tenu de la multitude d'options et des coûts variables. Des outils tels que Prompts.ai, Suite LLM Benchmark, et EvalFlow simplifiez ce processus en proposant des fonctionnalités telles que le suivi des coûts en temps réel, une sécurité robuste et des benchmarks de performance détaillés. Voici ce que vous devez savoir :

Ces outils rationalisent l'évaluation du LLM, vous permettant de gagner du temps, de réduire les coûts et de garantir une mise en œuvre sécurisée. Vous trouverez ci-dessous une comparaison rapide de leurs principales caractéristiques.

Chaque outil est adapté à des besoins spécifiques, qu'il s'agisse d'une gestion centralisée, d'une intégration conviviale pour les développeurs ou d'évaluations de niveau recherche.

Matrice des fonctionnalités des outils de comparaison LLM : Prompts.ai contre LLM Benchmark Suite contre EvalFlow

Prompts.ai simplifie l'accès à plus de 35 LLM de premier plan, tels que GPT-5, Claude, LLama et Gemini, via une plateforme unique et unifiée. En consolidant ces modèles, il élimine les tracas liés à la gestion de plusieurs clés d'API et comptes de facturation. Agissant comme une couche proxy, la plateforme connecte les utilisateurs à des terminaux tels que IA ouverte, Anthropique, et N'importe quelle échelle, reflétant le fonctionnement des outils LLM modernes en 2026. Les sections suivantes mettent en évidence ses caractéristiques remarquables en matière d'intégration de modèles, de gestion des coûts et de sécurité.

Prompts.ai s'intègre parfaitement aux frameworks d'orchestration les plus courants, notamment Chaîne Lang, Indice de lama, et des agents OpenAI. Cette architecture permet aux organisations d'intégrer facilement la plateforme à leurs flux de travail d'IA existants. Passer d'un modèle à l'autre ou en tester de nouveaux ne prend que quelques minutes, ce qui vous permet de garder une longueur d'avance dans un paysage d'IA en évolution rapide.

Avec Prompts.ai, les utilisateurs bénéficient d'une visibilité en temps réel sur l'utilisation des jetons dans tous les modèles et équipes. Ce suivi en temps réel permet des ajustements immédiats, évitant ainsi des factures imprévues à la fin du mois. Les coûts sont directement liés à des projets spécifiques, à des instructions et à des membres de l'équipe, offrant ainsi une clarté inégalée. La plateforme fonctionne sur un système de crédit TOKN à paiement à l'utilisation sans frais d'abonnement, garantissant ainsi aux utilisateurs de ne payer que pour ce qu'ils utilisent, sans perte de capacité.

La plateforme inclut des mesures de sécurité robustes, détectant automatiquement les injections rapides et les tentatives de jailbreak tout en signalant les violations des règles ou les violations potentielles de données. Les données sensibles, telles que les informations personnelles identifiables, sont automatiquement supprimées avant d'être enregistrées ou stockées. En outre, chaque interaction est liée à des versions spécifiques d'instructions, de modèles et de jeux de données, créant ainsi une piste d'audit détaillée pour les examens de conformité. Ces fonctionnalités garantissent un environnement sécurisé et fiable pour les opérations quotidiennes.

La suite LLM Benchmark propose une évaluation approfondie des modèles linguistiques grâce à des protocoles de test standardisés. Un exemple remarquable est le framework HELM de Stanford, qui évalue les modèles selon Plus de 200 scénarios et considère sept dimensions clés: précision, étalonnage, robustesse, équité, biais, toxicité et efficacité. En allant au-delà de la simple précision, cette approche à multiples facettes fournit une compréhension complète des performances du modèle. Ces évaluations jettent les bases des informations détaillées sur les performances et la sécurité abordées ci-dessous.

La suite s'appuie sur des benchmarks bien établis, notamment MMLU (Massive Multitask Language Understanding), GSM8K pour le raisonnement mathématique, HumanEval pour les tâches de codage et BIG-Bench Hard. Des outils tels que Éval de lumière étendre encore ses capacités, en soutenant plus de 1 000 tâches d'évaluation dans différents domaines. HELM a notamment considérablement étendu la couverture de ses scénarios, passant de 18 % à 96 %. Il va également au-delà des mesures de précision traditionnelles en incorporant des mesures telles que le temps d'inférence et l'utilisation des ressources de calcul, offrant ainsi une analyse des performances plus complète.

« HELM a été créé pour remédier aux pratiques d'évaluation fragmentées et incohérentes qui prévalent dans la recherche en LLM, permettant des comparaisons standardisées, transparentes et reproductibles. » — Stanford CRFM

La sécurité et la gouvernance sont tout aussi essentielles dans ces évaluations. Le Banc Air-bench Leaderboard, par exemple, évalue les modèles par rapport aux réglementations et politiques d'entreprise émergentes. Des outils avancés tels que Une équipe sauvage fournir des fonctionnalités automatisées de collaboration pour découvrir les vulnérabilités, tandis que WildGuard évalue la sécurité en temps réel. La confidentialité est un autre objectif essentiel, avec la ConfAide benchmark spécialement conçu pour tester dans quelle mesure les modèles gèrent les informations personnelles sensibles.

Ces outils mettent non seulement en valeur les performances, mais garantissent également une mise en œuvre sécurisée dans des applications pratiques. Les organisations peuvent créer des registres d'évaluation privés à l'aide de plateformes telles que Evaluations OpenAI, leur permettant de tester des données propriétaires en toute sécurité et sans exposition publique. En outre, l'utilisation de l'API Batch peut réduire les coûts d'évaluation jusqu'à 50 % par rapport aux méthodes d'inférence en temps réel.

EvalFlow prend un approche axée sur le développeur à l'évaluation de grands modèles de langage (LLM), en les intégrant parfaitement aux flux de travail modernes de l'IA au lieu de fonctionner comme un outil distinct. Dans le paysage actuel, les plateformes d'évaluation traitent les ensembles de données, les invites et les politiques comme des actifs versionnés au sein de LLMOP. Cette intégration aide les équipes à respecter des normes de qualité cohérentes lors de la transition des modèles du développement à la production. EvalFlow complète les principaux outils évoqués précédemment, en affinant davantage les processus LLMOPs.

EvalFlow peut être intégré à l'aide de SDK standard en Python et TypeScript. Cette configuration permet aux développeurs de suivre et de contrôler en détail le comportement des modèles à chaque étape du déploiement. En intégrant l'évaluation directement dans le pipeline de développement, EvalFlow élimine le besoin de points de contrôle manuels, ce qui rend le processus plus efficace et plus fiable.

Grâce à son framework LLM-as-a-Judge, EvalFlow automatise la notation et suit les expériences de manière systématique. Cela permet aux équipes de comparer efficacement les modèles et de détecter rapidement les problèmes de performance, en veillant à ce que les modèles répondent aux attentes avant le déploiement.

Le processus d'évaluation automatisé d'EvalFlow inclut des fonctionnalités de gouvernance de niveau entreprise. Ces contrôles permettent aux organisations de conserver des pistes d'audit et des dossiers de conformité tout au long du cycle de vie de l'évaluation. Cela est particulièrement crucial lorsque vous travaillez avec des données sensibles ou que vous respectez des normes réglementaires, car cela apporte un niveau supplémentaire de sécurité et de responsabilité.

Cette section met en évidence les avantages et les limites de chaque outil, afin de vous aider à déterminer celui qui correspond le mieux à vos besoins en matière de flux de travail d'IA.

Chaque outil présente ses avantages et ses inconvénients, en fonction de vos priorités.

Prompts.ai se distingue par sa capacité à centraliser la gestion des modèles, réunissant plus de 35 LLM de premier plan au sein d'une interface unique et unifiée. Il permet des comparaisons directes de modèles, un suivi des coûts FinOps en temps réel et une gouvernance de niveau entreprise, le tout en un seul endroit. Son système de crédit TOKN par paiement à l'utilisation peut réduire les coûts des logiciels d'IA jusqu'à 98 %, tout en maintenant la conformité aux normes SOC2 Type 2 et HIPAA. Cependant, les organisations fortement investies dans des frameworks spécifiques peuvent rencontrer certains défis initiaux lors de la transition de leurs flux de travail existants.

D'autre part, Suite LLM Benchmark les plateformes, comme HELM, se distinguent par leur capacité à évaluer des modèles sur de multiples plans, notamment en termes de précision, de sécurité et d'efficacité. Le CRFM de Stanford le décrit comme un « véritable cadre d'évaluation du LLM » qui couvre divers domaines, tels que les domaines juridique, médical et technique. Cela dit, la nature non déterministe des résultats probabilistes peut compliquer les mesures de cohérence, et de nombreuses tâches d'évaluation n'ont pas de réponses définitives, en particulier pour les tâches ouvertes telles que la synthèse.

De même, EvalFlow est particulièrement bien adapté aux environnements axés sur les développeurs. Il s'intègre parfaitement aux pipelines CI/CD sans nécessiter de configurations cloud ni de dépendances au SDK. Son framework LLM-as-a-Judge automatise la notation de manière systématique. Cependant, il offre moins de visibilité au niveau de la production. Greg Brockman, président d'OpenAI, souligne son importance :

« Si vous construisez avec des LLM, créer des évaluations de haute qualité est l'une des choses les plus efficaces que vous puissiez faire ».

Vous trouverez ci-dessous un tableau comparant ces outils en fonction de l'intégration, des performances, des coûts et de la gouvernance :

Ces comparaisons mettent en évidence les compromis à prendre en compte lors de l'intégration de ces outils dans vos flux de travail.

Le verrouillage des écosystèmes est une source de préoccupation potentielle : le choix d'une plateforme peut limiter la flexibilité des équipes travaillant dans des environnements multimodèles ou multicloud. En outre, si des outils profondément intégrés peuvent offrir une observabilité robuste, ils nécessitent souvent un investissement d'ingénierie important.

La sélection du meilleur outil de comparaison LLM dépend de vos objectifs spécifiques. Prompts.ai se distingue en rationalisant la gestion des modèles, le suivi des coûts et la gouvernance dans plus de 35 LLM. Avec son système de crédit TOKN pay-as-you-go et ses normes de conformité strictes, il convient parfaitement aux équipes qui souhaitent réduire la prolifération des outils tout en respectant des exigences de sécurité strictes.

Pour les équipes de recherche qui procèdent à des évaluations approfondies de modèles, des plateformes telles que HELM se distinguent par leurs capacités d'évaluation multidimensionnelle, qui analysent des paramètres tels que la précision, la sécurité et l'efficacité.

Le secteur évolue également vers des méthodes d'évaluation basées sur le comportement, modifiant ainsi la façon dont les équipes évaluent les performances du LLM. Comme le souligne Anthropic :

« L'évaluation du comportement d'un modèle, et pas seulement de ce qu'il dit, pourrait devenir une dimension cruciale de la confiance et de la sécurité dans les systèmes d'IA de prochaine génération ».

Cette approche met l'accent sur la surveillance du raisonnement en plusieurs étapes et de l'utilisation des outils, en allant au-delà des sorties statiques. Ces avancées soulignent l'importance d'aligner les fonctionnalités des outils sur les priorités de votre flux de travail.

Chaque outil possède ses propres atouts, adaptés à des besoins opérationnels spécifiques. Prompts.ai excelle dans la gestion centralisée avec des fonctionnalités FinOps et de conformité intégrées. BARRE propose une analyse comparative détaillée pour les environnements axés sur la recherche, tandis que EvalFlow s'adresse aux développeurs grâce à une intégration transparente du pipeline CI/CD. Pour les équipes travaillant sur des flux de travail agentiques, des outils prenant en charge les évaluations multi-tours et un suivi robuste sont essentiels. En adaptant les fonctionnalités des outils à vos priorités, que ce soit pour la gestion des coûts, la conformité réglementaire, l'efficacité du développement ou le suivi de la production, vous pouvez choisir en toute confiance la solution qui répond le mieux à vos besoins.

Prompts.ai propose une plateforme basée sur le cloud conçu pour simplifier et améliorer votre travail à l'aide de grands modèles de langage (LLM). Avec l'accès à plus de 35 modèles, vous pouvez les tester et les comparer côte à côte, sans aucun codage. Exécutez la même invite sur plusieurs modèles, obtenez des résultats instantanés et examinez des indicateurs clés tels que la précision, la latence et l'utilisation des jetons, le tout à partir d'un tableau de bord intuitif. De plus, grâce au suivi des coûts en temps réel en dollars américains et à la tarification au niveau des jetons, il est facile de repérer les demandes coûteuses et de gérer efficacement votre budget.

Au-delà de simples comparaisons, Prompts.ai optimise les flux de travail LLM en consolidant l'accès aux API, en réduisant les appels redondants et en centralisant les mesures de sécurité. Cela permet non seulement d'améliorer l'efficacité et de réduire les dépenses, mais également de réduire le risque de violations de données. La plateforme est conçue pour le travail d'équipe, permettant aux utilisateurs de partager les résultats et de collaborer sans effort. Que vous soyez un utilisateur non spécialisé qui explore les LLM ou que vous travailliez pour une entreprise jonglant avec plusieurs modèles, Prompts.ai fournit les outils et les informations nécessaires pour rendre votre travail plus fluide et plus efficace.

Le Suite LLM Benchmark offre un moyen complet d'évaluer les modèles en les testant dans plus de 200 scénarios. Ces tests couvrent des domaines clés tels que la précision, la robustesse, l'efficacité et les considérations éthiques, donnant une image claire des points forts de chaque modèle et des domaines dans lesquels il pourrait être amélioré.

Avec des ensembles de données standardisés et une API unifiée, la suite garantit des comparaisons cohérentes et transparentes entre les modèles. Il comprend également des outils tels qu'une interface Web et un classement, permettant aux utilisateurs de se plonger dans des résultats détaillés. Ces fonctionnalités facilitent l'évaluation des performances techniques et des aspects éthiques dans les applications pratiques.

Les détails concernant EvalFlow et ses caractéristiques ne sont pas incluses dans les informations fournies. Sans contexte supplémentaire ni description de ses fonctionnalités, il est difficile de discuter de la manière dont il pourrait s'intégrer dans des environnements axés sur les développeurs. Si vous pouvez nous en dire plus sur EvalFlow, je serais heureuse de vous proposer une réponse adaptée à ses caractéristiques spécifiques.