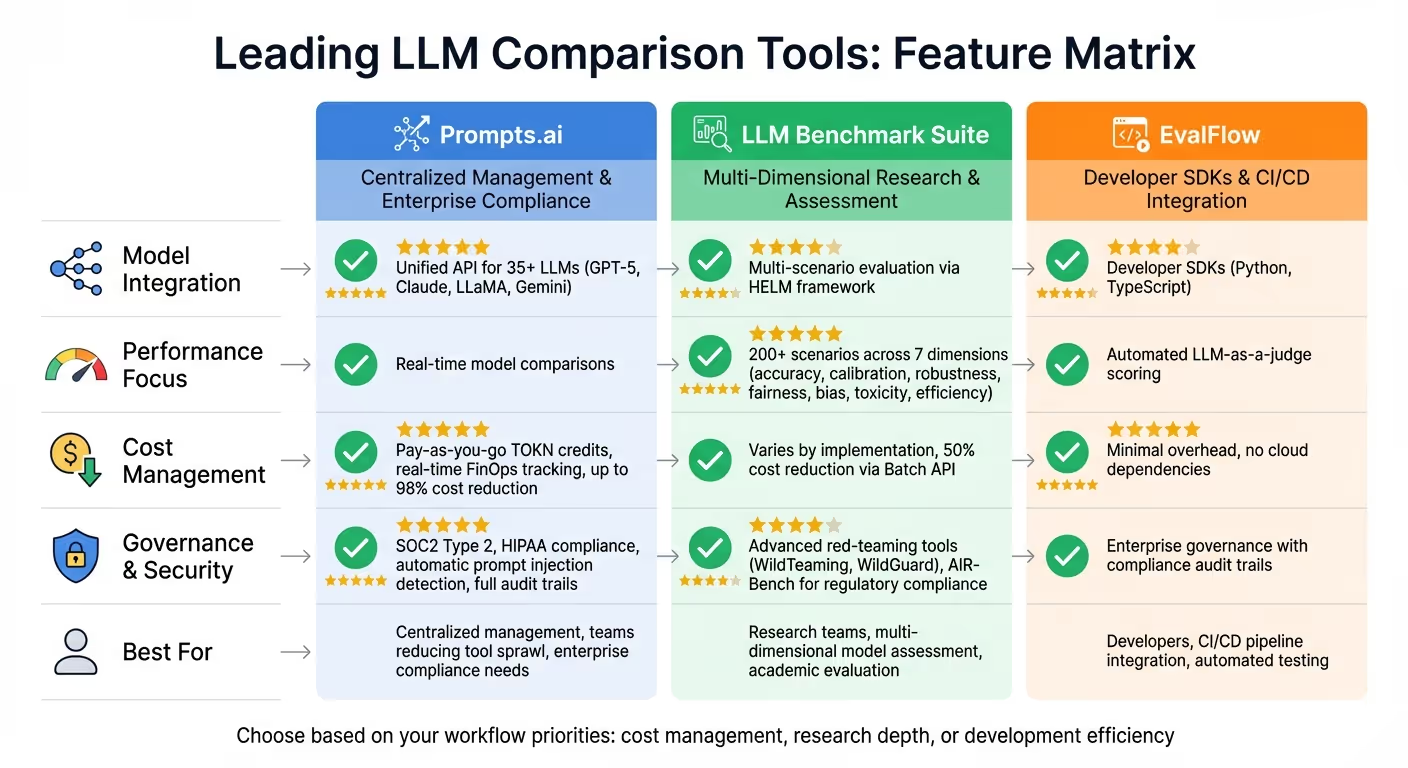

Seleccionar el modelo lingüístico de gran tamaño (LLM) adecuado puede resultar abrumador con tantas opciones y costos variables. Herramientas como Prompts.ai, Suite de referencia LLM, y EvalFlow simplifique este proceso al ofrecer funciones como el seguimiento de costos en tiempo real, una seguridad sólida y puntos de referencia de rendimiento detallados. Esto es lo que necesita saber:

Estas herramientas agilizan la evaluación de la LLM, lo que le ayuda a ahorrar tiempo, reducir costos y garantizar una implementación segura. A continuación se muestra una comparación rápida de sus principales funciones.

Cada herramienta se adapta a las necesidades específicas, desde la administración centralizada hasta la integración fácil para los desarrolladores o las evaluaciones con nivel de investigación.

Matriz de funciones de herramientas de comparación de LLM: Prompts.ai frente a LLM Benchmark Suite frente a EvalFlow

Prompts.ai simplifica el acceso a más de 35 LLM líderes, como GPT-5, Claude, LLama y Gemini, a través de una plataforma única y unificada. Al consolidar estos modelos, se elimina la molestia de administrar varias claves de API y cuentas de facturación. Al actuar como una capa de proxy, la plataforma conecta a los usuarios con puntos finales como IA abierta, Antrópico, y Cualquier escala, que refleja cómo funcionan las herramientas modernas de LLM en 2026. En las siguientes secciones se destacan sus características más destacadas en lo que respecta a la integración de modelos, la gestión de costes y la seguridad.

Prompts.ai se integra a la perfección con los marcos de orquestación más populares, que incluyen Cadena LANG, Índice Llamay agentes de OpenAI. Esta arquitectura permite a las organizaciones incorporar la plataforma a sus flujos de trabajo de IA existentes sin esfuerzo. Cambiar de un modelo a otro o probar otros nuevos lleva solo unos minutos, lo que facilita mantenerse a la vanguardia en un panorama de inteligencia artificial que cambia rápidamente.

Con Prompts.ai, los usuarios obtienen visibilidad en tiempo real del uso de los tokens en todos los modelos y equipos. Este seguimiento en tiempo real permite realizar ajustes inmediatos y evitar facturas inesperadas al final del mes. Los costos están directamente relacionados con los proyectos, las solicitudes y los miembros del equipo específicos, lo que ofrece una claridad sin igual. La plataforma funciona con un sistema de crédito TOKN de pago por uso sin comisiones de suscripción, lo que garantiza que los usuarios solo paguen por lo que utilizan, sin desperdiciar capacidad.

La plataforma incluye medidas de seguridad sólidas que detectan automáticamente las inyecciones rápidas y los intentos de jailbreak y, al mismo tiempo, señala las infracciones de las reglas o las posibles violaciones de datos. Los datos confidenciales, como la información de identificación personal, se redactan automáticamente antes de registrarlos o almacenarlos. Además, cada interacción está vinculada a versiones específicas de las indicaciones, los modelos y los conjuntos de datos, lo que crea un registro de auditoría detallado para las revisiones de cumplimiento. Estas funciones garantizan un entorno seguro y confiable para las operaciones diarias.

La suite LLM Benchmark ofrece una evaluación exhaustiva de los modelos lingüísticos a través de protocolos de prueba estandarizados. Un ejemplo sobresaliente es el marco HELM de Stanford, que evalúa modelos de diferentes tipos Más de 200 escenarios y considera siete dimensiones clave: precisión, calibración, robustez, equidad, sesgo, toxicidad y eficiencia. Al mirar más allá de la precisión, este enfoque multifacético ofrece una comprensión completa del rendimiento del modelo. Estas evaluaciones sientan las bases para obtener información detallada sobre el rendimiento y la seguridad que se analiza a continuación.

La suite se basa en puntos de referencia bien establecidos, como MMLU (Massive Multitask Language Understanding), GSM8K para el razonamiento matemático, HumanEval para tareas de codificación y Big-Bench Hard. Herramientas como Lighteval ampliar aún más sus capacidades, apoyando más de 1000 tareas de evaluación en varios dominios. Cabe destacar que HELM ha ampliado significativamente su cobertura de escenarios, pasando del 18% a un impresionante 96%. También va más allá de las medidas de precisión tradicionales al incorporar métricas como el tiempo de inferencia y el uso de los recursos computacionales, lo que ofrece un análisis de rendimiento más completo.

«HELM se creó para abordar las prácticas de evaluación fragmentadas e inconsistentes que prevalecen en la investigación de LLM, lo que permite realizar comparaciones estandarizadas, transparentes y reproducibles». — Stanford CRFM

La seguridad y la gobernanza son igualmente vitales en estas evaluaciones. El Banco de aire La tabla de clasificación, por ejemplo, evalúa los modelos comparándolos con las regulaciones y políticas corporativas emergentes. Herramientas avanzadas como Wild Teaming proporcionan capacidades automatizadas de trabajo en equipo rojo para descubrir vulnerabilidades, al mismo tiempo WildGuard evalúa la seguridad en tiempo real. La privacidad es otro enfoque fundamental, con la Confaide punto de referencia diseñado específicamente para probar qué tan bien los modelos manejan la información personal confidencial.

Estas herramientas no solo destacan el rendimiento, sino que también garantizan una implementación segura en aplicaciones prácticas. Las organizaciones pueden crear registros de evaluación privados utilizando plataformas como Evaluaciones de OpenAI, lo que les permite probar datos privados de forma segura y sin exposición pública. Además, aprovechar la API Batch puede reducir los costos de evaluación hasta en un 50% en comparación con los métodos de inferencia en tiempo real.

EvalFlow toma un enfoque centrado en el desarrollador para evaluar modelos lingüísticos de gran tamaño (LLM), integrándolos a la perfección en los flujos de trabajo de IA modernos en lugar de funcionar como una herramienta independiente. En el panorama actual, las plataformas de evaluación tratan los conjuntos de datos, las solicitudes y las políticas como activos versionados en los LLMOP. Esta integración ayuda a los equipos a mantener estándares de calidad consistentes a medida que los modelos pasan del desarrollo a la producción. EvalFlow complementa las principales herramientas mencionadas anteriormente, refinando aún más los procesos de LLMOP.

EvalFlow se puede integrar mediante SDK estándar en Python y TypeScript. Esta configuración ofrece a los desarrolladores un seguimiento y un control detallados del comportamiento del modelo en cada etapa de la implementación. Al integrar la evaluación directamente en el proceso de desarrollo, EvalFlow elimina la necesidad de establecer puntos de control manuales, lo que hace que el proceso sea más eficiente y confiable.

Con su marco LLM-as a Judge, EvalFlow automatiza la puntuación y hace un seguimiento sistemático de los experimentos. Esto permite a los equipos comparar los modelos de forma eficaz y detectar los problemas de rendimiento de forma temprana, lo que garantiza que los modelos cumplan con las expectativas antes de la implementación.

El proceso de evaluación automatizado de EvalFlow incluye funciones de gobierno de nivel empresarial. Estos controles permiten a las organizaciones mantener registros de auditoría y de cumplimiento durante todo el ciclo de vida de la evaluación. Esto es especialmente importante cuando se trabaja con datos confidenciales o se cumplen las normas reglamentarias, ya que proporciona una capa adicional de seguridad y responsabilidad.

En esta sección se destacan las ventajas y limitaciones de cada herramienta, lo que le ayuda a determinar cuál se adapta mejor a sus necesidades de flujo de trabajo de IA.

Cada herramienta ofrece sus propios puntos fuertes y desventajas, según cuáles sean sus prioridades.

Prompts.ai destaca por su capacidad para centralizar la gestión de modelos, reuniendo más de 35 LLM líderes en una sola interfaz unificada. Permite la comparación directa de modelos, el seguimiento de los costos de FinOps en tiempo real y la gobernanza de nivel empresarial, todo en un solo lugar. Su sistema de crédito TOKN de pago por uso puede reducir los costos del software de inteligencia artificial hasta en un 98% y, al mismo tiempo, mantener el cumplimiento de las normas SOC2 de tipo 2 e HIPAA. Sin embargo, las organizaciones que invierten mucho en marcos específicos pueden enfrentarse a algunos desafíos iniciales a la hora de realizar la transición de sus flujos de trabajo actuales.

Por otro lado, Suite de referencia LLM las plataformas, como HELM, destacan por su capacidad para evaluar modelos en múltiples dimensiones, incluidas la precisión, la seguridad y la eficiencia. El CRFM de Stanford lo describe como un «verdadero marco de evaluación de LLM» que abarca varios ámbitos, como el legal, el médico y el técnico. Dicho esto, la naturaleza no determinista de los resultados probabilísticos puede dificultar la medición de la coherencia, y muchas tareas de evaluación carecen de respuestas definitivas, especialmente en el caso de tareas abiertas como la resumición.

Del mismo modo, EvalFlow es particularmente adecuado para entornos centrados en los desarrolladores. Se integra perfectamente en las canalizaciones de CI/CD sin necesidad de configuraciones en la nube ni dependencias del SDK. Su marco de gestión de LLM como juez automatiza la puntuación de forma sistemática. Sin embargo, proporciona menos visibilidad a nivel de producción. Greg Brockman, presidente de OpenAI, destaca su importancia:

«Si estás construyendo con LLM, crear evaluaciones de alta calidad es una de las cosas más impactantes que puedes hacer».

A continuación se muestra una tabla en la que se comparan estas herramientas en función de la integración, el rendimiento, el costo y la gobernanza:

Estas comparaciones destacan las ventajas y desventajas que hay que tener en cuenta al incorporar estas herramientas en los flujos de trabajo.

La dependencia del ecosistema es un problema potencial: la selección de una plataforma puede limitar la flexibilidad de los equipos que trabajan en entornos multimodelo o multinube. Además, si bien las herramientas profundamente integradas pueden ofrecer una observabilidad sólida, a menudo requieren una importante inversión en ingeniería.

La selección de la mejor herramienta de comparación de LLM depende de sus objetivos específicos. Prompts.ai se destaca por la optimización de la gestión de modelos, el seguimiento de costos y la gobernanza en más de 35 LLM. Con su sistema de crédito TOKN de pago por uso y sus estrictos estándares de cumplimiento, es una excelente opción para los equipos que buscan reducir el uso excesivo de herramientas y, al mismo tiempo, cumplir con los estrictos requisitos de seguridad.

Para los equipos de investigación que realizan evaluaciones exhaustivas de modelos, las plataformas como HELM destacan por sus capacidades de evaluación multidimensional, que analizan métricas como la precisión, la seguridad y la eficiencia.

La industria también está optando por métodos de evaluación basados en el comportamiento, cambiando la forma en que los equipos evalúan el desempeño de la LLM. Como destaca Anthropic:

«Evaluar cómo se comporta un modelo, no solo lo que dice, podría convertirse en una dimensión crucial de confianza y seguridad en los sistemas de IA de próxima generación».

Este enfoque hace hincapié en la supervisión del razonamiento en varios pasos y el uso de herramientas, yendo más allá de los resultados estáticos. Estos avances subrayan la importancia de alinear las funciones de las herramientas con las prioridades de su flujo de trabajo.

Cada herramienta tiene sus propias fortalezas adaptadas a las necesidades operativas específicas. Prompts.ai sobresale en la administración centralizada con funciones integradas de FinOps y cumplimiento. TIMÓN ofrece una evaluación comparativa detallada para entornos centrados en la investigación, mientras EvalFlow abastece a los desarrolladores con una integración perfecta de las canalizaciones de CI/CD. Para los equipos que trabajan en flujos de trabajo basados en agencias, son esenciales las herramientas que respalden las evaluaciones en varios turnos y una supervisión sólida. Al adaptar las capacidades de las herramientas (ya sea para la gestión de costes, el cumplimiento normativo, la eficiencia del desarrollo o la supervisión de la producción) a sus prioridades, puede elegir con confianza la solución que mejor se adapte a sus necesidades.

Prompts.ai ofrece una plataforma basada en la nube diseñado para simplificar y mejorar su trabajo con modelos lingüísticos de gran tamaño (LLM). Con acceso a más de 35 modelos, puede probarlos y compararlos uno al lado del otro, sin necesidad de programar. Ejecute el mismo mensaje en varios modelos, obtenga resultados instantáneos y revise las métricas clave, como la precisión, la latencia y el uso de los tokens, todo desde un panel intuitivo. Además, con el seguimiento de los costes en tiempo real en USD y los precios a nivel simbólico, es fácil detectar las solicitudes costosas y gestionar el presupuesto de forma eficaz.

Más allá de las comparaciones, Prompts.ai optimiza los flujos de trabajo de LLM al consolidar el acceso a las API, reducir las llamadas redundantes y centralizar las medidas de seguridad. Esto no solo aumenta la eficiencia y reduce los gastos, sino que también reduce el riesgo de violaciones de datos. La plataforma está diseñada para el trabajo en equipo, lo que permite a los usuarios compartir resultados y colaborar sin esfuerzo. Tanto si es un usuario sin conocimientos técnicos que está explorando los LLM como si forma parte de una empresa que trabaja con varios modelos, Prompts.ai proporciona las herramientas y la información necesarias para que su trabajo sea más fluido e impactante.

El Suite de referencia LLM ofrece una forma integral de evaluar modelos probándolos en más de 200 escenarios. Estas pruebas abarcan áreas clave como la precisión, la solidez, la eficiencia y las consideraciones éticas, y brindan una imagen clara de los puntos fuertes de cada modelo y de los aspectos en los que podría mejorar.

Con conjuntos de datos estandarizados y una API unificada, la suite garantiza comparaciones consistentes y transparentes entre modelos. También incluye herramientas como una interfaz web y una tabla de clasificación, que permiten a los usuarios profundizar en los resultados detallados. Estas funciones facilitan la evaluación del rendimiento técnico y los aspectos éticos en las aplicaciones prácticas.

Los detalles sobre EvalFlow y sus funciones no están incluidas en la información proporcionada. Sin un contexto adicional ni una descripción de sus capacidades, resulta difícil analizar cómo podría adaptarse a los entornos centrados en los desarrolladores. Si puede compartir más información sobre EvalFlow, estaré encantado de ofrecerle una respuesta adaptada a sus atributos específicos.