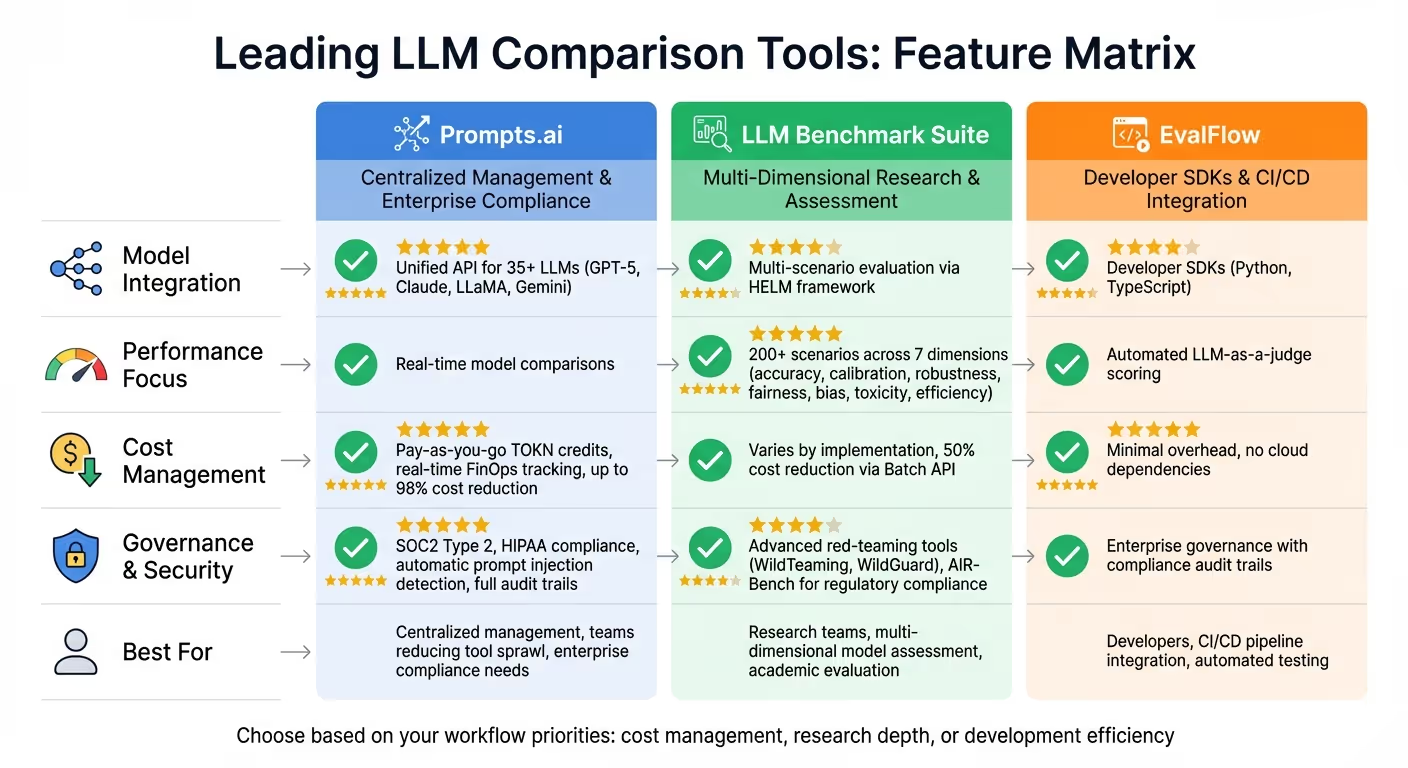

يمكن أن يكون اختيار نموذج اللغة الكبيرة المناسب (LLM) أمرًا مربكًا مع العديد من الخيارات والتكاليف المتفاوتة. أدوات مثل Prompts.ai، جناح LLM Benchmark، و إيفال فلو قم بتبسيط هذه العملية من خلال تقديم ميزات مثل تتبع التكاليف في الوقت الفعلي والأمان القوي ومعايير الأداء التفصيلية. إليك ما تحتاج إلى معرفته:

تعمل هذه الأدوات على تبسيط تقييم LLM، مما يساعدك على توفير الوقت وخفض التكاليف وضمان التنفيذ الآمن. فيما يلي مقارنة سريعة لميزاتها الرئيسية.

تم تصميم كل أداة وفقًا لاحتياجات محددة، بدءًا من الإدارة المركزية وحتى التكامل الصديق للمطورين أو التقييمات على مستوى البحث.

مصفوفة ميزات أدوات مقارنة LLM: Prompts.ai مقابل مجموعة معايير LLM مقابل EvalFlow

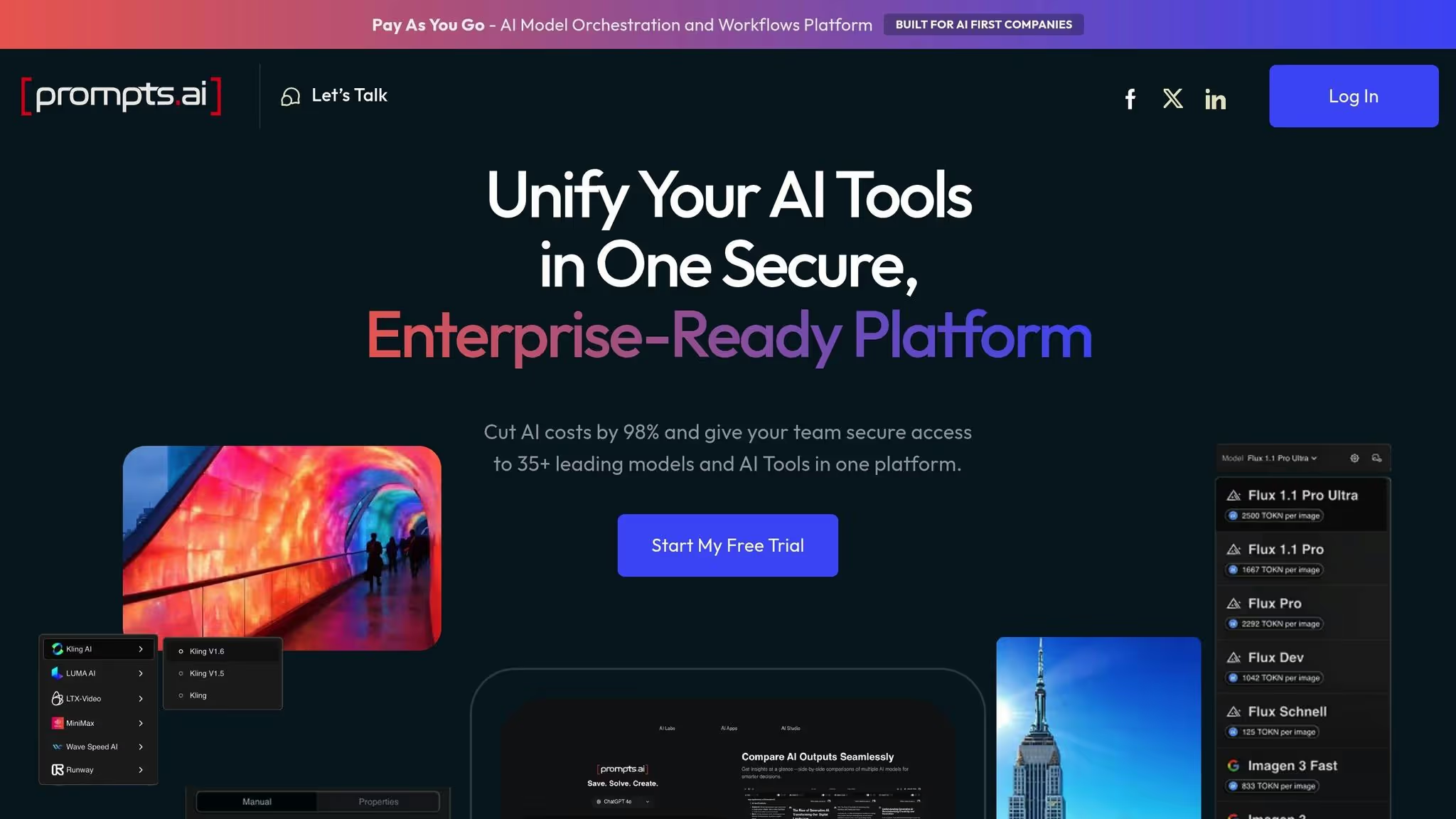

يعمل Prompts.ai على تبسيط الوصول إلى أكثر من 35 شركة LLM رائدة، مثل GPT-5 وكلود ولاما وجيميني، من خلال منصة واحدة وموحدة. من خلال دمج هذه النماذج، فإنه يزيل متاعب إدارة مفاتيح API المتعددة وحسابات الفواتير. تعمل المنصة كطبقة بروكسي، وتربط المستخدمين بنقاط النهاية مثل أوبن إيه آي، أنثروبي، و أي مقياس، مما يعكس كيفية عمل أدوات LLM الحديثة في عام 2026. تسلط الأقسام التالية الضوء على ميزاتها البارزة في تكامل النماذج وإدارة التكلفة والأمان.

يتكامل Prompts.ai بسلاسة مع أطر التنسيق الشائعة، بما في ذلك لانج تشين، مؤشر لاما، ووكلاء OpenAI. تسمح هذه البنية للمؤسسات بدمج النظام الأساسي في تدفقات عمل الذكاء الاصطناعي الحالية دون عناء. لا يستغرق التبديل بين النماذج أو اختبار نماذج جديدة سوى دقائق، مما يجعل من السهل البقاء في المقدمة في مشهد الذكاء الاصطناعي سريع التغير.

باستخدام Prompts.ai، يكتسب المستخدمون رؤية في الوقت الفعلي لاستخدام الرمز المميز عبر جميع النماذج والفرق. يتيح هذا التتبع المباشر إجراء تعديلات فورية، مما يمنع الفواتير غير المتوقعة في نهاية الشهر. ترتبط التكاليف مباشرة بمشاريع محددة ومطالبات وأعضاء فريق، مما يوفر وضوحًا لا مثيل له. تعمل المنصة على نظام ائتمان TOKN للدفع أولاً بأول بدون رسوم اشتراك، مما يضمن للمستخدمين الدفع مقابل ما يستخدمونه فقط - دون إهدار السعة.

تتضمن المنصة تدابير أمنية قوية، حيث تكتشف تلقائيًا عمليات الحقن السريعة ومحاولات الهروب من السجن أثناء الإبلاغ عن انتهاكات القواعد أو خروقات البيانات المحتملة. يتم تنقيح البيانات الحساسة، مثل معلومات التعريف الشخصية، تلقائيًا قبل تسجيلها أو تخزينها. بالإضافة إلى ذلك، يرتبط كل تفاعل بإصدارات محددة من المطالبات والنماذج ومجموعات البيانات، مما يؤدي إلى إنشاء مسار تدقيق مفصل لمراجعات الامتثال. تضمن هذه الميزات بيئة آمنة وجديرة بالثقة للعمليات اليومية.

يقدم LLM Benchmark Suite تقييمًا شاملاً لنماذج اللغة من خلال بروتوكولات الاختبار الموحدة. ومن الأمثلة البارزة على ذلك إطار HELM من ستانفورد، الذي يقيم النماذج عبر أكثر من 200 سيناريو وتعتبر سبعة أبعاد رئيسية: الدقة والمعايرة والمتانة والإنصاف والتحيز والسمية والكفاءة. من خلال النظر إلى ما وراء الدقة فقط، يوفر هذا النهج متعدد الأوجه فهمًا جيدًا لأداء النموذج. تضع هذه التقييمات الأساس للأداء التفصيلي والرؤى الأمنية التي تمت مناقشتها أدناه.

تعتمد المجموعة على معايير راسخة، بما في ذلك MMLU (الفهم الشامل للغات متعددة المهام)، و GSM8K للتفكير الرياضي، و HumanEval لمهام الترميز، و Big-Bench Hard. أدوات مثل ضوء مواصلة توسيع قدراتها ودعمها أكثر من 1000 مهمة تقييم عبر مختلف المجالات. والجدير بالذكر أن HELM قامت بتوسيع تغطية السيناريو بشكل كبير، حيث نمت من 18٪ إلى 96٪ مثيرة للإعجاب. كما أنه يتجاوز مقاييس الدقة التقليدية من خلال دمج مقاييس مثل وقت الاستدلال واستخدام الموارد الحسابية، مما يوفر تحليلًا أكثر شمولاً للأداء.

«تم إنشاء HELM لمعالجة ممارسات التقييم المجزأة وغير المتسقة السائدة في أبحاث LLM، مما يتيح إجراء مقارنات موحدة وشفافة وقابلة للتكرار.» - Stanford CRFM

والأمن والحوكمة لهما نفس القدر من الأهمية في هذه التقييمات. ال مقعد هوائي تقوم لوحة المتصدرين، على سبيل المثال، بتقييم النماذج مقابل اللوائح الناشئة وسياسات الشركات. أدوات متقدمة مثل وايلد تيم توفير قدرات الفريق الأحمر الآلي للكشف عن نقاط الضعف، في حين وايلدجارد يقيّم السلامة في الوقت الفعلي. الخصوصية هي نقطة تركيز مهمة أخرى، مع كونفاي إيد معيار مصمم خصيصًا لاختبار مدى جودة تعامل النماذج مع المعلومات الشخصية الحساسة.

لا تسلط هذه الأدوات الضوء على الأداء فحسب، بل تضمن أيضًا التنفيذ الآمن في التطبيقات العملية. يمكن للمؤسسات إنشاء سجلات تقييم خاصة باستخدام منصات مثل تقييمات OpenAI، مما يمكنهم من اختبار بيانات الملكية بشكل آمن ودون التعرض للجمهور. بالإضافة إلى ذلك، يمكن أن تؤدي الاستفادة من Batch API إلى تقليل تكاليف التقييم بنسبة تصل إلى 50٪ مقارنة بأساليب الاستدلال في الوقت الفعلي.

يأخذ برنامج EvalFlow نهج المطور أولاً لتقييم نماذج اللغات الكبيرة (LLMs)، والاندماج بسلاسة في تدفقات عمل الذكاء الاصطناعي الحديثة بدلاً من العمل كأداة منفصلة. في المشهد الحالي، تتعامل منصات التقييم مع مجموعات البيانات والمطالبات والسياسات كأصول ذات إصدار داخل LLMOps. يساعد هذا التكامل الفرق على دعم معايير الجودة المتسقة مع انتقال النماذج من التطوير إلى الإنتاج. يُكمل EvalFlow الأدوات الرائدة التي تمت مناقشتها سابقًا، مما يزيد من تحسين عمليات LLMOPS.

يمكن دمج EvalFlow باستخدام حزم SDK القياسية في بايثون وTypeScript. يوفر هذا الإعداد للمطورين تتبعًا تفصيليًا وتحكمًا في سلوك النموذج في كل مرحلة من مراحل النشر. من خلال دمج التقييم مباشرة في خط أنابيب التطوير، يلغي EvalFlow الحاجة إلى نقاط التفتيش اليدوية، مما يجعل العملية أكثر كفاءة وموثوقية.

من خلال إطار LLM-as-a-Judge الخاص به، يقوم EvalFlow بأتمتة التسجيل وتتبع التجارب بشكل منهجي. يتيح ذلك للفرق مقارنة النماذج بفعالية واكتشاف مشكلات الأداء مبكرًا، مما يضمن تلبية النماذج للتوقعات قبل النشر.

تتضمن عملية التقييم الآلي لـ EvalFlow ميزات الحوكمة على مستوى المؤسسة. تسمح عناصر التحكم هذه للمؤسسات بالحفاظ على مسارات التدقيق وسجلات الامتثال طوال دورة حياة التقييم. هذا أمر بالغ الأهمية بشكل خاص عند العمل مع البيانات الحساسة أو الالتزام بالمعايير التنظيمية، مما يوفر طبقة إضافية من الأمان والمساءلة.

يسلط هذا القسم الضوء على مزايا وقيود كل أداة، مما يساعدك على تحديد أفضل ما يناسب احتياجات سير عمل الذكاء الاصطناعي.

تقدم كل أداة نقاط القوة والمقايضات الخاصة بها، اعتمادًا على أولوياتك.

Prompts.ai تتميز بقدرتها على إدارة النماذج بشكل مركزي، حيث تجمع أكثر من 35 شركة LLMs رائدة في واجهة واحدة وموحدة. إنه يتيح إجراء مقارنات مباشرة بين النماذج وتتبع تكاليف FinOps في الوقت الفعلي والحوكمة على مستوى المؤسسة، كل ذلك في مكان واحد. يمكن لنظام TOKN الائتماني للدفع أولاً بأول تقليل تكاليف برامج الذكاء الاصطناعي بنسبة تصل إلى 98٪، مع الحفاظ على الامتثال لمعايير SOC2 Type 2 و HIPAA. ومع ذلك، قد تواجه المنظمات التي تستثمر بكثافة في أطر محددة بعض التحديات الأولية عند نقل تدفقات العمل الحالية.

من ناحية أخرى، جناح LLM Benchmark تتألق المنصات، مثل HELM، في قدرتها على تقييم النماذج عبر أبعاد متعددة، بما في ذلك الدقة والسلامة والكفاءة. يصفها CRFM في جامعة ستانفورد بأنها «إطار تقييم LLM حقيقي» يمتد إلى مجالات مختلفة، مثل المجالات القانونية والطبية والتقنية. ومع ذلك، فإن الطبيعة غير الحتمية للمخرجات الاحتمالية يمكن أن تجعل قياسات الاتساق صعبة، وتفتقر العديد من مهام التقييم إلى إجابات نهائية - خاصة بالنسبة للمهام المفتوحة مثل التلخيص.

وبالمثل، إيفال فلو مناسب بشكل خاص للبيئات التي تركز على المطورين. إنه يتكامل بسلاسة في خطوط أنابيب CI/CD دون الحاجة إلى إعدادات السحابة أو تبعيات SDK. يعمل إطار LLM-as-a-Judge الخاص به على أتمتة التسجيل بطريقة منهجية. ومع ذلك، فإنه يوفر رؤية أقل على مستوى الإنتاج. يؤكد جريج بروكمان، رئيس OpenAI، على أهميتها:

«إذا كنت تقوم بالبناء باستخدام LLMs، فإن إنشاء تقييمات عالية الجودة هو أحد أكثر الأشياء تأثيرًا التي يمكنك القيام بها».

يوجد أدناه جدول يقارن هذه الأدوات بناءً على التكامل والأداء والتكلفة والحوكمة:

تسلط هذه المقارنات الضوء على المقايضات التي يجب مراعاتها عند دمج هذه الأدوات في سير العمل.

يُعد قفل النظام البيئي مصدر قلق محتمل - فقد يؤدي اختيار النظام الأساسي إلى الحد من المرونة للفرق التي تعمل عبر بيئات متعددة النماذج أو بيئات سحابية متعددة. بالإضافة إلى ذلك، في حين أن الأدوات المدمجة بعمق يمكن أن توفر إمكانية مراقبة قوية، إلا أنها غالبًا ما تتطلب استثمارًا هندسيًا كبيرًا.

يعتمد اختيار أفضل أداة مقارنة LLM على أهدافك المحددة. Prompts.ai تبرز من خلال تبسيط إدارة النماذج وتتبع التكاليف والحوكمة عبر أكثر من 35 LLMs. بفضل نظام TOKN الائتماني للدفع أولاً بأول ومعايير الامتثال الصارمة، فهو مناسب تمامًا للفرق التي تهدف إلى تقليل انتشار الأدوات مع تلبية متطلبات الأمان الصارمة.

بالنسبة لفرق البحث التي تجري تقييمات متعمقة للنماذج، تتألق منصات مثل HELM بقدرات التقييم متعددة الأبعاد، وتحليل المقاييس مثل الدقة والسلامة والكفاءة.

تتجه الصناعة أيضًا نحو أساليب التقييم القائمة على السلوك، وتغيير كيفية تقييم الفرق لأداء LLM. كما يبرز أنثروبيك:

«يمكن أن يصبح تقييم سلوك النموذج، وليس فقط ما يقوله، بعدًا حاسمًا للثقة والأمان في أنظمة الذكاء الاصطناعي من الجيل التالي».

يؤكد هذا النهج على مراقبة التفكير متعدد الخطوات واستخدام الأدوات، وتجاوز المخرجات الثابتة. تؤكد هذه التطورات على أهمية مواءمة ميزات الأداة مع أولويات سير العمل.

كل أداة لها نقاط القوة الخاصة بها المصممة لتلبية الاحتياجات التشغيلية المحددة. Prompts.ai يتفوق في الإدارة المركزية مع FinOps المتكاملة وميزات الامتثال. رأس يقدم معايير تفصيلية للبيئات التي تركز على البحث، بينما إيفال فلو يلبي احتياجات المطورين من خلال تكامل سلس لخطوط أنابيب CI/CD. بالنسبة للفرق التي تعمل على سير عمل الوكلاء، تعد الأدوات التي تدعم التقييمات متعددة الأدوار والمراقبة القوية ضرورية. من خلال مطابقة إمكانات الأدوات - سواء لإدارة التكلفة أو الامتثال التنظيمي أو كفاءة التطوير أو مراقبة الإنتاج - مع أولوياتك، يمكنك بثقة اختيار الحل الذي يناسب احتياجاتك.

يقدم ملف Prompts.ai ملف منصة قائمة على السحابة مصممة لتبسيط عملك وتحسينه باستخدام نماذج اللغات الكبيرة (LLMs). من خلال الوصول إلى أكثر من 35 طرازًا، يمكنك اختبارها ومقارنتها جنبًا إلى جنب - دون الحاجة إلى ترميز. قم بتشغيل نفس المطالبة عبر نماذج متعددة، واحصل على نتائج فورية، وراجع المقاييس الرئيسية مثل الدقة ووقت الاستجابة واستخدام الرمز المميز، كل ذلك من لوحة تحكم واحدة سهلة الاستخدام. بالإضافة إلى ذلك، من خلال تتبع التكلفة في الوقت الفعلي بالدولار الأمريكي والتسعير على مستوى الرمز المميز، من السهل تحديد الطلبات المكلفة وإدارة ميزانيتك بفعالية.

بالإضافة إلى المقارنات فقط، يعمل Prompts.ai على تحسين سير عمل LLM من خلال دمج الوصول إلى API، وخفض المكالمات الزائدة عن الحاجة، وتركيز تدابير الأمان. هذا لا يعزز الكفاءة ويقلل النفقات فحسب، بل يقلل أيضًا من مخاطر انتهاكات البيانات. تم تصميم المنصة للعمل الجماعي، مما يسمح للمستخدمين بمشاركة النتائج والتعاون دون عناء. سواء كنت مستخدمًا غير تقني يستكشف LLMs أو جزءًا من مؤسسة تتلاعب بنماذج متعددة، فإن Prompts.ai يوفر الأدوات والرؤى لجعل عملك أكثر سلاسة وتأثيرًا.

ال جناح LLM Benchmark يقدم طريقة شاملة لتقييم النماذج من خلال اختبارها في أكثر من 200 سيناريو. تشمل هذه الاختبارات مجالات رئيسية مثل الدقة والمتانة والكفاءة والاعتبارات الأخلاقية، مما يعطي صورة واضحة عن نقاط القوة في كل نموذج وأين يمكن تحسينه.

من خلال مجموعات البيانات الموحدة وواجهة برمجة التطبيقات الموحدة، تضمن المجموعة مقارنات متسقة وشفافة بين النماذج. كما يتضمن أدوات مثل واجهة الويب ولوحة المتصدرين، مما يسمح للمستخدمين بالتعمق في النتائج التفصيلية. تسهل هذه الميزات تقييم الأداء الفني والجوانب الأخلاقية في التطبيقات العملية.

التفاصيل حول إيفال فلو ولا يتم تضمين ميزاته في المعلومات المقدمة. وبدون سياق إضافي أو وصف لقدراته، من الصعب مناقشة كيفية ملاءمته للبيئات التي تركز على المطورين. إذا كان بإمكانك مشاركة المزيد حول EvalFlow، فسيسعدني تقديم استجابة مصممة وفقًا لسماتها المحددة.