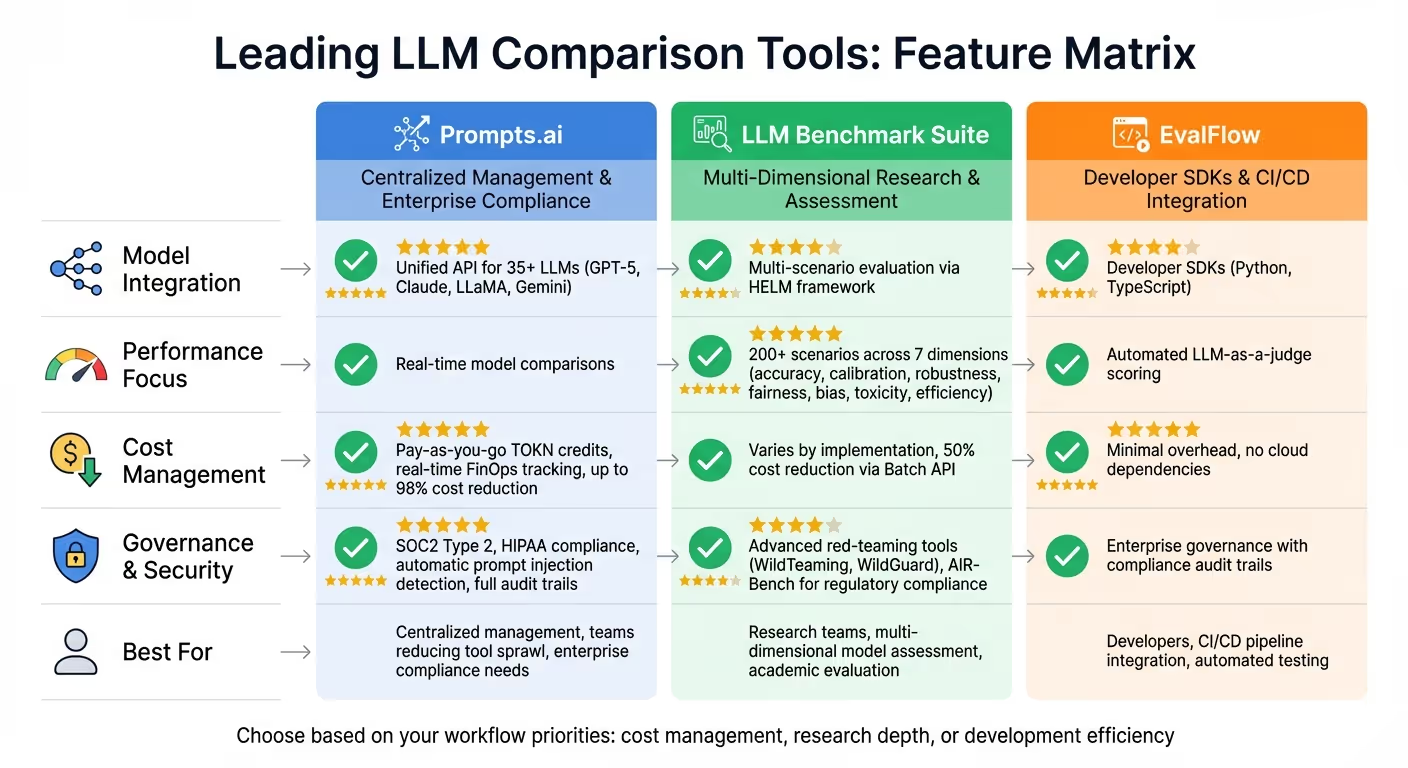

सही बड़े भाषा मॉडल (एलएलएम) का चयन करना बहुत सारे विकल्पों और अलग-अलग लागतों के साथ भारी लग सकता है। जैसे टूल Prompts.ai, एलएलएम बेंचमार्क सुइट, और एवलफ्लो रियल-टाइम कॉस्ट ट्रैकिंग, मजबूत सुरक्षा और विस्तृत प्रदर्शन बेंचमार्क जैसी सुविधाओं की पेशकश करके इस प्रक्रिया को सरल बनाएं। यहां बताया गया है कि आपको क्या जानना चाहिए:

ये उपकरण एलएलएम मूल्यांकन को सुव्यवस्थित करते हैं, जिससे आपको समय बचाने, लागत में कटौती करने और सुरक्षित कार्यान्वयन सुनिश्चित करने में मदद मिलती है। नीचे उनकी प्रमुख विशेषताओं की त्वरित तुलना की गई है।

प्रत्येक उपकरण विशिष्ट आवश्यकताओं के अनुरूप होता है, केंद्रीकृत प्रबंधन से लेकर डेवलपर-अनुकूल एकीकरण या अनुसंधान-ग्रेड मूल्यांकन तक।

LLM तुलना उपकरण फ़ीचर मैट्रिक्स: Prompts.ai बनाम LLM बेंचमार्क सुइट बनाम EvalFlow

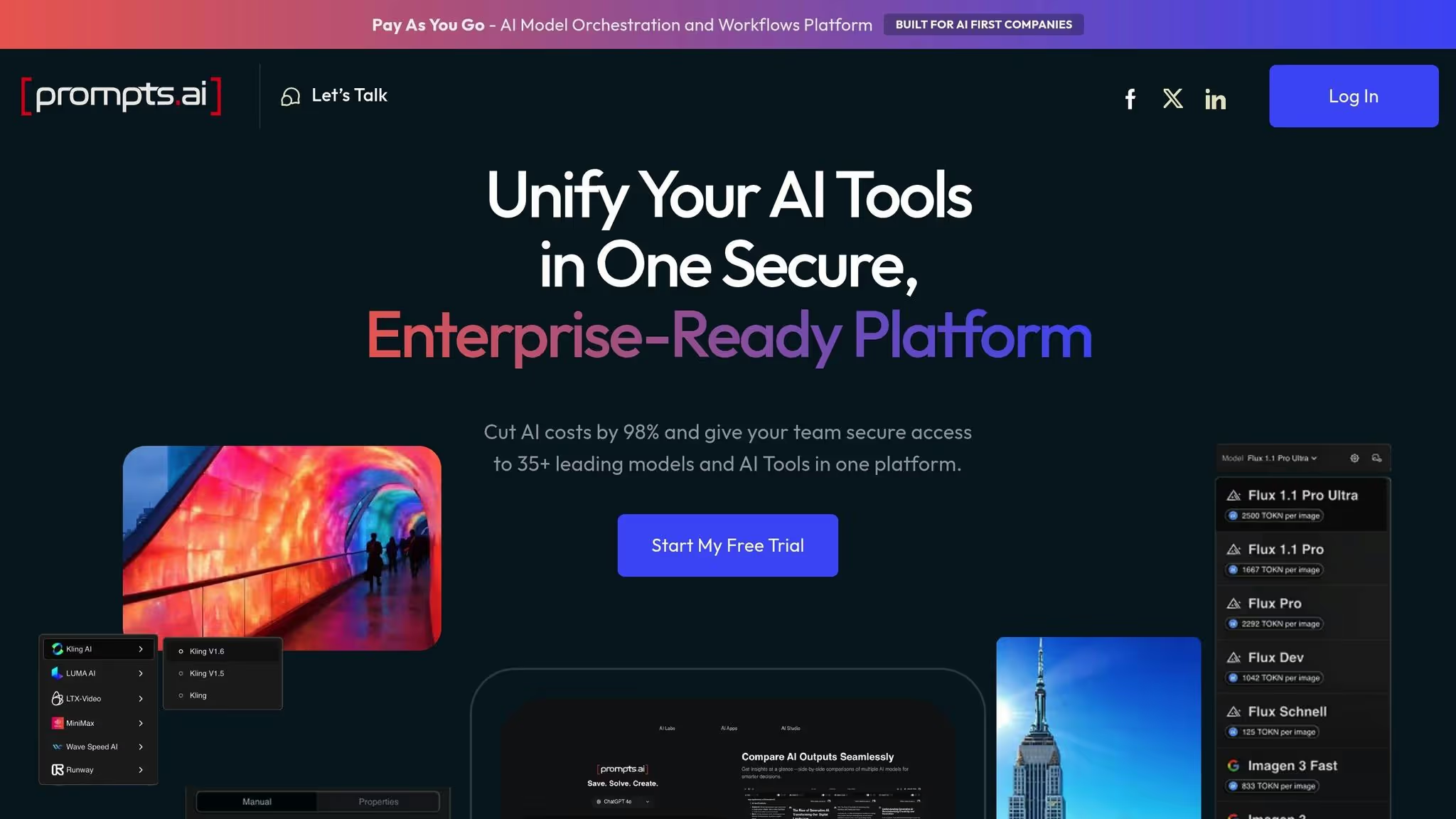

Prompts.ai एक एकल, एकीकृत प्लेटफ़ॉर्म के माध्यम से 35 से अधिक प्रमुख LLM, जैसे GPT-5, क्लाउड, LLaMa और Gemini तक पहुंच को सरल बनाता है। इन मॉडलों को समेकित करके, यह कई API कुंजियों और बिलिंग खातों को प्रबंधित करने की परेशानी को समाप्त करता है। प्रॉक्सी लेयर के रूप में कार्य करते हुए, प्लेटफ़ॉर्म यूज़र को एंडपॉइंट से जोड़ता है जैसे ओपनएआई, एंथ्रोपिक, और कोई भी पैमाना, यह दर्शाता है कि 2026 में आधुनिक एलएलएम उपकरण कैसे काम करते हैं। निम्नलिखित अनुभाग मॉडल एकीकरण, लागत प्रबंधन और सुरक्षा में इसकी असाधारण विशेषताओं को उजागर करते हैं।

Prompts.ai मूल रूप से लोकप्रिय ऑर्केस्ट्रेशन फ्रेमवर्क के साथ एकीकृत होता है, जिसमें शामिल हैं लैंग चैन, लामा इंडेक्स, और OpenAI एजेंट। यह आर्किटेक्चर संगठनों को अपने मौजूदा AI वर्कफ़्लो में प्लेटफ़ॉर्म को आसानी से शामिल करने की अनुमति देता है। मॉडल के बीच स्विच करने या नए मॉडल का परीक्षण करने में केवल कुछ मिनट लगते हैं, जिससे तेजी से बदलते AI परिदृश्य में आगे रहना आसान हो जाता है।

Prompts.ai के साथ, उपयोगकर्ता सभी मॉडलों और टीमों में टोकन उपयोग में रीयल-टाइम दृश्यता प्राप्त करते हैं। यह लाइव ट्रैकिंग तत्काल समायोजन को सक्षम करती है, जिससे महीने के अंत में अप्रत्याशित बिलों को रोका जा सकता है। लागत सीधे विशिष्ट परियोजनाओं, संकेतों और टीम के सदस्यों से जुड़ी होती है, जो बेजोड़ स्पष्टता प्रदान करती हैं। प्लेटफ़ॉर्म बिना किसी सदस्यता शुल्क के पे-एज़-यू-गो TOKN क्रेडिट सिस्टम पर काम करता है, यह सुनिश्चित करता है कि यूज़र केवल उसी चीज़ का भुगतान करें जिसका वे उपयोग करते हैं - कोई व्यर्थ क्षमता नहीं।

प्लेटफ़ॉर्म में मजबूत सुरक्षा उपाय शामिल हैं, जो नियम उल्लंघन या संभावित डेटा उल्लंघनों को फ़्लैग करते समय स्वचालित रूप से शीघ्र इंजेक्शन और जेलब्रेक प्रयासों का पता लगाते हैं। संवेदनशील डेटा, जैसे कि व्यक्तिगत रूप से पहचाने जाने योग्य जानकारी, लॉग इन या संग्रहीत होने से पहले स्वचालित रूप से संपादित किया जाता है। इसके अतिरिक्त, प्रत्येक इंटरैक्शन प्रॉम्प्ट, मॉडल और डेटासेट के विशिष्ट संस्करणों से जुड़ा होता है, जो अनुपालन समीक्षाओं के लिए एक विस्तृत ऑडिट ट्रेल बनाता है। ये सुविधाएं दैनिक कार्यों के लिए एक सुरक्षित और भरोसेमंद वातावरण सुनिश्चित करती हैं।

एलएलएम बेंचमार्क सुइट मानकीकृत परीक्षण प्रोटोकॉल के माध्यम से भाषा मॉडल का गहन मूल्यांकन प्रदान करता है। इसका एक असाधारण उदाहरण स्टैनफोर्ड का HELM फ्रेमवर्क है, जो सभी मॉडलों का मूल्यांकन करता है। 200+ परिदृश्य और समझता है सात प्रमुख आयाम: सटीकता, अंशांकन, मजबूती, निष्पक्षता, पूर्वाग्रह, विषाक्तता और दक्षता। सटीकता से परे देखने पर, यह बहुआयामी दृष्टिकोण मॉडल के प्रदर्शन की पूरी समझ प्रदान करता है। ये मूल्यांकन नीचे चर्चा किए गए विस्तृत प्रदर्शन और सुरक्षा अंतर्दृष्टि के लिए आधार तैयार करते हैं।

सुइट अच्छी तरह से स्थापित बेंचमार्क पर निर्भर करता है, जिसमें MMLU (मैसिव मल्टीटास्क लैंग्वेज अंडरस्टैंडिंग), गणितीय तर्क के लिए GSM8K, कोडिंग कार्यों के लिए HumanEval और बिग-बेंच हार्ड शामिल हैं। जैसे टूल लाइटवैल अपनी क्षमताओं को और आगे बढ़ाएं, समर्थन करें 1,000 से अधिक मूल्यांकन कार्य विभिन्न डोमेन में। विशेष रूप से, HELM ने अपने परिदृश्य कवरेज का काफी विस्तार किया है, जो 18% से बढ़कर 96% तक पहुंच गया है। यह अधिक व्यापक प्रदर्शन विश्लेषण की पेशकश करते हुए, अनुमान समय और कम्प्यूटेशनल संसाधन उपयोग जैसे मैट्रिक्स को शामिल करके पारंपरिक सटीकता उपायों से भी आगे जाता है।

“HELM को LLM अनुसंधान में प्रचलित खंडित और असंगत मूल्यांकन प्रथाओं को संबोधित करने के लिए बनाया गया था, जिससे मानकीकृत, पारदर्शी और प्रतिलिपि प्रस्तुत करने योग्य तुलनाओं को सक्षम किया जा सके।” - स्टैनफोर्ड CRFM

इन मूल्यांकनों में सुरक्षा और शासन समान रूप से महत्वपूर्ण हैं। द एयर-बेंच उदाहरण के लिए, लीडरबोर्ड उभरते नियमों और कॉर्पोरेट नीतियों के खिलाफ मॉडल का आकलन करता है। एडवांस टूल जैसे वाइल्ड टीमिंग कमजोरियों को उजागर करने के लिए स्वचालित रेड-टीमिंग क्षमताएं प्रदान करें, जबकि वाइल्डगार्ड वास्तविक समय की सुरक्षा का मूल्यांकन करता है। गोपनीयता एक और महत्वपूर्ण फोकस है, जिसमें ConFaIDE बेंचमार्क विशेष रूप से यह जांचने के लिए डिज़ाइन किया गया है कि मॉडल संवेदनशील व्यक्तिगत जानकारी को कितनी अच्छी तरह संभालते हैं।

ये उपकरण न केवल प्रदर्शन को उजागर करते हैं बल्कि व्यावहारिक अनुप्रयोगों में सुरक्षित कार्यान्वयन भी सुनिश्चित करते हैं। संगठन जैसे प्लेटफ़ॉर्म का उपयोग करके निजी मूल्यांकन रजिस्ट्रियां बना सकते हैं ओपनएआई इवल्स, उन्हें मालिकाना डेटा को सुरक्षित रूप से और सार्वजनिक जोखिम के बिना परीक्षण करने में सक्षम बनाता है। इसके अतिरिक्त, बैच API का लाभ उठाने से रीयल-टाइम अनुमान विधियों की तुलना में मूल्यांकन लागत को 50% तक कम किया जा सकता है।

EvalFlow एक लेता है डेवलपर-फर्स्ट अप्रोच बड़े भाषा मॉडल (LLM) का मूल्यांकन करने के लिए, एक अलग उपकरण के रूप में कार्य करने के बजाय आधुनिक AI वर्कफ़्लो में मूल रूप से एकीकृत करना। आज के परिदृश्य में, मूल्यांकन प्लेटफ़ॉर्म डेटासेट, प्रॉम्प्ट और नीतियों को LLMOP के भीतर संस्करणित संपत्ति के रूप में मानते हैं। यह एकीकरण टीमों को गुणवत्ता मानकों को बनाए रखने में मदद करता है, क्योंकि मॉडल विकास से उत्पादन की ओर बढ़ते हैं। EvalFlow पहले चर्चा किए गए प्रमुख टूल का पूरक है, जो LLMOPS प्रक्रियाओं को और परिष्कृत करता है।

EvalFlow को पायथन और टाइपस्क्रिप्ट में मानक SDK का उपयोग करके एकीकृत किया जा सकता है। यह सेटअप डेवलपर्स को परिनियोजन के प्रत्येक चरण में मॉडल व्यवहार पर विस्तृत ट्रैकिंग और नियंत्रण प्रदान करता है। मूल्यांकन को सीधे विकास पाइपलाइन में एम्बेड करके, EvalFlow मैन्युअल चेकपॉइंट की आवश्यकता को समाप्त करता है, जिससे प्रक्रिया अधिक कुशल और विश्वसनीय हो जाती है।

अपने LLM-as-a-Judge फ्रेमवर्क के साथ, EvalFlow स्कोरिंग को स्वचालित करता है और प्रयोगों को व्यवस्थित रूप से ट्रैक करता है। यह टीमों को मॉडल की प्रभावी ढंग से तुलना करने और प्रदर्शन समस्याओं का जल्द पता लगाने में सक्षम बनाता है, यह सुनिश्चित करता है कि मॉडल परिनियोजन से पहले अपेक्षाओं को पूरा करते हैं।

EvalFlow की स्वचालित मूल्यांकन प्रक्रिया में एंटरप्राइज़-ग्रेड गवर्नेंस सुविधाएँ शामिल हैं। इन नियंत्रणों से संगठनों को मूल्यांकन जीवनचक्र के दौरान ऑडिट ट्रेल्स और अनुपालन रिकॉर्ड बनाए रखने की अनुमति मिलती है। संवेदनशील डेटा के साथ काम करते समय या विनियामक मानकों का पालन करते समय, सुरक्षा और जवाबदेही की एक अतिरिक्त परत प्रदान करते समय यह विशेष रूप से महत्वपूर्ण होता है।

यह अनुभाग प्रत्येक टूल के फायदों और सीमाओं पर प्रकाश डालता है, जिससे आपको यह निर्धारित करने में मदद मिलती है कि आपके AI वर्कफ़्लो की ज़रूरतों के लिए सबसे उपयुक्त कौन सा है।

आपकी प्राथमिकताएं क्या हैं, इसके आधार पर प्रत्येक टूल अपनी खूबियां और ट्रेड-ऑफ प्रदान करता है।

Prompts.ai मॉडल प्रबंधन को केंद्रीकृत करने की अपनी क्षमता के लिए सबसे अलग है, जो 35 से अधिक प्रमुख एलएलएम को एक एकल, एकीकृत इंटरफ़ेस में एक साथ लाता है। यह प्रत्यक्ष मॉडल तुलना, रियल-टाइम FinOps लागत ट्रैकिंग, और एंटरप्राइज़-ग्रेड गवर्नेंस, सभी को एक ही स्थान पर सक्षम बनाता है। इसका पे-एज़-यू-गो TOKN क्रेडिट सिस्टम SOC2 टाइप 2 और HIPAA मानकों के अनुपालन को बनाए रखते हुए AI सॉफ़्टवेयर की लागत को 98% तक कम कर सकता है। हालांकि, विशिष्ट फ्रेमवर्क में भारी निवेश करने वाले संगठनों को अपने मौजूदा वर्कफ़्लो में बदलाव करते समय कुछ शुरुआती चुनौतियों का सामना करना पड़ सकता है।

दूसरी ओर, एलएलएम बेंचमार्क सुइट HELM जैसे प्लेटफ़ॉर्म, सटीकता, सुरक्षा और दक्षता सहित कई आयामों में मॉडल का मूल्यांकन करने की अपनी क्षमता में चमकते हैं। स्टैनफोर्ड का CRFM इसे “वास्तविक LLM मूल्यांकन ढांचे” के रूप में वर्णित करता है, जो कानूनी, चिकित्सा और तकनीकी क्षेत्रों जैसे विभिन्न डोमेन तक फैला हुआ है। हालांकि, संभाव्य आउटपुट की गैर-नियतात्मक प्रकृति स्थिरता मापन को मुश्किल बना सकती है, और कई मूल्यांकन कार्यों में निश्चित उत्तरों की कमी होती है - विशेष रूप से सारांशीकरण जैसे ओपन-एंडेड कार्यों के लिए।

इसी तरह, एवलफ्लो डेवलपर-केंद्रित वातावरण के लिए विशेष रूप से उपयुक्त है। यह क्लाउड सेटअप या SDK निर्भरता की आवश्यकता के बिना CI/CD पाइपलाइनों में मूल रूप से एकीकृत हो जाता है। इसका एलएलएम-ए-जज फ्रेमवर्क व्यवस्थित तरीके से स्कोरिंग को स्वचालित करता है। हालांकि, यह उत्पादन स्तर पर कम दृश्यता प्रदान करता है। OpenAI के अध्यक्ष ग्रेग ब्रॉकमैन इसके महत्व पर जोर देते हैं:

“यदि आप एलएलएम के साथ निर्माण कर रहे हैं, तो उच्च गुणवत्ता वाले ईवल बनाना आपके द्वारा किए जा सकने वाले सबसे प्रभावशाली कामों में से एक है"।

एकीकरण, प्रदर्शन, लागत और शासन के आधार पर इन उपकरणों की तुलना करने वाली तालिका नीचे दी गई है:

ये तुलनाएँ इन टूल को अपने वर्कफ़्लो में शामिल करते समय विचार करने के लिए ट्रेड-ऑफ़ को उजागर करती हैं।

इकोसिस्टम लॉक-इन एक संभावित चिंता का विषय है - एक प्लेटफ़ॉर्म का चयन करने से मल्टी-मॉडल या मल्टी-क्लाउड वातावरण में काम करने वाली टीमों के लिए लचीलापन सीमित हो सकता है। इसके अतिरिक्त, जबकि गहन रूप से एकीकृत उपकरण मजबूत अवलोकन प्रदान कर सकते हैं, उन्हें अक्सर एक महत्वपूर्ण इंजीनियरिंग निवेश की आवश्यकता होती है।

सर्वश्रेष्ठ एलएलएम तुलना टूल का चयन करना आपके विशिष्ट लक्ष्यों पर निर्भर करता है। Prompts.ai 35 से अधिक एलएलएम में मॉडल प्रबंधन, लागत ट्रैकिंग और शासन को सुव्यवस्थित करने में मदद करता है। अपने पे-एज़-यू-गो TOKN क्रेडिट सिस्टम और सख्त अनुपालन मानकों के साथ, यह उन टीमों के लिए बहुत उपयुक्त है, जो कड़े सुरक्षा आवश्यकताओं को पूरा करते हुए टूल स्प्रेल को कम करने का लक्ष्य रखती हैं।

गहन मॉडल आकलन करने वाली शोध टीमों के लिए, HELM जैसे प्लेटफ़ॉर्म अपनी बहु-आयामी मूल्यांकन क्षमताओं के साथ चमकते हैं, सटीकता, सुरक्षा और दक्षता जैसे मैट्रिक्स का विश्लेषण करते हैं।

उद्योग व्यवहार-आधारित मूल्यांकन विधियों की ओर भी बढ़ रहा है, जिससे टीमों के एलएलएम प्रदर्शन का आकलन करने का तरीका बदल रहा है। एंथ्रोपिक हाइलाइट्स के रूप में:

“यह मूल्यांकन करना कि एक मॉडल कैसे व्यवहार करता है, न कि केवल वह जो कहता है, वह अगली पीढ़ी के AI सिस्टम में विश्वास और सुरक्षा का एक महत्वपूर्ण आयाम बन सकता है"।

यह दृष्टिकोण स्थिर आउटपुट से आगे बढ़ते हुए बहु-चरणीय तर्क और उपकरण के उपयोग की निगरानी पर जोर देता है। इस तरह की प्रगति आपकी वर्कफ़्लो प्राथमिकताओं के साथ टूल सुविधाओं को संरेखित करने के महत्व को रेखांकित करती है।

विशिष्ट परिचालन आवश्यकताओं के अनुरूप प्रत्येक उपकरण की अपनी ताकत होती है। Prompts.ai एकीकृत FinOps और अनुपालन सुविधाओं के साथ केंद्रीकृत प्रबंधन में उत्कृष्टता प्राप्त करता है। पतवार अनुसंधान-केंद्रित वातावरण के लिए विस्तृत बेंचमार्किंग प्रदान करता है, जबकि एवलफ्लो निर्बाध CI/CD पाइपलाइन एकीकरण के साथ डेवलपर्स की सेवा करता है। एजेंटिक वर्कफ़्लो पर काम करने वाली टीमों के लिए, मल्टी-टर्न मूल्यांकन और मज़बूत निगरानी का समर्थन करने वाले टूल आवश्यक हैं। टूल क्षमताओं का मिलान करके - चाहे लागत प्रबंधन, विनियामक अनुपालन, विकास दक्षता, या उत्पादन निगरानी के लिए - अपनी प्राथमिकताओं के अनुसार, आप आत्मविश्वास के साथ वह समाधान चुन सकते हैं जो आपकी आवश्यकताओं के लिए सबसे उपयुक्त हो।

Prompts.ai एक प्रदान करता है क्लाउड-आधारित प्लेटफ़ॉर्म बड़े भाषा मॉडल (एलएलएम) के साथ आपके काम को सरल बनाने और बढ़ाने के लिए डिज़ाइन किया गया है। 35 से अधिक मॉडल तक पहुंच के साथ, आप उन्हें साथ-साथ परख सकते हैं और उनकी तुलना कर सकते हैं - किसी कोडिंग की आवश्यकता नहीं है। कई मॉडलों पर एक ही प्रॉम्प्ट चलाएँ, तुरंत परिणाम प्राप्त करें, और सटीकता, लेटेंसी और टोकन उपयोग जैसे प्रमुख मीट्रिक की समीक्षा करें, ये सब एक सहज डैशबोर्ड से करें। साथ ही, USD और टोकन-स्तरीय मूल्य निर्धारण में रीयल-टाइम लागत ट्रैकिंग के साथ, महंगे अनुरोधों को खोजना और अपने बजट को प्रभावी ढंग से प्रबंधित करना आसान है।

केवल तुलनाओं के अलावा, Prompts.ai API एक्सेस को समेकित करके, अनावश्यक कॉल में कटौती करके और सुरक्षा उपायों को केंद्रीकृत करके LLM वर्कफ़्लो को अनुकूलित करता है। यह न केवल दक्षता को बढ़ाता है और खर्चों को कम करता है, बल्कि डेटा उल्लंघनों के जोखिम को भी कम करता है। प्लेटफ़ॉर्म टीम वर्क के लिए बनाया गया है, जिससे यूज़र परिणाम साझा कर सकते हैं और आसानी से सहयोग कर सकते हैं। चाहे आप एलएलएम की खोज करने वाले गैर-तकनीकी उपयोगकर्ता हों या कई मॉडलों की बाजीगरी करने वाले उद्यम का हिस्सा हों, Prompts.ai आपके काम को आसान और अधिक प्रभावशाली बनाने के लिए टूल और अंतर्दृष्टि प्रदान करता है।

द एलएलएम बेंचमार्क सुइट 200 से अधिक परिदृश्यों में मॉडल का परीक्षण करके उनका मूल्यांकन करने का एक व्यापक तरीका प्रदान करता है। ये परीक्षण सटीकता, मजबूती, दक्षता और नैतिक विचारों जैसे प्रमुख क्षेत्रों में फैले हुए हैं, जो प्रत्येक मॉडल की खूबियों की स्पष्ट तस्वीर देते हैं और जहां यह बेहतर हो सकता है, की स्पष्ट तस्वीर देते हैं।

मानकीकृत डेटासेट और एकीकृत API के साथ, सुइट मॉडलों के बीच सुसंगत और पारदर्शी तुलना सुनिश्चित करता है। इसमें वेब इंटरफ़ेस और लीडरबोर्ड जैसे टूल भी शामिल हैं, जिससे यूज़र विस्तृत परिणामों में गोता लगा सकते हैं। इन सुविधाओं से व्यावहारिक अनुप्रयोगों में तकनीकी प्रदर्शन और नैतिक पहलुओं का आकलन करना आसान हो जाता है।

के बारे में जानकारी एवलफ्लो और इसकी विशेषताओं को दी गई जानकारी में शामिल नहीं किया गया है। अतिरिक्त संदर्भ या इसकी क्षमताओं के विवरण के बिना, यह चर्चा करना चुनौतीपूर्ण है कि यह डेवलपर-केंद्रित वातावरण में कैसे फिट हो सकता है। यदि आप EvalFlow के बारे में अधिक जानकारी साझा कर सकते हैं, तो मुझे इसकी विशिष्ट विशेषताओं के अनुरूप प्रतिक्रिया देने में खुशी होगी।