La gestion des modèles d'IA est complexe et couvre le développement, le déploiement, la surveillance et la mise hors service. Les bons outils peuvent simplifier les flux de travail, réduire les coûts et garantir la gouvernance. Voici un bref aperçu des cinq principales plateformes :

Chaque outil possède des atouts adaptés à différents besoins, qu'il s'agisse de la rentabilité ou des capacités d'intégration. Vous trouverez ci-dessous une comparaison pour vous aider à prendre une décision.

Choisissez l'outil qui correspond à vos priorités, qu'il s'agisse de réduire les coûts, de faire évoluer les opérations ou d'intégrer des systèmes existants.

Prompts.ai est un plateforme d'orchestration de l'IA d'entreprise conçu pour unifier plus de 35 grands modèles linguistiques (LLM) les plus importants au sein d'une interface sécurisée et centralisée. Conçu pour une ingénierie et une gestion rapides des flux de travail LLM, il dessert un large éventail de clients, des entreprises du Fortune 500 aux agences de création, en les aidant à rationaliser leurs outils tout en gardant le contrôle de la gouvernance et des coûts.

La plateforme se concentre sur étapes rapides d'ingénierie et d'expérimentation du cycle de vie des modèles d'IA. Il aide les utilisateurs à concevoir, tester et affiner les instructions, avec des fonctionnalités telles que le contrôle de version et les tests A/B pour garantir la cohérence et la reproductibilité tout au long des cycles de développement. En se concentrant sur ces phases critiques, Prompts.ai répond à un besoin essentiel en matière de mise à l'échelle efficace des flux de travail rapides.

Prompts.ai se connecte sans effort aux principaux fournisseurs de LLM via des points de terminaison d'API standardisés, simplifiant ainsi la gestion de plusieurs connexions API et informations d'identification entre les équipes. Cet accès unifié garantit une intégration fluide avec des piles de développement d'IA plus larges.

Bien que la plateforme soit optimisée pour les LLM basées sur le cloud, sa dépendance à l'égard de l'infrastructure cloud peut poser des défis aux entreprises soumises à des exigences strictes en matière de résidence des données. Les organisations doivent évaluer si sa configuration correspond à leurs besoins de conformité, en particulier si les solutions sur site constituent une priorité.

Prompts.ai comprend une suite robuste de outils de surveillance et de gouvernance adapté aux opérations à l'échelle de l'entreprise. C'est analyses en temps réel fournissent des informations sur les performances rapides, en suivant des indicateurs tels que la qualité de réponse, la latence et l'engagement des utilisateurs. Ces informations basées sur les données permettent aux équipes d'affiner leurs stratégies en fonction des résultats de performance.

Le cadre de gouvernance propose pistes d'audit pour des modifications rapides, des contrôles d'accès pour gérer les autorisations et des fonctionnalités de conformité compatibles avec les normes SOC 2 Type II, HIPAA et GDPR. Avec une visibilité totale sur les interactions avec l'IA, la plateforme garantit la transparence et la responsabilité, essentielles pour les entreprises qui parviennent à trouver un équilibre entre innovation et exigences réglementaires. Cette combinaison de surveillance et de gouvernance améliore à la fois l'efficacité opérationnelle et la supervision.

Prompts.ai permet de réaliser des économies considérables en réduisant les coûts liés au LLM. Son itération et ses tests rapides et efficaces minimisent le nombre d'appels d'API et d'exécutions de modèles nécessaires pour obtenir des résultats. La plateforme comprend tableaux de bord d'utilisation qui affichent les coûts en dollars américains, ventilés par équipe, projet ou modèle, offrant une visibilité claire des dépenses.

Le système de crédit TOKN à paiement à l'utilisation élimine les frais d'abonnement, liant les coûts directement à l'utilisation réelle. Ce modèle peut aider les organisations réduire les dépenses liées aux logiciels d'IA jusqu'à 98 %, en particulier par rapport à la gestion de plusieurs abonnements et outils LLM. En outre, la couche FinOps intégrée suit l'utilisation des jetons et relie les dépenses aux résultats, offrant ainsi aux équipes financières la transparence dont elles ont besoin.

L'accent ciblé mis par Prompts.ai sur les flux de travail rapides le distingue, ce qui en fait un puissant complément aux autres plateformes susceptibles de donner la priorité à des capacités d'IA plus étendues.

MLflow est un plateforme open source conçu pour simplifier le cycle de vie de l'apprentissage automatique. Il fournit un cadre complet pour la gestion et le suivi des modèles, couvrant tout, de l'expérimentation initiale au déploiement en production.

MLflow prend en charge les phases critiques du cycle de vie de l'IA en enregistrant automatiquement les paramètres, les versions de code, les métriques et les artefacts pendant le développement.

C'est Registre des modèles et standardisé Projets rationalisez les tâches telles que la gestion des versions, les transitions d'étape et la reproductibilité des expériences. Ces fonctionnalités garantissent une supervision claire et des processus de déploiement fiables.

MLflow fonctionne parfaitement avec un large éventail d'outils et de plateformes. Il s'intègre à AWS SageMaker, des plateformes MLOps comme Hub DagS, et prend en charge plusieurs environnements de programmation, notamment les API Python, R, Java et REST. Cette flexibilité permet aux équipes d'utiliser leur infrastructure existante tout en déployant des modèles dans divers environnements.

MLflow suit automatiquement les paramètres de formation, les métriques et les artefacts, créant ainsi des pistes d'audit détaillées qui facilitent les efforts de débogage et de conformité.

Le Registre des modèles fournit des outils avancés de contrôle de version et de gestion des étapes. Les équipes peuvent annoter les modèles à l'aide de descriptions, de balises et de métadonnées pour documenter leur objectif et leurs performances. Le registre suit également le lignage des modèles, ce qui facilite le suivi et la gestion de l'évolution des versions déployées.

La reproductibilité est une caractéristique remarquable de MLflow. Avec Projets, il regroupe le code, les dépendances et les configurations, résolvant ainsi le problème courant « cela fonctionne sur ma machine » lors de la transition des modèles du développement vers la production.

Kubeflow est un ensemble d'outils conçus pour créer et gérer des pipelines d'apprentissage automatique sur Kubernetes. En utilisant des déploiements conteneurisés, il garantit l'évolutivité et la flexibilité dans différents environnements informatiques.

Kubeflow se distingue dans la gestion des étapes d'orchestration et de déploiement du cycle de vie des modèles d'IA. Il planifie efficacement les tâches, garantissant ainsi la fiabilité, la reproductibilité et la rationalisation des processus d'apprentissage automatique. Construit sur Kubernetes, il offre la portabilité et l'évolutivité nécessaires à la gestion de systèmes complexes. De plus, il s'intègre parfaitement aux outils existants pour améliorer ses fonctionnalités.

Kubeflow prend en charge le déploiement dans des configurations cloud, sur site et hybrides, ce qui le rend adaptable à divers environnements. Grâce à Kubeflow Pipelines, il fonctionne avec différents frameworks de service, tandis que des outils tels que Planche Tensor permettre la surveillance des performances des modèles en temps réel. L'inclusion de métadonnées ML (MLMD) améliore encore ses fonctionnalités en suivant le lignage et les artefacts associés.

Kubeflow propose une surveillance robuste des modèles de production, garantissant ainsi une surveillance continue des performances. Il inclut également des fonctionnalités d'isolation multi-utilisateurs, permettant aux administrateurs de contrôler l'accès et de garantir la conformité. Ces outils de gouvernance sont particulièrement utiles pour gérer des opérations d'apprentissage automatique complexes et à grande échelle, aidant les organisations à garder le contrôle et la responsabilité à mesure que leurs projets d'IA se développent.

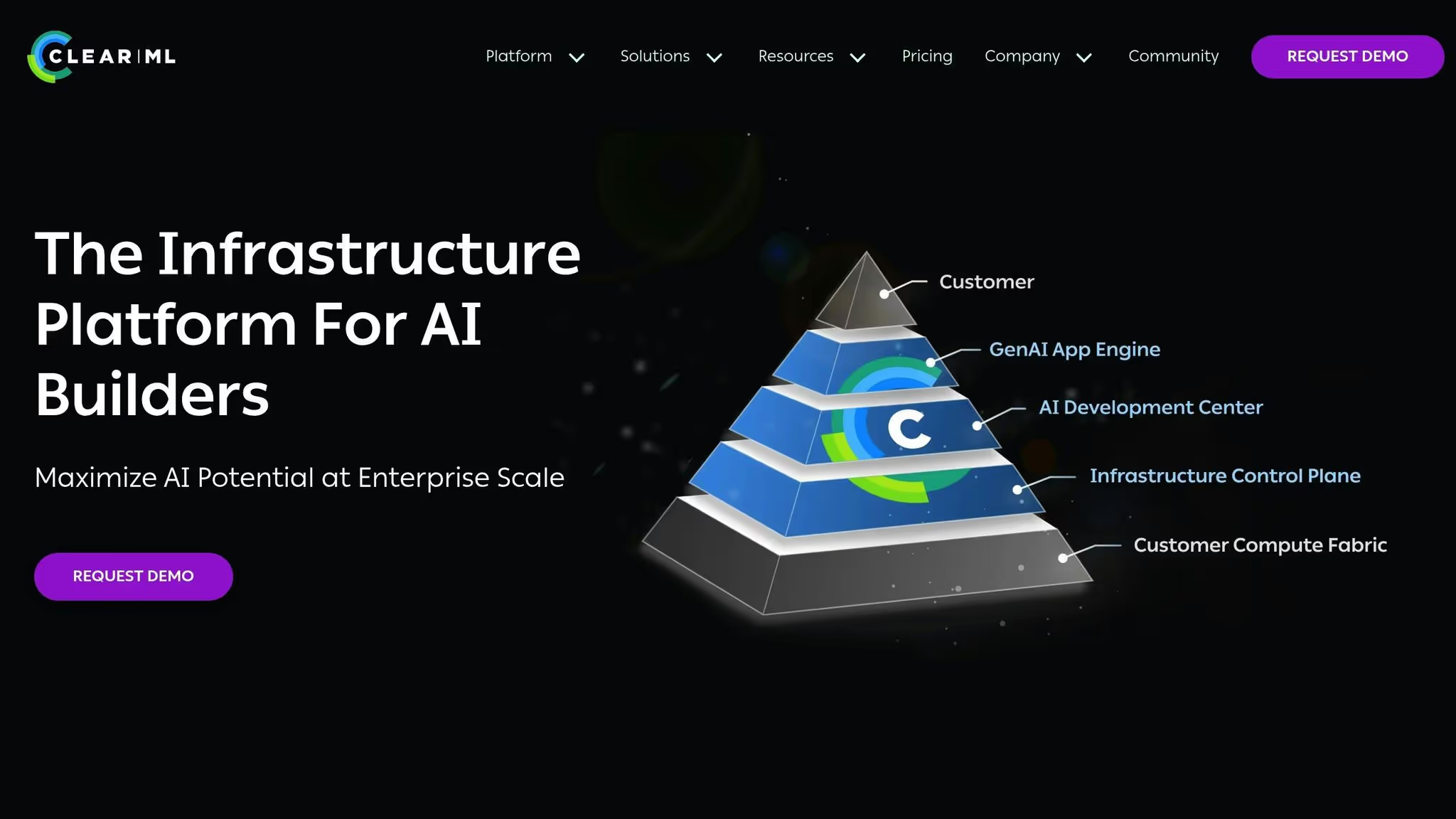

ClearML est une plateforme open source conçue pour gérer l'ensemble du cycle de vie de l'IA. Sa nature open source permet une personnalisation pour répondre à des besoins opérationnels spécifiques, bien que la disponibilité d'une documentation publique détaillée soit quelque peu limitée. Si vous envisagez ClearML, il est essentiel d'évaluer dans quelle mesure il correspond aux objectifs et à l'infrastructure de votre projet. Comme d'autres plateformes mentionnées, le cadre flexible de ClearML pourrait bien convenir pour répondre aux demandes uniques de votre flux de travail d'IA.

Google Cloud Vertex AI est une plateforme d'apprentissage automatique entièrement gérée de Google, conçue pour prendre en charge chaque phase du cycle de vie du machine learning au sein de l'écosystème Google Cloud. Il regroupe une variété d'outils et de services de machine learning sous une seule interface, ce qui en fait une solution incontournable pour les organisations qui utilisent déjà Google Cloud.

La plateforme est conçue pour répondre aux besoins d'un large éventail d'utilisateurs, qu'il s'agisse de data scientists écrivant du code personnalisé ou d'analystes commerciaux recherchant des options low-code. Cette flexibilité permet aux équipes de travailler de la manière qui répond le mieux à leurs besoins tout en maintenant l'uniformité des flux de travail de machine learning de l'organisation.

Vertex AI fournit une assistance complète pour l'ensemble du cycle de vie des modèles d'IA, en s'intégrant parfaitement aux services Google Cloud. Pour les équipes qui ont besoin d'un contrôle total, il propose une formation au code personnalisée. Dans le même temps, ses fonctionnalités AutoML et ses points de terminaison gérés simplifient la mise à l'échelle et la gestion de l'infrastructure pour ceux qui privilégient l'automatisation [6,7]. Les pipelines MLOps de la plateforme permettent une transition en douceur du développement à la production, même pour les équipes ne disposant pas d'une expertise approfondie en matière de DevOps. En outre, les ressources de calcul peuvent être augmentées ou réduites en fonction des exigences du projet, ce qui garantit une utilisation efficace des ressources. Ce support de bout en bout est étroitement intégré aux autres outils Google Cloud, ce qui permet de rationaliser le flux de travail.

Ce qui distingue Vertex AI, c'est son intégration approfondie avec les autres services de Google Cloud Platform. Il fonctionne sans effort avec BigQuery pour l'entreposage de données et Looker pour la business intelligence, offrant un environnement unifié pour les tâches de science des données.

Cette intégration étroite élimine le besoin de transferts de données complexes, car les data scientists peuvent accéder directement aux données organisationnelles dans l'environnement Vertex AI. Une API unifiée simplifie davantage les interactions entre les services Google Cloud, aidant les utilisateurs à s'adapter rapidement à la plateforme et à accélérer le développement.

Vertex AI va au-delà de la gestion du cycle de vie en proposant des fonctionnalités de surveillance et de gouvernance robustes. À l'aide des métadonnées Vertex ML, il suit les entrées, les sorties et les autres composants du pipeline afin de garantir une auditabilité complète. Cela est particulièrement utile pour les organisations des secteurs réglementés ou celles qui ont besoin de modèles de gouvernance stricts. La plateforme enregistre automatiquement les détails des expériences, les versions des modèles et les mesures de performance, créant ainsi une piste d'audit complète pour soutenir les efforts de conformité.

En tant que service géré, Vertex AI peut réduire les coûts de manière significative en supprimant le besoin d'équipes d'infrastructure dédiées. Son modèle de tarification basé sur le paiement à l'utilisation, associé à l'infrastructure mondiale de Google, permet aux entreprises de faire évoluer efficacement leurs opérations de machine learning et d'allouer les ressources là où elles sont le plus nécessaires. Pour les entreprises qui utilisent déjà Google Cloud, Vertex AI permet également d'éviter les coûts liés à la sortie des données, car toutes les données restent dans l'écosystème Google Cloud tout au long du cycle de vie du machine learning.

Les outils de gestion du cycle de vie des modèles d'IA présentent chacun leurs forces et leurs faiblesses. En comprenant ces compromis, les organisations peuvent adapter leurs choix à leurs besoins uniques, à leur infrastructure existante et à l'expertise de leurs équipes. Vous trouverez ci-dessous un résumé des principales caractéristiques et défis des plateformes populaires.

Prompts.ai se distingue par sa capacité à unifier plus de 35 LLM au sein d'un système TOKN payant à l'utilisation, ce qui pourrait permettre de réduire les coûts jusqu'à 98 %. Il offre une gouvernance axée sur l'entreprise avec des contrôles FinOps en temps réel, garantissant transparence et conformité. Cependant, sa spécialisation dans les flux de travail LLM peut limiter son attrait à des cas d'utilisation plus larges du ML.

Débit ML, une plateforme open source, fournit des composants modulaires qui évitent la dépendance vis-à-vis d'un fournisseur. Ses points forts résident dans le suivi des expériences et dans un registre de modèles robuste. Cependant, elle nécessite une configuration et une maintenance importantes, nécessitant une équipe DevOps dédiée pour une gestion efficace.

Kubeflow est conçu pour orchestrer des formations distribuées et des pipelines de machine learning complexes à l'aide de Kubernetes. Il excelle dans la gestion des charges de travail gourmandes en calcul, mais sa courbe d'apprentissage est abrupte, ce qui la rend difficile pour les équipes qui ne disposent pas d'une solide expertise de Kubernetes.

Effacer le ML simplifie la gestion des expériences en automatisant le suivi des modifications de code, des dépendances et des environnements. Cela réduit les efforts manuels et favorise la collaboration au sein de l'équipe. Cela dit, son écosystème plus restreint peut restreindre la gamme d'intégrations tierces disponibles.

Vertex AI, profondément intégré à Google Cloud, propose AutoML et des formations personnalisées dans un environnement entièrement géré. Sa connexion fluide à BigQuery et aux services associés réduit la complexité opérationnelle. Cependant, cela comporte le risque de blocage des fournisseurs et de coûts potentiels de sortie de données.

Le tableau ci-dessous met en évidence les principales caractéristiques de chaque outil :

Le choix du bon outil dépend des priorités de votre organisation. Si la rentabilité et les flux de travail LLM sont au cœur des préoccupations, Prompts.ai est un candidat sérieux. Pour les équipes en quête de flexibilité, Débit ML propose des solutions indépendantes des fournisseurs. Les organisations profondément intégrées à Google Cloud apprécieront Vertex AI, tandis que ceux qui possèdent une expertise de Kubernetes peuvent exploiter Kubeflow pour des fonctionnalités d'orchestration avancées.

Le choix du bon outil de cycle de vie de l'IA dépend de la taille, de l'infrastructure, du budget et des cas d'utilisation uniques de votre organisation. Voici comment certaines des principales plateformes répondent à différents besoins :

Compte tenu de ces atouts, de nombreuses organisations trouvent qu'une approche hybride est plus efficace que de s'appuyer sur une seule plateforme. Par exemple, Prompts.ai peut gérer l'orchestration du LLM et l'optimisation des coûts, tandis que MLflow suit les modèles ML traditionnels et que des outils natifs du cloud supervisent la surveillance de la production. Cette combinaison garantit une couverture complète du cycle de vie de l'IA tout en capitalisant sur les avantages de chaque outil.

Pour les petites équipes, des outils faciles à configurer et à une tarification transparente sont essentiels. Les entreprises de taille moyenne ont souvent besoin de solutions évolutives dotées de puissantes fonctionnalités de gouvernance, tandis que les grandes entreprises donnent la priorité à des pistes d'audit détaillées et à une intégration informatique fluide.

Alors que les outils d'IA continuent de progresser, concentrez-vous sur les plateformes en développement actif, bénéficiant d'un solide soutien communautaire et proposant des plans clairs pour l'avenir. Les flux de travail interopérables restent essentiels pour s'adapter à ce paysage en constante évolution et parvenir à un déploiement efficace de l'IA.

Lorsque vous choisissez un outil pour gérer le cycle de vie des modèles d'IA, il est important de vous concentrer sur les fonctionnalités qui répondent aux besoins spécifiques de votre organisation. Commencez par identifier les outils qui fournissent de puissantes capacités de service conçu pour votre cas d'utilisation particulier, ainsi que options de déploiement flexibles qui peut s'adapter à votre configuration opérationnelle. L'intégration parfaite à votre infrastructure d'apprentissage automatique actuelle est un autre facteur essentiel à prendre en compte.

Il est également judicieux de sélectionner des outils équipés de fonctionnalités de surveillance et d'observabilité pour aider à maintenir les performances et la fiabilité du modèle au fil du temps. Recherchez des solutions faciles à utiliser pour votre équipe tout en offrant de solides mesures de sécurité et de gouvernance pour garantir la conformité et protéger les données sensibles. Le bon choix peut simplifier vos flux de travail, améliorer l'efficacité et obtenir de meilleurs résultats dans la gestion de vos modèles d'IA.

Prompts.ai adhère à des cadres de conformité de premier plan tels que SOC 2 Type II, HIPAA, et GDPR, en garantissant de solides mesures de protection des données et de gouvernance. La plateforme intègre une surveillance continue via Vanta pour maintenir des normes de sécurité rigoureuses.

Le 19 juin 2025, Prompts.ai a lancé sa Processus d'audit SOC 2 de type II, réaffirmant son engagement à maintenir les plus hauts niveaux de sécurité et de conformité des données pour les entreprises clientes.

Les outils de gestion du cycle de vie de l'IA sont conçus pour fonctionner sans effort avec vos systèmes informatiques actuels. Ils sont conçus pour se connecter à des plateformes, des bases de données et des services cloud largement utilisés, afin de s'adapter parfaitement à votre configuration existante.

Ces outils s'intègrent en se connectant à vos pipelines de données, à vos solutions de stockage et à vos environnements de déploiement. Nombre d'entre eux sont également dotés d'API et de flux de travail flexibles, permettant une interaction fluide entre les composants. Cela garantit une supervision et un suivi efficaces de toutes vos initiatives en matière d'IA.