AI मॉडल का प्रबंधन जटिल है, जिसमें विकास, परिनियोजन, निगरानी और सेवानिवृत्ति शामिल है। सही उपकरण वर्कफ़्लो को आसान बना सकते हैं, लागत में कटौती कर सकते हैं और शासन को सुनिश्चित कर सकते हैं। यहां पांच प्रमुख प्लेटफ़ॉर्मों का त्वरित अवलोकन दिया गया है:

प्रत्येक उपकरण में लागत दक्षता से लेकर एकीकरण क्षमताओं तक, विभिन्न आवश्यकताओं के अनुरूप ताकत होती है। निर्णय लेने में आपकी मदद करने के लिए नीचे एक तुलना दी गई है।

वह टूल चुनें जो आपकी प्राथमिकताओं के अनुरूप हो, चाहे वह लागत कम करना हो, संचालन को बढ़ाना हो, या मौजूदा सिस्टम के साथ एकीकरण करना हो।

Prompts.ai एक है एंटरप्राइज एआई ऑर्केस्ट्रेशन प्लेटफॉर्म एक सुरक्षित, केंद्रीकृत इंटरफ़ेस के भीतर 35 से अधिक शीर्ष बड़े भाषा मॉडल (LLM) को एकजुट करने के लिए डिज़ाइन किया गया। प्रॉम्प्ट इंजीनियरिंग और एलएलएम वर्कफ़्लो के प्रबंधन के लिए तैयार किया गया, यह फ़ॉर्च्यून 500 कंपनियों से लेकर रचनात्मक एजेंसियों तक, विभिन्न प्रकार के क्लाइंट्स की सेवा करता है, जिससे उन्हें शासन और लागतों पर नियंत्रण बनाए रखते हुए अपने टूल को कारगर बनाने में मदद मिलती है।

मंच इस पर केंद्रित है शीघ्र इंजीनियरिंग और प्रयोग के चरण AI मॉडल जीवनचक्र का। यह विकास चक्रों में स्थिरता और पुनरुत्पादन सुनिश्चित करने के लिए संस्करण नियंत्रण और A/B परीक्षण जैसी सुविधाओं के साथ संकेतों को डिज़ाइन करने, परीक्षण करने और परिष्कृत करने में उपयोगकर्ताओं का समर्थन करता है। इन महत्वपूर्ण चरणों को ध्यान में रखकर, Prompts.ai प्रॉम्प्ट वर्कफ़्लो को प्रभावी ढंग से स्केल करने की एक महत्वपूर्ण आवश्यकता को पूरा करता है।

Prompts.ai मानकीकृत API एंडपॉइंट के माध्यम से प्रमुख LLM प्रदाताओं के साथ आसानी से जुड़ता है, जिससे टीमों में कई API कनेक्शन और क्रेडेंशियल्स के प्रबंधन को सरल बनाया जाता है। यह एकीकृत पहुंच व्यापक AI डेवलपमेंट स्टैक के साथ सहज एकीकरण सुनिश्चित करती है।

जबकि प्लेटफ़ॉर्म क्लाउड-आधारित एलएलएम के लिए अनुकूलित है, क्लाउड इन्फ्रास्ट्रक्चर पर इसकी निर्भरता सख्त डेटा रेजिडेंसी आवश्यकताओं वाली कंपनियों के लिए चुनौतियां पैदा कर सकती है। संगठनों को यह आकलन करना चाहिए कि क्या इसका सेटअप उनकी अनुपालन आवश्यकताओं के अनुरूप है, खासकर अगर ऑन-प्रिमाइसेस समाधान प्राथमिकता हैं।

Prompts.ai में एक मजबूत सूट शामिल है निगरानी और शासन उपकरण एंटरप्राइज़-स्केल ऑपरेशंस के लिए तैयार किया गया। यह है रियल टाइम एनालिटिक्स त्वरित प्रदर्शन, ट्रैकिंग मेट्रिक्स जैसे प्रतिक्रिया गुणवत्ता, विलंबता और उपयोगकर्ता सहभागिता के बारे में जानकारी प्रदान करें। डेटा-संचालित ये जानकारियां टीमों को प्रदर्शन परिणामों के आधार पर अपनी रणनीतियों को बेहतर बनाने में सक्षम बनाती हैं।

गवर्नेंस फ्रेमवर्क प्रदान करता है शीघ्र संशोधनों के लिए ऑडिट ट्रेल्स, अनुमतियों को प्रबंधित करने के लिए एक्सेस नियंत्रण, और SOC 2 टाइप II, HIPAA और GDPR मानकों का समर्थन करने वाली अनुपालन सुविधाएँ। AI इंटरैक्शन में पूरी दृश्यता के साथ, प्लेटफ़ॉर्म पारदर्शिता और जवाबदेही सुनिश्चित करता है - जो नियामक आवश्यकताओं के साथ नवाचार को संतुलित करने वाले उद्यमों के लिए आवश्यक है। निगरानी और शासन का यह मिश्रण परिचालन दक्षता और निरीक्षण दोनों को बढ़ाता है।

Prompts.ai LLM से संबंधित लागतों को कम करके उल्लेखनीय बचत प्रदान करता है। इसका कुशल त्वरित पुनरावर्तन और परीक्षण परिणाम प्राप्त करने के लिए आवश्यक API कॉल और मॉडल रन की संख्या को कम करता है। प्लेटफ़ॉर्म में शामिल हैं: उपयोग के डैशबोर्ड यह प्रदर्शन लागत अमेरिकी डॉलर में होती है, जिसे टीम, प्रोजेक्ट या मॉडल द्वारा विभाजित किया जाता है, जो खर्च में स्पष्ट दृश्यता प्रदान करता है।

द पे-एज़-यू-गो TOKN क्रेडिट सिस्टम सदस्यता शुल्क को समाप्त करता है, लागत को सीधे वास्तविक उपयोग से जोड़ता है। यह मॉडल संगठनों की मदद कर सकता है AI सॉफ़्टवेयर खर्च को 98% तक कम करें, खासकर जब कई एलएलएम सब्सक्रिप्शन और टूल के प्रबंधन की तुलना में की जाती है। इसके अतिरिक्त, एकीकृत FinOps लेयर टोकन के उपयोग को ट्रैक करता है और खर्च को परिणामों से जोड़ता है, जिससे वित्त टीमों को उनके लिए आवश्यक पारदर्शिता मिलती है।

प्रॉम्प्ट वर्कफ़्लोज़ पर Prompts.ai का लक्षित फ़ोकस इसे अलग करता है, जिससे यह अन्य प्लेटफार्मों के लिए एक शक्तिशाली पूरक बन जाता है जो व्यापक AI क्षमताओं को प्राथमिकता दे सकते हैं।

एमएलफ्लो एक है ओपन-सोर्स प्लेटफ़ॉर्म मशीन लर्निंग जीवनचक्र को सरल बनाने के लिए डिज़ाइन किया गया। यह मॉडल के प्रबंधन और ट्रैकिंग के लिए एक व्यापक ढांचा प्रदान करता है, जिसमें प्रारंभिक प्रयोग से लेकर उत्पादन में तैनाती तक सब कुछ शामिल है।

MLFlow विकास के दौरान स्वचालित रूप से मापदंडों, कोड संस्करणों, मेट्रिक्स और कलाकृतियों को लॉग करके AI जीवनचक्र के महत्वपूर्ण चरणों का समर्थन करता है।

यह मॉडल रजिस्ट्री और मानकीकृत परियोजनाएँ वर्जनिंग, स्टेज ट्रांज़िशन और एक्सपेरिमेंट रिप्रोड्यूसिबिलिटी जैसे कार्यों को कारगर बनाएं। ये सुविधाएं स्पष्ट निरीक्षण और भरोसेमंद परिनियोजन प्रक्रियाओं को सुनिश्चित करती हैं।

MLFlow टूल और प्लेटफ़ॉर्म की एक विस्तृत श्रृंखला के साथ निर्बाध रूप से काम करता है। यह किसके साथ एकीकृत होता है एडब्ल्यूएस सेजमेकर, एमएलओपीएस प्लेटफॉर्म जैसे डैग्स हब, और कई प्रोग्रामिंग वातावरण का समर्थन करता है, जिसमें पायथन, आर, जावा और आरईएसटी एपीआई शामिल हैं। यह लचीलापन टीमों को विभिन्न वातावरणों में मॉडल तैनात करते समय अपने मौजूदा बुनियादी ढांचे का उपयोग करने की अनुमति देता है।

MLFlow स्वचालित रूप से प्रशिक्षण मापदंडों, मैट्रिक्स और कलाकृतियों को ट्रैक करता है, जिससे विस्तृत ऑडिट ट्रेल्स बनते हैं जो डिबगिंग और अनुपालन प्रयासों में सहायता करते हैं।

द मॉडल रजिस्ट्री उन्नत संस्करण नियंत्रण और मंच प्रबंधन उपकरण प्रदान करता है। टीमें अपने उद्देश्य और प्रदर्शन का दस्तावेजीकरण करने के लिए विवरण, टैग और मेटाडेटा के साथ मॉडल को एनोटेट कर सकती हैं। रजिस्ट्री मॉडल वंशावली को भी ट्रैक करती है, जिससे परिनियोजित संस्करणों के विकास की निगरानी और प्रबंधन करना आसान हो जाता है।

पुनरुत्पादकता MLFlow की एक असाधारण विशेषता है। साथ में परियोजनाएँ, यह कोड, निर्भरता और कॉन्फ़िगरेशन को एक साथ पैकेज करता है, मॉडल को विकास से उत्पादन में स्थानांतरित करते समय “यह मेरी मशीन पर काम करता है” के सामान्य मुद्दे को संबोधित करता है।

Kubeflow, Kubernetes पर मशीन लर्निंग पाइपलाइन बनाने और प्रबंधित करने के लिए डिज़ाइन किए गए टूल का एक संग्रह है। कंटेनरीकृत परिनियोजन का उपयोग करके, यह विभिन्न कंप्यूटिंग वातावरणों में स्केलेबिलिटी और लचीलापन सुनिश्चित करता है।

Kubeflow AI मॉडल जीवनचक्र के ऑर्केस्ट्रेशन और परिनियोजन चरणों को संभालने में चमकता है। यह कुशलतापूर्वक कार्यों को शेड्यूल करता है, यह सुनिश्चित करता है कि मशीन सीखने की प्रक्रिया विश्वसनीय, प्रतिलिपि प्रस्तुत करने योग्य और सुव्यवस्थित हो। कुबेरनेट्स पर निर्मित, यह जटिल प्रणालियों के प्रबंधन के लिए आवश्यक पोर्टेबिलिटी और स्केलेबिलिटी प्रदान करता है। इसके अतिरिक्त, यह अपनी कार्यक्षमता को बढ़ाने के लिए मौजूदा उपकरणों के साथ सहजता से एकीकृत हो जाता है।

Kubeflow क्लाउड, ऑन-प्रिमाइसेस और हाइब्रिड सेटअप में परिनियोजन का समर्थन करता है, जिससे यह विविध वातावरणों के अनुकूल हो जाता है। क्यूबफ्लो पाइपलाइन के माध्यम से, यह विभिन्न सर्विंग फ्रेमवर्क के साथ काम करता है, जबकि टूल जैसे टेन्सर बोर्ड रीयल-टाइम मॉडल प्रदर्शन निगरानी सक्षम करें। ML मेटाडेटा (MLMD) को शामिल करने से वंशावली और संबंधित कलाकृतियों को ट्रैक करके इसकी कार्यक्षमता और बढ़ जाती है।

Kubeflow उत्पादन मॉडल के लिए मजबूत निगरानी प्रदान करता है, जिससे निरंतर प्रदर्शन निरीक्षण सुनिश्चित होता है। इसमें मल्टी-यूज़र आइसोलेशन फीचर्स भी शामिल हैं, जिससे एडमिनिस्ट्रेटर एक्सेस को नियंत्रित कर सकते हैं और अनुपालन सुनिश्चित कर सकते हैं। ये गवर्नेंस टूल बड़े पैमाने पर, जटिल मशीन लर्निंग ऑपरेशंस के प्रबंधन के लिए विशेष रूप से उपयोगी होते हैं, जिससे संगठनों को उनकी AI परियोजनाओं के बढ़ने पर नियंत्रण और जवाबदेही बनाए रखने में मदद मिलती है।

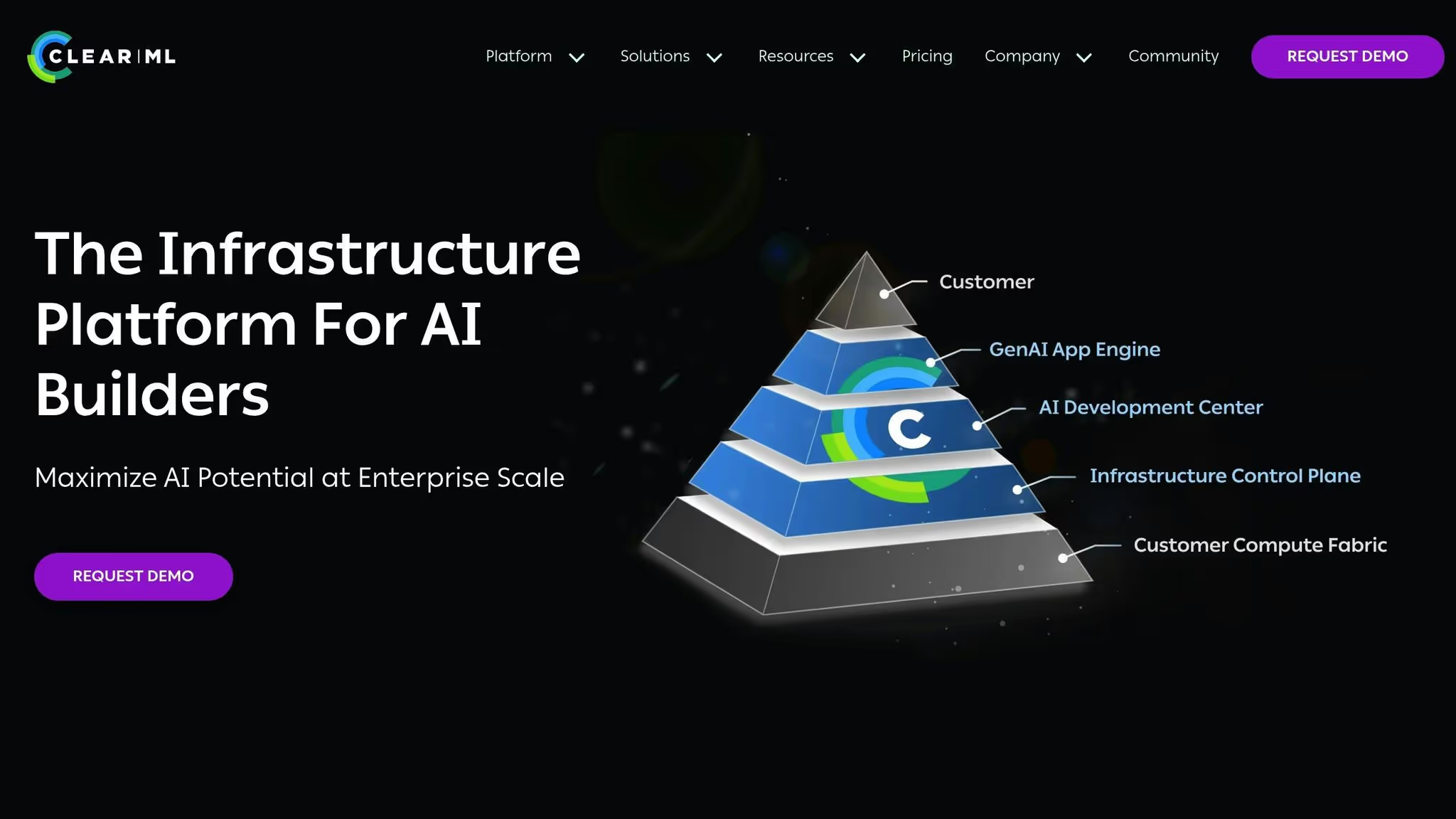

ClearML एक ओपन-सोर्स प्लेटफ़ॉर्म है जिसे संपूर्ण AI जीवनचक्र का प्रबंधन करने के लिए डिज़ाइन किया गया है। इसकी ओपन-सोर्स प्रकृति विशिष्ट परिचालन आवश्यकताओं को पूरा करने के लिए अनुकूलन की अनुमति देती है, हालांकि विस्तृत सार्वजनिक दस्तावेज़ों की उपलब्धता कुछ हद तक सीमित है। यदि आप ClearML पर विचार कर रहे हैं, तो यह आकलन करना आवश्यक है कि यह आपके प्रोजेक्ट के लक्ष्यों और बुनियादी ढांचे के साथ कितनी अच्छी तरह मेल खाता है। उल्लिखित अन्य प्लेटफार्मों की तरह, ClearML का लचीला ढांचा आपके AI वर्कफ़्लो में अद्वितीय मांगों को पूरा करने के लिए उपयुक्त हो सकता है।

Google Cloud Vertex AI, Google का एक पूरी तरह से प्रबंधित मशीन लर्निंग प्लेटफ़ॉर्म है, जिसे Google Cloud इकोसिस्टम के भीतर ML जीवनचक्र के हर चरण का समर्थन करने के लिए तैयार किया गया है। यह एक इंटरफ़ेस के तहत कई तरह के ML टूल और सेवाओं को एक साथ लाता है, जिससे यह उन संगठनों के लिए एक आसान समाधान बन जाता है जो पहले से ही Google Cloud का लाभ उठा रहे हैं।

प्लेटफ़ॉर्म को उपयोगकर्ताओं की एक विस्तृत श्रृंखला को पूरा करने के लिए डिज़ाइन किया गया है, जिसमें कस्टम कोड लिखने वाले डेटा वैज्ञानिकों से लेकर कम-कोड विकल्पों की तलाश करने वाले व्यावसायिक विश्लेषकों तक शामिल हैं। यह लचीलापन टीमों को उन तरीकों से काम करने की अनुमति देता है जो संगठन के ML वर्कफ़्लो में एकरूपता बनाए रखते हुए उनकी आवश्यकताओं के अनुरूप सर्वोत्तम तरीके से काम कर सकते हैं।

Vertex AI संपूर्ण AI मॉडल जीवनचक्र के लिए व्यापक सहायता प्रदान करता है, जो Google क्लाउड सेवाओं के साथ सहजता से एकीकृत होता है। पूर्ण नियंत्रण की आवश्यकता वाली टीमों के लिए, यह कस्टम कोड प्रशिक्षण प्रदान करता है। साथ ही, इसके AutoML फीचर्स और प्रबंधित एंडपॉइंट ऑटोमेशन के पक्षधर लोगों के लिए स्केलिंग और इंफ्रास्ट्रक्चर प्रबंधन को सरल बनाते हैं [6,7]। प्लेटफ़ॉर्म की MLOPS पाइपलाइन विकास से उत्पादन में आसानी से परिवर्तन करती हैं, यहाँ तक कि उन टीमों के लिए भी जिनके पास व्यापक DevOps विशेषज्ञता नहीं है। इसके अतिरिक्त, संसाधनों का कुशल उपयोग सुनिश्चित करते हुए, परियोजना की मांगों के आधार पर गणना संसाधनों को बढ़ाया या घटाया जा सकता है। शुरू से अंत तक मिलने वाली इस सहायता को अन्य Google Cloud टूल के साथ कसकर एकीकृत किया गया है, जिससे एक सुव्यवस्थित वर्कफ़्लो बनता है।

जो चीज Vertex AI को अलग करती है, वह है Google Cloud Platform की अन्य सेवाओं के साथ इसका गहरा एकीकरण। यह किसके साथ आसानी से काम करता है BigQuery डेटा वेयरहाउसिंग के लिए और लुकर व्यावसायिक बुद्धिमत्ता के लिए, डेटा विज्ञान कार्यों के लिए एकीकृत वातावरण प्रदान करना।

यह कड़ा एकीकरण जटिल डेटा ट्रांसफर की आवश्यकता को समाप्त करता है, क्योंकि डेटा वैज्ञानिक सीधे वर्टेक्स एआई वातावरण के भीतर संगठनात्मक डेटा तक पहुंच सकते हैं। एक एकीकृत API Google Cloud सेवाओं में इंटरैक्शन को और सरल बनाता है, जिससे यूज़र जल्दी से प्लेटफ़ॉर्म के अनुकूल हो जाते हैं और विकास में तेजी लाते हैं।

Vertex AI मजबूत निगरानी और शासन सुविधाओं की पेशकश करके जीवनचक्र प्रबंधन से आगे निकल जाता है। वर्टेक्स एमएल मेटाडेटा का उपयोग करते हुए, यह व्यापक ऑडिटेबिलिटी सुनिश्चित करने के लिए इनपुट, आउटपुट और अन्य पाइपलाइन घटकों को ट्रैक करता है। यह विनियमित उद्योगों के संगठनों या सख्त मॉडल गवर्नेंस की आवश्यकता वाले संगठनों के लिए विशेष रूप से मूल्यवान है। प्लेटफ़ॉर्म स्वचालित रूप से प्रयोग विवरण, मॉडल संस्करण और प्रदर्शन मेट्रिक्स को रिकॉर्ड करता है, जिससे अनुपालन प्रयासों का समर्थन करने के लिए एक संपूर्ण ऑडिट ट्रेल बनाया जाता है।

एक प्रबंधित सेवा के रूप में, वर्टेक्स एआई समर्पित इंफ्रास्ट्रक्चर टीमों की आवश्यकता को दूर करके लागत को काफी कम कर सकता है। इसका पे-एज़-यू-यूज़ प्राइसिंग मॉडल, Google के वैश्विक इन्फ्रास्ट्रक्चर के साथ मिलकर, संगठनों को ML ऑपरेशंस को कुशलतापूर्वक स्केल करने और उन संसाधनों को आवंटित करने में सक्षम बनाता है, जिनकी उन्हें सबसे अधिक आवश्यकता होती है। पहले से Google Cloud का उपयोग करने वाले संगठनों के लिए, Vertex AI डेटा निकालने की लागत से बचने में भी मदद करता है, क्योंकि सभी डेटा पूरे ML जीवनचक्र के दौरान Google Cloud इकोसिस्टम के भीतर रहता है।

AI मॉडल जीवनचक्र प्रबंधन उपकरण प्रत्येक अपनी ताकत और कमजोरियों को सामने लाते हैं। इन ट्रेड-ऑफ को समझकर, संगठन अपनी विशिष्ट आवश्यकताओं, मौजूदा बुनियादी ढांचे और टीम विशेषज्ञता के साथ अपनी पसंद को संरेखित कर सकते हैं। नीचे लोकप्रिय प्लेटफ़ॉर्म की प्रमुख विशेषताओं और चुनौतियों का संक्षिप्त विवरण दिया गया है।

Prompts.ai पे-एज़-यू-गो TOKN सिस्टम के तहत 35+ LLM को एकजुट करने की अपनी क्षमता के कारण सबसे अलग है, जिससे संभावित रूप से लागत में 98% तक की कमी आती है। यह वास्तविक समय के FinOps नियंत्रणों के साथ उद्यम-केंद्रित शासन प्रदान करता है, जिससे पारदर्शिता और अनुपालन सुनिश्चित होता है। हालांकि, LLM वर्कफ़्लो में इसकी विशेषज्ञता व्यापक ML उपयोग के मामलों तक इसकी अपील को सीमित कर सकती है।

एमएलफ्लो, एक ओपन-सोर्स प्लेटफ़ॉर्म, मॉड्यूलर घटक प्रदान करता है जो विक्रेता लॉक-इन से बचते हैं। इसकी खूबियां प्रयोग ट्रैकिंग और मजबूत मॉडल रजिस्ट्री में निहित हैं। हालाँकि, इसके लिए महत्वपूर्ण सेटअप और रखरखाव की आवश्यकता होती है, जिसके लिए एक समर्पित DevOps टीम को प्रभावी ढंग से प्रबंधित करने की आवश्यकता होती है।

क्यूबफ्लो को कुबेरनेट्स का उपयोग करके वितरित प्रशिक्षण और जटिल एमएल पाइपलाइनों को ऑर्केस्ट्रेट करने के लिए डिज़ाइन किया गया है। यह कंप्यूट-हैवी वर्कलोड को संभालने में उत्कृष्ट है, लेकिन इसमें सीखने की क्षमता बहुत तेज है, जिससे कुबेरनेट्स की मजबूत विशेषज्ञता वाली टीमों के लिए यह चुनौतीपूर्ण हो जाता है।

क्लियरएमएल कोड परिवर्तन, निर्भरता और वातावरण की ट्रैकिंग को स्वचालित करके प्रयोग प्रबंधन को सरल बनाता है। यह मैन्युअल प्रयास को कम करता है और टीम सहयोग को बढ़ावा देता है। हालांकि, इसका छोटा इकोसिस्टम उपलब्ध तृतीय-पक्ष एकीकरण की सीमा को सीमित कर सकता है।

वर्टेक्स एआई, जो Google Cloud के साथ गहराई से एकीकृत है, पूरी तरह से प्रबंधित वातावरण में AutoML और कस्टम प्रशिक्षण प्रदान करता है। BigQuery और संबंधित सेवाओं के साथ इसका सहज कनेक्शन परिचालन जटिलता को कम करता है। हालांकि, इसमें वेंडर लॉक-इन और संभावित डेटा निकासी लागतों का जोखिम होता है।

नीचे दी गई तालिका प्रत्येक टूल की मुख्य विशेषताओं पर प्रकाश डालती है:

सही टूल चुनना आपके संगठन की प्राथमिकताओं पर निर्भर करता है। यदि लागत दक्षता और एलएलएम वर्कफ़्लो शीर्ष चिंताएं हैं, Prompts.ai एक मजबूत दावेदार है। लचीलेपन की तलाश करने वाली टीमों के लिए, एमएलफ्लो विक्रेता-तटस्थ समाधान प्रदान करता है। Google Cloud के साथ गहराई से जुड़े संगठन इसकी सराहना करेंगे वर्टेक्स एआई, जबकि कुबेरनेट्स विशेषज्ञता वाले लोग इसका उपयोग कर सकते हैं क्यूबफ्लो उन्नत ऑर्केस्ट्रेशन क्षमताओं के लिए।

सही AI जीवनचक्र उपकरण का चयन करना आपके संगठन के आकार, बुनियादी ढांचे, बजट और अद्वितीय उपयोग के मामलों पर निर्भर करता है। यहां बताया गया है कि कुछ प्रमुख प्लेटफ़ॉर्म अलग-अलग ज़रूरतों के साथ कैसे संरेखित होते हैं:

इन खूबियों को देखते हुए, कई संगठन एक ही मंच पर भरोसा करने की तुलना में हाइब्रिड दृष्टिकोण को अधिक प्रभावी पाते हैं। उदाहरण के लिए, Prompts.ai LLM ऑर्केस्ट्रेशन और लागत अनुकूलन को संभाल सकता है, जबकि MLFlow पारंपरिक ML मॉडल को ट्रैक करता है, और क्लाउड-नेटिव टूल उत्पादन निगरानी की देखरेख करते हैं। यह संयोजन प्रत्येक टूल के फायदों को भुनाने के दौरान AI जीवनचक्र की व्यापक कवरेज सुनिश्चित करता है।

छोटी टीमों के लिए, आसान सेटअप और पारदर्शी मूल्य निर्धारण वाले टूल महत्वपूर्ण हैं। मध्यम आकार के संगठनों को अक्सर मजबूत शासन सुविधाओं के साथ स्केलेबल समाधानों की आवश्यकता होती है, जबकि बड़े उद्यम विस्तृत ऑडिट ट्रेल्स और सहज आईटी एकीकरण को प्राथमिकता देते हैं।

जैसे-जैसे AI टूल आगे बढ़ रहे हैं, सक्रिय विकास, मजबूत सामुदायिक समर्थन और भविष्य के लिए स्पष्ट योजनाओं वाले प्लेटफार्मों पर ध्यान केंद्रित करें। इस बदलते परिदृश्य के अनुकूल होने और प्रभावी AI परिनियोजन प्राप्त करने के लिए इंटरऑपरेबल वर्कफ़्लोज़ महत्वपूर्ण बने हुए हैं।

AI मॉडल के जीवनचक्र के प्रबंधन के लिए एक उपकरण चुनते समय, उन सुविधाओं पर ध्यान देना महत्वपूर्ण है जो आपके संगठन की विशिष्ट आवश्यकताओं से मेल खाती हैं। प्रदान करने वाले टूल की पहचान करके प्रारंभ करें शक्तिशाली सेवारत क्षमताएं आपके विशेष उपयोग के मामले के लिए डिज़ाइन किया गया है, साथ में लचीले परिनियोजन विकल्प जो आपके ऑपरेशनल सेटअप के अनुकूल हो सकता है। आपके मौजूदा मशीन लर्निंग इंफ्रास्ट्रक्चर के साथ सहज एकीकरण विचार करने के लिए एक और महत्वपूर्ण कारक है।

इससे लैस टूल का चयन करना भी बुद्धिमानी है निगरानी और अवलोकन की विशेषताएं समय के साथ मॉडल के प्रदर्शन और विश्वसनीयता को बनाए रखने में मदद करने के लिए। ऐसे समाधानों की तलाश करें, जो मज़बूत ऑफ़र करते समय आपकी टीम के लिए उपयोग करने में आसान हों सुरक्षा और शासन के उपाय अनुपालन सुनिश्चित करने और संवेदनशील डेटा की सुरक्षा के लिए। सही विकल्प आपके वर्कफ़्लो को सरल बना सकता है, दक्षता में सुधार कर सकता है और आपके AI मॉडल को प्रबंधित करने में बेहतर परिणाम दे सकता है।

Prompts.ai शीर्ष स्तरीय अनुपालन ढांचे का पालन करता है जैसे कि एसओसी 2 टाइप II, हिपा, और जीडीपीआर, मजबूत डेटा सुरक्षा और शासन उपायों को सुनिश्चित करना। मंच के माध्यम से निरंतर निगरानी को एकीकृत करता है वांता कठोर सुरक्षा मानकों को बनाए रखने के लिए।

19 जून, 2025 को, Prompts.ai ने इसकी शुरुआत की SOC 2 टाइप II ऑडिट प्रक्रिया, एंटरप्राइज़ ग्राहकों के लिए डेटा सुरक्षा और अनुपालन के उच्चतम स्तर को बनाए रखने के लिए अपने समर्पण की पुष्टि करता है।

AI जीवनचक्र प्रबंधन उपकरण आपके मौजूदा IT सिस्टम के साथ आसानी से काम करने के लिए बनाए गए हैं। वे व्यापक रूप से उपयोग किए जाने वाले प्लेटफ़ॉर्म, डेटाबेस और क्लाउड सेवाओं से जुड़ने के लिए डिज़ाइन किए गए हैं, ताकि यह सुनिश्चित हो सके कि वे आपके मौजूदा सेटअप में ठीक से फिट हों।

ये टूल आपकी डेटा पाइपलाइन, स्टोरेज समाधान और परिनियोजन वातावरण से लिंक करके एकीकृत होते हैं। कई API और लचीले वर्कफ़्लो के साथ भी आते हैं, जो घटकों के बीच सहज सहभागिता की अनुमति देते हैं। यह आपकी सभी AI पहलों पर प्रभावी निगरानी और निगरानी सुनिश्चित करता है।