La gestion de pipelines de machine learning complexes n'a jamais été aussi simple. En 2026, les équipes d'apprentissage automatique s'attaqueront à la complexité croissante des pipelines, aux besoins de conformité et aux coûts du cloud. Voici un aperçu des six principales plateformes d'orchestration qui rationalisent les flux de travail, réduisent les coûts et améliorent la gouvernance des projets d'IA d'entreprise :

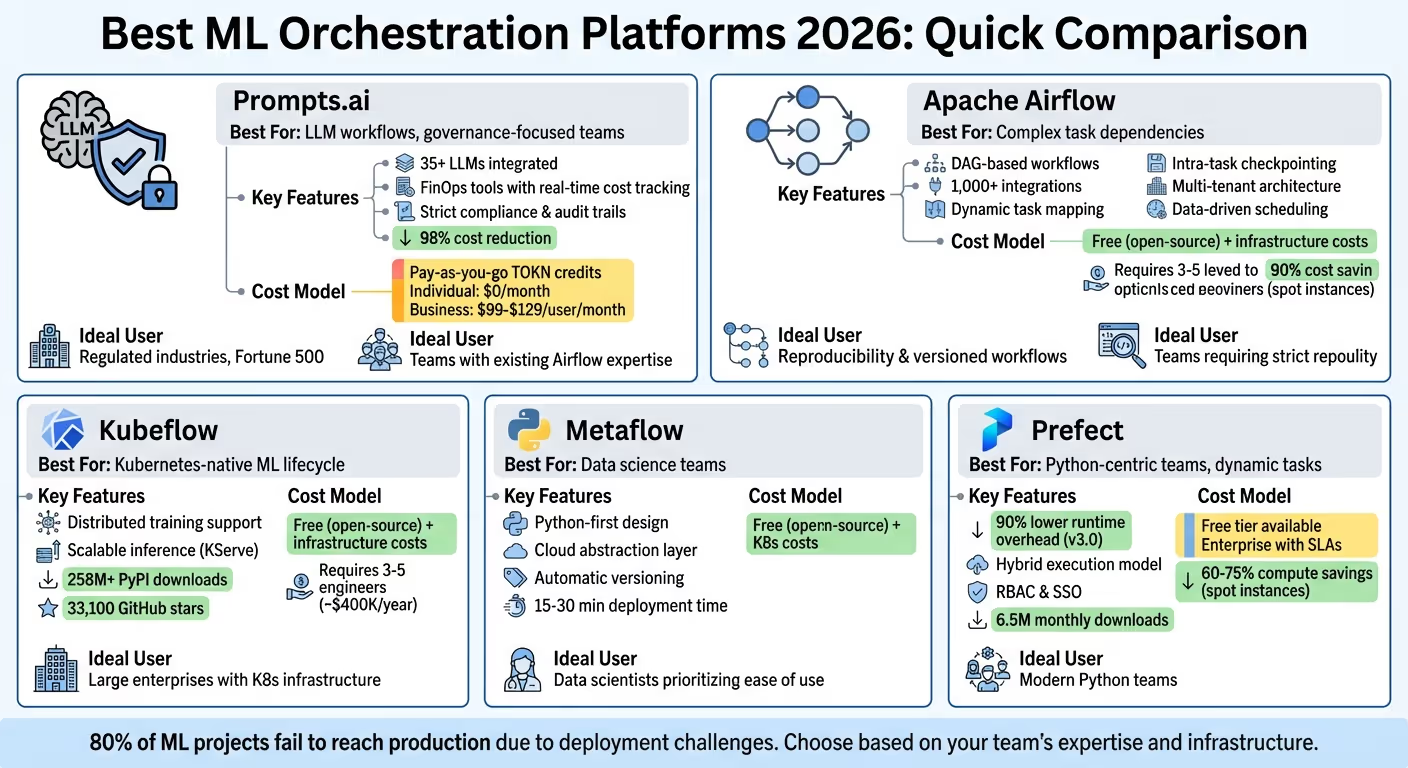

Chaque plateforme possède des atouts uniques, qu'il s'agisse de gérer des opérations LLM à grande échelle ou de proposer des fonctionnalités permettant de réduire les coûts, telles que la prise en charge des instances ponctuelles. Vous trouverez ci-dessous une comparaison rapide qui vous aidera à choisir la solution adaptée à votre équipe.

Qu'il s'agisse de faire évoluer les flux de travail d'IA, d'optimiser les coûts ou de garantir la conformité, le choix de la bonne plateforme dépend de votre infrastructure, de l'expertise de votre équipe et des objectifs du projet. Examinons plus en détail ce qui distingue chaque solution.

Plateformes d'orchestration ML 2026 : comparaison des fonctionnalités et des coûts

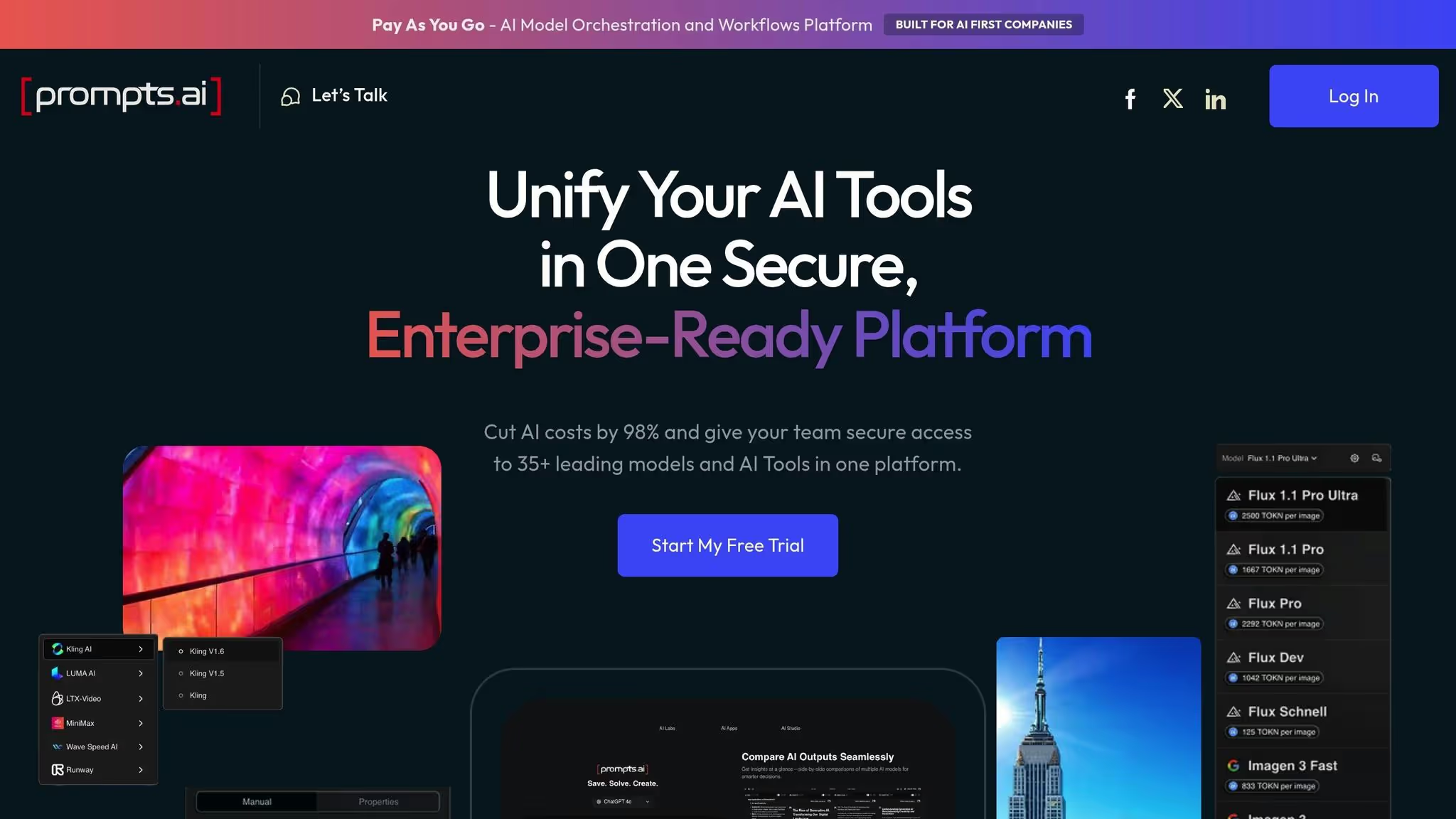

Prompts.ai sert de plate-forme unifiée, intégrant de manière fluide plus de 35 grands modèles de langage (y compris GPT-5, Claude, et Lama) dans une interface unique. Sa conception à plusieurs niveaux divise le processus en étapes distinctes : création rapide, contrôles de sécurité et déploiement. Cette structure minimise les risques opérationnels tout en garantissant la conformité de l'ensemble des flux de travail d'apprentissage automatique (ML). La plateforme prend également en charge les flux de travail agentiques, qui automatisent le mouvement des données et normalisent les sorties entre les pipelines. Grâce à l'intégration de la chaîne de pensée, les équipes peuvent suivre chaque décision prise par les modèles, ajoutant ainsi une couche de transparence aux systèmes de machine learning de production. Cette architecture est conçue pour améliorer l'analyse comparative du machine learning et améliorer l'efficacité opérationnelle.

Prompts.ai propose des outils d'analyse comparative directe des performances, permettant aux ingénieurs ML d'évaluer la précision, la latence et la qualité de sortie sans avoir besoin de plusieurs plateformes. Les fonctionnalités FinOps en temps réel surveillent l'utilisation des jetons, reliant les dépenses liées à l'IA aux résultats commerciaux. Cela permet aux équipes d'identifier les flux de travail coûteux avant la mise à l'échelle. Les « gains de temps » de la plateforme rationalisent les tâches de machine learning courantes telles que la validation des données, l'ingénierie des fonctionnalités et l'évaluation des modèles en intégrant les meilleures pratiques dans des flux de travail réutilisables. En outre, le programme intégré de certification Prompt Engineer permet aux équipes d'affiner et de standardiser les flux de travail, en transformant des expériences ponctuelles en processus reproductibles et vérifiables. Pour compléter ces fonctionnalités, Prompts.ai applique des mesures de sécurité strictes.

Comprenant le besoin critique de gouvernance dans les MLOP d'entreprise, Prompts.ai fournit un système de contrôle centralisé qui enregistre chaque décision des agents et applique des politiques strictes. Les pistes d'audit automatisées et le filtrage des informations personnelles garantissent la conformité aux normes américaines strictes. Ces protocoles de sécurité permettent aux entreprises du Fortune 500 et aux secteurs hautement réglementés de déployer des pipelines de machine learning en toute confiance, sans compromettre les données sensibles.

Prompts.ai fonctionne sur un système de crédit TOKN par paiement à l'utilisation, qui lie les coûts directement à l'utilisation. Les plans individuels commencent à 0$ par mois, ce qui permet une exploration sans risque, tandis que les niveaux commerciaux varient de 99$ à 129$ par utilisateur et par mois. En consolidant les outils en une seule couche d'orchestration, la plateforme peut réduire les coûts des logiciels d'IA jusqu'à 98 %. Le suivi des dépenses en temps réel et un tableau de bord FinOps détaillé fournissent des informations détaillées sur les modèles, les instructions et les flux de travail qui génèrent les coûts les plus élevés. Cette transparence est particulièrement utile pour les équipes américaines qui gèrent les budgets cloud sur AWS, Azure ou Google Cloud. Le modèle de coûts répond à la nécessité d'un contrôle des dépenses clair et basé sur l'utilisation.

Apache Airflow 3.x est construit sur architecture modulaire qui divise les fonctionnalités de base en quatre composants principaux : un planificateur, un serveur Web, une base de données de métadonnées et un processeur DAG autonome. Cette séparation garantit une meilleure sécurité en isolant le code fourni par l'utilisateur du planificateur. Début 2026, la dernière version stable est la 3.1.5, qui introduit le SDK de tâches. Ce SDK rationalise la création de tâches en découplant la logique d'exécution du moteur d'orchestration, ce qui rend les flux de travail plus efficaces.

Semblable à prompts.ai, Airflow répond à la demande d'orchestration du machine learning évolutive et efficace. Cependant, son framework open source contraste avec le modèle de plateforme intégré de prompts.ai. L'une des caractéristiques remarquables d'Airflow est sa modèle de calcul enfichable, qui permet d'exécuter des tâches sur diverses infrastructures. Par exemple, les tâches d'ingénierie des données peuvent tirer parti des clusters Spark, tandis que la formation sur les modèles peut utiliser des GPU via Opérateur Kubernetes. Le API TaskFlow simplifie le partage de données entre les tâches via des décorateurs Python et des XCOM implicites, permettant aux utilisateurs de transformer facilement des scripts ML standard en flux de travail orchestrés. En outre, mappage dynamique des tâches permet aux pipelines de s'adapter de manière dynamique pendant l'exécution. Cela est particulièrement utile pour exécuter un entraînement sur modèle parallèle avec différents hyperparamètres sans avoir à prédéfinir le nombre de tâches. Ces fonctionnalités font d'Airflow un outil polyvalent pour les projets de machine learning, complétant les fonctionnalités robustes de plateformes telles que prompts.ai.

Airflow a évolué au-delà de l'ingénierie des données traditionnelle et propose désormais plus de 1 000 intégrations, notamment MLflow, Weights & Biases, et des bases de données vectorielles telles que Pinecone et Weaviate. Cette extension positionne Airflow comme un acteur clé dans Flux de travail LLMops, tels que l'orchestration de la génération augmentée de récupération (RAG) et la mise au point de pipelines qui intègrent des données propriétaires dans des bases de données vectorielles. La cartographie dynamique des tâches améliore encore sa capacité à dimensionner les tâches de formation ML en parallèle.

Avec planification pilotée par les données alimentés par Airflow Datasets, les flux de travail peuvent se déclencher automatiquement lorsque des dépendances de données spécifiques sont mises à jour, créant ainsi des pipelines MLOps plus réactifs. Le Configuration et démontage les types de tâches permettent de gérer les ressources de machine learning temporaires, en veillant à ce que les clusters GPU coûteux ne soient actifs que pendant les tâches de formation, ce qui permet de contrôler les coûts d'infrastructure. Pour garantir la qualité des données avant la formation, Airflow s'intègre à des outils tels que De grandes attentes et Noyau de soda, réduisant ainsi le risque que des données de mauvaise qualité aient une incidence sur les résultats des modèles. Ces fonctionnalités mettent en évidence la capacité d'Airflow à faire le lien entre l'ingénierie des données traditionnelle et les opérations de machine learning de pointe.

Flux d'air « Les flux de travail sous forme de code » Cette approche permet aux équipes d'utiliser Git pour le contrôle des versions et la gestion des pistes d'audit. Il est intégré Intégration d'OpenLineage prend en charge le suivi du lignage des données et la gouvernance des modèles, ce qui est essentiel pour respecter les normes de conformité telles que le RGPD et la HIPAA. Le récemment introduit flux d'airctl L'outil de ligne de commande (version 0.1.0, publiée en octobre 2025) fournit un moyen sécurisé et piloté par API pour gérer les déploiements.

La sécurité est au cœur d'Airflow 3.x, qui met en œuvre un modèle de sécurité multirôle. Des rôles tels que Deployment Manager, DAG Author et Operations User permettent aux data scientists de créer des pipelines sans avoir besoin d'un accès administratif complet. Les flux de travail peuvent également être exécutés avec des autorisations utilisateur Unix spécifiques grâce à l'usurpation d'identité des tâches, en appliquant des limites de sécurité strictes. En outre, les intégrations avec Gestionnaire de secrets Amazon et Coffre-fort HashiCorp assurez-vous que les informations d'identification sensibles et les clés d'API sont stockées en toute sécurité.

Apache Airflow est utilisation gratuite sous la licence Apache 2.0. Cependant, le coût global de fonctionnement d'Airflow peut être important en raison des ressources DevOps nécessaires à la configuration et à la maintenance continue. Bien qu'il n'y ait pas de frais de licence, les entreprises doivent prendre en compte les dépenses liées à l'infrastructure cloud, au personnel qualifié et à la nature gourmande en ressources de la plateforme.

Pour ceux qui cherchent à réduire les frais d'exploitation, des services gérés tels que Astronome, AS MAWA, et Compositeur Google Cloud proposer une tarification échelonnée ou basée sur la consommation. Ces services incluent souvent des optimisations telles que les files d'attente des travailleurs, qui attribuent les tâches aux machines les plus rentables. Par exemple, les nœuds GPU peuvent gérer des tâches d'entraînement gourmandes en ressources, tandis que les tâches légères sont attribuées à des instances de processeur plus économiques. Pour optimiser la rentabilité, les entreprises doivent aligner leur utilisation sur ces modèles de tarification flexibles, en particulier dans les environnements hybrides ou basés sur le cloud.

Kubeflow Pipelines (KFP) permet aux utilisateurs de définir des flux de travail d'apprentissage automatique sous forme de graphes acycliques orientés via un SDK Python. Ces flux de travail sont compilés dans des fichiers YAML pour une exécution conteneurisée. La conception modulaire de la plateforme intègre plusieurs composants clés, notamment Trainer pour la formation distribuée, Katib pour le réglage des hyperparamètres, et K Serve pour une inférence évolutive. Un tableau de bord centralisé fournit une interface unifiée pour gérer ces composants, ce qui en fait un choix incontournable pour l'orchestration du machine learning native de Kubernetes. Kubeflow garantit que les flux de travail s'exécutent de manière cohérente, que ce soit sur des machines locales, des clusters sur site ou des plateformes cloud telles que Google Cloud Vertex AI. Cette architecture favorise un cycle de vie du machine learning fluide et efficace.

L'approche modulaire de Kubeflow lui fournit une gamme d'outils adaptés à l'apprentissage automatique. Il orchestre l'ensemble du cycle de vie du machine learning, de la préparation des données au déploiement, à l'aide de Pipelines, Trainer, Katib et KServe. Un registre de modèles intégré garantit la reproductibilité des expériences et des déploiements. Katib simplifie le réglage des hyperparamètres grâce à des méthodes telles que l'optimisation bayésienne et la recherche par grille. Pour les tâches à grande échelle, le composant Trainer prend en charge la formation distribuée à l'aide de frameworks tels que PyTorch, Visage étreignant, Vitesse profonde, et JAX. KServe propose une plate-forme sans serveur et indépendante du framework pour déployer des modèles construits avec TensorFlow, PyTorch, ou scikit-learn. Des fonctionnalités supplémentaires telles que l'exécution parallèle et la mise en cache améliorent l'efficacité des calculs, tandis que le SDK Kubeflow Python simplifie la création de pipelines.

Kubeflow utilise le RBAC Kubernetes et les espaces de noms pour isoler les charges de travail et gérer efficacement les autorisations des utilisateurs. Le service de métadonnées ML suit l'état et le lignage des conteneurs exécutés, en capturant des détails sur leurs entrées, leurs sorties et les artefacts de données associés. Le registre des modèles conserve une piste d'audit claire, reliant l'expérimentation aux flux de production. L'accès à tous les composants est sécurisé via le tableau de bord central, qui utilise des interfaces authentifiées. Un agent de persistance de pipeline enregistre les données d'exécution dans un magasin de métadonnées basé sur MySQL, répondant ainsi aux besoins de gouvernance et d'audit. Les secrets Kubernetes sont utilisés pour gérer en toute sécurité les informations d'identification sensibles, faisant de Kubeflow une option viable pour les environnements isolés et les déploiements de cloud privé.

En tant que projet open source sous licence Apache 2.0, Kubeflow élimine les frais de licence, mais les utilisateurs doivent prendre en compte les coûts de l'infrastructure Kubernetes sous-jacente. Cela inclut les dépenses liées aux plateformes cloud telles que Moteur Google Kubernetes ou des déploiements sur site, ainsi que des besoins de stockage pour gérer les artefacts via des outils tels que Algues marines ou Stockage dans le cloud de Google. Pour les entreprises qui cherchent à rationaliser leurs opérations, les services gérés tels que Google Cloud Vertex AI Pipelines proposent un modèle de paiement à l'utilisation qui prend en charge la gestion de l'infrastructure. En outre, des fonctionnalités telles que la mise en cache dans Kubeflow Pipelines peuvent contribuer à réduire les temps d'itération, réduisant ainsi les coûts associés au cloud.

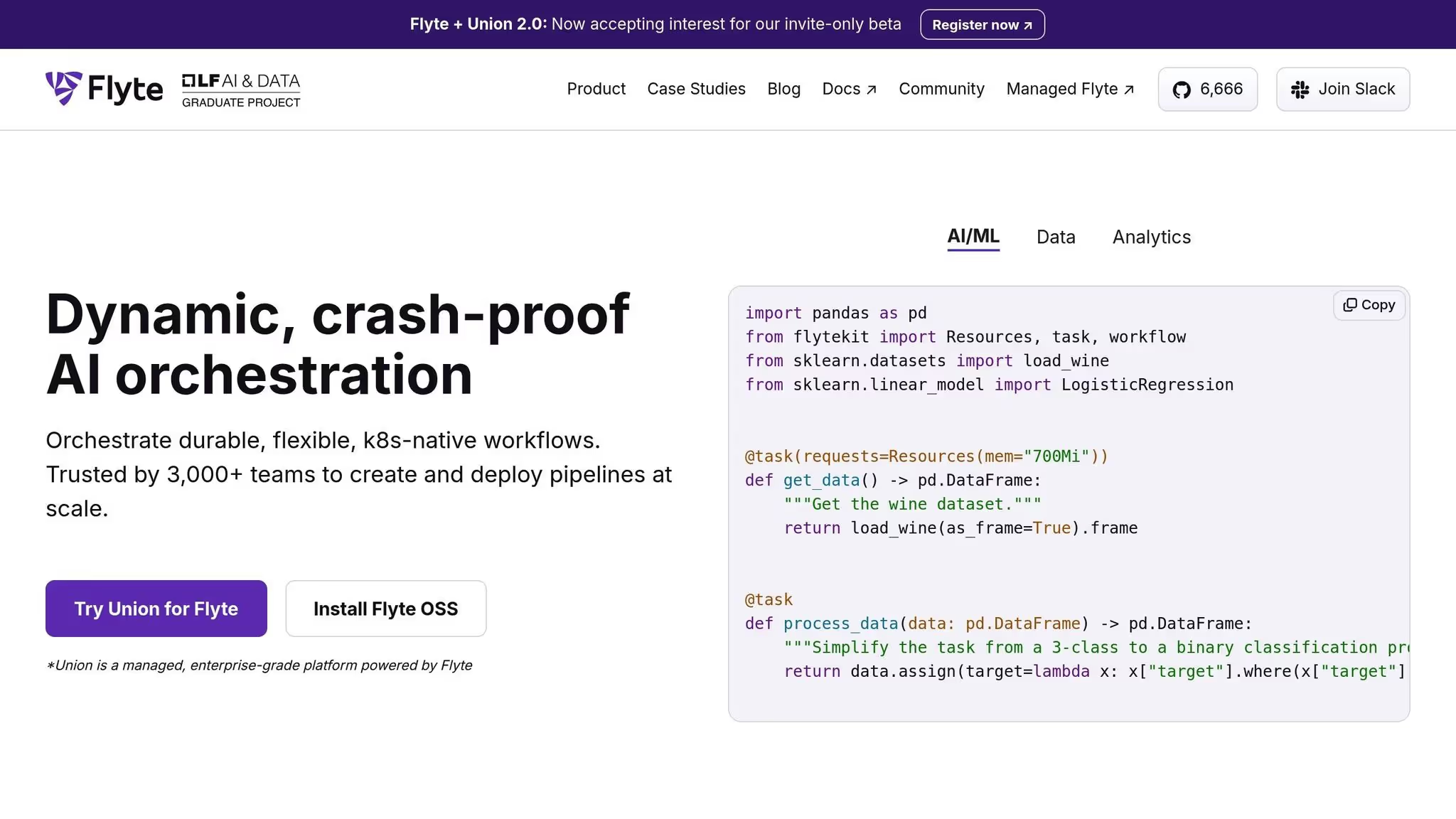

Flyte est construit sur un architecture à trois plans qui organise efficacement ses opérations : le plan utilisateur, le plan de contrôle et le plan de données.

Cette conception native de Kubernetes permet à Flyte de gérer une simultanéité élevée et d'évoluer sans effort, en prenant en charge des projets allant des petites expériences aux charges de travail nécessitant des milliers de processeurs. Aujourd'hui, plus de 3 000 équipes font confiance à Flyte pour déployer des pipelines à grande échelle. Cette architecture constitue l'épine dorsale des capacités d'apprentissage automatique de Flyte.

Flyte prend en charge l'ensemble du cycle de vie de l'apprentissage automatique avec des outils adaptés pour formation distribuée. Il s'intègre à Horovod et des opérateurs Kubeflow pour MPI, TensorFlow et PyTorch. Les développeurs peuvent définir les besoins en ressources directement en Python à l'aide de décorateurs tels que @task (Requests=Resources (gpu="2")). Flyte simplifie également le réglage des hyperparamètres avec map_task pour le traitement en parallèle et @dynamic flux de travail pour la recherche par grille, la recherche aléatoire ou l'optimisation bayésienne.

L'une des caractéristiques les plus remarquables est pointage de contrôle intra-tâche, qui permet aux tâches de longue durée de reprendre à leur dernier point de contrôle après un échec, évitant ainsi de devoir recommencer. Un exemple concret de l'évolutivité de Flyte est MéthaneSat, qui utilise Flyte pour traiter plus de 200 Go de données brutes par jour, exploite plus de 10 000 processeurs et génère environ 2 To de sortie.

« Lorsque vous écrivez des scripts Python, tout s'exécute et prend un certain temps, alors qu'aujourd'hui, gratuitement, nous obtenons un parallélisme entre les tâches. Nos data scientists pensent que c'est vraiment cool. » - Dylan Wilder, responsable de l'ingénierie, Spotify

Flytes architecture à locataires multiples permet à plusieurs équipes de partager leur infrastructure tout en isolant leurs données, leurs configurations et leurs ressources. L'exécution immuable garantit que les flux de travail ne peuvent pas être modifiés après leur exécution, ce qui crée une piste d'audit robuste et renforce l'isolation des données. La gestion des versions des flux de travail permet aux équipes de suivre les modifications et de revenir aux versions précédentes si nécessaire. Jeev Balakrishnan, ingénieur logiciel chez Nom gratuit, a souligné cet avantage :

« Flyte utilise ce concept de transformation immuable : il s'avère que les exécutions ne peuvent pas être supprimées. Le fait d'avoir une transformation immuable est donc une très bonne abstraction pour notre pile d'ingénierie des données ».

Flyte utilise également des interfaces fortement typées pour valider les données à chaque étape. Les informations d'identification sensibles sont gérées de manière sécurisée, soit montées sous forme de fichiers, soit transmises en tant que variables d'environnement. En outre, le suivi du lignage des données de bout en bout fournit une visibilité complète sur l'origine et les transformations des données tout au long de leur cycle de vie.

Flyte est un plateforme open source gratuite disponible sous licence Apache 2.0, les utilisateurs prenant en charge leurs propres coûts d'infrastructure Kubernetes. Pour réduire les dépenses, Flyte propose interruptible argument dans les décorateurs de tâches, permettant l'utilisation d'instances ponctuelles ou préemptives. Cette approche peut réduire les coûts de calcul jusqu'à 90 % par rapport à la tarification à la demande. Jeev Balakrishnan de Freenome a expliqué :

« Compte tenu de l'ampleur de l'exécution de certaines de ces tâches, le calcul peut devenir très coûteux. La possibilité d'ajouter un argument interruptible au décorateur de tâches pour certaines tâches s'est donc révélée très utile pour réduire les coûts ».

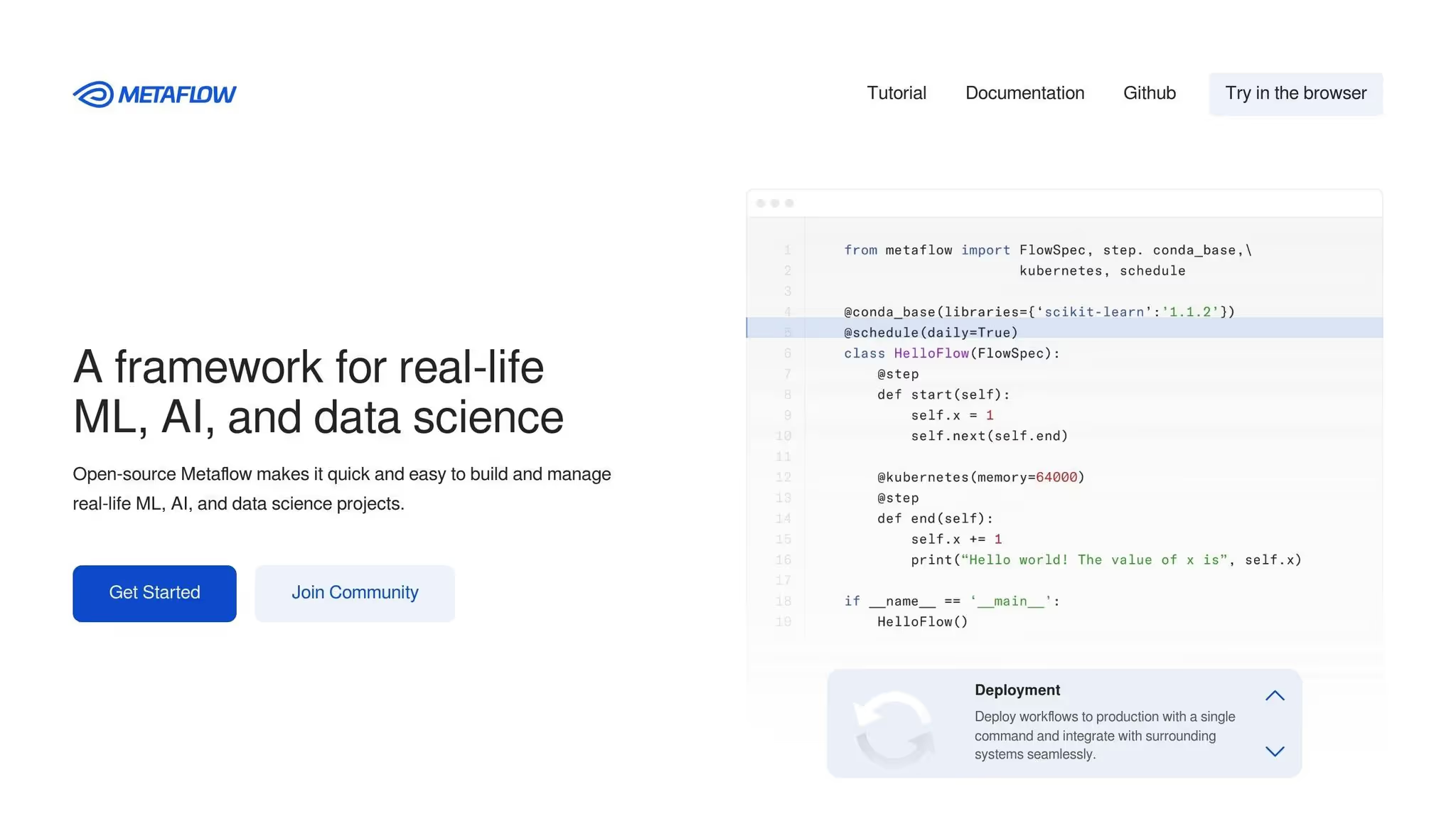

Metaflow présente une conception modulaire qui sépare la logique du flux de travail de l'exécution, ce qui permet aux développeurs de se concentrer plus facilement sur la création de flux de travail sans se soucier de l'infrastructure sous-jacente. Les flux de travail sont écrits en Python simple à l'aide d'une API unifiée, tandis que Metaflow gère l'exécution dans différents environnements. Son approche en couches fait abstraction de composants clés tels que la modélisation, le calcul, l'accès aux données et l'orchestration. Contrairement aux planificateurs autonomes, Metaflow fonctionne parfaitement avec des orchestrateurs de production tels que Fonctions AWS Step, Flux de travail Argo, Apache Airflow et Kubeflow. Cela permet aux équipes de développer des flux de travail localement et de les déployer en production sans modifier le code. Le framework s'intègre également aux principaux services cloud pour gérer efficacement les tâches gourmandes en données. Le déploiement de l'infrastructure Metaflow sur un compte cloud ou un cluster Kubernetes ne prend généralement que 15 à 30 minutes. Cette architecture simplifie les opérations d'apprentissage automatique (ML), ouvrant la voie aux fonctionnalités de ML spécialisées de la plateforme.

Metaflow suit automatiquement les versions du code, des données et des artefacts, éliminant ainsi le besoin d'une supervision manuelle. Les développeurs peuvent utiliser des décorateurs tels que @batch, @kubernetes, et @checkpoint pour affecter des ressources à des étapes spécifiques et à la progression des points de contrôle au cours de longs processus de formation, afin d'optimiser les coûts liés au cloud.

Les améliorations récentes incluent la prise en charge des étapes conditionnelles et itératives, permettant des flux de travail d'IA plus avancés. La commande « spin » simplifie la création de flux incrémentiels. En outre, Metaflow prend en charge du matériel spécialisé, tel qu'AWS Trainium, pour des tâches telles que la formation et la mise au point de grands modèles de langage.

La plateforme a démontré sa capacité à accélérer de manière significative les flux de travail de machine learning. Par exemple, Peyton McCullough, ingénieur logiciel chez Ramp, a indiqué que la mise en œuvre de Metaflow avec AWS Batch et Step Functions avait considérablement augmenté leur vitesse de développement de machine learning. Après avoir terminé un modèle « risqué » qui prenait autrefois des mois à construire, l'équipe a livré huit modèles supplémentaires en dix mois. Aujourd'hui, leur système gère plus de 6 000 flux. De même, l'équipe de science des données de CNN a indiqué avoir testé deux fois plus de modèles au premier trimestre 2021 par rapport à l'ensemble de l'année 2020.

« Airflow est destiné à être utilisé comme orchestrateur pour les charges de travail informatiques, plutôt que les charges de travail elles-mêmes... Metaflow inclut toujours une interface utilisateur pratique permettant aux data scientists d'examiner l'avancement des tâches. »

- Peyton McCullough, ingénieur logiciel, Ramp

Les atouts techniques de Metaflow sont complétés par l'accent mis sur la gouvernance et la sécurité, qui sont essentielles pour une utilisation en entreprise.

Metaflow propose des fonctionnalités de sécurité robustes adaptées aux environnements d'entreprise. Le @project decorator assure l'isolation des espaces de noms pour différents environnements (par exemple, utilisateur, test, production), protégeant ainsi les déploiements de production. Pour sécuriser davantage les opérations, les déploiements de production nécessitent des jetons d'autorisation. En déployant Metaflow directement dans le compte cloud ou le cluster Kubernetes d'une entreprise, toutes les données et les ressources de calcul restent dans le périmètre de sécurité de l'entreprise.

Le @project decorator prend également en charge des fonctionnalités d'audit complètes en suivant automatiquement tous les flux, expériences et artefacts. Metaflow s'intègre parfaitement aux protocoles de sécurité d'entreprise, aux cadres de gouvernance des données et aux systèmes de gestion des secrets existants, garantissant ainsi la conformité aux normes de l'entreprise.

Metaflow est open source et disponible sous la licence Apache 2.0, ce qui signifie que les équipes ne paient que pour les ressources cloud qu'elles utilisent. Son approche « Bring Your Own Cloud » permet un contrôle total des coûts. Pour ceux qui recherchent une assistance supplémentaire, des versions gérées et des services professionnels sont disponibles via Outerbounds.

Prefect utilise une architecture hybride qui sépare l'orchestration de l'exécution. Le plan de contrôle, géré via Cloud parfait, gère les métadonnées et la planification, tandis que l'exécution s'effectue sur une infrastructure privée. Cette configuration garantit que les données sensibles restent au sein de votre réseau, offrant sécurité et flexibilité. Les tâches sont exécutées dynamiquement en fonction des conditions en temps réel, avec la possibilité de reprendre à partir des points de défaillance.

Les flux de travail sont définis à l'aide de décorateurs Python tels que @flow et @task, ce qui facilite l'intégration de modèles de programmation modernes tels que async/wait et les astuces de saisie. Cette approche permet aux ingénieurs en apprentissage automatique de créer des tâches et des branches de manière dynamique, en adaptant les flux de travail en fonction des conditions des données sans avoir à prédéfinir chaque scénario.

Prefect utilise un mécanisme « pull » dans lequel les employés interrogent l'API Prefect pour les tâches planifiées, éliminant ainsi le besoin de connexions entrantes et garantissant la sécurité des pare-feux. Cette conception prend en charge des flux de travail évolutifs et efficaces pour les projets d'apprentissage automatique.

Prefect 3.0 a réduit les frais d'exécution jusqu'à 90 %, gagnant du terrain avec plus de 6,5 millions de téléchargements mensuels et près de 30 000 ingénieurs collaborateurs. Sa flexibilité et son évolutivité en ont fait un outil incontournable pour de nombreuses organisations.

À Application Cash, Wendy Tang, ingénieure en apprentissage automatique, a dirigé l'intégration de Prefect afin d'améliorer les flux de travail de prévention des fraudes. L'équipe a adapté les fonctionnalités de Prefect pour répondre à ses besoins en matière d'infrastructure tout en maintenant des normes de sécurité strictes.

« Nous avons utilisé toutes les fonctionnalités de Prefect et avons conçu une architecture qui fonctionne vraiment pour le provisionnement de notre infrastructure et pour notre organisation. » - Wendy Tang, ingénieure en apprentissage automatique, Cash App

Plongée avec tuba AI a utilisé la version open source de Prefect pour atteindre une évolutivité remarquable. Smit Shah, directeur de l'ingénierie, a mis en œuvre Prefect pour gérer plus de 1 000 flux par heure et des dizaines de milliers d'exécutions quotidiennes sur Kubernetes, ce qui a permis de multiplier par 20 le débit.

« Nous avons multiplié par 20 le débit grâce à Prefect. C'est notre outil de travail en matière de traitement asynchrone : un couteau suisse. » - Smit Shah, directeur de l'ingénierie, Snorkel AI

Le préfet inclut également le Serveur MCP (Model Context Protocol), qui simplifie la surveillance, le débogage et les requêtes de l'infrastructure. Cet outil simplifie le dépannage des pipelines complexes d'apprentissage automatique.

Prefect fournit des fonctionnalités de sécurité robustes, notamment Contrôle d'accès basé sur les rôles (RBAC) à plusieurs niveaux : compte, espace de travail et objet. Cela permet aux équipes de séparer les environnements de développement, de préparation et de production. Les fonctionnalités d'entreprise telles que l'authentification unique (SSO), la gestion d'équipe basée sur SCIM et une conception de connexion entrante nulle améliorent la sécurité et la conformité.

Les journaux d'audit suivent toutes les mesures prises pour répondre aux exigences de conformité, tandis que la gestion sécurisée des secrets garantit que les informations d'identification sont stockées en toute sécurité et non codées en dur dans les pipelines.

À Point final, Sunny Pachunuri, responsable de l'ingénierie des données et de la plateforme, a dirigé une migration vers Prefect depuis une plateforme concurrente. Cette transition a éliminé le besoin de modernisation et a permis de réaliser des économies de coûts et des gains de productivité substantiels.

« Le passage d'astronome à préfet a entraîné une réduction de 73,78 % des coûts de facturation à lui seul. » - Sunny Pachunuri, responsable de l'ingénierie des données et de la plateforme, Endpoint

Ces fonctionnalités rendent Prefect à la fois sûr et rentable pour une utilisation en entreprise.

Prefect propose trois niveaux de tarification pour répondre à différents besoins :

Le modèle d'exécution durable de Prefect permet de reprendre les flux de travail à partir des points de défaillance, évitant ainsi d'avoir à réexécuter des tâches de formation complètes en matière d'apprentissage automatique. Cela permet de réduire les coûts de calcul de manière significative. En outre, l'orchestration sensible à l'infrastructure prend en charge les instances spot Kubernetes, ce qui permet de réduire les dépenses de calcul de 60 à 75 % par rapport à la tarification à la demande.

Par exemple, Louez The Runway a fait état d'une réduction de 70 % des coûts de calcul en tirant parti de l'orchestration adaptée à l'infrastructure de Prefect.

Cette section s'appuie sur les évaluations précédentes des plateformes et propose une comparaison côte à côte de leurs principaux avantages et défis. Chaque plateforme possède ses propres atouts et inconvénients. Il est donc essentiel d'en choisir une qui correspond à votre infrastructure, à votre expertise et à votre budget. Le tableau ci-dessous met en évidence les principaux points forts, les limites et les cas d'utilisation idéaux de chaque plateforme.

Flux d'air Apache est réputé pour la gestion des dépendances de tâches complexes grâce à sa structure de graphe acyclique dirigé (DAG), qui garantit une exécution transparente et prévisible. Cependant, il nécessite des extensions de machine learning personnalisées, peut nécessiter beaucoup de ressources et ne dispose pas d'un support d'entreprise officiel.

Kubeflow s'intègre parfaitement à Kubernetes et bénéficie d'un soutien communautaire important, comme en témoignent plus de 258 millions de téléchargements PyPI et 33 100 étoiles GitHub. Malgré cela, il est connu pour sa complexité et ses exigences de maintenance élevées, nécessitant souvent une équipe dédiée de 3 à 5 ingénieurs, ce qui peut coûter environ 400 000 dollars par an.

Flûte excelle dans la gestion de flux de travail versionnés à grande échelle en mettant l'accent sur la reproductibilité, mais elle exige l'expertise de Kubernetes et entraîne des frais d'infrastructure supplémentaires.

Métaflow simplifie la gestion de l'infrastructure pour les data scientists, mais sa forte dépendance à Python la rend moins adaptée aux environnements nécessitant la prise en charge de plusieurs langages de programmation.

Préfet adopte une approche légère grâce à sa conception purement Python, qui élimine le besoin de DSL ou de YAML, et bénéficie d'une réduction de 90 % de la charge d'exécution dans la version 3.0. Cependant, il peut tout de même être gourmand en ressources pour les tâches de moindre envergure.

Ces informations soulignent l'importance d'aligner le choix de votre plateforme sur les besoins spécifiques de votre projet. Près de 80 % des projets d'apprentissage automatique ne parviennent pas à aller au-delà de l'expérimentation en raison de problèmes liés au déploiement, à la surveillance et à la fiabilité des modèles. Le choix d'une plateforme qui complète l'expertise de votre équipe et l'infrastructure existante, plutôt que de simplement opter pour l'option la plus riche en fonctionnalités, peut augmenter considérablement vos chances de réussir à atteindre la production.

La comparaison ci-dessus met en évidence les atouts uniques des différentes plateformes d'orchestration, ce qui montre clairement que le bon choix dépend de l'expertise de votre équipe et des besoins du projet.

Pour les équipes qui travaillent beaucoup en Python, Prefect propose une solution intuitive. Grâce à sa simplicité @flow décorateur, vous pouvez facilement transformer des fonctions en flux de production. Son modèle d'exécution hybride garantit la sécurité des données en conservant les informations sensibles en local tout en partageant uniquement les métadonnées en externe.

Si votre équipe fait confiance à Kubernetes, des plateformes comme Kubeflow ou Flyte sont d'excellentes options. Ces outils brillent dans les environnements qui exigent une reproductibilité stricte et de solides capacités DevOps, même s'ils s'accompagnent d'une courbe d'apprentissage plus abrupte et d'exigences de maintenance plus élevées.

Plateformes d'orchestration sans serveur telles que Canalisations SageMaker ou Vertex AI Pipelines sont idéaux pour les projets natifs du cloud et soucieux de leur budget. En facturant uniquement le temps de calcul réel et en évitant les coûts d'infrastructure inactifs, ils fournissent un modèle efficace et rentable.

Pour les équipes basées aux États-Unis opérant dans des secteurs réglementés, les fonctionnalités de sécurité telles que l'authentification unique, le contrôle d'accès basé sur les rôles et les journaux d'audit détaillés ne sont pas négociables. Le choix de plateformes dotées de ces fonctionnalités garantit la conformité et la fluidité des processus de déploiement.

Les organisations qui gèrent des flux de travail d'IA multimodèles avec des besoins de gouvernance stricts devraient envisager prompts.ai. Avec un accès à plus de 35 modèles d'IA de pointe et à des outils FinOps en temps réel, il propose un écosystème unifié capable de réduire les coûts de l'IA jusqu'à 98 %. Ses crédits TOKN payables à l'utilisation permettent d'aligner les dépenses directement sur l'utilisation, garantissant à la fois une rentabilité et une gouvernance de niveau entreprise.

Au fur et à mesure que les plateformes d'orchestration évoluent au-delà des structures DAG rigides pour adopter des flux de contrôle plus flexibles basés sur Python, elles permettent des flux de travail dynamiques pilotés par les événements et une orchestration agentique de l'IA. Choisir dès maintenant la bonne plateforme permettra non seulement de répondre à vos besoins actuels, mais également de positionner votre organisation pour l'avenir de l'orchestration autonome.

Lors de la sélection d'une plateforme d'orchestration d'apprentissage automatique, évolutivité devrait être une priorité absolue. Choisissez une solution capable de s'adapter à l'augmentation des charges de travail tout en prenant en charge les déploiements sur site, dans le cloud ou hybrides. Les meilleures plateformes y parviennent sans nécessiter de modifications importantes du code. Des fonctionnalités telles que l'orchestration des conteneurs, en particulier avec Kubernetes, peuvent simplifier les processus de mise à l'échelle et de déploiement.

Un autre facteur crucial est la facilité de création et gestion de flux de travail. Les plateformes qui prennent en charge des langages de programmation largement utilisés tels que Python permettent aux data scientists de concevoir plus facilement des pipelines de manière intuitive. En outre, recherchez une intégration fluide avec des outils de versionnage des données, de surveillance des modèles et de pipelines CI/CD afin de garantir des flux de travail fluides de bout en bout.

Enfin, faites attention à observabilité, fiabilité et coût. Une plate-forme fiable doit fournir une surveillance complète, des mesures en temps réel et une gestion efficace des erreurs afin de maintenir la disponibilité du système. Comparez les structures tarifaires, qu'il s'agisse de services gérés payants à l'utilisation ou de solutions auto-hébergées, et confirmez l'inclusion de fonctionnalités de sécurité essentielles, telles que le contrôle d'accès basé sur les rôles, pour répondre aux normes de conformité. En priorisant ces considérations, vous serez mieux équipé pour sélectionner une plateforme qui correspond aux exigences et aux objectifs de votre projet.

Les modèles de tarification pour les plateformes d'orchestration d'apprentissage automatique se répartissent généralement en trois types principaux : abonnements forfaitaires, frais basés sur l'utilisation, et contrats d'entreprise personnalisés. Les forfaits offrent des dépenses mensuelles prévisibles, ce qui peut être utile pour établir un budget, mais elles peuvent devenir coûteuses si votre utilisation dépasse le quota alloué. Les modèles basés sur l'utilisation, quant à eux, facturent en fonction de facteurs tels que le temps de calcul, les appels d'API ou le nombre d'exécutions de flux de travail. Ils permettent d'aligner les coûts sur l'utilisation réelle, ce qui en fait une solution idéale pour les entreprises dont la charge de travail fluctue, bien qu'ils puissent être plus difficiles à prévoir. Certaines plateformes adoptent une approche hybride, combinant des frais d'abonnement de base et des frais d'utilisation supplémentaires, offrant ainsi un mélange de flexibilité et de gestion des coûts.

Les prix peuvent également être influencés par les fonctionnalités de la plateforme. Des options telles que l'accélération GPU, la gestion de Kubernetes ou l'accès à un large éventail de modèles d'IA peuvent augmenter les coûts. Pour les entreprises qui se concentrent sur le contrôle des dépenses, les plateformes dotées de tableaux de bord de coûts clairs et de systèmes de facturation transparents constituent un meilleur choix. Dans le même temps, les équipes qui privilégient l'évolutivité rapide peuvent se tourner vers des solutions proposant une tarification flexible et à la demande, même si cela implique des coûts variables plus élevés. Pour évaluer avec précision l'impact financier d'une plateforme d'orchestration, il est essentiel de comprendre en détail sa structure tarifaire.

Lorsque vous choisissez une plateforme d'orchestration de machine learning, il est essentiel de vous concentrer sur les mesures de sécurité qui protègent à la fois vos données et vos flux de travail, tout en respectant les normes de conformité du secteur. Recherchez des plateformes qui donnent la priorité résidence des données, en veillant à ce que votre code et vos données restent au sein de votre environnement. Des fonctionnalités telles que les connexions professionnelles sortantes uniquement et les architectures hybrides qui bloquent l'accès réseau entrant sont essentielles pour maintenir le contrôle et la sécurité. Recherchez des certifications telles que SOC 2 Type II, GDPR, et HIPAA, parallèlement à des entraînements comme les entraînements réguliers test de pénétration et programmes Bug-Bounty pour identifier et corriger les vulnérabilités.

Efficace gestion des accès est un autre facteur critique. Les plateformes devraient inclure contrôle d'accès basé sur les rôles (RBAC), authentification multifactorielle (MFA), et authentification unique (SSO) pour garantir que seuls les utilisateurs autorisés y ont accès. Communication sécurisée de service à service avec comptes de service, et vérifiez que toutes les données sont cryptées à la fois au repos et pendant le transit. Une solution complète journal d'audit avec des périodes de conservation personnalisables est également nécessaire pour les enquêtes de conformité et de criminalistique.

Pour sécuriser davantage l'infrastructure, recherchez des fonctionnalités telles que sécurité des conteneurs, Kubernetes RBAC, segmentation du réseau, et Liste des adresses IP autorisées. Ces outils permettent de réduire les vulnérabilités potentielles et de garantir que votre environnement de machine learning est sécurisé et prêt pour la production.