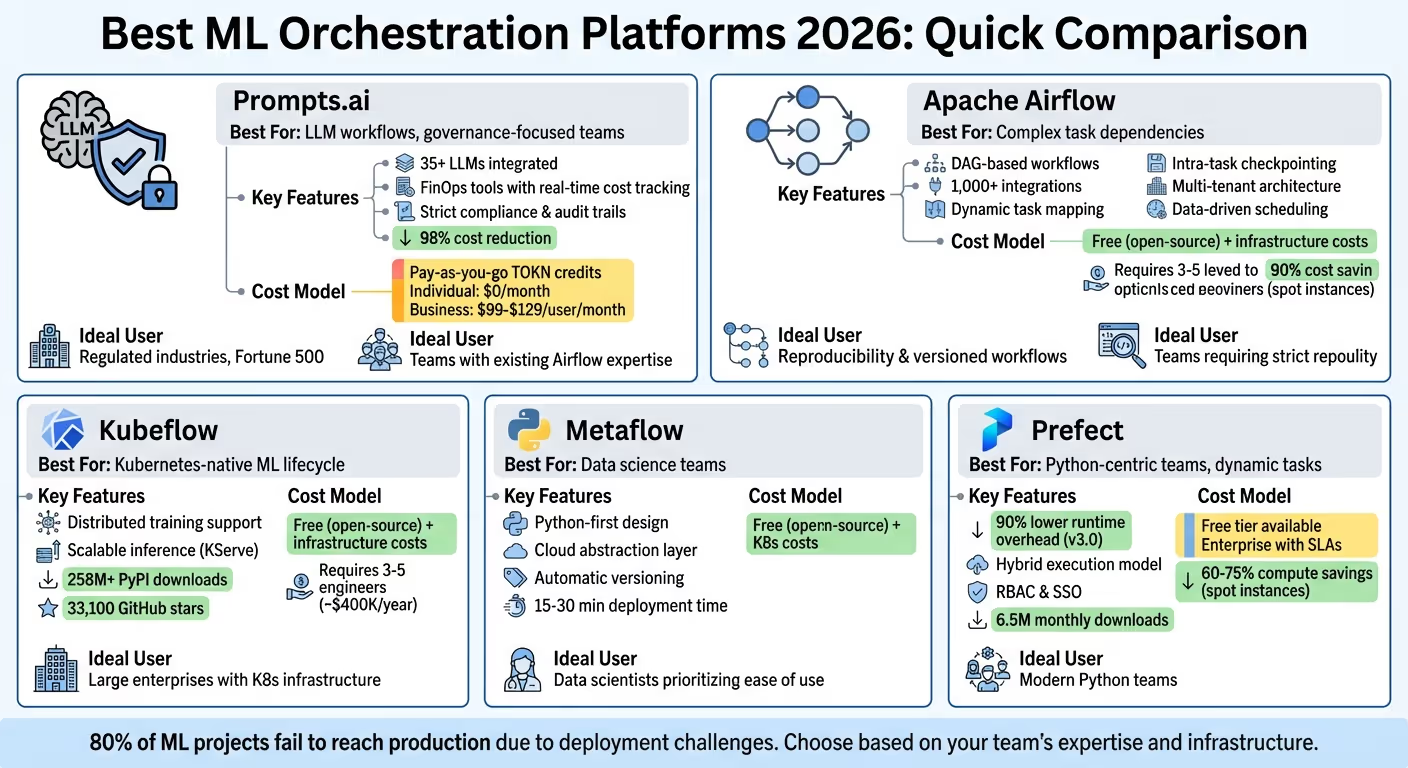

Administrar canalizaciones de aprendizaje automático complejas es más fácil que nunca. En 2026, los equipos de aprendizaje automático abordarán la creciente complejidad de los procesos, las necesidades de cumplimiento y los costos de la nube. Este es un breve desglose de las seis plataformas de orquestación líderes que optimizan los flujos de trabajo, reducen los costos y mejoran la gobernanza de los proyectos empresariales de inteligencia artificial:

Cada plataforma tiene puntos fuertes únicos, desde la gestión de operaciones de LLM a gran escala hasta la oferta de funciones que ahorran costes, como el soporte de instancias puntuales. A continuación encontrarás una comparación rápida que te ayudará a elegir la solución adecuada para tu equipo.

Ya sea que esté escalando los flujos de trabajo de IA, optimizando los costos o garantizando el cumplimiento, la selección de la plataforma adecuada depende de la infraestructura, la experiencia del equipo y los objetivos del proyecto. Profundicemos en lo que hace que cada solución destaque.

ML Orchestration Platforms 2026: comparación de funciones y costos

Prompts.ai actúa como una plataforma unificada que integra sin problemas más de 35 modelos lingüísticos de gran tamaño (incluidos GPT-5, Claudio, y Llama) en una sola interfaz. Su diseño de varios niveles divide el proceso en distintas etapas: creación rápida, comprobaciones de seguridad e implementación. Esta estructura minimiza los riesgos operativos y, al mismo tiempo, garantiza el cumplimiento en todos los flujos de trabajo de aprendizaje automático (ML). La plataforma también admite los flujos de trabajo de las agencias, que automatizan el movimiento de datos y estandarizan los resultados en todos los procesos. Gracias a la integración basada en la cadena de ideas, los equipos pueden hacer un seguimiento de cada decisión tomada por los modelos, lo que añade una capa de transparencia a los sistemas de aprendizaje automático de producción. Esta arquitectura está diseñada para mejorar la evaluación comparativa del aprendizaje automático y la eficiencia operativa.

Prompts.ai ofrece herramientas para la evaluación comparativa directa del rendimiento, lo que permite a los ingenieros de aprendizaje automático evaluar la precisión, la latencia y la calidad de los resultados sin necesidad de utilizar varias plataformas. Las funciones de FinOps en tiempo real supervisan el uso de los tokens y vinculan los gastos de inteligencia artificial con los resultados empresariales. Esto ayuda a los equipos a identificar los costosos flujos de trabajo antes de escalar. Los sistemas «Time Savers» de la plataforma simplifican las tareas comunes de aprendizaje automático, como la validación de datos, la ingeniería de funciones y la evaluación de modelos, al incorporar las mejores prácticas en los flujos de trabajo reutilizables. Además, el programa integrado de certificación Prompt Engineer capacita a los equipos para refinar y estandarizar los flujos de trabajo, transformando los experimentos puntuales en procesos repetibles y auditables. Para complementar estas capacidades, Prompts.ai aplica estrictas medidas de seguridad.

Al comprender la necesidad crítica de gobierno en los MLOP empresariales, Prompts.ai proporciona un sistema de control centralizado que registra todas las decisiones de los agentes y aplica políticas estrictas. Los registros de auditoría automatizados y el filtrado de la PII garantizan el cumplimiento de las estrictas normas estadounidenses. Estos protocolos de seguridad permiten a las empresas de la lista Fortune 500 y a los sectores altamente regulados implementar procesos de aprendizaje automático con confianza y sin comprometer los datos confidenciales.

Prompts.ai funciona con un sistema de crédito TOKN de pago por uso, que vincula los costos directamente al uso. Los planes individuales comienzan en 0 USD al mes, lo que permite explorar sin riesgos, mientras que los planes empresariales oscilan entre 99 y 129 USD por usuario y mes. Al consolidar las herramientas en una sola capa de orquestación, la plataforma puede reducir los costos del software de inteligencia artificial hasta en un 98%. El seguimiento de los gastos en tiempo real y un panel detallado de FinOps ofrecen información detallada sobre qué modelos, indicaciones y flujos de trabajo generan los costos más altos. Esta transparencia es especialmente valiosa para los equipos estadounidenses que administran los presupuestos de nube en AWS, Azure o Google Cloud. El modelo de costos se alinea con la necesidad de un control de gastos claro y basado en el uso.

Apache Airflow 3.x se basa en un arquitectura modular que divide las funcionalidades principales en cuatro componentes principales: un planificador, un servidor web, una base de datos de metadatos y un procesador DAG independiente. Esta separación garantiza una mayor seguridad al aislar del programador el código proporcionado por el usuario. A principios de 2026, la última versión estable es la 3.1.5, que introduce la SDK de tareas. Este SDK agiliza la creación de tareas al desvincular la lógica de ejecución del motor de orquestación, lo que hace que los flujos de trabajo sean más eficientes.

Al igual que prompts.ai, Airflow satisface la demanda de orquestación de aprendizaje automático escalable y eficiente. Sin embargo, su marco de código abierto contrasta con el modelo de plataforma integrada de prompts.ai. Una característica destacada de Airflow es su modelo de cómputo conectable, que permite que las tareas se ejecuten en diversas infraestructuras. Por ejemplo, las tareas de ingeniería de datos pueden aprovechar los clústeres de Spark, mientras que el entrenamiento con modelos puede utilizar las GPU a través del Operador PoD de Kubernetes. El API TaskFlow simplifica el intercambio de datos entre tareas a través de decoradores Python y XCOM implícitos, lo que permite a los usuarios transformar fácilmente los scripts de ML estándar en flujos de trabajo orquestados. Además, mapeo dinámico de tareas permite que las canalizaciones escalen dinámicamente durante el tiempo de ejecución. Esto es especialmente útil para ejecutar el entrenamiento de modelos en paralelo con diferentes hiperparámetros sin necesidad de predefinir el número de tareas. Estas funciones convierten a Airflow en una herramienta versátil para proyectos de aprendizaje automático, ya que complementa las sólidas capacidades de plataformas como prompts.ai.

Airflow ha evolucionado más allá de la ingeniería de datos tradicional y ahora ofrece más de 1000 integraciones, incluidas MLFlow, Weights & Biases y bases de datos vectoriales como Pinecone y Weaviate. Esta expansión posiciona a Airflow como un actor clave en Flujos de trabajo de LLMOps, como la organización de Retrieval Augmented Generation (RAG) y el ajuste fino de las canalizaciones que incorporan datos patentados en bases de datos vectoriales. La asignación dinámica de tareas mejora aún más su capacidad para escalar las tareas de entrenamiento de aprendizaje automático en paralelo.

Con programación basada en datos impulsados por Airflow Datasets, los flujos de trabajo pueden activarse automáticamente cuando se actualizan dependencias de datos específicas, lo que crea canalizaciones de MLOps con mayor capacidad de respuesta. El Configuración y desmontaje los tipos de tareas ayudan a administrar los recursos temporales de aprendizaje automático, lo que garantiza que los costosos clústeres de GPU solo estén activos durante las tareas de entrenamiento, lo que ayuda a controlar los costos de infraestructura. Para garantizar la calidad de los datos antes del entrenamiento, Airflow se integra con herramientas como Grandes expectativas y Soda Core, lo que reduce el riesgo de que los datos deficientes afecten a los resultados del modelo. Estas funciones destacan la capacidad de Airflow de combinar la ingeniería de datos tradicional con las operaciones de aprendizaje automático más avanzadas.

Flujo de aire «Flujos de trabajo como código» El enfoque permite a los equipos usar Git para el control de versiones y mantener los registros de auditoría. Está incorporado Integración con OpenLineage admite el seguimiento del linaje de datos y la gobernanza de modelos, lo cual es crucial para cumplir con los estándares de cumplimiento como el GDPR y la HIPAA. El recientemente presentado flujo de aire ctl La herramienta de línea de comandos (versión 0.1.0, publicada en octubre de 2025) proporciona una forma segura y basada en API de administrar las implementaciones.

La seguridad es un enfoque clave en Airflow 3.x, que implementa un modelo de seguridad multifunción. Funciones como Deployment Manager, DAG Author y Operations User garantizan que los científicos de datos puedan crear canalizaciones sin necesidad de un acceso administrativo total. Los flujos de trabajo también pueden ejecutarse con permisos de usuario específicos de Unix mediante la suplantación de tareas, lo que impone límites de seguridad estrictos. Además, las integraciones con Administrador de secretos de Amazon y Bóveda de HashiCorp asegúrese de que las credenciales confidenciales y las claves de API se almacenen de forma segura.

Apache Airflow es de uso gratuito bajo la licencia Apache 2.0. Sin embargo, el costo total de ejecutar Airflow puede ser considerable debido a los recursos de DevOps necesarios para la configuración y el mantenimiento continuo. Si bien no hay tarifas de licencia, las organizaciones deben tener en cuenta los gastos relacionados con la infraestructura de nube, el personal cualificado y la naturaleza intensiva de recursos de la plataforma.

Para aquellos que buscan reducir los gastos operativos, los servicios gestionados, como Astrónomo, COMO MAA, y Google Cloud Composer ofrecen precios escalonados o basados en el consumo. Estos servicios suelen incluir optimizaciones, como las colas de trabajadores, que asignan las tareas a las máquinas más rentables. Por ejemplo, los nodos de GPU pueden gestionar tareas de entrenamiento que consumen muchos recursos, mientras que las tareas ligeras se asignan a instancias de CPU más económicas. Para maximizar la rentabilidad, las organizaciones deben alinear su uso con estos modelos de precios flexibles, especialmente en entornos híbridos o basados en la nube.

Kubeflow Pipelines (KFP) permite a los usuarios definir flujos de trabajo de aprendizaje automático como gráficos acíclicos dirigidos a través de un SDK de Python. Estos flujos de trabajo se compilan en archivos YAML para su ejecución en contenedores. El diseño modular de la plataforma integra varios componentes clave, incluido Trainer para la formación distribuida, Katib para el ajuste de hiperparámetros, y K Serve para una inferencia escalable. Un panel centralizado proporciona una interfaz unificada para administrar estos componentes, lo que lo convierte en la opción ideal para la orquestación del aprendizaje automático nativo de Kubernetes. Kubeflow garantiza que los flujos de trabajo se ejecuten de manera uniforme, ya sea en máquinas locales, clústeres locales o plataformas en la nube como la de Google Cloud Vertex AI. Esta arquitectura admite un ciclo de vida de aprendizaje automático eficiente y sin interrupciones.

El enfoque modular de Kubeflow lo equipa con una gama de herramientas diseñadas para el aprendizaje automático. Organiza todo el ciclo de vida del aprendizaje automático, desde la preparación de los datos hasta la implementación, mediante Pipelines, Trainer, Katib y KServe. Un registro de modelos integrado garantiza la reproducibilidad en todos los experimentos e implementaciones. Katib simplifica el ajuste de los hiperparámetros con métodos como la optimización bayesiana y la búsqueda en cuadrículas. Para tareas a gran escala, el componente Trainer admite el entrenamiento distribuido mediante marcos como PyTorch, Cara abrazada, Velocidad profunda, y JAX. KServe ofrece una plataforma sin servidor e independiente del marco para implementar modelos creados con TensorFlow, PyTorch, o scikit-learn. Las funciones adicionales, como la ejecución en paralelo y el almacenamiento en caché, mejoran la eficiencia computacional, mientras que el SDK de Python de Kubeflow facilita la creación de canalizaciones.

Kubeflow emplea espacios de nombres y RBAC de Kubernetes para aislar las cargas de trabajo y gestionar los permisos de los usuarios de forma eficaz. El servicio de metadatos ML rastrea el estado y el linaje de los contenedores ejecutados y captura detalles sobre sus entradas, salidas y artefactos de datos asociados. El registro modelo mantiene un registro de auditoría claro, que vincula la experimentación con los flujos de trabajo de producción. El acceso a todos los componentes está protegido a través del panel central, que utiliza interfaces autenticadas. Un agente de persistencia de Pipeline registra los datos de ejecución en un almacén de metadatos respaldado por MySQL, lo que satisface las necesidades de gobernanza y auditoría. Los secretos de Kubernetes se utilizan para gestionar de forma segura las credenciales confidenciales, lo que convierte a Kubeflow en una opción viable para entornos aislados e implementaciones de nube privada.

Como proyecto de código abierto bajo la licencia Apache 2.0, Kubeflow elimina las tarifas de licencia, aunque los usuarios deben tener en cuenta los costos de la infraestructura subyacente de Kubernetes. Esto incluye los gastos relacionados con las plataformas en la nube, como Motor de Google Kubernetes o implementaciones locales, así como las necesidades de almacenamiento para administrar artefactos a través de herramientas como Algas marinas FS o Almacenamiento en la nube de Google. Para las organizaciones que buscan optimizar las operaciones, los servicios gestionados, como Google Cloud Vertex AI Pipelines, ofrecen un modelo de pago por uso que se encarga de la administración de la infraestructura. Además, funciones como el almacenamiento en caché en Kubeflow Pipelines pueden ayudar a reducir los tiempos de iteración y los costes asociados a la nube.

Flyte se basa en un arquitectura de tres planos que organiza sus operaciones de manera eficiente: el plano de usuario, el plano de control y el plano de datos.

Este diseño nativo de Kubernetes permite a Flyte gestionar una alta concurrencia y escalar sin esfuerzo, lo que permite respaldar proyectos que van desde pequeños experimentos hasta cargas de trabajo que requieren miles de CPU. En la actualidad, más de 3000 equipos confían en Flyte para implementar canalizaciones a gran escala. Esta arquitectura constituye la columna vertebral de las capacidades de aprendizaje automático de Flyte.

Flyte apoya durante todo el ciclo de vida del aprendizaje automático con herramientas diseñadas para formación distribuida. Se integra con Horovod y operadores de Kubeflow para MPI, TensorFlow y PyTorch. Los desarrolladores pueden definir los requisitos de recursos directamente en Python utilizando decoradores como @task (solicitudes=Recursos (gpu="2")). Flyte también simplifica el ajuste de hiperparámetros con map_tarea para procesamiento paralelo y @dynamic flujos de trabajo para la búsqueda en cuadrículas, la búsqueda aleatoria o la optimización bayesiana.

Una característica destacada es puntos de control intratarelas, que permite que los trabajos de larga duración se reanuden desde el último punto de control después de un fallo, evitando la necesidad de volver a empezar. Un ejemplo real de la escalabilidad de Flyte es Metano Sat, que utiliza Flyte para procesar más de 200 GB de datos sin procesar al día, aprovechar más de 10 000 CPU y generar aproximadamente 2 TB de salida.

«Cuando escribes scripts en Python, todo se ejecuta y lleva cierto tiempo, mientras que ahora, de forma gratuita, tenemos un paralelismo entre las tareas. Nuestros científicos de datos piensan que eso es genial». - Dylan Wilder, director de ingeniería de Spotify

Flyte's arquitectura multiusuario permite a varios equipos compartir la infraestructura y, al mismo tiempo, mantener sus datos, configuraciones y recursos aislados. La ejecución inmutable garantiza que los flujos de trabajo no puedan modificarse después de la ejecución, lo que crea un registro de auditoría sólido y refuerza el aislamiento de los datos. El control de versiones del flujo de trabajo permite a los equipos realizar un seguimiento de los cambios y volver a las versiones anteriores cuando sea necesario. Jeev Balakrishnan, ingeniero de software de Nombre gratis, destacó este beneficio:

«Flyte tiene este concepto de transformación inmutable: resulta que las ejecuciones no se pueden eliminar, por lo que tener una transformación inmutable es una abstracción muy buena para nuestra gama de ingeniería de datos».

Flyte también emplea interfaces fuertemente tipadas para validar los datos en cada paso. Las credenciales confidenciales se administran de forma segura, ya sea montadas como archivos o pasadas como variables de entorno. Además, el seguimiento integral del linaje de datos proporciona una visibilidad completa de los orígenes y transformaciones de los datos a lo largo de su ciclo de vida.

Flyte es un plataforma gratuita de código abierto disponible bajo la licencia Apache 2.0, y los usuarios cubren sus propios costos de infraestructura de Kubernetes. Para reducir los gastos, Flyte ofrece interrumpible argumento en los decoradores de tareas, que permite el uso de instancias puntuales o prevenibles. Este enfoque puede reducir los costos de procesamiento hasta en un 90% en comparación con los precios bajo demanda. Jeev Balakrishnan, de Freenome, explicó:

«Dada la escala a la que se ejecutan algunas de estas tareas, la computación puede resultar muy cara. Por lo tanto, poder añadir un argumento interrumpible al decorador de tareas para determinadas tareas ha sido muy útil para reducir los costos».

Metaflow presenta un diseño modular que separa la lógica del flujo de trabajo de la ejecución, lo que facilita que los desarrolladores se concentren en crear flujos de trabajo sin preocuparse por la infraestructura subyacente. Los flujos de trabajo se escriben en Python simple mediante una API unificada, mientras que Metaflow gestiona la ejecución en varios entornos. Su enfoque por capas abstrae componentes clave como el modelado, la computación, el acceso a los datos y la orquestación. A diferencia de los programadores independientes, Metaflow funciona a la perfección con orquestadores de nivel de producción, como Funciones de AWS Step, Flujos de trabajo de Argo, Apache Airflow y Kubeflow. Esto permite a los equipos desarrollar flujos de trabajo de forma local e implementarlos en la producción sin alterar el código. El marco también se integra con los principales servicios en la nube para gestionar eficazmente las tareas con muchos datos. La implementación de la infraestructura de Metaflow en una cuenta en la nube o en un clúster de Kubernetes suele tardar entre 15 y 30 minutos. Esta arquitectura simplifica las operaciones de aprendizaje automático (ML) y sienta las bases para las capacidades especializadas de aprendizaje automático de la plataforma.

Metaflow rastrea automáticamente las versiones del código, los datos y los artefactos, lo que elimina la necesidad de supervisión manual. Los desarrolladores pueden usar decoradores como @batch, @kubernetes, y @checkpoint para asignar recursos para pasos específicos y comprobar el progreso durante largos procesos de formación, lo que ayuda a optimizar los costos de la nube.

Las mejoras recientes incluyen la compatibilidad con pasos condicionales e iterativos, lo que permite flujos de trabajo de IA más avanzados. El comando «girar» simplifica la creación de flujos incrementales. Además, Metaflow admite hardware especializado, como AWS Trainium, para tareas como la formación y el ajuste de modelos lingüísticos de gran tamaño.

La plataforma ha demostrado su capacidad para acelerar significativamente los flujos de trabajo de aprendizaje automático. Por ejemplo, Peyton McCullough, ingeniera de software de Ramp, comentó que la implementación de Metaflow con AWS Batch y Step Functions aumentó considerablemente su velocidad de desarrollo de aprendizaje automático. Tras completar un modelo basado en el riesgo que antes tardaba meses en crearse, el equipo entregó ocho modelos adicionales en un plazo de diez meses. En la actualidad, su sistema gestiona más de 6.000 ciclos de flujo. Del mismo modo, el equipo de ciencia de datos de CNN informó que probó el doble de modelos en el primer trimestre de 2021 en comparación con todo el año de 2020.

«Airflow está diseñado para usarse como un orquestador para las cargas de trabajo de computación, en lugar de las cargas de trabajo en sí mismas... Metaflow aún incluye una interfaz de usuario práctica donde los científicos de datos pueden examinar el progreso de las tareas».

- Peyton McCullough, ingeniera de software, Ramp

Las fortalezas técnicas de Metaflow se complementan con su enfoque en la gobernanza y la seguridad, que son fundamentales para el uso empresarial.

Metaflow ofrece funciones de seguridad sólidas diseñadas para entornos empresariales. El @project decorator garantiza el aislamiento del espacio de nombres para diferentes entornos (por ejemplo, usuario, prueba, producción), protegiendo las implementaciones de producción. Para proteger aún más las operaciones, las implementaciones de producción requieren tokens de autorización. Al implementar Metaflow directamente en la cuenta de nube o en el clúster de Kubernetes de una organización, todos los recursos informáticos y de datos permanecen dentro del perímetro de seguridad de la empresa.

El @project decorator también admite capacidades de auditoría integrales al rastrear automáticamente todos los flujos, experimentos y artefactos. Metaflow se integra a la perfección con los protocolos de seguridad corporativos, los marcos de gobierno de datos y los sistemas de administración secretos existentes, lo que garantiza el cumplimiento de los estándares empresariales.

Metaflow es de código abierto y está disponible bajo la licencia Apache 2.0, lo que significa que los equipos solo pagan por los recursos de la nube que utilizan. Su enfoque de «traiga su propia nube» proporciona un control total sobre los costos. Para quienes buscan soporte adicional, las versiones administradas y los servicios profesionales están disponibles a través de Outerbounds.

Prefect emplea una arquitectura híbrida que separa la orquestación de la ejecución. El plano de control, gestionado mediante Nube perfecta, gestiona los metadatos y la programación, mientras que la ejecución del tiempo de ejecución se produce en una infraestructura privada. Esta configuración garantiza que los datos confidenciales permanezcan en la red, lo que ofrece seguridad y flexibilidad. Las tareas se ejecutan de forma dinámica en función de las condiciones en tiempo real, con la posibilidad de reanudarse a partir de puntos de fallo.

Los flujos de trabajo se definen mediante decoradores de Python como @flow y @task, lo que facilita la integración de patrones de programación modernos, como async/await y sugerencias de escritura. Este enfoque permite a los ingenieros de aprendizaje automático crear tareas y ramas de forma dinámica, adaptando los flujos de trabajo en función de las condiciones de los datos sin necesidad de predefinir cada escenario.

Prefect utiliza un mecanismo de «extracción» en el que los trabajadores consultan la API de Prefect para ver las tareas programadas, lo que elimina la necesidad de conexiones entrantes y mantiene los firewalls seguros. Este diseño admite flujos de trabajo escalables y eficientes para proyectos de aprendizaje automático.

Prefect 3.0 ha reducido la sobrecarga de tiempo de ejecución hasta en un 90% y ha ganado terreno con más de 6,5 millones de descargas mensuales y casi 30 000 ingenieros colaboradores. Su flexibilidad y escalabilidad la han convertido en una herramienta de referencia para muchas organizaciones.

En Aplicación Cash, la ingeniera de aprendizaje automático Wendy Tang encabezó la integración de Prefect para mejorar los flujos de trabajo de prevención del fraude. El equipo adaptó las funciones de Prefect para adaptarlas a sus necesidades de infraestructura y, al mismo tiempo, mantener unos estándares de seguridad estrictos.

«Tomamos todas las funciones perfectas y diseñamos una arquitectura que realmente funciona para el aprovisionamiento de nuestra infraestructura y para nuestra organización». - Wendy Tang, ingeniera de aprendizaje automático de Cash App

Snorkel AI utilizó la versión de código abierto de Prefect para lograr una escalabilidad notable. Smit Shah, director de ingeniería, implementó Prefect para gestionar más de 1000 flujos por hora y decenas de miles de ejecuciones diarias en Kubernetes, lo que se tradujo en un aumento de 20 veces el rendimiento.

«Hemos mejorado el rendimiento 20 veces con Prefect. Es nuestra herramienta de procesamiento asincrónico: una navaja suiza». - Smit Shah, director de ingeniería de Snorkel AI

Prefect también incluye el Servidor MCP (Model Context Protocol), lo que simplifica la infraestructura de supervisión, depuración y consulta. Esta herramienta agiliza la solución de problemas en procesos complejos de aprendizaje automático.

Prefect ofrece funciones de seguridad sólidas, que incluyen Control de acceso basado en roles (RBAC) en varios niveles: cuenta, espacio de trabajo y objeto. Esto permite a los equipos separar los entornos de desarrollo, preparación y producción. Las funciones empresariales, como el inicio de sesión único (SSO), la gestión de equipos basada en SCIM y un diseño sin conexiones entrantes, mejoran la seguridad y el cumplimiento.

Los registros de auditoría rastrean todas las acciones para cumplir con los requisitos de cumplimiento, mientras que la administración secreta segura garantiza que las credenciales se almacenen de forma segura y no se codifiquen en canalizaciones.

En Punto final, Sunny Pachunuri, gerente de plataformas e ingeniería de datos, dirigió una migración a Prefect desde una plataforma de la competencia. Esta transición eliminó la necesidad de modernizar y se tradujo en importantes ahorros de costos y aumentos de productividad.

«El cambio de astrónomo a prefecto se tradujo en una reducción del 73,78% solo en los costos de facturación». - Sunny Pachunuri, gerente de plataformas e ingeniería de datos de Endpoint

Estas características hacen que Prefect sea seguro y rentable para el uso empresarial.

Prefect ofrece tres niveles de precios para satisfacer diferentes necesidades:

El modelo de ejecución duradero de Prefect permite que los flujos de trabajo se reanuden a partir de puntos de falla, lo que evita la necesidad de volver a ejecutar trabajos completos de capacitación en aprendizaje automático. Esto reduce significativamente los costos de procesamiento. Además, la orquestación basada en la infraestructura es compatible con las instancias puntuales de Kubernetes, que pueden reducir los gastos de procesamiento entre un 60 y un 75% en comparación con los precios bajo demanda.

Por ejemplo, Alquila The Runway informó de una reducción del 70% en los costos de procesamiento al aprovechar la orquestación consciente de la infraestructura de Prefect.

Esta sección se basa en las revisiones anteriores de la plataforma y ofrece una comparación paralela de sus principales ventajas y desafíos. Cada plataforma aporta su propio conjunto de puntos fuertes y desventajas, por lo que es fundamental elegir una que se adapte a su infraestructura, experiencia y presupuesto. La siguiente tabla destaca los puntos fuertes, las limitaciones y los casos de uso ideales clave para cada plataforma.

Flujo de aire Apache es muy apreciado por gestionar dependencias de tareas complejas mediante su estructura de gráfico acíclico dirigido (DAG), que garantiza una ejecución transparente y predecible. Sin embargo, requiere extensiones de aprendizaje automático personalizadas, puede consumir muchos recursos y carece de soporte empresarial oficial.

Kubeflow se integra perfectamente con Kubernetes y ha obtenido un importante apoyo de la comunidad, como lo demuestran más de 258 millones de descargas de PyPI y 33.100 estrellas de GitHub. A pesar de ello, es conocido por su complejidad y sus altas exigencias de mantenimiento, ya que a menudo requiere un equipo dedicado de 3 a 5 ingenieros, lo que puede costar alrededor de 400 000 dólares al año.

Flyte se destaca en el manejo de flujos de trabajo versionados a gran escala con un enfoque en la reproducibilidad, pero exige experiencia en Kubernetes e introduce una sobrecarga de infraestructura adicional.

Metaflow simplifica la administración de la infraestructura para los científicos de datos, pero su gran dependencia de Python lo hace menos adecuado para entornos que requieren soporte para varios lenguajes de programación.

Prefecto adopta un enfoque ligero con su diseño puro de Python, lo que elimina la necesidad de usar DSL o YAML, y cuenta con una reducción del 90% en la sobrecarga de tiempo de ejecución en la versión 3.0. Sin embargo, puede seguir consumiendo muchos recursos para tareas más pequeñas.

Estos conocimientos destacan la importancia de alinear la elección de la plataforma con las necesidades específicas de su proyecto. Casi el 80% de los proyectos de aprendizaje automático no logran avanzar más allá de la experimentación debido a los desafíos relacionados con la implementación, la supervisión y la confiabilidad de los modelos. Seleccionar una plataforma que complemente la experiencia de su equipo y la infraestructura existente, en lugar de simplemente optar por la opción con más funciones, puede aumentar considerablemente sus posibilidades de llegar a la fase de producción con éxito.

La comparación anterior muestra las fortalezas únicas de varias plataformas de orquestación, dejando en claro que la elección correcta depende de la experiencia de su equipo y de las necesidades del proyecto.

Para los equipos que trabajan mucho en Python, Prefect ofrece una solución intuitiva. Con su sencillez @flow decorador, puede transformar fácilmente las funciones en flujos de trabajo de producción. Su modelo de ejecución híbrido garantiza la seguridad de los datos al mantener la información confidencial de forma local y, al mismo tiempo, compartir los metadatos de forma externa.

Si tu equipo confía en Kubernetes, plataformas como Kubeflow o Flyte son excelentes opciones. Estas herramientas brillan en entornos que exigen una reproducibilidad estricta y capacidades de DevOps sólidas, aunque conllevan una curva de aprendizaje más pronunciada y mayores exigencias de mantenimiento.

Plataformas de orquestación sin servidor como Canalizaciones de SageMaker o Vertex AI Pipelines son ideales para proyectos nativos de la nube que se preocupan por su presupuesto. Al cobrar solo por el tiempo de procesamiento real y evitar los costos de infraestructura inactiva, proporcionan un modelo eficiente y rentable.

Para los equipos con sede en EE. UU. que operan en sectores regulados, las funciones de seguridad como el inicio de sesión único, el control de acceso basado en funciones y los registros de auditoría detallados no son negociables. La elección de plataformas con estas capacidades garantiza el cumplimiento y los procesos de implementación sin problemas.

Las organizaciones que gestionan flujos de trabajo de IA multimodelo con necesidades de gobernanza estrictas deberían considerar prompts.ai. Con acceso a más de 35 de los mejores modelos de IA y herramientas FinOps en tiempo real, ofrece un ecosistema unificado que puede reducir los costos de la IA hasta en un 98%. Sus créditos TOKN de pago por uso alinean los gastos directamente con el uso, lo que garantiza tanto la rentabilidad como una gobernanza de nivel empresarial.

A medida que las plataformas de orquestación evolucionan más allá de las rígidas estructuras de DAG hacia flujos de control más flexibles basados en Python, permiten flujos de trabajo dinámicos basados en eventos y una orquestación de IA por parte de las agencias. La selección de la plataforma adecuada ahora no solo abordará sus necesidades actuales, sino que también posicionará a su organización para el futuro de la orquestación autónoma.

Al seleccionar una plataforma de orquestación de aprendizaje automático, escalabilidad debe ser una prioridad absoluta. Elija una solución capaz de adaptarse al aumento de las cargas de trabajo y, al mismo tiempo, admitir las implementaciones en configuraciones locales, en la nube o híbridas. Las mejores plataformas lo consiguen sin necesidad de realizar grandes modificaciones en el código. Funciones como la organización de contenedores, especialmente con Kubernetes, pueden simplificar los procesos de escalado e implementación.

Otro factor crucial es la facilidad de creación y administración de flujos de trabajo. Las plataformas que admiten los lenguajes de programación más utilizados, como Python, facilitan a los científicos de datos el diseño de canalizaciones de forma intuitiva. Además, busque una integración perfecta con las herramientas para el control de versiones de datos, la supervisión de modelos y las canalizaciones de CI/CD para garantizar flujos de trabajo fluidos de principio a fin.

Por último, presta atención a observabilidad, confiabilidad y costo. Una plataforma confiable debe proporcionar una supervisión integral, métricas en tiempo real y una gestión eficaz de los errores para mantener el tiempo de actividad del sistema. Compare las estructuras de precios (ya se trate de servicios gestionados de pago por uso o de soluciones autohospedadas) y confirme la inclusión de funciones de seguridad esenciales, como el control de acceso basado en roles, para cumplir con los estándares de cumplimiento. Al priorizar estas consideraciones, estará mejor preparado para seleccionar una plataforma que se adapte a los requisitos y objetivos de su proyecto.

Los modelos de precios para las plataformas de orquestación del aprendizaje automático generalmente se dividen en tres tipos principales: suscripciones de tarifa plana, tarifas basadas en el uso, y contratos empresariales personalizados. Los planes de tarifa plana ofrecen gastos mensuales predecibles, lo que puede resultar útil para presupuestar, pero pueden resultar costosos si el uso supera la cuota asignada. Los modelos basados en el uso, por otro lado, cobran en función de factores como el tiempo de procesamiento, las llamadas a la API o la cantidad de flujos de trabajo ejecutados. Estos permiten alinear los costos con el uso real, lo que los convierte en una buena opción para las empresas con cargas de trabajo fluctuantes, aunque pueden resultar más difíciles de pronosticar. Algunas plataformas adoptan un enfoque híbrido y combinan una tarifa de suscripción básica con cargos adicionales por el uso, lo que ofrece una combinación de flexibilidad y administración de costos.

Los precios también pueden estar influenciados por las características de la plataforma. Opciones como la aceleración por GPU, la administración de Kubernetes o el acceso a una amplia gama de modelos de IA pueden aumentar los costos. Para las empresas que se centran en controlar los gastos, las plataformas con paneles de costes claros y sistemas de facturación transparentes son la mejor opción. Mientras tanto, los equipos que priorizan la escalabilidad rápida pueden optar por soluciones con precios flexibles y bajo demanda, incluso si esto implica costos variables más altos. Para evaluar con precisión el impacto financiero de una plataforma de orquestación, es fundamental entender su estructura de precios en detalle.

Al elegir una plataforma de orquestación de aprendizaje automático, es fundamental centrarse en las medidas de seguridad que protegen tanto los datos como los flujos de trabajo, al tiempo que cumplen con los estándares de cumplimiento del sector. Busque plataformas que prioricen residencia de datos, garantizando que el código y los datos permanezcan dentro de su entorno. Características como las conexiones de trabajo exclusivas para los trabajadores y las arquitecturas híbridas que bloquean el acceso entrante a la red son fundamentales para mantener el control y la seguridad. Busque certificaciones como SOC 2 tipo II, GDPR, y HIPAA, junto con prácticas como las habituales pruebas de penetración y programas de recompensas por errores para identificar y abordar las vulnerabilidades.

Efectivo gestión de acceso es otro factor crítico. Las plataformas deben incluir control de acceso basado en funciones (RBAC), autenticación multifactorial (MFA), y inicio de sesión único (SSO) para garantizar que solo los usuarios autorizados tengan acceso. Comunicación segura de servicio a servicio con cuentas de servicioy confirme que todos los datos están cifrados tanto en reposo como durante el tránsito. Un completo registro de auditoría con períodos de retención personalizables también es necesario para las investigaciones forenses y de cumplimiento.

Para proteger aún más la infraestructura, busque funciones como seguridad de contenedores, RBAC de Kubernetes, segmentación de red, y Lista de direcciones IP permitidas. Estas herramientas ayudan a reducir las posibles vulnerabilidades y garantizan que su entorno de aprendizaje automático sea seguro y esté listo para la producción.