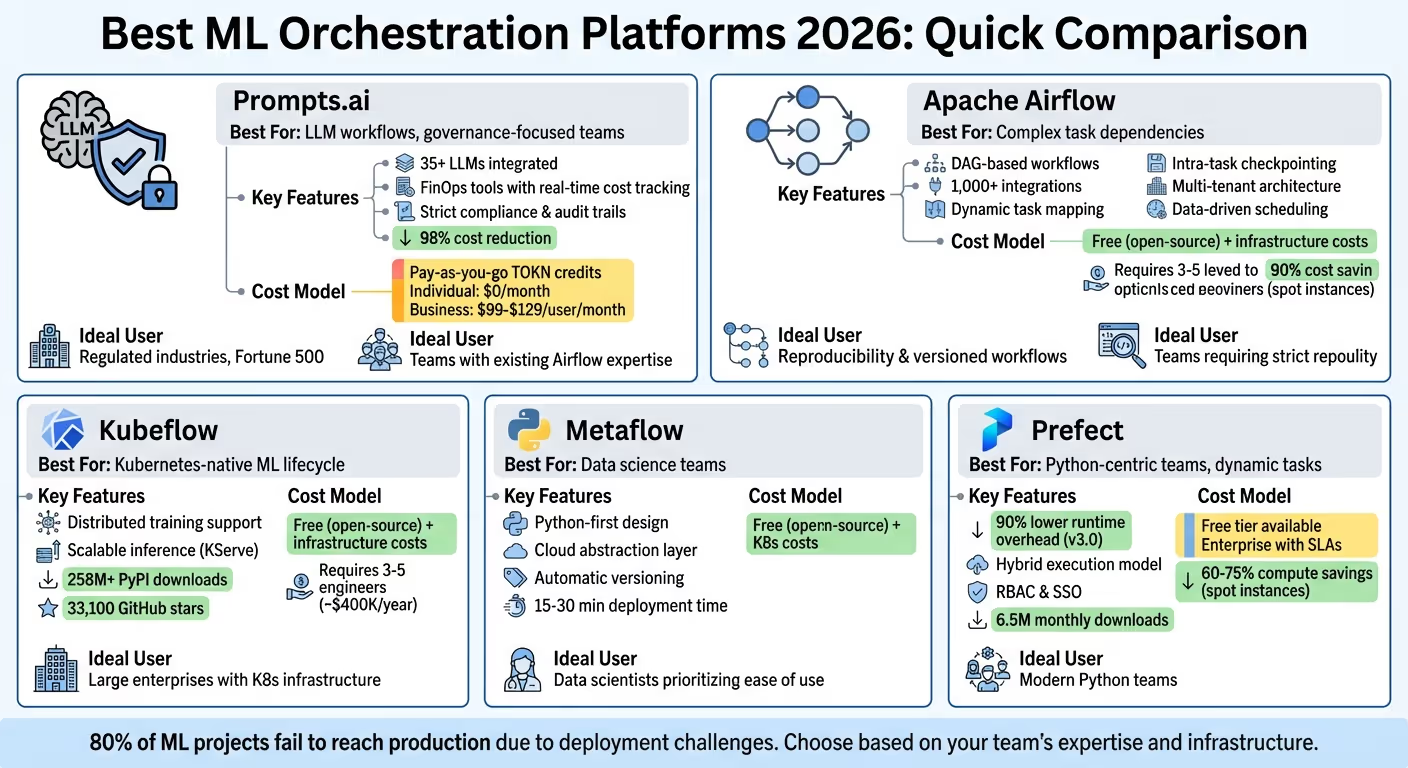

管理复杂的 ML 管道比以往任何时候都容易。 2026 年,机器学习团队将应对日益增加的管道复杂性、合规性需求和云成本。以下是六个领先的编排平台的简要分类,这些平台可以简化工作流程、降低成本并改善企业人工智能项目的治理:

从处理大规模 LLM 操作到提供竞价型实例支持等节省成本的功能,每个平台都有独特的优势。以下是快速对比,可帮助您为团队选择正确的解决方案。

无论您是扩展 AI 工作流程、优化成本还是确保合规性,选择正确的平台都取决于您的基础架构、团队专业知识和项目目标。让我们深入探讨每种解决方案脱颖而出的原因。

2026 年机器学习编排平台:功能和成本比较

Prompts.ai 用作统一平台,无缝集成超过 35 种大型语言模型(包括 GPT-5, 克劳德,以及 美洲驼) 进入单个接口。其多层设计将流程分为不同的阶段:即时创建、安全检查和部署。这种结构最大限度地降低了运营风险,同时确保了整个机器学习 (ML) 工作流程的合规性。该平台还支持代理工作流程,可自动移动数据并对管道中的输出进行标准化。通过思想链集成,团队可以追踪模型做出的每一项决策,从而为生产机器学习系统增加一层透明度。该架构专为增强机器学习基准测试和提高运营效率而量身定制。

Prompts.ai 提供直接性能基准测试工具,使机器学习工程师无需多个平台即可评估准确性、延迟和输出质量。实时FinOps功能监控代币使用情况,将人工智能支出与业务结果联系起来。这可以帮助团队在扩展之前识别昂贵的工作流程。该平台的 “省时工具” 通过将最佳实践嵌入到可重复使用的工作流程中,简化了常见的 ML 任务,例如数据验证、特征工程和模型评估。此外,内置的 Prompt Engineer 认证计划使团队能够完善和标准化工作流程,将一次性实验转化为可重复的、可审计的流程。为了补充这些功能,Prompts.ai 执行了严格的安全措施。

Prompts.ai 了解企业 MLOP 的关键治理需求,提供了一个集中控制系统,该系统可以记录每个代理决策并执行严格的策略。自动审计跟踪和 PII 筛选可确保遵守严格的美国标准。这些安全协议允许《财富》500强公司和受到严格监管的行业在不泄露敏感数据的情况下自信地部署机器学习管道。

Prompts.ai 在即用即付的代币积分系统上运行,将成本与使用量直接挂钩。个人计划起价为每月0美元,允许无风险探索,而业务套餐则从每位用户每月99美元到129美元不等。通过将工具整合到一个协调层中,该平台可以将人工智能软件成本降低多达98%。实时费用跟踪和详细的FinOps仪表板可以详细了解哪些模型、提示和工作流程产生的成本最高。这种透明度对于在AWS、Azure或谷歌云上管理云预算的美国团队来说尤其有价值。成本模型符合明确的、基于使用量的支出控制的需求。

Apache Airflow 3.x 建立在 模块化架构 它将核心功能分为四个主要组件:调度器、网络服务器、元数据数据库和独立的 DAG 处理器。这种分离通过将用户提供的代码与调度器隔离来确保更好的安全性。截至 2026 年初,最新的稳定版本是 3.1.5,它引入了 任务 SDK。该软件开发工具包通过将执行逻辑与编排引擎分离来简化任务创建,从而提高工作流程的效率。

与 prompts.ai 类似,Airflow 满足了对可扩展和高效机器学习编排的需求。但是,它的开源框架与 prompts.ai 的集成平台模型形成鲜明对比。Airflow 的一个突出特点是 可插拔计算模型,它允许任务在不同的基础架构上运行。例如,数据工程任务可以利用 Spark 集群,而模型训练可以通过以下方式使用 GPU KubernetesPod 运营商。这个 任务流 API 通过 Python 装饰器和隐式 xCOM 简化任务之间的数据共享,使用户能够轻松地将标准机器学习脚本转换为编排的工作流程。此外, 动态任务映射 允许管道在运行时动态扩展。这对于使用不同的超参数运行并行模型训练而无需预定义任务数量特别有用。这些功能使 Airflow 成为机器学习项目的多功能工具,补充了 prompts.ai 等平台的强大功能。

Airflow 已经超越了传统的数据工程,现在提供了 1,000 多个集成,包括 mlFlow、权重和偏差以及 Pinecone 和 Weaviate 等矢量数据库。此扩展将 Airflow 定位为关键玩家 llmOps 工作流程,例如协调检索增强生成 (RAG) 和微调将专有数据纳入矢量数据库的管道。动态任务映射进一步增强了其并行扩展 ML 训练任务的能力。

和 数据驱动的日程安排 由 Airflow 数据集提供支持,工作流可以在更新特定数据依赖关系时自动触发,从而创建响应更快的 MLOps 管道。这个 安装和拆解 任务类型有助于管理临时机器学习资源,确保昂贵的 GPU 集群仅在训练任务期间处于活动状态,这有助于控制基础设施成本。为了确保训练前的数据质量,Airflow 集成了诸如此类的工具 寄予厚望 和 苏打核心,降低了不良数据影响模型结果的风险。这些功能突显了Airflow将传统数据工程与尖端机器学习操作联系起来的能力。

Airflow “工作流程即代码” 方法允许团队使用 Git 进行版本控制和维护审计记录。它是内置的 openLineage 集成 支持数据沿袭跟踪和模型治理,这对于满足 GDPR 和 HIPAA 等合规标准至关重要。最近推出的 airflowctl 命令行工具(版本 0.1.0,2025 年 10 月发布)提供了一种安全、由 API 驱动的部署管理方式。

安全性是 Airflow 3.x 的重点,它实现了 多角色安全模型。部署经理、DAG 作者和操作用户等角色确保数据科学家无需完全管理访问权限即可创建管道。工作流程还可以通过任务模拟在特定的 Unix 用户权限下运行,强制执行严格的安全边界。此外,与的集成 亚马逊机密经理 和 HashiCorp 保管库 确保安全存储敏感凭证和 API 密钥。

Apache 气流是 免费使用 在 Apache 许可证 2.0 下。但是,由于设置和持续维护所需的 DevOps 资源,运行 Airflow 的总成本可能会很高。虽然没有许可费,但组织需要考虑与云基础架构、技术人员和平台的资源密集型性质相关的费用。

对于那些希望减少运营开支的人来说,托管服务,例如 天文学家, AWS MWAA,以及 谷歌云端作曲家 提供分层或基于消费的定价。这些服务通常包括诸如工作人员队列之类的优化,可将任务分配给最具成本效益的计算机。例如,GPU 节点可以处理资源密集型训练任务,而轻量级任务可以分配给更经济的 CPU 实例。为了最大限度地提高成本效率,组织应将其使用方式与这些灵活的定价模式保持一致,尤其是在混合或基于云的环境中。

Kubeflow Pipelines (KFP) 允许用户通过 Python SDK 将机器学习工作流程定义为有向无环图。这些工作流程被编译成 YAML 文件以供容器化执行。该平台的模块化设计集成了多个关键组件,包括用于分布式训练的Trainer, Katib 用于超参数调整,以及 KServe 用于可扩展的推断。集中式仪表板为管理这些组件提供了统一的界面,使其成为 Kubernetes 原生 ML 编排的首选。Kubeflow 确保工作流程始终如一地运行,无论是在本地计算机、本地集群上还是在谷歌云等云平台上 顶点人工智能。该架构支持无缝高效的 ML 生命周期。

Kubeflow 的模块化方法为其配备了一系列专为机器学习量身定制的工具。它使用 Pipelines、Trainer、Katib 和 KServe 协调从数据准备到部署的整个机器学习生命周期。内置的模型注册表确保了实验和部署过程中的可重复性。Katib 使用贝叶斯优化和网格搜索等方法简化了超参数调整。对于大规模任务,Trainer 组件支持使用以下框架进行分布式训练 PyTorch, HuggingFace, 深速,以及 JAX。KServe 提供了一个无服务器、独立于框架的平台,用于部署使用以下方法构建的模型 TensorFLOW, PyTorch,或 scikit-learn。并行执行和缓存等其他功能可提高计算效率,而 Kubeflow Python SDK 使流水线创建变得简单。

Kubeflow 使用 Kubernetes RBAC 和命名空间来隔离工作负载并有效地管理用户权限。机器学习元数据服务跟踪已执行容器的状态和谱系,捕获有关其输入、输出和相关数据构件的详细信息。模型注册表保留了清晰的审计记录,将实验与生产工作流程联系起来。通过中央仪表板保护对所有组件的访问,该控制板使用经过身份验证的接口。管道持久化代理将执行数据记录到 MySQL 支持的元数据存储中,以支持治理和审计需求。Kubernetes 密钥用于安全地管理敏感凭证,这使得 Kubeflow 成为气隙环境和私有云部署的可行选择。

作为Apache 2.0许可下的开源项目,Kubeflow取消了许可费,尽管用户必须考虑底层Kubernetes基础设施的成本。这包括与云平台相关的费用,例如 谷歌 Kubernetes 引擎 或本地部署,以及通过诸如此类的工具管理工件所需的存储空间 SeaweedFS 要么 谷歌云存储。对于希望简化运营的组织,Google Cloud Vertex AI Pipelines等托管服务提供了负责基础设施管理的即用即付模式。此外,Kubeflow Pipelines 中的缓存等功能可以帮助缩短迭代时间,降低相关的云成本。

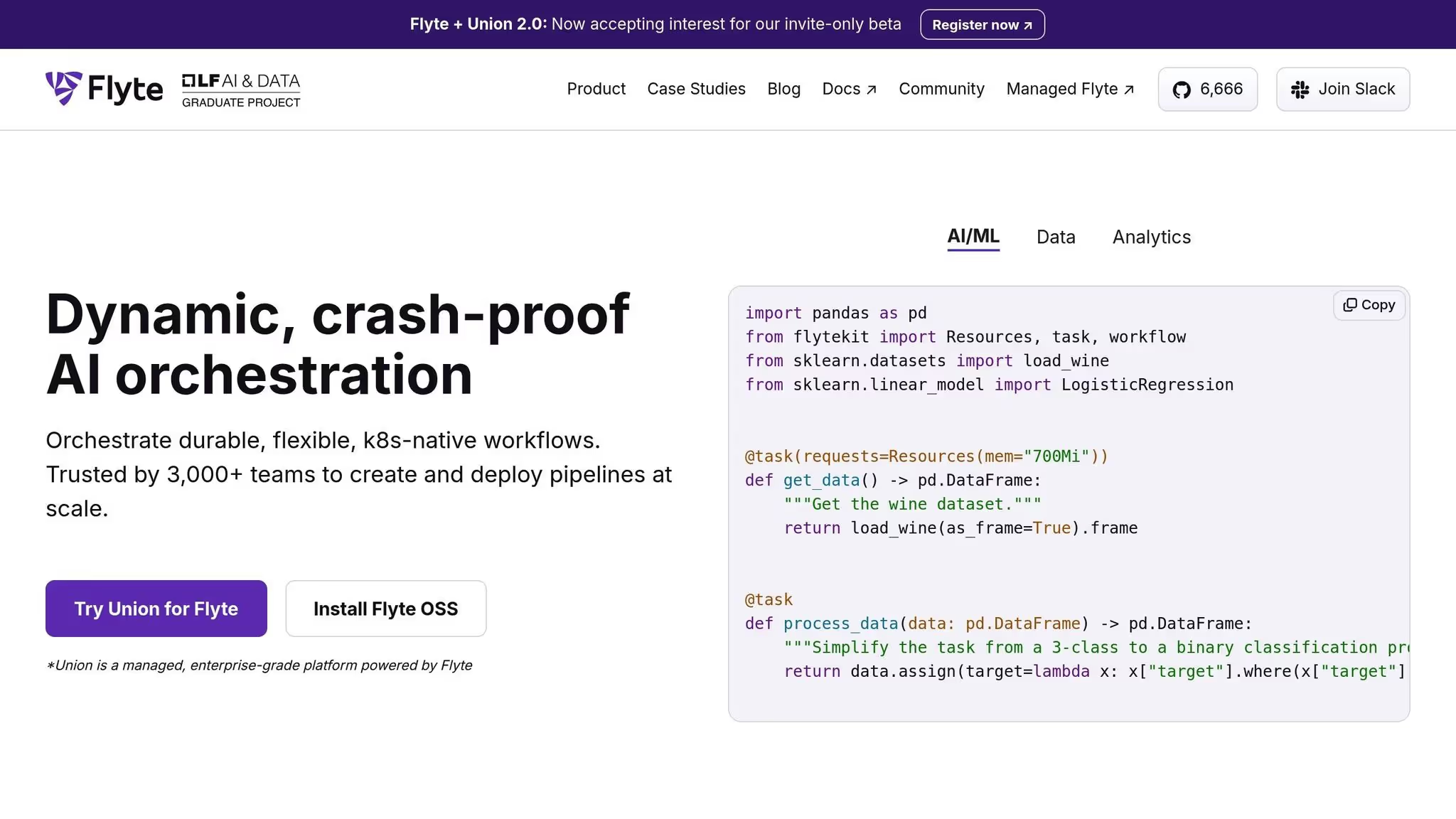

Flyte 建立在 三平面架构 它可以有效地组织其操作:用户平面、控制平面和数据平面。

这种 Kubernetes 原生设计使 Flyte 能够处理高并发性并轻松扩展,为从小型实验到需要数千个 CPU 的工作负载等各种项目提供支持。如今,超过 3,000 个团队依靠 Flyte 来大规模部署管道。这种架构构成了 Flyte 机器学习能力的支柱。

Flyte 使用专为其量身定制的工具支持整个机器学习生命周期 分布式训练。它集成了 霍罗沃德 以及 MPI、TensorFlow 和 PyTorch 的 Kubeflow 运算符。开发人员可以使用装饰器直接在 Python 中定义资源需求,例如 @task(请求=资源(gpu= “2"))。Flyte 还通过以下方式简化了超参数调整 map_task 用于并行处理和 @dynamic 网格搜索、随机搜索或贝叶斯优化的工作流程。

一个突出的特点是 任务内检查点,这允许长时间运行的作业在失败后从最后一个检查点恢复,从而无需重新开始。Flyte 可扩展性的一个真实例子是 MethaneSat,它使用 Flyte 每天处理超过 200 GB 的原始数据,利用超过 10,000 个 CPU,生成大约 2 TB 的输出。

“当你编写 Python 脚本时,一切都会运行并花费一定的时间,而现在我们可以免费实现跨任务的并行性。我们的数据科学家认为这真的很酷。”-Spotify工程经理迪伦·怀尔德

Flyte's 多租户架构 使多个团队能够共享基础架构,同时保持数据、配置和资源的隔离。不可变的执行可确保工作流程在执行后无法更改,从而创建了强大的审计跟踪并加强了数据隔离。工作流程版本控制允许团队跟踪更改并在需要时恢复到以前的版本。Jeev Balakrishnan,软件工程师 Freenome,强调了这个好处:

“Flyte 有这种不可变转换的概念——事实证明执行无法删除,因此对于我们的数据工程堆栈来说,不可变转换是一个非常好的抽象”。

Flyte 还使用强类型接口来验证每一步的数据。敏感凭证受到安全管理,可以作为文件挂载,也可以作为环境变量传递。此外,端到端的数据沿袭跟踪可在整个生命周期中全面了解数据来源和转换。

Flyte 是一个 免费的开源平台 在 Apache 2.0 许可证下提供,用户自付 Kubernetes 基础设施费用。为了削减开支,Flyte 提供 可中断的 任务装饰器中的参数,允许使用现货或抢占式实例。与按需定价相比,这种方法可以将计算成本降低多达90%。来自 Freenome 的 Jeev Balakrishnan 解释说:

“考虑到其中一些任务的运行规模,计算可能会变得非常昂贵。因此,能够为某些任务向任务装饰器添加一个可中断的参数对于削减成本非常有用”。

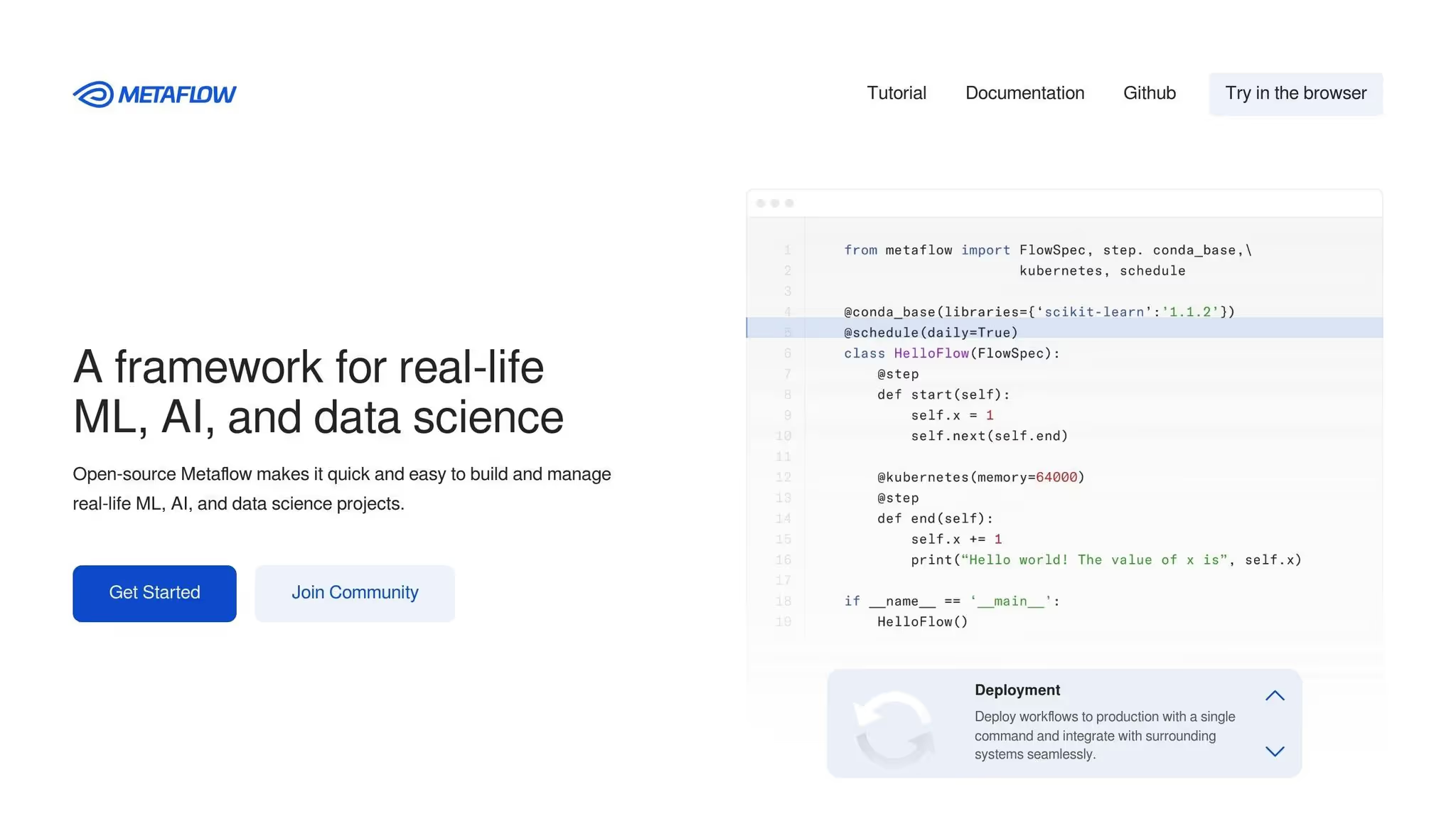

Metaflow 采用模块化设计,将工作流程逻辑与执行分开,使开发人员可以更轻松地专注于构建工作流程,而不必担心底层基础架构。工作流程使用统一的 API 用纯 Python 编写,而 Metaflow 则管理各种环境中的执行。其分层方法抽象了建模、计算、数据访问和编排等关键组件。与独立调度器不同,Metaflow 可与生产级编排器无缝协作,例如 AWS 分步函数, Argo 工作流程、Apache Airflow 和 Kubeflow。这允许团队在本地开发工作流程并将其部署到生产环境中,而无需更改代码。该框架还集成了领先的云服务,可有效处理数据密集型任务。将 Metaflow 基础设施部署到云账户或 Kubernetes 集群通常只需 15 到 30 分钟。该架构简化了机器学习 (ML) 操作,为平台的专业机器学习功能奠定了基础。

Metaflow 自动跟踪代码、数据和工件的版本,无需手动监督。开发人员可以使用像这样的装饰器 @batch, @kubernetes,以及 @checkpoint 在漫长的培训过程中,为特定步骤和检查点进度分配资源,帮助优化云成本。

最近的增强功能包括对条件和迭代步骤的支持,从而支持更高级的人工智能工作流程。“spin” 命令简化了增量流的创建。此外,Metaflow 支持专用硬件,例如 AWS Trainium,用于训练和微调大型语言模型等任务。

该平台已证明其能够显著加快机器学习工作流程。例如,Ramp 的软件工程师 Peyton McCullough 分享说,使用 AWS Batch 和 Step Functions 实现 Metaflow 可以显著提高他们的机器学习开发速度。在完成了曾经需要几个月才能构建的 “风险” 模型后,该团队在十个月内又交付了八个模型。如今,他们的系统可处理 6,000 多次流量。同样,美国有线电视新闻网的数据科学团队报告说,与2020年全年相比,2021年第一季度测试的模型数量是全年的两倍。

“Airflow 旨在用作计算工作负载的协调器,而不是工作负载本身...Metaflow 仍然包含一个方便的用户界面,数据科学家可以在其中检查任务进度。”

- Peyton McCullough,软件工程师,Ramp

Metaflow 的技术优势与其对治理和安全的关注相辅相成,这对于企业使用至关重要。

Metaflow 提供为企业环境量身定制的强大安全功能。这个 @project decorator 确保不同环境(例如用户、测试、产品)的命名空间隔离,从而保护生产部署。为了进一步保护操作,生产部署需要授权令牌。通过将 Metaflow 直接部署到组织的云账户或 Kubernetes 集群中,所有数据和计算资源都保持在企业的安全范围内。

这个 @project decorator 还通过自动跟踪所有流程、实验和工件来支持全面的审计功能。Metaflow 与现有的企业安全协议、数据治理框架和机密管理系统无缝集成,确保符合企业标准。

Metaflow 是开源的,在 Apache 许可证 2.0 下可用,这意味着团队只需为他们使用的云资源付费。其 “自带云” 方法可以完全控制成本。对于那些寻求额外支持的人,可以通过Outerbounds获得托管版本和专业服务。

Prefect 采用混合架构将编排与执行分开。控制平面,通过以下方式进行管理 Prefect Cloud,处理元数据和调度,而运行时执行则在私有基础设施上进行。这种设置可确保敏感数据保留在您的网络中,从而提供安全性和灵活性。任务是根据实时条件动态执行的,能够从故障点恢复。

工作流程是使用 Python 装饰器定义的,例如 @flow 和 @task,从而可以轻松集成现代编程模式,例如异步/等待和类型提示。这种方法允许机器学习工程师动态创建任务和分支,根据数据条件调整工作流程,而无需预定义每个场景。

Prefect 使用 “拉动” 机制,即工作人员轮询 Prefect API 以获取计划任务,从而无需入站连接并保持防火墙安全。该设计支持机器学习项目的可扩展、高效的工作流程。

Prefect 3.0将运行时开销减少了多达90%,每月下载量超过650万次,贡献了近3万名工程师,获得了越来越多的关注。它的灵活性和可扩展性使其成为许多组织的首选工具。

在 现金应用程序,机器学习工程师 Wendy Tang 率先整合了 Prefect,以增强防欺诈工作流程。该团队量身定制了 Prefect 的功能,以满足其基础设施需求,同时保持严格的安全标准。

“我们采用了所有 Prefect 功能,设计了一个真正适用于我们的基础设施配置和组织的架构。”-Wendy Tang,Cash App 机器学习工程师

浮潜人工智能 使用 Prefect 的开源版本实现了显著的可扩展性。工程总监史密特·沙阿在Kubernetes上实施了Prefect来管理每小时超过1,000个流量和数万个每日执行,从而将吞吐量提高了20倍。

“使用 Prefect,我们将吞吐量提高了 20 倍。它是我们异步处理的主力军 —— 一把瑞士军刀。”-Snorkel AI 工程总监 Smit Shah

Prefect 还包括 MCP(模型上下文协议)服务器,它简化了监控、调试和查询基础架构。该工具简化了复杂机器学习管道的故障排除。

Prefect 提供强大的安全功能,包括 基于角色的访问控制 (RBAC) 分为多个级别-帐户、工作空间和对象。这允许团队将开发、暂存和生产环境分开。单点登录 (SSO)、基于 SCIM 的团队管理和零入站连接设计等企业功能增强了安全性和合规性。

审计日志跟踪所有操作以满足合规性要求,而安全密钥管理可确保凭据安全存储而不是硬编码到管道中。

在 端点,数据工程和平台经理 Sunny Pachunuri 领导了从竞争平台向 Prefect 的迁移。这种过渡消除了改造的需要,从而节省了大量成本并提高了生产率。

“从天文学家转到Prefect,仅发票成本就降低了73.78%。”-Endpoint数据工程和平台经理Sunny Pachunuri

这些功能使 Prefect 既安全又经济实惠,适合企业使用。

Prefect 提供三个定价等级以满足不同的需求:

Prefect 的持久执行模型允许工作流程从故障点恢复,无需重新运行整个机器学习训练作业。这显著降低了计算成本。此外,基础设施感知编排支持 Kubernetes 竞价型实例,与按需定价相比,它可以将计算费用降低 60-75%。

例如, Rent The Runway 报告称,通过利用 Prefect 的基础设施感知编排,计算成本降低了 70%。

本节建立在先前的平台评测基础上,对它们的核心优势和挑战进行了并排比较。每个平台都有自己的一系列优势和权衡取舍,因此选择一个与您的基础架构、专业知识和预算相适应的平台至关重要。下表重点介绍了每个平台的主要优势、局限性和理想用例。

阿帕奇气流 因使用其定向无环图 (DAG) 结构管理复杂的任务依赖关系而备受赞誉,该结构可确保透明和可预测的执行。但是,它需要自定义 ML 扩展,可能占用大量资源,并且缺乏官方企业支持。

Kubeflow 与 Kubernetes 无缝集成,并获得了大量社区支持,超过 2.58 亿次 PyPI 下载量和 33,100 个 GitHub 明星就证明了这一点。尽管如此,它以其复杂性和高维护要求而闻名,通常需要一支由3-5名工程师组成的专门团队,每年可能花费约40万美元。

Flyte 擅长处理以可重复性为重点的大规模版本化工作流程,但它需要 Kubernetes 的专业知识并带来额外的基础设施开销。

元流 简化了数据科学家的基础设施管理,但它对Python的严重依赖使其不太适合需要支持多种编程语言的环境。

学长 采用轻量级方法,采用纯Python设计,无需使用DSL或YAML,并且在3.0版本中运行时开销减少了90%。但是,对于较小的任务,它仍然会占用大量资源。

这些见解突显了使平台选择与特定项目需求保持一致的重要性。由于部署、监控和模型可靠性方面的挑战,将近 80% 的机器学习项目未能在实验之外取得进展。选择一个能补充团队专业知识和现有基础架构的平台——而不是简单地选择功能最丰富的选项——可以显著提高你成功投入生产的机会。

上面的比较展示了各种编排平台的独特优势,清楚地表明正确的选择取决于团队的专业知识和项目需求。

对于大量使用 Python 工作的团队,Prefect 提供了直观的解决方案。凭借其直截了当 @flow 装饰器,您可以轻松地将功能转换为生产工作流程。其混合执行模型通过将敏感信息保存在本地,同时仅在外部共享元数据来确保数据安全。

如果你的团队依赖Kubernetes,那么像Kubeflow或Flyte这样的平台是很好的选择。这些工具在要求严格的可重复性和强大的 DevOps 功能的环境中大放异彩,尽管它们具有更陡峭的学习曲线和更高的维护需求。

无服务器编排平台,例如 SageMaker 管道 或者 Vertex AI Pipelines 非常适合注重预算的云原生项目。通过仅按实际计算时间收费并避免基础设施闲置成本,它们提供了一种高效且具有成本效益的模型。

对于在受监管行业工作的美国团队来说,单点登录、基于角色的访问控制和详细的审计日志等安全功能是不可谈判的。选择具有这些功能的平台可确保合规性和顺畅的部署流程。

管理具有严格监管需求的多模型 AI 工作流程的组织应考虑 prompts.ai。它可以访问超过35种顶级人工智能模型和实时FinOps工具,提供了一个统一的生态系统,可以将人工智能成本降低多达98%。其即用即付的TOKN积分将支出与使用量直接挂钩,从而确保了成本效率和企业级治理。

随着编排平台从僵化的 DAG 结构向更灵活的基于 Python 的控制流程演变,它们支持动态的、事件驱动的工作流程和代理式 AI 编排。立即选择正确的平台不仅可以满足您当前的需求,还可以使您的组织为未来的自主协调做好准备。

在选择机器学习编排平台时, 可扩展性 应该是重中之重。选择能够适应不断增加的工作负载的解决方案,同时支持本地、云或混合设置的部署。最好的平台无需修改大量代码即可实现这一点。容器编排等功能,尤其是 Kubernetes 的功能,可以简化扩展和部署流程。

另一个关键因素是易用性 建立和管理工作流程。支持 Python 等广泛使用的编程语言的平台使数据科学家更容易直观地设计管道。此外,寻求与数据版本控制、模型监控和 CI/CD 管道工具的无缝集成,以确保端到端工作流程的顺畅性。

最后,注意 可观测性、可靠性和成本。可靠的平台应提供全面的监控、实时指标和有效的错误处理,以维持系统的正常运行时间。比较定价结构(无论是按使用量付费的托管服务还是自托管解决方案),并确认包含基本的安全功能,例如基于角色的访问控制,以满足合规标准。通过优先考虑这些注意事项,您将更有能力选择符合项目要求和目标的平台。

机器学习编排平台的定价模型通常分为三种主要类型: 固定费率订阅, 基于使用量的费用,以及 定制企业合同。固定费率计划提供可预测的每月支出,这可能有助于编制预算,但是如果您的使用量超过分配的配额,它们可能会变得昂贵。另一方面,基于使用量的模型根据计算时间、API 调用或工作流程运行次数等因素收费。它们使成本与实际使用量保持一致,使其非常适合工作负载波动的企业,尽管它们可能更难预测。一些平台采用混合方法,将基本订阅费与额外使用费用相结合,提供灵活性和成本管理的组合。

定价也可能受到平台功能的影响。GPU 加速、托管 Kubernetes 或访问各种人工智能模型等选项可能会增加成本。对于专注于控制支出的企业来说,具有清晰成本仪表板和透明计费系统的平台是更好的选择。同时,优先考虑快速可扩展性的团队可能会倾向于采用灵活按需定价的解决方案,即使这意味着更高的可变成本。要准确评估协调平台的财务影响,详细了解其定价结构至关重要。

在选择机器学习编排平台时,必须将重点放在既能保护数据和工作流程又符合行业合规标准的安全措施上。寻找优先考虑的平台 数据驻留,确保您的代码和数据保留在您的环境中。仅限出站的工作人员连接和阻止入站网络访问的混合架构等功能对于保持控制和安全至关重要。寻找诸如此类的认证 SOC 2 类型 II, GDPR,以及 你好,再加上常规练习 渗透测试 和 漏洞赏金计划 识别和解决漏洞。

有效 访问管理 是另一个关键因素。平台应包括 基于角色的访问控制 (RBAC), 多因素身份验证 (MFA),以及 单点登录 (SSO) 确保只有授权用户才能访问。安全的服务间通信 服务账号,并确认所有数据在静态和传输过程中均已加密。全面的 审计日志 可自定义的保留期也是合规和法证调查的必要条件。

为了进一步保护基础架构,请寻找以下功能 容器安全, Kubernetes RBAC, 网络分割,以及 IP 许可名单。这些工具有助于减少潜在的漏洞,并确保您的机器学习环境安全并为生产做好准备。