La gestion de flux de travail d'apprentissage automatique à grande échelle nécessite des outils d'orchestration spécialisés qui garantissent la fluidité des opérations, le contrôle des coûts et la conformité. Que vous ayez affaire à des téraoctets de données ou que vous organisiez des formations distribuées sur Kubernetes, ou pour naviguer dans des environnements multicloud, il est essentiel de choisir la bonne plateforme. Voici un bref aperçu des six principales options :

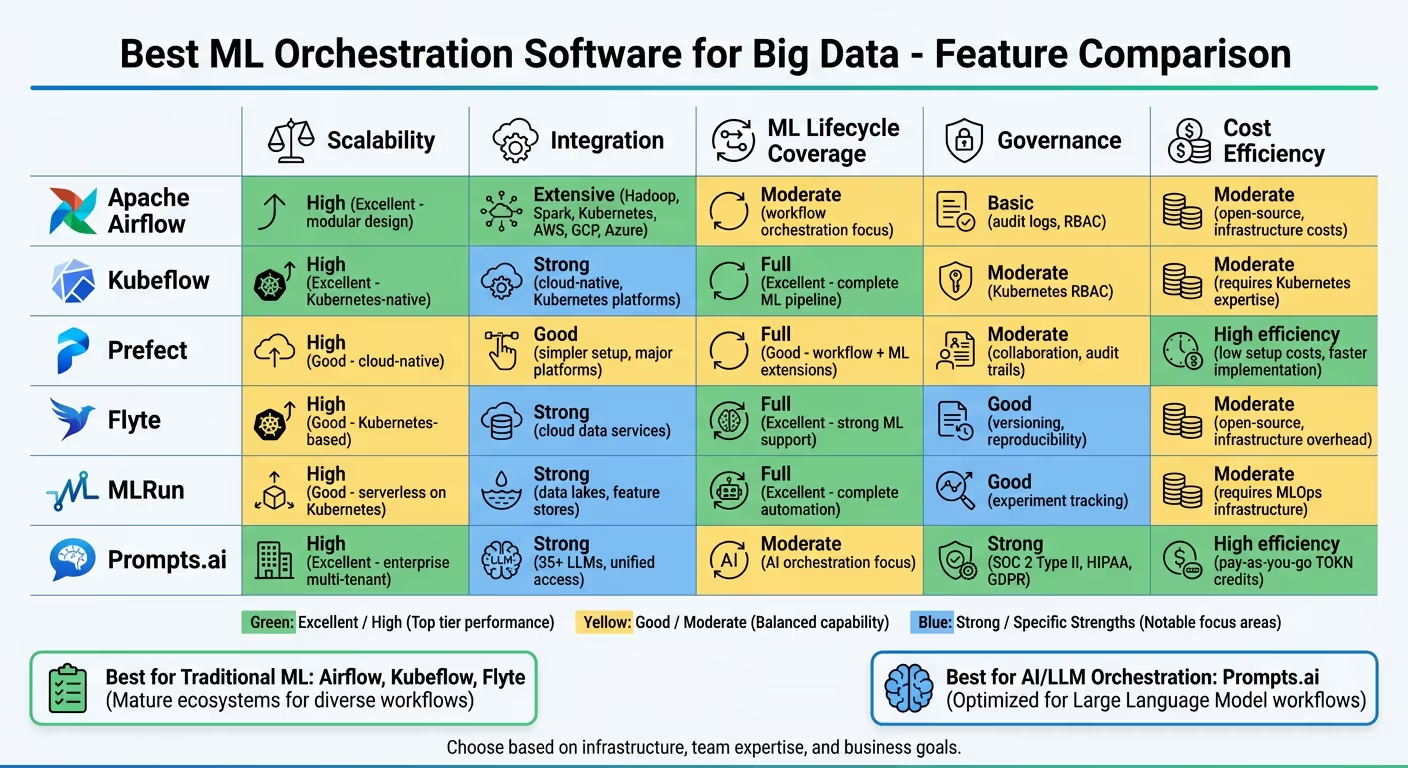

Chaque outil est évalué en fonction de son évolutivité, de son intégration, de sa couverture du cycle de vie, de sa gouvernance et de sa rentabilité. Pour les équipes qui accordent la priorité aux flux de travail ML traditionnels, des outils tels qu'Airflow, Kubeflow ou Flyte peuvent être les mieux adaptés. Pour ceux qui se concentrent sur l'orchestration de l'IA et les LLM, Prompts.ai offre une gouvernance et une transparence des coûts inégalées.

Le bon choix dépend de votre infrastructure, de l'expertise de votre équipe et de vos objectifs commerciaux. Approfondissez chaque outil pour trouver celui qui répond le mieux à vos besoins.

Comparaison des outils d'orchestration du machine learning : fonctionnalités, évolutivité et analyse des coûts

Apache Airflow est une plateforme d'orchestration open source basée sur Python, conçue pour gérer les flux de travail via des graphes acycliques dirigés (DAG). Initialement créé à Airbnb et désormais géré par Fondation pour le logiciel Apache, il a été largement adopté, en particulier par les équipes d'ingénierie des données. Bien qu'il ne soit pas spécifiquement conçu pour l'apprentissage automatique (ML), sa flexibilité en fait une option pratique pour gérer les flux de travail ML dans des environnements de données à grande échelle, en particulier pour les équipes qui maîtrisent déjà cet outil. Il fournit un cadre fiable pour organiser et gérer les flux de travail, même dans des environnements complexes de mégadonnées.

La conception modulaire d'Airflow lui permet d'évoluer efficacement. En répartissant les tâches entre les employés tout en respectant les dépendances spécifiées, il garantit que les flux de travail peuvent s'étendre à mesure que les demandes de traitement des données augmentent. Par exemple, Netflix s'appuie sur Airflow pour gérer et planifier des milliers de tâches dans ses pipelines de données, garantissant ainsi des opérations fluides. Cela dit, Airflow excelle dans les environnements où les flux de travail sont relativement stables et peut ne pas fonctionner aussi efficacement dans des configurations très dynamiques.

Airflow se distingue par sa capacité à s'intégrer à divers systèmes de mégadonnées, ce qui en fait un outil polyvalent pour divers écosystèmes. Il propose de nombreux opérateurs qui se connectent à des plateformes telles que Hadoop, Spark et Kubernetes. Par exemple, Sage, une société de technologie financière, utilise Airflow pour recycler les flux de travail ML sur Amazon SageMaker, facilitant la surveillance des transactions en temps réel et les processus Know Your Customer (KYC). En outre, des services gérés tels que Compositeur Google Cloud et Astronome simplifiez la mise à l'échelle et la transition d'un environnement sur site à un environnement basé sur le cloud.

L'approche programmatique basée sur Python d'Airflow permet aux équipes d'orchestrer plusieurs étapes du cycle de vie du machine learning, du prétraitement des données à la formation et au déploiement des modèles. Sa capacité à générer dynamiquement des pipelines permet aux utilisateurs de créer et de planifier des flux de travail complexes en fonction de paramètres spécifiques. Cependant, la configuration d'Airflow peut présenter des défis DevOps modérés, et certaines fonctionnalités spécifiques au ML présentes sur les plateformes conçues exclusivement pour l'apprentissage automatique peuvent être insuffisantes.

Airflow comprend une interface Web conviviale permettant de suivre la progression du pipeline et de résoudre les problèmes. Sa structure DAG organise non seulement les flux de travail, mais assure également le suivi des versions, ce qui facilite la collaboration et gère les pistes d'audit. Cette fonctionnalité est particulièrement utile pour les secteurs tels que la finance et la santé, où la conformité réglementaire et un lignage clair des données sont essentiels pour gérer les flux de travail de machine learning dans les environnements de mégadonnées.

En tant que plateforme open source, Apache Airflow oblige les utilisateurs à ne couvrir que les coûts d'infrastructure, qu'ils soient déployés sur site ou dans le cloud. Bien que les services gérés tels que Cloud Composer et Astronomer entraînent des dépenses supplémentaires, ils réduisent également la charge de maintenance, de mise à l'échelle et de mises à jour. Pour les équipes qui ont déjà utilisé Airflow dans le cadre de projets d'ingénierie des données, la courbe d'apprentissage est minimale, ce qui permet de réduire encore les coûts indirects.

Kubeflow est une boîte à outils open source conçue pour simplifier le déploiement, la surveillance et la gestion des flux de travail d'apprentissage automatique sur Kubernetes. Conçu pour les équipes qui utilisent Kubernetes pour gérer des opérations d'apprentissage automatique à grande échelle, Kubeflow se distingue des outils d'orchestration à usage général en se concentrant exclusivement sur les besoins uniques du cycle de vie du machine learning. Cette approche spécialisée en fait la solution idéale pour optimiser les flux de travail dans les environnements traitant de grands ensembles de données.

S'appuyant sur l'évolutivité native de Kubernetes, Kubeflow gère efficacement les charges de travail d'apprentissage automatique sur les systèmes distribués. Son cadre conteneurisé permet aux équipes de déployer des pipelines qui ajustent dynamiquement les ressources en fonction des demandes de traitement, une fonctionnalité essentielle lors de la formation de modèles sur des ensembles de données étendus. Kubeflow s'intègre également parfaitement aux principaux fournisseurs de cloud tels que AWS, Plateforme Google Cloud, et Microsoft Azure. Cette compatibilité multicloud permet aux entreprises de gérer des opérations de données à grande échelle avec une allocation flexible des ressources, ce qui en fait un outil puissant pour les configurations hybrides ou multicloud.

L'intégration de Kubeflow à Kubernetes lui permet de s'intégrer parfaitement aux écosystèmes d'ingénierie des données existants. Par exemple, il fonctionne avec des systèmes de flux de travail populaires tels qu'Airflow, permettant aux entreprises d'améliorer leurs capacités d'orchestration du machine learning sans revoir leur infrastructure. Sa conception native du cloud garantit la portabilité, ce qui le rend adaptable à différents environnements tout en préservant son efficacité.

Kubeflow couvre chaque étape du cycle de vie de l'apprentissage automatique, de la formation et des tests au déploiement, en passant par la gestion des versions des modèles et le réglage des hyperparamètres. La plateforme fournit des conteneurs préconfigurés, offrant un moyen standardisé de déployer des pipelines ML au sein de Kubernetes. Comme Domo remarques :

En normalisant la façon dont les pipelines ML sont déployés et servis, Kubeflow permet aux équipes d'innover rapidement sans avoir à réinventer la roue.

De plus, Kubeflow démocratise l'accès à des outils avancés d'apprentissage automatique, permettant aux ingénieurs et aux scientifiques de toutes les équipes de créer, d'exécuter et d'expérimenter des modèles, favorisant ainsi la collaboration et l'innovation.

Bien que Kubeflow soit lui-même gratuit, il nécessite une solide compréhension de Kubernetes pour être utilisé efficacement. Pour les équipes qui exploitent déjà des clusters Kubernetes, les coûts supplémentaires sont minimes. Cependant, les nouveaux utilisateurs de Kubernetes peuvent être confrontés à une courbe d'apprentissage abrupte et à des problèmes d'intégration, ce qui pourrait entraîner des dépenses initiales plus élevées.

Prefect est un système de gestion des flux de travail moderne conçu pour gérer les environnements de données et les infrastructures complexes d'aujourd'hui. Contrairement aux anciens outils d'orchestration, Prefect privilégie la facilité d'utilisation et la résilience, ce qui en fait un choix populaire pour les équipes qui gèrent des charges de travail imprévisibles liées au Big Data. Monte Carlo Data l'a même surnommée « Airflow, mais plus agréable » en raison de son interface intuitive, de son processus de configuration simplifié et de sa complexité réduite.

Prefect se distingue par sa capacité à évoluer de manière fluide. Il peut gérer des millions d'exécutions de flux de travail, offrant un niveau d'évolutivité adapté aux besoins de l'entreprise. La plateforme est disponible en deux versions : Prefect Core, une option open source, et Cloud parfait, une solution entièrement hébergée. Cette flexibilité permet aux équipes de commencer modestement et de s'étendre à mesure que leurs besoins en données augmentent. Prefect Cloud fournit des fonctionnalités supplémentaires telles que l'amélioration des performances et la surveillance des agents, essentielles pour gérer les flux de travail qui traitent de grands ensembles de données sur des systèmes distribués. Son modèle d'exécution hybride renforce encore sa capacité d'adaptation en permettant aux tâches de s'exécuter en toute sécurité dans des environnements sur site, cloud ou hybrides, ce qui est parfait pour les flux de travail liés au Big Data et à l'apprentissage automatique.

Prefect améliore les pipelines de données en incorporant des fonctionnalités essentielles telles que les nouvelles tentatives, la journalisation, le mappage dynamique, la mise en cache et les alertes de panne. Le mappage dynamique, en particulier, est très utile pour gérer des volumes de données fluctuants et permettre un traitement parallèle. La plateforme s'intègre également parfaitement à des outils tels que Lac Fs, permettant le versionnage des données en encapsulant les appels d'API dans PythonOperators ou des tâches personnalisées. Cette fonctionnalité garantit un contrôle de version efficace pour les ensembles de données à grande échelle.

Prefect va au-delà de la gestion traditionnelle des pipelines de données pour prendre en charge l'ensemble du cycle de vie de l'apprentissage automatique. L'introduction de Marvin, IA - un cadre pour créer des modèles, des classificateurs et des applications d'IA à l'aide d'interfaces en langage naturel - étend considérablement ses capacités. De plus, sa fonction de nouvelle tentative automatique protège l'intégrité du flux de travail, garantissant des opérations fluides tout au long du cycle de vie du machine learning.

Prefect Core est gratuit et open source, ce qui en fait une option accessible pour les développeurs travaillant avec des flux de données volumineux. Pour les équipes qui recherchent des fonctionnalités améliorées, Prefect Cloud propose un backend payant et entièrement hébergé avec des fonctionnalités telles que les autorisations, la gestion d'équipe et les accords de niveau de service (SLA). La tarification de Prefect Cloud varie en fonction de l'utilisation. Grâce à sa configuration simple et à sa conception conviviale, Prefect constitue un excellent choix pour les équipes qui souhaitent économiser du temps et des ressources lors de la mise en œuvre d'outils d'orchestration.

Flyte est une plateforme d'orchestration native de Kubernetes initialement développée par Lyft pour gérer des charges de travail d'apprentissage automatique à grande échelle en production. Aujourd'hui, il gère les flux de travail de plus de 3 000 équipes et de grandes entreprises comme Google et Airbnb lui font confiance pour adapter les modèles d'apprentissage automatique à tous les centres de données.

La conception de Flyte permet une mise à l'échelle dynamique, éliminant les coûts d'inactivité en ajustant les ressources à la demande. Il prend en charge la mise à l'échelle horizontale et verticale, ce qui permet d'ajuster les ressources directement à partir de votre code pendant l'exécution. Grâce à des fonctionnalités intégrées telles que les nouvelles tentatives automatiques, les points de contrôle et la reprise après échec, Flyte garantit la fiabilité et réduit le besoin de corrections manuelles. Ce cadre évolutif s'intègre également parfaitement aux systèmes de Big Data.

L'architecture de Flyte est optimisée pour des flux de travail hautement simultanés et faciles à gérer, ce qui la rend idéale pour les tâches d'apprentissage automatique et de traitement des données. Les équipes peuvent déployer des référentiels distincts sans perturber les fonctionnalités de la plateforme. Cette configuration empêche la fragmentation des outils entre les piles de données, de machine learning et d'analyse, tout en centralisant la gestion des flux de travail à grande échelle.

Flyte fournit une gestion complète des flux de travail pour développer, déployer et affiner les systèmes AI/ML sur une plate-forme unique. Son SDK Python prend en charge le prétraitement des données pour les flux de travail ETL. Pour la formation des modèles, Flyte facilite les flux de travail distribués et s'intègre parfaitement à des frameworks tels que TensorFlow et PyTorch.

La version open source de Flyte est gratuite, ce qui la rend accessible aux équipes de toutes tailles. Pour ceux qui ont besoin de fonctionnalités avancées, Union Enterprise propose une version gérée de Flyte avec des options de tarification personnalisées. Jeev Balakrishnan de Freenome décrit Flyte comme « un bourreau de travail », soulignant sa fiabilité et son efficacité. Cette flexibilité des coûts renforce la position de Flyte en tant que solution fiable pour les flux de travail ML à grande échelle et prêts pour la production.

MLrun est une plateforme open source conçue pour gérer l'ensemble du cycle de vie de l'apprentissage automatique à grande échelle. Son architecture élastique et sans serveur le rend particulièrement utile pour les équipes travaillant sur des opérations de données à grande échelle.

Avec sa capacité à prendre en charge des millions d'exécutions, MLrun élimine le besoin de gestion manuelle de l'infrastructure grâce à une mise à l'échelle élastique. Cette conception sans serveur permet aux équipes de se concentrer sur le développement de modèles pendant que la plateforme transforme leur code en flux de travail prêts pour la production.

Le framework de MLrun s'intègre sans effort à divers systèmes de données, ce qui en fait un choix judicieux pour le traitement des mégadonnées. Il comprend un magasin de fonctionnalités et d'artefacts pour gérer l'ingestion, le traitement, les métadonnées et le stockage des données sur plusieurs référentiels et technologies. Cette centralisation est essentielle pour les opérations liées au Big Data. La plateforme prend en charge divers systèmes de stockage, notamment S3, Artifactif, Système d'exploitation Alibaba Cloud, HTTP, Git et GCS, offrant une flexibilité dans les choix d'infrastructures. De plus, sa couche d'abstraction se connecte parfaitement à un large éventail d'outils et de plug-ins d'apprentissage automatique, garantissant ainsi la compatibilité avec les frameworks de Big Data établis.

MLrun va au-delà de l'évolutivité et de l'intégration en couvrant l'ensemble du pipeline d'apprentissage automatique, du développement initial au déploiement. Il rationalise les processus tels que les expériences automatisées, la formation de modèles, les tests et les déploiements de pipelines en temps réel, tout en préservant la cohérence à chaque étape du cycle de vie de l'apprentissage automatique.

En tant que plateforme open source, MLrun est gratuite, ce qui en fait une option économique pour les organisations de toutes tailles. Cette structure de coûts permet aux équipes d'allouer plus de ressources à l'infrastructure et aux talents plutôt que de payer des frais de licence onéreux, ce qui est particulièrement bénéfique pour les startups et les groupes axés sur la recherche.

Prompts.ai est une puissante plateforme d'entreprise conçue pour rationaliser l'orchestration de l'IA. Il permet d'accéder à plus de 35 grands modèles linguistiques de premier plan, tels que GPT-5, Claude, Lama, et Gémeaux, le tout au sein d'une interface unique et sécurisée. Contrairement à d'autres outils, Prompts.ai met l'accent sur une gouvernance solide, une gestion précise des coûts et un accès fluide aux modèles d'IA modernes, ce qui en fait un choix fiable pour gérer les flux de travail d'apprentissage automatique à grande échelle. Ses fonctionnalités répondent à l'évolutivité, à l'intégration, à la gouvernance et à la gestion des coûts, garantissant ainsi aux entreprises un fonctionnement efficace.

Prompts.ai est conçu pour évoluer en fonction de vos besoins. Ses espaces de travail dynamiques et ses outils collaboratifs permettent aux équipes de mettre en commun leurs ressources de manière efficace, grâce à un système de crédit TOKN flexible avec paiement à l'utilisation. Grâce à son architecture mutualisée, les équipes de science des données, les ingénieurs ML et les professionnels de l'analyse peuvent exécuter des expériences et des pipelines simultanés sur de grands ensembles de données sans ralentir les performances.

La plateforme s'intègre parfaitement aux infrastructures de données existantes, prenant en charge les flux de travail RAG et les configurations de bases de données vectorielles pour permettre des pipelines d'apprentissage automatique de bout en bout. En associant les processus de machine learning traditionnels aux fonctionnalités modernes des grands modèles linguistiques, Prompts.ai permet aux équipes de gérer de grandes quantités de données tout en maintenant des connexions sécurisées à leurs systèmes existants. Cette approche garantit la gestion efficace de divers environnements de données.

La sécurité et la conformité sont au cœur de Prompts.ai. Il est conforme aux normes industrielles telles que SOC 2 Type II, HIPAA et GDPR pour protéger les données sensibles, ce qui les rend particulièrement utiles pour des secteurs tels que la santé et la finance. La plateforme a entamé son processus d'audit SOC 2 de type II le 19 juin 2025 et propose un centre de confiance public à https://trust.prompts.ai/ où les utilisateurs peuvent accéder à des mises à jour en temps réel sur son état de sécurité et de conformité. Des fonctionnalités telles que la surveillance de la conformité et des outils de gouvernance sont incluses dans ses plans d'affaires, garantissant une supervision complète.

Prompts.ai introduit un système de crédit TOKN à paiement à l'utilisation, s'éloignant des licences traditionnelles par siège. Ses options tarifaires incluent un niveau exploratoire de 0$ et des plans d'affaires allant de 99$ à 129$ par membre et par mois. Grâce aux outils FinOps en temps réel, les utilisateurs peuvent surveiller l'utilisation des jetons et optimiser les dépenses, en veillant à ce que les coûts de l'IA correspondent aux objectifs commerciaux. Cette transparence aide les entreprises à réduire leurs dépenses globales tout en maximisant leur valeur.

Chaque outil présente ses points forts et ses propres défis en termes d'évolutivité, d'intégration avec les systèmes de mégadonnées et d'IA, de gestion du cycle de vie du machine learning, de gouvernance et de rentabilité. Découvrons les principaux points forts :

Flux d'air Apache se distingue par son évolutivité, grâce à sa conception modulaire et à son planificateur efficace capable de gérer des milliers de tâches simultanées dans des environnements de production. Il s'intègre parfaitement aux systèmes distribués tels que Hadoop, Spark et Kubernetes, ainsi qu'aux principales plateformes cloud telles qu'AWS, GCP et Azure. Cependant, sa courbe d'apprentissage abrupte et sa configuration complexe peuvent ralentir son adoption, en particulier pour les petites équipes.

Kubeflow tire parti de son framework natif de Kubernetes pour offrir une évolutivité native au cloud. Cependant, pour exploiter tout son potentiel, les équipes ont besoin d'une expérience préalable de Kubernetes et de l'infrastructure nécessaire pour le prendre en charge.

Préfet simplifie le déploiement grâce à son approche moderne axée sur Python, qui permet aux équipes d'obtenir des résultats plus rapidement avec moins de complexité. Cela en fait un choix populaire pour les équipes en croissance rapide qui recherchent une mise en œuvre plus rapide.

Flûte et Exécution du ML concentrez-vous sur la reproductibilité tout au long du cycle de vie du machine learning. Bien que les deux outils excellent dans ce domaine, leurs écosystèmes ne sont pas aussi étendus que ceux d'Apache Airflow, qui dispose d'une base d'utilisateurs plus établie.

Prompts.ai adopte une approche différente en se concentrant sur l'orchestration de l'IA plutôt que sur les pipelines de machine learning traditionnels. Il offre un accès unifié à plus de 35 grands modèles linguistiques de premier plan via une interface sécurisée et inclut des contrôles FinOps intégrés pour la gestion des coûts. Son système TOKN payant à l'utilisation élimine les frais par siège, et sa conformité à la SOC 2 Type II, à la HIPAA et au RGPD garantit qu'il répond aux besoins de gouvernance des secteurs réglementés.

Voici une comparaison rapide de ces outils basée sur des indicateurs clés :

Le bon outil dépend largement de l'infrastructure existante, de l'expertise et des besoins spécifiques de votre équipe. Les équipes possédant de solides compétences en Kubernetes peuvent trouver Kubeflow ou Flyte plus adapté, tandis que celles qui recherchent la simplicité et un déploiement plus rapide peuvent se tourner vers Prefect. Pour les entreprises qui accordent la priorité à la gouvernance, à la gestion des coûts et à l'accès unifié aux modèles d'IA, Prompts.ai propose une solution remarquable grâce à sa conception axée sur la conformité et à sa structure de coûts transparente.

Pour choisir le bon logiciel d'orchestration de machine learning, il faut l'aligner sur l'expertise de votre équipe, l'infrastructure existante et les priorités commerciales. Flux d'air Apache reste un concurrent sérieux pour l'orchestration générale des flux de travail, offrant une évolutivité éprouvée sur des plateformes telles que Hadoop, Spark et les principaux fournisseurs de cloud. Son architecture modulaire gère efficacement des milliers de tâches simultanément, bien qu'elle nécessite un effort de configuration important.

La gouvernance et la conformité jouent également un rôle central, en particulier dans les secteurs réglementés. Des fonctionnalités telles que les contrôles d'accès basés sur les rôles, la journalisation des audits et le suivi du lignage des données sont essentielles pour répondre à des normes telles que le RGPD et la HIPAA. Cependant, la mise en œuvre de ces fonctionnalités nécessite souvent des investissements d'infrastructure considérables et une maintenance continue.

Pour les entreprises basées aux États-Unis qui tirent parti Infrastructure basée sur Kubernetes, des outils tels que Kubeflow et Flyte offrent une évolutivité robuste, native du cloud, avec un support solide pour la gestion du cycle de vie du machine learning. Bien que les deux s'intègrent parfaitement à l'orchestration des conteneurs, ils nécessitent une solide compréhension de Kubernetes. Pour les équipes qui n'ont pas cette expertise, Prefect propose un processus de déploiement plus simple.

Pour les entreprises qui se concentrent sur Projets pilotés par LLM et orchestration de l'IA, Prompts.ai se démarque. Il simplifie l'accès à plus de 35 modèles linguistiques tout en relevant les défis de gouvernance liés à la conformité à la norme SOC 2 Type II, à l'HIPAA et au RGPD. Le système de crédit TOKN pay-as-you-go garantit la transparence des coûts en éliminant les frais de licence par siège, un avantage évident pour les entreprises américaines qui cherchent à trouver un équilibre entre évolutivité et contraintes budgétaires.

En fin de compte, votre décision dépend de votre priorité : les flux de travail de machine learning traditionnels ou l'orchestration moderne de l'IA. En évaluant vos besoins par rapport à des critères clés (évolutivité, intégration, couverture du cycle de vie, gouvernance et rentabilité), vous pouvez faire un choix éclairé. Les pipelines de machine learning établis s'harmonisent bien avec les outils d'orchestration traditionnels, tandis que Prompts.ai convient parfaitement aux opérations d'IA unifiées et axées sur le LLM.

Lorsque vous choisissez un outil d'orchestration de machine learning pour le Big Data, il est essentiel de hiérarchiser les priorités compatibilité avec votre infrastructure technologique actuelle. Un outil qui s'intègre parfaitement à vos systèmes existants permet d'économiser du temps et des ressources, tout en réduisant les complications inutiles.

Pensez à l'outil évolutivité - est-il capable de gérer des volumes de données croissants et des flux de travail de plus en plus complexes à mesure que vos besoins augmentent ? Il est tout aussi important de prendre en compte facilité d'utilisation pour votre équipe. Un outil convivial adapté au niveau de compétence de votre équipe peut réduire considérablement le temps consacré à la formation et à l'intégration.

De plus, robuste fonctionnalités de surveillance et d'automatisation sont essentiels pour simplifier la gestion des flux de travail et garantir des performances fiables. Enfin, évaluez si l'outil correspond aux plans à long terme de votre organisation, tels que l'adoption de nouvelles technologies ou la transition vers le cloud.

La gouvernance et la conformité jouent un rôle clé dans le choix d'un logiciel d'orchestration d'apprentissage automatique, car elles garantissent que vos flux de travail sont conformes aux exigences légales et aux normes internes. Offre d'outils lignage des données, pistes d'audit, et contrôles de sécurité stricts contribuent à protéger l'intégrité de vos données tout en préservant la conformité réglementaire.

Dans le contexte des flux de données volumineux, la conformité garantit que les informations sensibles sont gérées de manière responsable et transparente. Une gouvernance efficace minimise les risques et renforce la confiance dans vos processus d'apprentissage automatique, ouvrant ainsi la voie à une évolutivité fluide tout en respectant les directives du secteur.

Les dépenses liées à l'utilisation d'un logiciel d'orchestration d'apprentissage automatique sont influencées par plusieurs facteurs clés, notamment exigences en matière d'infrastructure, échelle de fonctionnement, et exigences en matière de support. Par exemple, des plateformes comme Kubeflow et Métaflow entraînent souvent des coûts d'infrastructure plus élevés en raison de la complexité de leurs processus de déploiement. D'autre part, les solutions open source telles qu'Apache Airflow et Prefect peuvent contribuer à réduire les dépenses liées aux licences, mais peuvent nécessiter des ressources internes supplémentaires pour la configuration et la maintenance continue.

En fin de compte, le coût total dépendra de vos besoins spécifiques. Des variables telles que la taille de vos flux de données, le degré d'automatisation que vous souhaitez atteindre et le fait que vous ayez besoin d'une assistance au niveau de l'entreprise ou d'intégrations personnalisées jouent un rôle important dans la détermination des dépenses globales.