تتطلب إدارة عمليات سير عمل التعلم الآلي واسعة النطاق أدوات تنسيق متخصصة تضمن العمليات السلسة والتحكم في التكاليف والامتثال. سواء كنت تتعامل مع تيرابايت من البيانات، تقوم بتشغيل التدريب الموزع على كوبيرنيتيس، أو التنقل في بيئات متعددة السحابات، يعد اختيار النظام الأساسي المناسب أمرًا بالغ الأهمية. فيما يلي نظرة عامة سريعة على ستة خيارات رائدة:

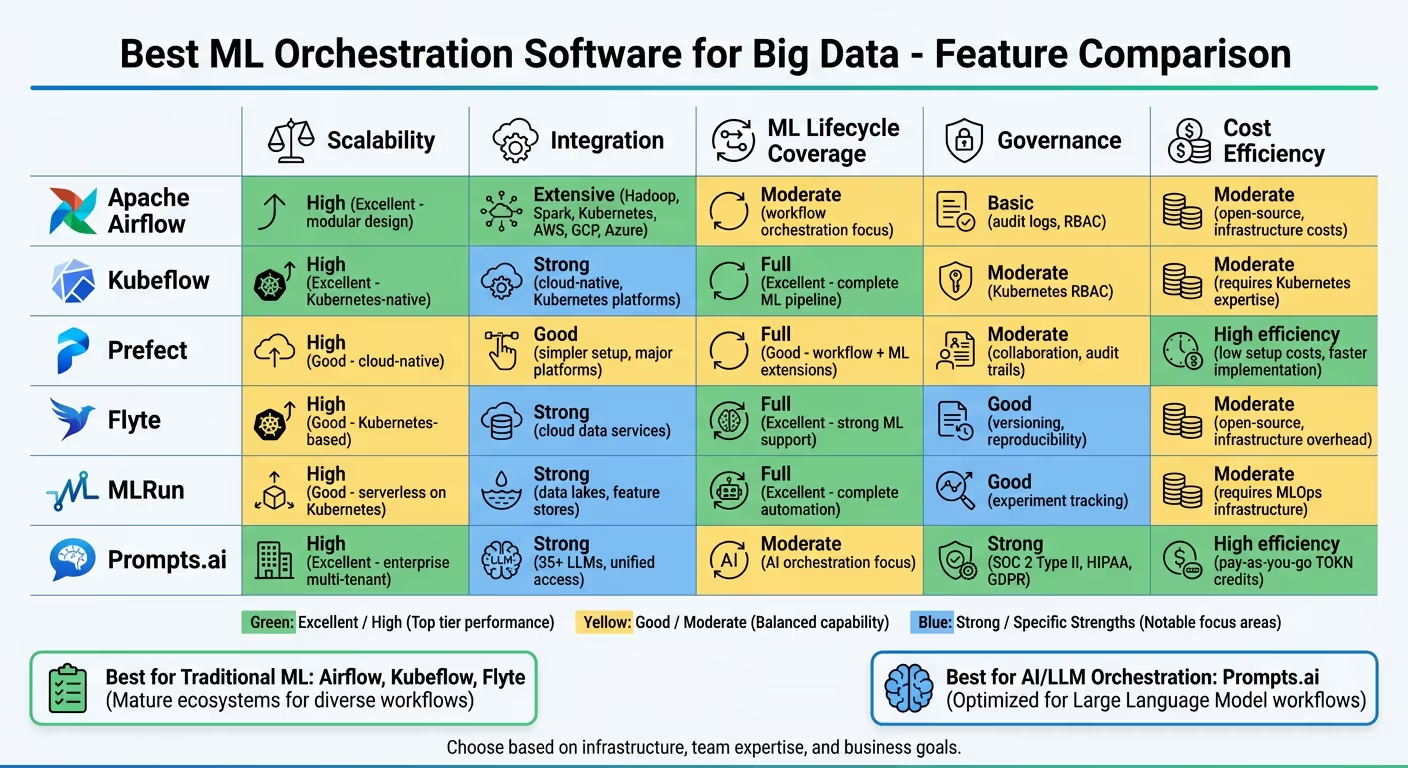

يتم تقييم كل أداة بناءً على قابلية التوسع والتكامل وتغطية دورة الحياة والحوكمة وكفاءة التكلفة. بالنسبة للفرق التي تعطي الأولوية لسير عمل التعلم الآلي التقليدي، قد تكون أدوات مثل Airflow أو Kubeflow أو Flyte مناسبة بشكل أفضل. بالنسبة لأولئك الذين يركزون على تنسيق الذكاء الاصطناعي وLLMs، Prompts.ai يوفر حوكمة لا مثيل لها وشفافية في التكاليف.

يعتمد الاختيار الصحيح على البنية التحتية وخبرة الفريق وأهداف العمل. تعمق في كل أداة للعثور على أفضل ما يناسب احتياجاتك.

مقارنة أدوات تنسيق ML: الميزات وقابلية التوسع وتحليل التكلفة

Apache Airflow عبارة عن منصة تنسيق مفتوحة المصدر مبنية على Python، وهي مصممة لإدارة عمليات سير العمل من خلال الرسوم البيانية غير الدورية الموجهة (DAGs). تم إنشاؤه في البداية في Airbnb ويتم الحفاظ عليها الآن من قبل مؤسسة أباتشي للبرمجيات، وقد تم اعتماده على نطاق واسع، لا سيما بين فرق هندسة البيانات. على الرغم من أنها ليست مصممة خصيصًا للتعلم الآلي (ML)، إلا أن مرونتها تجعلها خيارًا عمليًا للتعامل مع عمليات سير عمل التعلم الآلي في بيئات البيانات واسعة النطاق، خاصة للفرق التي تتقن بالفعل الأداة. يوفر إطارًا موثوقًا لتنظيم وإدارة عمليات سير العمل، حتى في إعدادات البيانات الضخمة المعقدة.

يتيح التصميم المعياري لـ Airflow إمكانية التوسع بفعالية. من خلال توزيع المهام بين العمال مع الالتزام بالتبعيات المحددة، فإنه يضمن توسيع سير العمل مع نمو متطلبات معالجة البيانات. على سبيل المثال، نيتفليكس تعتمد على Airflow لإدارة وجدولة آلاف المهام في خطوط أنابيب البيانات الخاصة بها، مع الحفاظ على عمليات سلسة. ومع ذلك، تتفوق Airflow في البيئات ذات تدفقات العمل المستقرة نسبيًا وقد لا تعمل بكفاءة في الإعدادات الديناميكية للغاية.

تتميز Airflow بقدرتها على الاندماج مع أنظمة البيانات الضخمة المختلفة، مما يجعلها أداة متعددة الاستخدامات للنظم البيئية المتنوعة. إنه يوفر العديد من المشغلين الذين يتصلون بمنصات مثل Hadoop و Spark و Kubernetes. على سبيل المثال، حكيم، وهي شركة تكنولوجيا مالية، تستفيد من Airflow لإعادة تدريب تدفقات عمل ML على أمازون سيج ميكر، مما يساعد في مراقبة المعاملات في الوقت الفعلي وعمليات اعرف عميلك (KYC). بالإضافة إلى ذلك، الخدمات المُدارة مثل غوغل كلاود كومبوسر و عالم الفلك تبسيط التوسع والانتقال من البيئات المحلية إلى البيئات القائمة على السحابة.

يسمح نهج Airflow البرمجي المستند إلى Python للفرق بتنسيق مراحل متعددة من دورة حياة التعلم الآلي، بدءًا من المعالجة المسبقة للبيانات وحتى التدريب على النماذج ونشرها. تتيح قدرتها على إنشاء خطوط الأنابيب ديناميكيًا للمستخدمين إنشاء وجدولة عمليات سير عمل معقدة بناءً على معايير محددة. ومع ذلك، يمكن أن يؤدي إعداد Airflow إلى تحديات DevOps معتدلة، وقد يفتقر إلى بعض الإمكانات الخاصة بـ ML الموجودة في المنصات المصممة حصريًا للتعلم الآلي.

يتضمن Airflow واجهة ويب سهلة الاستخدام لمراقبة تقدم خطوط الأنابيب وحل المشكلات. لا ينظم هيكل DAG الخاص به سير العمل فحسب، بل يتتبع أيضًا الإصدارات ويسهل التعاون ويحافظ على مسارات التدقيق. تعتبر هذه الميزة ذات قيمة خاصة لصناعات مثل التمويل والرعاية الصحية، حيث يعد الامتثال التنظيمي ونسب البيانات الواضح أمرًا بالغ الأهمية لإدارة عمليات سير عمل التعلم الآلي في بيئات البيانات الضخمة.

كمنصة مفتوحة المصدر، يتطلب Apache Airflow من المستخدمين تغطية تكاليف البنية التحتية فقط، سواء تم نشرها محليًا أو في السحابة. في حين أن الخدمات المُدارة مثل Cloud Composer و Astronomer تأتي مع نفقات إضافية، فإنها تقلل أيضًا من عبء الصيانة والتوسع والتحديثات. بالنسبة للفرق ذات الخبرة بالفعل في Airflow من خلال مشاريع هندسة البيانات، يكون منحنى التعلم ضئيلًا، مما يؤدي إلى خفض التكاليف غير المباشرة.

Kubeflow عبارة عن مجموعة أدوات مفتوحة المصدر مصممة لتبسيط نشر ومراقبة وإدارة سير عمل التعلم الآلي على Kubernetes. تم تصميم Kubeflow للفرق التي تستفيد من Kubernetes للتعامل مع عمليات التعلم الآلي واسعة النطاق، وهي تتميز عن أدوات التنسيق للأغراض العامة من خلال التركيز حصريًا على الاحتياجات الفريدة لدورة حياة التعلم الآلي. هذا النهج المتخصص يجعله مثاليًا لتحسين سير العمل في البيئات التي تتعامل مع مجموعات البيانات الضخمة.

استنادًا إلى قابلية التوسع الأصلية لـ Kubernetes، يتعامل Kubeflow بكفاءة مع أعباء عمل التعلم الآلي عبر الأنظمة الموزعة. يسمح إطار العمل بالحاويات للفرق بنشر خطوط الأنابيب التي تضبط الموارد ديناميكيًا بناءً على متطلبات المعالجة، وهي ميزة مهمة عند تدريب النماذج على مجموعات بيانات شاملة. يتكامل Kubeflow أيضًا بسلاسة مع مزودي السحابة الرئيسيين مثل الخدمات اللاسلكية المتقدمة، منصة جوجل كلاود، و ميكروسوفت أزور. يوفر هذا التوافق متعدد السحابات للمؤسسات القدرة على إدارة عمليات البيانات واسعة النطاق مع تخصيص مرن للموارد، مما يجعله أداة قوية للإعدادات المختلطة أو متعددة السحابات.

يتيح تكامل Kubeflow مع Kubernetes ملاءمتها بسلاسة للنظم البيئية لهندسة البيانات الحالية. على سبيل المثال، تعمل جنبًا إلى جنب مع أنظمة سير العمل الشائعة مثل Airflow، مما يسمح للمؤسسات بتعزيز قدرات تنسيق ML الخاصة بها دون إصلاح بنيتها التحتية. يضمن تصميمها السحابي الأصلي قابلية النقل، مما يجعلها قابلة للتكيف مع البيئات المختلفة مع الحفاظ على الكفاءة.

يغطي Kubeflow كل مرحلة من مراحل دورة حياة التعلم الآلي، بدءًا من التدريب والاختبار وحتى النشر وإصدار النماذج وضبط المعلمات الفائقة. توفر المنصة حاويات تم تكوينها مسبقًا، مما يوفر طريقة موحدة لنشر خطوط أنابيب ML داخل Kubernetes. كما دومو الملاحظات:

من خلال توحيد كيفية نشر خطوط أنابيب ML وتقديمها، تضمن Kubeflow أن الفرق يمكنها الابتكار بسرعة دون إعادة اختراع العجلة.

علاوة على ذلك، تعمل Kubeflow على إضفاء الطابع الديمقراطي على الوصول إلى أدوات التعلم الآلي المتقدمة، وتمكين المهندسين والعلماء عبر الفرق من بناء النماذج وتشغيلها وتجربتها، وتعزيز التعاون والابتكار.

في حين أن Kubeflow نفسه مجاني، إلا أنه يتطلب فهمًا قويًا لـ Kubernetes لاستخدامه بفعالية. بالنسبة للفرق التي تقوم بالفعل بتشغيل مجموعات Kubernetes، فإن التكاليف الإضافية ضئيلة. ومع ذلك، قد يواجه هؤلاء الجدد في Kubernetes منحنى تعليمي حاد وتحديات تكامل، مما قد يؤدي إلى ارتفاع النفقات الأولية.

Prefect هو نظام حديث لإدارة سير العمل مصمم للتعامل مع بيئات البيانات والبنى التحتية المعقدة اليوم. على عكس أدوات التنسيق القديمة، تعطي Prefect الأولوية لسهولة الاستخدام والمرونة، مما يجعلها خيارًا شائعًا للفرق التي تدير أعباء عمل البيانات الضخمة غير المتوقعة. حتى أن Monte Carlo Data أطلقت عليها اسم «تدفق الهواء، ولكن أجمل» نظرًا لواجهتها البديهية وعملية الإعداد المبسطة وتقليل التعقيد.

تتميز شركة Prefect بقدرتها على التوسع بسلاسة. يمكنه التعامل مع الملايين من عمليات سير العمل، مما يوفر مستوى من قابلية التوسع المناسبة لاحتياجات المؤسسة. النظام الأساسي متاح في نسختين: بريفكت كور، وهو خيار مفتوح المصدر، و سحابة مثالية، حل مستضاف بالكامل. تسمح هذه المرونة للفرق بالبدء على نطاق صغير والتوسع مع نمو متطلبات البيانات الخاصة بهم. يوفر Prefect Cloud ميزات إضافية مثل تحسينات الأداء ومراقبة الوكلاء، وهي ضرورية لإدارة عمليات سير العمل التي تعالج مجموعات البيانات الكبيرة عبر الأنظمة الموزعة. يعمل نموذج التنفيذ المختلط الخاص به على تعزيز قدرته على التكيف من خلال تمكين المهام من العمل بأمان عبر البيئات المحلية أو السحابية أو المختلطة - وهو مثالي للبيانات الضخمة وسير عمل التعلم الآلي.

يعمل Prefect على تحسين خطوط أنابيب البيانات من خلال دمج الميزات الهامة مثل عمليات إعادة المحاولة والتسجيل والتخطيط الديناميكي والتخزين المؤقت وتنبيهات الفشل. يعد التخطيط الديناميكي، على وجه الخصوص، أمرًا لا يقدر بثمن للتعامل مع أحجام البيانات المتقلبة وتمكين المعالجة المتوازية. تتكامل المنصة أيضًا بسلاسة مع أدوات مثل بحيرة إف إس، وتمكين إصدار البيانات عن طريق تغليف استدعاءات API في PythonOperators أو المهام المخصصة. تضمن هذه الوظيفة التحكم الفعال في الإصدار لمجموعات البيانات واسعة النطاق.

يتجاوز Prefect إدارة خطوط أنابيب البيانات التقليدية لدعم دورة حياة التعلم الآلي بأكملها. مقدمة عن مارفن إيه آي - إطار لبناء نماذج الذكاء الاصطناعي والمصنفات والتطبيقات باستخدام واجهات اللغة الطبيعية - يوسع قدراته بشكل كبير. بالإضافة إلى ذلك، تعمل ميزة إعادة المحاولة التلقائية على حماية سلامة سير العمل، مما يضمن عمليات سلسة طوال دورة حياة ML.

Prefect Core مجاني ومفتوح المصدر، مما يجعله خيارًا متاحًا للمطورين الذين يعملون مع تدفقات عمل البيانات الضخمة. بالنسبة للفرق التي تبحث عن إمكانات محسّنة، تقدم Prefect Cloud واجهة خلفية مدفوعة ومستضافة بالكامل مع ميزات مثل الأذونات وإدارة الفريق واتفاقيات مستوى الخدمة (SLAs). تختلف أسعار Prefect Cloud بناءً على الاستخدام. بفضل الإعداد المباشر والتصميم سهل الاستخدام، يعد Prefect خيارًا ممتازًا للفرق التي تتطلع إلى توفير الوقت والموارد أثناء تنفيذ أدوات التنسيق.

Flyte عبارة عن منصة تنسيق أصلية لـ Kubernetes تم تطويرها في البداية بواسطة ليفت لإدارة أعباء عمل التعلم الآلي واسعة النطاق في الإنتاج. أما اليوم، فهي تدعم سير العمل لأكثر من 3000 فريق وتحظى بثقة الشركات الكبرى مثل Google وAirbnb لتوسيع نطاق نماذج التعلم الآلي عبر مراكز البيانات.

يسمح تصميم Flyte بالتوسع الديناميكي، والقضاء على التكاليف الخاملة عن طريق تعديل الموارد حسب الطلب. وهو يدعم التحجيم الأفقي والعمودي، مما يتيح تعديلات الموارد مباشرة من التعليمات البرمجية أثناء وقت التشغيل. من خلال الميزات المضمنة مثل عمليات إعادة المحاولة التلقائية ونقاط التفتيش واستعادة الأعطال، يضمن Flyte الموثوقية ويقلل من الحاجة إلى الإصلاحات اليدوية. يتكامل هذا الإطار القابل للتطوير أيضًا بسلاسة مع أنظمة البيانات الضخمة.

تم تحسين بنية Flyte لسير العمل المتزامن للغاية والذي يمكن صيانته، مما يجعله مثاليًا للتعلم الآلي ومهام معالجة البيانات. يمكن للفرق نشر مستودعات منفصلة دون تعطيل وظائف النظام الأساسي. يمنع هذا الإعداد تجزئة الأدوات عبر مجموعات البيانات والتعلم الآلي والتحليلات، مع تركيز إدارة سير العمل على نطاق واسع.

يوفر Flyte إدارة شاملة لسير العمل لتطوير ونشر وتحسين أنظمة AI/ML على منصة واحدة. يدعم Python SDK الخاص به المعالجة المسبقة للبيانات لسير عمل ETL. بالنسبة للتدريب النموذجي، يسهل Flyte سير العمل الموزع ويتكامل بسلاسة مع أطر مثل تينسورفلو و PyTorch.

إصدار Flyte مفتوح المصدر مجاني، مما يجعله في متناول الفرق من جميع الأحجام. بالنسبة لأولئك الذين يحتاجون إلى ميزات متقدمة، تقدم Union Enterprise إصدارًا مُدارًا من Flyte مع خيارات تسعير مخصصة. يصف جيف بالاكريشنان من فرينوم فلايت بأنها «العمود الفقري»، مسلطًا الضوء على موثوقيتها وفعاليتها. تعمل مرونة التكلفة هذه على تعزيز مكانة Flyte كحل يمكن الاعتماد عليه لعمليات سير عمل ML واسعة النطاق والجاهزة للإنتاج.

MLRun عبارة عن منصة مفتوحة المصدر مصممة لإدارة دورة حياة التعلم الآلي بأكملها على نطاق واسع. إن بنيتها المرنة التي لا تحتاج إلى خادم تجعلها مفيدة بشكل خاص للفرق التي تعمل مع عمليات البيانات واسعة النطاق.

بفضل قدرته على دعم ملايين عمليات التشغيل، يلغي MLRun الحاجة إلى إدارة البنية التحتية اليدوية من خلال التوسع المرن. يسمح هذا التصميم بدون خادم للفرق بالتركيز على تطوير النماذج بينما تقوم المنصة بتحويل التعليمات البرمجية الخاصة بها إلى عمليات سير عمل جاهزة للإنتاج.

يتكامل إطار MLRun بسهولة مع أنظمة البيانات المختلفة، مما يجعله خيارًا قويًا للتعامل مع البيانات الضخمة. يتضمن متجرًا للميزات والأدوات لإدارة استيعاب البيانات ومعالجتها والبيانات الوصفية والتخزين عبر مستودعات وتقنيات متعددة. تعد هذه المركزية أمرًا بالغ الأهمية لعمليات البيانات الضخمة. تدعم المنصة مجموعة متنوعة من أنظمة التخزين، بما في ذلك S3، قطعة أثرية، علي بابا كلاود أو إسو HTTP و Git و GCS، مما يوفر المرونة في خيارات البنية التحتية. بالإضافة إلى ذلك، تتصل طبقة التجريد الخاصة بها بسلاسة مع مجموعة واسعة من أدوات التعلم الآلي والمكونات الإضافية، مما يضمن التوافق مع أطر البيانات الضخمة المعمول بها.

يتجاوز MLRun قابلية التوسع والتكامل من خلال تغطية خط أنابيب التعلم الآلي بالكامل، من التطوير الأولي إلى النشر. فهي تبسط العمليات مثل التجارب الآلية والتدريب النموذجي والاختبار وعمليات نشر خطوط الأنابيب في الوقت الفعلي، مع الحفاظ على الاتساق في كل مرحلة من مراحل دورة حياة التعلم الآلي.

كمنصة مفتوحة المصدر، MLRun مجانية للاستخدام، مما يجعلها خيارًا اقتصاديًا للمؤسسات من جميع الأحجام. يسمح هيكل التكلفة هذا للفرق بتخصيص المزيد من الموارد للبنية التحتية والمواهب بدلاً من رسوم الترخيص الباهظة، وهو أمر مفيد بشكل خاص للشركات الناشئة والمجموعات التي تركز على البحث.

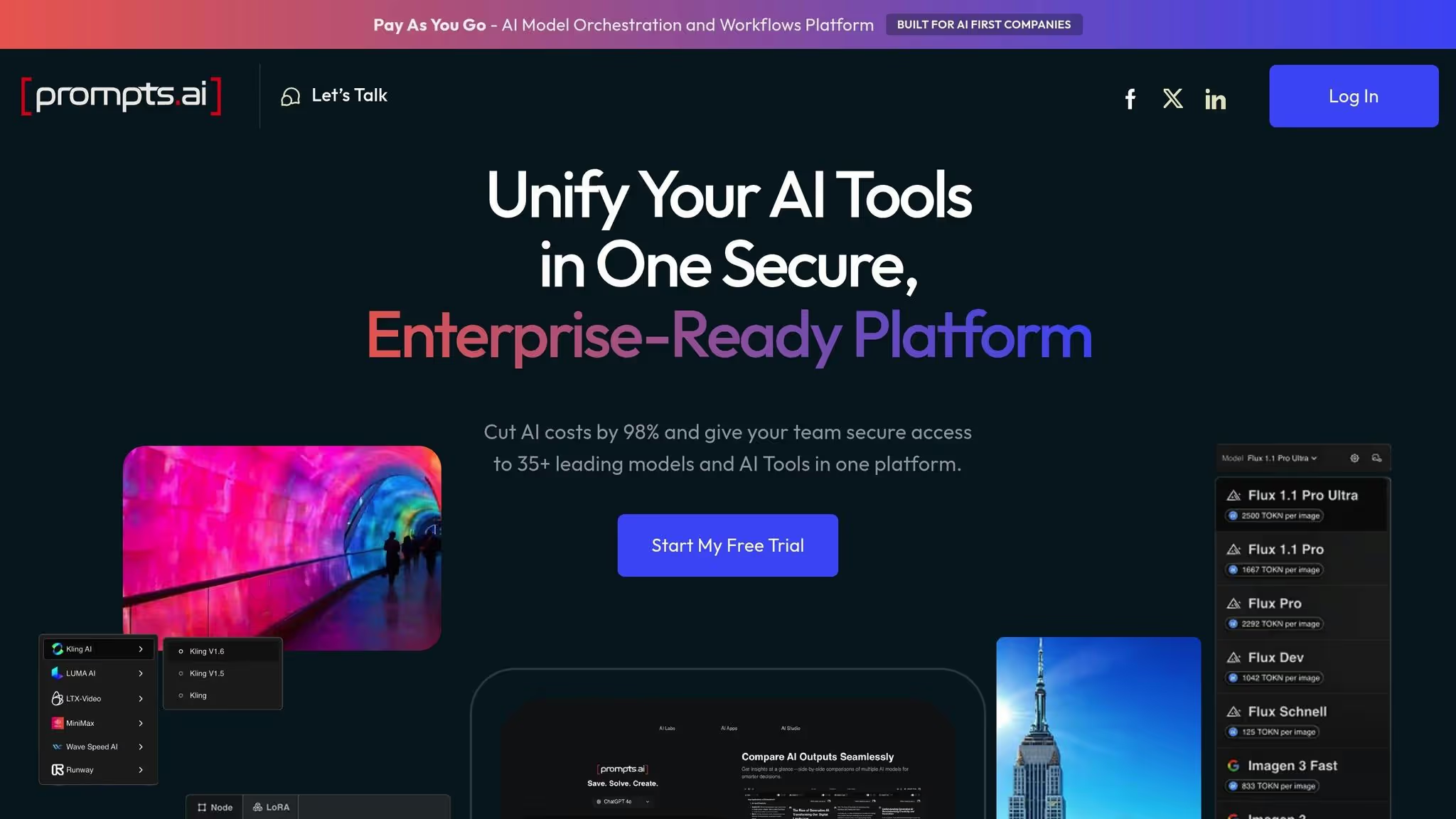

Prompts.ai عبارة عن منصة مؤسسة قوية مصممة لتبسيط تنسيق الذكاء الاصطناعي. فهو يجمع بين الوصول إلى أكثر من 35 نموذجًا رائدًا للغات الكبيرة، مثل جي بي تي -5، كلود، لاما، و الجوزاء، كل ذلك ضمن واجهة واحدة وآمنة. على عكس الأدوات الأخرى، تؤكد Prompts.ai على الحوكمة القوية والإدارة الدقيقة للتكاليف والوصول السلس إلى نماذج الذكاء الاصطناعي الحديثة، مما يجعلها خيارًا موثوقًا لإدارة تدفقات عمل التعلم الآلي على نطاق واسع. وتلبي ميزاته قابلية التوسع والتكامل والحوكمة وإدارة التكاليف، مما يضمن قدرة الشركات على العمل بكفاءة.

تم تصميم Prompts.ai لتنمو جنبًا إلى جنب مع احتياجاتك. تسمح مساحات العمل الديناميكية والأدوات التعاونية للفرق بتجميع الموارد بفعالية، بدعم من نظام ائتمان TOKN المرن للدفع أولاً بأول. بفضل بنيتها متعددة المستأجرين، يمكن لفرق علوم البيانات ومهندسي التعلم الآلي ومحترفي التحليلات إجراء تجارب وخطوط أنابيب متزامنة عبر مجموعات بيانات كبيرة دون تباطؤ الأداء.

تتكامل المنصة بسلاسة مع البنى التحتية الحالية للبيانات، وتدعم عمليات سير عمل RAG وتكوينات قاعدة بيانات المتجهات لتمكين خطوط أنابيب التعلم الآلي من البداية إلى النهاية. من خلال ربط عمليات التعلم الآلي التقليدية بقدرات نماذج اللغات الكبيرة الحديثة، تعمل Prompts.ai على تمكين الفرق من التعامل مع كميات هائلة من البيانات مع الحفاظ على اتصالات آمنة بأنظمتها الحالية. يضمن هذا النهج إمكانية إدارة بيئات البيانات المتنوعة بكفاءة.

يقع الأمان والامتثال في صميم Prompts.ai. وهي تتوافق مع معايير الصناعة مثل SOC 2 Type II و HIPAA و GDPR لحماية البيانات الحساسة، مما يجعلها ذات قيمة خاصة لصناعات مثل الرعاية الصحية والتمويل. بدأت المنصة عملية تدقيق SOC 2 Type II في 19 يونيو 2025، وتقدم مركز ثقة عام في https://trust.prompts.ai/ حيث يمكن للمستخدمين الوصول إلى تحديثات في الوقت الفعلي حول حالة الأمان والامتثال. يتم تضمين ميزات مثل مراقبة الامتثال وأدوات الحوكمة في خطط الأعمال، مما يضمن الإشراف الشامل.

تقدم Prompts.ai نظام ائتمان TOKN للدفع أولاً بأول، مبتعدًا عن الترخيص التقليدي لكل مقعد. تتضمن خيارات التسعير الخاصة بها فئة استكشافية بقيمة 0 دولار وخطط عمل تتراوح من 99 دولارًا إلى 129 دولارًا لكل عضو شهريًا. باستخدام أدوات FinOps في الوقت الفعلي، يمكن للمستخدمين مراقبة استخدام الرموز وتحسين الإنفاق، مما يضمن توافق تكاليف الذكاء الاصطناعي مع أهداف العمل. تساعد هذه الشفافية الشركات على تقليل النفقات الإجمالية مع تعظيم القيمة.

تجلب كل أداة نقاط القوة والتحديات الخاصة بها عندما يتعلق الأمر بقابلية التوسع والتكامل مع البيانات الضخمة وأنظمة الذكاء الاصطناعي وإدارة دورة حياة التعلم الآلي والحوكمة وكفاءة التكلفة. دعونا نحلل النقاط البارزة الرئيسية:

تدفق هواء أباتشي تتميز بقابليتها للتطوير، وذلك بفضل تصميمها المعياري وجدولتها الفعالة التي يمكنها التعامل مع آلاف المهام المتزامنة في بيئات الإنتاج. يتكامل بسلاسة مع الأنظمة الموزعة مثل Hadoop و Spark و Kubernetes، إلى جانب المنصات السحابية الرئيسية مثل AWS و GCP و Azure. ومع ذلك، قد يؤدي منحنى التعلم الحاد والإعداد المعقد إلى إبطاء التبني، خاصة بالنسبة للفرق الصغيرة.

كيوبيفلو يستفيد من إطار Kubernetes الأصلي الخاص به لتوفير قابلية التوسع السحابية الأصلية. ومع ذلك، لإطلاق العنان لإمكاناتها الكاملة، تحتاج الفرق إلى خبرة سابقة مع Kubernetes والبنية التحتية اللازمة لدعمها.

حاكم يبسط عملية النشر من خلال منهجه الحديث الذي يعتمد على Python أولاً، مما يسمح للفرق بتحقيق نتائج أسرع بأقل تعقيد. هذا يجعله خيارًا شائعًا للفرق سريعة النمو التي تبحث عن تنفيذ أسرع.

فلايت و إم إل ران ركز على قابلية التكرار عبر دورة حياة ML. بينما تتفوق كلتا الأداتين في هذا المجال، فإن أنظمتها البيئية ليست واسعة مثل Apache Airflow، التي لديها قاعدة مستخدمين أكثر رسوخًا.

Prompts.ai يتخذ نهجًا مختلفًا من خلال التركيز على تنسيق الذكاء الاصطناعي بدلاً من خطوط أنابيب ML التقليدية. يوفر وصولاً موحدًا إلى أكثر من 35 نموذجًا رائدًا للغات الكبيرة من خلال واجهة آمنة ويتضمن عناصر تحكم FinOps المضمنة لإدارة التكاليف. يلغي نظام TOKN للدفع أولاً بأول رسوم المقعد، ويضمن امتثاله لـ SOC 2 Type II و HIPAA و GDPR أنه يلبي احتياجات الحوكمة للصناعات المنظمة.

فيما يلي مقارنة سريعة لهذه الأدوات استنادًا إلى المقاييس الرئيسية:

تعتمد الأداة المناسبة بشكل كبير على البنية التحتية الحالية لفريقك وخبرته واحتياجاته الخاصة. قد تجد الفرق التي تتمتع بمهارات Kubernetes القوية أن Kubeflow أو Flyte أكثر ملاءمة، في حين أن أولئك الذين يبحثون عن البساطة والنشر الأسرع قد يميلون إلى Prefect. بالنسبة للمؤسسات التي تعطي الأولوية للحوكمة وإدارة التكاليف والوصول الموحد إلى نموذج الذكاء الاصطناعي، Prompts.ai تقدم حلاً متميزًا بتصميمها القائم على الامتثال وهيكل التكلفة الشفاف.

يتوقف اختيار برنامج تنسيق التعلم الآلي المناسب على مواءمته مع خبرة فريقك والبنية التحتية الحالية وأولويات العمل. تدفق هواء أباتشي لا يزال منافسًا قويًا لتنسيق سير العمل العام، مما يوفر قابلية تطوير مثبتة عبر منصات مثل Hadoop و Spark ومقدمي الخدمات السحابية الرئيسيين. تقوم بنيتها المعيارية بإدارة آلاف المهام بكفاءة في وقت واحد، على الرغم من أنها تتطلب مجهودًا كبيرًا في الإعداد.

تلعب الحوكمة والامتثال أيضًا دورًا محوريًا، خاصة في الصناعات المنظمة. تعد الميزات مثل عناصر التحكم في الوصول القائمة على الأدوار وتسجيل التدقيق وتتبع نسب البيانات ضرورية لتلبية معايير مثل GDPR و HIPAA. ومع ذلك، غالبًا ما يتطلب تنفيذ هذه القدرات استثمارات كبيرة في البنية التحتية والصيانة المستمرة.

للشركات التي تتخذ من الولايات المتحدة مقراً لها والتي تستفيد البنية التحتية القائمة على Kubernetes، توفر أدوات مثل Kubeflow و Flyte قابلية تطوير قوية للسحابة الأصلية مع دعم قوي لإدارة دورة حياة ML. بينما يتكامل كلاهما بسلاسة مع تنسيق الحاوية، إلا أنهما يتطلبان فهمًا قويًا لـ Kubernetes. بالنسبة للفرق التي تفتقر إلى هذه الخبرة، تقدم Prefect عملية نشر أكثر وضوحًا.

للمؤسسات التي تركز على المشاريع القائمة على LLM وتنسيق الذكاء الاصطناعي، Prompts.ai تبرز. إنه يبسط الوصول إلى أكثر من 35 نموذجًا لغويًا مع مواجهة تحديات الحوكمة من خلال الامتثال لـ SOC 2 Type II و HIPAA و GDPR. يضمن نظام TOKN الائتماني للدفع أولاً بأول شفافية التكلفة، وإلغاء رسوم الترخيص لكل مقعد - وهي فائدة واضحة للشركات الأمريكية التي تتطلع إلى موازنة قابلية التوسع مع قيود الميزانية.

في النهاية، يعتمد قرارك على ما إذا كانت أولوياتك تكمن في تدفقات عمل ML التقليدية أو تنسيق الذكاء الاصطناعي الحديث. من خلال موازنة احتياجاتك مع المعايير الرئيسية - قابلية التوسع والتكامل وتغطية دورة الحياة والحوكمة وكفاءة التكلفة - يمكنك اتخاذ قرار مستنير. تتوافق خطوط أنابيب ML المنشأة جيدًا مع أدوات التنسيق التقليدية، بينما Prompts.ai مناسب تمامًا لعمليات الذكاء الاصطناعي الموحدة التي تركز على LLM.

عند اختيار أداة تنسيق ML للبيانات الضخمة، من الضروري تحديد الأولويات التوافق مع مجموعة التكنولوجيا الحالية الخاصة بك. يمكن للأداة التي تتكامل بسلاسة مع أنظمتك الحالية توفير الوقت والموارد وتقليل المضاعفات غير الضرورية.

فكر في الأدوات القابلية للتطوير - هل يمكنها التعامل مع أحجام البيانات المتزايدة وسير العمل الأكثر تعقيدًا مع نمو احتياجاتك؟ من المهم بنفس القدر التفكير في سهولة الاستخدام لفريقك. يمكن للأداة سهلة الاستخدام التي تتوافق مع مستوى مهارة فريقك أن تقلل بشكل كبير الوقت المستغرق في التدريب والإعداد.

بالإضافة إلى ذلك، قوية ميزات المراقبة والأتمتة ضرورية لتبسيط إدارة سير العمل وضمان أداء يمكن الاعتماد عليه. أخيرًا، قم بتقييم ما إذا كانت الأداة تتوافق مع الخطط طويلة الأجل لمؤسستك، مثل اعتماد تقنيات جديدة أو الانتقال إلى السحابة.

تلعب الحوكمة والامتثال دورًا رئيسيًا في اختيار برامج تنسيق التعلم الآلي، حيث يضمنان توافق سير العمل مع كل من المتطلبات القانونية والمعايير الداخلية. عرض الأدوات نسب البيانات، مسارات التدقيق، و ضوابط أمنية قوية المساعدة في حماية سلامة بياناتك مع الحفاظ على الامتثال التنظيمي.

في سياق عمليات سير عمل البيانات الضخمة، يضمن الامتثال إدارة المعلومات الحساسة بمسؤولية وشفافية. تعمل الحوكمة الفعالة على تقليل المخاطر وتعزيز الثقة في عمليات التعلم الآلي الخاصة بك، مما يمهد الطريق للتوسع السلس مع الالتزام بإرشادات الصناعة.

تتأثر تكلفة استخدام برامج تنسيق التعلم الآلي بالعديد من العوامل الرئيسية، بما في ذلك متطلبات البنية التحتية، مقياس التشغيل، و متطلبات الدعم. على سبيل المثال، منصات مثل Kubeflow و ميتافلو غالبًا ما تؤدي إلى ارتفاع تكاليف البنية التحتية بسبب عمليات النشر المعقدة. من ناحية أخرى، يمكن أن تساعد الحلول مفتوحة المصدر مثل Apache Airflow و Prefect في خفض نفقات الترخيص ولكنها قد تتطلب موارد داخلية إضافية للإعداد والصيانة المستمرة.

في النهاية، ستعتمد التكلفة الإجمالية على احتياجاتك الخاصة. تلعب المتغيرات مثل حجم عمليات سير عمل البيانات ودرجة الأتمتة التي تهدف إلى تحقيقها وما إذا كنت تحتاج إلى دعم على مستوى المؤسسة أو عمليات تكامل مخصصة دورًا مهمًا في تحديد النفقات الإجمالية.