La administración de flujos de trabajo de aprendizaje automático a gran escala requiere herramientas de orquestación especializadas que garanticen operaciones fluidas, control de costos y cumplimiento. Ya sea que se trate de terabytes de datos, impartiendo formación distribuida en Kubernetes, o para navegar por entornos multinube, es fundamental elegir la plataforma adecuada. Esta es una descripción general rápida de las seis opciones principales:

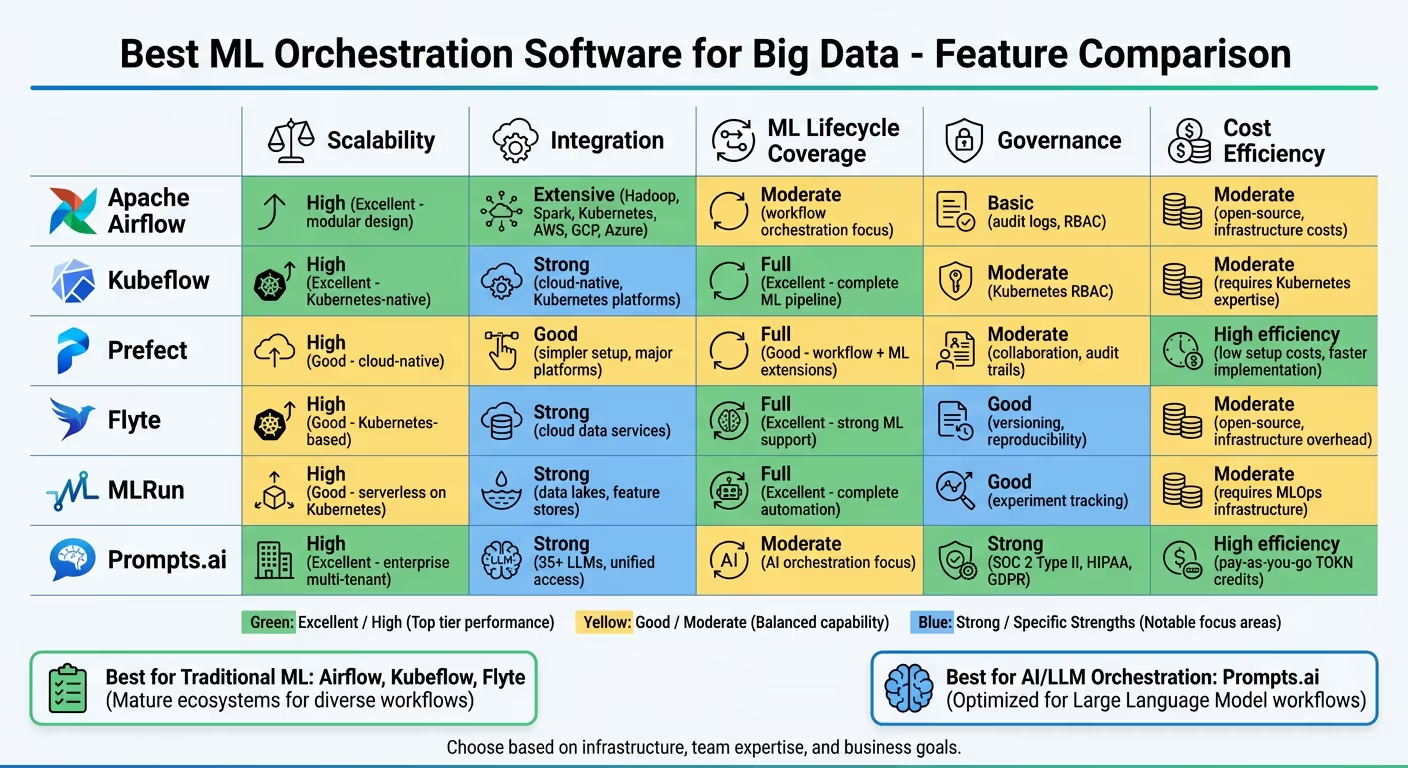

Cada herramienta se evalúa en función de la escalabilidad, la integración, la cobertura del ciclo de vida, la gobernanza y la rentabilidad. Para los equipos que priorizan los flujos de trabajo tradicionales de aprendizaje automático, las herramientas como Airflow, Kubeflow o Flyte pueden ser las más adecuadas. Para aquellos que se centran en la orquestación de la IA y los LLM, Prompts.ai ofrece una gobernanza y una transparencia de costes incomparables.

La elección correcta depende de la infraestructura, la experiencia del equipo y los objetivos empresariales. Profundice en cada herramienta para encontrar la que mejor se adapte a sus necesidades.

Comparación de herramientas de orquestación de aprendizaje automático: funciones, escalabilidad y análisis de costos

Apache Airflow es una plataforma de orquestación de código abierto basada en Python, diseñada para administrar los flujos de trabajo a través de gráficos acíclicos dirigidos (DAG). Creada inicialmente en Airbnb y ahora mantenido por el Fundación Apache Software, ha obtenido una adopción generalizada, especialmente entre los equipos de ingeniería de datos. Si bien no está diseñada específicamente para el aprendizaje automático (ML), su flexibilidad la convierte en una opción práctica para gestionar los flujos de trabajo de aprendizaje automático en entornos de datos a gran escala, especialmente para los equipos que ya dominan la herramienta. Proporciona un marco fiable para organizar y gestionar los flujos de trabajo, incluso en entornos complejos de big data.

El diseño modular de Airflow le permite escalar de manera eficaz. Al distribuir las tareas entre los trabajadores sin dejar de respetar las dependencias especificadas, garantiza que los flujos de trabajo puedan ampliarse a medida que aumentan las demandas de procesamiento de datos. Por ejemplo, Netflix confía en Airflow para administrar y programar miles de tareas en sus canalizaciones de datos, manteniendo operaciones fluidas. Dicho esto, Airflow sobresale en entornos con flujos de trabajo relativamente estables y es posible que no funcione de manera tan eficiente en configuraciones altamente dinámicas.

Airflow destaca por su capacidad para integrarse con varios sistemas de big data, lo que lo convierte en una herramienta versátil para diversos ecosistemas. Ofrece numerosos operadores que se conectan con plataformas como Hadoop, Spark y Kubernetes. Por ejemplo, Sabio, una empresa de tecnología financiera, aprovecha Airflow para volver a capacitar los flujos de trabajo de aprendizaje automático en Amazon SageMaker, lo que contribuye a la supervisión de las transacciones en tiempo real y a los procesos de conocimiento del cliente (KYC). Además, servicios gestionados como Google Cloud Composer y Astrónomo simplifique el escalado y la transición de entornos locales a entornos basados en la nube.

El enfoque programático basado en Python de Airflow permite a los equipos organizar varias etapas del ciclo de vida del aprendizaje automático, desde el preprocesamiento de datos hasta el entrenamiento y la implementación de modelos. Su capacidad para generar canalizaciones de forma dinámica permite a los usuarios crear y programar flujos de trabajo complejos en función de parámetros específicos. Sin embargo, la configuración de Airflow puede presentar desafíos moderados para DevOps y puede carecer de algunas de las capacidades específicas de aprendizaje automático que se encuentran en las plataformas diseñadas exclusivamente para el aprendizaje automático.

Airflow incluye una interfaz web fácil de usar para monitorear el progreso del oleoducto y resolver problemas. Su estructura de DAG no solo organiza los flujos de trabajo, sino que también hace un seguimiento de las versiones, lo que facilita la colaboración y mantiene los registros de auditoría. Esta función es especialmente valiosa para sectores como el financiero y el sanitario, donde el cumplimiento de las normativas y la existencia de datos claros son fundamentales para gestionar los flujos de trabajo de aprendizaje automático en entornos de big data.

Como plataforma de código abierto, Apache Airflow requiere que los usuarios cubran solo los costos de infraestructura, ya sea que se implemente en las instalaciones o en la nube. Si bien los servicios gestionados, como Cloud Composer y Astronomer, conllevan gastos adicionales, también reducen la carga del mantenimiento, el escalado y las actualizaciones. Para los equipos que ya tienen experiencia con Airflow a través de proyectos de ingeniería de datos, la curva de aprendizaje es mínima, lo que reduce aún más los costos indirectos.

Kubeflow es un conjunto de herramientas de código abierto diseñado para simplificar la implementación, la supervisión y la administración de los flujos de trabajo de aprendizaje automático en Kubernetes. Diseñado para los equipos que utilizan Kubernetes para gestionar operaciones de aprendizaje automático a gran escala, Kubeflow se diferencia de las herramientas de orquestación de uso general al centrarse exclusivamente en las necesidades únicas del ciclo de vida del aprendizaje automático. Este enfoque especializado lo hace ideal para optimizar los flujos de trabajo en entornos que manejan conjuntos de datos masivos.

Basado en la escalabilidad nativa de Kubernetes, Kubeflow gestiona de manera eficiente las cargas de trabajo de aprendizaje automático en sistemas distribuidos. Su marco en contenedores permite a los equipos implementar canalizaciones que ajustan los recursos de forma dinámica en función de las demandas de procesamiento, una característica fundamental a la hora de entrenar modelos con conjuntos de datos extensos. Kubeflow también se integra perfectamente con los principales proveedores de nube, como AWS, Google Cloud Platform, y Microsoft Azure. Esta compatibilidad con múltiples nubes ofrece a las empresas la capacidad de gestionar operaciones de datos a gran escala con una asignación flexible de recursos, lo que la convierte en una herramienta potente para configuraciones híbridas o multinube.

La integración de Kubeflow con Kubernetes le permite adaptarse sin problemas a los ecosistemas de ingeniería de datos existentes. Por ejemplo, funciona junto con los sistemas de flujo de trabajo más populares, como Airflow, lo que permite a las organizaciones mejorar sus capacidades de organización del aprendizaje automático sin tener que revisar su infraestructura. Su diseño nativo de la nube garantiza la portabilidad, lo que lo hace adaptable a diferentes entornos y, al mismo tiempo, mantiene la eficiencia.

Kubeflow cubre todas las etapas del ciclo de vida del aprendizaje automático, desde el entrenamiento y las pruebas hasta la implementación, el control de versiones de modelos y el ajuste de hiperparámetros. La plataforma proporciona contenedores preconfigurados, que ofrecen una forma estandarizada de implementar canalizaciones de aprendizaje automático en Kubernetes. Como Domo notas:

Al estandarizar la forma en que se implementan y sirven las canalizaciones de aprendizaje automático, Kubeflow garantiza que los equipos puedan innovar rápidamente sin tener que reinventar la rueda.

Además, Kubeflow democratiza el acceso a herramientas avanzadas de aprendizaje automático, lo que permite a los ingenieros y científicos de todos los equipos crear, ejecutar y experimentar con modelos, lo que fomenta la colaboración y la innovación.

Si bien Kubeflow en sí es gratuito, se requiere un conocimiento sólido de Kubernetes para usarlo de manera efectiva. Para los equipos que ya utilizan clústeres de Kubernetes, los costos adicionales son mínimos. Sin embargo, los nuevos usuarios de Kubernetes pueden enfrentarse a una curva de aprendizaje pronunciada y a dificultades de integración, lo que podría conllevar un aumento de los gastos iniciales.

Prefect es un sistema moderno de gestión del flujo de trabajo diseñado para gestionar los complejos entornos e infraestructuras de datos actuales. A diferencia de las herramientas de orquestación más antiguas, Prefect prioriza la facilidad de uso y la resiliencia, por lo que es una opción popular para los equipos que gestionan cargas de trabajo impredecibles de big data. Monte Carlo Data incluso la ha denominado «Airflow, pero más agradable» debido a su interfaz intuitiva, su proceso de configuración simplificado y su menor complejidad.

Prefect destaca por su capacidad de escalar sin problemas. Puede gestionar millones de flujos de trabajo y ofrece un nivel de escalabilidad adecuado para las necesidades empresariales. La plataforma está disponible en dos versiones: Núcleo perfecto, una opción de código abierto, y Nube perfecta, una solución totalmente alojada. Esta flexibilidad permite a los equipos empezar de a poco y expandirse a medida que aumentan sus requisitos de datos. Prefect Cloud ofrece funciones adicionales, como las mejoras de rendimiento y la supervisión de los agentes, que son esenciales para gestionar los flujos de trabajo que procesan grandes conjuntos de datos en sistemas distribuidos. Su modelo de ejecución híbrido refuerza aún más su adaptabilidad al permitir que las tareas se ejecuten de forma segura en entornos locales, en la nube o híbridos, lo que resulta perfecto para los flujos de trabajo de macrodatos y aprendizaje automático.

Prefect mejora las canalizaciones de datos mediante la incorporación de funciones críticas como los reintentos, el registro, el mapeo dinámico, el almacenamiento en caché y las alertas de error. El mapeo dinámico, en particular, tiene un valor incalculable para gestionar volúmenes de datos fluctuantes y permitir el procesamiento paralelo. La plataforma también se integra perfectamente con herramientas como Lago Fs, lo que permite el control de versiones de datos empaquetando las llamadas a la API en PythonOperators o tareas personalizadas. Esta funcionalidad garantiza un control de versiones eficiente para conjuntos de datos a gran escala.

Prefect va más allá de la gestión tradicional de canalizaciones de datos para respaldar todo el ciclo de vida del aprendizaje automático. La introducción de Marvin AI - un marco para crear modelos, clasificadores y aplicaciones de IA utilizando interfaces de lenguaje natural - amplía sus capacidades de manera significativa. Además, su función de reintento automático protege la integridad del flujo de trabajo y garantiza un funcionamiento fluido durante todo el ciclo de vida del aprendizaje automático.

Prefect Core es gratuito y de código abierto, lo que lo convierte en una opción accesible para los desarrolladores que trabajan con flujos de trabajo de big data. Para los equipos que buscan capacidades mejoradas, Prefect Cloud ofrece un backend de pago totalmente alojado con funciones como permisos, administración de equipos y acuerdos de nivel de servicio (SLA). Los precios de Prefect Cloud varían según el uso. Con su configuración sencilla y su diseño fácil de usar, Prefect es una excelente opción para los equipos que buscan ahorrar tiempo y recursos al implementar herramientas de orquestación.

Flyte es una plataforma de orquestación nativa de Kubernetes desarrollada inicialmente por Lyft para gestionar cargas de trabajo de aprendizaje automático a gran escala en producción. En la actualidad, impulsa los flujos de trabajo de más de 3000 equipos y grandes empresas, como Google y Airbnb, confían en ella para escalar los modelos de aprendizaje automático en todos los centros de datos.

El diseño de Flyte permite un escalado dinámico, lo que elimina los costos inactivos al ajustar los recursos según la demanda. Admite el escalado horizontal y vertical, lo que permite ajustar los recursos directamente desde el código durante el tiempo de ejecución. Con funciones integradas como los reintentos automáticos, los puntos de control y la recuperación de errores, Flyte garantiza la fiabilidad y reduce la necesidad de correcciones manuales. Este marco escalable también se integra perfectamente con los sistemas de big data.

La arquitectura de Flyte está optimizada para flujos de trabajo altamente simultáneos y fáciles de mantener, lo que la hace ideal para tareas de procesamiento de datos y aprendizaje automático. Los equipos pueden implementar repositorios independientes sin interrumpir la funcionalidad de la plataforma. Esta configuración evita la fragmentación de las herramientas en las pilas de datos, aprendizaje automático y análisis, al tiempo que centraliza la gestión del flujo de trabajo a gran escala.

Flyte proporciona una gestión integral del flujo de trabajo para desarrollar, implementar y perfeccionar los sistemas de AI/ML en una sola plataforma. Su SDK de Python admite el preprocesamiento de datos para los flujos de trabajo de ETL. Para el entrenamiento de modelos, Flyte facilita los flujos de trabajo distribuidos y se integra perfectamente con marcos como TensorFlow y PyTorch.

La versión de código abierto de Flyte es gratuita, por lo que es accesible para equipos de todos los tamaños. Para aquellos que necesitan funciones avanzadas, Union Enterprise ofrece una versión gestionada de Flyte con opciones de precios personalizadas. Jeev Balakrishnan, de Freenome, describe a Flyte como «un caballo de batalla» y destaca su fiabilidad y eficacia. Esta flexibilidad de costes refuerza la posición de Flyte como una solución fiable para flujos de trabajo de aprendizaje automático a gran escala y listos para la producción.

MLRun es una plataforma de código abierto diseñada para gestionar todo el ciclo de vida del aprendizaje automático a escala. Su arquitectura elástica y sin servidor la hace especialmente útil para los equipos que trabajan con operaciones de datos a gran escala.

Con su capacidad para soportar millones de ejecuciones, MLRun elimina la necesidad de administrar manualmente la infraestructura mediante un escalado elástico. Este diseño sin servidor permite a los equipos centrarse en desarrollar modelos mientras la plataforma transforma su código en flujos de trabajo listos para la producción.

El marco de MLRun se integra sin esfuerzo con varios sistemas de datos, lo que lo convierte en una opción sólida para gestionar grandes volúmenes de datos. Incluye un almacén de funciones y artefactos para gestionar la ingesta, el procesamiento, los metadatos y el almacenamiento de datos en múltiples repositorios y tecnologías. Esta centralización es fundamental para las operaciones de big data. La plataforma admite una variedad de sistemas de almacenamiento, entre los que se incluyen S3, Artifativo, Sistema operativo en la nube de Alibaba, HTTP, Git y GCS, que ofrece flexibilidad en las opciones de infraestructura. Además, su capa de abstracción se conecta perfectamente con una amplia gama de herramientas y complementos de aprendizaje automático, lo que garantiza la compatibilidad con los marcos de big data establecidos.

MLRun va más allá de la escalabilidad y la integración al cubrir todo el proceso de aprendizaje automático, desde el desarrollo inicial hasta la implementación. Optimiza procesos como los experimentos automatizados, el entrenamiento de modelos, las pruebas y las implementaciones en canalización en tiempo real, manteniendo la coherencia en todas las etapas del ciclo de vida del aprendizaje automático.

Como plataforma de código abierto, MLRun es de uso gratuito, lo que la convierte en una opción económica para organizaciones de todos los tamaños. Esta estructura de costos permite a los equipos asignar más recursos a la infraestructura y al talento en lugar de pagar costosas licencias, lo que es especialmente beneficioso para las empresas emergentes y los grupos centrados en la investigación.

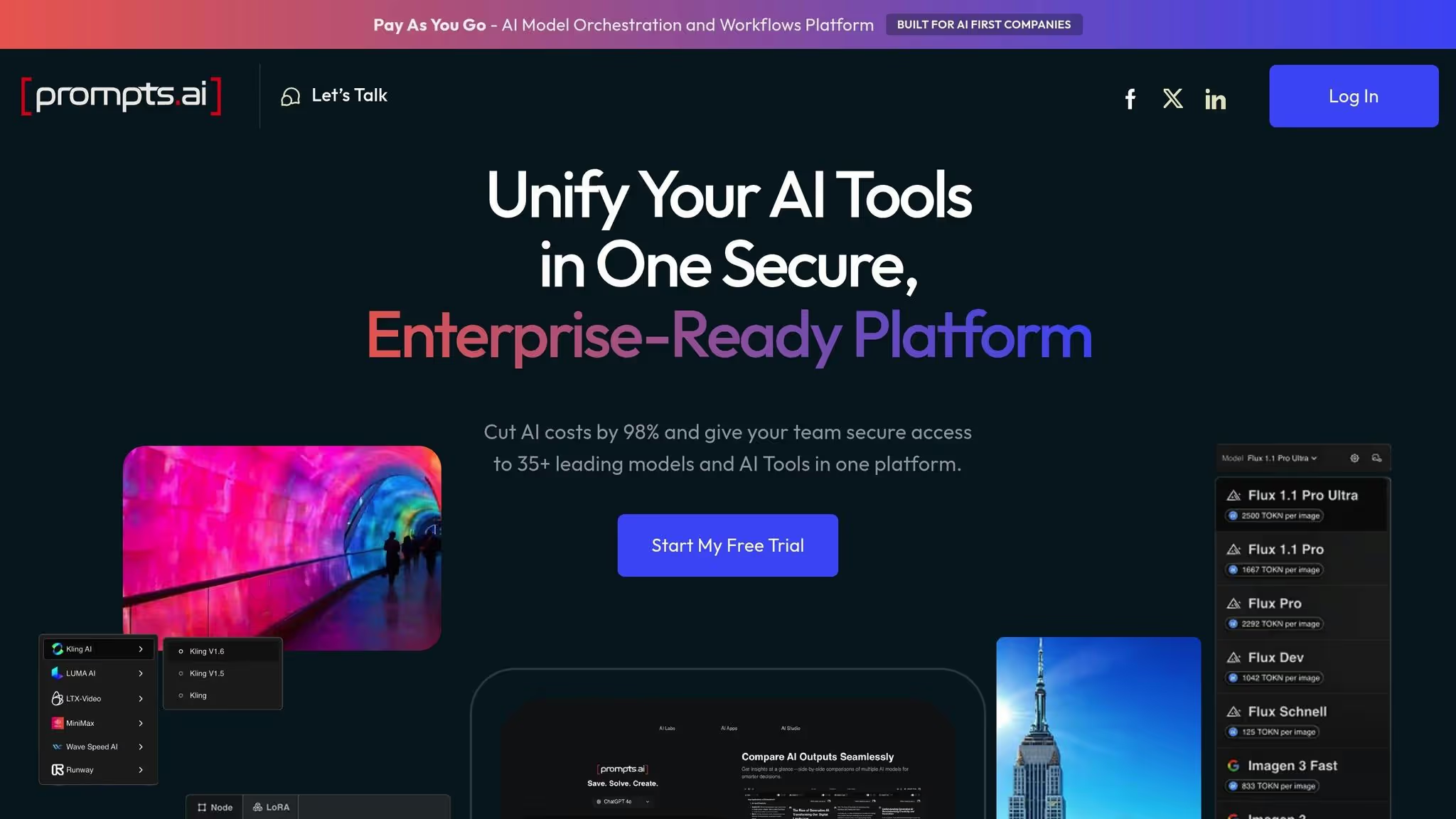

Prompts.ai es una potente plataforma empresarial diseñada para agilizar la orquestación de la IA. Reúne el acceso a más de 35 modelos lingüísticos de gran tamaño líderes, como GPT-5, Claudio, Llama, y Géminis, todo dentro de una interfaz única y segura. A diferencia de otras herramientas, Prompts.ai hace hincapié en una gobernanza sólida, una gestión precisa de los costes y un acceso sin problemas a los modelos de IA modernos, lo que la convierte en una opción fiable para gestionar los flujos de trabajo de aprendizaje automático a escala. Sus funciones se centran en la escalabilidad, la integración, la gobernanza y la gestión de costos, lo que garantiza que las empresas puedan operar de manera eficiente.

Prompts.ai está diseñado para crecer junto con sus necesidades. Sus espacios de trabajo dinámicos y sus herramientas colaborativas permiten a los equipos aunar recursos de manera eficaz, con el respaldo de un sistema de crédito TOKN flexible de pago por uso. Gracias a su arquitectura multiusuario, los equipos de ciencia de datos, los ingenieros de aprendizaje automático y los profesionales del análisis pueden ejecutar experimentos y canalizaciones simultáneos en grandes conjuntos de datos sin ralentizar el rendimiento.

La plataforma se integra a la perfección con las infraestructuras de datos existentes y admite los flujos de trabajo RAG y las configuraciones de bases de datos vectoriales para permitir canalizaciones de aprendizaje automático de extremo a extremo. Al combinar los procesos tradicionales de aprendizaje automático con las capacidades modernas de los modelos lingüísticos de gran tamaño, Prompts.ai permite a los equipos gestionar grandes cantidades de datos y, al mismo tiempo, mantener conexiones seguras con sus sistemas existentes. Este enfoque garantiza que los diversos entornos de datos se puedan administrar de manera eficiente.

La seguridad y el cumplimiento son la base de Prompts.ai. Se alinea con los estándares del sector, como el SOC 2 de tipo II, la HIPAA y el RGPD, para proteger los datos confidenciales, lo que los hace especialmente valiosos para sectores como el sanitario y el financiero. La plataforma comenzó su proceso de auditoría del SOC 2 de tipo II el 19 de junio de 2025 y ofrece un centro de confianza público en https://trust.prompts.ai/ donde los usuarios pueden acceder a actualizaciones en tiempo real sobre su estado de seguridad y cumplimiento. Sus planes empresariales incluyen funciones como la supervisión del cumplimiento y las herramientas de gobernanza, lo que garantiza una supervisión integral.

Prompts.ai presenta un sistema de crédito TOKN de pago por uso, que se aleja de las licencias tradicionales por puesto. Sus opciones de precios incluyen un nivel exploratorio de 0 dólares y planes empresariales que oscilan entre 99 y 129 dólares por miembro y mes. Con las herramientas de FinOps en tiempo real, los usuarios pueden supervisar el uso de los tokens y optimizar los gastos, garantizando que los costes de la IA se alineen con los objetivos empresariales. Esta transparencia ayuda a las empresas a reducir los gastos generales y, al mismo tiempo, a maximizar el valor.

Cada herramienta aporta sus propios puntos fuertes y desafíos en lo que respecta a la escalabilidad, la integración con sistemas de big data e IA, la gestión del ciclo de vida del aprendizaje automático, la gobernanza y la rentabilidad. Analicemos los aspectos más destacados:

Flujo de aire Apache destaca por su escalabilidad, gracias a su diseño modular y a su eficiente planificador que puede gestionar miles de tareas simultáneas en entornos de producción. Se integra perfectamente con sistemas distribuidos como Hadoop, Spark y Kubernetes, junto con las principales plataformas en la nube, como AWS, GCP y Azure. Sin embargo, su pronunciada curva de aprendizaje y su compleja configuración pueden retrasar su adopción, especialmente para los equipos más pequeños.

Kubeflow aprovecha su marco nativo de Kubernetes para ofrecer escalabilidad nativa de la nube. Sin embargo, para aprovechar todo su potencial, los equipos necesitan experiencia previa con Kubernetes y la infraestructura necesaria para respaldarlo.

Prefecto simplifica la implementación con su enfoque moderno centrado en Python, lo que permite a los equipos lograr resultados más rápidos con menos complejidad. Esto lo convierte en una opción popular para los equipos en rápido crecimiento que buscan una implementación más rápida.

Flyte y MLRun centrarse en la reproducibilidad a lo largo del ciclo de vida del aprendizaje automático. Si bien ambas herramientas destacan en esta área, sus ecosistemas no son tan extensos como los de Apache Airflow, que tiene una base de usuarios más consolidada.

Prompts.ai adopta un enfoque diferente al centrarse en la orquestación de la IA en lugar de en los canales de aprendizaje automático tradicionales. Ofrece acceso unificado a más de 35 modelos lingüísticos de gran tamaño líderes a través de una interfaz segura e incluye controles FinOps integrados para la gestión de costos. Su sistema TOKN de pago por uso elimina las tarifas por puesto, y su cumplimiento con el SOC 2 de tipo II, la HIPAA y el RGPD garantiza que satisface las necesidades de gobernanza de los sectores regulados.

Esta es una comparación rápida de estas herramientas en función de las métricas clave:

La herramienta adecuada depende en gran medida de la infraestructura, la experiencia y las necesidades específicas existentes de su equipo. Los equipos con conocimientos sólidos de Kubernetes pueden considerar que Kubeflow o Flyte son más adecuados, mientras que aquellos que buscan simplicidad y una implementación más rápida pueden optar por Prefect. Para las empresas que priorizan la gobernanza, la gestión de costes y el acceso unificado al modelo de IA, Prompts.ai ofrece una solución sobresaliente con su diseño orientado al cumplimiento y una estructura de costos transparente.

La elección del software de orquestación de aprendizaje automático adecuado depende de alinearlo con la experiencia de su equipo, la infraestructura existente y las prioridades empresariales. Flujo de aire Apache sigue siendo un fuerte competidor para la orquestación general del flujo de trabajo, ya que ofrece una escalabilidad comprobada en plataformas como Hadoop, Spark y los principales proveedores de nube. Su arquitectura modular gestiona de forma eficiente miles de tareas de forma simultánea, aunque requiere un importante esfuerzo de configuración.

La gobernanza y el cumplimiento también desempeñan un papel fundamental, especialmente en las industrias reguladas. Funciones como los controles de acceso basados en roles, el registro de auditorías y el seguimiento del linaje de datos son esenciales para cumplir con estándares como el GDPR y la HIPAA. Sin embargo, la implementación de estas capacidades a menudo exige inversiones considerables en infraestructura y un mantenimiento continuo.

Para empresas con sede en EE. UU. que aprovechan Infraestructura basada en Kubernetes, herramientas como Kubeflow y Flyte proporcionan una escalabilidad sólida y nativa de la nube con un sólido soporte para la administración del ciclo de vida del aprendizaje automático. Si bien ambas se integran perfectamente con la orquestación de contenedores, requieren un conocimiento sólido de Kubernetes. Para los equipos que carecen de esta experiencia, Prefect ofrece un proceso de implementación más sencillo.

Para empresas que se centran en Proyectos impulsados por LLM y orquestación de IA, Prompts.ai se destaca. Simplifica el acceso a más de 35 modelos lingüísticos y, al mismo tiempo, aborda los desafíos de gobernanza al cumplir con el SOC 2 de tipo II, la HIPAA y el RGPD. El sistema de crédito TOKN de pago por uso garantiza la transparencia de los costos y elimina las tarifas de licencia por puesto, una clara ventaja para las empresas estadounidenses que buscan equilibrar la escalabilidad con las restricciones presupuestarias.

En última instancia, su decisión depende de si sus prioridades radican en los flujos de trabajo de aprendizaje automático tradicionales o en la orquestación moderna de la IA. Si compara sus necesidades con criterios clave (escalabilidad, integración, cobertura del ciclo de vida, gobernanza y rentabilidad), puede tomar una decisión informada. Las canalizaciones de aprendizaje automático establecidas se alinean bien con las herramientas de orquestación tradicionales, al mismo tiempo Prompts.ai es una excelente opción para las operaciones de IA unificadas y centradas en la LLM.

Al elegir una herramienta de orquestación de aprendizaje automático para big data, es crucial priorizar compatibilidad con tu oferta tecnológica actual. Una herramienta que se integre sin problemas con sus sistemas actuales puede ahorrar tiempo y recursos y reducir las complicaciones innecesarias.

Piense en la herramienta escalabilidad - ¿puede gestionar volúmenes de datos cada vez mayores y flujos de trabajo más complejos a medida que aumentan sus necesidades? Es igualmente importante tener en cuenta la facilidad de uso para tu equipo. Una herramienta fácil de usar que se adapte al nivel de habilidad de tu equipo puede reducir significativamente el tiempo dedicado a la formación y la incorporación.

Además, robusto funciones de supervisión y automatización son esenciales para simplificar la gestión del flujo de trabajo y garantizar un rendimiento fiable. Por último, evalúe si la herramienta se ajusta a los planes a largo plazo de su organización, como la adopción de nuevas tecnologías o la transición a la nube.

La gobernanza y el cumplimiento desempeñan un papel clave a la hora de seleccionar el software de orquestación del aprendizaje automático, ya que garantizan que sus flujos de trabajo se ajusten tanto a los requisitos legales como a los estándares internos. Oferta de herramientas linaje de datos, registros de auditoría, y fuertes controles de seguridad ayude a proteger la integridad de sus datos y, al mismo tiempo, mantenga el cumplimiento normativo.

En el contexto de los flujos de trabajo de big data, el cumplimiento garantiza que la información confidencial se gestione de manera responsable y transparente. Una gobernanza eficaz minimiza los riesgos y fomenta la confianza en los procesos de aprendizaje automático, lo que allana el camino para una escalabilidad fluida y, al mismo tiempo, cumple con las directrices del sector.

El costo de utilizar un software de orquestación de aprendizaje automático se ve influenciado por varios factores clave, que incluyen demandas de infraestructura, escala de operación, y requisitos de soporte. Por ejemplo, plataformas como Kubeflow y Metaflow a menudo conducen a mayores costos de infraestructura debido a sus intrincados procesos de implementación. Por otro lado, las soluciones de código abierto, como Apache Airflow y Prefect, pueden ayudar a reducir los gastos de licencias, pero pueden requerir recursos internos adicionales para la configuración y el mantenimiento continuo.

En última instancia, el costo total dependerá de sus necesidades específicas. Variables como el tamaño de los flujos de trabajo de datos, el grado de automatización que pretendes lograr y si necesitas soporte de nivel empresarial o integraciones personalizadas desempeñan un papel importante a la hora de determinar el gasto total.