Les modèles de langage d'IA remodèlent les industries grâce à des outils qui favorisent l'automatisation et l'efficacité. Le choix du bon fournisseur dépend des besoins de votre entreprise. Voici un bref aperçu des trois meilleurs joueurs :

Chaque fournisseur possède des atouts uniques, qu'il s'agisse de la précision du codage ou des capacités multimodales. De nombreuses entreprises combinent plusieurs modèles pour des raisons de flexibilité et de performance.

Pour optimiser l'efficacité et réduire les coûts, pensez à des plateformes d'orchestration telles que Prompts.ai, qui unifient l'accès à plusieurs modèles sous une seule interface.

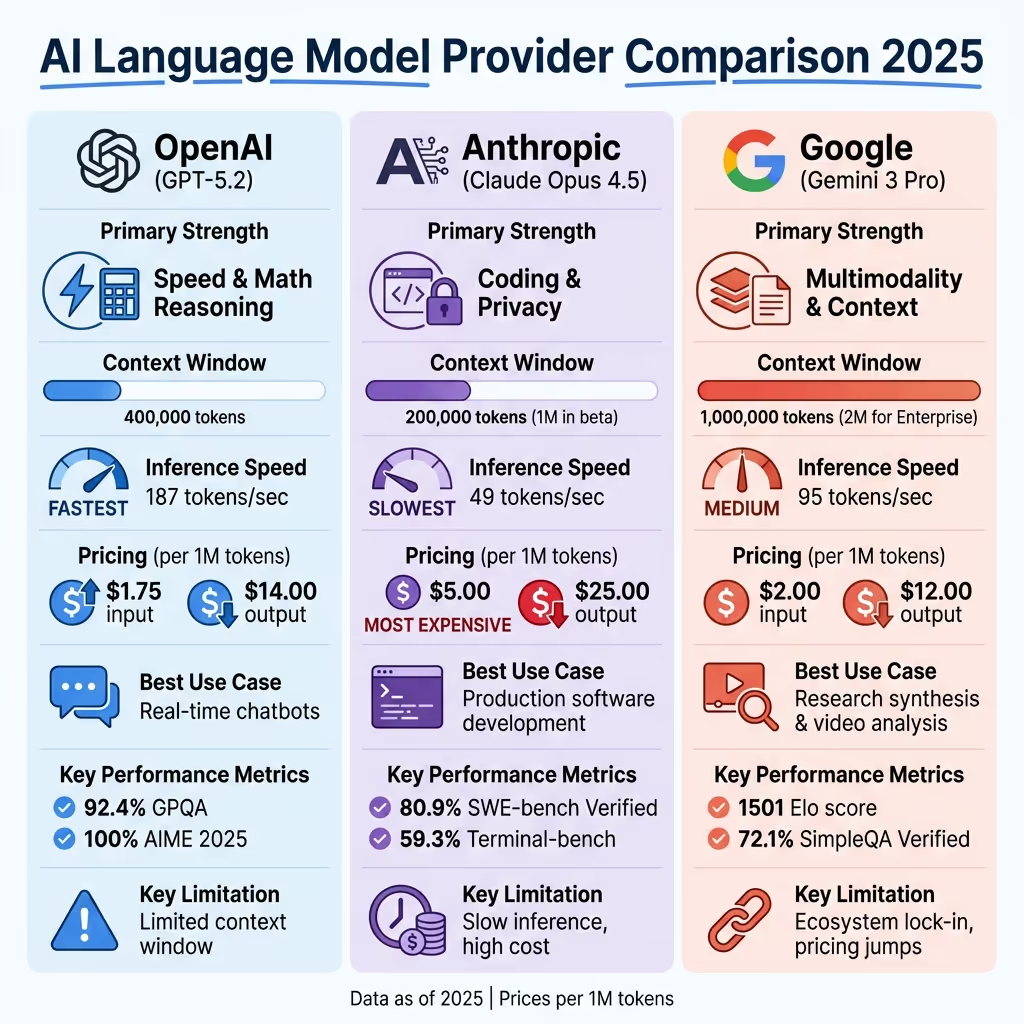

Comparaison des fournisseurs de modèles de langage d'IA : OpenAI vs Anthropic vs Google Gémeaux

OpenAI fournit un écosystème d'IA robuste construit autour de sa famille de modèles GPT. Parmi celles-ci, GPT-5.2 se distingue par ses performances exceptionnelles en matière de codage et de tâches agentiques, atteignant 92,4 % sur GPQA et 100 % sur AIME 2025. Pour les utilisateurs qui recherchent une vitesse et une précision accrues, une version « Pro » premium est également disponible.

Les capacités des modèles d'OpenAI sont impressionnantes. GPT-5 prend en charge un Fenêtre contextuelle de 400 000 jetons, ce qui le rend idéal pour analyser de grands ensembles de données tels que des bases de code complètes ou des documents juridiques complets. Entre-temps, GPT-4 fournit des réponses rapides en seulement 320 ms, permettant des interactions vocales naturelles et fluides.

Alexandr Frunza, développeur backend chez Index.dev, a déclaré : « OpenAI a créé GPT-4o pour gérer de vraies conversations... suffisamment rapidement pour que les utilisateurs ne remarquent pas le retard ».

OpenAI propose également des modèles spécialisés tels que o3-recherche approfondie, conçu pour des analyses avancées, et Sora 2, conçu pour un traitement vidéo de haute qualité avec audio synchronisé. Pour les tâches à volume élevé, GPT-5 mini est un choix économique, à un prix juste 0,25$ par million de jetons d'entrée. Zillow, par exemple, utilise l'API OpenAI Realtime pour effectuer des recherches vocales de logements et d'options de financement, permettant ainsi aux utilisateurs d'interagir naturellement avec leur plateforme.

OpenAI s'engage en faveur de la sécurité, en utilisant une approche à plusieurs niveaux qui inclut le filtrage des données, l'alignement via l'apprentissage par renforcement à partir du feedback humain (RLHF) et une équipe rouge rigoureuse. Lors du lancement de GPT-4, plus de 100 équipes externes ont été impliquées pour identifier et atténuer les risques. Les résultats sont clairs : GPT-4 est 82 % moins susceptible de répondre à un contenu interdit et 40 % plus susceptibles de fournir des informations factuelles par rapport à GPT-3.5.

Le Groupe consultatif sur la sécurité supervise les évaluations des modèles, en veillant à ce que seuls ceux ayant un score de risque « moyen » ou inférieur après atténuation soient rendus publics. OpenAI publie également des cartes système détaillées pour les versions majeures, décrivant les risques et les garanties potentiels. Pour les utilisateurs professionnels, la plateforme propose Conformité à la norme SOC 2 Type 2 et des politiques facultatives de conservation zéro des données pour une sécurité accrue.

Les API d'OpenAI sont conçues dans un souci de flexibilité, offrant des options RESTful, de streaming et en temps réel compatibles avec tout système prenant en charge les requêtes HTTP. Les SDK officiels pour Python, JavaScript et C# rationalisent les processus de développement, tandis que des outils tels que Kit de développement logiciel pour agents et Créateur d'agents simplifiez la création de flux de travail prêts pour la production.

Rayure a tiré parti du framework OpenAI Evals pour évaluer la précision de leur outil de documentation technique basé sur le GPT, en l'améliorant grâce à une supervision humaine.

Pour les entreprises, OpenAI propose des fonctionnalités telles que le SSO, le MFA et le RBAC. Dans les secteurs réglementés, les déploiements via Azure garantissez l'isolation du réseau virtuel et la conformité HIPAA via des contrats de partenariat commercial. Il est conseillé aux développeurs d'utiliser des versions de modèles épinglées (par exemple, gpt-4o-2024-08-06) pour maintenir un comportement cohérent dans les environnements de production.

Par rapport à des concurrents tels que Claude Opus 4.1, qui facture 15,00$ par million de jetons d'entrée et 75,00$ par million de jetons de sortie, GPT-5.1 s'avère environ 8 fois plus rentable. Pour les tâches qui ne sont pas urgentes, l'API Batch permet de réaliser des économies supplémentaires en permettant un traitement différé.

Ensuite, nous examinerons de plus près Anthropic Claude, qui propose un ensemble distinct de fonctionnalités dans le paysage de l'IA.

La famille Anthropic Claude propose une IA conversationnelle qui semble naturelle, évitant les sons robotiques. Son modèle phare, Claude Opus 4.5, a fait ses débuts en novembre 2025 et affiche un score d'intelligence impressionnant de 49. L'une de ses caractéristiques les plus remarquables est Mode de réflexion étendu, permettant un raisonnement détaillé étape par étape pour aborder des tâches analytiques complexes.

Claude Opus 4.5 brille dans le codage et les flux de travail autonomes, en gérant facilement les défis complexes du génie logiciel. Il a obtenu un score impressionnant de 80,9 % sur SWE-Bench Verified et prend en charge une fenêtre contextuelle standard de 200 000 jetons, avec des options au niveau de l'entreprise s'étendant jusqu'à un million de jetons [5,32].

« Claude Opus 4.5 est notre nouveau modèle de raisonnement hybride en langage large. Il est à la pointe de la technologie parmi les modèles de pointe en matière de tâches de codage logiciel et de tâches agentiques qui l'obligent à fonctionner de manière autonome pour le compte de l'utilisateur. » — Anthropic

Le modèle Artefacts cette fonctionnalité améliore la collaboration en affichant du code, des diagrammes et des aperçus de sites Web côte à côte, rationalisant ainsi l'itération [5,25]. En ce qui concerne les tâches basées sur les terminaux, Claude est en tête avec un score de 59,3 % sur Terminal-bench, surpassant son concurrent le plus proche d'environ 12 points. Les développeurs bénéficient également de l'outil Claude Code CLI, qui permet une interaction directe avec des bases de code complexes, consolidant ainsi sa réputation de puissance de codage.

Ces performances ont jeté les bases de ses mesures de sécurité robustes et de ses capacités d'intégration sans faille.

Claude se distingue par son approche axée sur la sécurité, qui s'appuie sur IA constitutionnelle pour s'assurer que les modèles restent utiles, honnêtes et inoffensifs. C'est Politique de dimensionnement responsable attribue des niveaux de sécurité à l'IA (ASL) sur la base d'évaluations des risques catastrophiques, Claude Opus 4.5 répondant à la stricte norme de sécurité ASL-3 [26,28].

Lors de tests de sécurité multilingues, le modèle a obtenu un taux de réponse inoffensif de 99,78 % pour les demandes non conformes dans des langues telles que l'arabe, le français, le coréen, le mandarin et le russe. Il a également fait preuve d'une sécurité agentique élevée, refusant 88,39 % des requêtes malveillantes liées à l'utilisation de l'ordinateur et bloquant avec succès 99,4 % des attaques par injection rapide lors de l'exécution de la commande bash.

Claude s'intègre parfaitement à des plateformes telles que Substrat rocheux d'Amazon, Google Vertex AI, et Microsoft Azure AI Foundry. C'est Protocole de contexte modèle (MCP) se connecte en toute sécurité à des sources de données externes tout en bloquant 94 % des attaques par injection rapide. Ces fonctionnalités sont renforcées par des certifications de niveau professionnel, notamment la norme SOC II Type 2 et la conformité HIPAA en option.

Pour optimiser les coûts, Claude utilise une mise en cache rapide, réduisant ainsi les dépenses d'entrée de 90 % pour les flux de travail répétitifs. La Developer Console comprend un plan de travail pour une ingénierie rapide, et la plate-forme prend en charge les fonctionnalités de vision, ce qui la rend idéale pour le traitement de tableaux, de graphiques et de diagrammes techniques.

Claude Opus 4.5 traite à 49 jetons par seconde, privilégiant le raisonnement analytique approfondi à la rapidité, ce qui en fait la solution idéale pour les tâches complexes. Pour des réponses plus rapides, Claude Sonnet 4,5 délivre 70 jetons par seconde avec une latence de seulement 2,15 secondes. Les utilisateurs individuels peuvent opter pour un abonnement Claude Pro, au prix d'environ 20$ par mois, pour des limites d'utilisation plus élevées.

Nous verrons ensuite comment Google Gemini aborde les capacités d'IA multimodales.

Lancée en novembre 2025, la famille Gemini 3 de Google apporte des fonctionnalités avancées d'IA multimodale, gérant le texte, les images, la vidéo et l'audio de manière fluide [33, 34]. Le modèle phare, Gémeaux 3 Pro, a obtenu un impressionnant score Elo de 1501 sur le classement LMArena et a obtenu un score de 72,1 % sur SimpleQA Verified [33, 35].

Gemini 3 Pro se distingue par sa capacité à gérer des tâches de raisonnement complexes, obtenant un score de 91,9 % sur GPQA Diamond et effectue des opérations multimodales complexes avec une précision de 81,0 % sur MMMU-Pro. Sa fenêtre contextuelle de 1 million de jetons permet de traiter de vastes ensembles de données, tels que des bases de code complètes, de longues conférences vidéo ou des centaines d'articles universitaires simultanément [33, 35].

Pour les applications nécessitant rapidité et rentabilité, Gemini 3 Flash traite les données à seulement 0,50$ par million de jetons d'entrée. Pendant ce temps, Gemini 2.5 Flash-Lite, optimisé pour les tâches à volume élevé, fonctionne à un prix économique de 0,02$ par million de jetons [35, 42].

« Gemini 3 est également bien plus efficace pour déterminer le contexte et l'intention de votre demande, afin que vous obteniez ce dont vous avez besoin en moins de temps. » — Sundar Pichai, PDG de Google et Alphabet

Dans les applications pratiques, JetBrains a testé Gemini 3 Pro en générant des milliers de lignes de code frontal à partir d'une seule invite, ce qui montre une amélioration des performances de 50 % par rapport à Gemini 2.5 Pro lors des tests de performance. De même, Groupe Rakuten Inc. a utilisé Gemini 3 pour transcrire des réunions multilingues d'une durée de trois heures, excellant ainsi dans l'identification des locuteurs et surpassant les modèles de référence de plus de 50 %.

Gemini 3 a fait l'objet d'évaluations de sécurité rigoureuses en collaboration avec l'AISI britannique et des sociétés indépendantes telles qu'Apollo et Vaultis. Ces évaluations ont révélé une résistance accrue aux injections rapides et une réduction du comportement sycophantique par rapport aux versions précédentes. Google a également intégré ID de synthèse dans Gemini, un outil qui intègre des filigranes numériques imperceptibles dans des images et du texte générés par l'IA, garantissant ainsi la traçabilité du contenu créé par l'IA.

Gemini s'intègre parfaitement à la recherche Google, à l'application Gemini, à AI Studio et à Vertex AI. Grâce à Vertex AI, les entreprises ont accès à plus de 200 modèles de base, dont un générateur d'agents pour créer des agents d'IA à l'aide du langage naturel. Les requêtes peuvent être améliorées grâce à des résultats de recherche en temps réel ou à des données propriétaires stockées dans BigQuery et alliage DB [37, 40 et 41].

Les applications du monde réel mettent en évidence la polyvalence de Gemini. FOX Sports utilise Vertex AI et Gemini pour cataloguer et récupérer les meilleurs moments des vidéos à diffuser, tandis que Wendy's a mis en place un système drive-thru génératif piloté par IA pour gérer et afficher les commandes personnalisées, rationalisant ainsi les interactions avec les clients.

Gemini propose également des fonctionnalités économiques telles que la mise en cache du contexte, qui permet aux utilisateurs de stocker le contexte fréquemment utilisé avec une réduction de 75 % (avec un minimum de 32 000 jetons), et le mode batch, qui réduit les coûts des jetons de 50 % pour les tâches traitées dans les 24 heures [42, 43]. Ces caractéristiques font de Gemini une solution flexible et rentable répondant aux différents besoins des entreprises.

Pour les utilisateurs individuels, Gemini 2.5 Pro est disponible via Gemini Advanced pour 19,99$ par mois [7, 36]. Les nouveaux clients de Google Cloud peuvent tester Gemini sur Vertex AI avec 300$ de crédits gratuits [37, 41]. Les entreprises qui traitent plus de 100 millions de jetons par mois peuvent négocier des remises sur volume allant de 20 % à 40 %.

L'application Gemini comptant désormais plus de 650 millions d'utilisateurs mensuels, la plateforme démontre son attrait à la fois pour les particuliers et les grandes entreprises. Les sections suivantes exploreront plus en détail les points forts et les défis de ces offres.

Chaque fournisseur présente des avantages et des défis uniques, ce qui fait que leur adéquation dépend de vos besoins spécifiques. Ci-dessous, nous décrivons les principaux facteurs qui différencient ces fournisseurs.

GPT-5.2 d'OpenAI se distingue par sa rapidité et son raisonnement mathématique, traitant 187 jetons par seconde, soit 3,8 fois plus vite que le Claude Opus 4.5 d'Anthropic, qui traite 49 jetons par seconde. Cela fait de GPT-5.2 un excellent choix pour les applications en temps réel destinées aux clients. Cependant, sa fenêtre contextuelle de 400 000 jetons peut constituer une limitation lorsque vous travaillez avec des ensembles de données extrêmement volumineux.

Claude Opus 4.5 d'Anthropic excelle en termes de précision de codage, obtenant un score de 80,9 % sur SWE-Bench Verified, surpassant 80,0 % pour GPT-5.2 et 76,8 % pour Gemini 3 Pro. Sa politique de non-formation sur les données des clients garantit une confidentialité accrue, ce qui constitue un avantage significatif pour les flux de travail des entreprises. Cependant, il présente le coût le plus élevé (5 dollars par million de jetons d'entrée et 25 dollars par million de jetons de sortie) et se heurte à des tâches de raisonnement complexes, obtenant 78,4 % sur GPQA Diamond contre 92,4 % pour GPT-5.2.

Alors qu'Anthropic met l'accent sur la précision du codage, Gemini 3 Pro de Google met l'accent sur les capacités multimodales et la grande profondeur du contexte. Avec la plus grande fenêtre contextuelle d'un million de jetons (jusqu'à 2 millions pour les entreprises clientes), Gemini peut gérer simultanément du texte, des images, du son et de la vidéo. Elle a également obtenu un impressionnant score LMArena Elo de 1501 à la fin de 2025. Cependant, Gemini est connu pour produire du contenu non pertinent lors d'analyses de données complexes, et son prix double lorsque le contexte d'entrée dépasse 200 000 jetons.

En matière d'intégration des écosystèmes, OpenAI est en tête avec plus de 1 000 connecteurs tiers. Anthropic a toutefois conquis 32 % de la part de marché des entreprises à la mi-2025, dépassant les 25 % d'OpenAI. Gemini de Google bénéficie d'une intégration étroite avec Espace de travail Google, offrant une expérience fluide aux organisations utilisant GCP. Cependant, il a été critiqué pour son écosystème limité, avec seulement plus de 50 intégrations tierces.

Ces comparaisons fournissent une vision claire des points forts et des défis de chaque fournisseur, vous aidant ainsi à identifier celui qui convient le mieux à vos besoins spécifiques.

La sélection du bon fournisseur de modèles de langage d'IA dépend largement des exigences uniques de votre entreprise. OpenAI GPT-5.2 se distingue en matière de création de contenu créatif et de tâches conversationnelles, ce qui en fait une référence pour les équipes marketing et les personnes en contact avec les clients. D'autre part, Claude Opus 4.5 d'Anthropic est conçu pour les applications techniques, en mettant fortement l'accent sur la confidentialité grâce à sa politique de formation zéro. Il convient parfaitement aux équipes de développement de logiciels et aux secteurs soumis à des réglementations strictes. Pour les organisations axées sur la recherche qui s'appuient sur Google Workspace, Gemini 3 Pro de Google est un choix naturel.

De nombreuses entreprises américaines adoptent une approche stratégique en déployant plusieurs fournisseurs, chacun sélectionné pour ses points forts spécifiques. Ce modèle hybride permet non seulement d'éviter la dépendance vis-à-vis des fournisseurs, mais garantit également aux équipes l'accès aux meilleurs outils adaptés à leurs besoins particuliers.

Pour gérer efficacement ces diverses fonctionnalités, une solution d'orchestration unifiée devient indispensable. Traditionnellement, la gestion de plusieurs fournisseurs d'IA exigeait de jongler avec des comptes distincts, de suivre les coûts sur différents systèmes de facturation et de gérer des intégrations complexes. Des plateformes comme Prompts.ai simplifiez ce processus en proposant un plan de contrôle unique, donnant accès à plus de 35 modèles de langage de pointe, dont GPT-5.2, Claude et Gemini, depuis une seule interface. Cette approche unifiée permet aux entreprises de passer facilement d'un modèle à l'autre, optimisant à la fois les performances et les coûts grâce à des fonctionnalités telles que le suivi des jetons en temps réel.

« L'avantage d'un plan de contrôle unique est que, sur le plan architectural, vous, en tant qu'équipe chargée des données, n'avez pas à payer 50 fournisseurs différents pour 50 clusters de calcul différents, ce qui coûte du temps et de l'argent à entretenir. » — Hugo Lu, PDG d'Orchestra

Pour les entreprises américaines qui souhaitent développer efficacement l'adoption de l'IA, les plateformes d'orchestration permettent de réduire la prolifération des outils, de renforcer la gouvernance et de réduire les coûts des logiciels d'IA jusqu'à 98 %. Ces outils transforment les efforts expérimentaux épars en flux de travail rationalisés et conformes, tout en conservant la flexibilité nécessaire pour s'adapter à l'émergence de nouveaux modèles et technologies.

Pour trouver le fournisseur de modèles de langage d'IA adapté à votre entreprise, commencez par définir clairement vos objectifs. Identifiez les tâches spécifiques que le modèle doit effectuer, qu'il s'agisse synthèse des rapports, écriture de code, ou dynamiser les chatbots. Concentrez-vous sur vos priorités et recherchez des fournisseurs dont les modèles sont spécialisés dans ces domaines. Par exemple, certains modèles sont conçus pour gérer un traitement de texte étendu, tandis que d'autres excellent dans les interactions en temps réel ou les tâches impliquant plusieurs formats tels que les images et le son.

Une fois que vous avez défini vos besoins, considérez les aspects pratiques tels que coût, vie privée, capacités d'intégration, et indicateurs de performance. Examinez des facteurs tels que la vitesse de traitement des jetons, la durée du contexte et la tarification pour vous assurer que le modèle correspond à la fois à votre budget et à vos exigences techniques. Si votre entreprise utilise déjà des outils tels que Google Workspace, le choix d'un fournisseur offrant une intégration fluide peut vous faire gagner du temps et réduire la complexité de la configuration.

Enfin, profitez des essais gratuits ou des niveaux d'accès limités pour tester différents modèles au sein de vos flux de travail. Évaluez leurs performances en fonction de la qualité, de la rapidité et de la rentabilité. Combinez ces résultats à des considérations telles que l'assistance aux fournisseurs et les garanties de confidentialité pour prendre une décision éclairée qui correspond aux besoins de votre entreprise.

Les prix pratiqués par les fournisseurs varient considérablement, en fonction du type de modèle et des niveaux d'utilisation.

OpenAI s'adresse à ceux qui recherchent des performances de haut niveau à un coût élevé, Anthropic propose une option de milieu de gamme équilibrée et Google se distingue par son prix abordable, en particulier pour les tâches nécessitant un volume élevé ou des capacités multimodales.

Les entreprises s'appuient souvent sur une combinaison de fournisseurs de modèles de langage d'IA pour répondre à divers besoins. Chaque fournisseur apporte ses propres atouts : certains se distinguent par la fourniture de réponses en temps réel, d'autres gèrent facilement des tâches complexes telles que la génération de code, et certains proposent des solutions économiques pour les charges de travail volumineuses. En tirant parti de plusieurs fournisseurs, les entreprises peuvent trouver l'équilibre parfait entre performance, coût et efficacité, en veillant à ce qu'ils disposent toujours de l'outil adapté à la tâche à accomplir.

Cette approche présente également des avantages pratiques, tels que le fait d'éviter de dépendre d'un fournisseur, de garantir un service ininterrompu en cas de panne potentielle et de répondre à des exigences spécifiques exigences réglementaires ou de confidentialité. En outre, la technologie de l'IA évoluant à un rythme rapide, la collaboration avec plusieurs fournisseurs permet aux entreprises de rester agiles et d'adopter des fonctionnalités de pointe sans attendre qu'un seul fournisseur les rattrape.

{» @context « : » https://schema.org","@type":"FAQPage","mainEntity":[{"@type":"Question","name":"How puis-je choisir le meilleur fournisseur de modèles linguistiques d'IA pour mon entreprise ? » , « AcceptedAnswer » : {» @type « :"Answer », "text » : » <p>Pour trouver le fournisseur de modèles linguistiques d'IA adapté à votre entreprise, commencez par définir clairement vos objectifs. Identifiez les tâches spécifiques que le modèle doit effectuer, qu'il s'agisse de <strong>résumer des rapports</strong>, de <strong>rédiger du code</strong> ou de faire fonctionner des <strong>chatbots</strong>. Concentrez-vous sur vos priorités et recherchez des fournisseurs dont les modèles sont spécialisés dans ces domaines. Par exemple, certains modèles sont conçus pour gérer un traitement de texte étendu, tandis que d'autres excellent dans les interactions en temps réel ou les tâches impliquant plusieurs formats tels que les images et le son.</p> <p>Une fois que vous avez défini vos besoins, prenez en compte des aspects pratiques tels que les <strong>coûts</strong>, <strong>la confidentialité</strong>, <strong>les capacités d'intégration</strong> et <strong>les indicateurs de performance</strong>. Examinez des facteurs tels que la vitesse de traitement des jetons, la durée du contexte et la tarification pour vous assurer que le modèle correspond à la fois à votre budget et à vos exigences techniques. Si votre entreprise utilise déjà des outils tels que Google Workspace, le choix d'un fournisseur offrant une intégration fluide peut vous faire gagner du temps et réduire la complexité de la configuration.</p> <p>Enfin, profitez des essais gratuits ou des niveaux d'accès limités pour tester différents modèles au sein de vos flux de travail. Évaluez leurs performances en fonction de la qualité, de la rapidité et de la rentabilité. Combinez ces résultats à des considérations telles que l'assistance aux fournisseurs et les garanties de confidentialité pour prendre une décision éclairée qui correspond aux besoins de votre entreprise</p>. «}}, {» @type « :"Question », "name » :"Comment se comparent OpenAI, Anthropic et Google en termes de prix pour leurs modèles de langage d'IA ? » , « AcceptedAnswer » : {» @type « :"Answer », "text » : » <p>Les prix pratiqués par les fournisseurs varient considérablement, en fonction du type de modèle et des niveaux d'</p>utilisation. <ul><li><strong>OpenAI</strong> : les modèles premium tels que GPT-5.2 sont proposés au prix de <strong>1,75$ par million de jetons d'entrée et de 14$ par million de jetons</strong> <strong>de sortie, avec des remises disponibles pour</strong> les entrées mises en cache. Pour les utilisateurs plus soucieux des coûts, le GPT-5 mini propose un prix inférieur à <strong>0,25$ par million de jetons d'entrée et <strong>2$ par</strong> million de jetons</strong></li> de sortie. <li><strong>Anthropic</strong> : les modèles Claude se situent dans la catégorie de prix de milieu de gamme, coûtant environ <strong>1 à 3 dollars par million de jetons d'entrée et 3 à 6 dollars par million de jetons</strong> <strong>de sortie, selon le niveau de modèle spécifique</strong>.</li> <li><strong>Google (Gemini)</strong> : Gemini offre un avantage concurrentiel grâce à sa structure tarifaire, à commencer par un niveau gratuit pour les intégrations. Les niveaux payants commencent à <strong>0,30$ par million de jetons d'entrée</strong> et à <strong>0,075$ par million de jetons de sortie</strong> pour une utilisation de base. Les niveaux de performance avancés sont proposés à un prix compris entre <strong>1,25$ et 2,50$ par million de jetons d'entrée et entre 10 et 15$ par million de jetons</strong> <strong>de sortie.</strong></li></ul> <p>OpenAI s'adresse à ceux qui recherchent des performances de haut niveau à un coût élevé, Anthropic propose une option de milieu de gamme équilibrée et Google se distingue par son prix abordable, en particulier pour les tâches nécessitant un volume élevé ou des capacités multimodales.</p> «}}, {» @type « :"Question », "name » :"Pourquoi une entreprise utiliserait-elle plusieurs fournisseurs de modèles linguistiques d'IA ? » , « AcceptedAnswer » : {» @type « :"Answer », "text » : » <p>Les entreprises s'appuient souvent sur une combinaison de fournisseurs de modèles linguistiques d'IA pour répondre à divers besoins. Chaque fournisseur apporte ses propres atouts : certains se distinguent par la fourniture de réponses en temps réel, d'autres gèrent facilement des tâches complexes telles que la génération de code, et certains proposent des solutions économiques pour les charges de travail volumineuses. En s'appuyant sur plusieurs fournisseurs, les entreprises peuvent trouver l'équilibre parfait entre <strong>performances, coûts et efficacité</strong>, en s'assurant de toujours disposer du bon outil pour la tâche à accomplir.</p> <p>Cette approche présente également des avantages pratiques, tels que la prévention de la dépendance vis-à-vis d'un fournisseur, la garantie d'un service ininterrompu en cas de panne potentielle et le respect d'exigences réglementaires <strong>ou de confidentialité</strong> spécifiques. En outre, la technologie de l'IA évoluant à un rythme rapide, la collaboration avec plusieurs fournisseurs permet aux entreprises de rester agiles et d'adopter des fonctionnalités de pointe sans attendre qu'un seul fournisseur les rattrape.</p> «}}]}