Los modelos de lenguaje de IA están remodelando las industrias con herramientas que impulsan la automatización y la eficiencia. La elección del proveedor adecuado depende de las necesidades de su empresa. He aquí un resumen rápido de los tres jugadores principales:

Cada proveedor tiene puntos fuertes únicos, desde la precisión de codificación hasta las capacidades multimodales. Muchas empresas combinan varios modelos para lograr flexibilidad y rendimiento.

Para maximizar la eficiencia y reducir los costos, considere plataformas de orquestación como Prompts.ai, que unifican el acceso a varios modelos en una sola interfaz.

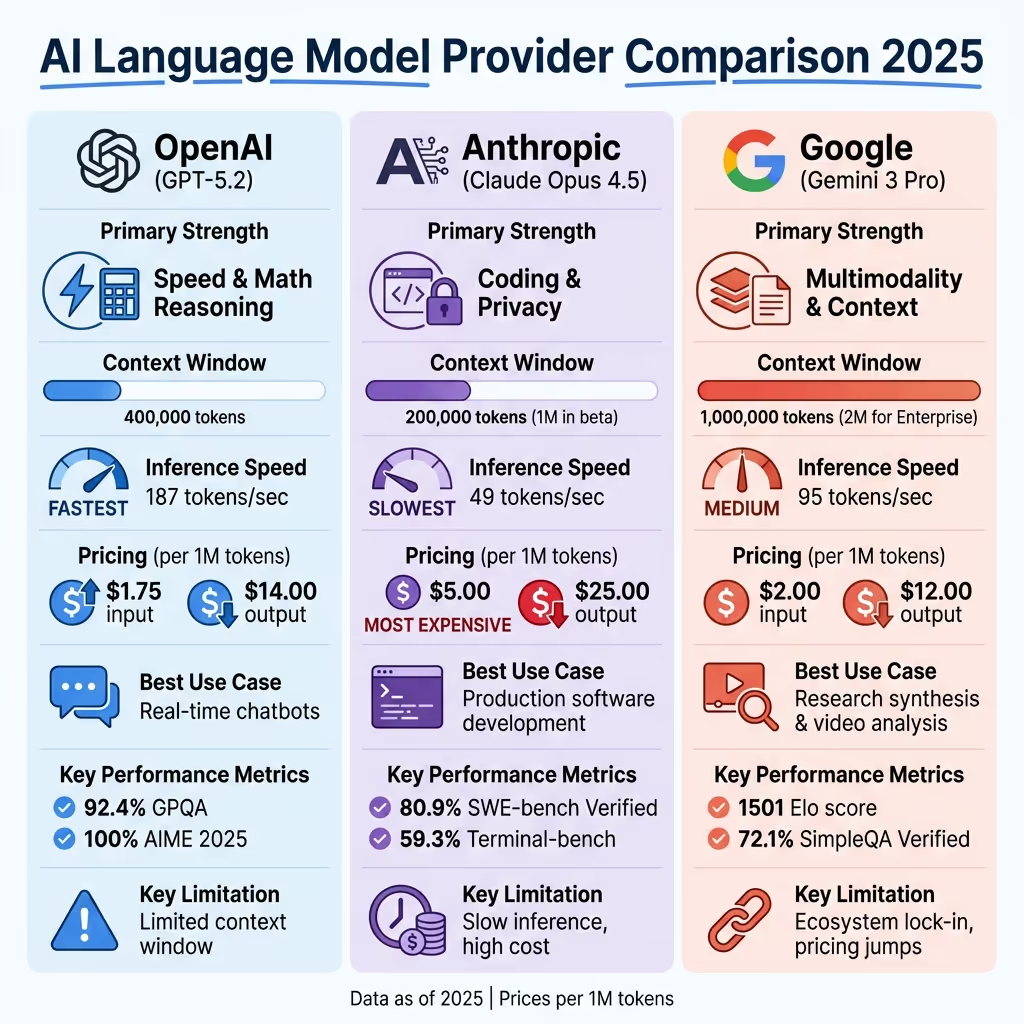

Comparación de proveedores de modelos de lenguaje de IA: OpenAI vs Anthropic vs Google Géminis

OpenAI proporciona un ecosistema de IA sólido creado en torno a su familia de modelos GPT. Entre estos, GPT-5.2 se destaca por su excepcional desempeño en tareas de codificación y agencia, logrando 92,4% en GPQA y 100% en AIME 2025. Para los usuarios que buscan una mayor velocidad y precisión, también está disponible una versión premium «Pro».

Las capacidades de los modelos de OpenAI son impresionantes. GPT-5 admite un Ventana de contexto de 400 000 tokens, lo que lo hace ideal para analizar grandes conjuntos de datos, como bases de código completas o documentos legales exhaustivos. Mientras tanto, GPT-4o ofrece respuestas rápidas en tan solo 320 ms, lo que permite interacciones de voz naturales y fluidas.

Alexandr Frunza, desarrollador de backend de Index.dev, comentó: «OpenAI creó GPT-4o para gestionar conversaciones reales... lo suficientemente rápido como para que los usuarios no noten el retraso».

OpenAI también ofrece modelos especializados como o3-investigación profunda, diseñado para análisis avanzados, y Sora 2, diseñado para el procesamiento de vídeo de alta calidad con audio sincronizado. Para tareas de gran volumen, GPT-5 mini es una opción económica, con un precio justo 0,25$ por cada 1 millón de fichas de entrada. Zillow, por ejemplo, utiliza la API OpenAI Realtime para impulsar las búsquedas por voz de viviendas y opciones de financiación, lo que permite a los usuarios interactuar de forma natural con su plataforma.

OpenAI está comprometida con la seguridad y emplea un enfoque de varios niveles que incluye el filtrado de datos, la alineación mediante el aprendizaje reforzado a partir de la retroalimentación humana (RLHF) y un riguroso trabajo en equipo rojo. Durante el lanzamiento de GPT-4o, participaron más de 100 equipos rojos externos para identificar y mitigar los riesgos. Los resultados son claros: GPT-4 tiene un 82% menos de probabilidades de responder al contenido no permitido y Un 40% más de probabilidades de proporcionar información objetiva en comparación con el GPT-3.5.

El Grupo Asesor de Seguridad supervisa las evaluaciones de los modelos y garantiza que solo se den a conocer al público aquellas con una puntuación de riesgo «media» o inferior después de la mitigación. OpenAI también publica tarjetas de sistema detalladas para las principales versiones, en las que se describen los posibles riesgos y medidas de seguridad. Para los usuarios empresariales, la plataforma ofrece Cumplimiento de SOC 2 tipo 2 y políticas opcionales de cero retención de datos para mayor seguridad.

Las API de OpenAI están diseñadas para ofrecer flexibilidad y ofrecen opciones RESTful, de streaming y en tiempo real compatibles con cualquier sistema que admita solicitudes HTTP. Los SDK oficiales para Python, JavaScript y C# agilizan los procesos de desarrollo, mientras que herramientas como SDK de agentes y Creador de agentes simplifique la creación de flujos de trabajo listos para la producción.

Rayas aprovecharon el marco OpenAI Evals para evaluar la precisión de su herramienta de documentación técnica impulsada por GPT, mejorándola con supervisión humana.

Para las empresas, OpenAI ofrece funciones como SSO, MFA y RBAC. En los sectores regulados, las implementaciones a través de Azure garantice el aislamiento de las redes virtuales y el cumplimiento de la HIPAA mediante acuerdos de asociación comercial. Se recomienda a los desarrolladores que utilicen versiones de modelos ancladas (p. ej., gpt-4o-2024-08-06) para mantener un comportamiento uniforme en los entornos de producción.

En comparación con competidores como Claude Opus 4.1, que cobra 15,00$ por 1 millón de fichas de entrada y 75,00$ por 1 millón de fichas de salida, GPT-5.1 demuestra ser aproximadamente 8 veces más rentable. Para las tareas que no son urgentes, la API Batch proporciona ahorros adicionales al permitir el procesamiento retrasado.

A continuación, analizaremos más de cerca a Anthropic Claude, que ofrece un conjunto distinto de capacidades en el panorama de la IA.

La familia Anthropic Claude ofrece una IA conversacional que se siente natural y evita los tonos robóticos. Su modelo estrella, Claude Opus 4.5, debutó en noviembre de 2025 y cuenta con una impresionante puntuación de inteligencia de 49. Una de sus características más destacadas es Modo de pensamiento extendido, lo que permite un razonamiento detallado y paso a paso para abordar tareas analíticas complejas.

Claude Opus 4.5 destaca en la codificación y los flujos de trabajo autónomos, ya que maneja los intrincados desafíos de ingeniería de software con facilidad. Obtuvo una impresionante puntuación del 80,9% en SWE-Bench Verified y admite una ventana de contexto estándar de 200 000 tokens, con opciones de nivel empresarial que se extienden hasta alcanzar la impresionante cantidad de 1 millón de tokens [5,32].

«Claude Opus 4.5 es nuestro nuevo modelo de lenguaje grande de razonamiento híbrido. Está a la vanguardia entre los modelos más avanzados de tareas de codificación de software y tareas de agencia que requieren que se ejecute de forma autónoma en nombre del usuario». — Anthropic

La modelo Artefacto La función mejora la colaboración al mostrar código, diagramas y vistas previas de sitios web una al lado de la otra, lo que agiliza la iteración [5,25]. En las tareas basadas en terminales, Claude lidera con una puntuación del 59,3% en Terminal-bench, superando a su competidor más cercano en aproximadamente 12 puntos. Los desarrolladores también se benefician de la herramienta CLI Claude Code, que permite la interacción directa con bases de código complejas, lo que consolida su reputación como una potencia de codificación.

Estos logros en cuanto al rendimiento sientan las bases de sus sólidas medidas de seguridad y sus capacidades de integración sin fisuras.

Claude destaca por su enfoque centrado en la seguridad, que aprovecha IA constitucional para garantizar que los modelos sigan siendo útiles, honestos e inofensivos. Es Política de escalamiento responsable asigna niveles de seguridad de la IA (ASL) en función de las evaluaciones de riesgos catastróficos, y Claude Opus 4.5 cumple con el estricto estándar de seguridad ASL-3 [26,28].

En las pruebas de seguridad multilingües, el modelo logró una tasa de respuesta inofensiva del 99,78% para las solicitudes infractivas en idiomas como el árabe, el francés, el coreano, el mandarín y el ruso. También demostró una sólida seguridad por parte de los agentes, ya que rechazó el 88,39% de las solicitudes de uso indebido de ordenadores y bloqueó con éxito el 99,4% de los ataques de inyección rápida durante la ejecución de comandos de bash.

Claude se integra a la perfección con plataformas como lecho rocoso amazónico, Inteligencia artificial de Google Vertex, y Microsoft Azure AI Foundry. Es Protocolo de contexto modelo (MCP) se conecta de forma segura a fuentes de datos externas y bloquea el 94% de los ataques de inyección inmediata. Estas capacidades se ven reforzadas por certificaciones de nivel empresarial, que incluyen el SOC II de tipo 2 y el cumplimiento opcional de la HIPAA.

Para optimizar los costos, Claude emplea el almacenamiento rápido en caché, lo que reduce los gastos de entrada en un 90% para los flujos de trabajo repetitivos. La consola para desarrolladores incluye una mesa de trabajo para una ingeniería rápida, y la plataforma admite capacidades de visión, lo que la convierte en experta en el procesamiento de tablas, gráficos y diagramas técnicos.

Claude Opus 4.5 procesa a 49 fichas por segundo, priorizando el razonamiento analítico profundo por encima de la velocidad, lo que lo hace ideal para tareas complejas. Para obtener respuestas más rápidas, Claude Sonnet 4.5 entrega 70 fichas por segundo con una latencia de solo 2,15 segundos. Los usuarios individuales pueden optar por una suscripción a Claude Pro, con un precio de unos 20 dólares al mes, para límites de uso más altos.

A continuación, analizaremos cómo Google Gemini aborda las capacidades de IA multimodal.

Lanzada en noviembre de 2025, la familia Gemini 3 de Google ofrece capacidades avanzadas de inteligencia artificial multimodal, que gestionan texto, imágenes, vídeo y audio sin problemas [33, 34]. El modelo estrella, Gemini 3 Pro, obtuvo una impresionante puntuación Elo de 1501 en la clasificación de LMArena y obtuvo un 72,1% en SimpleQA Verified [33, 35].

Gemini 3 Pro destaca por su capacidad para gestionar tareas de razonamiento complejas, obteniendo una puntuación del 91,9% en GPQA Diamond y realizando intrincadas operaciones multimodales con una precisión del 81,0% en MMMU-Pro. Su ventana contextual de 1 millón de fichas permite procesar grandes conjuntos de datos, como bases de código completas, largas videoconferencias o cientos de trabajos académicos simultáneamente [33, 35].

Para las aplicaciones que requieren velocidad y rentabilidad, Gemini 3 Flash procesa los datos a solo 0,50 USD por millón de tokens de entrada. Mientras tanto, Gemini 2.5 Flash-Lite, optimizado para tareas de gran volumen, funciona a un precio económico de 0,02 USD por millón de fichas [35, 42].

«Gemini 3 también es mucho mejor a la hora de determinar el contexto y la intención detrás de tu solicitud, por lo que obtienes lo que necesitas con menos preguntas». — Sundar Pichai, director ejecutivo de Google y Alphabet

En aplicaciones prácticas, JetBrains probé Gemini 3 Pro generando miles de líneas de código de interfaz a partir de un solo mensaje, lo que muestra una mejora del rendimiento del 50% con respecto a Gemini 2.5 Pro en las pruebas comparativas. Del mismo modo, Grupo Rakuten Inc. utilizó Gemini 3 para transcribir reuniones multilingües de tres horas de duración, con lo que se destacó en la identificación de hablantes y superó los modelos de referencia en más de un 50%.

Gemini 3 se sometió a rigurosas evaluaciones de seguridad en colaboración con la AISI del Reino Unido y firmas independientes como Apollo y Vaultis. Estas evaluaciones revelaron una mejora de la resistencia a las inyecciones rápidas y una reducción del comportamiento adulador en comparación con las versiones anteriores. Google también ha integrado SynthID en Gemini, una herramienta que incorpora marcas de agua digitales imperceptibles en imágenes y textos generados por la IA, lo que garantiza la trazabilidad del contenido creado por la IA.

Gemini se integra perfectamente en la Búsqueda de Google, la aplicación Gemini, AI Studio y Vertex AI. Gracias a la IA de Vertex, las empresas tienen acceso a más de 200 modelos básicos, incluido un generador de agentes para crear agentes de IA utilizando lenguaje natural. Las consultas se pueden mejorar con resultados de búsqueda en tiempo real o con datos propios almacenados en BigQuery y Aleación DB [37, 40, 41].

Las aplicaciones del mundo real destacan la versatilidad de Gemini. FOX Sports utiliza Vertex AI y Gemini para catalogar y recuperar vídeos destacados para las transmisiones, mientras que Wendy's ha implementado un sistema de autoservicio generativo basado en inteligencia artificial para gestionar y mostrar los pedidos personalizados, lo que agiliza las interacciones con los clientes.

Gemini también ofrece funciones que permiten ahorrar costos, como el almacenamiento en caché de contexto, que permite a los usuarios almacenar el contexto de uso frecuente con un descuento del 75% (con un mínimo de 32 000 tokens), y el modo por lotes, que reduce los costos de los tokens en un 50% para las tareas procesadas en 24 horas [42, 43]. Estas características hacen de Gemini una solución flexible y rentable para diversas necesidades empresariales.

Para usuarios individuales, Gemini 2.5 Pro está disponible a través de Gemini Advanced por 19,99$ al mes [7, 36]. Los nuevos clientes de Google Cloud pueden probar Gemini en Vertex AI con 300$ en créditos gratuitos [37, 41]. Las empresas que procesan más de 100 millones de fichas al mes pueden negociar descuentos por volumen que oscilan entre el 20 y el 40%.

Ahora que la aplicación Gemini cuenta con más de 650 millones de usuarios mensuales, la plataforma demuestra su atractivo tanto para los consumidores individuales como para las grandes empresas. En las siguientes secciones se analizarán con más detalle los puntos fuertes y los desafíos de estas ofertas.

Cada proveedor ofrece ventajas y desafíos únicos, por lo que su idoneidad depende de sus necesidades específicas. A continuación, desglosamos los factores clave que diferencian a estos proveedores.

GPT-5.2 de OpenAI destaca por su velocidad y razonamiento matemático, ya que procesa la impresionante cantidad de 187 fichas por segundo, 3,8 veces más rápido que la Claude Opus 4.5 de Anthropic, que procesa 49 fichas por segundo. Esto convierte al GPT-5.2 en una excelente opción para aplicaciones en tiempo real orientadas al cliente. Sin embargo, su ventana de contexto de 400 000 fichas puede ser una limitación cuando se trabaja con conjuntos de datos extremadamente grandes.

Claude Opus 4.5 de Anthropic sobresale en la precisión de codificación, logrando una puntuación del 80,9% en SWE-Bench Verified, superando al 80,0% de GPT-5.2 y al 76,8% de Gemini 3 Pro. Su política de no capacitarse sobre los datos de los clientes proporciona una mayor privacidad, lo cual es una ventaja significativa para los flujos de trabajo empresariales. Sin embargo, es la que cuesta más (5 dólares por millón de fichas de entrada y 25 dólares por millón de fichas de salida) y tiene dificultades para realizar tareas de razonamiento complejas, ya que obtiene un 78,4% en GPQA Diamond, frente al 92,4% de GPT-5.2.

Si bien Anthropic se centra en la precisión de la codificación, Gemini 3 Pro de Google enfatiza las capacidades multimodales y la amplia profundidad del contexto. Con la ventana de contexto más grande, con 1 millón de tokens (hasta 2 millones para los clientes empresariales), Gemini puede gestionar texto, imágenes, audio y vídeo de forma simultánea. A finales de 2025, también había conseguido una impresionante puntuación máxima en Elo en el LMArena, de 1501 puntos. Sin embargo, se sabe que Gemini produce contenido irrelevante durante el análisis de datos complejos, y su precio se duplica cuando el contexto de entrada supera los 200 000 tokens.

Cuando se trata de la integración de ecosistemas, OpenAI es líder con más de 1000 conectores de terceros. Sin embargo, Anthropic capturó el 32% de la cuota de mercado empresarial a mediados de 2025, superando el 25% de OpenAI. Gemini de Google se beneficia de una estrecha integración con Espacio de trabajo de Google, que ofrece una experiencia perfecta para las organizaciones que utilizan GCP. Sin embargo, ha recibido críticas por su ecosistema limitado, con solo más de 50 integraciones de terceros.

Estas comparaciones brindan una visión clara de las fortalezas y desafíos de cada proveedor, lo que lo ayuda a identificar la mejor opción para sus requisitos específicos.

La selección del proveedor de modelos lingüísticos de IA adecuado depende en gran medida de los requisitos únicos de su empresa. Los de OpenAI GPT-5.2 destaca por la creación de contenido creativo y las tareas conversacionales, por lo que es una opción ideal para los equipos de marketing y las funciones de atención al cliente. Por otro lado, Claude Opus 4.5 de Anthropic está diseñado para aplicaciones técnicas, con un fuerte énfasis en la privacidad a través de su política de cero capacitación, una excelente opción para los equipos de desarrollo de software y las industrias con regulaciones estrictas. Para las organizaciones impulsadas por la investigación que confían en Google Workspace, Gemini 3 Pro de Google es una elección natural.

Muchas empresas estadounidenses están adoptando un enfoque estratégico mediante el despliegue de varios proveedores, cada uno seleccionado por sus puntos fuertes específicos. Este modelo híbrido no solo evita la dependencia de un solo proveedor, sino que también garantiza que los equipos tengan acceso a las mejores herramientas para sus necesidades particulares.

Para gestionar estas diversas capacidades de manera eficaz, es indispensable contar con una solución de orquestación unificada. Tradicionalmente, la gestión de varios proveedores de inteligencia artificial requería hacer malabares con cuentas separadas, realizar un seguimiento de los costos en varios sistemas de facturación y gestionar integraciones complejas. Plataformas como Prompts.ai simplifique este proceso al ofrecer un único plano de control, lo que permite el acceso a más de 35 modelos lingüísticos líderes, incluidos GPT-5.2, Claude y Gemini, todo desde una sola interfaz. Este enfoque unificado permite a las empresas cambiar de modelo sin problemas, optimizando tanto el rendimiento como el coste con funciones como el seguimiento de los tokens en tiempo real.

«La ventaja de tener un solo plano de control es que, desde el punto de vista arquitectónico, el equipo de datos no tiene que pagar a 50 proveedores diferentes por 50 clústeres de procesamiento diferentes, cuyo mantenimiento cuesta tiempo y dinero». — Hugo Lu, director ejecutivo de Orchestra

Para las empresas estadounidenses que buscan escalar la adopción de la IA de manera eficiente, las plataformas de orquestación proporcionan una forma de reducir la proliferación de herramientas, reforzar la gobernanza y reducir los costos del software de IA hasta 98%. Estas herramientas transforman los esfuerzos experimentales dispersos en flujos de trabajo simplificados y compatibles, al tiempo que mantienen la flexibilidad necesaria para adaptarse a medida que surgen nuevos modelos y tecnologías.

Para encontrar el proveedor de modelos lingüísticos de IA adecuado para su empresa, comience por definir claramente sus objetivos. Identifique las tareas específicas que necesita que realice el modelo, ya sea resumir informes, escribir código, o potenciando los chatbots. Concéntrese en sus prioridades y busque proveedores cuyos modelos se especialicen en esas áreas. Por ejemplo, algunos modelos están diseñados para procesar textos extensos, mientras que otros se destacan en interacciones o tareas en tiempo real que involucran múltiples formatos, como imágenes y audio.

Una vez que hayas descrito tus necesidades, considera aspectos prácticos como coste, intimidad, capacidades de integración, y métricas de rendimiento. Examine factores como la velocidad de procesamiento de los tokens, la duración del contexto y los precios para asegurarse de que el modelo se ajusta tanto a su presupuesto como a sus requisitos técnicos. Si tu empresa ya usa herramientas como Google Workspace, elegir un proveedor con una integración fluida puede ahorrar tiempo y reducir la complejidad durante la configuración.

Por último, aproveche las pruebas gratuitas o los niveles de acceso limitado para probar diferentes modelos dentro de sus flujos de trabajo. Evalúe su rendimiento en función de la calidad, la velocidad y la rentabilidad. Combine estos hallazgos con consideraciones como el soporte de los proveedores y las garantías de privacidad para tomar una decisión informada que se ajuste a las necesidades de su empresa.

Los precios entre los proveedores muestran una amplia gama, influenciada por el tipo de modelo y los niveles de uso.

OpenAI está dirigido a quienes buscan un rendimiento de primer nivel a un precio superior, Anthropic ofrece una opción equilibrada de gama media y Google destaca por su asequibilidad, especialmente para tareas que requieren capacidades multimodales o de gran volumen.

Las empresas suelen confiar en una combinación de proveedores de modelos lingüísticos de IA para abordar una variedad de necesidades. Cada proveedor aporta sus puntos fuertes: algunos destacan por ofrecer respuestas en tiempo real, otros gestionan tareas complejas como la generación de código con facilidad y otros ofrecen soluciones económicas para cargas de trabajo de gran volumen. Al aprovechar la existencia de varios proveedores, las empresas pueden lograr el equilibrio perfecto entre rendimiento, costo y eficiencia, garantizando que siempre tengan la herramienta adecuada para la tarea en cuestión.

Este enfoque también ofrece beneficios prácticos, como evitar la dependencia de un proveedor, garantizar un servicio ininterrumpido durante posibles interrupciones y cumplir con requisitos específicos requisitos reglamentarios o de privacidad. Además, dado que la tecnología de inteligencia artificial avanza a un ritmo acelerado, trabajar con varios proveedores mantiene la agilidad de las empresas y les permite adoptar funciones de vanguardia sin tener que esperar a que un solo proveedor se ponga al día.

{» @context «:» https://schema.org","@type":"FAQPage","mainEntity":[{"@type":"Question","name":"How ¿puedo elegir el mejor proveedor de modelos de lenguaje de IA para mi empresa?» , "acceptedAnswer»: {» @type «:"Answer», "text»:» <p>Para encontrar el proveedor de modelos lingüísticos de IA adecuado para su empresa, comience por definir claramente sus objetivos. <strong><strong>Identifica las tareas específicas que necesitas que lleve a cabo el modelo, ya sea <strong>resumir informes</strong>, escribir código o impulsar los chatbots.</strong></strong> Concéntrese en sus prioridades y busque proveedores cuyos modelos se especialicen en esas áreas. Por ejemplo, algunos modelos están diseñados para procesar textos extensos, mientras que otros se destacan en las interacciones o tareas en tiempo real que involucran múltiples formatos, como imágenes y audio.</p> <p>Una vez que hayas definido tus necesidades, considera aspectos prácticos como el <strong>costo</strong>, la <strong>privacidad</strong>, <strong>las capacidades de integración</strong> y las <strong>métricas de rendimiento</strong>. Examine factores como la velocidad de procesamiento de los tokens, la duración del contexto y los precios para asegurarse de que el modelo se ajusta tanto a su presupuesto como a sus requisitos técnicos. Si tu empresa ya usa herramientas como Google Workspace, elegir un proveedor con una integración fluida puede ahorrar tiempo y reducir</p> la complejidad durante la configuración. <p>Por último, aprovecha las pruebas gratuitas o los niveles de acceso limitado para probar diferentes modelos en tus flujos de trabajo. Evalúe su rendimiento en función de la calidad, la velocidad y la rentabilidad. Combine estos hallazgos con consideraciones como el soporte de los proveedores y las garantías de privacidad para tomar una decisión informada que se ajuste a las necesidades de su empresa</p>. «}}, {» @type «:"Question», "name» :"¿ Cómo se comparan OpenAI, Anthropic y Google en términos de precios para sus modelos de lenguaje de IA?» , "acceptedAnswer»: {» @type «:"Answer», "text»:» Los precios según los <p>proveedores muestran una amplia gama de precios, según el tipo de modelo y los niveles de uso</p>. <ul><li><strong>OpenAI</strong>: Los modelos premium, como el GPT-5.2, tienen un precio de <strong>1,75 dólares por cada 1 millón de fichas de entrada y 14 dólares por cada 1 millón de fichas de salida</strong><strong>, con descuentos disponibles para las entradas almacenadas en caché</strong>. </li><strong>Para los usuarios más preocupados por los costes, el GPT-5 mini ofrece un precio más bajo: <strong>0,25$ por cada 1 millón de fichas de entrada y 2$ por cada 1</strong> millón de fichas de salida.</strong> <li>Los modelos <strong>Anthropic</strong>: Claude pertenecen a la categoría de precios de gama media, ya que cuestan entre 1 y 3 <strong>dólares por cada 1 millón de fichas de entrada y entre 3 y 6 dólares por cada 1 millón de fichas</strong> de salida<strong>, según el nivel</strong> de modelo específico.</li> <li><strong>Google (Gemini): Gemini</strong> ofrece una ventaja competitiva con su estructura de precios, empezando por un nivel gratuito para las incrustaciones. Los niveles de pago comienzan en <strong>0,30 USD por cada 1 millón de fichas de entrada</strong> y <strong>0,075 USD por cada 1 millón</strong> de fichas de salida para uso básico. Los niveles de rendimiento avanzados tienen un precio de entre <strong>1,25 y 2,50 dólares por cada 1 millón de fichas de entrada y entre 10 y 15 <strong>dólares</strong> por cada 1 millón de fichas</strong></li></ul> de salida. <p>OpenAI está dirigido a quienes buscan un rendimiento de primer nivel a un precio superior, Anthropic ofrece una opción equilibrada de gama media y Google destaca por su asequibilidad, especialmente para tareas que requieren capacidades multimodales o de gran volumen.</p> «}}, {» @type «:"Question», "name» :"Por qué una empresa utilizaría varios proveedores de modelos de lenguaje de IA?» , "acceptedAnswer»: {» @type «:"Answer», "text»:» <p>Las empresas suelen confiar en una combinación de proveedores de modelos lingüísticos de IA para abordar una variedad de necesidades. Cada proveedor aporta sus puntos fuertes: algunos destacan por ofrecer respuestas en tiempo real, otros gestionan tareas complejas como la generación de código con facilidad y algunos ofrecen soluciones económicas para cargas de trabajo de gran volumen. Al recurrir a varios proveedores, las empresas pueden lograr el equilibrio perfecto entre <strong>rendimiento, coste y eficiencia,</strong> asegurándose de disponer siempre de la herramienta adecuada para la tarea</p> en cuestión. <p>Este enfoque también ofrece beneficios prácticos, como evitar la dependencia de un solo proveedor, garantizar un servicio ininterrumpido durante posibles interrupciones y cumplir con los requisitos normativos o de <strong>privacidad</strong> específicos. Además, dado que la tecnología de inteligencia artificial avanza a un ritmo acelerado, trabajar con varios proveedores mantiene la agilidad de las empresas y les permite adoptar funciones de vanguardia sin tener que esperar a que un solo proveedor se ponga al</p> día. «}}]}