La IA generativa se ha convertido en una piedra angular para las empresas, ya que transforma los flujos de trabajo, reduce los costos y aumenta la eficiencia. Sin embargo, elegir el proveedor adecuado es fundamental.

He aquí un rápido desglose de los cinco principales actores del mercado:

Cada proveedor tiene puntos fuertes únicos, desde el control de costos y el acceso multimodelo hasta integraciones perfectas y capacidades avanzadas de inteligencia artificial. Su elección depende de sus prioridades: ahorro de costes, flexibilidad técnica o integración del ecosistema.

Sugerencia: Pruebe plataformas con proyectos piloto para validar el rendimiento, los costos y la usabilidad según sus necesidades.

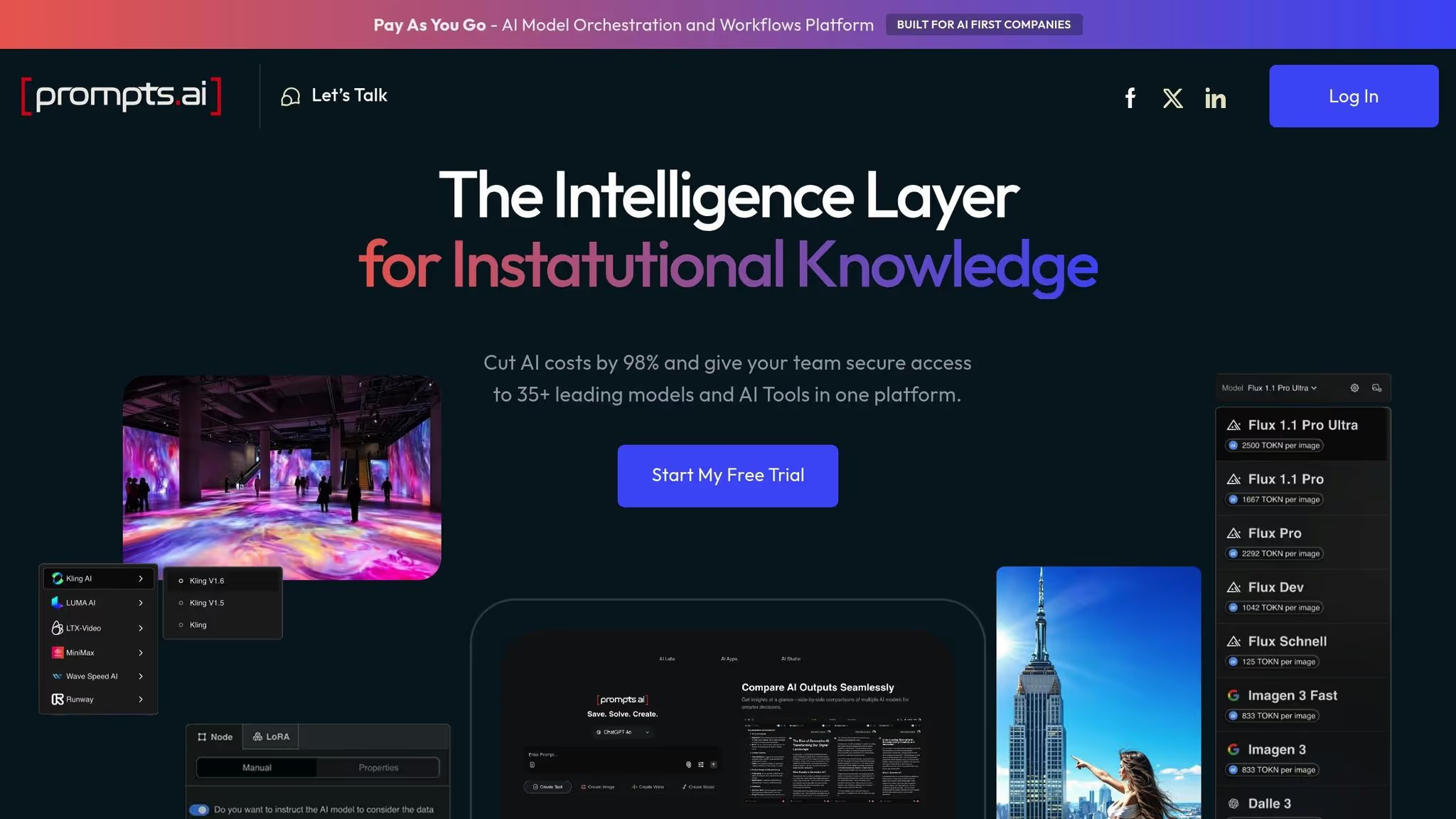

Prompts.ai se destaca como plataforma de orquestación de IA de nivel empresarial que simplifica la administración de múltiples herramientas de IA. En lugar de obligar a las organizaciones a hacer malabares con distintas suscripciones para distintos modelos, consolida el acceso a más de 35 de los principales modelos lingüísticos de gran tamaño, incluido el GPT-5, Claudio, Llama, Géminis, Grok-4, Flux Pro y Kling, en una única interfaz unificada.

Fundada por el director creativo Steven P. Simmons, la plataforma se basa en la idea de crear «La capa de inteligencia para el conocimiento institucional». Su misión es dotar de estructura y eficiencia a la adopción de la IA a gran escala, para atender a una amplia gama de organizaciones, desde empresas de la lista Fortune 500 hasta agencias creativas y laboratorios de investigación, todas las cuales requieren flujos de trabajo confiables y auditables sin comprometer la flexibilidad.

La arquitectura de Prompts.ai está diseñada para una integración perfecta de varios modelos. Los equipos pueden cambiar entre modelos de IA dentro del mismo flujo de trabajo sin necesidad de reconfigurar los sistemas ni administrar varias claves de API. Esto permite a los usuarios comparar directamente modelos como el GPT-5, el Claude y el Gemini uno al lado del otro para determinar cuál funciona mejor para necesidades específicas. Por ejemplo, un modelo puede sobresalir en la elaboración de textos de marketing creativos, mientras que otro es más adecuado para generar documentación técnica precisa.

La plataforma también proporciona API y conectores que se integran con varios modelos básicos, lo que garantiza que las organizaciones no estén limitadas a un solo proveedor. Por ejemplo, un equipo de marketing podría probar diferentes variantes de pronósticos en varios modelos simultáneamente, identificar la combinación más eficaz y estandarizar ese enfoque en toda la organización. Esta flexibilidad permite a los equipos utilizar modelos especializados adaptados a sus requisitos únicos.

Una característica destacada de Prompts.ai es su Capa FinOps, que rastrea el uso de los tokens en todos los modelos y equipos. La plataforma ofrece planes empresariales: Core (99$ por miembro/mes), Pro (119$ por miembro/mes) y Elite (129$ por miembro/mes), que incluyen Análisis de uso, que proporciona información detallada sobre las interacciones de la IA y el consumo de recursos. Los equipos financieros pueden supervisar los gastos departamentales, identificar qué modelos suponen los costes más altos e identificar las áreas de optimización.

Prompts.ai también presenta Créditos TOKN, un modelo de pago por uso que reemplaza las suscripciones mensuales fijas tradicionales. En lugar de pagar una tarifa fija independientemente del uso, las organizaciones compran créditos TOKN y los consumen según sea necesario. Este enfoque vincula directamente los costos con el uso real, lo que facilita la ampliación o reducción de los recursos de IA en función de las demandas empresariales. Funciones como la agrupación de TOKN y la agrupación de almacenamiento permiten a los equipos compartir créditos, lo que permite un seguimiento centralizado y una mejor gestión del presupuesto.

Para las empresas que luchan por hacerse una idea clara de sus gastos en IA, esta transparencia puede suponer importantes ahorros. Prompts.ai afirma que puede ayudar a las organizaciones reducir los costos de software de IA hasta en un 98% eliminando las suscripciones redundantes y optimizando el uso del modelo en función de los datos de rendimiento y costos.

Con estructuras de costes claras, Prompts.ai facilita la automatización eficiente de los flujos de trabajo, maximizando la productividad y el rendimiento. Los equipos pueden cree, programe y ejecute solicitudes como parte de flujos de trabajo automatizados más amplios. Por ejemplo, un equipo de servicio al cliente podría automatizar las respuestas a consultas comunes, mientras que un equipo de contenido podría programar publicaciones periódicas en redes sociales o borradores de blogs. La compatibilidad de la plataforma con la lógica condicional permite a los usuarios adaptar los flujos de trabajo, por ejemplo, dirigir las consultas técnicas a un modelo y las tareas creativas a otro.

La biblioteca «Time Savers» prediseñada simplifica la implementación al ofrecer plantillas de mensajes listas para usar que los equipos pueden compartir internamente. Esto garantiza una calidad uniforme en todos los departamentos y ayuda a los nuevos usuarios a ponerse al día rápidamente.

Prompts.ai hace hincapié en los flujos de trabajo de IA seguros y eficientes en todos los departamentos. La plataforma incorpora funciones sólidas de seguridad y cumplimiento, como control de acceso basado en funciones, que permite a los administradores definir quién puede acceder a indicaciones, modelos o flujos de trabajo específicos. Registros de auditoría mantenga un registro detallado de todas las interacciones de la IA, garantizando el cumplimiento de la normativa. Los datos confidenciales se protegen mediante cifrado tanto en tránsito como en reposo, lo que responde a las necesidades de sectores como el sanitario y el financiero.

Para las organizaciones que requieren un cumplimiento estricto, funciones como la administración de la gobernanza y la supervisión del cumplimiento garantizan que las políticas se apliquen en todo el uso de la IA. Por ejemplo, una institución financiera puede restringir el acceso a las instrucciones confidenciales únicamente al personal autorizado y, al mismo tiempo, mantener un registro completo de cada interacción con fines de auditoría. Este nivel de control es fundamental para cumplir con normativas como la HIPAA, el SOC 2 o el RGPD.

Prompts.ai también ofrece un Programa de certificación rápida de ingenieros capacitar a los miembros del equipo interno en la creación y el mantenimiento de flujos de trabajo de IA que se alineen con los estándares de la organización. Al invertir en la experiencia de los equipos, las empresas pueden garantizar que las políticas de gobierno se implementen de manera efectiva en las operaciones diarias, en lugar de ser reglas abstractas difíciles de seguir.

Los niveles de precios de la plataforma se adaptan a una variedad de usuarios, desde particulares hasta empresas. Las opciones incluyen el plan Pay As You Go gratuito para explorar, el plan Creator (29$ al mes) y el plan familiar (99$ al mes) para uso personal, así como los planes empresariales Core, Pro y Elite. Esta gama ayuda a las organizaciones en todas las etapas de su proceso de desarrollo hacia la IA, ya sea que estén empezando a implementar la IA o iniciando el proceso de expansión para lograr una implementación empresarial completa.

Microsoft ha consolidado su papel como actor clave en la IA generativa a través de una asociación estratégica con OpenAI y al integrar las capacidades de IA en su amplia gama de productos. Al integrar la IA en herramientas en las que la gente ya confía, como las aplicaciones de Office y los servicios en la nube, Microsoft hace que la IA avanzada sea accesible y práctica para una amplia gama de usuarios.

En el centro de la estrategia de IA de Microsoft se encuentra la Servicio Azure OpenAI, que permite a las empresas acceder a los modelos de OpenAI, incluidos el GPT-4 y el GPT-4 Turbo. Este servicio permite a las empresas implementar estos modelos en sus propios entornos de nube, lo que garantiza que mantienen el control sobre la residencia y el uso de los datos. Los desarrolladores también pueden ajustar estos modelos utilizando datos propios, lo que les permite adaptar la IA a las necesidades específicas de la industria, como comprender la terminología especializada o los flujos de trabajo.

Para aumentar aún más la flexibilidad, Estudio de IA de Azure ofrece una variedad de modelos básicos de varios proveedores. Esta plataforma permite a las organizaciones experimentar con diferentes modelos y comparar su desempeño en varias tareas antes de comprometerse con la implementación de la producción. Desde la generación de texto y la creación de imágenes hasta la finalización de códigos y el reconocimiento de voz, Azure AI Studio brinda a los equipos técnicos las herramientas necesarias para adaptar el modelo correcto a sus desafíos específicos.

Microsoft también ha integrado la IA directamente en sus herramientas de productividad con Copiloto de Microsoft 365. Esta función lleva el GPT-4 a aplicaciones conocidas como Word, Excel, PowerPoint, Outlook y Teams. Con Copilot, los usuarios pueden realizar tareas como resumir reuniones en Teams, redactar correos electrónicos en Outlook o analizar datos en Excel, todo ello sin salir de la aplicación en la que están trabajando. Esta perfecta integración simplifica los flujos de trabajo y mantiene a los usuarios concentrados en sus tareas.

El servicio Azure OpenAI funciona mediante el pago por token y cobra a las empresas según la cantidad de tokens procesados. Los costos de los tokens varían según el modelo, lo que refleja la intensidad computacional de cada uno. Para ayudar a las organizaciones a administrar los gastos, Microsoft proporciona paneles de facturación detallados que desglosan el uso por modelo, aplicación y departamento, lo que brinda a los equipos financieros las herramientas necesarias para monitorear y analizar los gastos relacionados con la IA.

Sin embargo, comprender los costos puede ser un desafío. El consumo de fichas depende de factores como la duración de la solicitud, la complejidad de la respuesta y el modelo específico que se utilice. Las empresas suelen necesitar implementar sistemas de seguimiento para conectar el uso de los tokens con los resultados empresariales y medir el retorno de la inversión (ROI).

Para Copiloto de Microsoft 365, el modelo de precios es diferente. Los usuarios pagan una tarifa fija por usuario además de su suscripción actual a Microsoft 365. Esto simplifica la presupuestación, pero requiere que las organizaciones evalúen si las funciones adicionales se utilizarán con la frecuencia suficiente como para justificar el costo adicional.

De Microsoft Plataforma eléctrica permite a las organizaciones crear flujos de trabajo automatizados que incorporen la IA. Con Power Automate, los usuarios pueden diseñar flujos que activen modelos de IA basados en eventos específicos. Por ejemplo, las empresas pueden analizar automáticamente los comentarios de los clientes, clasificar los tickets de soporte o generar borradores de respuestas a consultas comunes. Estos flujos de trabajo pueden conectarse al servicio Azure OpenAI o usar modelos AI Builder prediseñados para tareas como el análisis de opiniones y la extracción de entidades.

La interfaz de bajo código de la plataforma la hace accesible para usuarios no técnicos. Los equipos pueden arrastrar y soltar componentes, establecer los parámetros del modelo de IA mediante herramientas visuales y probar los flujos de trabajo antes de implementarlos. Para los desarrolladores que buscan una funcionalidad más avanzada, Aplicaciones Azure Logic ofrece la capacidad de diseñar procesos complejos de varios pasos que integran varios modelos de IA, API externas y fuentes de datos. Estos flujos de trabajo pueden gestionar la gestión de errores, la lógica de reintentos y la bifurcación condicional, lo que garantiza que cumplen con las exigencias de las operaciones empresariales a gran escala.

Microsoft pone un gran énfasis en la seguridad y el cumplimiento, especialmente para las industrias con requisitos reglamentarios estrictos. El servicio Azure OpenAI garantiza el aislamiento de los datos, lo que significa que los datos de los clientes que se utilizan para generar respuestas no se comparten externamente ni se utilizan para capacitar a otros modelos. Todos los datos que se intercambian con el servicio están cifrados y se pueden configurar puntos finales privados para mantener el tráfico dentro de redes virtuales seguras.

La plataforma incluye control de acceso basado en funciones (RBAC), que permite a los administradores establecer permisos detallados para la implementación del modelo, el acceso a los recursos y la supervisión del uso. Integración con Azure Active Directory habilita políticas de inicio de sesión único y acceso condicional, mientras que los registros de auditoría capturan las llamadas a la API y las acciones administrativas con fines de cumplimiento.

Para las organizaciones que se rigen por normativas como HIPAA, SOC 2 o GDPR, Microsoft cuenta con certificaciones de cumplimiento para sus servicios de Azure. Estas certificaciones están respaldadas por auditorías periódicas de terceros y por una exhaustiva documentación de seguridad. Las herramientas de filtrado de contenido integradas ayudan a bloquear las entradas o salidas inapropiadas, lo que reduce el riesgo de generar material dañino u ofensivo.

Para proteger aún más el contenido generado por IA, Microsoft ofrece Seguridad del contenido de Azure AI, un servicio diseñado para filtrar textos e imágenes en busca de material dañino antes y después del procesamiento. Las organizaciones pueden personalizar las políticas para definir el uso aceptable, marcando o bloqueando automáticamente el contenido que infrinja las directrices. Esta función es especialmente valiosa para las aplicaciones orientadas al cliente, ya que garantiza que el contenido generado por IA se ajuste tanto a los estándares de la marca como a los requisitos legales.

AWS aprovecha su amplia infraestructura de nube para ofrecer soluciones de IA generativas diseñadas para satisfacer una variedad de demandas empresariales. A diferencia de los proveedores que se centran en un único modelo, AWS hace hincapié en la creación de un ecosistema flexible y escalable. Este enfoque integra a la perfección las capacidades de inteligencia artificial en los entornos de nube empresariales, aprovechando el poder de la escala de la nube para mejorar la funcionalidad y la adaptabilidad.

Las soluciones de IA de Google se centran en combinar la integración, la escalabilidad y los flujos de trabajo simplificados. Con décadas de investigación en inteligencia artificial, vastos recursos informáticos y experiencia avanzada en aprendizaje automático, Google se posiciona como líder en la combinación de tecnología de vanguardia con herramientas prácticas para las empresas. El objetivo es hacer que la IA sea accesible para los equipos con distintos niveles de habilidad y necesidades organizativas.

En el corazón del ecosistema de IA de Google se encuentra Vertex AI, una plataforma unificada que permite a las empresas trabajar sin problemas con varios modelos de IA en un entorno. Es compatible con los modelos patentados de Google, como Gemini y Palma 2y opciones de terceros, que ofrecen flexibilidad para elegir las mejores herramientas para tareas específicas.

Google lleva la integración un paso más allá al integrar la IA generativa directamente en sus herramientas de productividad, como Gmail, Docs y Sheets. Por ejemplo, un equipo de marketing puede crear borradores de campañas y generar conceptos de imagen en Docs, lo que agiliza su flujo de trabajo sin tener que cambiar de plataforma.

Para simplificar la administración de modelos, Google Jardín modelo actúa como un centro central donde los desarrolladores pueden descubrir, personalizar e implementar modelos de IA. Esta configuración reduce los desafíos técnicos que implica gestionar varias versiones y dependencias de modelos. Las organizaciones pueden ajustar los modelos con sus propios datos, asegurándose de que funcionen sin problemas con los sistemas existentes y, al mismo tiempo, manteniendo el control sobre sus operaciones.

La estructura de precios flexible de Google complementa aún más este enfoque.

El modelo de precios de pago por uso de Google cobra por carácter para los modelos de texto y por imagen para los modelos visuales, lo que permite a las organizaciones presupuestar con precisión. La plataforma incluye una calculadora de precios que permite a los usuarios estimar los costos ingresando los volúmenes mensuales esperados, desglosando los gastos por tipo de modelo y operación. Esta transparencia ayuda a los equipos financieros a evitar cargos inesperados y a planificar de manera eficaz.

Para las empresas con un uso constante de la IA, Google ofrece descuentos por uso sostenido. Estas reducciones integradas pueden reducir los costos hasta un 30% para los usuarios habituales, lo que las convierte en una opción atractiva para las empresas que realizan operaciones de IA a gran escala. A diferencia de las promociones temporales, estos descuentos recompensan el uso continuo y proporcionan ahorros a largo plazo.

Google mejora la productividad con flujos de trabajo automatizados impulsados por Funciones en la nube y Ejecución en la nube, lo que permite que las operaciones impulsadas por la IA se activen a partir de eventos específicos. Por ejemplo, los flujos de trabajo de atención al cliente pueden redactar respuestas y enviarlas para su revisión por humanos.

La plataforma también cuenta con Dialogflow CX, que admite la creación de agentes de IA conversacional avanzados. Estos agentes pueden gestionar tareas como la programación de citas, el procesamiento de pedidos y la resolución de problemas. Cuando una tarea supera las capacidades del agente, transfiere sin problemas la conversación a un representante humano, incluido el contexto completo de la interacción.

A través de Apigee, las empresas pueden exponer sus capacidades de IA como API gestionadas. Esto incluye funciones como la limitación de velocidad, la autenticación y la supervisión, que facilitan la integración de la IA en las aplicaciones móviles, las plataformas web y los sistemas de los socios. Los equipos de desarrollo pueden analizar el uso de las API para identificar y resolver posibles cuellos de botella, garantizando así una experiencia de usuario fluida.

Para las organizaciones con requisitos normativos estrictos, Google ofrece herramientas de gobierno sólidas. Controles de servicio de VPC garantizar que los datos se mantengan dentro de los límites designados, una característica fundamental para industrias como la salud y las finanzas.

Para proteger la información confidencial, Google Prevención de pérdida de datos (DLP) escanea las entradas y salidas de la IA para obtener detalles como números de tarjetas de crédito y datos de la seguridad social. En función de las políticas predefinidas, el sistema puede redactar, enmascarar o bloquear contenido confidencial.

Google también proporciona información detallada Registros de auditoría en la nube, que rastrean cada interacción con los modelos de IA, incluido quién accedió a ellos, qué datos se procesaron y cuándo se realizaron las operaciones. Estos registros se integran con los sistemas de información de seguridad y gestión de eventos (SIEM), lo que brinda a los equipos de seguridad una visibilidad completa del uso de la IA. Los responsables de cumplimiento pueden generar informes para demostrar el cumplimiento de las políticas internas y las normativas externas sin intervención manual.

Además, Federación de identidades de carga de trabajo permite a las organizaciones usar sus proveedores de identidad existentes para la administración del acceso. Esto elimina la necesidad de tener credenciales de Google Cloud independientes, lo que simplifica los permisos y garantiza que se ajusten a las funciones y responsabilidades de la organización.

OpenAI se destaca por combinar avances de vanguardia con aplicaciones prácticas diseñadas para las empresas. Sus modelos destacan en áreas como la comprensión del lenguaje, la generación de contenido creativo y la resolución de problemas complejos. Al centrarse en la mejora continua y ofrecer herramientas fáciles de usar para los desarrolladores, OpenAI se ha convertido en la solución ideal para tareas que van desde la automatización de la atención al cliente hasta la asistencia en el desarrollo de software.

OpenAI proporciona acceso a varias familias de modelos potentes a través de su API:

La plataforma también admite llamada a funciones, lo que permite a los modelos interactuar con herramientas y bases de datos externas. Por ejemplo, un chatbot del servicio de atención al cliente puede comprobar sin problemas el estado de los pedidos o actualizar los detalles de la cuenta en tiempo real, lo que mejora la eficiencia y la experiencia del usuario.

Además, OpenAI ofrece opciones de ajuste, lo que permite a las empresas adaptar los modelos utilizando sus conjuntos de datos patentados. Esta personalización garantiza que los resultados se ajusten a la terminología específica del sector, las directrices de la marca o la experiencia especializada, sin necesidad de una configuración de aprendizaje automático a gran escala.

OpenAI emplea un sistema de precios basado en tokens, donde los costos se calculan en función del número de tokens de entrada y salida. Este modelo flexible permite a las empresas predecir los gastos en función de su uso previsto. Para mantener el control sobre los gastos, OpenAI ofrece paneles y herramientas integrados para monitorear el uso y establecer límites de gasto. Este enfoque de precios sencillo facilita a los equipos la integración de la automatización sin costes inesperados.

La integración con los modelos de OpenAI es sencilla, gracias a las API REST estándar que devuelven respuestas JSON estructuradas. Funciones como las salidas de streaming mejoran las interacciones en tiempo real al enviar texto de forma incremental, lo que mejora el flujo de la conversación. Además, la API de moderación garantiza que el contenido se revise en tiempo real, manteniendo el cumplimiento y la seguridad.

OpenAI prioriza la seguridad y la gobernanza al proteger el acceso a la API con claves secretas y aplicar políticas estrictas de privacidad de datos. Los equipos pueden supervisar el uso de las API mediante los controles de las cuentas, garantizando así el cumplimiento y la seguridad de las operaciones en todos los ámbitos. Este enfoque en la gobernanza convierte a OpenAI en una opción confiable para despliegues de nivel empresarial.

Esta sección proporciona una descripción general concisa de las características más destacadas y los posibles inconvenientes de cada plataforma, lo que le ayuda a alinear sus necesidades específicas con la plataforma más adecuada.

Cada proveedor aporta ventajas y desventajas únicas, ya que ofrece soluciones adaptadas a las diferentes prioridades organizativas y requisitos técnicos.

Prompts.ai simplifica la gestión de la IA al ofrecer una interfaz unificada que admite el acceso multimodelo. Su capa FinOps integrada proporciona información en tiempo real sobre el uso y los costos de los tokens, lo que permite a los equipos controlar los gastos de manera eficiente. El sistema de crédito TOKN de pago por uso garantiza que solo pagues por lo que utilizas. Además, la plataforma admite un programa rápido de certificación de ingeniería y flujos de trabajo compartidos por la comunidad, que ayudan a los equipos a adoptar las mejores prácticas con mayor rapidez.

Microsoft se integra perfectamente con las herramientas en las que muchas organizaciones ya confían, como Office 365, Teams y Azure. Esta integración permite a los equipos incorporar capacidades de inteligencia artificial en entornos familiares y, al mismo tiempo, beneficiarse de sólidos controles de seguridad y certificaciones de cumplimiento. Sin embargo, esta estrecha integración a veces puede llevar a la dependencia de un solo proveedor, lo que limita la flexibilidad de las organizaciones que buscan alternativas fuera del ecosistema de Microsoft.

AWS destaca por su amplia infraestructura global y una amplia gama de opciones de procesamiento, desde funciones sin servidor hasta instancias de GPU dedicadas. Sus herramientas de gobierno avanzadas ofrecen controles de acceso granulares y registros de auditoría detallados, lo que la convierte en una opción sólida para los equipos con una sólida experiencia en DevOps. Por el lado negativo, las amplias opciones de configuración de la plataforma pueden resultar abrumadoras para los equipos más pequeños, y es necesaria una gestión cuidadosa de los costos para evitar gastos inesperados.

Google aprovecha su investigación avanzada de IA a través de Vertex AI, que ofrece herramientas sofisticadas para el entrenamiento y la implementación de modelos personalizados. La integración con Google Workspace facilita la incorporación de la inteligencia artificial en las tareas empresariales rutinarias. Si bien estas funciones son ideales para los equipos de ciencia de datos, pueden suponer una curva de aprendizaje empinada para las organizaciones con una experiencia limitada en aprendizaje automático.

IA abierta es famosa por sus API fáciles de usar para desarrolladores y por su amplia documentación, lo que simplifica la integración de modelos como el GPT-4 y el DALL-E 3 en las aplicaciones. Sus precios flexibles y sus opciones de personalización proporcionan previsibilidad y control. Sin embargo, confiar en la hoja de ruta de un único proveedor puede limitar su control sobre la disponibilidad y los precios de los modelos futuros.

Al elegir una plataforma, las organizaciones deben tener en cuenta sus prioridades. Quienes buscan flexibilidad y control de costos pueden optar por plataformas que ofrezcan acceso multimodelo, mientras que las empresas que ya están integradas en un ecosistema de nube específico pueden preferir soluciones que se integren perfectamente con sus herramientas existentes. Los equipos de desarrollo que buscan una integración rápida de las API probablemente valorarán una implementación sencilla, mientras que los equipos que se centran en la investigación pueden priorizar el acceso a arquitecturas de modelos vanguardistas.

Las estructuras de precios también desempeñan un papel crucial. Algunas plataformas cobran en función de los recursos informáticos, otras en función de los tokens de API, mientras que Prompts.ai ofrece un sistema basado en créditos. Comprender estos modelos de precios y alinearlos con tus patrones de uso es fundamental para gestionar los gastos de forma eficaz.

La seguridad y el cumplimiento son igualmente importantes, especialmente para las industrias reguladas. Las plataformas con certificaciones como SOC 2, HIPAA o FedRAMP son esenciales para cumplir con los estándares del sector. Las funciones, como los registros de auditoría, los controles de acceso y las políticas de retención de datos, varían según el proveedor, por lo que es fundamental adaptar estas capacidades a sus requisitos de gobierno antes de tomar una decisión.

La elección del proveedor de IA generativa adecuado depende de las prioridades de la organización, la infraestructura existente y los objetivos a largo plazo. Este es un desglose de los puntos fuertes que aporta cada proveedor para ayudarte a tomar una decisión informada:

Prompts.ai reúne más de 35 modelos en una sola plataforma, junto con una capa FinOps que puede reducir los costos hasta en un 98% utilizando su sistema de crédito TOKN de pago por uso. Su rápido programa de certificación de ingeniería y sus flujos de trabajo compartidos facilitan a los equipos la adopción y el escalamiento entre departamentos.

Microsoft se integra perfectamente con Azure y Office 365, lo que lo convierte en una opción natural para las empresas que ya han invertido en este ecosistema. Sin embargo, esta estrecha integración puede limitar la flexibilidad a la hora de explorar otras soluciones.

AWS destaca por su escalabilidad, respaldada por una infraestructura global y una amplia gama de opciones de procesamiento. Dicho esto, la gestión de sus complejas configuraciones normalmente requiere una sólida experiencia en DevOps.

Google brilla con su plataforma Vertex AI, que ofrece capacidades avanzadas de entrenamiento de modelos. Esto la convierte en una opción sólida para los equipos que realizan una gran cantidad de investigación y cuentan con una amplia experiencia en aprendizaje automático.

IA abierta es ideal para los desarrolladores que valoran la integración rápida de las API y la documentación detallada. Sin embargo, su dependencia de una hoja de ruta única puede restringir el control sobre los precios y las futuras actualizaciones de los modelos.

Al tomar una decisión, tenga en cuenta el enfoque de su organización. Priorización de los equipos ahorro de costes y flexibilidad debe buscar plataformas que ofrezcan acceso multimodelo con precios claros y transparentes. Aquellos integrados en ecosistemas de nube específicos se beneficiará de las integraciones nativas con las herramientas existentes. Equipos centrados en los desarrolladores debe buscar API simplificadas y una documentación sólida, al mismo tiempo grupos impulsados por la investigación puede necesitar plataformas que ofrezcan arquitecturas de modelos avanzadas y personalización.

La consolidación de los flujos de trabajo de la IA es clave para mejorar tanto el rendimiento como la rentabilidad. Evalúe cada plataforma no solo por sus capacidades actuales, sino también por la forma en que su hoja de ruta se alinea con el crecimiento futuro de su organización. Evalúe cuidadosamente las ventajas y desventajas entre la conveniencia de la integración y los riesgos de dependencia de un proveedor. Evalúe si su equipo cuenta con la experiencia técnica necesaria para gestionar configuraciones complejas o si se beneficiaría de una solución unificada y más gestionada.

Antes de comprometerse con un solo proveedor, pruebe varias plataformas con proyectos piloto. Este enfoque ayuda a validar las suposiciones sobre el rendimiento, el costo y la usabilidad en el contexto de sus necesidades específicas. Preste especial atención a la forma en que los precios varían con el uso y asegúrese de que las funciones de seguridad y cumplimiento cumplan con los estándares reglamentarios de su sector.

Al elegir un proveedor de IA generativa, es importante sopesar varios factores para encontrar el que mejor se adapte a tu negocio. Empieza con el modelos de precios - busque proveedores que ofrezcan costos iniciales claros y planes flexibles que puedan adaptarse a su presupuesto. A continuación, evalúe el características y capacidades disponible. Ya sea que necesite procesamiento del lenguaje natural, herramientas de creación de contenido o automatización del flujo de trabajo, asegúrese de que la plataforma se adapte a sus necesidades específicas.

También es esencial comprobar si hay alguna límites de uso o restricciones para confirmar que la solución puede crecer junto con su empresa. El historial de innovación de un proveedor y la calidad de su atención al cliente pueden ofrecer información adicional sobre su fiabilidad. Si considera detenidamente estos elementos, puede tomar una decisión que se alinee con sus objetivos y prepare a su empresa para el éxito.

Prompts.ai facilita la administración de los costos con su Capa FinOps. Esta función proporciona información en tiempo real sobre el uso, el gasto y el retorno de la inversión (ROI), lo que brinda a las empresas una visión clara de sus gastos relacionados con la IA.

Con herramientas que identifican las ineficiencias y ofrecen recomendaciones prácticas, Prompts.ai ayuda a las organizaciones a aprovechar al máximo sus inversiones y, al mismo tiempo, a mantener el control sobre los presupuestos. Es una forma práctica de alinear la disciplina financiera con la búsqueda de la innovación.

La integración de la IA generativa en sus flujos de trabajo puede transformar la forma en que se gestionan las tareas. Por automatizar las actividades repetitivas, aumenta la productividad y permite la creación de contenido nuevo y atractivo. Esta tecnología simplifica los procesos, ahorra un tiempo valioso y crea espacio para un trabajo más creativo y eficiente.

Dicho esto, hay algunos obstáculos que sortear. La implementación y la personalización de los sistemas de IA generativa a menudo exigen habilidades técnicas especializadas, y garantizar privacidad y seguridad de los datos añade otra capa de complejidad. Para garantizar una integración exitosa, es crucial planificar cuidadosamente y tener una visión clara de sus objetivos.