L'IA générative est devenue la pierre angulaire des entreprises, transformant les flux de travail, réduisant les coûts et augmentant l'efficacité. Mais il est essentiel de choisir le bon fournisseur.

Voici un bref aperçu des cinq principaux acteurs du marché :

Chaque fournisseur possède des atouts uniques, qu'il s'agisse du contrôle des coûts, de l'accès multimodèle ou d'intégrations fluides et de capacités d'IA avancées. Votre choix dépend de vos priorités : économies de coûts, flexibilité technique ou intégration de l'écosystème.

Astuce: Testez des plateformes avec des projets pilotes pour valider les performances, les coûts et la facilité d'utilisation en fonction de vos besoins.

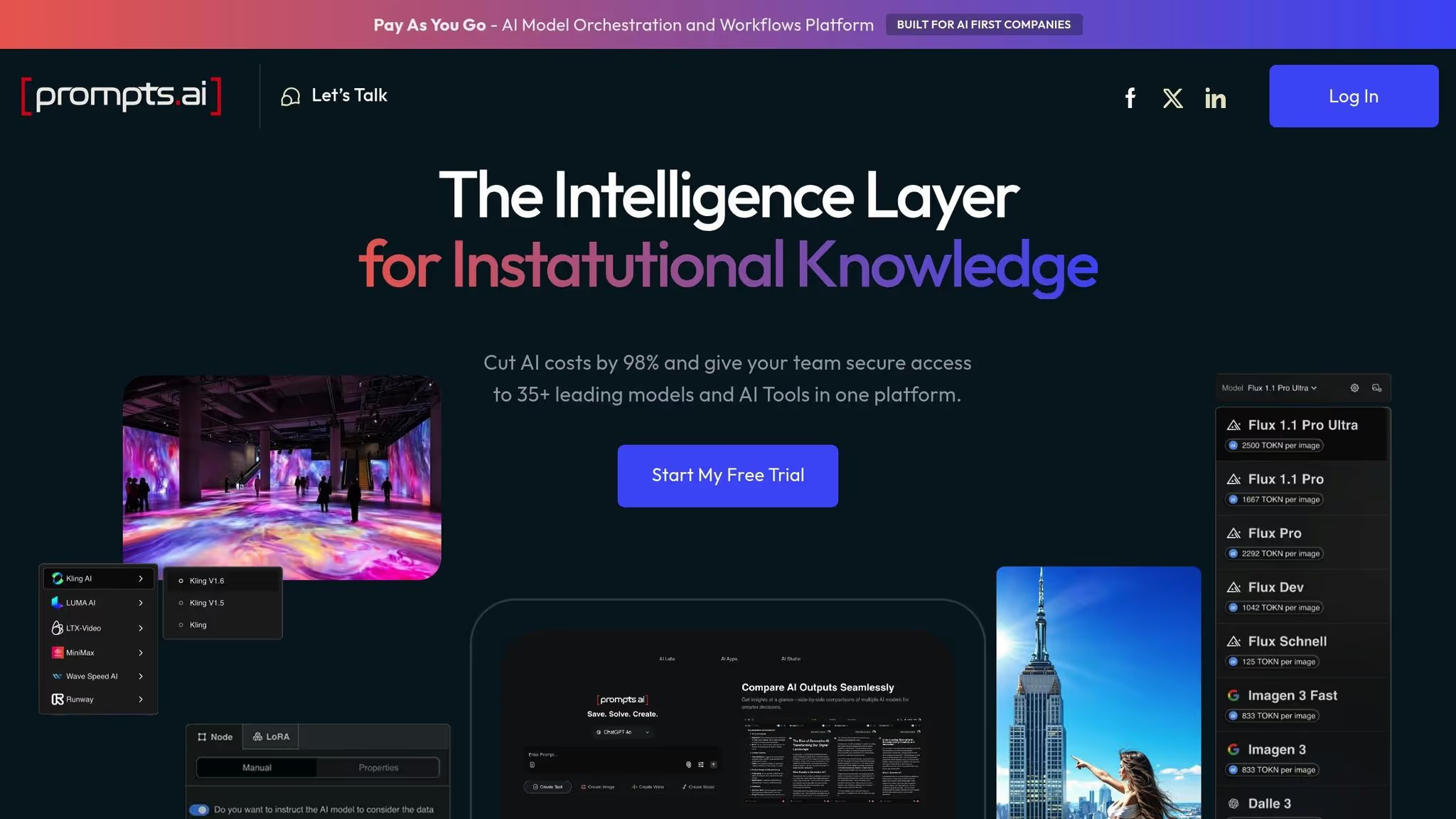

Prompts.ai se distingue en tant que plateforme d'orchestration d'IA de niveau entreprise qui simplifie la gestion de plusieurs outils d'IA. Au lieu d'obliger les entreprises à jongler entre des abonnements distincts pour différents modèles, il consolide l'accès à plus de 35 grands modèles linguistiques de premier plan, dont GPT-5, Claude, Lama, Gémeaux, Grok-4, Flux Pro et Kling, dans une interface unique et unifiée.

Fondée par le directeur artistique Steven P. Simmons, la plateforme repose sur l'idée de créer « la couche d'intelligence pour les connaissances institutionnelles ». Sa mission est d'apporter structure et efficacité à l'adoption à grande échelle de l'IA, répondant aux besoins d'un large éventail d'organisations, des entreprises du Fortune 500 aux agences de création et aux laboratoires de recherche, qui ont toutes besoin de flux de travail fiables et vérifiables sans compromettre la flexibilité.

L'architecture de Prompts.ai est conçue pour une intégration fluide de plusieurs modèles. Les équipes peuvent basculer entre les modèles d'IA au sein du même flux de travail sans avoir à reconfigurer les systèmes ou à gérer plusieurs clés d'API. Cela permet aux utilisateurs de comparer directement des modèles tels que GPT-5, Claude et Gemini côte à côte afin de déterminer lequel répond le mieux à des besoins spécifiques. Par exemple, un modèle peut exceller dans la création de textes marketing créatifs, tandis qu'un autre convient mieux à la génération de documentation technique précise.

La plateforme fournit également des API et des connecteurs qui s'intègrent à différents modèles de base, garantissant ainsi que les organisations ne sont pas bloquées par un seul fournisseur. Par exemple, une équipe marketing pourrait tester différentes variations de prompts sur plusieurs modèles simultanément, identifier la combinaison la plus efficace et standardiser cette approche au sein de l'organisation. Cette flexibilité permet aux équipes d'utiliser des modèles spécialisés adaptés à leurs besoins uniques.

Une caractéristique remarquable de Prompts.ai est sa couche FinOps, qui suit l'utilisation des jetons sur tous les modèles et toutes les équipes. La plateforme propose des forfaits d'entreprise - Core (99 $/membre/mois), Pro (119 $/membre/mois) et Elite (129 $/membre/mois) - qui incluent Analyses d'utilisation, fournissant des informations détaillées sur les interactions de l'IA et la consommation de ressources. Les équipes financières peuvent surveiller les dépenses des départements, identifier les modèles les plus coûteux et identifier les domaines à optimiser.

Prompts.ai présente également Crédits TOKN, un modèle de paiement à l'utilisation qui remplace les abonnements mensuels fixes traditionnels. Au lieu de payer des frais fixes quelle que soit leur utilisation, les organisations achètent des crédits TOKN et les consomment selon leurs besoins. Cette approche lie directement les coûts à l'utilisation réelle, ce qui facilite l'augmentation ou la diminution des ressources d'IA en fonction des demandes de l'entreprise. Des fonctionnalités telles que TOKN Pooling et Storage Pooling permettent aux équipes de partager des crédits, ce qui permet un suivi centralisé et une meilleure gestion du budget.

Pour les entreprises qui ont du mal à se faire une idée précise de leurs dépenses en matière d'IA, cette transparence peut permettre de réaliser des économies importantes. Prompts.ai prétend pouvoir aider les organisations réduire les coûts des logiciels d'IA jusqu'à 98 % en éliminant les abonnements redondants et en optimisant l'utilisation des modèles en fonction des données de performance et de coûts.

Grâce à des structures de coûts claires, Prompts.ai facilite l'automatisation efficace des flux de travail, maximisant ainsi la productivité et les performances. Les équipes peuvent créez, planifiez et exécutez des instructions dans le cadre de flux de travail automatisés plus importants. Par exemple, une équipe du service client peut automatiser les réponses aux demandes courantes, tandis qu'une équipe de contenu peut programmer des publications régulières sur les réseaux sociaux ou des brouillons de blog. La prise en charge de la logique conditionnelle par la plateforme permet aux utilisateurs d'adapter les flux de travail, par exemple en acheminant les requêtes techniques vers un modèle et les tâches créatives vers un autre.

La bibliothèque « Time Savers » prédéfinie simplifie la mise en œuvre en proposant des modèles d'invite prêts à l'emploi que les équipes peuvent partager en interne. Cela garantit une qualité constante dans tous les services et aide les nouveaux utilisateurs à se mettre rapidement au courant.

Prompts.ai met l'accent sur des flux de travail d'IA sécurisés et efficaces dans tous les départements. La plateforme intègre des fonctionnalités de sécurité et de conformité robustes, telles que contrôle d'accès basé sur les rôles, qui permet aux administrateurs de définir qui peut accéder à des invites, des modèles ou des flux de travail spécifiques. Pistes d'audit conserver un enregistrement détaillé de toutes les interactions avec l'IA, afin de garantir la conformité réglementaire. Les données sensibles sont protégées par chiffrement à la fois en transit et au repos, répondant ainsi aux besoins de secteurs tels que la santé et la finance.

Pour les organisations qui exigent une conformité stricte, des fonctionnalités telles que l'administration de la gouvernance et la surveillance de la conformité garantissent l'application des politiques pour toutes les utilisations de l'IA. Par exemple, une institution financière peut limiter l'accès aux messages sensibles au personnel autorisé uniquement, tout en conservant un journal complet de chaque interaction à des fins d'audit. Ce niveau de contrôle est essentiel pour respecter les réglementations telles que HIPAA, SOC 2 ou GDPR.

Prompts.ai propose également un Programme de certification Prompt Engineer pour former les membres de l'équipe interne à la création et à la gestion de flux de travail d'IA conformes aux normes organisationnelles. En investissant dans l'expertise des équipes, les entreprises peuvent s'assurer que les politiques de gouvernance sont mises en œuvre efficacement dans leurs opérations quotidiennes, au lieu de constituer des règles abstraites difficiles à suivre.

Les niveaux de tarification de la plateforme s'adressent à une variété d'utilisateurs, des particuliers aux entreprises. Les options incluent un niveau Pay As You Go gratuit pour l'exploration, les options Creator (29 $/mois) et Family Plan (99 $/mois) pour un usage personnel, ainsi que les plans d'entreprise Core, Pro et Elite. Cette gamme soutient les organisations à chaque étape de leur parcours vers l'IA, qu'elles démarrent ou passent à un déploiement complet en entreprise.

Microsoft a consolidé son rôle d'acteur clé de l'IA générative grâce à un partenariat stratégique avec OpenAI et en intégrant les capacités de l'IA à sa vaste gamme de produits. En intégrant l'IA à des outils sur lesquels les utilisateurs s'appuient déjà, tels que les applications Office et les services cloud, Microsoft rend l'IA avancée accessible et pratique pour un large éventail d'utilisateurs.

Au cœur de la stratégie d'IA de Microsoft se trouve Service Azure OpenAI, qui permet aux entreprises d'accéder aux modèles d'OpenAI, notamment GPT-4 et GPT-4 Turbo. Ce service permet aux entreprises de déployer ces modèles dans leurs propres environnements cloud, en leur garantissant le contrôle de la résidence et de l'utilisation des données. Les développeurs peuvent également affiner ces modèles à l'aide de données propriétaires, ce qui leur permet d'adapter l'IA aux besoins spécifiques du secteur, tels que la compréhension de la terminologie spécialisée ou des flux de travail.

Pour améliorer encore la flexibilité, Azure AI Studio propose une variété de modèles de fondation provenant de plusieurs fournisseurs. Cette plateforme permet aux organisations d'expérimenter différents modèles, de comparer leurs performances sur différentes tâches avant de s'engager dans un déploiement en production. De la génération de texte à la création d'images, en passant par la complétion de code et la reconnaissance vocale, Azure AI Studio fournit aux équipes techniques les outils nécessaires pour adapter le modèle adapté à leurs défis spécifiques.

Microsoft a également intégré l'IA directement dans ses outils de productivité avec Copilote Microsoft 365. Cette fonctionnalité permet d'intégrer GPT-4 à des applications familières telles que Word, Excel, PowerPoint, Outlook et Teams. Avec Copilot, les utilisateurs peuvent effectuer des tâches telles que la synthèse de réunions dans Teams, la rédaction d'e-mails dans Outlook ou l'analyse de données dans Excel, le tout sans quitter l'application dans laquelle ils travaillent. Cette intégration fluide simplifie les flux de travail et permet aux utilisateurs de se concentrer sur leurs tâches.

Le service Azure OpenAI fonctionne sur la base du paiement par jeton, facturant les entreprises en fonction du nombre de jetons traités. Les coûts des jetons varient selon les modèles, en fonction de l'intensité de calcul de chacun. Pour aider les entreprises à gérer leurs dépenses, Microsoft fournit des tableaux de bord de facturation détaillés qui ventilent l'utilisation par modèle, application et service, fournissant aux équipes financières les outils nécessaires pour surveiller et analyser les dépenses liées à l'IA.

Cependant, il peut être difficile de comprendre les coûts. La consommation de jetons dépend de facteurs tels que la longueur du message, la complexité de la réponse et le modèle spécifique utilisé. Les entreprises ont souvent besoin de mettre en œuvre des systèmes de suivi pour relier l'utilisation des jetons aux résultats commerciaux et mesurer leur retour sur investissement (ROI).

Pour Copilote Microsoft 365, le modèle de tarification est différent. Les utilisateurs paient des frais fixes par utilisateur en plus de leur abonnement Microsoft 365 existant. Cela simplifie la budgétisation mais oblige les organisations à évaluer si les fonctionnalités ajoutées seront utilisées suffisamment fréquemment pour justifier le coût supplémentaire.

de Microsoft Plateforme d'alimentation permet aux organisations de créer des flux de travail automatisés intégrant l'IA. Avec Power Automate, les utilisateurs peuvent concevoir des flux qui déclenchent des modèles d'IA en fonction d'événements spécifiques. Par exemple, les entreprises peuvent analyser automatiquement les commentaires des clients, classer les tickets d'assistance par catégorie ou générer des brouillons de réponses aux demandes courantes. Ces flux de travail peuvent se connecter au service Azure OpenAI ou utiliser des modèles AI Builder prédéfinis pour des tâches telles que l'analyse des sentiments et l'extraction d'entités.

L'interface low-code de la plateforme la rend accessible aux utilisateurs non techniques. Les équipes peuvent glisser-déposer des composants, définir les paramètres des modèles d'IA à l'aide d'outils visuels et tester les flux de travail avant de les déployer. Pour les développeurs qui recherchent des fonctionnalités plus avancées, Applications Azure Logic offre la possibilité de concevoir des processus complexes en plusieurs étapes qui intègrent plusieurs modèles d'IA, des API externes et des sources de données. Ces flux de travail peuvent gérer la gestion des erreurs, la logique des nouvelles tentatives et le branchement conditionnel, garantissant ainsi qu'ils répondent aux exigences des opérations d'entreprise à grande échelle.

Microsoft accorde une grande importance à la sécurité et à la conformité, en particulier pour les secteurs soumis à des exigences réglementaires strictes. Le service Azure OpenAI garantit l'isolation des données, ce qui signifie que les données clients utilisées pour générer des réponses ne sont pas partagées en externe ni utilisées pour entraîner d'autres modèles. Toutes les données échangées avec le service sont cryptées et des terminaux privés peuvent être configurés pour maintenir le trafic sur des réseaux virtuels sécurisés.

La plateforme comprend contrôle d'accès basé sur les rôles (RBAC), qui permet aux administrateurs de définir des autorisations détaillées pour le déploiement des modèles, l'accès aux ressources et la surveillance de l'utilisation. Intégration avec Azure Active Directory met en place des politiques d'authentification unique et d'accès conditionnel, tandis que les journaux d'audit capturent les appels d'API et les actions administratives à des fins de conformité.

Pour les organisations soumises à des réglementations telles que HIPAA, SOC 2 ou GDPR, Microsoft détient des certifications de conformité pour ses services Azure. Ces certifications sont soutenues par des audits réguliers par des tiers et par une documentation de sécurité complète. Les outils de filtrage de contenu intégrés permettent de bloquer les entrées ou les sorties inappropriées, réduisant ainsi le risque de générer du contenu nuisible ou offensant.

Pour mieux protéger le contenu généré par l'IA, Microsoft propose Sécurité du contenu Azure AI, un service conçu pour filtrer le texte et les images pour détecter tout contenu dangereux avant et après le traitement. Les organisations peuvent personnaliser les politiques pour définir une utilisation acceptable, en signalant ou en bloquant automatiquement le contenu qui enfreint les directives. Cette fonctionnalité est particulièrement utile pour les applications destinées aux clients, car elle garantit que le contenu généré par l'IA est conforme aux normes de la marque et aux exigences légales.

AWS exploite sa vaste infrastructure cloud pour fournir des solutions d'IA génératives conçues pour répondre à diverses demandes des entreprises. Contrairement aux fournisseurs qui se concentrent sur un modèle unique, AWS met l'accent sur la création d'un écosystème flexible et évolutif. Cette approche intègre de manière transparente les capacités d'IA dans les environnements cloud d'entreprise, en tirant parti de la puissance de l'évolutivité du cloud pour améliorer les fonctionnalités et l'adaptabilité.

Les solutions d'IA de Google visent à associer intégration, évolutivité et flux de travail simplifiés. Grâce à des décennies de recherche sur l'IA, à de vastes ressources informatiques et à une expertise avancée en matière d'apprentissage automatique, Google se positionne comme un leader en combinant des technologies de pointe avec des outils pratiques pour les entreprises. L'objectif est de rendre l'IA accessible aux équipes, quel que soit leur niveau de compétence et leurs besoins organisationnels.

Au cœur de l'écosystème d'IA de Google se trouve Vertex AI, une plateforme unifiée qui permet aux entreprises de travailler de manière fluide avec plusieurs modèles d'IA dans un seul environnement. Il prend en charge à la fois les modèles propriétaires de Google, tels que Gemini et PalM 2, et des options tierces, offrant la flexibilité de choisir les meilleurs outils pour des tâches spécifiques.

Google va encore plus loin en intégrant l'IA générative directement dans ses outils de productivité tels que Gmail, Docs et Sheets. Par exemple, une équipe marketing peut créer des brouillons de campagne et générer des concepts d'images dans Docs, rationalisant ainsi son flux de travail sans passer d'une plateforme à l'autre.

Pour simplifier la gestion des modèles, Google Jardin modèle agit comme un hub central où les développeurs peuvent découvrir, personnaliser et déployer des modèles d'IA. Cette configuration réduit les défis techniques liés à la gestion de plusieurs versions et dépendances de modèles. Les organisations peuvent affiner les modèles à partir de leurs propres données, afin de s'assurer qu'ils fonctionnent parfaitement au sein des systèmes existants tout en gardant le contrôle de leurs opérations.

La structure tarifaire flexible de Google vient compléter cette approche.

Le modèle de tarification à l'utilisation de Google facture par caractère pour les modèles de texte et par image pour les modèles visuels, ce qui permet aux organisations de budgétiser avec précision. La plateforme comprend un calculateur de prix qui permet aux utilisateurs d'estimer les coûts en saisissant les volumes mensuels attendus, en ventilant les dépenses par type de modèle et par opération. Cette transparence permet aux équipes financières d'éviter des frais imprévus et de planifier efficacement.

Pour les entreprises utilisant régulièrement l'IA, Google propose remises pour utilisation prolongée. Ces réductions intégrées peuvent réduire les coûts jusqu'à 30 % pour les gros utilisateurs, ce qui en fait une option intéressante pour les entreprises qui gèrent des opérations d'IA à grande échelle. Contrairement aux promotions temporaires, ces remises récompensent l'utilisation continue, ce qui permet de réaliser des économies à long terme.

Google améliore sa productivité grâce à des flux de travail automatisés alimentés par Fonctions du cloud et Cloud Run, permettant des opérations pilotées par l'IA déclenchées par des événements spécifiques. Par exemple, les flux de travail du support client peuvent rédiger des réponses et les acheminer pour qu'elles soient examinées par un humain.

La plateforme propose également Dialogflow CX, qui soutient la création d'agents d'IA conversationnels avancés. Ces agents peuvent gérer des tâches telles que la prise de rendez-vous, le traitement des commandes et le dépannage. Lorsqu'une tâche dépasse les capacités de l'agent, la conversation est transférée de manière fluide à un représentant humain, y compris le contexte complet de l'interaction.

À travers Apigée, les entreprises peuvent exposer leurs capacités d'IA sous forme d'API gérées. Cela inclut des fonctionnalités telles que la limitation du débit, l'authentification et la surveillance, qui facilitent l'intégration de l'IA dans les applications mobiles, les plateformes Web et les systèmes partenaires. Les équipes de développement peuvent analyser l'utilisation des API pour identifier et résoudre les goulots d'étranglement potentiels, garantissant ainsi une expérience utilisateur fluide.

Pour les organisations soumises à des exigences réglementaires strictes, Google propose des outils de gouvernance robustes. Contrôles de service VPC assurez-vous que les données restent dans les limites définies, une caractéristique essentielle pour des secteurs tels que la santé et la finance.

Pour protéger les informations sensibles, Google Prévention des pertes de données (DLP) analyse les entrées et les sorties de l'IA à la recherche de détails tels que les numéros de carte de crédit et les données de sécurité sociale. En fonction de politiques prédéfinies, le système peut supprimer, masquer ou bloquer le contenu sensible.

Google fournit également des informations détaillées Journaux d'audit du cloud, qui suivent chaque interaction avec les modèles d'IA, y compris qui y a accédé, quelles données ont été traitées et quand les opérations ont eu lieu. Ces journaux s'intègrent aux systèmes de gestion des informations et des événements de sécurité (SIEM), offrant aux équipes de sécurité une visibilité complète sur l'utilisation de l'IA. Les responsables de la conformité peuvent générer des rapports pour démontrer le respect des politiques internes et des réglementations externes sans intervention manuelle.

En outre, Fédération des identités de charge de travail permet aux organisations d'utiliser leurs fournisseurs d'identité existants pour la gestion des accès. Cela élimine le besoin d'informations d'identification Google Cloud distinctes, rationalise les autorisations et garantit leur adéquation avec les rôles et responsabilités de l'organisation.

OpenAI se distingue en combinant des avancées de pointe avec des applications pratiques adaptées aux entreprises. Ses modèles excellent dans des domaines tels que la compréhension des langues, la génération de contenu créatif et la résolution de problèmes complexes. En se concentrant sur l'amélioration continue et en proposant des outils adaptés aux développeurs, OpenAI est devenue une solution incontournable pour des tâches allant de l'automatisation du support client à l'assistance au développement de logiciels.

OpenAI donne accès à plusieurs familles de modèles puissantes via son API :

La plateforme prend également en charge appel de fonction, permettant aux modèles d'interagir avec des outils et des bases de données externes. Par exemple, un chatbot du service client peut facilement vérifier l'état des commandes ou mettre à jour les détails du compte en temps réel, améliorant ainsi l'efficacité et l'expérience utilisateur.

En outre, OpenAI fournit des options de réglage, permettant aux entreprises de personnaliser les modèles à l'aide de leurs ensembles de données propriétaires. Cette personnalisation garantit que les résultats sont conformes à la terminologie spécifique du secteur, aux directives de la marque ou à une expertise spécialisée, sans nécessiter une configuration d'apprentissage automatique complète.

OpenAI utilise un système de tarification basé sur des jetons, dans lequel les coûts sont calculés en fonction du nombre de jetons d'entrée et de sortie. Ce modèle flexible permet aux entreprises de prévoir les dépenses en fonction de leur utilisation prévue. Pour garder le contrôle des dépenses, OpenAI propose des tableaux de bord intégrés et des outils permettant de surveiller l'utilisation et de fixer des limites de dépenses. Cette approche tarifaire simple permet aux équipes d'intégrer plus facilement l'automatisation sans coûts imprévus.

L'intégration avec les modèles OpenAI est simple, grâce aux API REST standard qui renvoient des réponses JSON structurées. Des fonctionnalités telles que les sorties en streaming améliorent les interactions en temps réel en diffusant le texte de manière incrémentielle, améliorant ainsi le flux conversationnel. En outre, l'API de modération garantit que le contenu est filtré en temps réel, garantissant ainsi la conformité et la sécurité.

OpenAI donne la priorité à la sécurité et à la gouvernance en protégeant l'accès aux API à l'aide de clés secrètes et en appliquant des politiques strictes de confidentialité des données. Les équipes peuvent surveiller l'utilisation des API grâce à des contrôles de compte, garantissant ainsi la conformité et la sécurité des opérations à tous les niveaux. Cette focalisation sur la gouvernance fait d'OpenAI un choix fiable pour les déploiements de niveau entreprise.

Cette section fournit un aperçu concis des caractéristiques remarquables et des inconvénients potentiels de chaque plateforme, afin de vous aider à adapter vos besoins spécifiques à la plateforme la plus adaptée.

Chaque fournisseur apporte des avantages et des compromis uniques, en proposant des solutions adaptées aux différentes priorités organisationnelles et exigences techniques.

Prompts.ai simplifie la gestion de l'IA en proposant une interface unifiée qui prend en charge l'accès multimodèle. Sa couche FinOps intégrée fournit des informations en temps réel sur l'utilisation et les coûts des jetons, permettant aux équipes de contrôler efficacement les dépenses. Le système de crédit TOKN pay-as-you-go vous garantit de ne payer que ce que vous utilisez. En outre, la plateforme prend en charge un programme de certification technique rapide et des flux de travail partagés par la communauté, qui aident les équipes à adopter les meilleures pratiques plus rapidement.

Microsoft s'intègre parfaitement aux outils sur lesquels de nombreuses organisations s'appuient déjà, tels qu'Office 365, Teams et Azure. Cette intégration permet aux équipes d'intégrer des fonctionnalités d'IA dans des environnements familiers tout en bénéficiant de contrôles de sécurité stricts et de certifications de conformité. Cependant, cette intégration étroite peut parfois entraîner une dépendance vis-à-vis d'un fournisseur, ce qui limite la flexibilité des organisations qui explorent des alternatives en dehors de l'écosystème Microsoft.

AWS se distingue par sa vaste infrastructure mondiale et son large éventail d'options de calcul, allant des fonctions sans serveur aux instances GPU dédiées. Ses outils de gouvernance avancés offrent des contrôles d'accès granulaires et des pistes d'audit détaillées, ce qui en fait un choix judicieux pour les équipes possédant une solide expertise DevOps. En revanche, les nombreuses options de configuration de la plateforme peuvent être écrasantes pour les petites équipes, et une gestion minutieuse des coûts est nécessaire pour éviter des dépenses imprévues.

Google tire parti de ses recherches avancées en matière d'IA par le biais de Vertex AI, en proposant des outils sophistiqués pour la formation et le déploiement de modèles personnalisés. L'intégration à Google Workspace facilite l'intégration de l'IA dans les tâches commerciales courantes. Bien que ces fonctionnalités soient idéales pour les équipes de data science, elles peuvent représenter une courbe d'apprentissage ardue pour les organisations dont l'expertise en matière d'apprentissage automatique est limitée.

IA ouverte est célèbre pour ses API conviviales pour les développeurs et sa documentation complète, qui simplifient l'intégration de modèles tels que GPT-4 et DALL-E 3 dans les applications. Ses options flexibles de tarification et de personnalisation assurent prévisibilité et contrôle. Cependant, le fait de vous fier à la feuille de route d'un fournisseur unique peut limiter votre contrôle sur la disponibilité et les prix futurs des modèles.

Lors du choix d'une plateforme, les organisations doivent tenir compte de leurs priorités. Ceux qui recherchent la flexibilité et le contrôle des coûts peuvent se tourner vers des plateformes offrant un accès multimodèle, tandis que les entreprises déjà intégrées dans un écosystème cloud spécifique peuvent préférer des solutions qui s'intègrent parfaitement à leurs outils existants. Les équipes de développement qui recherchent une intégration rapide des API apprécieront probablement une mise en œuvre simple, tandis que les équipes axées sur la recherche peuvent donner la priorité à l'accès à des architectures de modèles de pointe.

Les structures de prix jouent également un rôle crucial. Certaines plateformes facturent en fonction des ressources de calcul, d'autres en fonction des jetons d'API, tandis que Prompts.ai propose un système basé sur le crédit. Il est essentiel de comprendre ces modèles de tarification et de les aligner sur vos habitudes d'utilisation pour gérer efficacement les dépenses.

La sécurité et la conformité sont tout aussi importantes, en particulier pour les secteurs réglementés. Les plateformes dotées de certifications telles que SOC 2, HIPAA ou FedRAMP sont essentielles pour répondre aux normes du secteur. Les fonctionnalités telles que les pistes d'audit, les contrôles d'accès et les politiques de conservation des données varient d'un fournisseur à l'autre. Il est donc essentiel d'adapter ces fonctionnalités à vos exigences de gouvernance avant de prendre une décision.

Le choix du bon fournisseur d'IA générative dépend des priorités de votre organisation, de l'infrastructure existante et des objectifs à long terme. Voici un aperçu des points forts de chaque fournisseur pour vous aider à prendre une décision éclairée :

Prompts.ai réunit plus de 35 modèles sur une seule plateforme, associés à une couche FinOps qui peut réduire les coûts jusqu'à 98 % grâce à son système de crédit TOKN par paiement à l'utilisation. Son programme rapide de certification d'ingénierie et ses flux de travail partagés permettent aux équipes de l'adopter et de l'étendre plus facilement à tous les départements.

Microsoft s'intègre parfaitement à Azure et Office 365, ce qui en fait une solution idéale pour les entreprises qui ont déjà investi dans cet écosystème. Cependant, cette intégration étroite peut limiter la flexibilité lors de l'exploration d'autres solutions.

AWS se distingue par son évolutivité, soutenue par une infrastructure mondiale et une large gamme d'options de calcul. Cela dit, la gestion de ses configurations complexes nécessite généralement une solide expertise DevOps.

Google brille avec sa plateforme Vertex AI, qui offre des capacités avancées d'entraînement de modèles. Cela en fait un choix judicieux pour les équipes à forte activité de recherche dotées d'une expertise approfondie en apprentissage automatique.

IA ouverte est idéal pour les développeurs qui apprécient l'intégration rapide des API et une documentation détaillée. Cependant, sa dépendance à une feuille de route unique peut restreindre le contrôle sur les prix et les futures mises à jour des modèles.

Au moment de prendre une décision, tenez compte de l'orientation de votre organisation. Priorisation des équipes économies de coûts et flexibilité devrait rechercher des plateformes offrant un accès multimodèle avec une tarification claire et transparente. Ceux intégrés dans écosystèmes cloud spécifiques bénéficiera d'intégrations natives avec les outils existants. Des équipes centrées sur les développeurs devrait rechercher des API rationalisées et une documentation robuste, tandis que groupes axés sur la recherche peuvent avoir besoin de plateformes offrant des architectures de modèles avancées et une personnalisation.

La consolidation des flux de travail d'IA est essentielle pour améliorer à la fois les performances et la rentabilité. Évaluez chaque plateforme non seulement en fonction de ses capacités actuelles, mais également en fonction de la manière dont sa feuille de route s'aligne sur la croissance future de votre organisation. Évaluez soigneusement les compromis entre la commodité de l'intégration et les risques liés à la dépendance vis-à-vis des fournisseurs. Déterminez si votre équipe possède l'expertise technique nécessaire pour gérer des configurations complexes ou si elle bénéficierait d'une solution mieux gérée et unifiée.

Avant de vous engager auprès d'un seul fournisseur, testez plusieurs plateformes dans le cadre de projets pilotes. Cette approche permet de valider les hypothèses concernant les performances, les coûts et la facilité d'utilisation dans le contexte de vos besoins spécifiques. Portez une attention particulière à l'évolution des prix en fonction de l'utilisation et assurez-vous que les fonctionnalités de sécurité et de conformité répondent aux normes réglementaires de votre secteur.

Lorsque vous choisissez un fournisseur d'IA générative, il est important de prendre en compte plusieurs facteurs pour trouver la solution la mieux adaptée à votre entreprise. Commencez par modèles de tarification - recherchez des prestataires qui proposent des coûts initiaux clairs et des plans flexibles qui peuvent s'adapter à votre budget. Ensuite, évaluez caractéristiques et capacités disponible. Que vous ayez besoin de traitement du langage naturel, d'outils de création de contenu ou d'automatisation des flux de travail, assurez-vous que la plateforme répond à vos besoins spécifiques.

Il est également essentiel de vérifier limites d'utilisation ou des restrictions pour confirmer que la solution peut évoluer parallèlement à votre entreprise. L'historique d'innovation d'un fournisseur et la qualité de son support client peuvent fournir des informations supplémentaires sur sa fiabilité. En tenant compte de ces éléments avec soin, vous pouvez faire un choix qui correspond à vos objectifs et qui met votre entreprise sur la voie du succès.

Prompts.ai simplifie la gestion des coûts grâce à son couche FinOps. Cette fonctionnalité fournit des informations en temps réel sur l'utilisation, les dépenses et le retour sur investissement (ROI), donnant aux entreprises une image claire de leurs dépenses liées à l'IA.

Avec des outils qui identifient les inefficacités et fournissent des recommandations pratiques, Prompts.ai aide les organisations à tirer le meilleur parti de leurs investissements tout en contrôlant leurs budgets. Il s'agit d'un moyen pratique d'aligner la discipline financière sur la recherche de l'innovation.

L'intégration de l'IA générative dans vos flux de travail peut transformer la façon dont les tâches sont gérées. Par automatisation des activités répétitives, il augmente la productivité et permet de créer du contenu frais et attrayant. Cette technologie simplifie les processus, permet de gagner un temps précieux et permet de travailler de manière plus créative et plus efficace.

Cela dit, il y a quelques obstacles à surmonter. La mise en œuvre et l'adaptation de systèmes d'IA génératifs exigent souvent compétences techniques spécialisées, et en veillant à confidentialité et sécurité des données ajoute un niveau de complexité supplémentaire. Pour garantir une intégration réussie, il est essentiel de bien planifier et d'avoir une vision claire de vos objectifs.