Las herramientas de orquestación de IA simplifican la administración de varios modelos, flujos de trabajo y flujos de datos, pero una gobernanza deficiente puede exponer a su organización a riesgos graves. Desde las violaciones de datos hasta las sanciones por cumplimiento, hay mucho en juego. ¿La solución? Estrategias de gobierno sólidas que garantizan la seguridad, el cumplimiento y la eficiencia operativa.

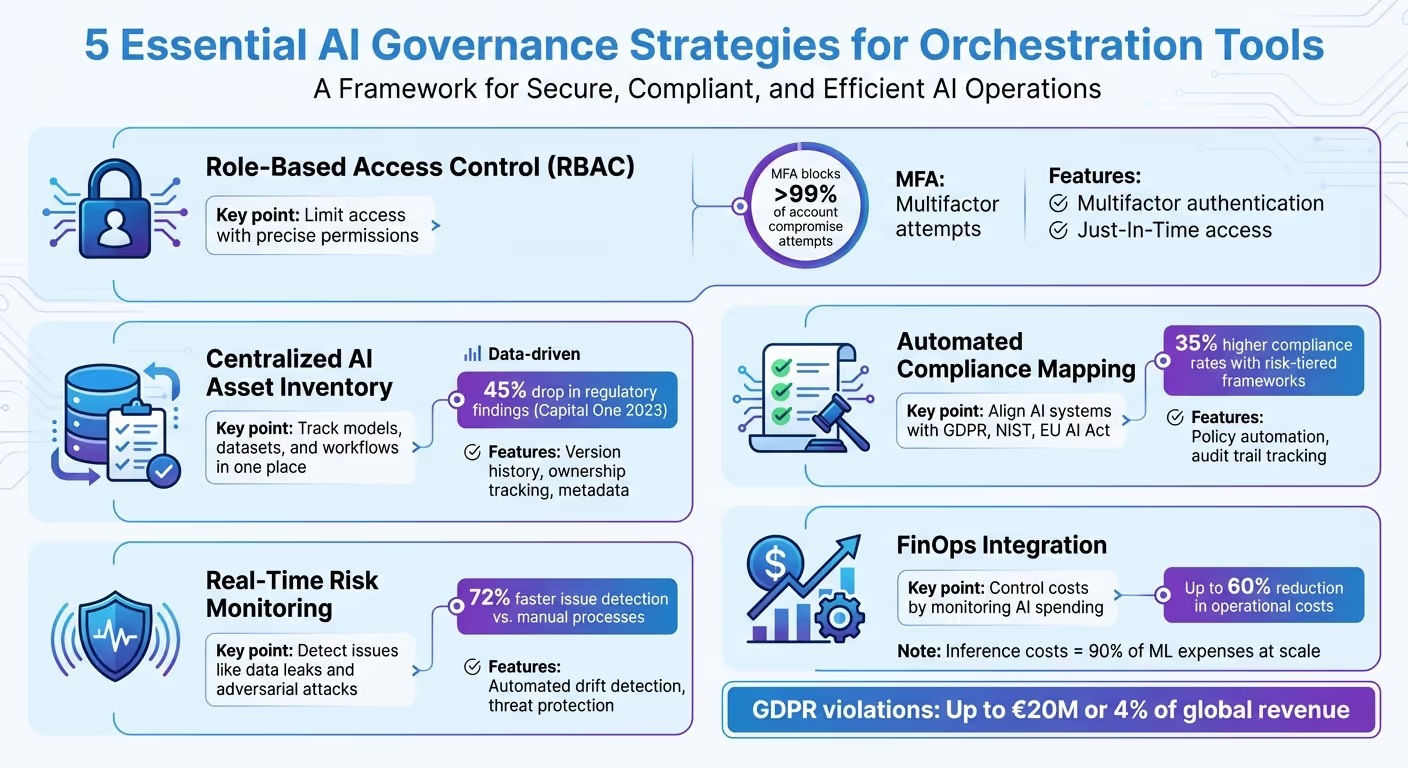

Las estrategias clave incluyen:

Prompts.ai ofrece una plataforma unificada para proteger, gestionar y escalar los flujos de trabajo de IA. Integra más de 35 modelos (como GPT-5 y Claudio) con herramientas de gobierno integradas, monitoreo en tiempo real y controles de costos. Ya sea que proteja los datos confidenciales o optimice las operaciones, esta plataforma convierte los desafíos de la gobernanza en oportunidades de crecimiento.

5 estrategias esenciales de gobierno de la IA para las herramientas de orquestación

La gestión de las plataformas de orquestación de IA conlleva una serie de obstáculos éticos, normativos y de seguridad. Brittany Woodsmall y Simon Fellows de Darktrace destaque el ritmo de adopción de la IA:

La adopción de la IA está a la vanguardia del movimiento digital en las empresas, superando el ritmo al que los profesionales de TI y seguridad pueden establecer modelos de gobierno y parámetros de seguridad.

Cada interacción de la IA puede introducir riesgos como el uso indebido de la identidad, la filtración de datos, la explotación de la lógica de las aplicaciones y las vulnerabilidades de la cadena de suministro. Para abordar estos problemas, los marcos de gobierno deben ser tan ágiles y adaptables como los sistemas de IA que supervisan.

Los riesgos éticos, como los prejuicios y la falta de transparencia, se encuentran entre los desafíos más apremiantes. Los modelos de IA suelen tener sesgos arraigados, que pueden conducir a resultados discriminatorios. Esto ya ha provocado que las instituciones se enfrenten a multas millonarias. Más allá de las sanciones financieras, la confianza en sistemas sesgados puede erosionar la confianza y la toma de decisiones. Matthew DeChant, director ejecutivo de Security Counsel, advierte:

La confianza excesiva en la orquestación de la IA puede disminuir «el elemento humano esencial del pensamiento crítico», lo que resulta en una pérdida del mando operativo.

Otro problema es la naturaleza de «caja negra» de muchos sistemas de IA, que oculta sus procesos de toma de decisiones y aumenta la probabilidad de obtener resultados no verificados. Esta opacidad se vuelve aún más peligrosa cuando la IA generativa produce alucinaciones, es decir, resultados seguros pero incorrectos que pueden inducir a error a las empresas. Sin una supervisión adecuada, estos sistemas también pueden generar contenido dañino, como material racista o sexista, lo que expone a las organizaciones a dañar su reputación.

Para mitigar estos riesgos, las organizaciones deben adoptar protocolos human-in-the-loop (HITL) para tomar decisiones críticas, utilice herramientas automatizadas de detección de sesgos para monitorear los resultados del modelo y establezca juntas de revisión ética que incluyan diversos conocimientos. La realización de ejercicios de trabajo en equipo en red también puede descubrir vulnerabilidades, como los ataques por inyección inmediata, antes de que interrumpan los flujos de trabajo.

El panorama regulatorio añade otro nivel de complejidad a la orquestación de la IA. Por ejemplo, las infracciones del RGPD pueden conllevar multas de hasta 20 millones de euros o el 4% de los ingresos anuales mundiales, el que sea mayor. Estas normativas exigen políticas estrictas de retención de datos, la capacidad de eliminar datos personales a petición y registros de auditoría detallados para todas las interacciones de la IA, incluidas las indicaciones, las respuestas y las versiones de los modelos.

Leyes de soberanía y residencia de datos complican aún más la orquestación. Las herramientas de inteligencia artificial deben garantizar que los tiempos de ejecución, las fuentes de datos y los resultados se mantengan dentro de regiones geográficas específicas, lo que es particularmente difícil en los entornos basados en la nube. Los flujos de datos transfronterizos añaden otro nivel de dificultad, ya que requieren el cumplimiento de leyes superpuestas, como la CCPA, el GDPR y el Ley de IA de la UE.

Con nuevos estándares como ISO/IEC 42001 y el Marco de gestión de riesgos de IA del NIST Las organizaciones emergentes necesitan herramientas de orquestación que puedan adaptar rápidamente los flujos de trabajo para cumplir con los requisitos cambiantes. Implementación control de acceso basado en funciones (RBAC) puede ayudar al restringir quién puede crear e implementar agentes de IA, lo que reduce el riesgo de proyectos no autorizados de «IA oculta».

Las herramientas de orquestación de IA también se enfrentan a importantes amenazas de seguridad. Técnicas como inyección rápida y jailbreak - cuando las entradas se diseñan para eludir los controles de seguridad, pueden provocar acciones no autorizadas o fugas de datos. Los ataques de envenenamiento de datos, que manipulan conjuntos de entrenamiento, y las técnicas de inversión de modelos, que extraen datos confidenciales de los resultados, ponen aún más de manifiesto las vulnerabilidades.

Los riesgos no son hipotéticos. Para enero de 2026, más de 500 organizaciones habían sido víctimas de Medusa ransomware, a menudo explotando las debilidades de las herramientas de gestión y orquestación remotas. La aparición de agentes de IA autónomos, capaces de iniciar acciones e interactuar con los sistemas de forma independiente, ha ampliado la superficie de ataque. Además, los registros inseguros y los historiales de notificaciones pueden exponer información confidencial.

Para abordar estos riesgos, las organizaciones deben imponer el acceso con privilegios mínimos mediante identidades administradas, aplicar un filtrado de entrada/salida adaptativo con análisis contextual y establecer perímetros de servicio para evitar la filtración de datos. La formación habitual de equipos contradictorios en red puede simular posibles ataques antes de la implementación, mientras que el registro centralizado garantiza que los registros de auditoría sean inmutables y recopilen todos los detalles relevantes, como las versiones de los modelos, las solicitudes y las interacciones de los usuarios. Por último, aplicar los principios de minimización de los datos (por ejemplo, evitar la recopilación de datos confidenciales innecesarios y utilizar datos sintéticos o anónimos) puede limitar el impacto de cualquier infracción.

A continuación, exploraremos las estrategias para abordar estos desafíos de manera efectiva.

Con los desafíos de las herramientas de orquestación de la IA claramente identificados, es hora de profundizar en las estrategias que pueden ayudar a las organizaciones a crear sistemas que sean seguros, que cumplan con las normas y sean rentables. Estas estrategias actúan como una hoja de ruta para abordar los obstáculos descritos anteriormente.

Cada agente de IA debe tratarse como una identidad distinta, con un acceso adaptado a tareas específicas y otorgado temporalmente a través de sistemas Just-In-Time (JIT). Al emplear métodos de autenticación multifactorial (MFA), como las claves respaldadas por hardware y las identidades administradas, las organizaciones pueden reducir considerablemente la dependencia de las credenciales codificadas. El acceso mediante JIT garantiza que los permisos se limiten a filas o tablas de datos precisas y que solo sean válidos mientras dure la tarea. Este enfoque es particularmente importante para los agentes autónomos que actúan de forma independiente.

La autenticación multifactor es una potente medida de seguridad que bloquea más del 99% de los intentos de comprometer las cuentas. Para la orquestación de la IA, dé prioridad a las opciones de MFA resistentes a la suplantación de identidad, como las claves criptográficas (FIDO2) o Windows Hello para empresas.

La aplicación de las políticas debe ser automática e inmediata. Las herramientas como el acceso condicional evalúan factores como el grupo de usuarios, la ubicación y la sensibilidad de las aplicaciones en tiempo real. Las infracciones deberían provocar la suspensión inmediata de la ejecución. BlackArc Systems destaca este enfoque:

la capa de orquestación es donde estos problemas deben resolverse de una vez y aplicarse en todas partes.

Para evitar la filtración de datos confidenciales, aplique políticas de prevención de pérdida de datos (DLP) en la capa de orquestación. Estas políticas pueden impedir que los agentes accedan o muestren información confidencial, como números de tarjetas de crédito, en sus respuestas.

Un inventario centralizado de todos los modelos, conjuntos de datos y flujos de trabajo de IA, con metadatos detallados como la propiedad, el historial de versiones y las dependencias, crea una única fuente de información fiable para la organización.

En 2023, la Oficina de Riesgos de Modelos de Capital One implementó un inventario de este tipo junto con estrictos estándares de documentación, lo que llevó a una caída del 45% en las conclusiones regulatorias. Las herramientas automatizadas de recopilación de metadatos, como las «hojas informativas sobre la IA» o las «tarjetas modelo», pueden mejorar aún más este inventario al recopilar detalles clave, como las métricas de rendimiento de los modelos, el origen de los datos de entrenamiento y los casos de uso previstos. Las auditorías periódicas de este inventario también pueden impedir el despliegue no autorizado de sistemas de «inteligencia artificial oculta».

Las herramientas automatizadas de detección de desviaciones pueden identificar problemas un 72% más rápido que los procesos manuales, lo que permite respuestas más rápidas. Plataformas de observabilidad centralizadas, como Análisis de registros de Azure supervise continuamente el comportamiento de los agentes, las interacciones de los usuarios y el rendimiento del sistema. Herramientas de protección contra amenazas específicas para la IA, como Microsoft Defender para la nube puede detectar la manipulación inmediata, los intentos de jailbreak y el acceso no autorizado a los datos.

Las barandillas en tiempo real son otra capa esencial de protección. Estos filtros automatizados bloquean las entradas contradictorias, evitan la filtración de datos confidenciales y garantizan que las salidas sigan siendo adecuadas. Por ejemplo, en 2024, Clínica Mayo implementó un modelo de predicción de la insuficiencia cardíaca con una precisión del 93%, basándose en un marco de evaluación del impacto clínico para monitorear los sesgos y garantizar la equidad en tiempo real. Defina umbrales claros para detectar anomalías (como picos de latencia o patrones de producción inusuales) y dirija las alertas directamente al Centro de Operaciones de Seguridad (SOC). Como Jeff Monnette, director sénior de gestión de entregas de EPAM, explica:

el mayor desafío al que se enfrentan las organizaciones a la hora de orquestar los sistemas de IA es gestionar su inherente falta de determinismo.

El cumplimiento se puede simplificar automatizando el mapeo de marcos regulatorios como el NIST, la ISO/IEC 42001 y la Ley de IA de la UE. Esto garantiza que los controles técnicos se apliquen de forma coherente en todas las cargas de trabajo de IA. Los administradores de cumplimiento especializados pueden traducir los requisitos reglamentarios abstractos en controles técnicos prácticos para las herramientas de orquestación.

Por ejemplo, las reglas de retención de datos del RGPD se pueden aplicar mediante procesos automatizados que eliminan o anonimizan los registros después de un período determinado. Herramientas de gobierno como Política de Azure o Controles de servicio de Google Cloud VPC puede aplicar estas medidas de cumplimiento de manera uniforme en todas las plataformas.

Las organizaciones que utilizan marcos de gobierno por niveles de riesgo reportan tasas de cumplimiento un 35% más altas sin ralentizar las operaciones. Este enfoque aplica controles rigurosos para las aplicaciones de alto riesgo, como las de atención médica o financiera, al tiempo que utiliza controles más ligeros para las herramientas internas. El seguimiento integral del linaje (documentar las transformaciones de los datos y las versiones de los modelos) es esencial para cumplir con los requisitos de auditoría establecidos en reglamentos como el RGPD, HIPAA, y la CCPA. AWS subraya este punto:

Los marcos de gobierno de la IA crean prácticas consistentes en la organización para abordar los riesgos organizacionales, el despliegue ético, la calidad y el uso de los datos e incluso el cumplimiento de las normativas.

Las revisiones trimestrales garantizan que los mapas de cumplimiento se mantengan actualizados con la evolución de las normativas. Más allá de las medidas reglamentarias, la supervisión financiera añade otro nivel de optimización a la orquestación de la IA.

La orquestación de la IA puede resultar cara sin una gestión financiera adecuada. Las prácticas de FinOps alinean el gasto en IA con los objetivos empresariales, garantizando la responsabilidad y una rentabilidad mensurable. La gobernanza automatizada puede reducir los costos operativos hasta en un 60%, lo que hace que las inversiones en IA sean más eficientes e impactantes.

La gestión eficaz de la inteligencia artificial requiere herramientas que puedan gestionar la seguridad, optimizar los diversos recursos y mantener los costos bajo control. Prompts.ai satisface estas necesidades con una plataforma unificada que integra más de 35 de los principales modelos lingüísticos de gran tamaño, incluidos GPT-5, Claude, Llama, y Géminis. Esta interfaz segura y preparada para la empresa simplifica la organización de la IA al tiempo que implementa directamente estrategias de gobierno avanzadas.

Prompts.ai garantiza una seguridad sólida mediante control de acceso basado en funciones (RBAC), que restringe los permisos de usuario únicamente a los modelos y flujos de trabajo relevantes para sus funciones. Los datos de los flujos de trabajo de la IA están protegidos con un cifrado sólido, y la aplicación automatizada de políticas garantiza el cumplimiento de las directrices internas y las normativas externas en tiempo real. Otras funciones, como los controles de autorización en tiempo real y las funciones de integración directa del LLM, detectan y bloquean de forma activa amenazas como la inyección inmediata, la filtración de datos y el acceso no autorizado.

Para simplificar la gobernanza, Prompts.ai consolida varias herramientas de inteligencia artificial en una sola plataforma, lo que reduce la complejidad de administrar suscripciones, controles de acceso y comprobaciones de cumplimiento independientes. Al proporcionar un sistema centralizado, elimina riesgos como la «inteligencia artificial oculta» y ofrece una única fuente fiable para hacer un seguimiento del uso de los modelos y garantizar una supervisión simplificada.

Las herramientas FinOps integradas de Prompts.ai ofrecen una visibilidad completa del gasto en IA en todos los flujos de trabajo. La plataforma rastrea las métricas de uso de la computación, como las horas de GPU/CPU, el consumo de memoria y los volúmenes de solicitudes. Con la asignación de costos basada en etiquetas, las organizaciones pueden asignar los gastos a equipos o proyectos específicos. Los controles de costos automatizados, que incluyen las cuotas para limitar las solicitudes simultáneas, evitan los aumentos inesperados de los gastos. Las alertas en tiempo real ayudan además a los equipos a responder rápidamente a patrones de uso inusuales. Dado que los costes de inferencia pueden representar hasta el 90% de los gastos totales de aprendizaje automático en las implementaciones de IA a gran escala, esta gestión granular de los costes es esencial para mantener el equilibrio financiero y, al mismo tiempo, ampliar las operaciones.

Una sólida gobernanza de la IA garantiza el cumplimiento, genera confianza y agiliza las operaciones. Para lograrlo, las organizaciones deben adoptar estrategias como el control de acceso basado en roles (RBAC), los inventarios de activos centralizados, la supervisión de riesgos en tiempo real, la cartografía automatizada del cumplimiento y la integración de FinOps. Sin estas medidas, los riesgos son considerables: las infracciones de normativas como el RGPD pueden conllevar multas cuantiosas. Estos desafíos enfatizan la importancia de una solución integral.

Una plataforma unificada se vuelve fundamental para abordar estos riesgos. Prompts.ai consolida más de 35 modelos lingüísticos de gran tamaño líderes en un ecosistema único y seguro. La plataforma ofrece una automatización de políticas integrada, una gestión unificada del flujo de trabajo y un seguimiento detallado de los costos. Funciones como los controles de acceso basados en roles, la autorización en tiempo real y las pruebas contradictorias (red teaming) brindan protección contra amenazas como la inyección rápida de datos y la filtración de datos. La supervisión centralizada evita además los despliegues de inteligencia artificial en la sombra, que podrían poner en peligro la seguridad y el cumplimiento.

Estas capacidades sientan las bases para prácticas de gobierno sólidas. Los pasos clave incluyen la adopción de un marco de gestión de riesgos alineado con estándares como el RMF AI del NIST, el mantenimiento de un inventario de activos de inteligencia artificial y la implementación de la aplicación automatizada de políticas. Las organizaciones también deben definir los protocolos de respuesta a los incidentes, usar etiquetas centradas en los costos para monitorear el uso de los tokens y realizar pruebas contradictorias antes de implementar los sistemas.

El avance hacia la aplicación automatizada y los protocolos de gobierno estandarizados señala el futuro de la gestión de la IA. Los líderes del sector, como Microsoft, enfatizan la importancia de estas medidas:

Sin una gobernanza adecuada, los agentes de IA pueden introducir riesgos relacionados con la exposición de datos confidenciales, los límites de cumplimiento y las vulnerabilidades de seguridad.

La plataforma unificada de Prompts.ai convierte estos desafíos en procesos estructurados y auditables que crecen junto con las iniciativas de IA de su organización.

La supervisión inadecuada de las herramientas de orquestación de la IA puede abrir la puerta a riesgos graves. Sin una gobernanza clara, los sistemas de IA pueden tomar decisiones poco éticas o incumplir las normativas, lo que podría desembocar en resultados sesgados, infracciones legales o multas cuantiosas. Las brechas de seguridad, como las protecciones de datos débiles o el acceso no autorizado, también podrían dejar la información confidencial vulnerable a las infracciones y a las complicaciones legales.

Desde un punto de vista operativo, una gobernanza deficiente puede crear desafíos como la falta de trazabilidad, lo que dificulta la auditoría o la replicación de los resultados. Esto puede interrumpir los flujos de trabajo, desperdiciar recursos y poner en peligro la continuidad empresarial. Además, cuando las acciones de la IA no se controlan, los pequeños errores pueden propagarse a los sistemas interconectados, lo que aumenta los costos y perjudica la reputación de una organización. Una gobernanza eficaz es crucial para garantizar que los sistemas de IA sigan siendo éticos, seguros y confiables.

El control de acceso basado en roles (RBAC) desempeña un papel crucial en la gestión de los sistemas de IA al garantizar que los usuarios y los servicios solo puedan acceder a las herramientas, los datos o los modelos necesarios para sus funciones específicas. Por ejemplo, los administradores pueden asignar funciones como gerente de proyecto, desarrollador, o revisor, concediéndoles acceso exclusivo a los recursos necesarios para sus responsabilidades. Este enfoque ayuda a mitigar los riesgos, como el uso indebido accidental o el abuso intencionado, y protege contra problemas como las filtraciones de datos o los sesgos en los flujos de trabajo de la IA.

El RBAC también refuerza los esfuerzos de cumplimiento al mantener registros detallados que rastrean quién accedió a qué, cuándo y con qué propósito. Estos registros son esenciales para cumplir con las normas reglamentarias de EE. UU., incluidas la HIPAA y PCI-DSS, y tienen un valor incalculable durante las auditorías internas. Este nivel de transparencia tranquiliza a las partes interesadas al garantizar que solo las personas autorizadas puedan influir en las decisiones impulsadas por la IA.

Al estandarizar los permisos y automatizar su aplicación, el RBAC mejora la eficiencia operativa. Elimina el acceso innecesario, refuerza los controles de costes y agiliza los flujos de trabajo, al tiempo que contribuye a los objetivos más amplios de la gobernanza de la IA: conformidad, confianza, y eficiencia.

El monitoreo de riesgos en tiempo real desempeña un papel clave en el mantenimiento flujos de trabajo de IA seguros, éticos y confiables. Al identificar y abordar problemas como los sesgos, las desviaciones o el uso inesperado de los recursos a medida que se producen, las organizaciones pueden prevenir los posibles daños antes de que se agraven. Este método proactivo no solo contribuye al cumplimiento de las normativas y políticas internas, sino que también mejora el rendimiento general de los sistemas de IA.

En entornos de producción acelerados, en los que los modelos y agentes de IA funcionan de forma autónoma, la supervisión en tiempo real actúa como una protección fundamental. Ayuda a detectar y contrarrestar amenazas como las brechas de seguridad o los intentos de manipular los modelos. Funciones como las alertas automatizadas, los registros de auditoría detallados y las medidas de seguridad adaptativas garantizan que cualquier actividad maliciosa se identifique y se aborde con rapidez, preservando la integridad de su infraestructura de IA.

La rápida evolución de la IA subraya aún más la importancia del monitoreo continuo. Las revisiones periódicas simplemente no pueden seguir el ritmo de los cambios. El seguimiento en tiempo real garantiza que los cambios en el comportamiento de los modelos o en la calidad de los datos se detecten al instante, lo que permite respuestas más rápidas, una supervisión más sólida y operaciones de inteligencia artificial más fluidas.