选择正确的大型语言模型 (LLM) 绝非易事,GPT-5、Claude、Gemini 和 LLaMa 等选项在准确性、安全性、成本和性能方面具有不同的优势。为了做出明智的决策,企业需要能够提供清晰的、以数据为依据的比较的工具。本文回顾了最佳的LLM比较工具,重点介绍了其功能、模型覆盖范围和成本节约能力。

关键要点:

这些工具帮助团队根据准确性、延迟、成本和安全性等指标比较 LLM,确保根据特定需求选择正确的模型。

快速比较:

这些工具使用户能够做出更明智的LLM决策,在性能与成本和安全性之间取得平衡。

LLM 模型比较工具功能矩阵:覆盖范围、成本优化和企业能力

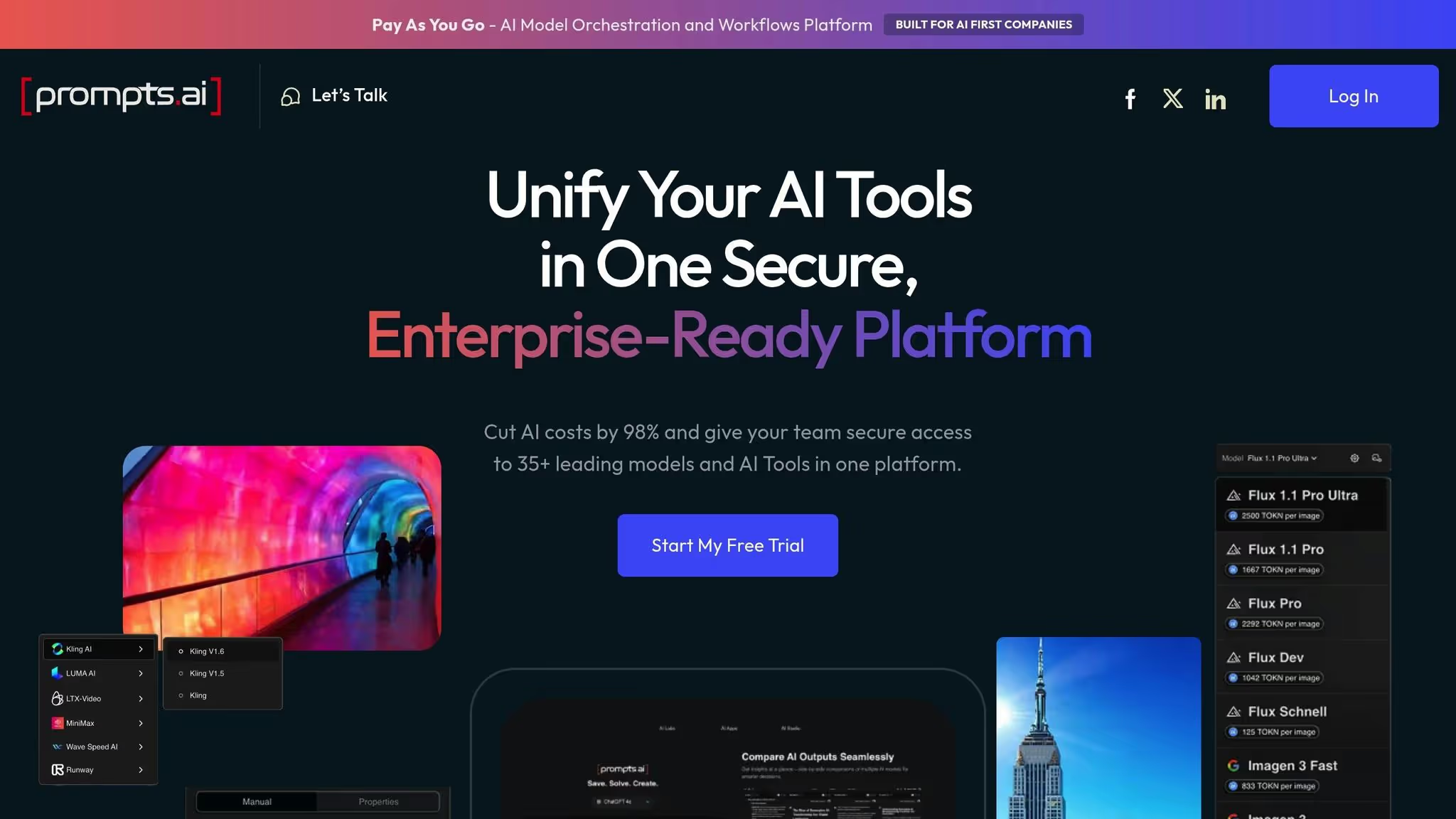

Prompts.ai 将超过 35 个顶级大型语言模型 (LLM) 整合到一个统一的平台中,从而消除了处理多个 API 密钥、仪表板和计费系统的麻烦。该平台集成了行业领导者的模型,例如 人类 (Claude 4 系列)、OpenAI(GPT-5)、谷歌(Gemini 3 Pro)、Meta(Llama 4)、 xAI, 智浦人工智能, 登月人工智能, 深度寻找,以及 阿里云。这种全面的覆盖范围使团队能够在短短几分钟内对 GPT-5、Claude 4 和 Gemini 3 Pro 等型号的提示进行测试,而无需切换选项卡或管理单独的供应商协议。

Prompts.ai 通过启用并行评估来实现无缝的模型比较。用户可以通过不同的模型运行相同的输入,并根据准确性、延迟、安全性、成本、一致性和事实可靠性等关键指标对其进行评估。此功能可帮助团队精确地确定满足其特定需求的最佳模型。

该平台提供实时代币跟踪和财务控制,以帮助有效管理成本。它显示每种模型每百万个代币的投入和输出费用,允许企业筛选出仍符合性能标准的成本效益选项。凭借其即用即付的 TOKN 积分,Prompts.ai 消除了经常性订阅费,从而更容易将支出与实际使用量保持一致并证明投资回报率。这些工具可确保财务清晰度,并使控制在预算之内更易于管理。

Prompts.ai 在构建时考虑了企业级治理、安全性和合规性。每次 AI 交互都会记录详细的审计记录,从而确保敏感数据保持安全和可控。该平台包括动手入职培训和即时工程师认证计划,以建立跨团队的最佳实践。无论你是拥有严格数据政策的《财富 500 强》公司,还是想要高效扩展工作流程的创意机构,Prompts.ai 都能快速适应——在几分钟内添加模型、用户和团队,而不会出现工具互不关联的混乱局面。

截至2026年1月12日, llm-stats.com 曲目令人印象深刻 235 个 AI 模型,将自己定位为可用的最详细的基准测试资源之一。它的数据库既包括领先的专有模型(例如GPT-5.2、Gemini 3 Pro和Claude Opus 4.5),也包括开源选项,例如智浦AI的GLM-4.7和来自的MIMO-v2-Flash 小米。该范围涵盖了美国的主要参与者,例如OpenAI、谷歌、Anthropic和xAI,以及包括智浦人工智能在内的知名中国开发商, miniMax、小米、Moonshot AI 和 DeepSeek。

该平台根据编码、图像生成、写作和开放 LLM 等领域的表现将这些模型归类为排行榜。其他排名侧重于医疗保健、法律、金融、数学与科学以及视觉等专业领域。值得注意的是,某些型号,例如 Gemini 3 Pro 和 Gemini 3 Flash,支持的最大上下文窗口 100 万个代币,为用户提供高级应用程序的卓越灵活性。这种广泛的覆盖范围构成了该平台性能和成本评估的基础。

llm-stats.com 提供用于并排比较模型的工具,允许用户评估多个维度的性能。例如,截至2026年1月,Gemini 3 Pro以其性能得分位居榜首 1,519,而 GPT-5.2 则拥有 92.4% 成功率 在特定的基准上。这些比较涵盖工具使用情况、长情境能力、结构化输出和创造性任务等领域。

该平台还评估各种应用类别或 “子领域”(包括图像、视频、网站、游戏和聊天界面)的模型。这种详细的细分可以帮助团队确定满足其特定需求的最佳模型。除了绩效指标外,llm-stats.com还非常重视成本透明度。

llm-stats.com的一个突出特点是其详细的定价数据,其中列出了每100万个投入和输出代币的确切成本。例如,Gemini 3 Pro 的定价为 每 100 万个输入代币 2.00 美元 和 每 100 万个输出代币 12.00 美元,而更经济实惠的 MIMO-v2-Flash 的成本仅为 输入费 0.10 美元 和 输出 0.30 美元。此外,该平台还提供推理成本降低计划,最多可以将生产费用削减至最多 30%,使其成为管理 AI 部署成本的宝贵工具。

OpenAI 评估套件旨在评估各种模型,包括 OpenAI 自己的 GPT-4、GPT-4.1、GPT-3.5、GPT-4O、GPT-4O、GPT-4O-Mini、o3 和 o3-mini,以及第三方大型语言模型 (LLM)。这种灵活性使团队不仅可以评估单个模型,还可以评估完整的 LLM 系统,包括单回合交互、多步骤工作流程,甚至包括单代理和多代理设置中的自主代理。如此广泛的模型兼容性构成了该套件评估能力的支柱。

该套房提供 开源注册表 以具有挑战性的基准测试为特色,例如MMLU、CoQA和Spider。用户可以从两种评估方法中进行选择:

对于需要量身定制解决方案的团队,该框架支持 Python、YAML 或 JSONL 格式的自定义评估。

像GPT-4.1一样,法学硕士评委已经表现出80%以上的认同感,与典型的人类共识水平非常吻合。正如 OpenAI 的文档中所强调的那样:

“如果你使用像 GPT-4 这样的基础模型进行构建,那么创建高质量的评估是你能做的最有影响力的事情之一”。

这些高级工具非常适合一般和企业特定的应用程序。

对于企业用户,评估套件支持使用内部数据集进行私有评估。集成选项包括命令行界面 (oaieval)、编程 API 和面向非技术用户的 OpenAI 控制面板。结果可以直接登录到 Snowflake 数据库 用于简化数据管理。此外,该套件允许对元数据进行最多 16 个键值对 每个评估对象,密钥限制为 64 个字符,值限制为 512 个字符。

评估套件包含以下工具 模型蒸馏,使团队能够将知识从更大、更昂贵的模型转移到更小、更快、更实惠的替代方案中。尽管标准的 API 费用仍然适用,但使用 LLM 进行自动判断是一种具有成本效益的选择。为了协助预算管理,该平台提供了详细的每种型号的使用情况报告,跟踪诸如提示性、完成率和缓存的代币数量等指标,使团队能够密切关注他们的支出。

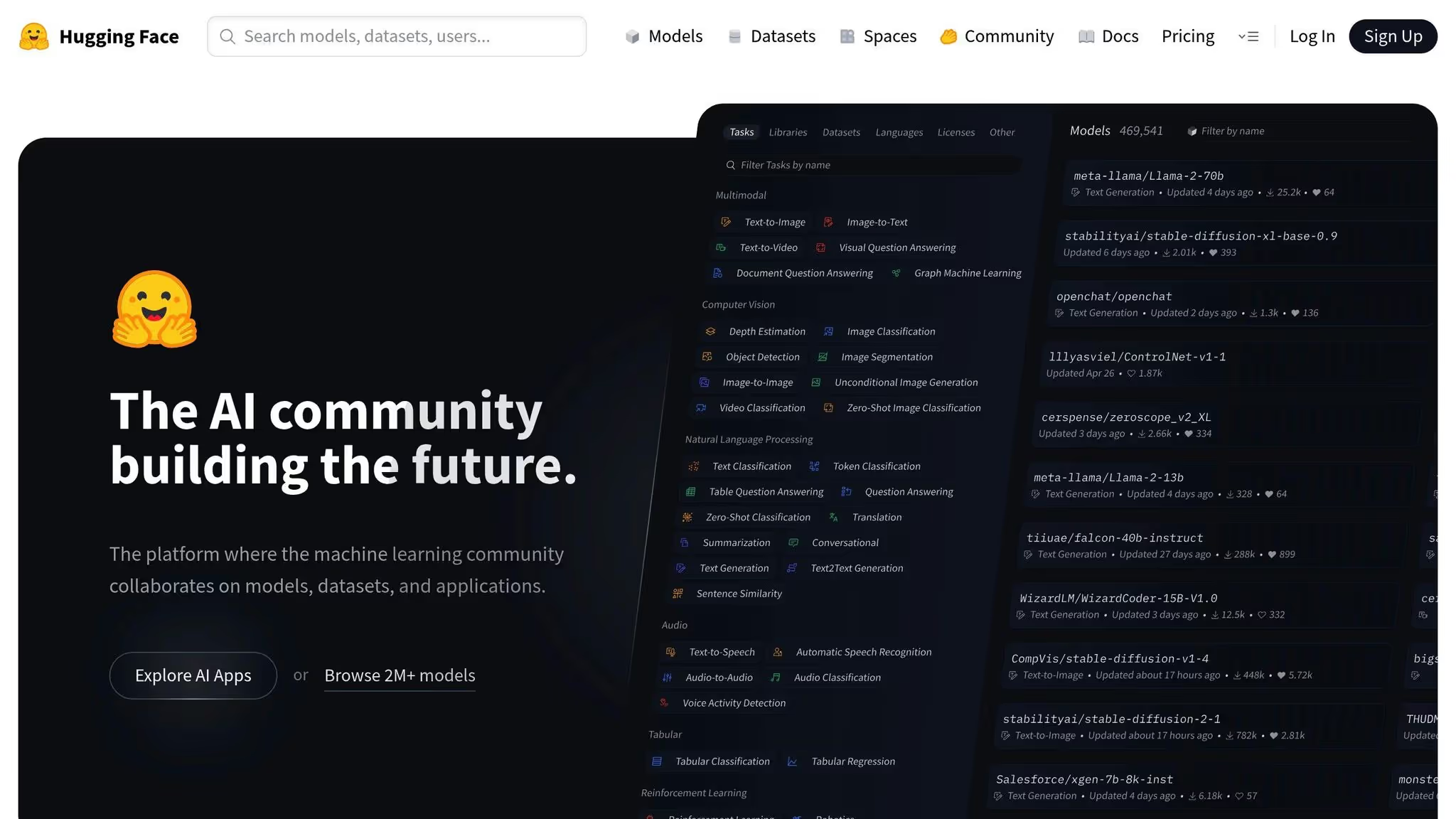

Hugging Face Evaluate 的覆盖范围远远超出了传统的基于文本的语言模型,可容纳各种模型类型。其中包括视觉语言模型 (VLM)、嵌入模型、代理 LLM 和音频/语音识别模型。例如,OpenVLM排行榜评估了31项多模态基准测试中的超过272种视觉语言模型,其中包括GPT-4V和Gemini等公开的API模型。同样,大规模文本嵌入基准 (MTEB) 评估了跨越 1,000 多种语言的 100 多种文本和图像嵌入模型。

该平台提供了三种主要的评估途径: 社区排行榜 对于排名模型, 模型卡 展示特定模型的功能和开源工具,例如 评估 和 LightEval 用于构建自定义工作流程 [20,21]。对于那些比较LLM的人来说,LightEval库支持1,000多项任务,并与高级后端无缝集成,例如vLLM、TGI和Hugging Face Inference Endpoints [19,26]。这种全面的模型支持为量身定制的基准测试解决方案奠定了坚实的基础。

Hugging Face Evaluate 将其基准测试工具分为三个关键领域: 指标, 比较,以及 测量 [22,23]。使用 evaluate.evaluator () 工具,用户可以通过输入模型、数据集和指标来自动推断 变形金刚 管道。

为确保精度,该平台采用了先进的统计方法。Bootstrapping 用于计算置信区间和标准误差,从而深入了解分数的稳定性。McNemar 测试提供了一个 p 值来确定两个模型的预测是否存在显著差异。在分布式计算环境中,Apache Arrow 用于跨节点存储预测和参考信息,从而可以在不超载 GPU 或 CPU 内存的情况下计算 F1 等复杂指标。除了性能分数外,该平台还优先考虑实际部署注意事项,使其适合企业级需求。

GitHub上有超过23,600个项目依赖它,Hugging Face Evaluate提供了企业级功能。它跟踪系统元数据以确保评估结果可以复制 [20,23]。这个 push_to_hub () 该功能允许团队将结果直接上传到 Hugging Face Hub,从而实现透明的报告和组织内部的无缝协作。

两者都是 评估 和 LightEval 图书馆是开源的,根据许可提供——分别是Apache-2.0和麻省理工学院 [19,26]。虽然这些库可以免费使用,但通过推理端点或第三方 API 进行的任何评估都可能产生费用,具体取决于服务提供商。此外,LLM-Perf 排行榜跟踪能源和内存使用情况,帮助企业选择符合其硬件能力和预算限制的模型 [20,21]。这些功能使 Hugging Face Evaluate 成为在技术和实践方面优化 AI 工作流程不可或缺的工具。

LangChain 基准测试侧重于实际应用和成本效率,补充了旨在比较大型语言模型 (LLM) 的其他工具。

LangChain 基准测试支持多种模型,包括 OpenAI 的 GPT-4 Turbo 和 GPT-3.5、Anthropic 的 Claude 3 Opus、Haiku 和 Sonnet、谷歌的 Gemini 1.0 和 1.5 以及 Mistral 的 Mixtral 8x22b。它还包括开源选项,例如Mistral-7b和Zephyr。这种广泛的兼容性使团队能够在统一的框架内评估专有和开源模型,提供针对实际用例量身定制的见解。

该工具专为现实世界的任务而设计,例如检索增强生成 (RAG)、数据提取和代理工具的使用。它集成了 朗·史密斯 提供详细的执行跟踪,从而更容易识别问题是源于检索错误还是模型的推理。

LangChain 基准测试使用各种评估方法,包括 LLM-asJudge、基于代码的规则、人工审查和成对比较。比较视图直观地突出显示变化,回归以红色标记,改进以绿色标记,从而简化了性能跟踪。例如,在使用 LangChain 文档的初始问答基准测试中, OpenAI 助手 API 得分最高,为 0.62,在对话检索任务中的表现优于 GPT-4(0.50)和 Claude-2(0.56)。

除了性能指标外,LangChain 基准测试还帮助团队选择平衡质量和响应时间的模型。例如,在 2023 年 RAG 基准测试期间, Mistral-7b 的平均响应时间为 18 秒,明显快于 GPT-3.5 的 29 秒。这种方法可确保支出与性能需求保持一致,从而避免在小型车型足够的情况下为高端车型付出不必要的成本。为了进一步控制开支, 速率限制器 class 管理 API 调用以防止节流费用,而在线评估人员可调整的采样率可在 LLM-as-Judge 评估期间保持成本的可控性。

对于企业用户,LangChain 基准测试提供了 自托管计划 它在 AWS、GCP 或 Azure 上的 Kubernetes 集群上运行,确保数据留在本地。该平台通过无培训政策强制执行严格的数据隐私,并使用异步分布式跟踪收集器来避免在实时应用程序中引入延迟。此外,团队可以将失败的生产跟踪转化为测试用例,从而实现部署前测试和实时监控。

LLM 比较工具既有优势,也有挑战。 OpenAI 评估 因其灵活性而引人注目,它允许团队创建自定义评估逻辑,并将结果无缝集成到Snowflake或Weights & Biases等平台中,所有这些都不会冒敏感数据泄露的风险。也就是说,该平台需要一定程度的技术专业知识,这可能会使非开发人员难以接近。

头盔 提供强大的多供应商集成,支持在单个 Python 框架内对来自 OpenAI、Anthropic 和 Google 的模型进行测试。它还评估偏差、毒性、效率和准确性等关键指标。但是,它对学术基准的强调可能并不总是符合企业的实际需求,例如面向客户的聊天机器人或代理工作流程。

对于注意预算的团队,可以使用诸如此类的工具 牛皮纸 和 whatllm.org 通过在 “最佳价值” 下对模型进行分类并提供每代币价格图表,提供有价值的见解。例如, 新星微型 每100万个代币的投入定价为0.04美元,产出价格为0.14美元,而 GPT-4.5 每100万个代币的投入收入大幅上涨,为75.00美元,产出为150.00美元。这些排行榜会定期更新,要求团队对定价变化和新车型发布保持警惕。

具有安全意识的企业可能会倾向于使用诸如此类的模式 Claude Opus 4.5,截至2025年11月,它在整体人工智能测试中获得了100%的完美越狱阻力分数,超过了 Claude 3.7 十四行诗 99%。另一方面,一些工具会优先考虑纯粹的性能- Llama 4 Scout例如,它是可用的最快模型之一,每秒最多可处理 2,600 个代币。平衡这些因素(性能、成本和安全性)需要仔细考虑多种工具。这些见解共同帮助团队根据其特定工作流程做出明智的决策。

选择正确的LLM比较工具取决于您的特定工作流程和优先级。对于企业团队而言,重点应放在确保强有力的安全措施和有效的偏见控制的工具上。另一方面,个人开发人员可能会优先考虑提供成本效益和速度的工具。研究人员从提供可重复基准和透明评估方法的平台中受益最大。这些因素指导着评价做法的不断完善。

“如果你使用LLM进行构建,那么创建高质量的评估是你可以做的最有影响力的事情之一。” — OpenAI总裁格雷格·布罗克曼

评估标准正在扩展到传统指标之外。对于注意预算的团队来说,将质量指标与成本进行比较可以发现意想不到的价值——有些模型在没有高昂价格的情况下擅长完成特定任务。同时,更高级的模型对于复杂的推理任务是必不可少的,但前提是用例证明其支出是合理的。

LLM 比较工具以直截了当的并排格式呈现复杂的定价细节,从而更容易管理成本。例如,它们会分解每个代币的费率——比如 对于较小的模型,每 1,000 个代币 0.0003 美元 与 大型型号为 0.0150 美元 -并让用户输入他们的预期用量。这样可以即时估算出针对特定工作负载量身定制的每月支出,从而帮助团队确定最经济实惠的模式,同时仍能提供所需的性能。

除了成本明细外,这些工具还根据其成本效率对模型进行排名,并允许按准确性、推理能力或安全性等因素进行过滤。此功能使用户能够探索诸如切换到低成本模型之类的场景,同时保持可接受的质量。有了这些见解,组织可以削减 API 支出,避开过度配置,并将节省的资金转用于其 AI 运营的其他重要方面。

在选择工具来比较企业应用程序的大型语言模型 (LLM) 时,优先考虑提供以下功能的平台 对模型性能进行清晰的并排比较。选择能够呈现易于理解的视觉效果(例如图表)的工具,以评估推理、编码和多模态任务等关键基准的模型。获得准确性、速度和成本等指标对于做出明智的决策至关重要。

企业解决方案还应强调 成本清晰度和运营洞察。寻找提供有关每代币定价、延迟、吞吐量和总拥有成本的详细信息的平台。允许根据特定行业或用例进行筛选的工具对于与组织的目标保持一致特别有用。

最后,确保该工具支持 定制评估和合规需求。可导出报告、API 集成以及私有云或本地环境的部署选项等功能对于维护数据隐私和遵守企业级标准至关重要。

正在评估 准确性 在 LLM 中,对于确保它们持续提供可靠、高质量的结果以满足您的特定需求至关重要。这在精度至关重要的领域尤为重要,例如内容创作、数据分析或管理客户互动。

考虑中 响应时间(延迟) 允许您精确定位能够快速提供答案的模型,这对于以成本和速度为优先事项的实时参与或工作流程至关重要。更快的响应不仅可以提高用户满意度,还可以提高时间敏感场景中的效率。