إن اختيار نموذج اللغة الكبيرة المناسب (LLM) ليس بالمهمة السهلة، حيث توفر خيارات مثل GPT-5 و Claude و Gemini و LLAMA نقاط قوة متفاوتة في الدقة والسلامة والتكلفة والأداء. لاتخاذ قرارات مستنيرة، تحتاج الشركات إلى أدوات توفر مقارنات واضحة تعتمد على البيانات. تستعرض هذه المقالة أفضل أدوات مقارنة LLM، وتسلط الضوء على ميزاتها وتغطية النموذج وقدرات توفير التكاليف.

الوجبات السريعة الرئيسية:

تساعد هذه الأدوات الفرق على مقارنة LLMs استنادًا إلى مقاييس مثل الدقة ووقت الاستجابة والتكلفة والسلامة، مما يضمن اختيار النموذج المناسب لاحتياجات محددة.

مقارنة سريعة:

تعمل هذه الأدوات على تمكين المستخدمين من اتخاذ قرارات LLM أكثر ذكاءً، وتحقيق التوازن بين الأداء والتكلفة والأمان.

مصفوفة ميزات أدوات مقارنة نموذج LLM: التغطية وتحسين التكلفة وقدرات المؤسسة

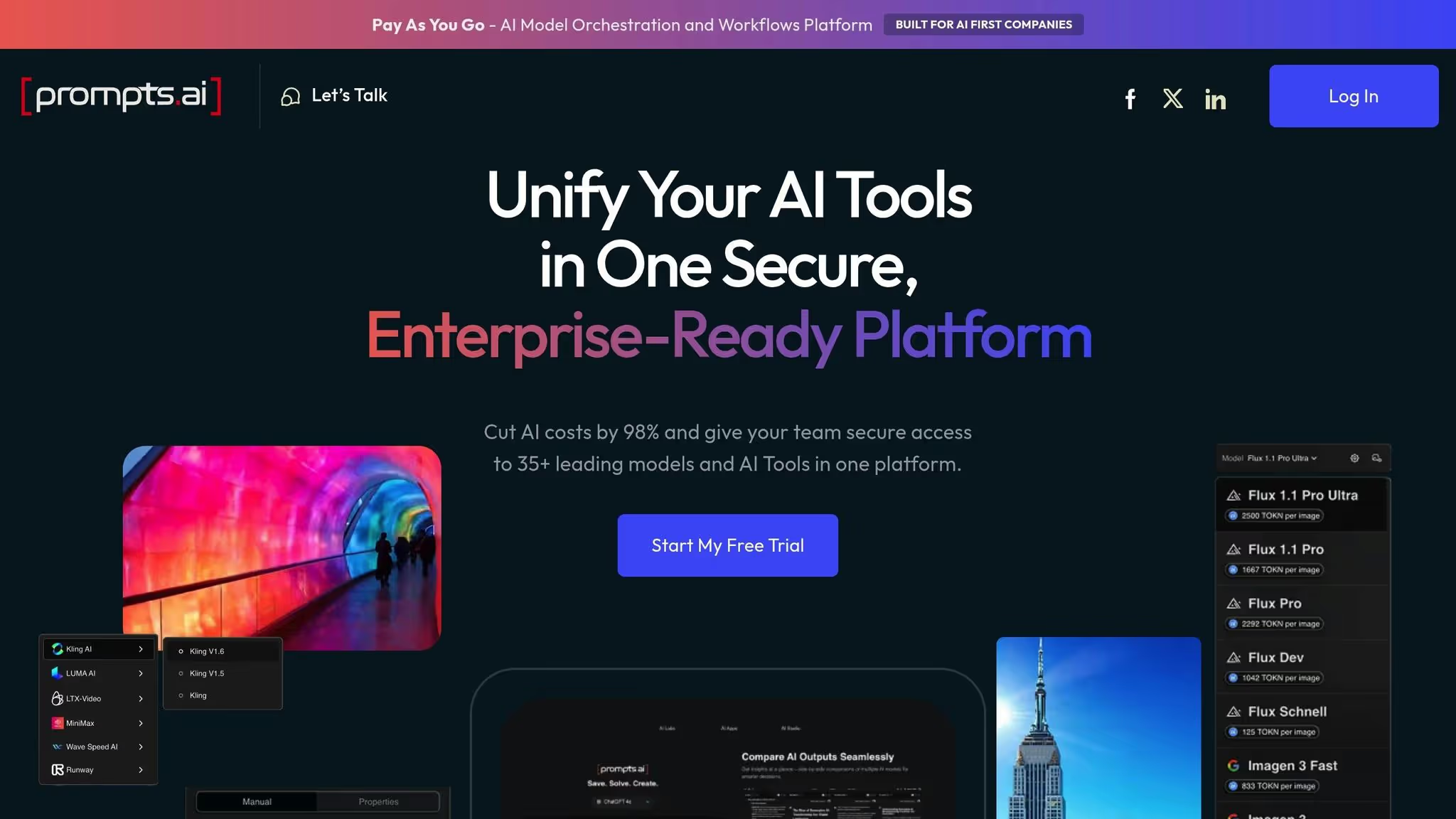

يجمع Prompts.ai أكثر من 35 نموذجًا من نماذج اللغات الكبيرة من الدرجة الأولى (LLMs) في نظام أساسي موحد، مما يزيل متاعب التوفيق بين العديد من مفاتيح API ولوحات المعلومات وأنظمة الفواتير. تدمج المنصة نماذج من قادة الصناعة مثل أنثروبي (سلسلة كلود 4)، أوبن إيه آي (GPT-5)، غوغل (جيميني 3 برو)، ميتا (لاما 4)، أكسي آي، زيبو AI، شركة مونشوت للذكاء الاصطناعي، ديب سيك، و سحابة علي بابا. تسمح هذه التغطية الشاملة للفرق باختبار المطالبات عبر نماذج مثل GPT-5 و Claude 4 و Gemini 3 Pro في بضع دقائق فقط - كل ذلك دون تبديل علامات التبويب أو إدارة اتفاقيات البائع المنفصلة.

يجعل Prompts.ai مقارنة النماذج سلسة من خلال تمكين التقييمات جنبًا إلى جنب. يمكن للمستخدمين تشغيل نفس المدخلات من خلال نماذج مختلفة وتقييمها وفقًا للمقاييس الرئيسية مثل الدقة ووقت الاستجابة والسلامة والتكلفة والتماسك والموثوقية الواقعية. تساعد هذه الميزة الفرق على تحديد أفضل نموذج لاحتياجاتهم الخاصة بدقة.

توفر المنصة تتبع الرموز في الوقت الفعلي والضوابط المالية للمساعدة في إدارة التكاليف بفعالية. وهي تعرض نفقات المدخلات والمخرجات لكل مليون رمز لكل نموذج، مما يسمح للمؤسسات بالبحث عن خيارات فعالة من حيث التكلفة لا تزال تلبي معايير الأداء. من خلال أرصدة TOKN للدفع أولاً بأول، تلغي Prompts.ai رسوم الاشتراك المتكررة، مما يسهل مواءمة الإنفاق مع الاستخدام الفعلي وإظهار عائد الاستثمار. تضمن هذه الأدوات الوضوح المالي وتجعل البقاء ضمن الميزانية أكثر قابلية للإدارة.

تم إنشاء Prompts.ai مع وضع الحوكمة والأمان والامتثال على مستوى المؤسسة في الاعتبار. يتم تسجيل كل تفاعل للذكاء الاصطناعي من خلال مسارات تدقيق مفصلة، مما يضمن بقاء البيانات الحساسة آمنة وتحت السيطرة. تتضمن المنصة التدريب العملي على الإعداد وبرنامج شهادة المهندس الفوري لوضع أفضل الممارسات عبر الفرق. سواء كنت شركة Fortune 500 ذات سياسات بيانات صارمة أو وكالة إبداعية تتطلع إلى توسيع نطاق سير العمل بكفاءة، فإن Prompts.ai تتكيف بسرعة - بإضافة النماذج والمستخدمين والفرق في دقائق دون فوضى الأدوات غير المتصلة.

اعتبارًا من 12 يناير 2026، llm-stats.com مسارات مثيرة للإعجاب 235 نماذج الذكاء الاصطناعي، واضعةً نفسها كواحدة من أكثر موارد قياس الأداء المتاحة تفصيلاً. تتضمن قاعدة البيانات الخاصة بها كلاً من النماذج الاحتكارية الرائدة - مثل GPT-5.2 و Gemini 3 Pro و Claude Opus 4.5 - وخيارات مفتوحة المصدر مثل GLM-4.7 من Zhipu AI و Mimo-v2-flash من زياومي. يشمل هذا النطاق اللاعبين الرئيسيين في الولايات المتحدة، مثل OpenAI و Google و Anthropic و xAI، بالإضافة إلى المطورين الصينيين البارزين، بما في ذلك Zhipu AI، مينيماكس، شياومي، مونشوت إيه آي، وديب سيك.

تقوم المنصة بتصنيف هذه النماذج إلى قوائم المتصدرين بناءً على الأداء في مجالات مثل الترميز وتوليد الصور والكتابة وفتح LLMs. تركز التصنيفات الإضافية على المجالات المتخصصة مثل الرعاية الصحية والقانونية والمالية والرياضيات والعلوم والرؤية. والجدير بالذكر أن بعض الموديلات، مثل Gemini 3 Pro و Gemini 3 Flash، تدعم نوافذ السياق التي تصل إلى 1.0 مليون توكن، مما يوفر للمستخدمين مرونة استثنائية للتطبيقات المتقدمة. تشكل هذه التغطية الواسعة العمود الفقري لأداء المنصة وتقييمات التكلفة.

يقدم llm-stats.com أدوات لمقارنات النماذج جنبًا إلى جنب، مما يسمح للمستخدمين بتقييم الأداء عبر أبعاد متعددة. على سبيل المثال، اعتبارًا من يناير 2026، تتصدر Gemini 3 Pro التصنيفات بدرجة أداء تبلغ 1,519، في حين أن GPT-5.2 تفتخر بـ نسبة نجاح 92.4% على معايير محددة. تغطي هذه المقارنات مجالات مثل استخدام الأدوات وإمكانيات السياق الطويل والمخرجات المنظمة والمهام الإبداعية.

تقوم المنصة أيضًا بتقييم النماذج عبر فئات التطبيقات المختلفة، أو «الساحات الفرعية»، بما في ذلك واجهات الصور والفيديو والموقع الإلكتروني والألعاب والدردشة. يساعد هذا التقسيم التفصيلي الفرق على تحديد أفضل النماذج لاحتياجاتهم الخاصة. بالإضافة إلى مقاييس الأداء، يركز llm-stats.com بشدة على شفافية التكلفة.

إحدى الميزات البارزة لـ llm-stats.com هي بيانات التسعير التفصيلية، والتي تسرد التكاليف الدقيقة لكل مليون رمز إدخال وإخراج. على سبيل المثال، يتم تسعير Gemini 3 Pro بـ 2.00 دولار لكل مليون رمز إدخال و 12.00 دولارًا لكل مليون رمز إخراج، في حين أن تكلفة فلاش Mimo-v2-flash الأكثر ملاءمة للميزانية فقط 0.10 دولار للإدخال و 0.30 دولار للإخراج. بالإضافة إلى ذلك، تقدم المنصة برنامجًا لخفض تكلفة الاستدلال يمكنه خفض نفقات الإنتاج بنسبة تصل إلى 30%مما يجعلها أداة قيّمة لإدارة تكاليف نشر الذكاء الاصطناعي.

تم تصميم OpenAI Eval Suite لتقييم مجموعة متنوعة من النماذج، بما في ذلك GPT-4 و GPT-4.1 و GPT-3.5 و GPT-4o و GPT-4o-mini و o3 و o3-mini، بالإضافة إلى نماذج اللغات الكبيرة التابعة لجهات خارجية (LLMs). تتيح هذه المرونة للفرق تقييم ليس فقط النماذج الفردية ولكن أيضًا أنظمة LLM الكاملة، بما في ذلك التفاعلات أحادية الدور، وسير العمل متعدد الخطوات، وحتى الوكلاء المستقلين في كل من إعدادات الوكيل الفردي ومتعدد الوكلاء. يشكل هذا التوافق الشامل للنماذج العمود الفقري لإمكانيات تقييم المجموعة.

يوفر الجناح سجل مفتوح المصدر تتميز بمعايير صعبة، مثل MMLU و CoQA و Spider. يمكن للمستخدمين الاختيار من بين طريقتين للتقييم:

بالنسبة للفرق التي تحتاج إلى حلول مخصصة، يدعم الإطار التقييمات المخصصة بتنسيقات Python أو YAML أو JSONL.

أظهر قضاة LLM، مثل GPT4.1، اتفاقًا يزيد عن 80٪ مع المقيّمين البشريين، بما يتماشى بشكل وثيق مع مستويات الإجماع البشري النموذجية. كما هو موضح في وثائق OpenAI:

«إذا كنت تقوم بالبناء باستخدام نماذج أساسية مثل GPT-4، فإن إنشاء تقييمات عالية الجودة هو أحد أكثر الأشياء تأثيرًا التي يمكنك القيام بها».

هذه الأدوات المتقدمة مناسبة تمامًا للتطبيقات العامة والخاصة بالمؤسسات.

بالنسبة لمستخدمي المؤسسات، تدعم Eval Suite التقييمات الخاصة باستخدام مجموعات البيانات الداخلية. تتضمن خيارات التكامل واجهة سطر أوامر (أوسايفال)، وواجهة برمجة التطبيقات، ولوحة معلومات OpenAI، التي تلبي احتياجات المستخدمين غير التقنيين. يمكن تسجيل النتائج مباشرة إلى قواعد بيانات سنوفلاك لإدارة البيانات المبسطة. بالإضافة إلى ذلك، تسمح المجموعة بوضع علامات على البيانات الوصفية بما يصل إلى 16 زوجًا من قيم المفاتيح لكل كائن تقييم، مع قيود تبلغ 64 حرفًا للمفاتيح و 512 حرفًا للقيم.

تتضمن مجموعة Eval أدوات لـ تقطير نموذجي، مما يمكّن الفرق من نقل المعرفة من النماذج الأكبر والأكثر تكلفة إلى بدائل أصغر وأسرع وبأسعار معقولة. يعد التحكيم الآلي باستخدام LLMs خيارًا فعالاً من حيث التكلفة، على الرغم من أن رسوم API القياسية لا تزال سارية. للمساعدة في إدارة الميزانية، توفر المنصة تقارير استخدام مفصلة لكل نموذج، ومقاييس التتبع مثل عدد الرموز السريعة والإكمال والتخزين المؤقت، مما يسمح للفرق بمراقبة إنفاقها عن كثب.

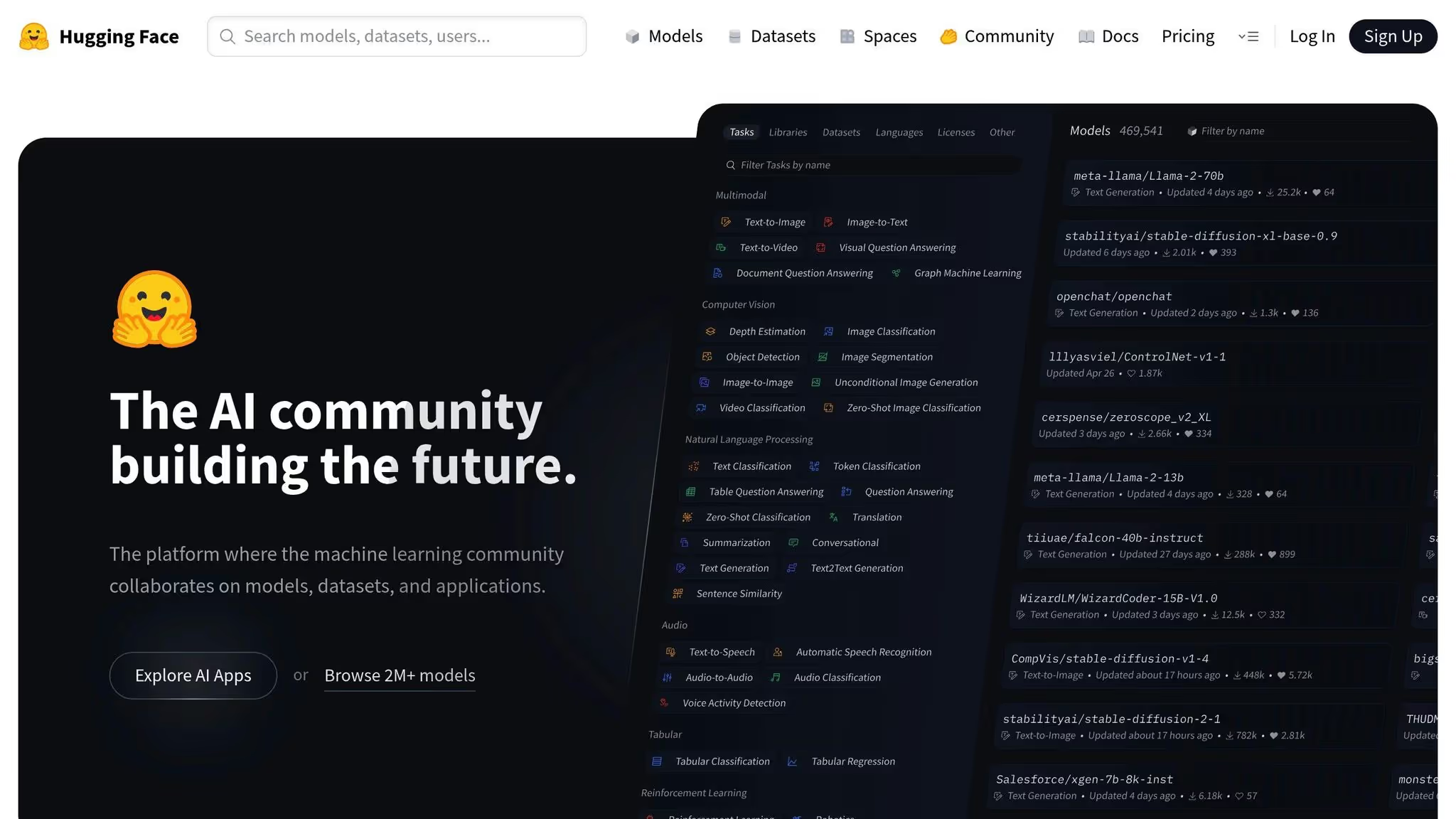

تعمل Hugging Face Evaluate على توسيع نطاق وصولها إلى ما هو أبعد من نماذج اللغة التقليدية القائمة على النص، حيث تستوعب مجموعة واسعة من أنواع النماذج. وتشمل هذه نماذج لغة الرؤية (VLMs) ونماذج التضمين ونماذج LLMs الوكيل ونماذج التعرف على الصوت/الكلام. على سبيل المثال، يقوم OpenVLM Leaderboard بتقييم أكثر من 272 نموذجًا من نماذج لغة الرؤية عبر 31 معيارًا متعدد الوسائط، ويضم نماذج API المتاحة للجمهور مثل GPT-4v و Gemini. وبالمثل، يقوم معيار تضمين النص الشامل (MTEB) بتقييم أكثر من 100 نموذج لتضمين النص والصور، يمتد على أكثر من 1000 لغة.

تقدم المنصة ثلاثة مسارات رئيسية للتقييم: لوحات المتصدرين المجتمعية لنماذج الترتيب، بطاقات نموذجية لعرض القدرات الخاصة بالنموذج والأدوات مفتوحة المصدر مثل تقييم و ضوء إيفال لبناء عمليات سير عمل مخصصة [20,21]. بالنسبة لأولئك الذين يقارنون LLMs، تدعم مكتبة LightEval أكثر من 1,000 مهمة وتتكامل بسلاسة مع الخلفيات المتقدمة مثل vLLM و TGI ونقاط نهاية استدلال الوجه العناق [19,26]. يضع هذا الدعم الشامل للنموذج أساسًا قويًا لحلول قياس الأداء المصممة خصيصًا.

تنظم Hugging Face EVALUATE أدوات القياس الخاصة بها في ثلاثة مجالات رئيسية: المقاييس، مقارنات، و القياسات [22,23]. استخدام تقييم. مقيم () أداة، يمكن للمستخدمين إدخال نموذج ومجموعة بيانات ومقياس لأتمتة الاستدلال من خلال محولات خطوط الأنابيب.

لضمان الدقة، تتضمن المنصة أساليب إحصائية متقدمة. يتم استخدام Bootstrapping لحساب فترات الثقة والخطأ المعياري، مما يوفر رؤى حول استقرار النتيجة. يوفر اختبار McNemar قيمة p لتحديد ما إذا كانت تنبؤات النموذجين تختلف بشكل كبير. في بيئات الحوسبة الموزعة، يتم استخدام Apache Arrow لتخزين التنبؤات والمراجع عبر العقد، مما يتيح حساب المقاييس المعقدة مثل F1 دون زيادة التحميل على وحدة معالجة الرسومات أو ذاكرة وحدة المعالجة المركزية. بالإضافة إلى درجات الأداء فقط، تعطي المنصة أيضًا الأولوية لاعتبارات النشر العملية، مما يجعلها مناسبة للاحتياجات على مستوى المؤسسة.

مع اعتماد أكثر من 23,600 مشروع على GitHub عليه، يوفر Huging Face Equalization إمكانات على مستوى المؤسسات. يتتبع البيانات الوصفية للنظام لضمان إمكانية تكرار التقييمات [20,23]. ال اضغط على المحور () تسمح الميزة للفرق بتحميل النتائج مباشرة إلى Hugging Face Hub، مما يتيح إعداد التقارير الشفافة والتعاون السلس داخل المنظمات.

كلا من تقييم و ضوء إيفال المكتبات مفتوحة المصدر، ويتم تقديمها بموجب تراخيص متساهلة - Apache-2.0 و MIT، على التوالي [19,26]. في حين أن المكتبات مجانية الاستخدام، فإن أي تقييمات يتم إجراؤها من خلال نقاط النهاية الاستدلالية أو واجهات برمجة التطبيقات التابعة لجهات خارجية قد تتحمل تكاليف بناءً على مزود الخدمة. بالإضافة إلى ذلك، يتتبع LLM-perf Leaderboard استخدام الطاقة والذاكرة، مما يساعد المؤسسات على اختيار النماذج التي تتوافق مع إمكانات الأجهزة وقيود الميزانية [20,21]. تجعل هذه الميزات Hugging Face Valuate أداة لا غنى عنها لتحسين سير عمل الذكاء الاصطناعي في كل من الأبعاد التقنية والعملية.

تركز LangChain Benchmarks على التطبيقات العملية وكفاءة التكلفة، لتكمل الأدوات الأخرى المصممة لمقارنة نماذج اللغات الكبيرة (LLMs).

تدعم LangChain Benchmarks مجموعة واسعة من النماذج، بما في ذلك GPT-4 Turbo و GPT-3.5 من شركة OpenAI، وكلود 3 أوبوس وهايكو وسونيت من أنثروبيك، وجيميني 1.0 و1.5، وميكسترال 8x22b من شركة ميسترال. كما يتضمن خيارات مفتوحة المصدر مثل Mistral-7b و Zephyr. يسمح هذا التوافق الواسع للفرق بتقييم كل من النماذج الاحتكارية والمفتوحة المصدر ضمن إطار موحد، مما يوفر رؤى مصممة خصيصًا لحالات الاستخدام العملي.

تم تصميم الأداة لمهام العالم الحقيقي مثل الجيل المعزز للاسترجاع (RAG) واستخراج البيانات واستخدام أداة الوكيل. يتكامل مع لانج سميث لتوفير آثار تنفيذ مفصلة، مما يسهل تحديد ما إذا كانت المشكلات تنبع من أخطاء الاسترجاع أو منطق النموذج.

تستخدم معايير LangChain طرق تقييم مختلفة، بما في ذلك ماجستير في القانون كقاضوالقواعد المستندة إلى التعليمات البرمجية والمراجعات البشرية والمقارنات الزوجية. تُبرز طريقة عرض المقارنة التغييرات بصريًا، مع تمييز الانحدارات باللون الأحمر والتحسينات باللون الأخضر، مما يبسط تتبع الأداء. على سبيل المثال، في معايير الأسئلة والأجوبة الأولية باستخدام وثائق LangChain، فإن سجلت واجهة برمجة تطبيقات OpenAI Assistant أعلى مستوى عند 0.62، متفوقًا على GPT-4 (0.50) وكلود-2 (0.56) في مهام الاسترجاع التحادثي.

بالإضافة إلى مقاييس الأداء، تساعد LangChain Benchmarks الفرق على اختيار النماذج التي توازن الجودة ووقت الاستجابة. على سبيل المثال، خلال معيار RAG لعام 2023، حقق Mistral-7b متوسط وقت استجابة قدره 18 ثانية، وهو أسرع بكثير من 29 ثانية لـ GPT-3.5. يضمن هذا النهج مواءمة الإنفاق مع احتياجات الأداء، وتجنب التكاليف غير الضرورية للنماذج المتميزة عندما تكفي النماذج الصغيرة. لمزيد من التحكم في النفقات، فإن محدد المعدل يدير الفصل مكالمات API لمنع الرسوم الخانقة، بينما تحافظ معدلات أخذ العينات القابلة للتعديل للمقيّمين عبر الإنترنت على إمكانية التحكم في التكاليف أثناء تقييمات LLM-as-judge.

بالنسبة لمستخدمي المؤسسات، تقدم معايير LangChain خطة الاستضافة الذاتية يتم تشغيله على مجموعات Kubernetes عبر AWS أو GCP أو Azure، مما يضمن بقاء البيانات محلية. تفرض المنصة خصوصية صارمة للبيانات من خلال سياسة عدم التدريب وتستخدم أداة تجميع التتبع الموزعة غير المتزامنة لتجنب إدخال وقت الاستجابة في التطبيقات الحية. بالإضافة إلى ذلك، يمكن للفرق تحويل آثار الإنتاج الفاشلة إلى حالات اختبار، مما يتيح اختبار ما قبل النشر والمراقبة في الوقت الفعلي.

تجلب أدوات مقارنة LLM مزيجًا من نقاط القوة والتحديات إلى الطاولة. تقييمات OpenAI تتميز بمرونتها، مما يسمح للفرق بإنشاء منطق تقييم مخصص ودمج النتائج بسلاسة في منصات مثل Snowflake أو Weights & Beides - كل ذلك دون المخاطرة بالتعرض للبيانات الحساسة. ومع ذلك، تتطلب المنصة مستوى معينًا من الخبرة الفنية، مما قد يجعلها أقل سهولة لغير المطورين.

رأس يوفر تكاملاً قويًا متعدد المزودين، مما يتيح الاختبار عبر نماذج من OpenAI و Anthropic و Google ضمن إطار Python واحد. كما يقوم بتقييم المقاييس الهامة مثل التحيز والسمية والكفاءة والدقة. ومع ذلك، فإن تركيزها على المعايير الأكاديمية قد لا يتماشى دائمًا مع احتياجات المؤسسة العملية، مثل روبوتات المحادثة التي تتعامل مع العملاء أو عمليات سير عمل الوكلاء.

بالنسبة للفرق التي تضع في اعتبارها الميزانيات، فإن الأدوات مثل فيلوم و whatllm.org تقديم رؤى قيمة من خلال تصنيف النماذج ضمن «أفضل قيمة» وتقديم مخططات السعر لكل رمز. على سبيل المثال، نوفا مايكرو بسعر 0.04 دولار للإدخال و 0.14 دولار للإخراج لكل مليون رمز، بينما GPT-4.5 يأتي بسعر أعلى بكثير عند 75.00 دولارًا للإدخال و 150.00 دولارًا للإخراج لكل مليون رمز. يتم تحديث قوائم المتصدرين هذه بانتظام، مما يتطلب من الفرق البقاء في حالة تأهب لتغييرات الأسعار وإصدارات النماذج الجديدة.

قد تنجذب الشركات المهتمة بالأمن نحو نماذج مثل كلود أوبوس 4.5، والتي حققت درجة مقاومة مثالية بنسبة 100٪ في اختبار الذكاء الاصطناعي الشامل اعتبارًا من نوفمبر 2025، متجاوزة كلود 3.7 سونيت 99%. من ناحية أخرى، تعطي بعض الأدوات الأولوية للأداء المطلق - لاما 4 سكاوت، على سبيل المثال، هو أحد أسرع النماذج المتاحة، حيث يعالج ما يصل إلى 2600 رمز في الثانية. تتطلب موازنة هذه العوامل - الأداء والتكلفة والأمان - دراسة متأنية لأدوات متعددة. تساعد هذه الرؤى معًا الفرق على اتخاذ قرارات مستنيرة مصممة خصيصًا لسير العمل المحدد.

يتوقف تحديد أداة مقارنة LLM الصحيحة على سير العمل والأولويات المحددة. بالنسبة لفرق المؤسسة، يجب أن يكون التركيز على الأدوات التي تضمن تدابير أمنية قوية وضوابط تحيز فعالة. من ناحية أخرى، قد يعطي المطورون الفرديون الأولوية للأدوات التي توفر كفاءة التكلفة والسرعة. يستفيد الباحثون أكثر من المنصات التي توفر معايير قابلة للتكرار وطرق تقييم شفافة. توجه هذه العوامل التحسين المستمر لممارسات التقييم.

«إذا كنت تقوم بالبناء باستخدام LLMs، فإن إنشاء تقييمات عالية الجودة هو أحد أكثر الأشياء تأثيرًا التي يمكنك القيام بها.» - جريج بروكمان، رئيس OpenAI

تتوسع معايير التقييم بما يتجاوز المقاييس التقليدية. بالنسبة للفرق التي تدرك الميزانيات، يمكن أن تكشف مقارنة مقاييس الجودة جنبًا إلى جنب مع التكلفة عن قيمة غير متوقعة - تتفوق بعض النماذج في مهام محددة دون دفع السعر المتميز. في الوقت نفسه، لا غنى عن النماذج الأكثر تقدمًا لمهام التفكير المعقدة، ولكن فقط عندما تبرر حالة الاستخدام نفقاتها.

تعمل أدوات مقارنة LLM على تسهيل إدارة التكاليف من خلال تقديم تفاصيل التسعير المعقدة بتنسيق مباشر جنبًا إلى جنب. على سبيل المثال، يقومون بتفصيل معدلات كل رمز - مثل 0.0003 دولار لكل 1,000 رمز للموديلات الأصغر ضد 0.0150 دولارًا للموديلات الأكبر - والسماح للمستخدمين بإدخال الاستخدام المتوقع. يؤدي ذلك إلى إنشاء تقديرات فورية للنفقات الشهرية المصممة خصيصًا لأحمال عمل محددة، مما يساعد الفرق على تحديد النموذج الأكثر ملاءمة للميزانية والذي لا يزال يوفر الأداء الذي يحتاجون إليه.

بالإضافة إلى تفاصيل التكلفة، تقوم هذه الأدوات بتصنيف النماذج بناءً على كفاءتها من حيث التكلفة وتسمح بالتصفية حسب عوامل مثل الدقة أو القدرة على التفكير أو السلامة. تتيح هذه الوظيفة للمستخدمين استكشاف سيناريوهات مثل التبديل إلى نموذج منخفض التكلفة مع الحفاظ على الجودة المقبولة. وبفضل هذه الرؤى، يمكن للمؤسسات خفض الإنفاق على واجهات برمجة التطبيقات، وتجنب الإفراط في التوفير، وإعادة توجيه المدخرات إلى الجوانب الحيوية الأخرى لعمليات الذكاء الاصطناعي الخاصة بها.

عند اختيار أداة لمقارنة نماذج اللغات الكبيرة (LLMs) لتطبيقات المؤسسات، قم بإعطاء الأولوية للمنصات التي تقدم مقارنة واضحة جنبًا إلى جنب لأداء النموذج. اختر الأدوات التي تقدم صورًا سهلة الفهم، مثل المخططات، لتقييم النماذج عبر المعايير الهامة مثل التفكير والترميز والمهام متعددة الوسائط. يعد الوصول إلى مقاييس مثل الدقة والسرعة والتكلفة أمرًا بالغ الأهمية لاتخاذ قرارات مستنيرة.

يجب أن تؤكد حلول المؤسسات أيضًا وضوح التكلفة والرؤى التشغيلية. ابحث عن المنصات التي توفر معلومات مفصلة عن التسعير لكل رمز، ووقت الاستجابة، والإنتاجية، والتكلفة الإجمالية للملكية. يمكن أن تكون الأدوات التي تسمح بالتصفية استنادًا إلى صناعات أو حالات استخدام محددة مفيدة بشكل خاص للتوافق مع أهداف مؤسستك.

أخيرًا، تأكد من دعم الأداة التقييمات المخصصة واحتياجات الامتثال. تعد الميزات مثل التقارير القابلة للتصدير وتكامل واجهة برمجة التطبيقات وخيارات النشر للسحابة الخاصة أو البيئات المحلية ضرورية للحفاظ على خصوصية البيانات والالتزام بالمعايير على مستوى المؤسسة.

تقييم صحة في LLMs أمر ضروري لضمان أنها تقدم باستمرار نتائج موثوقة وعالية الجودة تناسب احتياجاتك الخاصة. يصبح هذا مهمًا بشكل خاص في المجالات التي تكون فيها الدقة أمرًا بالغ الأهمية، مثل إنشاء المحتوى أو تحليل البيانات أو إدارة تفاعلات العملاء.

مع مراعاة وقت الاستجابة (وقت الاستجابة) يسمح لك بتحديد النماذج القادرة على تقديم إجابات سريعة، وهو أمر أساسي للمشاركة في الوقت الفعلي أو سير العمل حيث تكون التكلفة والسرعة من الأولويات. لا تؤدي الاستجابات السريعة إلى تحسين رضا المستخدم فحسب، بل تعزز أيضًا الكفاءة في السيناريوهات الحساسة للوقت.