सही बड़े भाषा मॉडल (LLM) को चुनना कोई आसान काम नहीं है, जिसमें GPT-5, क्लाउड, जेमिनी और लामा जैसे विकल्प सटीकता, सुरक्षा, लागत और प्रदर्शन में अलग-अलग ताकत प्रदान करते हैं। सोच-समझकर निर्णय लेने के लिए, व्यवसायों को ऐसे टूल की आवश्यकता होती है, जो स्पष्ट, डेटा-संचालित तुलना प्रदान करते हैं। यह लेख सर्वश्रेष्ठ एलएलएम तुलनात्मक टूल की समीक्षा करता है, जिसमें उनकी विशेषताओं, मॉडल कवरेज और लागत-बचत क्षमताओं पर प्रकाश डाला गया है।

मुख्य बातें:

ये उपकरण टीमों को सटीकता, विलंबता, लागत और सुरक्षा जैसे मैट्रिक्स के आधार पर एलएलएम की तुलना करने में मदद करते हैं, यह सुनिश्चित करते हैं कि विशिष्ट आवश्यकताओं के लिए सही मॉडल चुना जाए।

त्वरित तुलना:

ये उपकरण उपयोगकर्ताओं को लागत और सुरक्षा के साथ प्रदर्शन को संतुलित करते हुए बेहतर एलएलएम निर्णय लेने के लिए सशक्त बनाते हैं।

एलएलएम मॉडल तुलना उपकरण फ़ीचर मैट्रिक्स: कवरेज, लागत अनुकूलन और एंटरप्राइज़ क्षमताएं

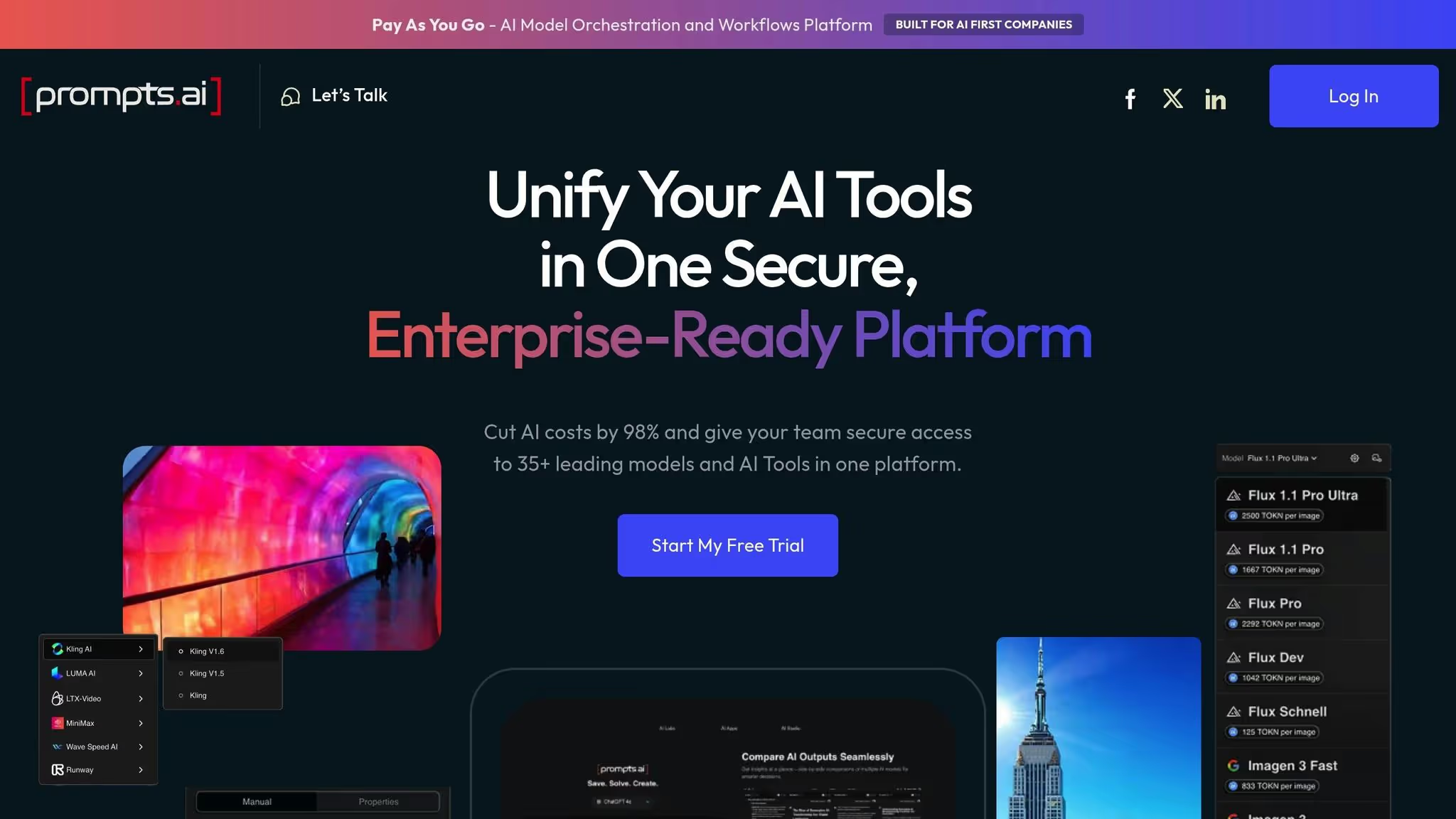

Prompts.ai 35 से अधिक शीर्ष स्तरीय बड़े भाषा मॉडल (LLM) को एक एकीकृत प्लेटफ़ॉर्म में लाता है, जिससे कई API कुंजियों, डैशबोर्ड्स और बिलिंग सिस्टम को जॉगलिंग करने की परेशानी दूर हो जाती है। प्लेटफ़ॉर्म उद्योग के नेताओं के मॉडल को एकीकृत करता है जैसे एंथ्रोपिक (क्लाउड 4 सीरीज़), ओपनएआई (जीपीटी-5), गूगल (जेमिनी 3 प्रो), मेटा (लामा 4), एक्सएआई, झीपू एआई, मूनशॉट एआई, डीप सीक, और अलीबाबा क्लाउड। इस व्यापक कवरेज से टीमें कुछ ही मिनटों में GPT-5, Claude 4, और Gemini 3 Pro जैसे मॉडलों के प्रॉम्प्ट का परीक्षण कर सकती हैं - यह सब टैब स्विच किए बिना या अलग-अलग विक्रेता अनुबंधों को प्रबंधित किए बिना।

Prompts.ai साइड-बाय-साइड मूल्यांकन को सक्षम करके मॉडल तुलना को सहज बनाता है। उपयोगकर्ता एक ही इनपुट को विभिन्न मॉडलों के माध्यम से चला सकते हैं और सटीकता, विलंबता, सुरक्षा, लागत, सुसंगतता और तथ्यात्मक विश्वसनीयता जैसे प्रमुख मैट्रिक्स पर उनका आकलन कर सकते हैं। यह सुविधा टीमों को सटीकता के साथ अपनी विशिष्ट आवश्यकताओं के लिए सर्वश्रेष्ठ मॉडल की पहचान करने में मदद करती है।

प्लेटफ़ॉर्म लागतों को प्रभावी ढंग से प्रबंधित करने में मदद करने के लिए रीयल-टाइम टोकन ट्रैकिंग और वित्तीय नियंत्रण प्रदान करता है। यह प्रत्येक मॉडल के लिए प्रति मिलियन टोकन के इनपुट और आउटपुट खर्चों को प्रदर्शित करता है, जिससे उद्यमों को लागत-कुशल विकल्पों के लिए फ़िल्टर करने की अनुमति मिलती है जो अभी भी प्रदर्शन मानकों को पूरा करते हैं। अपने पे-एज़-यू-गो TOKN क्रेडिट के साथ, Prompts.ai आवर्ती सदस्यता शुल्क को समाप्त कर देता है, जिससे वास्तविक उपयोग के साथ खर्च को संरेखित करना और ROI प्रदर्शित करना आसान हो जाता है। ये टूल वित्तीय स्पष्टता सुनिश्चित करते हैं और बजट के भीतर रहने को अधिक प्रबंधनीय बनाते हैं।

Prompts.ai को एंटरप्राइज़-स्तरीय शासन, सुरक्षा और अनुपालन को ध्यान में रखकर बनाया गया है। प्रत्येक AI इंटरैक्शन को विस्तृत ऑडिट ट्रेल्स के साथ लॉग किया जाता है, जिससे यह सुनिश्चित होता है कि संवेदनशील डेटा सुरक्षित और नियंत्रण में रहे। प्लेटफ़ॉर्म में हैंड्स-ऑन ऑनबोर्डिंग और एक प्रॉम्प्ट इंजीनियर सर्टिफिकेशन प्रोग्राम शामिल है, ताकि टीमों के बीच सर्वोत्तम अभ्यास स्थापित किए जा सकें। चाहे आप सख्त डेटा नीतियों वाली Fortune 500 कंपनी हों या वर्कफ़्लो को कुशलता से स्केल करने की कोशिश करने वाली एक रचनात्मक एजेंसी हो, Prompts.ai तेज़ी से अपना लेता है - डिस्कनेक्ट किए गए टूल की अव्यवस्था के बिना मिनटों में मॉडल, यूज़र और टीम जोड़ देता है।

12 जनवरी, 2026 तक llm-stats.com एक प्रभावशाली ट्रैक करता है 235 AI मॉडल, खुद को उपलब्ध सबसे विस्तृत बेंचमार्किंग संसाधनों में से एक के रूप में स्थान देना। इसके डेटाबेस में दोनों प्रमुख मालिकाना मॉडल शामिल हैं - जैसे GPT-5.2, Gemini 3 Pro, और क्लाउड ओपस 4.5 - और Zhipu AI से GLM-4.7 और Mimo-V2-Flash जैसे ओपन-सोर्स विकल्प Xiaomi। यह रेंज अमेरिका के प्रमुख खिलाड़ियों, जैसे कि OpenAI, Google, Anthropic, और XAi के साथ-साथ Zhipu AI सहित प्रमुख चीनी डेवलपर्स तक फैली हुई है। मिनीमैक्स, श्याओमी, मूनशॉट एआई और डीपसेक।

प्लेटफ़ॉर्म इन मॉडलों को कोडिंग, इमेज जनरेशन, राइटिंग और ओपन एलएलएम जैसे क्षेत्रों में प्रदर्शन के आधार पर लीडरबोर्ड में वर्गीकृत करता है। अतिरिक्त रैंकिंग हेल्थकेयर, लीगल, फाइनेंस, मैथ एंड साइंस और विज़न जैसे विशिष्ट क्षेत्रों पर केंद्रित होती है। विशेष रूप से, कुछ मॉडल, जैसे कि जेमिनी 3 प्रो और जेमिनी 3 फ्लैश, अधिकतम की कॉन्टेक्स्ट विंडो का समर्थन करते हैं 1.0 मिलियन टोकन, उपयोगकर्ताओं को उन्नत अनुप्रयोगों के लिए असाधारण लचीलापन प्रदान करता है। यह व्यापक कवरेज प्लेटफ़ॉर्म के प्रदर्शन और लागत मूल्यांकन का आधार है।

llm-stats.com साइड-बाय-साइड मॉडल तुलना के लिए टूल प्रदान करता है, जिससे उपयोगकर्ता कई आयामों में प्रदर्शन का आकलन कर सकते हैं। उदाहरण के लिए, जनवरी 2026 तक, जेमिनी 3 प्रो निम्नलिखित के प्रदर्शन स्कोर के साथ रैंकिंग में सबसे आगे है 1,519, जबकि GPT-5.2 में एक है 92.4% सफलता दर विशिष्ट बेंचमार्क पर। इन तुलनाओं में टूल का उपयोग, लंबे-संदर्भ क्षमताएं, संरचित आउटपुट और रचनात्मक कार्य जैसे क्षेत्र शामिल हैं।

प्लेटफ़ॉर्म विभिन्न एप्लिकेशन श्रेणियों, या “सब-एरेनास” में मॉडल का मूल्यांकन भी करता है, जिसमें छवि, वीडियो, वेबसाइट, गेम और चैट इंटरफेस शामिल हैं। यह विस्तृत ब्रेकडाउन टीमों को उनकी विशिष्ट आवश्यकताओं के लिए सर्वश्रेष्ठ मॉडल चुनने में मदद करता है। परफ़ॉर्मेंस मेट्रिक्स के अलावा, llm-stats.com लागत पारदर्शिता पर ज़ोर देता है।

llm-stats.com की एक ख़ास विशेषता इसका विस्तृत मूल्य निर्धारण डेटा है, जो प्रति 1M इनपुट और आउटपुट टोकन की सटीक लागतों को सूचीबद्ध करता है। उदाहरण के लिए, जेमिनी 3 प्रो की कीमत क्या है $2.00 प्रति 1M इनपुट टोकन और $12.00 प्रति 1M आउटपुट टोकन, जबकि अधिक बजट-अनुकूल Mimo-V2-Flash की लागत सिर्फ इनपुट के लिए $0.10 और आउटपुट के लिए $0.30। इसके अतिरिक्त, प्लेटफ़ॉर्म एक अनुमान लागत में कमी कार्यक्रम प्रदान करता है जो उत्पादन खर्च में अधिकतम कटौती कर सकता है 30%, जो इसे AI परिनियोजन लागतों के प्रबंधन के लिए एक मूल्यवान उपकरण बनाता है।

OpenAI Eval Suite को विभिन्न प्रकार के मॉडलों का मूल्यांकन करने के लिए डिज़ाइन किया गया है, जिसमें OpenAI का अपना GPT-4, GPT-4.1, GPT-3.5, GPT-4o, GPT-4O-mini, o3, और o3-mini, साथ ही तृतीय-पक्ष बड़े भाषा मॉडल (LLM) शामिल हैं। यह लचीलापन टीमों को न केवल व्यक्तिगत मॉडल का आकलन करने में सक्षम बनाता है, बल्कि एलएलएम सिस्टम को भी पूरा करता है, जिसमें सिंगल-टर्न इंटरैक्शन, मल्टी-स्टेप वर्कफ़्लो और यहां तक कि सिंगल-एजेंट और मल्टी-एजेंट सेटअप दोनों में स्वायत्त एजेंट शामिल होते हैं। इस तरह की व्यापक मॉडल अनुकूलता सुइट की मूल्यांकन क्षमताओं का आधार बनती है।

सुइट एक प्रदान करता है ओपन-सोर्स रजिस्ट्री जिसमें MMLU, CoQA और स्पाइडर जैसे चुनौतीपूर्ण बेंचमार्क शामिल हैं। उपयोगकर्ता दो मूल्यांकन विधियों में से चुन सकते हैं:

अनुकूलित समाधानों की आवश्यकता वाली टीमों के लिए, फ्रेमवर्क पायथन, वाईएएमएल या जेएसओएनएल प्रारूपों में कस्टम मूल्यांकन का समर्थन करता है।

GPT-4.1 जैसे LLM जजों ने मानव मूल्यांकनकर्ताओं के साथ 80% से अधिक समझौते का प्रदर्शन किया है, जो सामान्य मानव सहमति स्तरों के साथ निकटता से जुड़ा हुआ है। जैसा कि OpenAI के दस्तावेज़ों में हाइलाइट किया गया है:

“यदि आप GPT-4 जैसे मूलभूत मॉडल के साथ निर्माण कर रहे हैं, तो उच्च गुणवत्ता वाले ईवल बनाना आपके द्वारा किए जा सकने वाले सबसे प्रभावशाली कामों में से एक है"।

ये उन्नत उपकरण सामान्य और उद्यम-विशिष्ट अनुप्रयोगों दोनों के लिए उपयुक्त हैं।

एंटरप्राइज़ उपयोगकर्ताओं के लिए, Eval Suite आंतरिक डेटासेट का उपयोग करके निजी मूल्यांकन का समर्थन करता है। एकीकरण विकल्पों में कमांड-लाइन इंटरफ़ेस शामिल है (ओएवल), एक प्रोग्रामेटिक API, और OpenAI डैशबोर्ड, जो गैर-तकनीकी उपयोगकर्ताओं को पूरा करता है। परिणामों को सीधे लॉग इन किया जा सकता है स्नोफ्लेक डेटाबेस सुव्यवस्थित डेटा प्रबंधन के लिए। इसके अतिरिक्त, सुइट अधिकतम के साथ मेटाडेटा टैगिंग की अनुमति देता है 16 कुंजी-मूल्य जोड़े प्रति मूल्यांकन ऑब्जेक्ट, कुंजियों के लिए 64 वर्णों और मानों के लिए 512 वर्णों के प्रतिबंध के साथ।

इवल सूट में निम्नलिखित के लिए उपकरण शामिल हैं मॉडल आसवन, टीमों को बड़े, अधिक महंगे मॉडल से ज्ञान को छोटे, तेज़ और अधिक किफायती विकल्पों में स्थानांतरित करने में सक्षम बनाता है। एलएलएम का उपयोग करके स्वचालित निर्णय लेना एक लागत-कुशल विकल्प है, हालांकि मानक API शुल्क अभी भी लागू होते हैं। बजट प्रबंधन में सहायता के लिए, प्लेटफ़ॉर्म विस्तृत प्रति-मॉडल उपयोग रिपोर्ट, ट्रैकिंग मेट्रिक्स जैसे प्रॉम्प्ट, कंप्लीशन और कैश्ड टोकन काउंट प्रदान करता है, जिससे टीमें अपने खर्च पर कड़ी नज़र रख सकती हैं।

हगिंग फेस इवैल्यूट पारंपरिक टेक्स्ट-आधारित भाषा मॉडल से कहीं आगे अपनी पहुंच का विस्तार करता है, जिसमें मॉडल प्रकारों की एक विस्तृत श्रृंखला शामिल होती है। इनमें विजन-लैंग्वेज मॉडल (VLM), एम्बेडिंग मॉडल, एजेंटिक LLM और ऑडियो/स्पीच रिकग्निशन मॉडल शामिल हैं। उदाहरण के लिए, OpenVLM लीडरबोर्ड 31 मल्टी-मोडल बेंचमार्क में 272 से अधिक विजन-भाषा मॉडल का आकलन करता है, जिसमें GPT-4V और Gemini जैसे सार्वजनिक रूप से उपलब्ध API मॉडल शामिल हैं। इसी तरह, मैसिव टेक्स्ट एम्बेडिंग बेंचमार्क (MTEB) 1,000 से अधिक भाषाओं में फैले 100 से अधिक टेक्स्ट और इमेज एम्बेडिंग मॉडल का मूल्यांकन करता है।

मंच मूल्यांकन के लिए तीन मुख्य पथ प्रदान करता है: सामुदायिक लीडरबोर्ड रैंकिंग मॉडल के लिए, मॉडल कार्ड्स मॉडल-विशिष्ट क्षमताओं को प्रदर्शित करने के लिए, और ओपन-सोर्स टूल जैसे मूल्यांकन करना और लाइट ईवल कस्टम वर्कफ़्लोज़ बनाने के लिए [20,21]। LLM की तुलना करने वालों के लिए, LightEval लाइब्रेरी 1,000 से अधिक कार्यों का समर्थन करती है और VLLM, TGI, और हगिंग फेस इंफ़रेंस एंडपॉइंट्स [19,26] जैसे उन्नत बैकएंड के साथ मूल रूप से एकीकृत होती है। यह व्यापक मॉडल समर्थन अनुकूलित बेंचमार्किंग समाधानों के लिए एक मजबूत आधार देता है।

Hugging Face Evaluate अपने बेंचमार्किंग टूल को तीन प्रमुख क्षेत्रों में व्यवस्थित करता है: मेट्रिक्स, तुलनाएँ, और मापन [22,23]। का उपयोग करना मूल्यांकन करें. इवैलुएटर () उपकरण, उपयोगकर्ता अनुमान को स्वचालित करने के लिए एक मॉडल, डेटासेट और मीट्रिक इनपुट कर सकते हैं रूपांतरकर्ता पाइपलाइन।

सटीकता सुनिश्चित करने के लिए, प्लेटफ़ॉर्म उन्नत सांख्यिकीय तरीकों को शामिल करता है। बूटस्ट्रैपिंग का उपयोग आत्मविश्वास के अंतराल और मानक त्रुटि की गणना करने के लिए किया जाता है, जो स्कोर स्थिरता में अंतर्दृष्टि प्रदान करता है। मैकनेमर टेस्ट यह निर्धारित करने के लिए पी-वैल्यू प्रदान करता है कि दो मॉडल की भविष्यवाणियां काफी भिन्न हैं या नहीं। वितरित कंप्यूटिंग वातावरण में, Apache Arrow का उपयोग सभी नोड्स में भविष्यवाणियों और संदर्भों को संग्रहीत करने के लिए किया जाता है, जिससे GPU या CPU मेमोरी को ओवरलोड किए बिना F1 जैसे जटिल मेट्रिक्स की गणना की जा सकती है। केवल प्रदर्शन स्कोर के अलावा, प्लेटफ़ॉर्म व्यावहारिक परिनियोजन विचारों को भी प्राथमिकता देता है, जिससे यह एंटरप्राइज़-स्तर की ज़रूरतों के लिए उपयुक्त हो जाता है।

GitHub पर 23,600 से अधिक परियोजनाओं के इस पर निर्भर होने के साथ, हगिंग फेस इवैल्यूएशन एंटरप्राइज़-ग्रेड क्षमताएं प्रदान करता है। यह सिस्टम मेटाडेटा को ट्रैक करता है ताकि यह सुनिश्चित किया जा सके कि मूल्यांकन को दोहराया जा सके [20,23]। द push_to_hub () यह सुविधा टीमों को सीधे हगिंग फेस हब पर परिणाम अपलोड करने की अनुमति देती है, जिससे पारदर्शी रिपोर्टिंग और संगठनों के भीतर सहज सहयोग संभव हो जाता है।

दोनों मूल्यांकन करना और लाइट ईवल लाइब्रेरी ओपन-सोर्स हैं, जिन्हें क्रमशः अनुमेय लाइसेंस - अपाचे-2.0 और एमआईटी के तहत पेश किया जाता है [19,26]। हालांकि लाइब्रेरी उपयोग करने के लिए स्वतंत्र हैं, लेकिन अनुमान एंडपॉइंट या तृतीय-पक्ष API के माध्यम से किए गए किसी भी मूल्यांकन में सेवा प्रदाता के आधार पर लागत लग सकती है। इसके अतिरिक्त, LLM-Perf लीडरबोर्ड ऊर्जा और मेमोरी उपयोग को ट्रैक करता है, जिससे उद्यमों को ऐसे मॉडल चुनने में मदद मिलती है जो उनकी हार्डवेयर क्षमताओं और बजट बाधाओं के अनुरूप हों [20,21]। ये सुविधाएं तकनीकी और व्यावहारिक दोनों आयामों में AI वर्कफ़्लो को अनुकूलित करने के लिए Hugging Face Evaluate को एक अनिवार्य टूल बनाती हैं।

लैंगचैन बेंचमार्क व्यावहारिक अनुप्रयोगों और लागत दक्षता पर केंद्रित है, जो बड़े भाषा मॉडल (एलएलएम) की तुलना करने के लिए डिज़ाइन किए गए अन्य टूल का पूरक है।

लैंगचैन बेंचमार्क मॉडल की एक विस्तृत श्रृंखला का समर्थन करता है, जिसमें OpenAI का GPT-4 टर्बो और GPT-3.5, एंथ्रोपिक का क्लाउड 3 ओपस, हाइकू और सॉनेट, Google का जेमिनी 1.0 और 1.5, और मिस्ट्रल का मिक्सट्रल 8x22b शामिल हैं। इसमें मिस्ट्राल-7b और Zephyr जैसे ओपन-सोर्स विकल्प भी शामिल हैं। यह व्यापक अनुकूलता टीमों को एकीकृत ढांचे के भीतर मालिकाना और ओपन-सोर्स मॉडल दोनों का मूल्यांकन करने की अनुमति देती है, जो व्यावहारिक उपयोग के मामलों के अनुरूप अंतर्दृष्टि प्रदान करती है।

टूल को वास्तविक दुनिया के कार्यों जैसे कि रिट्रीवल ऑगमेंटेड जेनरेशन (RAG), डेटा निष्कर्षण और एजेंट टूल के उपयोग के लिए डिज़ाइन किया गया है। यह इसके साथ एकीकृत होता है लैंग स्मिथ विस्तृत निष्पादन निशान प्रदान करने के लिए, जिससे यह पहचानना आसान हो जाता है कि क्या समस्याएँ पुनर्प्राप्ति त्रुटियों या मॉडल के तर्क से उत्पन्न होती हैं।

लैंगचैन बेंचमार्क विभिन्न मूल्यांकन विधियों का उपयोग करता है, जिनमें शामिल हैं एलएलएम-एज़-जज, कोड-आधारित नियम, मानवीय समीक्षाएं, और जोड़ीदार तुलना। तुलनात्मक दृश्य में परिवर्तनों को दृष्टिगत रूप से उजागर किया जाता है, जिसमें लाल रंग में चिह्नित रिग्रेशन और हरे रंग में सुधार होते हैं, जिससे प्रदर्शन ट्रैकिंग सरल हो जाती है। उदाहरण के लिए, LangChain के दस्तावेज़ों का उपयोग करते हुए शुरुआती Q&A बेंचमार्क में, OpenAI सहायक API ने सबसे अधिक 0.62 अंक प्राप्त किए, संवादात्मक पुनर्प्राप्ति कार्यों में GPT-4 (0.50) और क्लाउड-2 (0.56) से बेहतर प्रदर्शन करना।

प्रदर्शन मेट्रिक्स से परे, लैंगचैन बेंचमार्क टीमों को ऐसे मॉडल चुनने में मदद करता है जो गुणवत्ता और प्रतिक्रिया समय को संतुलित करते हैं। उदाहरण के लिए, 2023 RAG बेंचमार्क के दौरान, Mistral-7b ने 18 सेकंड का औसत प्रतिक्रिया समय हासिल किया, जो GPT-3.5 के 29 सेकंड की तुलना में काफी तेज है। यह दृष्टिकोण सुनिश्चित करता है कि खर्च प्रदर्शन की ज़रूरतों के अनुरूप हो, जब छोटे मॉडल पर्याप्त होते हैं तो प्रीमियम मॉडल के लिए अनावश्यक लागतों से बचा जाता है। खर्चों को और नियंत्रित करने के लिए, रेट लिमिटर क्लास थ्रॉटलिंग शुल्क को रोकने के लिए एपीआई कॉल का प्रबंधन करता है, जबकि ऑनलाइन मूल्यांकनकर्ताओं के लिए समायोज्य नमूना दरें एलएलएम-एज़-जज मूल्यांकन के दौरान लागत को प्रबंधनीय रखती हैं।

एंटरप्राइज़ उपयोगकर्ताओं के लिए, लैंगचैन बेंचमार्क एक प्रदान करता है सेल्फ-होस्टेड प्लान जो AWS, GCP, या Azure में Kubernetes क्लस्टर पर चलता है, यह सुनिश्चित करता है कि डेटा ऑन-प्रिमाइसेस रहता है। प्लेटफ़ॉर्म नो-ट्रेनिंग पॉलिसी के साथ सख्त डेटा गोपनीयता लागू करता है और लाइव एप्लिकेशन में लेटेंसी शुरू करने से बचने के लिए एसिंक्रोनस डिस्ट्रिब्यूटेड ट्रेस कलेक्टर का उपयोग करता है। इसके अतिरिक्त, टीमें विफल प्रोडक्शन ट्रेस को टेस्ट केस में बदल सकती हैं, जिससे प्री-डिप्लॉयमेंट टेस्टिंग और रियल-टाइम मॉनिटरिंग दोनों सक्षम हो सकते हैं।

एलएलएम तुलनात्मक उपकरण तालिका में ताकत और चुनौतियों का मिश्रण लाते हैं। ओपनएआई इवल्स अपने लचीलेपन के लिए सबसे अलग है, जिससे टीमें कस्टम मूल्यांकन तर्क बना सकती हैं और परिणामों को स्नोफ्लेक या वेट एंड बायसेस जैसे प्लेटफार्मों में समेकित रूप से एकीकृत कर सकती हैं - सभी संवेदनशील डेटा के संपर्क में आने का जोखिम उठाए बिना। हालांकि, प्लेटफ़ॉर्म एक निश्चित स्तर की तकनीकी विशेषज्ञता की मांग करता है, जिससे गैर-डेवलपर्स के लिए इसे कम सुलभ बनाया जा सकता है।

पतवार मजबूत मल्टी-प्रोवाइडर इंटीग्रेशन प्रदान करता है, जो एक ही पायथन फ्रेमवर्क के भीतर OpenAI, एंथ्रोपिक और Google के सभी मॉडलों का परीक्षण करने में सक्षम बनाता है। यह पूर्वाग्रह, विषाक्तता, दक्षता और सटीकता जैसे महत्वपूर्ण मैट्रिक्स का भी आकलन करता है। हालांकि, अकादमिक बेंचमार्क पर इसका जोर हमेशा व्यावहारिक उद्यम आवश्यकताओं, जैसे कि ग्राहक-सामना करने वाले चैटबॉट या एजेंट वर्कफ़्लो के अनुरूप नहीं हो सकता है।

बजट को ध्यान में रखने वाली टीमों के लिए, जैसे टूल वेल्लम और whatllm.org “सर्वोत्तम मूल्य” के तहत मॉडल को वर्गीकृत करके और मूल्य-प्रति-टोकन चार्ट की पेशकश करके मूल्यवान जानकारी प्रदान करें। उदाहरण के लिए, नोवा माइक्रो इनपुट के लिए $0.04 और आउटपुट के लिए $0.14 प्रति 1 मिलियन टोकन की कीमत है, जबकि जीपीटी-4.5 इनपुट के लिए $75.00 और आउटपुट के लिए $150.00 प्रति 1 मिलियन टोकन पर काफी अधिक आता है। इन लीडरबोर्ड को नियमित रूप से अपडेट किया जाता है, जिसके लिए टीमों को मूल्य निर्धारण में बदलाव और नए मॉडल रिलीज़ के प्रति सतर्क रहने की आवश्यकता होती है।

सुरक्षा के प्रति सजग उद्यम ऐसे मॉडल की ओर अग्रसर हो सकते हैं जैसे क्लाउड ओपस 4.5, जिसने नवंबर 2025 तक होलिस्टिक एआई परीक्षण में 100% जेलब्रेकिंग प्रतिरोध स्कोर हासिल किया, जो इसे पार कर गया क्लाउड 3.7 सॉनेट 99%। दूसरी ओर, कुछ टूल बेहतर प्रदर्शन को प्राथमिकता देते हैं - लामा 4 स्काउटउदाहरण के लिए, उपलब्ध सबसे तेज़ मॉडलों में से एक है, जो प्रति सेकंड 2,600 टोकन तक प्रोसेस करता है। इन कारकों को संतुलित करने के लिए - प्रदर्शन, लागत और सुरक्षा - के लिए कई उपकरणों पर सावधानीपूर्वक विचार करने की आवश्यकता होती है। साथ में, ये जानकारियां टीमों को उनके विशिष्ट वर्कफ़्लो के अनुरूप सूचित निर्णय लेने में मदद करती हैं।

सही एलएलएम तुलना टूल का चयन करना आपके विशिष्ट वर्कफ़्लो और प्राथमिकताओं पर निर्भर करता है। एंटरप्राइज़ टीमों के लिए, उन उपकरणों पर ध्यान केंद्रित किया जाना चाहिए जो मजबूत सुरक्षा उपाय और प्रभावी पूर्वाग्रह नियंत्रण सुनिश्चित करते हैं। दूसरी ओर, व्यक्तिगत डेवलपर ऐसे टूल को प्राथमिकता दे सकते हैं जो लागत-दक्षता और गति प्रदान करते हैं। शोधकर्ताओं को उन प्लेटफार्मों से सबसे अधिक लाभ होता है जो प्रतिलिपि प्रस्तुत करने योग्य बेंचमार्क और पारदर्शी मूल्यांकन विधियां प्रदान करते हैं। ये कारक मूल्यांकन पद्धतियों के निरंतर परिशोधन का मार्गदर्शन करते हैं।

“यदि आप एलएलएम के साथ निर्माण कर रहे हैं, तो उच्च गुणवत्ता वाले ईवल बनाना आपके द्वारा किए जा सकने वाले सबसे प्रभावशाली कामों में से एक है।” - ग्रेग ब्रॉकमैन, प्रेसिडेंट, ओपनएआई

पारंपरिक मेट्रिक्स से आगे मूल्यांकन मानकों का विस्तार हो रहा है। बजट का ध्यान रखने वाली टीमों के लिए, लागत के साथ-साथ क्वालिटी मेट्रिक्स की तुलना करने से अप्रत्याशित मूल्य का पता चल सकता है - कुछ मॉडल प्रीमियम मूल्य टैग के बिना विशिष्ट कार्यों में उत्कृष्ट प्रदर्शन करते हैं। साथ ही, जटिल तर्क कार्यों के लिए अधिक उन्नत मॉडल अपरिहार्य होते हैं, लेकिन केवल तभी जब उपयोग का मामला उनके खर्च को सही ठहराता है।

एलएलएम तुलनात्मक उपकरण जटिल मूल्य निर्धारण विवरण को सीधे, साइड-बाय-साइड प्रारूप में प्रस्तुत करके लागतों का प्रबंधन करना आसान बनाते हैं। उदाहरण के लिए, वे प्रति-टोकन दरों को तोड़ते हैं - जैसे छोटे मॉडल के लिए $0.0003 प्रति 1,000 टोकन बनाम बड़े मॉडल के लिए $0.0150 - और उपयोगकर्ताओं को उनके प्रत्याशित उपयोग को इनपुट करने दें। यह विशिष्ट वर्कलोड के अनुरूप मासिक खर्चों का तत्काल अनुमान लगाता है, जिससे टीमों को सबसे बजट-अनुकूल मॉडल का पता लगाने में मदद मिलती है, जो अभी भी उनके लिए आवश्यक प्रदर्शन प्रदान करता है।

कॉस्ट ब्रेकडाउन के अलावा, ये टूल अपनी लागत दक्षता के आधार पर मॉडल को रैंक करते हैं और सटीकता, तर्क क्षमता या सुरक्षा जैसे कारकों द्वारा फ़िल्टर करने की अनुमति देते हैं। यह कार्यक्षमता यूज़र को स्वीकार्य गुणवत्ता बनाए रखते हुए कम लागत वाले मॉडल पर स्विच करने जैसे परिदृश्यों का पता लगाने में सक्षम बनाती है। इन जानकारियों के साथ, संगठन API खर्च में कटौती कर सकते हैं, ओवर-प्रोविजनिंग को दरकिनार कर सकते हैं और बचत को अपने AI संचालन के अन्य महत्वपूर्ण पहलुओं पर पुनर्निर्देशित कर सकते हैं।

एंटरप्राइज़ अनुप्रयोगों के लिए बड़े भाषा मॉडल (LLM) की तुलना करने के लिए एक उपकरण का चयन करते समय, उन प्लेटफ़ॉर्म को प्राथमिकता दें जो ऑफ़र करते हैं मॉडल के प्रदर्शन की स्पष्ट, अगल-बगल तुलना। रीज़निंग, कोडिंग और मल्टीमॉडल टास्क जैसे महत्वपूर्ण बेंचमार्क में मॉडल का मूल्यांकन करने के लिए ऐसे टूल चुनें, जो आसानी से समझ में आने वाले विज़ुअल्स, जैसे चार्ट, प्रस्तुत करते हैं। सोच-समझकर निर्णय लेने के लिए सटीकता, गति और लागत जैसे मेट्रिक्स तक पहुंच महत्वपूर्ण है।

एंटरप्राइज़ समाधानों पर भी ज़ोर देना चाहिए लागत स्पष्टता और परिचालन अंतर्दृष्टि। ऐसे प्लेटफ़ॉर्म खोजें जो प्रति-टोकन मूल्य निर्धारण, विलंबता, थ्रूपुट और स्वामित्व की कुल लागत के बारे में विस्तृत जानकारी प्रदान करते हैं। ऐसे टूल जो विशिष्ट उद्योगों या उपयोग के मामलों के आधार पर फ़िल्टर करने की अनुमति देते हैं, आपके संगठन के उद्देश्यों के साथ तालमेल बिठाने के लिए विशेष रूप से उपयोगी हो सकते हैं।

अंत में, सुनिश्चित करें कि उपकरण समर्थन करता है कस्टम मूल्यांकन और अनुपालन आवश्यकताएं। डेटा गोपनीयता बनाए रखने और एंटरप्राइज़-स्तर के मानकों का पालन करने के लिए निजी-क्लाउड या ऑन-प्रिमाइसेस वातावरण के लिए निर्यात करने योग्य रिपोर्ट, API एकीकरण और परिनियोजन विकल्प जैसी सुविधाएँ आवश्यक हैं।

मूल्यांकन कर रहा है शुद्धता एलएलएम में यह सुनिश्चित करना आवश्यक है कि वे आपकी विशिष्ट आवश्यकताओं के अनुकूल भरोसेमंद, उच्च-गुणवत्ता वाले परिणाम लगातार प्रदान करें। यह उन क्षेत्रों में विशेष रूप से महत्वपूर्ण हो जाता है जहां सटीकता महत्वपूर्ण है, जैसे कि सामग्री निर्माण, डेटा विश्लेषण, या ग्राहक इंटरैक्शन का प्रबंधन करना।

विचार करते हुए प्रतिक्रिया समय (विलंबता) आपको त्वरित उत्तर देने में सक्षम मॉडल को इंगित करने की अनुमति देता है, जो वास्तविक समय की व्यस्तताओं या वर्कफ़्लो के लिए महत्वपूर्ण है जहां लागत और गति प्राथमिकताएं हैं। तेज़ प्रतिक्रियाएँ न केवल उपयोगकर्ता की संतुष्टि को बढ़ाती हैं, बल्कि समय के प्रति संवेदनशील परिदृश्यों में दक्षता को भी बढ़ाती हैं।