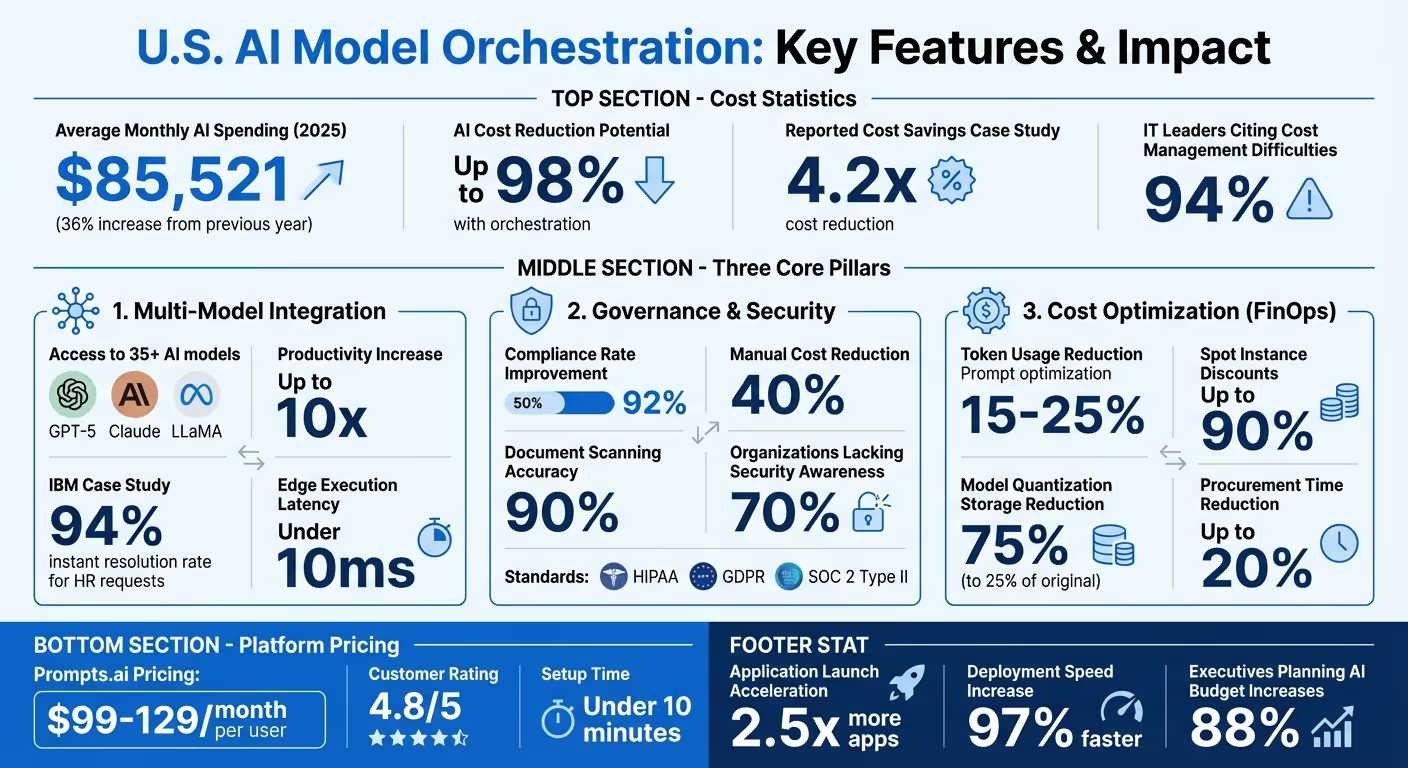

L'orchestration des modèles d'IA aux États-Unis redéfinit les flux de travail des entreprises en unifiant les outils, en automatisant les opérations et en optimisant les coûts. Des plateformes comme Prompts.ai intégrer plus de 35 meilleurs modèles d'IA, permettant une commutation fluide, réduisant les dépenses jusqu'à 98 %, et remédier au « chaos de l'IA » grâce à une gouvernance robuste. Les principales caractéristiques sont les suivantes :

Les entreprises dépensant en moyenne 85 521 $/mois sur l'IA en 2025, les plateformes américaines se concentrent sur la mise à l'échelle rentable, la conformité et l'efficacité opérationnelle. Prompts.ai se distingue en proposant des flux de travail centralisés, une gouvernance prête à être auditée et une tarification transparente à partir de 99 $/mois par utilisateur. Cette approche permet aux entreprises de faire évoluer l'IA de manière sécurisée et efficace.

Fonctionnalités de la plateforme d'orchestration d'IA et statistiques sur les économies de coûts

Les plateformes d'orchestration de l'IA américaines reposent sur trois fonctionnalités essentielles : le routage multimodèle et l'intégration des flux de travail, des mesures de gouvernance et de sécurité robustes et la gestion des coûts via FinOps. Ces fonctionnalités sont conçues pour relever les défis pratiques auxquels les entreprises sont confrontées lors de la mise à l'échelle des opérations d'IA.

Ces plateformes simplifient le travail sur plusieurs modèles d'IA en proposant une interface unifiée. Cela permet aux développeurs de passer facilement d'un modèle à l'autre, sans avoir à modifier le code. Par exemple, certains services permettent des interactions multimodales fluides, ce qui rend le processus d'intégration plus efficace.

L'une des fonctionnalités les plus remarquables est la coordination autonome des agents, qui synchronise les agents d'IA entre les outils et les sources de données. IBM, par exemple, a résolu instantanément 94 % des millions de demandes relatives aux ressources humaines, ce qui a permis au personnel de se concentrer sur ses priorités stratégiques. Ce niveau d'automatisation repose sur des plateformes qui gèrent l'état de plusieurs agents, réduisent la latence grâce à la mise en cache multicouche et créent des flux de travail répétables à l'aide de graphes acycliques dirigés (DAG).

Les techniques d'exécution avancées améliorent encore les performances. L'exécution native en périphérie, par exemple, utilise le calcul distribué pour fournir des démarrages à froid inférieurs à 50 ms et une latence inférieure à 10 ms, faisant ainsi des applications en temps réel une réalité.

L'adoption du Model Context Protocol (MCP) a également joué un rôle crucial. MCP fournit un cadre standardisé permettant aux agents d'IA d'interagir avec les systèmes d'entreprise tels que les bases de données et les référentiels de contenu. Comme indiqué par Flocon de neige:

« Les serveurs MCP sont devenus la base des applications agentiques, car ils fournissent un mécanisme cohérent et sécurisé pour invoquer des outils et récupérer des données ».

En éliminant les connecteurs point à point fragiles, cette approche simplifie les intégrations d'IA et garantit une fiabilité à long terme.

Bien que l'intégration améliore les flux de travail, la gouvernance garantit que ces systèmes fonctionnent de manière fiable et sécurisée. Les plateformes américaines renforcent la gouvernance grâce à des cadres de conformité automatisés, à des contrôles d'accès Zero Trust et à une détection des anomalies pilotée par l'IA. Par exemple, une agence américaine a augmenté son taux de conformité de 50 % à plus de 92 % tout en réduisant les coûts manuels de 40 % en automatisant son cycle de vie cybernétique.

Le contrôle d'accès basé sur les rôles (RBAC) est la pierre angulaire de ces plateformes, avec des politiques adaptatives qui ajustent dynamiquement les autorisations en fonction du comportement de l'utilisateur, de sa localisation et du contexte de l'appareil. Le Administration des services généraux (GSA) a tiré parti de ces fonctionnalités pour contrôler la conformité à la Section 508 et aux réglementations de sécurité, en scannant des millions de documents fédéraux avec une précision de 90 % pour prévoir la non-conformité.

Pour les secteurs qui traitent des données sensibles, ces plateformes garantissent que les informations personnelles identifiables (PII) sont masquées et segmentées en toute sécurité. Le Commission des soins de santé du Maryland (MHCC), par exemple, a modernisé son infrastructure de sécurité afin de gérer les données cliniques et les informations personnelles de plus de 50 hôpitaux, préservant ainsi plus de 3 millions de jours-patients. Comme SÈVE Points forts du personnel de NS2 :

« Les initiatives en matière d'IA doivent s'aligner sur les politiques et les contrôles applicables. Pensez à la segmentation des données, à la gouvernance des accès, au chiffrement en transit/au repos, à la gouvernance des modèles et à des pistes d'audit rigoureuses. Les principes de confiance zéro, la gestion des identités et des rôles, ainsi que l'accès au moindre privilège sont les piliers d'une IA sécurisée ».

Les outils d'audit continu jouent également un rôle clé en générant des rapports prêts à être mis en conformité pour des réglementations telles que HIPAA, GDPR et CCPA. Ces mesures sont essentielles, d'autant que près de 70 % des organisations signalent un manque de sensibilisation de base à la sécurité.

En 2025, les dépenses mensuelles moyennes consacrées à l'IA ont atteint 85 521 dollars, soit une augmentation de 36 % par rapport à l'année précédente, et 94 % des responsables informatiques ont fait état de difficultés à gérer ces coûts. Des problèmes tels que les pénuries de GPU, la facturation basée sur les jetons et les écarts de coûts importants entre les déploiements optimisés et non optimisés contribuent à ce problème.

Pour y remédier, les plateformes utilisent le redimensionnement des modèles, permettant aux entreprises de basculer entre des modèles très rationnels tels que GPT-4 et des modèles plus petits et plus abordables tels que Mistral 7B, en fonction de la complexité de la tâche. Le balisage automatique via l'infrastructure en tant que code (IaC) fournit une visibilité détaillée, permettant aux modèles de « rétrospective » de responsabiliser les équipes quant à leur utilisation.

Les optimisations de calcul jouent également un rôle important. Il s'agit notamment de tirer parti des instances Spot pour bénéficier de remises allant jusqu'à 90 %, de changer de modèle de manière dynamique en fonction des exigences des tâches et d'utiliser l'inférence sans serveur pour minimiser les coûts.

Les techniques d'optimisation par inférence permettent de réduire davantage les dépenses. Par exemple, l'ajout de la mention « soyez concis » aux instructions de l'IA peut réduire l'utilisation des jetons de 15 % à 25 %. La mise en cache des réponses fréquemment demandées réduit les appels d'API redondants, tandis que la quantification des modèles (conversion des modèles FP32 en INT8) réduit les besoins de stockage à seulement 25 % de la taille d'origine sans compromettre la précision.

Les garde-fous financiers constituent un autre élément essentiel. Il s'agit notamment de définir des seuils budgétaires avec des alertes en temps réel en cas d'anomalies. De nombreuses organisations s'orientent également vers une infrastructure dédiée à coût fixe pour stabiliser leurs budgets, en particulier compte tenu de l'imprévisibilité de la facturation basée sur des jetons. Comme Open Metal le dit succinctement :

« Le moyen le plus rapide de mettre fin à une initiative d'IA est de demander aux équipes de justifier chaque heure de GPU avant de la lancer ».

FinOps garantit un équilibre entre rentabilité et flexibilité opérationnelle, permettant aux entreprises de faire évoluer l'IA sans se ruiner.

Les plateformes d'orchestration de l'IA aux États-Unis peuvent être regroupées en trois catégories principales, chacune étant adaptée aux différents besoins organisationnels et exigences techniques. Ces catégories reflètent l'accent mis sur la gestion des coûts, la garantie de la gouvernance et la mise en place d'une intégration évolutive. Qu'il s'agisse d'automatisation des processus métier, d'intégration fluide dans le cloud ou d'efficacité opérationnelle, ces plateformes mettent en évidence les différentes approches qui façonnent le paysage de l'orchestration de l'IA aux États-Unis. Décomposons chaque catégorie.

Ces plateformes s'adressent aux équipes des ressources humaines, des finances et des ventes en proposant des flux de travail prédéfinis conçus pour les utilisateurs non techniques. Par exemple, IBM watsonx Orchestrate propose un essai gratuit et une application automatisée des politiques, permettant aux services des ressources humaines de traiter instantanément de grands volumes de demandes, libérant ainsi du temps pour les initiatives stratégiques. De même, Dun & Bradstreet a réussi à réduire jusqu'à 20 % les délais d'approvisionnement grâce à une évaluation des risques pilotée par l'IA.

La gouvernance centralisée et les garanties intégrées sont les principales caractéristiques de ces plateformes. Comme Domo le dit avec justesse :

« Le succès en matière d'IA ne consiste plus à disposer du plus grand nombre de modèles, mais à les orchestrer efficacement. »

L'un des avantages notables est l'approche « no rip and replace », qui s'intègre parfaitement aux outils SaaS existants tels que Salesforce et SAP, évitant ainsi la nécessité d'une refonte complète de l'infrastructure. À partir de là, nous passons aux couches d'orchestration natives du cloud qui sont étroitement liées aux écosystèmes cloud existants.

Les principaux fournisseurs de cloud américains tels qu'AWS, Microsoft Azure et Google Cloud proposent des services d'orchestration profondément intégrés à leurs écosystèmes. Fonctions AWS Step, par exemple, permet une orchestration sans serveur et une exécution rapide des flux de travail en s'intégrant étroitement aux autres services AWS. Pipelines Amazon SageMaker peut gérer des dizaines de milliers de flux de travail ML simultanés, comme le démontre Hypothèque Rocketl'utilisation de plusieurs LLM open source pour l'évaluation.

Le service Foundry Agent de Microsoft va encore plus loin en matière d'intégration en unifiant les modèles, les outils et les frameworks en un seul environnement d'exécution. Il renforce la sécurité du contenu, gère les conversations et s'intègre aux systèmes d'identité tels que Microsoft Entra. Avec Base de données Azure Cosmos, la plateforme garantit la préservation de l'État et l'historique des conversations, même en cas de panne régionale. Une entreprise a déclaré avoir réalisé 4,2 fois plus d'économies de coûts après avoir adopté la suite Microsoft Foundry. Les développeurs bénéficient également de fonctionnalités telles que les modes d'exécution locaux, qui permettent de tester les flux de travail sur des appareils personnels avant d'engager des coûts liés au cloud. Les fonctionnalités de gouvernance telles que le contrôle d'accès basé sur les rôles (RBAC), l'isolation du réseau et les historiques d'exécution détaillés garantissent que les tâches de machine learning restent auditables et sécurisées. Enfin, examinons les plateformes AIOps qui visent à améliorer l'efficacité opérationnelle des équipes techniques.

Les plateformes AIOps sont conçues pour les data scientists et les ingénieurs ML qui supervisent le cycle de vie des systèmes d'IA. Construit sur des frameworks open source tels que Flux d'air Apache et Ray, ces plateformes excellent en matière de formation, de mise à l'échelle et de surveillance distribuées, le tout sans frais de licence. Par exemple, N'importe quelle échelle répartit efficacement les charges de travail entre les clusters, optimisant ainsi les performances tout en minimisant les coûts liés à l'inactivité de l'infrastructure.

Bien que ces plateformes offrent une flexibilité inégalée, elles exigent un niveau d'expertise technique plus élevé. Les organisations doivent gérer leur propre infrastructure et en assurer la maintenance, ce qui ajoute à la complexité. Les plateformes AIOps sont conçues pour donner la priorité aux performances et à l'efficacité des ressources, en prenant en charge la formation continue et les charges de travail d'inférence à volume élevé.

Les options de déploiement varient considérablement : les plateformes d'entreprise proposent souvent des configurations SaaS et hybrides, les couches natives du cloud proposent des environnements sans serveur et entièrement gérés, et les plateformes AIOps prennent en charge les configurations open source, gérées et hybrides. Cette variété permet aux organisations de choisir des solutions adaptées à leurs capacités techniques, à leurs besoins de conformité et à leurs considérations budgétaires.

Prompts.ai fait des progrès sur le marché américain en s'attaquant au problème de la fragmentation des abonnements à l'IA. En réunissant plus de 35 grands modèles linguistiques de premier plan au sein d'une plate-forme unique et sécurisée, il simplifie les opérations et élimine la prolifération écrasante d'outils. Cette solution intègre des contrôles de niveau entreprise qui répondent aux normes élevées des directeurs financiers et des responsables de la sécurité de l'information, garantissant ainsi confiance et fiabilité.

Prompts.ai offre un accès transparent à plus de 35 modèles haut de gamme via une interface unifiée, permettant aux utilisateurs d'effectuer des comparaisons côte à côte en temps réel. Il a été démontré que cette approche augmente la productivité jusqu'à 10 fois. Comme Steven Simmons, PDG et fondateur, l'a souligné :

« Grâce aux LoRas et aux flux de travail de Prompts.ai, il réalise désormais des rendus et des propositions en une seule journée. »

La plateforme supprime les retards causés par les limitations matérielles et transforme les processus expérimentaux en flux de travail réutilisables. Ces flux de travail peuvent être déployés instantanément dans tous les services tels que le marketing, les ressources humaines et les finances. Avec des temps de configuration rapides, souvent inférieurs à 10 minutes, et des intégrations avec des outils tels que Slack, Gmail, et Trello, Prompts.ai facilite l'adoption de nouveaux flux de travail. Ces fonctionnalités de flux de travail sont soutenues par un cadre de gouvernance solide, qui est exploré plus en détail ci-dessous.

Prompts.ai garantit un suivi précis de l'utilisation de l'IA grâce à des pistes d'audit complètes et à un contrôle d'accès basé sur les rôles (RBAC). Cette fonctionnalité permet aux équipes juridiques et de conformité de surveiller les interactions en toute confiance. La plateforme s'aligne sur les meilleures pratiques établies, notamment les normes SOC 2 Type II, HIPAA et GDPR, et a entamé son processus d'audit SOC 2 Type 2 le 19 juin 2025. Prompts.ai fournit également un centre de gestion de la confiance public, proposant des mises à jour de sécurité en temps réel grâce à une surveillance continue alimentée par Vanta.

Pour les entreprises, la plateforme comprend des modules de surveillance de la conformité et de gouvernance, offrant aux organisations une supervision centralisée afin d'éviter le « chaos de l'IA » qui peut résulter de mises en œuvre désorganisées. Cette focalisation sur la gouvernance concorde avec les prévisions selon lesquelles les tableaux de bord d'orchestration multi-agents deviendront la pierre angulaire des entreprises intelligentes. Combinée à ses fonctionnalités de sécurité robustes, la stratégie de gestion des coûts de Prompts.ai améliore encore sa valeur pour les utilisateurs professionnels.

Prompts.ai utilise une approche axée sur FinOps, utilisant des crédits TOKN payables à l'utilisation et des analyses en temps réel pour fournir des solutions d'IA évolutives et efficaces. En mutualisant les crédits et le stockage entre les équipes, la plateforme aide les organisations à réduire les coûts associés à la gestion de plusieurs licences, réalisant ainsi des réductions des coûts d'IA allant jusqu'à 98 %. Les analyses détaillées permettent aux équipes FinOps de surveiller de près l'utilisation des jetons, d'optimiser les flux de travail et de réduire les dépenses.

Les comparaisons de modèles côte à côte de la plateforme permettent également aux ingénieurs d'évaluer la rentabilité avant d'étendre les déploiements. Une entreprise a déclaré avoir multiplié par 4,2 ses coûts en adoptant la pile d'orchestration de Prompts.ai. La tarification pour les niveaux professionnels est transparente, allant de 99$ à 129$ par membre et par mois. Frank Buscemi, PDG et CCO, a attribué à la plateforme une note de 4,8 sur 5, louant sa capacité à rationaliser la création de contenu et à libérer des ressources pour les priorités stratégiques.

Pour trouver la bonne plateforme d'orchestration de l'IA, il faut trouver un équilibre entre les capacités techniques et les priorités commerciales. Pour les entreprises américaines, la flexibilité de l'intégration est essentielle. Les plateformes doivent proposer des API et des connecteurs robustes pour relier de manière fluide les modèles d'IA aux bases de données existantes et aux systèmes existants. La prise en charge des configurations hybrides et multicloud est également essentielle pour permettre aux charges de travail de passer facilement de l'infrastructure sur site aux services de cloud public.

La sécurité et la gouvernance ne sont pas négociables. Les plateformes doivent inclure des fonctionnalités telles que des contrôles d'accès basés sur les rôles (RBAC), des protocoles de chiffrement robustes et des certifications de conformité telles que HIPAA pour les soins de santé ou SOC 2 Type II pour les besoins plus généraux des entreprises. Ces outils garantissent une supervision centralisée, aidant les organisations à respecter les normes éthiques en matière d'IA et à respecter les réglementations en matière de confidentialité des données. Le choix entre l'orchestration basée sur des règles et les systèmes natifs de l'IA dépend de la tâche à accomplir. Les systèmes basés sur des règles sont idéaux pour les tâches structurées telles que le traitement de documents juridiques, offrant des résultats prévisibles et vérifiables. D'autre part, les approches natives de l'IA brillent dans des scénarios dynamiques tels que les chatbots de support client.

La gestion des coûts est un autre facteur essentiel. Les plateformes dotées d'outils FinOps intégrés fournissent des tableaux de bord en temps réel pour surveiller l'utilisation des jetons, l'allocation des ressources et les dépenses de calcul. Les options permettant de réduire les coûts, telles que les remises pour utilisation engagée (CUD) ou les machines virtuelles ponctuelles pour des tâches non critiques, peuvent optimiser considérablement les dépenses. Beena Ammanath, directrice exécutive de Institut mondial d'IA Deloitte, souligne l'importance d'une planification précoce :

« L'orchestration et la gouvernance doivent être envisagées à un stade précoce, ce qui rend l'intégration et la supervision proactives essentielles pour un succès évolutif ».

Ces considérations constituent la base de stratégies de déploiement efficaces et évolutives.

Commencez par des flux de travail déterministes pour les processus qui nécessitent des règles strictes et des pistes d'audit complètes. Des outils tels qu'AWS Step Functions sont excellents pour fournir des résultats prévisibles et traçables pendant les phases pilotes. Une fois que ces flux de travail sont stables, intégrez progressivement l'orchestration native de l'IA pour des tâches plus complexes et plus flexibles.

Établissez des cadres de gouvernance à un stade précoce, avant de les étendre au-delà des équipes initiales. Les recherches montrent que les organisations utilisant l'orchestration de l'IA lancent en moyenne 2,5 fois plus d'applications que celles qui n'en utilisent pas. Standardisation des flux de travail avec des frameworks open source tels que Chaîne Lang ou des API conformes aux normes du secteur peuvent rationaliser la coordination des agents. Les architectures pilotées par les événements peuvent encore améliorer la réactivité en déclenchant des actions d'IA basées sur des téléchargements de données ou des transactions en temps réel, garantissant ainsi une intégration fluide avec les systèmes informatiques existants.

Le suivi des performances et des coûts en temps réel est essentiel. Cette visibilité permet aux équipes FinOps d'ajuster les flux de données, d'optimiser les modèles et de contrôler efficacement les budgets. Pour les tâches critiques ou créatives, la supervision humaine reste essentielle pour garantir que les résultats de l'IA correspondent aux objectifs commerciaux. Enfin, optez pour des plateformes dotées d'architectures modulaires qui prennent en charge des normes ouvertes comme ONNX. Cela permet de mettre à jour ou de remplacer facilement les modèles à mesure que la technologie évolue, évitant ainsi toute dépendance vis-à-vis d'un fournisseur.

L'adoption de l'IA par les entreprises américaines continue de croître et d'évoluer. Les plateformes telles que Prompts.ai jouent un rôle central en intégrant plus de 35 modèles, en rationalisant les flux de travail et en proposant des tableaux de bord FinOps en temps réel pour contrôler les dépenses informatiques.

La volonté d'innovation alimente le leadership américain en matière d'IA. Il a été démontré que le déploiement orchestré de l'IA accélère le déploiement des applications de 97 %. Cependant, alors que 88 % des dirigeants prévoient d'augmenter les budgets consacrés à l'IA pour faire face à des complexités croissantes, le besoin de plateformes modulaires et indépendantes des fournisseurs est plus que jamais essentiel. Ces plateformes permettent aux entreprises d'échanger des modèles, de faire évoluer les charges de travail dans des environnements cloud hybrides et de rester flexibles à mesure que la technologie progresse. Comme le dit si justement Domo :

« Le succès en matière d'IA ne consiste plus à disposer du plus grand nombre de modèles, mais à les orchestrer efficacement ».

Cette évolution met en évidence l'importance de la conformité, de la sécurité et de l'efficacité opérationnelle à l'échelle de l'entreprise.

Pour les secteurs tels que la finance et la santé, où la réglementation est stricte, la gouvernance et la conformité ne sont pas négociables. Les fonctionnalités de gouvernance centralisées, telles que les contrôles d'accès basés sur les rôles, l'application automatisée des politiques et les pistes d'audit détaillées, transforment les plateformes d'orchestration en de puissants hubs de contrôle. Cela garantit non seulement le respect des normes de conformité, mais favorise également la confiance entre les clients et les régulateurs.

L'optimisation des coûts est un autre facteur clé de différenciation entre une croissance durable et des dépenses incontrôlées. Les plateformes qui allouent les ressources de manière dynamique, réduisent les tâches d'intégration manuelles et permettent aux équipes de se concentrer sur l'innovation plutôt que sur la maintenance créent des avantages mesurables pour tous les services, notamment les achats, les ressources humaines et les opérations.

Le succès dans ce domaine dépend d'une planification précoce et d'une exécution réfléchie. En commençant par des flux de travail déterministes, en établissant des cadres de gouvernance solides avant la mise à l'échelle et en donnant la priorité aux normes ouvertes pour l'interopérabilité, les entreprises américaines peuvent rester compétitives tout en gérant les coûts et en gérant efficacement la complexité.

L'orchestration des modèles d'IA simplifie et automatise l'ensemble du flux de travail de l'IA, aidant ainsi les entreprises à réduire leurs coûts de manière significative. En supprimant les tâches manuelles, telles que le déclenchement de la formation des modèles ou la gestion des pipelines de données, il réduit les heures de travail et élimine les inefficacités opérationnelles. Ces plateformes garantissent également une utilisation plus intelligente des ressources en distribuant de manière dynamique le calcul, la mémoire et le stockage, évitant ainsi les dépenses excessives en matériel.

Le regroupement de plusieurs modèles, API et sources de données dans un flux de travail cohérent améliore la supervision du système. Cette visibilité améliorée permet d'identifier et de résoudre les problèmes rapidement, de réduire les temps d'arrêt et d'éviter des rediffusions coûteuses. De plus, la rationalisation des opérations d'IA permet aux entreprises de s'adapter en fonction de leurs besoins sans avoir à gérer une infrastructure sous-utilisée. Le résultat ? Des économies tangibles dans des domaines critiques tels que les finances, la gestion de la chaîne d'approvisionnement et le service client.

Pour garantir la fiabilité et répondre aux normes de conformité, les plateformes d'orchestration de l'IA doivent intégrer des cadres de gouvernance efficaces et des protocoles de sécurité robustes. La gouvernance implique l'établissement de politiques claires qui définissent les rôles, les responsabilités et l'autorité décisionnelle pour la gestion des flux de travail liés à l'IA. Les organisations doivent conserver des journaux détaillés des versions des modèles, appliquer des critères transparents pour la sélection des modèles et valider régulièrement les systèmes d'IA afin de les aligner sur les directives éthiques et les exigences réglementaires. La surveillance continue des performances des modèles et des biais potentiels est essentielle pour favoriser la confiance et la responsabilité.

Sur le plan de la sécurité, les plateformes devraient adopter gestion des identités et des accès (IAM) avec des autorisations basées sur les rôles pour contrôler l'accès. Les données doivent être cryptées à la fois pendant le stockage et la transmission, et les points de terminaison de l'API doivent être sécurisés pour empêcher tout accès non autorisé. Les systèmes de surveillance et de détection des anomalies en temps réel peuvent aider à identifier les activités inhabituelles, tandis qu'un plan de réponse aux incidents bien documenté garantit une résolution rapide des problèmes. Des techniques telles que la confidentialité différentielle protègent les informations sensibles et la réalisation d'évaluations régulières des vulnérabilités renforcent encore la sécurité. Ensemble, ces mesures fournissent un cadre solide pour faire évoluer les flux de travail liés à l'IA tout en protégeant les données et en préservant la confiance du public.

Les entreprises peuvent maîtriser leurs dépenses liées à l'IA en les jumelant Frameworks FinOps grâce à des plateformes d'orchestration d'IA avancées. Les outils FinOps ventilent les dépenses en analysant des détails tels que l'utilisation du cloud computing, les coûts de stockage et les dépenses liées aux appels d'API. Cela permet aux organisations de suivre avec précision les dépenses liées aux charges de travail liées à l'IA. En balisant des modèles et des pipelines spécifiques, les équipes peuvent attribuer des coûts à des projets individuels, définir des alertes budgétaires et suivre les dépenses grâce à des tableaux de bord en temps réel.

Combinées à des plateformes d'orchestration basées sur l'IA, ces informations peuvent déclencher des ajustements automatisés. Par exemple, les systèmes peuvent être optimisés en réduisant les ressources de calcul, en suspendant les processus inutilisés ou en passant à des nœuds plus rentables. Cette configuration crée un processus fluide dans lequel les équipes financières établissent les budgets, les outils FinOps fournissent un suivi clair des coûts et les plateformes d'orchestration gèrent l'optimisation des ressources. Le résultat ? Les projets d'IA respectent le budget tout en obtenant les meilleurs résultats possibles.