La orquestación de modelos de IA en EE. UU. está remodelando los flujos de trabajo empresariales mediante la unificación de las herramientas, la automatización de las operaciones y la optimización de los costos. Plataformas como Prompts.ai integrar sobre Los 35 mejores modelos de IA, lo que permite una conmutación fluida y reduce los gastos hasta en 98%, y abordar el «caos de la IA» con una gobernanza sólida. Entre las principales características se incluyen:

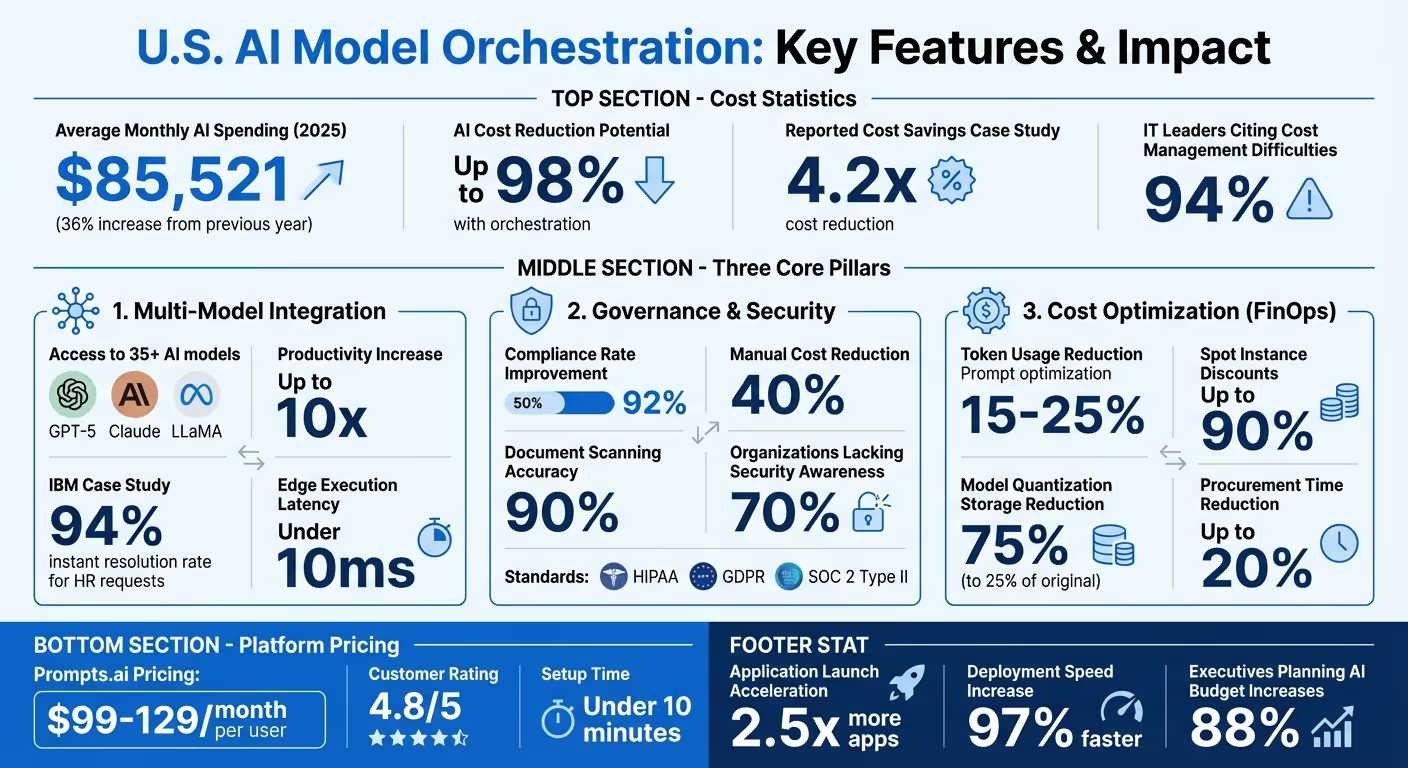

Dado que las empresas gastan un promedio de 85.521 dólares/mes sobre la IA en 2025, las plataformas estadounidenses se centran en la escalabilidad rentable, el cumplimiento y la eficiencia operativa. Prompts.ai se destaca por ofrecer flujos de trabajo centralizados, una gobernanza lista para la auditoría y precios transparentes a partir de 99$ al mes por usuario. Este enfoque garantiza que las empresas puedan escalar la IA de forma segura y eficiente.

Características de la plataforma de orquestación de IA y estadísticas de ahorro de costos

Las plataformas de orquestación de IA de EE. UU. se basan en tres capacidades esenciales: enrutamiento multimodelo e integración de flujos de trabajo, sólidas medidas de gobierno y seguridad y administración de costos a través de FinOps. Estas funciones están diseñadas para abordar los desafíos prácticos a los que se enfrentan las empresas a la hora de ampliar las operaciones de IA.

Estas plataformas simplifican la complejidad de trabajar en varios modelos de IA al ofrecer una interfaz unificada. Esto permite a los desarrolladores cambiar de modelo sin problemas, sin necesidad de modificar el código. Por ejemplo, algunos servicios permiten interacciones multimodales fluidas, lo que hace que el proceso de integración sea más eficiente.

Una característica destacada es la coordinación autónoma de agentes, que sincroniza a los agentes de IA entre herramientas y fuentes de datos. IBM, por ejemplo, logró soluciones instantáneas para el 94% de los millones de solicitudes de recursos humanos, lo que permitió al personal centrarse en las prioridades estratégicas. Este nivel de automatización se basa en plataformas que administran el estado de varios agentes, reducen la latencia mediante el almacenamiento en caché de varias capas y crean flujos de trabajo repetibles mediante gráficos acíclicos dirigidos (DAG).

Las técnicas de ejecución avanzadas mejoran aún más el rendimiento. La ejecución nativa de Edge, por ejemplo, utiliza la computación distribuida para ofrecer arranques en frío inferiores a 50 ms y una latencia inferior a 10 ms, lo que convierte las aplicaciones en tiempo real en una realidad.

La adopción del Protocolo de contexto modelo (MCP) también ha sido fundamental. El MCP proporciona un marco estandarizado para que los agentes de IA interactúen con los sistemas empresariales, como las bases de datos y los repositorios de contenido. Como lo señaló Copo de nieve:

«Los servidores MCP se han convertido en la base de las aplicaciones de agencia, ya que proporcionan un mecanismo coherente y seguro para invocar herramientas y recuperar datos».

Al eliminar los frágiles conectores punto a punto, este enfoque simplifica las integraciones de IA y garantiza la confiabilidad a largo plazo.

Si bien la integración mejora los flujos de trabajo, la gobernanza garantiza que estos sistemas funcionen de manera confiable y segura. Las plataformas estadounidenses fortalecen la gobernanza mediante marcos de cumplimiento automatizados, controles de acceso basados en la confianza cero y la detección de anomalías impulsada por la inteligencia artificial. Por ejemplo, una agencia estadounidense aumentó su tasa de cumplimiento del 50% a más del 92% y, al mismo tiempo, redujo los costos manuales en un 40% al automatizar su ciclo de vida cibernético.

El control de acceso basado en roles (RBAC) es la piedra angular de estas plataformas, con políticas adaptables que ajustan los permisos de forma dinámica en función del comportamiento del usuario, la ubicación y el contexto del dispositivo. El Administración de Servicios Generales (GSA) aprovechó estas capacidades para supervisar el cumplimiento de la Sección 508 y las normas de seguridad, escaneando millones de documentos federales con una precisión del 90% a la hora de predecir el incumplimiento.

Para las industrias que manejan datos confidenciales, estas plataformas garantizan que la información de identificación personal (PII) esté enmascarada y segmentada de forma segura. El Comisión de Atención Médica de Maryland (MHCC), por ejemplo, modernizó su infraestructura de seguridad para gestionar los datos clínicos y la PII de más de 50 hospitales, con lo que se protegió la información de más de 3 millones de días de pacientes. Como SAVIA Aspectos destacados del personal de NS2:

«Las iniciativas de IA deben alinearse con las políticas y los controles aplicables. Piense en la segmentación de los datos, la gobernanza del acceso, el cifrado en tránsito o inactivo, la gobernanza modelo y los rigurosos registros de auditoría. Los principios de confianza cero, la gestión de identidades y roles y el acceso con privilegios mínimos son la columna vertebral de una IA segura».

Las herramientas de auditoría continua también desempeñan un papel clave, ya que generan informes listos para el cumplimiento de normativas como la HIPAA, el RGPD y la CCPA. Estas medidas son fundamentales, especialmente porque casi el 70% de las organizaciones declaran que carecen de conocimientos básicos sobre la seguridad.

En 2025, el gasto medio mensual en IA alcanzó los 85.521 dólares, un 36% más que el año anterior, y el 94% de los líderes de TI mencionaron dificultades para gestionar estos costes. A este problema contribuyen desafíos como la escasez de GPU, la facturación basada en fichas y las importantes variaciones de costes entre las implementaciones optimizadas y las no optimizadas.

Para abordar este problema, las plataformas utilizan el dimensionamiento correcto de los modelos, lo que permite a las empresas cambiar entre modelos de alto razonamiento, como el GPT-4, y modelos más pequeños y asequibles, como el Mistral 7B, según la complejidad de la tarea. El etiquetado automatizado a través de la infraestructura como código (IaC) proporciona una visibilidad detallada, lo que permite que los equipos rindan cuentas por su uso mediante modelos «retrospectivos».

Las optimizaciones informáticas también desempeñan un papel importante. Estas incluyen aprovechar las instancias puntuales para obtener descuentos de hasta el 90%, cambiar de modelo de forma dinámica en función de los requisitos de las tareas y utilizar la inferencia sin servidor para minimizar los costos.

Las técnicas de optimización de inferencias reducen aún más los gastos. Por ejemplo, añadir «sé conciso» a las instrucciones de la IA puede reducir el uso de los tokens entre un 15% y un 25%. El almacenamiento en caché de las respuestas solicitadas con frecuencia reduce las llamadas redundantes a la API, mientras que la cuantificación de los modelos (convertir los modelos FP32 en INT8) reduce las necesidades de almacenamiento a solo un 25% del tamaño original sin comprometer la precisión.

Las barreras financieras son otra característica fundamental. Estas incluyen establecer umbrales presupuestarios con alertas en tiempo real para detectar anomalías. Muchas organizaciones también están optando por una infraestructura dedicada de costo fijo para estabilizar los presupuestos, especialmente dada la imprevisibilidad de la facturación basada en fichas. Como Open Metal lo expresa sucintamente:

«La forma más rápida de acabar con una iniciativa de IA es hacer que los equipos justifiquen cada hora de GPU antes de ponerla en marcha».

FinOps garantiza un equilibrio entre la rentabilidad y la flexibilidad operativa, lo que permite a las empresas escalar la IA sin arruinarse.

Las plataformas de orquestación de IA en EE. UU. se pueden agrupar en tres categorías principales, cada una adaptada a las diferentes necesidades organizativas y exigencias técnicas. Estas categorías reflejan un enfoque en la administración de los costos, la garantía de la gobernanza y la habilitación de una integración escalable. Ya sea que se trate de la automatización de los procesos empresariales, la integración perfecta en la nube o la eficiencia operativa, estas plataformas destacan los diversos enfoques que configuran el panorama de la orquestación de la IA en EE. UU. Vamos a desglosar cada categoría.

Estas plataformas se adaptan a los equipos de RRHH, finanzas y ventas al ofrecer flujos de trabajo prediseñados para usuarios no técnicos. Por ejemplo, IBM watsonx Orchestrate ofrece una versión de prueba gratuita y una aplicación automatizada de políticas, lo que permite a los departamentos de RRHH gestionar grandes volúmenes de solicitudes al instante, lo que permite dedicar más tiempo a las iniciativas estratégicas. Del mismo modo, Dun & Bradstreet logró una reducción de hasta un 20% en el tiempo de adquisición mediante la evaluación de riesgos basada en la inteligencia artificial.

La gobernanza centralizada y las protecciones integradas son características clave de estas plataformas. Como Domo Lo expresa acertadamente:

«El éxito en la IA ya no consiste en tener la mayor cantidad de modelos, sino en orquestarlos de manera efectiva».

Una ventaja notable es el enfoque de «no separar ni reemplazar», que se integra perfectamente con las herramientas SaaS existentes, como Salesforce y SAP, lo que evita la necesidad de una reforma completa de la infraestructura. A partir de aquí, pasamos a las capas de orquestación nativas de la nube que están estrechamente integradas en los ecosistemas de nube existentes.

Los principales proveedores de nube de EE. UU., como AWS, Microsoft Azure y Google Cloud, ofrecen servicios de orquestación que están profundamente integrados en sus ecosistemas. Funciones de AWS Step, por ejemplo, permite la orquestación sin servidores y la ejecución rápida del flujo de trabajo al integrarse estrechamente con otros servicios de AWS. Canalizaciones de Amazon SageMaker puede gestionar decenas de miles de flujos de trabajo simultáneos de aprendizaje automático, como lo demuestra Hipoteca Rocketel uso de múltiples LLM de código abierto para la evaluación.

El servicio Foundry Agent de Microsoft lleva la integración un paso más allá al unificar modelos, herramientas y marcos en un único tiempo de ejecución. Refuerza la seguridad del contenido, gestiona las conversaciones y se integra con sistemas de identidad como Microsoft Entra. Con Base de datos Azure Cosmos, la plataforma garantiza la preservación del estado y el historial de conversaciones incluso durante las interrupciones regionales. Una empresa informó que había logrado un ahorro de costos de 4,2 veces mayor tras adoptar el paquete Microsoft Foundry. Los desarrolladores también se benefician de funciones como los modos de ejecución local, que permiten probar el flujo de trabajo en dispositivos personales antes de incurrir en costos de nube. Las funciones de gobierno, como el control de acceso basado en roles (RBAC), el aislamiento de la red y los historiales de ejecución detallados, garantizan que las tareas de aprendizaje automático sigan siendo auditables y seguras. Por último, analicemos las plataformas de AIOps que se centran en aumentar la eficiencia operativa de los equipos técnicos.

Las plataformas AIOps están diseñadas para científicos de datos e ingenieros de aprendizaje automático que supervisan el ciclo de vida de los sistemas de IA. Se basan en marcos de código abierto como Flujo de aire Apache y Rayo, estas plataformas se destacan en la capacitación, el escalado y la supervisión distribuidos, todo ello sin tasas de licencia. Por ejemplo, Cualquier escala distribuye de manera eficiente las cargas de trabajo entre los clústeres, optimizando el rendimiento y minimizando los costos de la infraestructura inactiva.

Si bien estas plataformas ofrecen una flexibilidad sin igual, exigen un mayor nivel de experiencia técnica. Las organizaciones deben gestionar su propia infraestructura y gestionar el mantenimiento, lo que añade complejidad. Las plataformas AIOps están diseñadas para priorizar el rendimiento y la eficiencia de los recursos, lo que permite la capacitación continua y las cargas de trabajo de inferencia de gran volumen.

Las opciones de implementación varían ampliamente: las plataformas empresariales suelen ofrecer configuraciones SaaS e híbridas, las capas nativas de la nube ofrecen entornos sin servidor y totalmente gestionados, y las plataformas AIOps admiten configuraciones híbridas, gestionadas y de código abierto. Esta variedad permite a las organizaciones elegir soluciones que se ajusten a sus capacidades técnicas, necesidades de cumplimiento y consideraciones presupuestarias.

Prompts.ai está avanzando a pasos agigantados en el mercado estadounidense al abordar el problema de las suscripciones fragmentadas de IA. Al reunir más de 35 de los principales modelos lingüísticos de gran tamaño en una plataforma única y segura, simplifica las operaciones y elimina la abrumadora cantidad de herramientas. Esta solución integra controles de nivel empresarial que cumplen con los altos estándares de los directores financieros y CISO, lo que garantiza la confianza y la confiabilidad.

Prompts.ai ofrece un acceso sin interrupciones a más de 35 modelos principales a través de una interfaz unificada, lo que permite a los usuarios realizar comparaciones paralelas en tiempo real. Se ha demostrado que este enfoque aumenta la productividad hasta 10 veces. Como destacó Steven Simmons, director ejecutivo y fundador:

«Con los LoRAs y los flujos de trabajo de Prompts.ai, ahora completa renderizados y propuestas en un solo día».

La plataforma elimina los retrasos causados por las limitaciones del hardware y transforma los procesos experimentales en flujos de trabajo reutilizables. Estos flujos de trabajo se pueden implementar instantáneamente en departamentos como marketing, recursos humanos y finanzas. Con tiempos de configuración rápidos (a menudo inferiores a 10 minutos) e integraciones con herramientas como Slack, Gmail, y Trello, Prompts.ai facilita la adopción de nuevos flujos de trabajo. Estas capacidades de flujo de trabajo están respaldadas por un sólido marco de gobierno, que se explora más adelante.

Prompts.ai garantiza un seguimiento preciso del uso de la IA mediante registros de auditoría completos y un control de acceso basado en roles (RBAC). Esta función permite a los equipos legales y de cumplimiento supervisar las interacciones con confianza. La plataforma se alinea con las mejores prácticas establecidas, incluidas las normas SOC 2 de tipo II, HIPAA y GDPR, y comenzó su proceso de auditoría del SOC 2 de tipo 2 el 19 de junio de 2025. Prompts.ai también proporciona un centro de confianza público que ofrece actualizaciones de seguridad en tiempo real mediante una supervisión continua impulsada por Vanta.

Para las empresas, la plataforma incluye módulos de control y supervisión del cumplimiento, lo que brinda a las organizaciones una supervisión centralizada para evitar el «caos de la IA» que puede surgir de las implementaciones desorganizadas. Este enfoque en la gobernanza se alinea con las predicciones de que los paneles de orquestación de múltiples agentes se convertirán en la piedra angular de las empresas inteligentes. En combinación con sus sólidas funciones de seguridad, la estrategia de gestión de costes de Prompts.ai mejora aún más su valor para los usuarios empresariales.

Prompts.ai emplea un enfoque centrado en FinOps, que utiliza créditos TOKN de pago por uso y análisis en tiempo real para ofrecer soluciones de IA escalables y eficientes. Al agrupar los créditos y el almacenamiento entre equipos, la plataforma ayuda a las organizaciones a reducir los costos asociados con la administración de múltiples licencias, lo que permite reducir los costos de inteligencia artificial de hasta un 98%. Los análisis detallados permiten a los equipos de FinOps monitorear de cerca el uso de los tokens, optimizando los flujos de trabajo y reduciendo los gastos.

Las comparaciones de modelos en paralelo de la plataforma también permiten a los ingenieros evaluar la rentabilidad antes de ampliar las implementaciones. Una empresa informó de que había ahorrado 4,2 veces más en costes tras adoptar el sistema de orquestación de Prompts.ai. Los precios de los niveles empresariales son transparentes y oscilan entre 99 y 129 dólares por miembro y mes. Frank Buscemi, CEO y CCO, otorgó a la plataforma una calificación de 4,8 sobre 5, elogiando su capacidad para agilizar la creación de contenido y liberar recursos para las prioridades estratégicas.

Encontrar la plataforma de orquestación de IA adecuada significa equilibrar las capacidades técnicas con las prioridades empresariales. Para las empresas estadounidenses, la flexibilidad de la integración es clave. Las plataformas deben ofrecer API y conectores sólidos para vincular sin problemas los modelos de IA con las bases de datos existentes y los sistemas heredados. La compatibilidad con las configuraciones híbridas y multinube también es esencial, ya que permite que las cargas de trabajo cambien sin problemas entre la infraestructura local y los servicios de nube pública.

La seguridad y la gobernanza no son negociables. Las plataformas deben incluir funciones como los controles de acceso basados en roles (RBAC), protocolos de cifrado sólidos y certificaciones de cumplimiento, como la HIPAA para la atención médica o el SOC 2 de tipo II para las necesidades empresariales más amplias. Estas herramientas garantizan una supervisión centralizada, lo que ayuda a las organizaciones a cumplir con los estándares éticos de inteligencia artificial y a cumplir con las normas de privacidad de datos. La elección entre la orquestación basada en reglas y los sistemas nativos de IA depende de la tarea en cuestión. Los sistemas basados en reglas son ideales para tareas estructuradas como el procesamiento de documentos legales, ya que ofrecen resultados predecibles y auditables. Por otro lado, los enfoques nativos de la IA brillan en escenarios dinámicos como los chatbots de atención al cliente.

La administración de costos es otro factor crítico. Las plataformas con herramientas FinOps integradas proporcionan paneles de control en tiempo real para monitorear el uso de los tokens, la asignación de recursos y el gasto informático. Las opciones de ahorro de costes, como los descuentos por compromiso de uso (CUD) o las máquinas virtuales puntuales para tareas no críticas, pueden optimizar significativamente los gastos. Beena Ammanath, directora ejecutiva de Instituto Global de Inteligencia Artificial de Deloitte, destaca la importancia de la planificación temprana:

«La orquestación y la gobernanza deben considerarse desde el principio, por lo que la integración y la supervisión proactivas son esenciales para un éxito escalable».

Estas consideraciones forman la base de las estrategias de implementación eficaces y escalables.

Comience con flujos de trabajo deterministas para los procesos que requieren reglas estrictas y registros de auditoría completos. Las herramientas como AWS Step Functions son excelentes para ofrecer resultados predecibles y rastreables durante las fases piloto. Una vez que estos flujos de trabajo estén estables, integre gradualmente la orquestación nativa de la IA para realizar tareas más complejas y flexibles.

Establezca los marcos de gobierno desde el principio, antes de expandirse más allá de los equipos iniciales. Las investigaciones muestran que las organizaciones que utilizan la orquestación de la IA lanzan una media de 2,5 veces más aplicaciones que las que no la utilizan. Estandarizar los flujos de trabajo con marcos de código abierto como Cadena LANG o las API estándar del sector pueden agilizar la coordinación de los agentes. Las arquitecturas basadas en eventos pueden mejorar aún más la capacidad de respuesta al activar acciones de inteligencia artificial basadas en cargas de datos o transacciones en tiempo real, lo que garantiza una integración perfecta con los sistemas de TI existentes.

La supervisión del rendimiento y los costos en tiempo real es esencial. Esta visibilidad permite a los equipos de FinOps ajustar los flujos de datos, optimizar los modelos y controlar los presupuestos de manera efectiva. En el caso de las tareas críticas o creativas, la supervisión humana sigue siendo vital para garantizar que los resultados de la IA se alineen con los objetivos empresariales. Por último, opte por plataformas con arquitecturas modulares que admitan estándares abiertos como ONNX. Esto permite actualizar o reemplazar fácilmente los modelos a medida que la tecnología evoluciona, evitando la dependencia de un solo proveedor.

La adopción de la IA entre las empresas estadounidenses sigue creciendo y evolucionando. Las plataformas como Prompts.ai desempeñan un papel fundamental al integrar más de 35 modelos, agilizar los flujos de trabajo y ofrecer paneles de FinOps en tiempo real para controlar los gastos informáticos.

El impulso a la innovación impulsa el liderazgo de EE. UU. en inteligencia artificial. Se ha demostrado que la implementación orquestada de la IA acelera el despliegue de aplicaciones en un impresionante 97%. Sin embargo, dado que el 88% de los ejecutivos planea aumentar los presupuestos de IA para hacer frente a las crecientes complejidades, la necesidad de plataformas modulares e independientes de los proveedores es más crítica que nunca. Estas plataformas permiten a las empresas intercambiar modelos, escalar las cargas de trabajo en entornos de nube híbrida y mantener la flexibilidad a medida que avanza la tecnología. Como afirma acertadamente Domo:

«El éxito en la IA ya no consiste en tener la mayor cantidad de modelos, sino en orquestarlos de manera efectiva».

Este cambio resalta la importancia del cumplimiento, la seguridad y la eficiencia operativa en toda la empresa.

Para sectores como el financiero y el sanitario, donde la regulación es estricta, la gobernanza y el cumplimiento no son negociables. Las funciones de gobierno centralizado, como los controles de acceso basados en funciones, la aplicación automatizada de políticas y los registros de auditoría detallados, convierten las plataformas de orquestación en potentes centros de control. Esto no solo garantiza el cumplimiento de los estándares de cumplimiento, sino que también fomenta la confianza entre los clientes y los reguladores.

La optimización de costos es otro diferenciador clave entre el crecimiento sostenible y el gasto descontrolado. Las plataformas que asignan recursos de forma dinámica, reducen las tareas de integración manual y permiten a los equipos centrarse en la innovación en lugar del mantenimiento generan beneficios cuantificables en todos los departamentos, incluidos los de compras, recursos humanos y operaciones.

El éxito en este ámbito depende de una planificación temprana y una ejecución cuidadosa. Comenzar con flujos de trabajo deterministas, establecer marcos de gobierno sólidos antes de escalar y priorizar los estándares abiertos de interoperabilidad puede ayudar a las empresas estadounidenses a mantenerse competitivas y, al mismo tiempo, gestionar los costos y afrontar la complejidad de manera eficaz.

La orquestación del modelo de IA simplifica y automatiza todo el flujo de trabajo de la IA, lo que ayuda a las empresas a reducir significativamente los costos. Al eliminar las tareas manuales, como activar el entrenamiento con modelos o administrar los flujos de datos, reduce las horas de trabajo y elimina las ineficiencias operativas. Estas plataformas también garantizan un uso más inteligente de los recursos mediante la distribución dinámica de la computación, la memoria y el almacenamiento, lo que evita gastos excesivos en hardware excesivo.

La combinación de varios modelos, API y fuentes de datos en un flujo de trabajo coherente mejora la supervisión del sistema. Esta visibilidad mejorada ayuda a identificar y abordar los problemas de manera temprana, lo que reduce el tiempo de inactividad y evita costosas repeticiones. Además, las operaciones de IA optimizadas permiten a las empresas escalar según sea necesario sin la carga de mantener una infraestructura infrautilizada. ¿El resultado? Ahorros tangibles en áreas críticas como las finanzas, la gestión de la cadena de suministro y el servicio al cliente.

Para garantizar la confiabilidad y cumplir con los estándares de cumplimiento, las plataformas de orquestación de IA deben integrarse marcos de gobernanza eficaces y protocolos de seguridad sólidos. La gobernanza implica establecer políticas claras que describan las funciones, las responsabilidades y la autoridad de toma de decisiones para gestionar los flujos de trabajo de la IA. Las organizaciones deben mantener registros detallados de las versiones de los modelos, aplicar criterios transparentes para la selección de modelos y validar de forma rutinaria los sistemas de IA para que cumplan con las directrices éticas y los requisitos reglamentarios. El monitoreo continuo del rendimiento de los modelos y los posibles sesgos es clave para fomentar la confianza y la responsabilidad.

En el frente de la seguridad, las plataformas deberían adoptar administración de identidades y accesos (IAM) con permisos basados en funciones para controlar el acceso. Los datos deben cifrarse tanto durante el almacenamiento como durante la transmisión, y los puntos finales de la API deben estar protegidos para evitar el acceso no autorizado. Los sistemas de monitoreo y detección de anomalías en tiempo real pueden ayudar a identificar actividades inusuales, mientras que un plan de respuesta a incidentes bien documentado garantiza una resolución rápida de los problemas. Técnicas como la privacidad diferencial protegen la información confidencial y la realización de evaluaciones periódicas de las vulnerabilidades refuerza aún más la seguridad. En conjunto, estas medidas proporcionan un marco sólido para ampliar los flujos de trabajo de la IA y, al mismo tiempo, proteger los datos y mantener la confianza del público.

Las empresas pueden mantener los gastos de IA bajo control mediante el emparejamiento Marcos FinOps con plataformas avanzadas de orquestación de IA. Las herramientas de FinOps desglosan los gastos mediante el análisis de detalles como el uso de la computación en la nube, los costos de almacenamiento y los gastos de llamadas a las API. Esto permite a las organizaciones realizar un seguimiento preciso de los gastos de las cargas de trabajo de IA. Al etiquetar modelos y procesos específicos, los equipos pueden asignar costos a proyectos individuales, establecer alertas presupuestarias y controlar los gastos mediante paneles en tiempo real.

Cuando se combinan con las plataformas de orquestación de IA, estos conocimientos pueden desencadenar ajustes automatizados. Por ejemplo, los sistemas pueden optimizarse reduciendo los recursos informáticos, deteniendo los procesos no utilizados o cambiando a nodos más rentables. Esta configuración crea un proceso fluido en el que los equipos financieros establecen los presupuestos, las herramientas de FinOps proporcionan un seguimiento claro de los costos y las plataformas de orquestación se encargan de la optimización de los recursos. ¿El resultado? Los proyectos de IA se mantienen dentro del presupuesto y, al mismo tiempo, ofrecen los mejores resultados posibles.