L'amélioration des performances des modèles d'apprentissage automatique (ML) est essentielle pour réduire les coûts, accélérer le déploiement et améliorer l'efficacité. Cet article décrit les principaux défis tels que le surajustement, les exigences de calcul élevées et les goulots d'étranglement liés au déploiement, ainsi que des stratégies éprouvées pour les relever.

Commencez par évaluer vos flux de travail, optimisez-les à l'aide de ces méthodes et suivez les résultats pour un retour sur investissement mesurable.

La mise à l'échelle des modèles d'apprentissage automatique comporte souvent des obstacles qui ont une incidence sur leur précision, leur efficacité et leur fiabilité.

Le surajustement se produit lorsqu'un modèle devient trop complexe pour les données d'apprentissage, essentiellement en mémorisant des exemples spécifiques au lieu d'identifier des modèles qui s'appliquent à des données invisibles. Ce problème est fréquent lorsque les données sont insuffisantes ou incohérentes. D'autre part, un sous-ajustement se produit lorsqu'un modèle est trop simpliste et ne parvient pas à saisir les modèles sous-jacents des données, ce qui entraîne de mauvaises performances à la fois pour la formation et pour les nouveaux ensembles de données.

Les modèles d'apprentissage profond nécessitent des ressources informatiques importantes en raison de leurs architectures complexes et de leurs couches profondes. Le recours à une précision à virgule flottante de 32 bits amplifie encore ces exigences de calcul. Pour les organisations qui gèrent simultanément plusieurs tâches de formation, ces exigences peuvent rapidement faire grimper les dépenses opérationnelles.

Même les modèles qui excellent pendant la formation peuvent rencontrer des difficultés lorsqu'ils sont déployés dans des environnements aux ressources limitées. Comme l'a souligné Google Cloud:

Les LLM de très grande taille peuvent être très performants sur une infrastructure de formation massive, mais les très grands modèles peuvent ne pas fonctionner correctement dans des environnements à capacité limitée tels que les appareils mobiles.

Les défis découlent de la puissance de traitement et de la mémoire limitées sur les appareils périphériques, des exigences de latence strictes et des contraintes en matière d'entrée et de sortie des données. De plus, l'extension de la formation à plusieurs GPU entraîne des retards de synchronisation et une surcharge de communication entre GPU, ce qui peut entraver les gains de performances et réduire la fiabilité globale du système.

Ces obstacles soulignent l'importance de l'optimisation des performances, qui sera examinée plus en détail dans la section suivante.

Techniques d'optimisation des modèles ML : impact sur les performances et les économies de coûts

L'amélioration des performances des modèles d'apprentissage automatique (ML) implique des techniques qui améliorent la précision, réduisent la consommation de ressources et permettent une évolutivité fluide.

Les hyperparamètres dictent les aspects critiques d'un modèle, tels que le taux d'apprentissage, l'architecture et la complexité. Contrairement aux paramètres appris pendant l'entraînement, les hyperparamètres doivent être ajustés manuellement pour équilibrer le surajustement et le sous-ajustement. Les méthodes populaires incluent Recherche dans la grille, qui teste de manière exhaustive toutes les combinaisons, et Recherche aléatoire, qui échantillonne les configurations pour des résultats plus rapides. Pour une approche plus intelligente, Optimisation bayésienne utilise des modèles probabilistes pour identifier des ensembles d'hyperparamètres prometteurs.

Pour les modèles à grande échelle, en particulier les réseaux de neurones profonds en vision par ordinateur, Hyperbande peut accélérer le réglage des hyperparamètres jusqu'à trois fois par rapport aux méthodes bayésiennes. Même des ajustements mineurs des hyperparamètres peuvent entraîner une amélioration notable de la précision. Des plateformes comme Amazon SageMaker simplifiez ce processus en proposant un réglage automatique avec la recherche bayésienne et Hyperband. Une fois les hyperparamètres optimisés, le fait de se concentrer sur les caractéristiques d'entrée peut encore améliorer les performances.

Les caractéristiques d'entrée que vous fournissez à un modèle jouent un rôle essentiel dans son succès. Trop peu de fonctionnalités peuvent entraver la généralisation, tandis qu'un trop grand nombre peut entraîner un surajustement et une complexité inutile. Les caractéristiques qui sont fortement corrélées entre elles ou qui ne sont pas pertinentes pour la variable cible peuvent également dégrader les performances et masquer l'interprétabilité du modèle.

Les techniques de sélection des fonctionnalités permettent d'identifier et de supprimer les entrées redondantes ou non informatives. L'une des approches consiste à ajouter ou à supprimer des fonctionnalités de manière itérative, en testant leur impact sur les performances du modèle. Des outils tels que FORME valeurs (ShapLey Additive Explications) peut quantifier la contribution de chaque fonctionnalité, ce qui permet d'éliminer plus facilement celles qui ont un impact minimal. En outre, des techniques de prétraitement telles que la mise à l'échelle des caractéristiques garantissent que les variables d'entrée sont correctement équilibrées lors de l'optimisation, améliorant ainsi la stabilité du modèle. Des bibliothèques comme SciKit Learn fournir des implémentations accessibles pour de nombreuses méthodes de sélection de fonctionnalités et de prétraitement.

La rationalisation des modèles par le biais de l'élagage et de la quantification peut réduire de manière significative les demandes de calcul tout en préservant la précision.

Élagage supprime les poids inutiles du modèle. L'élagage basé sur la magnitude, suivi d'un recyclage, peut maintenir les performances tout en réduisant les paramètres de 30 à 50 %. Ce processus permet non seulement de réduire la taille du modèle, mais également de rendre l'inférence plus rapide et plus efficace.

Quantification réduit la précision des valeurs numériques d'un modèle. Par exemple, la conversion de valeurs à virgule flottante 32 bits en entiers 16 bits ou 8 bits peut entraîner des gains de performances substantiels. Sur les GPU NVIDIA A100, la réduction de la précision de FP32 à BF16/FP16 peut théoriquement augmenter les performances de 19,5 TFLOPS à 312 TFLOPS, soit une amélioration de 16 fois. Dans la formation aux modèles linguistiques, l'utilisation de types de données de moindre précision a montré une augmentation de 15 % du débit des jetons. La quantification réduit généralement la taille du modèle de 75 à 80 % avec une perte de précision minimale (généralement inférieure à 2 %). Bien que la quantification après l'entraînement soit simple, elle peut légèrement affecter la précision ; formation axée sur la quantification y remédie en tenant compte des contraintes de précision pendant la phase d'entraînement, afin de préserver les performances de manière plus efficace.

La combinaison de l'élagage et de la quantification peut apporter des avantages encore plus importants. Par exemple, une grande banque a réduit le temps d'inférence de 73 % en utilisant ces méthodes. Les modèles soumis à un élagage suivi d'une quantification sont souvent 4 à 5 fois plus petits et 2 à 3 fois plus rapides que leurs homologues d'origine. Pour garantir que ces optimisations apportent des avantages concrets, il est essentiel de comparer des indicateurs tels que le temps d'inférence, l'utilisation de la mémoire et les FLOPS tout au long du processus.

Les outils avancés font passer les flux de travail d'apprentissage automatique au niveau supérieur, en améliorant les processus de formation, d'inférence et de déploiement. Ces outils répondent aux défis de production courants, en aidant les équipes à accélérer le déploiement et à créer des systèmes évolutifs et efficaces tout en maintenant une précision élevée.

XGBoost est un excellent choix pour les tâches de données structurées telles que la régression, la classification et le clustering. Sa capacité à gérer efficacement de grands ensembles de données et à fournir des performances élevées en fait un outil incontournable pour de nombreux praticiens de l'apprentissage automatique.

L'apprentissage par transfert s'appuie sur des modèles pré-entraînés, tels que ResNet-50 formé sur ImageNet, afin de simplifier et d'accélérer le processus de réglage pour des tâches spécifiques. Cette approche est particulièrement utile lorsque vous travaillez avec des données d'entraînement limitées, car elle exploite des modèles tirés d'ensembles de données plus importants et diversifiés pour améliorer les performances. Cependant, il est important de noter que les modèles préentraînés peuvent parfois présenter des biais par rapport à leurs données d'entraînement d'origine.

Tensor RT est conçu pour optimiser les modèles d'apprentissage en profondeur à des fins d'inférence, d'augmentation du débit et de minimisation de la latence. Il est donc idéal pour les applications à hautes performances.

Exécution ONNX propose une solution multiplateforme polyvalente pour déployer des modèles à partir de frameworks tels que PyTorch, TensorFlow/Keras, TFlite et scikit-learn. Il prend en charge le déploiement sur une gamme d'environnements matériels et de programmation, notamment Python, C#, C++ et Java. Les deux outils améliorent l'efficacité de l'inférence et garantissent une utilisation optimale des ressources dans les environnements de production.

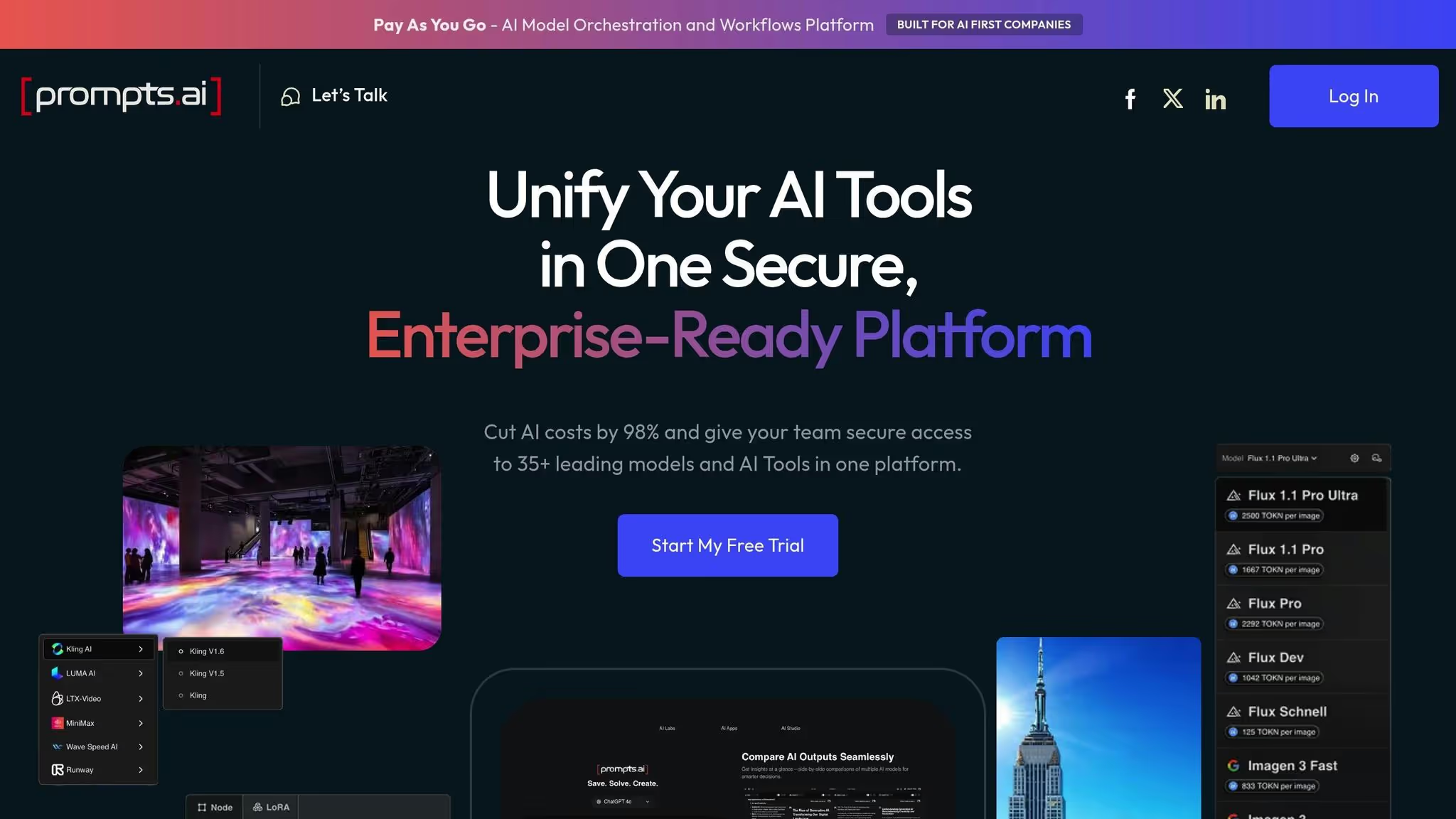

La gestion de plusieurs modèles et outils d'IA peut rapidement augmenter les coûts et la complexité pour les équipes d'apprentissage automatique (ML). Pour y remédier, les plateformes d'orchestration jouent un rôle clé dans la rationalisation des opérations et l'amélioration des performances. Prompts.ai simplifie ces défis en proposant une interface unique pour centraliser l'accès aux modèles, appliquer la gouvernance et surveiller les dépenses liées à l'IA.

Prompts.ai optimise la gestion des modèles en unifiant l'accès à plus de 35 principaux modèles d'IA, notamment GPT-5, Claude, Gémeaux, et Lama - via une API unique. Pour passer d'un modèle à l'autre, il suffit de régler un paramètre de configuration. La plateforme comprend également une bibliothèque de modèles d'invite versionnés, permettant aux équipes de réutiliser des flux de travail efficaces dans tous les services. Par exemple, une équipe de support client basée aux États-Unis pourrait mettre en place un flux de travail qui extrait les articles de la base de connaissances, achemine les requêtes vers le modèle le plus rentable en fonction de leur complexité, vérifie la présence de données sensibles et enregistre chaque interaction. Cette configuration permet aux équipes de tester de nouveaux modèles dans des environnements de test tout en conservant des versions stables en production, en promouvant les mises à jour uniquement après une évaluation approfondie.

Prompts.ai intègre les opérations financières directement dans les flux de travail d'IA, fournissant un suivi en temps réel des dépenses par modèle, équipe et projet. Les tableaux de bord présentent les coûts en dollars américains avec des ventilations détaillées par jour ou par heure, reflétant l'utilisation des jetons et la tarification des fournisseurs. Les organisations peuvent définir des budgets, par exemple plafonner un projet de vente à 25 000 dollars par mois, et recevoir des alertes lorsque les dépenses atteignent 75 %, 90 % ou 100 % de la limite. Les règles de routage dynamiques optimisent davantage les coûts en attribuant des tâches à faible risque à des modèles plus abordables tout en réservant des options premium pour les tâches critiques. En liant l'utilisation des modèles aux résultats commerciaux, la plateforme calcule des indicateurs de coût par résultat, aidant ainsi les décideurs à évaluer le retour sur investissement (ROI). Ce niveau de contrôle des coûts favorise également l'analyse comparative et garantit la conformité.

Prompts.ai permet aux équipes de comparer des modèles côte à côte à l'aide de charges de travail réelles et d'instructions spécifiques aux États-Unis, telles que la tarification en dollars et les formats de date MM/JJ/AAAA. Des indicateurs tels que la latence (temps de réponse p95), le coût pour 1 000 jetons et les scores de qualité fournissent des informations exploitables. Par exemple, une comparaison peut montrer qu'un modèle est 28 % moins cher mais 6 % moins précis pour les requêtes sensibles à la conformité, ce qui oriente les décisions politiques. Sur le plan de la conformité, la plateforme applique un contrôle d'accès basé sur les rôles et s'intègre à l'authentification unique (SSO) pour limiter les modifications sensibles du flux de travail aux utilisateurs autorisés. Les garde-corps intégrés empêchent les modèles externes d'accéder aux données sensibles, tandis que les journaux d'audit centralisés prennent en charge les normes SOC 2, HIPAA et d'autres examens réglementaires. Prompts.ai a entamé son processus d'audit SOC 2 de type 2 le 19 juin 2025 et gère un centre de confiance public pour des mises à jour en temps réel sur sa posture de sécurité.

L'amélioration des performances des modèles d'apprentissage automatique n'est pas simplement une nécessité technique, elle influe directement sur vos résultats. En s'appuyant sur des stratégies d'optimisation éprouvées, les entreprises peuvent améliorer la précision des modèles de 15 à 40 % tout en réduisant les coûts d'inférence de 30 à 70 %. Par exemple, une entreprise américaine gérant 50 millions de prévisions par mois pourrait économiser des centaines de milliers de dollars par an en passant à des environnements d'exécution optimisés tels que TensorRT ou ONNX Runtime au prix standard d'un GPU cloud.

Le principal défi consiste à trouver un équilibre entre précision, rapidité et coût pour chaque cas d'utilisation. Prenons l'exemple d'une application bancaire mobile : elle peut donner la priorité aux modèles épurés ou quantifiés afin de minimiser la latence et de préserver l'autonomie de la batterie de millions d'appareils. Parallèlement, un système de détection des fraudes pourrait réserver des modèles de haute précision pour les transactions critiques, en acheminant les requêtes à moindre risque via des alternatives plus rentables. Prompts.ai simplifie ce processus de prise de décision en centralisant la sélection des modèles et le suivi des coûts, ce qui facilite la gestion de ces compromis.

Pour commencer à réaliser des bénéfices, commencez par évaluer vos performances et vos coûts actuels sur 1 à 3 flux de travail de machine learning clés. Concentrez-vous sur les améliorations réalisables, telles que le réglage des hyperparamètres ou l'adoption de temps d'exécution optimisés, pour obtenir des gains rapides. L'intégration de ces flux de travail dans Prompts.ai vous permet de surveiller les indicateurs de performance, d'expérimenter des modèles réduits ou distillés et de lier l'utilisation des modèles directement aux résultats commerciaux, qu'il s'agisse de réduire le coût par prévision, de respecter les SLA de latence ou d'augmenter les revenus par visiteur. Ces efforts peuvent vous aider à estimer une période d'amortissement de 6 à 18 mois.

Au-delà de ces optimisations immédiates, Prompts.ai fournit un cadre pour une gouvernance à long terme et des rendements évolutifs. En unifiant les équipes des finances, des risques et de l'ingénierie au sein d'une plateforme unique, elle institutionnalise la gestion des dépenses et la conformité liées à l'IA. Des fonctionnalités telles que les journaux d'audit centralisés, les contrôles d'accès basés sur les rôles et les garde-corps intégrés garantissent que seuls les modèles approuvés et performants sont mis en production. Cette approche rationalisée transforme les améliorations isolées en un processus reproductible et évolutif, améliorant à la fois les performances des modèles et la conformité organisationnelle. Le résultat ? Des gains de productivité tangibles et un retour sur investissement mesurable dans l'ensemble de votre entreprise.

Le réglage des hyperparamètres consiste à affiner les paramètres d'un modèle d'apprentissage automatique, tels que le taux d'apprentissage, la taille du lot ou le nombre de couches, afin d'améliorer ses performances. En expérimentant systématiquement différentes combinaisons, vous pouvez améliorer la précision du modèle et vous assurer qu'il se généralise efficacement à des données invisibles.

Lorsqu'il est correctement effectué, le réglage minimise les erreurs et évite le surajustement, ce qui permet au modèle de fonctionner de manière fiable au-delà du simple jeu de données d'entraînement. Des techniques telles que la recherche par grille, la recherche aléatoire ou l'utilisation de cadres automatisés peuvent simplifier et accélérer ce processus d'optimisation.

L'optimisation des modèles d'apprentissage automatique en termes de performances et d'efficacité implique souvent deux techniques clés : taille et quantification.

Élagage se concentre sur la réduction d'un modèle en éliminant les paramètres qui ne sont pas essentiels. En réduisant la taille et la complexité du modèle, il permet des calculs plus rapides et utilise moins de ressources, tout en maintenant une précision proche de celle d'origine.

Quantification répond aux exigences de mémoire et de calcul en utilisant des types de données de moindre précision pour les pondérations et les activations des modèles, comme le passage de 32 bits à 8 bits. Cette approche permet non seulement d'accélérer l'inférence, mais également de garantir que le modèle peut fonctionner efficacement sur des appareils soumis à des contraintes matérielles, tels que les smartphones ou les appareils périphériques.

Prompts.ai simplifie la gestion des dépenses grâce à son Payez à l'utilisation système, offrant un accès à plus de 35 modèles d'IA. Cette approche permet aux utilisateurs de réduire leurs coûts jusqu'à 98 %, en ne payant que pour ce qu'ils utilisent réellement. C'est un moyen intelligent de maîtriser les budgets sans sacrifier l'accès à de puissants outils.

Pour les organisations qui accordent la priorité à la sécurité et à la conformité, Prompts.ai fournit un plateforme sécurisée et prête à l'emploi. Doté de puissantes fonctionnalités de gouvernance, il garantit un accès contrôlé aux outils et aux flux de travail d'IA, aidant ainsi les entreprises à respecter les normes réglementaires tout en protégeant leurs données.