Mejorar el rendimiento del modelo de aprendizaje automático (ML) es fundamental para reducir los costos, acelerar la implementación y aumentar la eficiencia. Este artículo describe los desafíos clave, como el sobreajuste, las altas exigencias computacionales y los cuellos de botella en la implementación, junto con estrategias comprobadas para abordarlos.

Comience por comparar sus flujos de trabajo, optimice con estos métodos y realice un seguimiento de los resultados para obtener un ROI cuantificable.

La ampliación de los modelos de aprendizaje automático suele conllevar obstáculos que afectan a su precisión, eficiencia y fiabilidad.

El sobreajuste ocurre cuando un modelo se vuelve demasiado complejo para los datos de entrenamiento y, básicamente, memoriza ejemplos específicos en lugar de identificar patrones que se aplican a datos invisibles. Este problema es común cuando los datos son insuficientes o inconsistentes. Por otro lado, el ajuste insuficiente se produce cuando un modelo es demasiado simplista y no logra captar los patrones subyacentes de los datos, lo que se traduce en un rendimiento deficiente tanto en los conjuntos de datos nuevos como en los de formación.

Los modelos de aprendizaje profundo exigen importantes recursos informáticos debido a sus intrincadas arquitecturas y capas profundas. La confianza en la precisión de punto flotante de 32 bits amplifica aún más estos requisitos computacionales. Para las organizaciones que gestionan varios trabajos de formación de forma simultánea, estas exigencias pueden aumentar rápidamente los gastos operativos.

Incluso los modelos que sobresalen durante la capacitación pueden encontrar dificultades cuando se implementan en entornos con recursos limitados. Como se destaca en Google Cloud:

Los LLM que son muy grandes pueden tener un alto rendimiento en una infraestructura de capacitación masiva, pero los modelos muy grandes pueden no funcionar bien en entornos con capacidad limitada, como los dispositivos móviles.

Los desafíos surgen de la capacidad de procesamiento y la memoria limitadas en los dispositivos periféricos, los estrictos requisitos de latencia y las restricciones en la entrada y salida de datos. Además, la ampliación del entrenamiento a varias GPU provoca retrasos en la sincronización y sobrecarga de comunicación entre las GPU, lo que puede dificultar el aumento del rendimiento y reducir la fiabilidad general del sistema.

Estos obstáculos subrayan la importancia de las optimizaciones del rendimiento, que se analizarán con más detalle en la siguiente sección.

Técnicas de optimización del modelo ML: impacto en el rendimiento y el ahorro de costos

Lograr un mejor rendimiento del modelo de aprendizaje automático (ML) implica técnicas que mejoren la precisión, reduzcan el consumo de recursos y permitan una escalabilidad perfecta.

Los hiperparámetros dictan los aspectos críticos de un modelo, como la tasa de aprendizaje, la arquitectura y la complejidad. A diferencia de los parámetros aprendidos durante el entrenamiento, los hiperparámetros se deben ajustar manualmente para equilibrar el sobreajuste y el subajuste. Entre los métodos más populares se incluyen Búsqueda en cuadrícula, que prueba exhaustivamente todas las combinaciones, y Búsqueda aleatoria, que muestra configuraciones para obtener resultados más rápidos. Para un enfoque más inteligente, Optimización bayesiana utiliza modelos probabilísticos para identificar conjuntos de hiperparámetros prometedores.

Para los modelos a gran escala, en particular las redes neuronales profundas en la visión artificial, Hiperbanda puede acelerar el ajuste de hiperparámetros hasta tres veces en comparación con los métodos bayesianos. Incluso los ajustes más pequeños de los hiperparámetros pueden conducir a mejoras notables en la precisión. Plataformas como Amazon SageMaker simplifique este proceso al ofrecer un ajuste automático con la búsqueda bayesiana y Hyperband. Una vez optimizados los hiperparámetros, centrarse en las funciones de entrada puede mejorar aún más el rendimiento.

Las funciones de entrada que se proporcionan a un modelo desempeñan un papel fundamental en su éxito. Muy pocas funciones pueden dificultar la generalización, mientras que demasiadas pueden provocar un ajuste excesivo y una complejidad innecesaria. Las características que están altamente correlacionadas entre sí o que son irrelevantes para la variable objetivo también pueden degradar el rendimiento y dificultar la interpretabilidad del modelo.

Las técnicas de selección de características ayudan a identificar y eliminar las entradas redundantes o poco informativas. Un enfoque consiste en agregar o eliminar funciones de forma iterativa, probando su impacto en el rendimiento del modelo. Herramientas como FORMA Valores (ShapEy Additive Explanations) puede cuantificar la contribución de cada función, lo que facilita la eliminación de aquellas con un impacto mínimo. Además, las técnicas de preprocesamiento, como el escalado de características, garantizan que las variables de entrada se equilibren correctamente durante la optimización, lo que mejora la estabilidad del modelo. Bibliotecas como Scikit-learn proporcionan implementaciones accesibles para muchos métodos de preprocesamiento y selección de funciones.

La racionalización de los modelos mediante la reducción y la cuantificación puede reducir significativamente las demandas computacionales y, al mismo tiempo, mantener la precisión.

Poda elimina los pesos innecesarios del modelo. La poda basada en la magnitud, seguida de un readiestramiento, puede mantener el rendimiento y, al mismo tiempo, reducir los parámetros entre un 30 y un 50%. Este proceso no solo reduce el tamaño del modelo, sino que también hace que la inferencia sea más rápida y eficiente.

Cuantificación reduce la precisión de los valores numéricos de un modelo. Por ejemplo, la conversión de valores de coma flotante de 32 bits en enteros de 16 u 8 bits puede generar un aumento sustancial del rendimiento. En las GPU NVIDIA A100, reducir la precisión de FP32 a BF16/FP16 puede, en teoría, aumentar el rendimiento de 19,5 TFLOPS a 312 TFLOPS, lo que supone una mejora de 16 veces. En el entrenamiento con modelos lingüísticos, el uso de tipos de datos de menor precisión ha demostrado un aumento del 15% en el rendimiento de los tokens. La cuantificación suele reducir el tamaño del modelo entre un 75 y un 80% con una pérdida de precisión mínima (normalmente menos del 2%). Si bien la cuantificación posterior al entrenamiento es sencilla, puede afectar levemente a la precisión; formación consciente de la cuantificación aborda esto teniendo en cuenta las restricciones de precisión durante la fase de entrenamiento, preservando el rendimiento de manera más efectiva.

La combinación de la poda y la cuantificación puede generar beneficios aún mayores. Por ejemplo, un banco importante redujo el tiempo de inferencia en un 73% con estos métodos. Los modelos que se someten a una poda seguida de una cuantificación suelen ser entre 4 y 5 veces más pequeños y entre 2 y 3 veces más rápidos que sus homólogos originales. Para garantizar que estas optimizaciones ofrezcan beneficios reales, es fundamental comparar métricas como el tiempo de inferencia, el uso de la memoria y los fracasos durante todo el proceso.

Las herramientas avanzadas llevan los flujos de trabajo de aprendizaje automático al siguiente nivel y mejoran los procesos de capacitación, inferencia e implementación. Estas herramientas abordan los desafíos de producción más comunes y ayudan a los equipos a acelerar la implementación y crear sistemas escalables y eficientes, a la vez que mantienen una alta precisión.

XGBoost es una excelente opción para tareas de datos estructurados como la regresión, la clasificación y la agrupación en clústeres. Su capacidad para gestionar de manera eficiente grandes conjuntos de datos y ofrecer un alto rendimiento lo convierte en una herramienta de referencia para muchos profesionales del aprendizaje automático.

El aprendizaje por transferencia aprovecha modelos previamente entrenados, como ResNet-50 entrenado en ImageNet, para simplificar y acelerar el proceso de ajuste para tareas específicas. Este enfoque es especialmente útil cuando se trabaja con datos de entrenamiento limitados, ya que aprovecha los patrones aprendidos de conjuntos de datos más grandes y diversos para mejorar el rendimiento. Sin embargo, es importante tener en cuenta que los modelos previamente entrenados a veces pueden presentar sesgos con respecto a sus datos de entrenamiento originales.

Tensor RT está diseñado para optimizar los modelos de aprendizaje profundo para la inferencia, aumentar el rendimiento y minimizar la latencia. Esto lo hace ideal para aplicaciones de alto rendimiento.

Tiempo de ejecución de ONNX ofrece una solución versátil y multiplataforma para implementar modelos a partir de marcos como PyTorch, TensorFlow/Keras, TFLite y scikit-learn. Admite la implementación en una variedad de entornos de hardware y programación, incluidos Python, C#, C++ y Java. Ambas herramientas mejoran la eficiencia de la inferencia y garantizan un uso óptimo de los recursos en los entornos de producción.

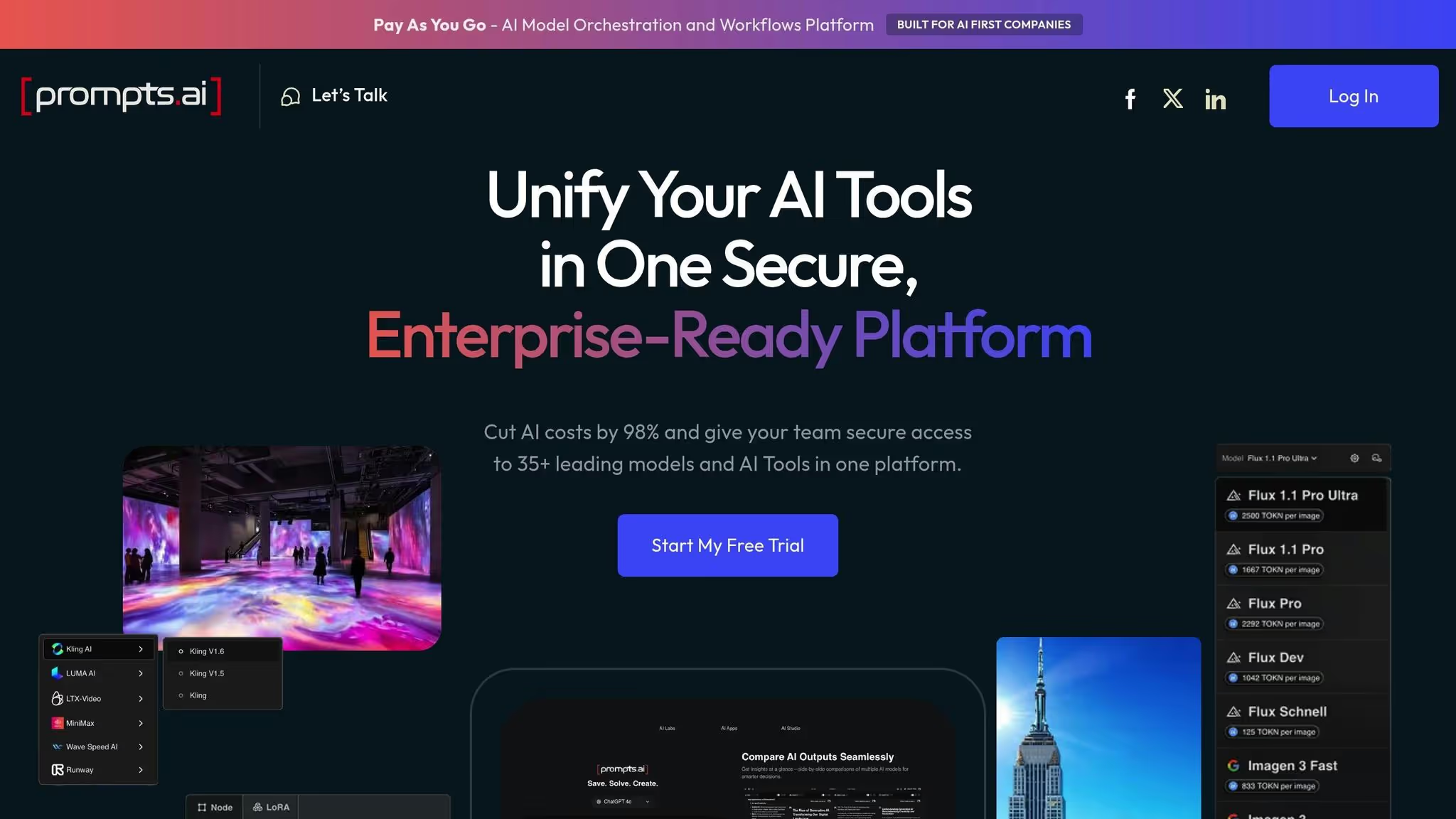

La administración de varios modelos y herramientas de IA puede aumentar rápidamente los costos y la complejidad para los equipos de aprendizaje automático (ML). Para abordar este problema, las plataformas de orquestación desempeñan un papel clave a la hora de racionalizar las operaciones y mejorar el rendimiento. Prompts.ai simplifica estos desafíos al ofrecer una interfaz única para centralizar el acceso a los modelos, reforzar la gobernanza y supervisar el gasto en inteligencia artificial.

Prompts.ai optimiza la administración de modelos al unificar el acceso a más de 35 modelos de IA líderes, incluidos GPT-5, Claudio, Géminis, y Llama - a través de una única API. Cambiar entre modelos es tan sencillo como ajustar un ajuste de configuración. La plataforma también incluye una biblioteca de plantillas de mensajes versionadas, que permite a los equipos reutilizar flujos de trabajo eficaces en todos los departamentos. Por ejemplo, un equipo de atención al cliente con sede en EE. UU. podría configurar un flujo de trabajo que recupere los artículos de la base de conocimientos, dirija las consultas al modelo más rentable en función de su complejidad, compruebe si hay datos confidenciales y registre cada interacción. Esta configuración permite a los equipos probar nuevos modelos en entornos de ensayo y, al mismo tiempo, mantener las versiones estables en producción, y promover las actualizaciones solo después de una evaluación exhaustiva.

Prompts.ai integra las operaciones financieras directamente en los flujos de trabajo de IA, lo que proporciona un seguimiento en tiempo real de los gastos por modelo, equipo y proyecto. Los paneles muestran los costos en USD con desgloses detallados por día u hora, lo que refleja el uso de los tokens y los precios de los proveedores. Las organizaciones pueden establecer presupuestos (por ejemplo, limitar un proyecto de ventas a 25 000 USD al mes) y recibir alertas cuando los gastos alcancen el 75%, el 90% o el 100% del límite. Las reglas de enrutamiento dinámico optimizan aún más los costos al asignar tareas de bajo riesgo a modelos más asequibles y, al mismo tiempo, reservar opciones premium para trabajos críticos. Al vincular el uso del modelo con los resultados empresariales, la plataforma calcula las métricas del coste por resultado, lo que ayuda a los responsables de la toma de decisiones a evaluar el retorno de la inversión (ROI). Este nivel de control de costos también respalda la evaluación comparativa y garantiza el cumplimiento.

Prompts.ai permite a los equipos comparar los modelos uno al lado del otro utilizando cargas de trabajo reales e indicaciones específicas de EE. UU., como precios en dólares y formatos de fecha MM/DD/AAAA. Métricas como la latencia (tiempo de respuesta de 95 puntos), el coste por cada 1000 fichas y las puntuaciones de calidad proporcionan información útil. Por ejemplo, una comparación podría mostrar que un modelo es un 28% más barato, pero un 6% menos preciso para las consultas sensibles al cumplimiento normativo, lo que sirve de guía para la toma de decisiones políticas. En cuanto al cumplimiento, la plataforma aplica un control de acceso basado en funciones y se integra con el inicio de sesión único (SSO) para restringir las modificaciones delicadas del flujo de trabajo a los usuarios autorizados. Las barreras integradas impiden que los modelos externos accedan a datos confidenciales, mientras que los registros de auditoría centralizados son compatibles con las revisiones del SOC 2, la HIPAA y otras normativas. Prompts.ai inició su proceso de auditoría del SOC 2 de tipo 2 el 19 de junio de 2025 y mantiene un centro de confianza público para recibir actualizaciones en tiempo real sobre su postura de seguridad.

Mejorar el rendimiento de los modelos de aprendizaje automático no es solo una necesidad técnica, sino que influye directamente en sus resultados. Al aprovechar las estrategias de optimización probadas, las empresas pueden mejorar la precisión de los modelos entre un 15 y un 40% y, al mismo tiempo, reducir los costos de inferencia entre un 30 y un 70%. Por ejemplo, una empresa estadounidense que gestione 50 millones de predicciones al mes podría ahorrar cientos de miles de dólares al año si optara por tiempos de ejecución optimizados, como TensorRT u ONNX Runtime, a precios estándar de GPU en la nube.

El desafío clave radica en equilibrar la precisión, la velocidad y el costo para cada caso de uso. Tomemos como ejemplo una aplicación de banca móvil: podría priorizar los modelos reducidos o cuantificados para minimizar la latencia y conservar la duración de la batería en millones de dispositivos. Mientras tanto, un sistema de detección de fraudes podría reservar modelos de alta precisión para las transacciones críticas y, de este modo, canalizar las consultas de menor riesgo a través de alternativas más rentables. Prompts.ai simplifica este proceso de toma de decisiones al centralizar la selección de modelos y el seguimiento de los costos, lo que facilita la gestión de estas compensaciones.

Para comenzar a obtener beneficios, comience por comparar su rendimiento y costos actuales en 1 a 3 flujos de trabajo clave de aprendizaje automático. Céntrese en las mejoras que se puedan lograr, como el ajuste de los hiperparámetros o la adopción de tiempos de ejecución optimizados, para garantizar ganancias rápidas. La integración de estos flujos de trabajo en Prompts.ai permite supervisar las métricas de rendimiento, experimentar con modelos depurados o destilados y vincular el uso de los modelos directamente con los resultados empresariales, ya sea para reducir el coste por predicción, cumplir los acuerdos de nivel de servicio de latencia o aumentar los ingresos por visitante. Estos esfuerzos pueden ayudarle a estimar un período de amortización de entre 6 y 18 meses.

Más allá de estas optimizaciones inmediatas, Prompts.ai proporciona un marco para la gobernanza a largo plazo y los retornos escalables. Al unificar los equipos de finanzas, riesgos e ingeniería en una sola plataforma, institucionaliza la gestión del gasto y el cumplimiento de la IA. Funciones como los registros de auditoría centralizados, los controles de acceso basados en funciones y las barreras de protección integradas garantizan que solo lleguen a la producción modelos comprobados y de alto rendimiento. Este enfoque simplificado convierte las mejoras aisladas en un proceso escalable y repetible, lo que mejora tanto el rendimiento del modelo como el cumplimiento organizacional. ¿El resultado? Ganancias de productividad tangibles y un ROI cuantificable en toda la empresa.

El ajuste de hiperparámetros implica ajustar la configuración de un modelo de aprendizaje automático (como la velocidad de aprendizaje, el tamaño del lote o la cantidad de capas) para mejorar su rendimiento. Al experimentar de forma sistemática con varias combinaciones, puede aumentar la precisión del modelo y garantizar que se generalice de manera eficaz a datos invisibles.

Cuando se hace correctamente, el ajuste minimiza los errores y evita el sobreajuste, lo que ayuda al modelo a funcionar de manera confiable más allá del conjunto de datos de entrenamiento. Técnicas como la búsqueda en cuadrículas, la búsqueda aleatoria o el uso de marcos automatizados pueden simplificar y acelerar este proceso de optimización.

La optimización de los modelos de aprendizaje automático para mejorar el rendimiento y la eficiencia a menudo implica dos técnicas clave: despunte y cuantización.

Poda se centra en recortar un modelo mediante la eliminación de parámetros que no son esenciales. Al reducir el tamaño y la complejidad del modelo, logra cálculos más rápidos y utiliza menos recursos, a la vez que mantiene la precisión en los niveles casi originales.

Cuantificación aborda las demandas computacionales y de memoria mediante el uso de tipos de datos de menor precisión para las ponderaciones y activaciones de los modelos, como cambiar de 32 bits a 8 bits. Este enfoque no solo acelera la inferencia, sino que también garantiza que el modelo pueda ejecutarse de manera eficaz en dispositivos con limitaciones de hardware, como teléfonos inteligentes o dispositivos periféricos.

Prompts.ai facilita la gestión de los gastos con su paga sobre la marcha sistema, que ofrece acceso a más de 35 modelos de IA. Este enfoque permite a los usuarios reducir los costos hasta en un 98%, pagando solo por lo que realmente usan. Es una forma inteligente de mantener los presupuestos bajo control sin sacrificar el acceso a herramientas potentes.

Para las organizaciones que priorizan la seguridad y el cumplimiento, Prompts.ai proporciona una plataforma segura y preparada para la empresa. Con sólidas funciones de gobernanza, garantiza un acceso controlado a las herramientas y los flujos de trabajo de inteligencia artificial, lo que ayuda a las empresas a cumplir las normas reglamentarias y, al mismo tiempo, a proteger sus datos.