लागत कम करने, तैनाती में तेजी लाने और दक्षता बढ़ाने के लिए मशीन लर्निंग (एमएल) मॉडल के प्रदर्शन में सुधार करना महत्वपूर्ण है। यह लेख ओवरफिटिंग, उच्च कम्प्यूटेशनल मांगों, और तैनाती की बाधाओं जैसी प्रमुख चुनौतियों को रेखांकित करता है, साथ ही उन्हें दूर करने के लिए सिद्ध रणनीतियों के बारे में बताता है।

अपने वर्कफ़्लो को बेंचमार्क करके शुरू करें, इन तरीकों से ऑप्टिमाइज़ करें, और मापने योग्य ROI के लिए परिणामों को ट्रैक करें।

स्केलिंग मशीन लर्निंग मॉडल अक्सर ऐसी बाधाएं लाते हैं जो उनकी सटीकता, दक्षता और विश्वसनीयता को प्रभावित करती हैं।

ओवरफिटिंग तब होती है जब एक मॉडल प्रशिक्षण डेटा के लिए अत्यधिक जटिल हो जाता है, अनिवार्य रूप से अनदेखी डेटा पर लागू होने वाले पैटर्न की पहचान करने के बजाय विशिष्ट उदाहरणों को याद रखता है। यह समस्या तब आम होती है जब डेटा अपर्याप्त या असंगत होता है। दूसरी ओर, अंडरफिटिंग तब होती है जब कोई मॉडल बहुत सरल होता है, डेटा में अंतर्निहित पैटर्न को समझने में विफल होता है, जिसके परिणामस्वरूप प्रशिक्षण और नए डेटासेट दोनों पर खराब प्रदर्शन होता है।

डीप लर्निंग मॉडल अपने जटिल आर्किटेक्चर और गहरी परतों के कारण पर्याप्त कंप्यूटिंग संसाधनों की मांग करते हैं। 32-बिट फ़्लोटिंग-पॉइंट सटीकता पर निर्भरता इन कम्प्यूटेशनल आवश्यकताओं को और बढ़ा देती है। एक साथ कई प्रशिक्षण नौकरियों का प्रबंधन करने वाले संगठनों के लिए, ये मांगें परिचालन खर्चों को तेजी से बढ़ा सकती हैं।

यहां तक कि प्रशिक्षण के दौरान उत्कृष्ट मॉडल भी सीमित संसाधनों वाले वातावरण में तैनात होने पर कठिनाइयों का सामना कर सकते हैं। जैसा कि इसके द्वारा हाइलाइट किया गया गूगल क्लाउड:

एलएलएम जो बहुत बड़े हैं, बड़े पैमाने पर प्रशिक्षण बुनियादी ढांचे पर अत्यधिक प्रदर्शन कर सकते हैं, लेकिन बहुत बड़े मॉडल मोबाइल उपकरणों जैसे क्षमता-बाधित वातावरण में अच्छा प्रदर्शन नहीं कर सकते हैं।

एज डिवाइस पर सीमित प्रोसेसिंग पावर और मेमोरी, सख्त लेटेंसी आवश्यकताओं और डेटा इनपुट और आउटपुट पर बाधाओं से चुनौतियां उत्पन्न होती हैं। इसके अलावा, कई GPU में स्केलिंग प्रशिक्षण में सिंक्रनाइज़ेशन में देरी और इंटर-जीपीयू संचार ओवरहेड की शुरुआत होती है, जो प्रदर्शन लाभ में बाधा डाल सकती है और सिस्टम की समग्र विश्वसनीयता को कम कर सकती है।

ये बाधाएं प्रदर्शन अनुकूलन के महत्व को रेखांकित करती हैं, जिसे अगले भाग में और खोजा जाएगा।

एमएल मॉडल ऑप्टिमाइज़ेशन तकनीक: प्रदर्शन और लागत बचत पर प्रभाव

बेहतर मशीन लर्निंग (एमएल) मॉडल के प्रदर्शन को प्राप्त करने में ऐसी तकनीकें शामिल हैं जो सटीकता को बढ़ाती हैं, संसाधनों की खपत को कम करती हैं और निर्बाध स्केलेबिलिटी को सक्षम करती हैं।

हाइपरपैरामीटर्स एक मॉडल के महत्वपूर्ण पहलुओं को निर्धारित करते हैं, जैसे कि सीखने की दर, वास्तुकला और जटिलता। प्रशिक्षण के दौरान सीखे गए मापदंडों के विपरीत, ओवरफिटिंग और अंडरफिटिंग को संतुलित करने के लिए हाइपरपैरामीटर को मैन्युअल रूप से समायोजित किया जाना चाहिए। लोकप्रिय तरीकों में शामिल हैं: ग्रिड सर्च, जो सभी संयोजनों का संपूर्ण परीक्षण करता है, और रैंडम सर्च, जो त्वरित परिणामों के लिए कॉन्फ़िगरेशन का नमूना लेता है। अधिक बुद्धिमान दृष्टिकोण के लिए, बायेसियन ऑप्टिमाइज़ेशन होनहार हाइपरपैरामीटर सेट की पहचान करने के लिए संभाव्य मॉडल का उपयोग करता है।

कंप्यूटर विज़न में बड़े पैमाने के मॉडल, विशेष रूप से गहरे तंत्रिका नेटवर्क के लिए, हाइपरबैंड बायेसियन तरीकों की तुलना में हाइपरपैरामीटर ट्यूनिंग को तीन गुना तक तेज कर सकता है। यहां तक कि हाइपरपैरामीटर में मामूली समायोजन से भी सटीकता में सुधार हो सकता है। प्लेटफ़ॉर्म जैसे अमेज़ॅन सेजमेकर बायेसियन सर्च और हाइपरबैंड के साथ स्वचालित ट्यूनिंग की पेशकश करके इस प्रक्रिया को सरल बनाएं। एक बार हाइपरपैरामीटर अनुकूलित हो जाने के बाद, इनपुट सुविधाओं पर ध्यान केंद्रित करने से प्रदर्शन में और वृद्धि हो सकती है।

आपके द्वारा किसी मॉडल को प्रदान की जाने वाली इनपुट सुविधाएँ इसकी सफलता में महत्वपूर्ण भूमिका निभाती हैं। बहुत कम सुविधाएं सामान्यीकरण में बाधा उत्पन्न कर सकती हैं, जबकि बहुत सी सुविधाएं अति-उपयुक्त और अनावश्यक जटिलता का कारण बन सकती हैं। ऐसी सुविधाएँ जो एक-दूसरे के साथ अत्यधिक सहसंबद्ध हैं या लक्ष्य चर के लिए अप्रासंगिक हैं, प्रदर्शन को खराब कर सकती हैं और मॉडल की व्याख्या को अस्पष्ट कर सकती हैं।

फ़ीचर चयन तकनीकें अनावश्यक या गैर-सूचनात्मक इनपुट को पहचानने और हटाने में मदद करती हैं। एक तरीका है सुविधाओं को पुनरावृत्त रूप से जोड़ना या हटाना, मॉडल के प्रदर्शन पर उनके प्रभाव का परीक्षण करना। जैसे टूल तेज (शेपली एडिटिव एक्सप्लेनेशन) मान प्रत्येक सुविधा के योगदान को निर्धारित कर सकता है, जिससे न्यूनतम प्रभाव वाले लोगों को समाप्त करना आसान हो जाता है। इसके अतिरिक्त, फ़ीचर स्केलिंग जैसी प्रीप्रोसेसिंग तकनीकें यह सुनिश्चित करती हैं कि अनुकूलन के दौरान इनपुट चर ठीक से संतुलित हों, जिससे मॉडल की स्थिरता में सुधार हो। लाइब्रेरी जैसे स्किकिट-लर्न कई फीचर चयन और प्रीप्रोसेसिंग विधियों के लिए सुलभ कार्यान्वयन प्रदान करें।

प्रूनिंग और क्वांटाइजेशन के माध्यम से मॉडल को सुव्यवस्थित करने से सटीकता बनाए रखते हुए कम्प्यूटेशनल मांगों को काफी कम किया जा सकता है।

प्रूनिंग मॉडल से अनावश्यक भार हटाता है। परिमाण-आधारित प्रूनिंग, इसके बाद फिर से प्रशिक्षण दिया जाता है, मापदंडों को 30-50% तक कम करते हुए प्रदर्शन को बनाए रख सकता है। यह प्रक्रिया न केवल मॉडल के आकार को कम करती है, बल्कि अनुमान को तेज़ और अधिक कुशल बनाती है।

परिमाणीकरण एक मॉडल में संख्यात्मक मानों की सटीकता को कम करता है। उदाहरण के लिए, 32-बिट फ़्लोटिंग-पॉइंट मानों को 16-बिट या 8-बिट पूर्णांक में परिवर्तित करने से पर्याप्त प्रदर्शन लाभ हो सकता है। NVIDIA A100 GPU पर, FP32 से BF16/FP16 तक सटीकता कम करने से सैद्धांतिक रूप से प्रदर्शन को 19.5 TFLOPS से 312 TFLOPS तक बढ़ाया जा सकता है - एक 16× सुधार। भाषा मॉडल प्रशिक्षण में, कम सटीक डेटा प्रकारों का उपयोग करने से टोकन थ्रूपुट में 15% की वृद्धि देखी गई है। परिमाणीकरण आमतौर पर न्यूनतम सटीकता हानि (आमतौर पर 2% से कम) के साथ मॉडल के आकार को 75-80% तक कम कर देता है। हालांकि प्रशिक्षण के बाद का परिमाणीकरण सरल है, लेकिन यह सटीकता को थोड़ा प्रभावित कर सकता है; परिमाणीकरण-जागरूक प्रशिक्षण प्रशिक्षण चरण के दौरान सटीक बाधाओं पर विचार करके, प्रदर्शन को अधिक प्रभावी ढंग से संरक्षित करके इसका समाधान करता है।

प्रूनिंग और क्वांटिज़ेशन के संयोजन से और भी अधिक लाभ मिल सकते हैं। उदाहरण के लिए, एक प्रमुख बैंक ने इन तरीकों का उपयोग करके अनुमान लगाने में लगने वाले समय में 73% की कमी की। ऐसे मॉडल जो प्रूनिंग के बाद क्वांटाइजेशन से गुजरते हैं, वे अक्सर अपने मूल समकक्षों की तुलना में 4—5× छोटे और 2—3× तेज होते हैं। यह सुनिश्चित करने के लिए कि ये ऑप्टिमाइज़ेशन वास्तविक दुनिया के लाभ प्रदान करते हैं, पूरी प्रक्रिया के दौरान अनुमान समय, मेमोरी उपयोग और FLOPS जैसे मेट्रिक्स को बेंचमार्क करना आवश्यक है।

उन्नत उपकरण मशीन लर्निंग वर्कफ़्लो को अगले स्तर तक ले जाते हैं, जिससे प्रशिक्षण, अनुमान और परिनियोजन प्रक्रियाओं में सुधार होता है। ये उपकरण सामान्य उत्पादन चुनौतियों का समाधान करते हैं, जिससे टीमों को तैनाती में तेजी लाने और उच्च सटीकता बनाए रखते हुए स्केलेबल, कुशल सिस्टम बनाने में मदद मिलती है।

XGBoost प्रतिगमन, वर्गीकरण और क्लस्टरिंग जैसे संरचित डेटा कार्यों के लिए एक असाधारण विकल्प है। बड़े डेटासेट को कुशलतापूर्वक संभालने और उच्च प्रदर्शन देने की इसकी क्षमता इसे कई मशीन लर्निंग प्रैक्टिशनर्स के लिए एक उपयोगी टूल बनाती है।

ट्रांसफर लर्निंग पूर्व-प्रशिक्षित मॉडल का लाभ उठाता है, जैसे रेसनेट -50 पर प्रशिक्षित इमेजनेट, विशिष्ट कार्यों के लिए फाइन-ट्यूनिंग की प्रक्रिया को सरल और तेज करने के लिए। सीमित प्रशिक्षण डेटा के साथ काम करते समय यह दृष्टिकोण विशेष रूप से सहायक होता है, क्योंकि यह प्रदर्शन को बढ़ाने के लिए बड़े, विविध डेटासेट से सीखे गए पैटर्न का उपयोग करता है। हालांकि, यह ध्यान रखना महत्वपूर्ण है कि पूर्व-प्रशिक्षित मॉडल कभी-कभी अपने मूल प्रशिक्षण डेटा से पक्षपात कर सकते हैं।

TensorRT अनुमान के लिए गहन शिक्षण मॉडल को अनुकूलित करने, थ्रूपुट बढ़ाने और विलंबता को कम करने के लिए डिज़ाइन किया गया है। यह इसे उच्च प्रदर्शन वाले अनुप्रयोगों के लिए आदर्श बनाता है।

ONNX रनटाइम जैसे फ्रेमवर्क से मॉडल को तैनात करने के लिए एक बहुमुखी, क्रॉस-प्लेटफ़ॉर्म समाधान प्रदान करता है PyTorch, टेंसरफ़्लो/केरस, फ़्लाइट, और स्किकिट-लर्न। यह कई हार्डवेयर और प्रोग्रामिंग परिवेशों में परिनियोजन का समर्थन करता है, जिसमें पायथन, C #, C ++, और Java शामिल हैं। दोनों उपकरण अनुमान दक्षता को बढ़ाते हैं और उत्पादन सेटिंग्स में संसाधनों का इष्टतम उपयोग सुनिश्चित करते हैं।

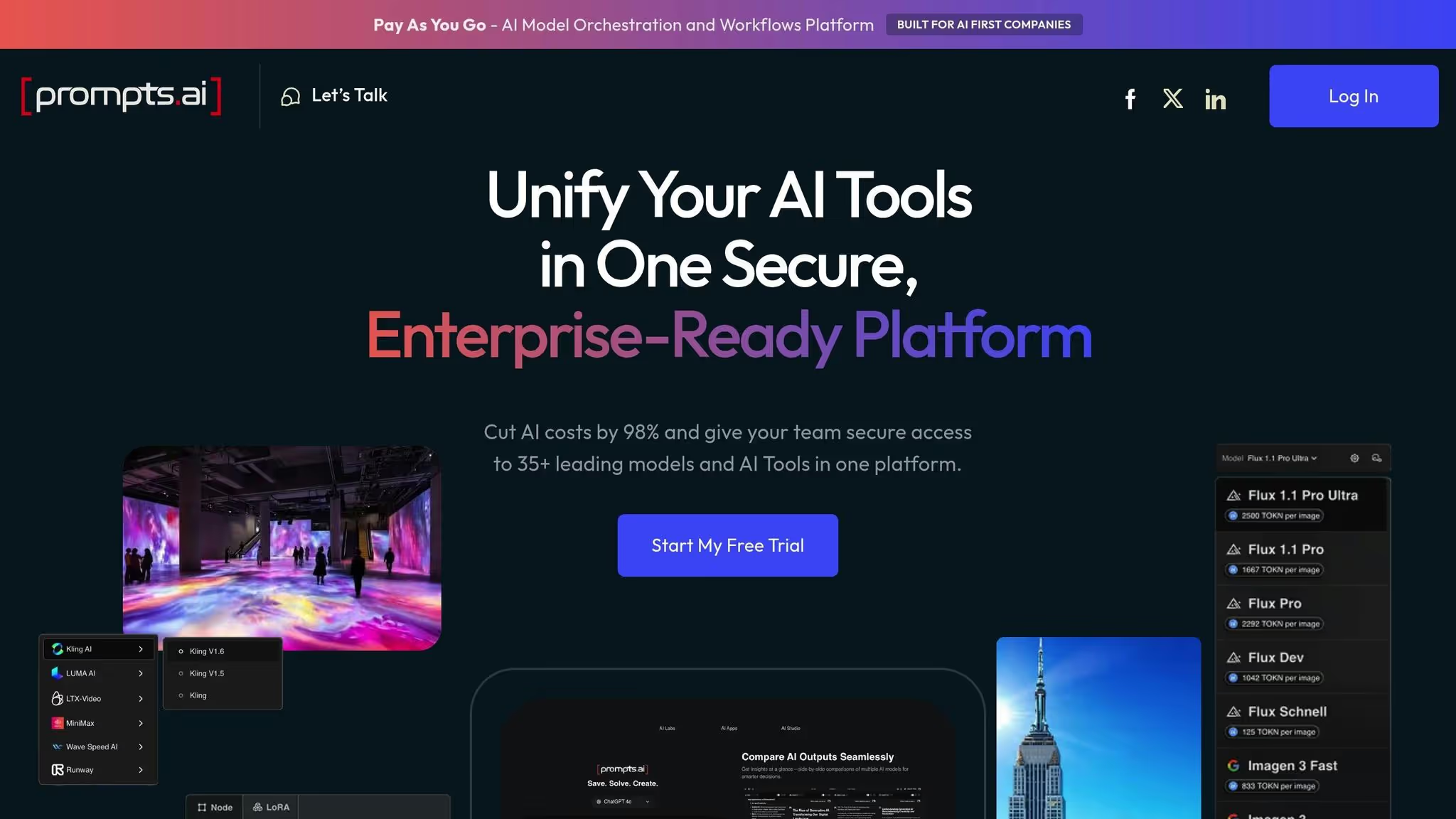

कई AI मॉडल और टूल को प्रबंधित करने से मशीन लर्निंग (ML) टीमों के लिए लागत और जटिलता तेजी से बढ़ सकती है। इससे निपटने के लिए, ऑर्केस्ट्रेशन प्लेटफ़ॉर्म संचालन को सुव्यवस्थित करने और प्रदर्शन को बेहतर बनाने में महत्वपूर्ण भूमिका निभाते हैं। Prompts.ai मॉडल एक्सेस को केंद्रीकृत करने, शासन को लागू करने और AI खर्च की निगरानी करने के लिए एकल इंटरफ़ेस की पेशकश करके इन चुनौतियों को सरल बनाता है।

Prompts.ai 35 से अधिक प्रमुख AI मॉडल तक पहुंच को एकीकृत करके मॉडल प्रबंधन का अनुकूलन करता है - जिसमें शामिल हैं जीपीटी-5, क्लाउड, युग्म, और लामा - एकल API के माध्यम से। मॉडल के बीच स्विच करना उतना ही सरल है जितना कि कॉन्फ़िगरेशन सेटिंग को एडजस्ट करना। प्लेटफ़ॉर्म में एक संस्करणित प्रॉम्प्ट टेम्पलेट लाइब्रेरी भी शामिल है, जो टीमों को सभी विभागों में प्रभावी वर्कफ़्लो का पुन: उपयोग करने में सक्षम बनाती है। उदाहरण के लिए, एक यूएस-आधारित ग्राहक सहायता टीम एक वर्कफ़्लो सेट कर सकती है, जो ज्ञान-आधारित लेखों को पुनर्प्राप्त करती है, जटिलता के आधार पर प्रश्नों को सबसे अधिक लागत-कुशल मॉडल तक ले जाती है, संवेदनशील डेटा की जांच करती है, और हर इंटरैक्शन को लॉग करती है। यह सेटअप टीमों को उत्पादन में स्थिर संस्करण रखते हुए, गहन मूल्यांकन के बाद ही अपडेट को बढ़ावा देते हुए, स्टेजिंग वातावरण में नए मॉडल का परीक्षण करने की अनुमति देता है।

Prompts.ai वित्तीय संचालन को सीधे AI वर्कफ़्लो में एकीकृत करता है, जो मॉडल, टीम और प्रोजेक्ट द्वारा खर्च की रीयल-टाइम ट्रैकिंग प्रदान करता है। डैशबोर्ड यूएसडी में लागत पेश करते हैं, जिसमें दिन या घंटे के हिसाब से विस्तृत ब्रेकडाउन होते हैं, जो टोकन के उपयोग और प्रदाता मूल्य निर्धारण को दर्शाते हैं। संगठन बजट सेट कर सकते हैं - उदाहरण के लिए, बिक्री परियोजना को $25,000 प्रति माह तक सीमित करना - और खर्च सीमा के 75%, 90% या 100% तक पहुंचने पर अलर्ट प्राप्त कर सकते हैं। डायनामिक रूटिंग नियम महत्वपूर्ण कार्यों के लिए प्रीमियम विकल्पों को आरक्षित करते हुए अधिक किफायती मॉडल को कम जोखिम वाले कार्य सौंपकर लागतों को और बेहतर बनाते हैं। मॉडल के उपयोग को व्यावसायिक परिणामों से जोड़कर, प्लेटफ़ॉर्म लागत-प्रति-परिणाम मेट्रिक्स की गणना करता है, जिससे निर्णय लेने वालों को निवेश पर लाभ (ROI) का आकलन करने में मदद मिलती है। लागत नियंत्रण का यह स्तर बेंचमार्किंग का भी समर्थन करता है और अनुपालन सुनिश्चित करता है।

Prompts.ai टीमों को वास्तविक वर्कलोड और यूएस-विशिष्ट संकेतों, जैसे डॉलर-आधारित मूल्य निर्धारण और MM/DD/YYYY दिनांक स्वरूपों का उपयोग करके मॉडल को साथ-साथ बेंचमार्क करने की अनुमति देता है। लेटेंसी (p95 रिस्पॉन्स टाइम), लागत प्रति 1,000 टोकन, और गुणवत्ता स्कोर जैसे मेट्रिक्स कार्रवाई योग्य जानकारी प्रदान करते हैं। उदाहरण के लिए, तुलना से पता चलता है कि नीतिगत निर्णयों का मार्गदर्शन करने वाले अनुपालन-संवेदनशील प्रश्नों के लिए एक मॉडल 28% सस्ता है, लेकिन अनुपालन-संवेदनशील प्रश्नों के लिए 6% कम सटीक है। अनुपालन के मोर्चे पर, प्लेटफ़ॉर्म भूमिका-आधारित अभिगम नियंत्रण को लागू करता है और संवेदनशील वर्कफ़्लो संशोधनों को अधिकृत उपयोगकर्ताओं तक सीमित करने के लिए सिंगल साइन-ऑन (SSO) के साथ एकीकृत करता है। अंतर्निहित रेलिंग बाहरी मॉडल को संवेदनशील डेटा तक पहुँचने से रोकते हैं, जबकि केंद्रीकृत ऑडिट लॉग SOC 2, HIPAA और अन्य विनियामक समीक्षाओं का समर्थन करते हैं। Prompts.ai ने 19 जून, 2025 को अपनी SOC 2 टाइप 2 ऑडिट प्रक्रिया शुरू की, और अपनी सुरक्षा स्थिति पर रीयल-टाइम अपडेट के लिए एक पब्लिक ट्रस्ट सेंटर का रखरखाव करता है।

मशीन लर्निंग मॉडल के प्रदर्शन में सुधार करना केवल एक तकनीकी आवश्यकता नहीं है - यह सीधे आपकी निचली रेखा को प्रभावित करता है। सिद्ध अनुकूलन रणनीतियों का लाभ उठाकर, व्यवसाय मॉडल की सटीकता को 15-40% तक बढ़ा सकते हैं जबकि अनुमान लागत में 30-70% की कमी कर सकते हैं। उदाहरण के लिए, मासिक रूप से 50 मिलियन भविष्यवाणियों को संभालने वाली एक अमेरिकी कंपनी मानक क्लाउड GPU मूल्य निर्धारण पर TensorRT या ONNX रनटाइम जैसे अनुकूलित रनटाइम पर स्विच करके सालाना सैकड़ों हजारों डॉलर बचा सकती है।

मुख्य चुनौती प्रत्येक उपयोग के मामले के लिए सटीकता, गति और लागत को संतुलित करने में निहित है। उदाहरण के तौर पर एक मोबाइल बैंकिंग ऐप लें - यह लेटेंसी को कम करने और लाखों डिवाइसों में बैटरी लाइफ को बचाने के लिए काट-छांट या क्वांटिज़्ड मॉडल को प्राथमिकता दे सकता है। इस बीच, धोखाधड़ी का पता लगाने वाली प्रणाली महत्वपूर्ण लेनदेन के लिए उच्च सटीकता वाले मॉडल आरक्षित कर सकती है, और अधिक लागत प्रभावी विकल्पों के माध्यम से कम जोखिम वाले प्रश्नों को रूट कर सकती है। Prompts.ai मॉडल चयन और लागत ट्रैकिंग को केंद्रीकृत करके इस निर्णय लेने की प्रक्रिया को सरल बनाता है, जिससे इन ट्रेड-ऑफ़ को प्रबंधित करना आसान हो जाता है।

रिटर्न प्राप्त करना शुरू करने के लिए, 1—3 प्रमुख ML वर्कफ़्लो में अपने वर्तमान प्रदर्शन और लागतों को बेंचमार्क करके प्रारंभ करें। त्वरित जीत हासिल करने के लिए, प्राप्त करने योग्य सुधारों पर ध्यान दें, जैसे कि हाइपरपैरामीटर ट्यूनिंग या अनुकूलित रनटाइम अपनाना। इन वर्कफ़्लो को Prompts.ai में एकीकृत करने से आप प्रदर्शन मेट्रिक्स की निगरानी कर सकते हैं, काट-छांट या डिस्टिल्ड मॉडल के साथ प्रयोग कर सकते हैं, और मॉडल के उपयोग को सीधे व्यावसायिक परिणामों से जोड़ सकते हैं - चाहे वह प्रति पूर्वानुमान लागत कम करना हो, लेटेंसी SLAs को पूरा करना हो, या प्रति विज़िटर राजस्व बढ़ाना हो। इन प्रयासों से आपको 6-18 महीनों की पेबैक अवधि का अनुमान लगाने में मदद मिल सकती है।

इन तात्कालिक अनुकूलन के अलावा, Prompts.ai दीर्घकालिक शासन और स्केलेबल रिटर्न के लिए एक ढांचा प्रदान करता है। एक ही मंच के तहत वित्त, जोखिम और इंजीनियरिंग टीमों को एकीकृत करके, यह AI खर्च प्रबंधन और अनुपालन को संस्थागत बनाता है। सेंट्रलाइज्ड ऑडिट लॉग, रोल-बेस्ड एक्सेस कंट्रोल और बिल्ट-इन गार्डराइल जैसी सुविधाएं यह सुनिश्चित करती हैं कि केवल जांचे गए, उच्च प्रदर्शन करने वाले मॉडल ही प्रोडक्शन में जगह बना सकें। यह सुव्यवस्थित दृष्टिकोण अलग-अलग सुधारों को दोहराने योग्य, स्केलेबल प्रक्रिया में बदल देता है, जिससे मॉडल प्रदर्शन और संगठनात्मक अनुपालन दोनों में वृद्धि होती है। नतीजा क्या है? आपके पूरे उद्यम में मूर्त उत्पादकता लाभ और औसत दर्जे का ROI।

हाइपरपैरामीटर ट्यूनिंग में मशीन लर्निंग मॉडल की सेटिंग्स को ठीक से ट्यून करना शामिल है - जैसे सीखने की दर, बैच का आकार, या परतों की संख्या - इसके प्रदर्शन को बेहतर बनाने के लिए। विभिन्न संयोजनों के साथ व्यवस्थित रूप से प्रयोग करके, आप मॉडल की सटीकता को बढ़ा सकते हैं और यह सुनिश्चित कर सकते हैं कि यह अनदेखे डेटा के लिए प्रभावी रूप से सामान्यीकृत हो।

जब सही तरीके से किया जाता है, तो ट्यूनिंग त्रुटियों को कम करती है और ओवरफिटिंग से बचाती है, जिससे मॉडल को केवल प्रशिक्षण डेटासेट से परे मज़बूती से प्रदर्शन करने में मदद मिलती है। ग्रिड सर्च, रैंडम सर्च या स्वचालित फ़्रेमवर्क का उपयोग करने जैसी तकनीकें इस ऑप्टिमाइज़ेशन प्रक्रिया को सरल और तेज़ कर सकती हैं।

प्रदर्शन और दक्षता के लिए मशीन लर्निंग मॉडल को अनुकूलित करने में अक्सर दो प्रमुख तकनीकें शामिल होती हैं: कामुकता और परिमाणीकरण।

प्रूनिंग उन मापदंडों को हटाकर एक मॉडल को कम करने पर ध्यान केंद्रित करता है जो आवश्यक नहीं हैं। मॉडल के आकार और जटिलता को कम करके, यह तेज़ी से गणना करता है और कम संसाधनों का उपयोग करता है, जबकि यह सब निकट-मूल स्तरों पर सटीकता बनाए रखता है।

परिमाणीकरण मॉडल वेट और एक्टिवेशन के लिए कम-सटीक डेटा प्रकारों का उपयोग करके मेमोरी और कम्प्यूटेशनल मांगों से निपटता है - जैसे 32-बिट से 8-बिट पर स्विच करना। यह दृष्टिकोण न केवल अनुमान को तेज करता है, बल्कि यह भी सुनिश्चित करता है कि मॉडल स्मार्टफ़ोन या एज डिवाइस जैसे हार्डवेयर-बाधित डिवाइसों पर प्रभावी ढंग से चल सके।

Prompts.ai इसके साथ खर्चों के प्रबंधन को सरल बनाता है पे-एज़-यू-गो सिस्टम, 35 से अधिक AI मॉडल तक पहुंच प्रदान करता है। यह दृष्टिकोण उपयोगकर्ताओं को लागत को 98% तक कम करने की अनुमति देता है, केवल उसी चीज का भुगतान करता है जो वे वास्तव में उपयोग करते हैं। शक्तिशाली टूल तक पहुंच का त्याग किए बिना बजट को नियंत्रण में रखने का यह एक स्मार्ट तरीका है।

सुरक्षा और अनुपालन को प्राथमिकता देने वाले संगठनों के लिए, Prompts.ai एक प्रदान करता है सुरक्षित, एंटरप्राइज़-तैयार प्लेटफ़ॉर्म। मजबूत गवर्नेंस सुविधाओं के साथ, यह AI टूल और वर्कफ़्लो तक नियंत्रित पहुंच सुनिश्चित करता है, जिससे व्यवसायों को अपने डेटा की सुरक्षा करते हुए विनियामक मानकों को पूरा करने में मदद मिलती है।