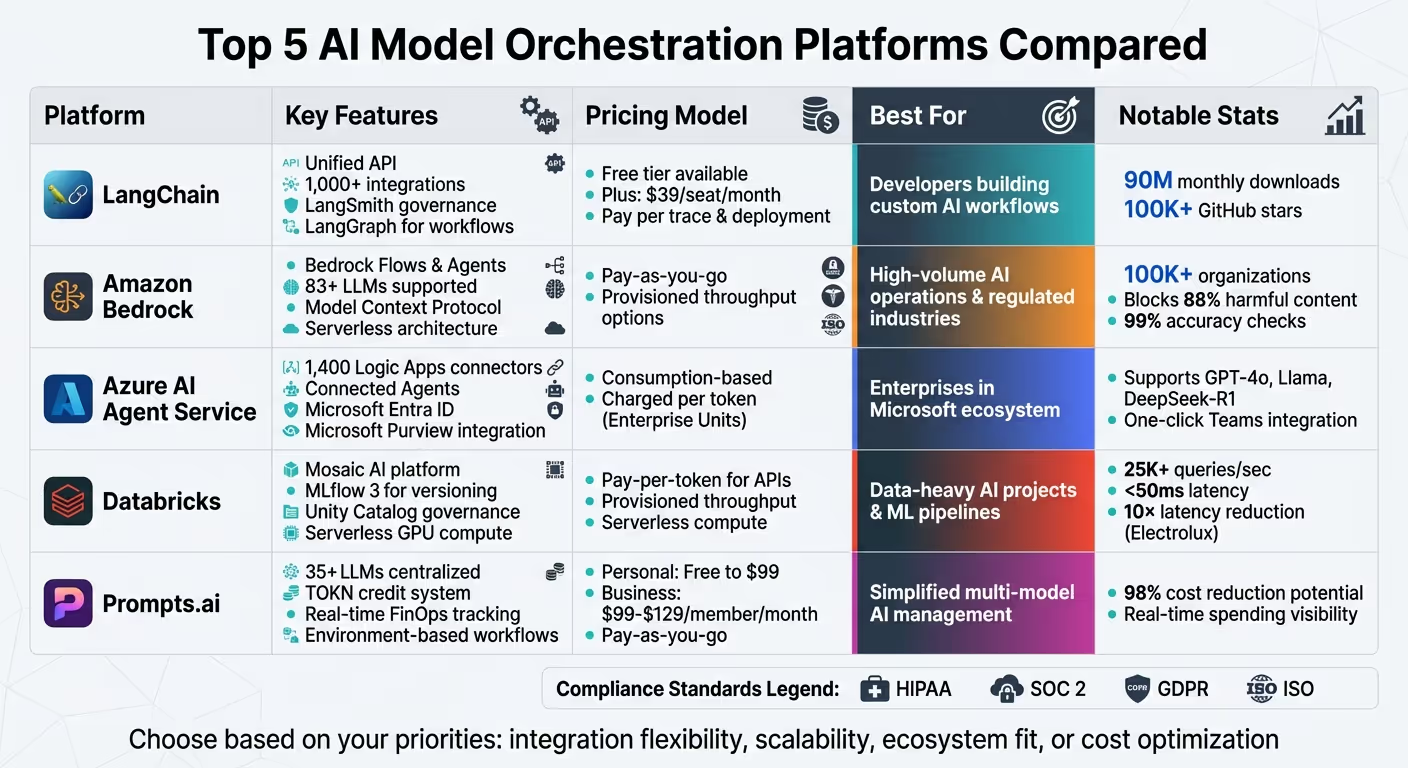

Les plateformes d'orchestration de modèles d'IA sont essentielles pour gérer efficacement plusieurs outils, modèles et flux de travail d'IA. Ces plateformes simplifient l'intégration, automatisent les processus et garantissent la gouvernance, ce qui les rend indispensables aux organisations qui font évoluer leurs opérations d'IA. Vous trouverez ci-dessous un bref aperçu des cinq principales plateformes et de leurs caractéristiques remarquables :

Chaque plateforme répond à des besoins différents, qu'il s'agisse d'outils destinés aux développeurs ou de solutions à l'échelle de l'entreprise. Choisissez en fonction des priorités de votre organisation, telles que l'intégration, l'évolutivité ou la rentabilité.

Ces plateformes rationalisent les opérations d'IA, réduisent les coûts et améliorent l'efficacité des flux de travail, ce qui en fait des outils essentiels pour les entreprises modernes.

Comparaison des plateformes d'orchestration de modèles d'IA : fonctionnalités, prix et meilleurs cas d'utilisation

LangChain est le #1 Framework d'agents le plus téléchargé au monde, avec plus de 90 millions de téléchargements mensuels et plus de 100 000 étoiles sur GitHub. Il s'agit d'un choix fiable pour les développeurs qui souhaitent créer rapidement des flux de travail d'IA sans être liés à un seul fournisseur.

LangChain simplifie l'intégration des modèles grâce à un API unifiée qui normalise les interactions entre les fournisseurs. Que vous utilisiez IA ouverte, Anthropique, ou Gemini de Google, le passage de l'un à l'autre est fluide. Les développeurs peuvent se connecter aux principaux fournisseurs et créer des agents fonctionnels avec seulement 10 lignes de code. La plateforme prend en charge plus de 1 000 intégrations, couvrant les sources de données, les services cloud et les outils spécialisés. Pour ceux qui travaillent sur la génération augmentée de récupération (RAG), LangChain offre une intégration fluide avec les bases de données vectorielles et les chargeurs de documents, permettant aux modèles de traiter des données propriétaires ou en temps réel sans formation supplémentaire. Cette connectivité étendue est la pierre angulaire de l'évolutivité de LangChain.

LangChain est conçu pour gérer les opérations à l'échelle de l'entreprise via mise à l'échelle horizontale, soutenu par des files d'attente de tâches optimisées. Son infrastructure prend en charge les flux de travail des agents de longue durée qui peuvent s'étendre sur des heures, voire des jours, avec des fonctionnalités de dimensionnement automatique adaptées à ces demandes. Comme l'explique LangChain :

L'infrastructure standard ne peut pas gérer les charges de travail des agents de longue durée qui nécessitent une collaboration humaine. Déployez avec des API qui gèrent la mémoire, la mise à l'échelle automatique et la sécurité de l'entreprise.

La plateforme est alimentée par LangGraph, qui garantit une exécution durable et permet des points de contrôle personnalisés pour maintenir l'état des processus complexes.

LangChain propose une tarification flexible pour répondre à différents besoins. Le Plan pour développeurs est gratuit, y compris 1 siège et 5 000 traces de base par mois. Le Forfait Plus coûte 39$ par siège par mois, fournissant 10 000 traces de base, un déploiement de développement gratuit et des exécutions d'agents supplémentaires à 0,005$ par exécution. Pour les déploiements en production, la disponibilité est facturée à 0,0036 USD par minute. Les équipes peuvent encore réduire les coûts en utilisant des traces de base (rétention de 14 jours à 0,50 USD pour 1 000 traces) pour le débogage de gros volumes et en réservant des traces étendues (rétention de 400 jours à 5 USD pour 1 000 traces) pour obtenir de précieuses données de feedback utilisées pour affiner le modèle. Outre la rentabilité, LangChain garantit une gouvernance et une sécurité robustes.

LangSmith, le système d'observabilité et de déploiement de LangChain, adhère à HIPAA, SOC 2 Type 2 et RGPD normes de conformité, offrant des informations détaillées sur le comportement des agents grâce au suivi des exécutions, aux transitions d'état et aux mesures d'exécution. LangGraph prend également en charge les flux de travail humains, permettant une intervention et une approbation manuelles pour les tâches sensibles. Les entreprises clientes bénéficient d'une flexibilité de déploiement, avec des options pour des configurations basées sur le cloud, hybrides (plan de contrôle SaaS avec plan de données auto-hébergé) ou entièrement auto-hébergées au sein de leur propre VPC.

Amazon Bedrock prend en charge l'IA générative pour plus de 100 000 organisations, qui propose une plateforme sans serveur entièrement gérée qui élimine le besoin de gérer l'infrastructure. Cela permet aux utilisateurs de faire évoluer les applications d'IA de manière fluide, selon les besoins.

Amazon Bedrock propose trois méthodes distinctes pour intégrer les flux de travail d'IA :

Le protocole MCP (Model Context Protocol) de Bedrock améliore encore l'intégration en convertissant les API et les fonctions Lambda existantes en outils compatibles MCP. Cela permet aux agents d'interagir avec les systèmes de l'entreprise tels que Salesforce, Slack, et JIRA avec un minimum d'effort de codage. Ces options d'intégration offrent flexibilité et adaptabilité pour diverses applications d'IA.

En 2024, Robinhood a démontré l'évolutivité de Bedrock en augmentant ses opérations d'IA de 500 millions à 5 milliards de jetons par jour en six mois seulement. Modèles distillés hébergés sur Bedrock run cinq fois plus rapide et coûtent jusqu'à 75 % de moins par rapport à leurs homologues d'origine. En outre, le routage rapide intelligent peut réduire les coûts jusqu'à 30 %, tout en préservant la qualité de sortie. Cette évolutivité est également soutenue par le modèle de tarification basé sur la consommation de Bedrock.

Bedrock fonctionne selon un modèle de paiement à l'utilisation, ce qui signifie que les utilisateurs sont facturés en fonction de l'utilisation des ressources. Par exemple, dans Bedrock Flows, les coûts sont liés aux ressources spécifiques invoquées, comme un modèle Titan utilisé dans un nœud prompt. Les organisations dont les charges de travail sont importantes peuvent opter pour un débit provisionné et bénéficier de capacités dédiées à des tarifs réduits. Robinhood a tiré parti de l'infrastructure de Bedrock pour réduire ses coûts d'IA en 80 % et réduisez de moitié le temps de développement. Dev Tagare, responsable de l'IA chez Robinhood, a souligné les points forts de Bedrock :

Les fonctionnalités de diversité des modèles, de sécurité et de conformité d'Amazon Bedrock sont spécialement conçues pour les secteurs réglementés.

Amazon Bedrock donne la priorité à la sécurité et à la conformité des données. Les données des clients ne sont jamais partagées avec des fournisseurs de modèles tiers ni utilisées pour former des modèles de base. Les organisations conservent le contrôle total de leurs clés de chiffrement via AWS Key Management Service. Les garanties supplémentaires incluent :

La plateforme répond à des normes rigoureuses, notamment ISO, SOC, GDPR et FedRAMP High, et est éligible à la HIPAA. Des politiques IAM précises permettent de contrôler les actions des utilisateurs et l'accès aux ressources, tout en AWS CloudTrail et Amazon CloudWatch l'intégration permet une surveillance et un audit détaillés. Ces fonctionnalités font de Bedrock un choix sûr et fiable pour les organisations qui gèrent des données sensibles.

Le service Azure AI Agent, qui fait partie de Microsoft Foundry, fait office de plateforme d'orchestration centralisée qui regroupe des modèles, des outils et des cadres au sein d'un système unifié. Ce service simplifie les opérations en gérant automatiquement l'état des conversations et les appels aux outils, éliminant ainsi toute intervention manuelle. Microsoft décrit son objectif comme suit :

Foundry Agent Service connecte les éléments essentiels de Foundry, tels que les modèles, les outils et les frameworks, en un seul environnement d'exécution... Ces activités permettent de s'assurer que les agents sont sécurisés, évolutifs et prêts pour la production.

Cette plateforme se distingue par sa capacité à intégrer des modèles et des outils sans effort. Il prend en charge un large éventail de grands modèles linguistiques, notamment Azure OpenAI (GPT-4o, GPT-4, GPT-3.5), Llama et DeepSeek-R1. À travers 1 400 Applications Azure Logic connecteurs, les utilisateurs peuvent accéder directement à des systèmes tels que SharePoint, Tissu Microsoftet des API personnalisées. Pour améliorer la sécurité et l'interopérabilité, la plateforme utilise le Protocole de contexte modèle (MCP) pour connecter les agents à des outils personnalisés et à des API.

L'une des caractéristiques les plus remarquables est Agents connectés, qui permet à un orchestrateur principal d'attribuer des tâches à des sous-agents spécialisés à l'aide du routage en langage naturel. Cela élimine le besoin d'une logique codée en dur, bien que les agents parents ne puissent déléguer des tâches qu'à des sous-agents. Pour les configurations plus complexes, la création de sous-agents ciblés et réutilisables simplifie la maintenance et le débogage, au lieu de surcharger un seul agent doté de multiples fonctionnalités.

Azure AI Agent Service prend en charge les agents conteneurisés créés avec des frameworks tels que LangGraph, permettant opérations évolutives pour gérer différentes charges de travail. Les agents peuvent passer automatiquement à une région secondaire à l'aide de la fonction provisionnée par le client Base de données Azure Cosmos tient compte des interruptions de service dans la région principale. Microsoft souligne que cette fonctionnalité est essentielle à la préparation des entreprises :

Déployez et orchestrez des agents d'IA à grande échelle, gérés, observables et intégrés pour la transformation de l'entreprise.

Le service propose également intégration en un clic avec Microsoft Teams et Copilote Microsoft 365 pour un déploiement rapide. L'exécution côté serveur avec de nouvelles tentatives automatiques pour les appels d'outils réduit les demandes de traitement côté client lors d'opérations à grande échelle.

La plateforme fonctionne sur modèle de tarification basé sur la consommation, facturant en fonction du nombre de jetons traités par chaque action de l'agent. Ces coûts apparaissent sous la forme d' « unités d'entreprise » sur les factures. Pour les flux de travail créés avec Azure Logic Apps, les utilisateurs ne paient que les frais d'application logiques standard, tandis que l'utilisation de modèles d'IA (comme Azure OpenAI) entraîne des frais distincts. Cette structure tarifaire flexible permet aux organisations de développer leurs opérations d'IA sans investissements initiaux importants.

Chaque agent se voit attribuer un numéro unique ID d'agent Microsoft Entra, permettant une gestion précise des identités, un contrôle d'accès et une application des politiques. Le service s'intègre à Microsoft Purview pour appliquer des politiques de prévention des pertes de données, des étiquettes de sensibilité et garantir la conformité aux règles de résidence des données. Filtrage en temps réel via Sécurité du contenu Azure AI aide à atténuer les risques tels que les injections rapides et les tentatives de jailbreak.

Pour plus de sécurité, les déploiements bénéficient de l'isolation du réseau via Azure Virtual Networks et des points de terminaison privés. Le Agent d'équipe AI Red permet aux entreprises de simuler des attaques potentielles et d'identifier les vulnérabilités avant le déploiement complet. Journalisation centralisée, alimentée par Azure Log Analytics et Informations sur les applications, garantit une traçabilité complète des conversations et de l'utilisation des outils à des fins d'audit. Le service est conforme aux principales normes internationales, notamment RGPD, HIPAA, ISO et SOC.

Databricks associe l'ingénierie des données, l'apprentissage automatique et l'orchestration de l'IA via sa plateforme Mosaic AI. Avec Mosaic AI Model Serving, les utilisateurs peuvent déployer à la fois des modèles classiques et de base, ainsi que des agents d'IA, via une API REST unifiée. Lakeflow Jobs simplifie davantage les processus en automatisant les flux de travail ETL, analytiques et AI à l'aide d'une structure DAG.

Databricks prend en charge plus de 25 000 requêtes par seconde avec une latence de moins de 50 millisecondes. Les modèles peuvent être intégrés dans des flux de travail analytiques à l'aide de Databricks SQL pour l'inférence par lots ou des API REST standard pour les applications en temps réel. Le Mosaic AI Agent Framework permet de développer des applications de génération augmentée par extraction et prêtes à être utilisées en production, tandis que Mosaic AI Gateway gère les limites de débit et surveille la qualité des modèles auprès de fournisseurs tels qu'OpenAI et Anthropic.

Pour la gestion des modèles, Databricks utilise une version gérée de MLflow 3, qui gère le suivi des expériences, la gestion des versions des modèles et la gestion du cycle de vie des déploiements via Deployment Jobs. En outre, l'AI Playground propose une interface semblable à un chat pour tester et comparer différents modèles linguistiques de grande taille.

« Databricks Model Serving accélère nos projets pilotés par l'IA en facilitant l'accès et la gestion sécurisés de plusieurs modèles SaaS et ouverts, y compris ceux hébergés sur ou en dehors de Databricks. »

- Greg Rokita, vice-président en charge de la technologie chez Edmunds.com

Ce cadre d'intégration garantit une évolutivité et une adaptabilité fluides pour répondre à divers besoins.

Databricks utilise le calcul GPU sans serveur pour prendre en charge les tâches d'apprentissage profond à nœud unique et multi-nœuds, en travaillant avec des frameworks tels que PyTorch, TensorFlow, et Keras pour la formation et la mise au point à grande échelle. Intégration avec Ray sur Databricks permet aux charges de travail d'apprentissage automatique d'évoluer dans des environnements distribués, ce qui est particulièrement bénéfique pour la formation intensive des modèles et l'inférence. Les terminaux des modèles s'ajustent automatiquement pour répondre à la demande, en partant de zéro et en redescendant pour réduire les coûts. Par exemple, en 2024, Electrolux a unifié sa plateforme de données et d'IA, multipliant par 10 la latence d'inférence et réduisant les frais de maintenance.

Databricks propose des options de tarification flexibles pour équilibrer performances et coûts. Son modèle de paiement par jeton pour les API Foundation Model permet aux utilisateurs d'accéder à des modèles sélectionnés comme Llama sans engagement initial. Pour les charges de travail nécessitant des garanties de performances spécifiques ou des modèles affinés, le débit provisionné est disponible. Les options de calcul sans serveur permettent une tarification à l'utilisation pour les services de modèles et Lakeflow Jobs, avec la possibilité de passer à zéro pour éliminer les coûts d'inactivité. Les espaces de travail peuvent gérer jusqu'à 2 000 exécutions de tâches simultanées et enregistrer 12 000 tâches. Lakeflow Jobs inclut également une fonction « Réparer et réexécuter », qui permet de réessayer uniquement les nœuds défaillants d'un flux de travail, ce qui permet d'économiser du temps et des ressources. Le prix de ces tâches dépend des ressources de calcul utilisées, en fonction du forfait, du fournisseur de cloud et de la configuration du cluster.

Catalogue Unity agit comme une couche de gouvernance centralisée pour gérer toutes les données et tous les actifs d'IA, y compris les données structurées et non structurées, les modèles d'apprentissage automatique, les blocs-notes et les fonctions. Les organisations peuvent définir des politiques d'accès au niveau du compte et les appliquer à toutes les charges de travail. Le système prend en charge les filtres au niveau des lignes et les masques de colonnes à l'aide de la norme ANSI SQL, garantissant que les utilisateurs n'accèdent qu'aux données autorisées. Les données sont protégées par le cryptage AES-256 au repos et le cryptage TLS 1.2+ pendant le transit.

La plateforme est conforme aux principales réglementations telles que le RGPD, le CCPA, l'HIPAA, le BCBS 239 et la SOX. En outre, le lignage de bout en bout permet de suivre les données depuis leur origine jusqu'à leur destination finale, y compris le lignage des modèles, qui identifie la version spécifique de l'ensemble de données utilisée pour la formation et l'évaluation. Cette approche globale garantit à la fois sécurité et transparence.

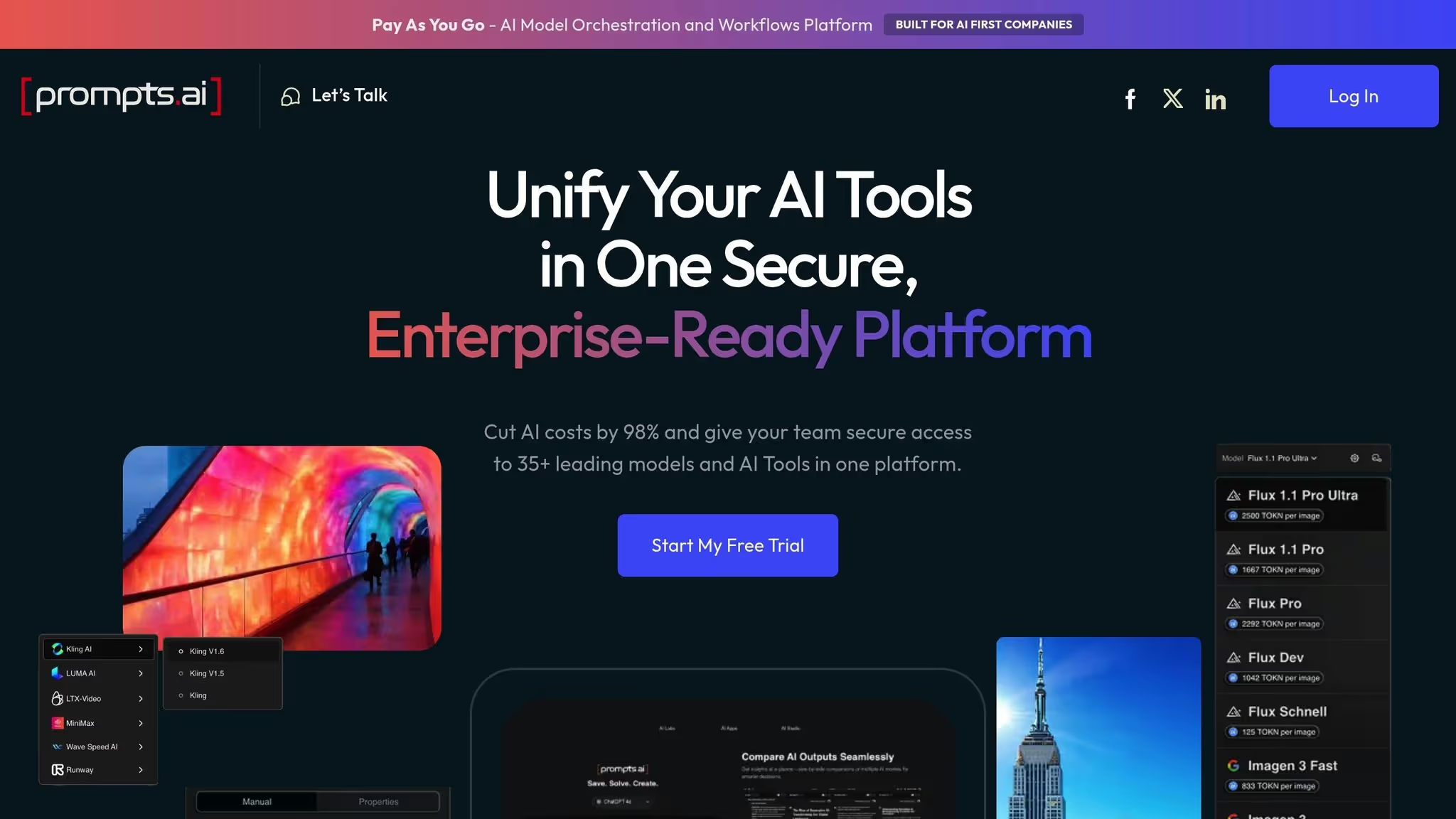

Prompts.ai est une puissante plateforme d'entreprise conçue pour simplifier la gestion de l'IA. Il réunit plus de 35 grands modèles de langage (LLM) de premier plan dans une interface rationalisée, abordant le problème de la dispersion des outils d'IA. En centralisant l'accès aux modèles, aux flux de travail et aux contrôles de gouvernance, Prompts.ai aide les organisations à réduire les coûts des logiciels d'IA jusqu'à 98 %. Cette approche unifiée rend l'intégration et la gestion des modèles plus efficaces que jamais.

Prompts.ai fournit une interface unique et intuitive qui se connecte de manière fluide à plusieurs fournisseurs de LLM. En séparant la gestion des commandes du code sous-jacent, les équipes peuvent mettre à jour les fonctionnalités de l'IA sans interrompre les opérations. La plateforme prend en charge l'intégration avec les meilleurs fournisseurs tels que OpenAI, Anthropic et Google Vertex AI, permettant aux utilisateurs de comparer les performances des modèles côte à côte. Cette flexibilité permet aux organisations de passer facilement d'un modèle à l'autre, en adaptant les solutions à des besoins spécifiques.

Prompts.ai est conçu pour évoluer avec votre organisation. Son interface centralisée prend en charge les flux de travail basés sur l'environnement, ce qui permet aux équipes de l'entreprise de gérer facilement les opérations d'IA de manière efficace. L'ajout de nouveaux modèles, utilisateurs ou équipes ne prend que quelques minutes. Que vous soyez une petite ou une grande entreprise, l'architecture de la plateforme s'adapte à vos habitudes d'utilisation, éliminant ainsi le besoin d'investissements dans les infrastructures fixes.

La plateforme utilise un système de crédit TOKN par paiement à l'utilisation, liant les coûts directement à l'utilisation des jetons. Grâce à une couche FinOps intégrée, les utilisateurs bénéficient d'une visibilité en temps réel sur les dépenses des différents modèles, équipes et applications. Le prix des forfaits professionnels commence à 99$ par membre et par mois pour le niveau Core, 119$ pour la version Pro et 129$ pour la version Elite. Pour un usage personnel, les forfaits vont d'une option gratuite de paiement à l'utilisation à 99$ pour l'accès familial.

Prompts.ai garantit un contrôle et une transparence complets sur les flux de travail de l'IA. Il fournit des pistes d'audit détaillées pour maintenir la conformité et permet aux organisations de définir des politiques d'accès et de surveiller les performances rapides dans les environnements en direct. La plateforme donne également la priorité à des mesures strictes de protection des données. Afin de promouvoir les meilleures pratiques, le programme de certification Prompt Engineer propose des conseils et des formations structurés aux utilisateurs.

Pour choisir la bonne plateforme d'orchestration, il faut évaluer ses avantages par rapport à ses limites, car chaque option peut influencer le flux de travail, le budget et la capacité d'adaptation de votre équipe. Vous trouverez ci-dessous une liste des principaux atouts et défis de plusieurs plateformes populaires, afin de vous aider à aligner votre choix sur vos objectifs spécifiques.

Chaîne Lang se distingue par sa grande flexibilité, avec plus de 1 000 intégrations et une communauté dynamique. Avec 90 millions de téléchargements mensuels et 112 000 étoiles sur GitHub, sa popularité met en évidence son utilité et sa portée. Cependant, cette polyvalence a un coût : attendez-vous à un temps de latence de 15 à 25 % par rapport aux appels par modèle direct. De plus, sa courbe d'apprentissage abrupte nécessite un haut niveau d'expertise des développeurs.

Substrat rocheux d'Amazon simplifie les opérations en automatisant la mise à l'échelle et la sécurité, en offrant un accès à 83 LLM différents via une seule API. Bien que cela élimine de nombreux problèmes d'infrastructure, sa tarification basée sur l'utilisation peut entraîner une augmentation rapide des coûts lors de la gestion de volumes élevés. Les équipes peuvent également avoir des difficultés à quitter l'écosystème AWS si nécessaire.

Service d'agent Azure AI est un choix judicieux pour les organisations qui ont déjà investi dans l'écosystème de Microsoft. Il s'intègre parfaitement à des plateformes telles que Synapse Azure, ce qui en fait la solution idéale pour les flux de données distribués. Cependant, sa mise en œuvre nécessite une expertise technique importante et peut limiter la flexibilité des équipes qui souhaitent adopter des stratégies multicloud.

Databricks offre des performances exceptionnelles pour la planification à grande échelle et les charges de travail distribuées, grâce à des intégrations avec des outils tels que Ray et Débit d'air. Cela dit, ses fonctionnalités avancées exigent un niveau élevé d'expertise et d'infrastructure, ce qui le rend moins accessible aux petites équipes ou à celles qui commencent tout juste à utiliser l'IA.

Prompts.ai offre une flexibilité inégalée avec la possibilité de basculer instantanément entre plus de 35 modèles sans modifier le code. Son système de crédit TOKN à paiement à l'utilisation garantit que les coûts sont directement liés à l'utilisation, évitant ainsi les pièges des abonnements fixes. La couche FinOps intégrée à la plateforme fournit des informations sur les dépenses en temps réel, aidant ainsi les équipes à éviter les surprises budgétaires. De plus, son interface unifiée peut réduire les dépenses liées aux logiciels d'IA jusqu'à 98 %, remplaçant ainsi le besoin d'outils fragmentés.

Le regroupement de modèles d'IA dispersés dans un système rationalisé et efficace nécessite une orchestration réfléchie. Le choix de la bonne plateforme dépend de facteurs tels que les compétences techniques de votre équipe, les contraintes budgétaires et les objectifs opérationnels. Chaque plateforme possède ses propres atouts, adaptés pour répondre à des besoins spécifiques.

Chaîne Lang s'impose comme un outil clé pour le développement d'applications basées sur le LLM. Sa conception modulaire permet aux développeurs de connecter divers modèles, sources de données et API dans des flux de travail fluides. Pour les organisations qui ont déjà investi dans l'écosystème Microsoft, Service d'agent Azure AI offre une automatisation robuste et des fonctionnalités de sécurité de haut niveau adaptées aux environnements d'entreprise. D'autre part, Prompts.ai aborde les complexités liées à la gestion de multiples outils et aux dépenses imprévisibles. Il donne accès à plus de 35 modèles linguistiques de premier plan via une interface unique et sécurisée, soutenue par un système de crédit TOKN flexible avec paiement à l'utilisation et un suivi FinOps en temps réel.

Lorsque vous sélectionnez une plateforme d'orchestration de modèles d'IA, concentrez-vous sur ses capacités d'intégration. La plateforme idéale devrait connecter de manière fluide divers modèles d'IA et sources de données au sein d'une interface unique et unifiée, éliminant ainsi les tracas liés à la jonglerie entre plusieurs outils. Cela simplifie les opérations et garantit des flux de travail plus fluides.

Évolutivité est un autre facteur important. Choisissez une plateforme capable de gérer efficacement des charges de travail croissantes et prenant en charge des environnements cloud natifs tels que Kubernetes, garantissant des performances optimales même lorsque les exigences augmentent.

Faites attention à transparence des coûts. Optez pour des plateformes proposant des modèles de tarification flexibles et payants à l'utilisation, ainsi que des outils qui vous permettent de surveiller l'utilisation et de gérer efficacement les dépenses. Fort fonctionnalités de gouvernance sont tout aussi importants. Recherchez des options telles que les contrôles d'accès basés sur les rôles, les journaux d'audit et les paramètres de confidentialité des données pour garantir la conformité aux normes réglementaires.

Enfin, priorisez facilité d'utilisation. Une plateforme dotée d'une interface simple ou d'options low-code peut simplifier les flux de travail complexes, tandis qu'un support fiable et une documentation complète peuvent faciliter le processus d'adoption. En tenant compte de ces facteurs, vous pouvez rationaliser les déploiements d'IA, réduire les coûts et atténuer les risques de manière efficace.

Les plateformes d'orchestration de modèles d'IA offrent aux organisations un moyen plus intelligent de gérer leurs opérations d'IA tout en réduisant les coûts. En centralisant la supervision de plusieurs modèles d'IA et ressources de calcul, ces plateformes éliminent le besoin de contrats ou d'infrastructures distincts, simplifient les flux de travail et réduisent les frais de licence et les frais de licence inutiles.

L'une des caractéristiques les plus remarquables est suivi des coûts en temps réel, qui permet aux équipes de suivre de près les dépenses, de définir des alertes budgétaires et d'éviter de gaspiller de l'argent sur des ressources inutilisées. Le modèle de tarification à l'utilisation garantit que vous n'êtes facturé que pour la puissance de calcul que vous utilisez réellement, résolvant ainsi le problème du surprovisionnement qui affecte souvent les systèmes traditionnels.

L'automatisation joue également un rôle clé en prenant en charge des tâches telles que la mise à l'échelle et la surveillance des modèles. Cela réduit le besoin d'interventions manuelles, réduit les dépenses de main-d'œuvre et minimise les erreurs coûteuses qui pourraient entraîner des rediffusions fastidieuses. Ces fonctionnalités combinées fournissent une structure de coûts claire et prévisible, ce qui permet aux entreprises américaines de dimensionner plus facilement leurs charges de travail d'IA de manière efficace sans dépasser leur budget.

Les plateformes d'orchestration de l'IA mettent fortement l'accent sur la sécurité et utilisent des méthodes avancées pour protéger les données, les modèles et les flux de travail. Les principales caractéristiques incluent souvent contrôle d'accès basé sur les rôles (RBAC), qui garantit une gestion rigoureuse des autorisations des utilisateurs, associée à des journaux d'audit détaillés pour suivre toutes les actions à des fins de conformité. Pour mieux protéger les informations sensibles, ces plateformes s'appuient sur chiffrement de niveau professionnel pour la protection des données, à la fois au repos et pendant la transmission, en répondant fréquemment à des certifications telles que HIPAA et NORME ISO 27001.

La sécurité est encore renforcée grâce à outils de gouvernance qui aident à suivre les coûts, à appliquer les politiques organisationnelles et à fournir une visibilité claire sur les modèles d'utilisation. De nombreuses plateformes tirent également parti mécanismes d'isolation auprès des fournisseurs de cloud, en veillant à ce que les charges de travail des clients restent séparées afin de préserver la confidentialité, l'intégrité et la disponibilité. Ces mesures permettent aux entreprises de gérer en toute confiance leurs modèles et flux de travail d'IA sans compromettre la sécurité.