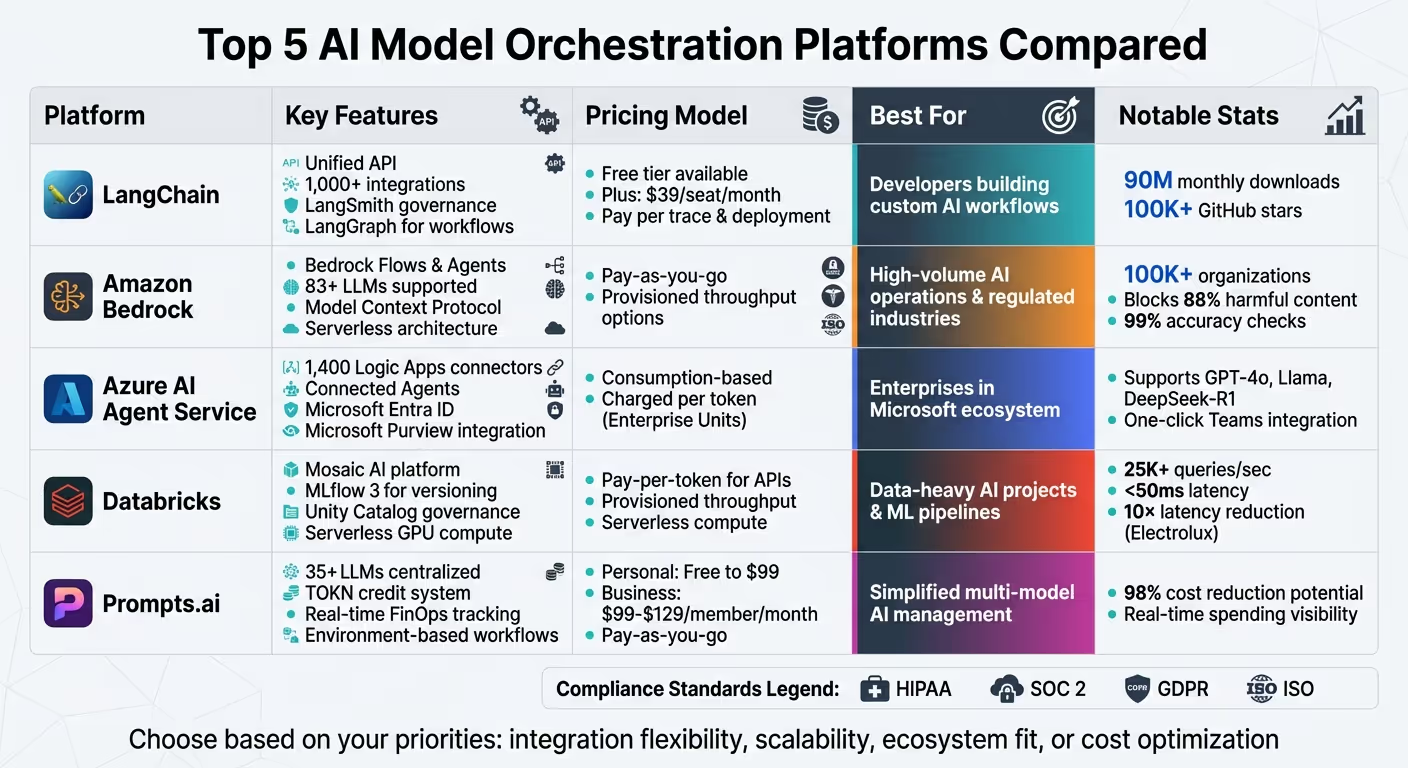

AI 模型编排平台对于高效管理多个 AI 工具、模型和工作流程至关重要。这些平台可简化集成、自动化流程并确保治理,使其成为组织扩展 AI 运营不可或缺的一部分。以下是五个领先平台及其突出功能的简要概述:

从以开发人员为中心的工具到企业级解决方案,每个平台都能满足不同的需求。根据组织的优先事项(例如集成、可扩展性或成本效率)进行选择。

这些平台简化了人工智能运营,降低了成本,提高了工作流程效率,使其成为现代企业的关键工具。

AI 模型编排平台比较:功能、定价和最佳用例

LangChain 是 #1 世界上下载的代理框架,每月下载量超过9000万次,GitHub明星超过10万人。对于希望快速构建 AI 工作流程而不受单一供应商束缚的开发人员来说,这是一个值得信赖的选择。

LangChain 使用简化模型集成 统一 API 这使提供商之间的互动标准化。无论你在使用 OpenAI, 人类,或者谷歌的双子座,它们之间的切换是无缝的。开发人员只需短短 10 行代码即可连接到领先的提供商并创建功能代理。该平台支持 1,000 多个集成,涵盖数据源、云服务和专业工具。对于从事检索增强生成(RAG)的人员来说,LangChain提供了与矢量数据库和文档加载器的平滑集成,使模型无需重新训练即可处理专有或实时数据。这种广泛的连接是LangChain可扩展性的基石。

LangChain 旨在通过以下方式处理企业规模的运营 水平缩放,由优化的任务队列支持。其基础设施可适应长时间运行的代理工作流程,这些工作流程可能持续数小时甚至数天,并具有针对此类需求量身定制的自动扩展功能。正如 LangChain 解释的那样:

标准基础架构无法处理需要人工协作的长时间运行的代理工作负载。使用管理内存、自动扩展和企业安全的 API 进行部署。

该平台由 LangGrap,这可确保持久执行,并允许使用自定义检查点来维护复杂进程的状态。

LangChain提供灵活的定价以满足不同的需求。这个 开发者计划 免费,包括每月 1 个座位和 5,000 条基础曲目。这个 Plus 套餐 每月每个席位的费用为39美元,提供10,000条基本跟踪,免费开发部署,额外的代理运行费用为每次运行0.005美元。对于生产部署,正常运行时间定价为每分钟 0.0036 美元。团队可以通过使用基本跟踪(14 天保留率,每 1,000 条轨迹 0.50 美元)进行大量调试,以及为模型微调中使用的有价值的反馈数据保留延期跟踪(400 天的保留期,每 1,000 条轨迹 5.00 美元)来进一步降低成本。除了成本效益外,LangChain还确保了强大的治理和安全性。

LangChain 的可观察性和部署系统 LangSmith 坚持 HIPAA、SOC 2 类型 2 和 GDPR 合规标准,通过执行跟踪、状态转换和运行时指标提供对代理行为的详细见解。LangGraph 还支持人工在环工作流程,支持对敏感任务进行手动干预和批准。企业客户可以灵活部署,可以在自己的 VPC 内选择基于云的、混合的(带有自托管数据平面的SaaS控制平面)或完全自托管的设置。

亚马逊 Bedrock 支持生成式 AI 超过 100,000 个组织,提供完全托管的无服务器平台,无需管理基础架构。这允许用户根据需要无缝扩展 AI 应用程序。

Amazon Bedrock 为整合 AI 工作流程提供了三种不同的方法:

Bedrock 的模型上下文协议 (MCP) 通过将现有的 API 和 Lambda 函数转换为兼容 MCP 的工具,进一步增强了集成。这允许代理与企业系统进行交互,例如 销售部队, Slack,以及 吉拉 只需最少的编码工作量。这些集成选项为各种 AI 应用程序提供了灵活性和适应性。

在 2024 年, 罗宾汉 通过增加其 AI 运营,展示了 Bedrock 的可扩展性 每天 5 亿到 50 亿个代币 在短短六个月内。Bedrock run 上托管的蒸馏模型 快五倍 而且成本最高可达 减少 75% 比他们原来的同行。此外,智能提示路由可以将成本削减多达 30%,同时保持输出质量。Bedrock 基于消费的定价模型进一步支持了这种可扩展性。

Bedrock 采用即用即付模式,这意味着根据资源使用量向用户收费。例如,在 Bedrock Flows 中,成本与调用的特定资源相关联,例如提示节点中使用的 Titan 模型。拥有大型工作负载的组织可以选择预置吞吐量,以折扣价获得专用容量。Robinhood 利用 Bedrock 的基础架构将其人工智能成本降低了 80% 并将开发时间缩短了一半。Robinhood 人工智能主管 Dev Tagare 强调了 Bedrock 的优势:

Amazon Bedrock 的模型多样性、安全性和合规性功能是专为受监管行业打造的。

Amazon Bedrock 将数据安全性与合规性放在首位。客户数据永远不会与第三方模型提供商共享或用于训练基础模型。组织通过 AWS 密钥管理服务保留对其加密密钥的完全控制权。其他保障措施包括:

该平台符合严格的标准,包括ISO、SOC、GDPR和FedRAMP High,并且符合HIPAA资格。精细的 IAM 策略提供对用户操作和资源访问的控制,而 AWS 云轨迹 和 亚马逊云观察 集成可实现详细的监控和审计。这些功能使得 Bedrock 成为处理敏感数据的组织的安全可靠选择。

Azure AI 代理服务,的一部分 微软铸造厂,用作 集中式编排平台 它将模型、工具和框架汇集到一个统一的系统中。该服务通过自动管理对话状态和工具调用来简化操作,无需手动干预。微软概述了其用途如下:

Foundry 代理服务将 Foundry 的核心部分(例如模型、工具和框架)连接到单个运行时中...这些活动有助于确保代理安全、可扩展且可用于生产。

该平台因其轻松集成模型和工具的能力而脱颖而出。它支持各种大型语言模型,包括 天蓝OpenAI (GPT-4o、GPT-4、GPT-3.5)、美洲驼和 DeepSeek-R1。通过 1,400 Azure 逻辑应用程序 连接器,用户可以直接链接到系统,例如 分享点, 微软面料和自定义 API。为了增强安全性和互操作性,该平台采用了 模型上下文协议 (MCP) 用于将代理连接到自定义工具和 API。

一个突出的特点是 连接的代理,它允许主要协调器使用自然语言路由将任务分配给专门的子代理。尽管父代理只能将任务委派给子代理,但这消除了对硬编码逻辑的需求。对于更复杂的设置,创建有针对性且可重复使用的子代理可简化维护和调试,而不是使用多种功能使单个代理负担过重。

Azure AI 代理服务支持使用 LangGraph 等框架构建的容器化代理,启用 可扩展的操作 管理不同的工作负载。代理可以使用客户配置自动切换到辅助区域 Azure Cosmos 数据库 如果主要区域出现停机,则为账户。微软强调此功能对于企业做好准备至关重要:

大规模部署和编排 AI 代理——可管理、可观察和集成,可实现企业转型。

该服务还提供 一键集成 和 微软团队 和 微软 365 Copilot 用于快速部署。通过自动重试工具调用的服务器端执行减少了大规模操作期间的客户端处理需求。

该平台运行在 基于消费的定价模型,根据每个代理操作处理的代币数量收费。这些费用在发票上显示为 “企业单位”。对于使用 Azure 逻辑应用程序构建的工作流,用户只需支付标准逻辑应用程序费用,而人工智能模型的使用(如 Azure OpenAI)会产生单独的费用。这种灵活的定价结构使组织无需大量前期投资即可扩展其人工智能运营。

每个代理都被分配了一个唯一的 微软 Entra 代理 ID,实现精确的身份管理、访问控制和策略执行。该服务集成了 微软 Purview 应用数据丢失防护策略、敏感度标签,并确保遵守数据驻留规则。实时过滤 Azure AI 内容安全 有助于降低诸如即时注射和越狱尝试之类的风险。

为了提高安全性,部署可通过 Azure 虚拟网络和私有端点进行网络隔离。这个 AI Red Teaming Agent 允许组织在全面部署之前模拟潜在攻击并识别漏洞。集中式日志记录,由 Azure 日志分析 和 应用程序见解,确保用于审计目的的对话和工具使用情况的完全可追溯性。该服务符合关键的国际标准,包括 GDPR、HIPAA、ISO 和 SOC。

Databricks 通过其 Mosaic AI 平台将数据工程、机器学习和人工智能编排结合在一起。借助 Mosaic AI 模型服务,用户可以通过统一的 REST API 部署传统和基础模型以及 AI 代理。Lakeflow Jobs 通过使用 DAG 结构自动化 ETL、分析和 AI 工作流程,进一步简化了流程。

Databricks 每秒支持超过 25,000 个查询,开销延迟小于 50 毫秒。可以使用 Databricks SQL 进行批量推理或使用标准 REST API 将模型集成到分析工作流程中,用于实时应用程序。Mosaic AI 代理框架支持开发可用于生产的检索增强型生成应用程序,而 Mosaic AI Gateway 则管理速率限制并监控 OpenAI 和 Anthropic 等提供商的模型质量。

对于模型管理,Databricks 采用了 MLFlow 3 的托管版本,该版本通过部署任务处理实验跟踪、模型版本控制和部署生命周期管理。此外,AI Playground 还提供了类似聊天的界面,用于测试和比较各种大型语言模型。

“Databricks模型服务使我们可以轻松安全地访问和管理多个SaaS和开放模型,包括托管在Databricks上或外部的模型,从而加速我们的人工智能驱动项目。”

- Edmunds.com 技术副总裁格雷格·罗基塔

该集成框架可确保无缝扩展和适应各种需求。

Databricks 使用无服务器 GPU 计算来支持单节点和多节点深度学习任务,使用诸如此类的框架 PyTorch, TensorFLOW,以及 Keras 用于大规模训练和微调。与(集成) 射线 on Databricks 允许机器学习工作负载在分布式环境中扩展,这对于密集的模型训练和推理特别有利。模型端点自动调整以满足需求,从零向上扩展并向下扩展以降低成本。例如,在 2024 年, 伊莱克斯 统一了其数据和人工智能平台,将推理延迟减少了10倍,并降低了维护开销。

Databricks提供灵活的定价选项,以平衡性能和成本。其基础模型API的按代币付费模式使用户无需预先承诺即可访问诸如Llama之类的精选模型。对于需要特定性能保证或微调模型的工作负载,可提供预置吞吐量。无服务器计算选项支持模型服务和Lakeflow Jobs的即用即付定价,并能够扩展到零以消除闲置成本。工作空间可以处理多达 2,000 个并发任务运行并保存 12,000 个作业。Lakeflow 作业还包含 “修复并重新运行” 功能,该功能仅重试工作流程中出现故障的节点,从而节省时间和资源。这些任务的定价取决于所使用的计算资源,因计划、云提供商和集群配置而异。

Unity 目录 充当集中管理层,用于管理所有数据和人工智能资产,包括结构化和非结构化数据、机器学习模型、笔记本电脑和功能。组织可以在账户级别定义访问策略,并将其应用于所有工作负载。该系统支持使用 ANSI SQL 的行级筛选器和列掩码,确保用户仅访问授权数据。使用 AES-256 静态加密和传输期间的 TLS 1.2+ 加密来保护数据。

该平台符合 GDPR、CCPA、HIPAA、BCBS 239 和 SOX 等关键法规。此外,端到端谱系可以跟踪从其来源到最终目的地的数据,包括模型谱系,它可以识别用于训练和评估的特定数据集版本。这种全面的方法确保了安全性和透明度。

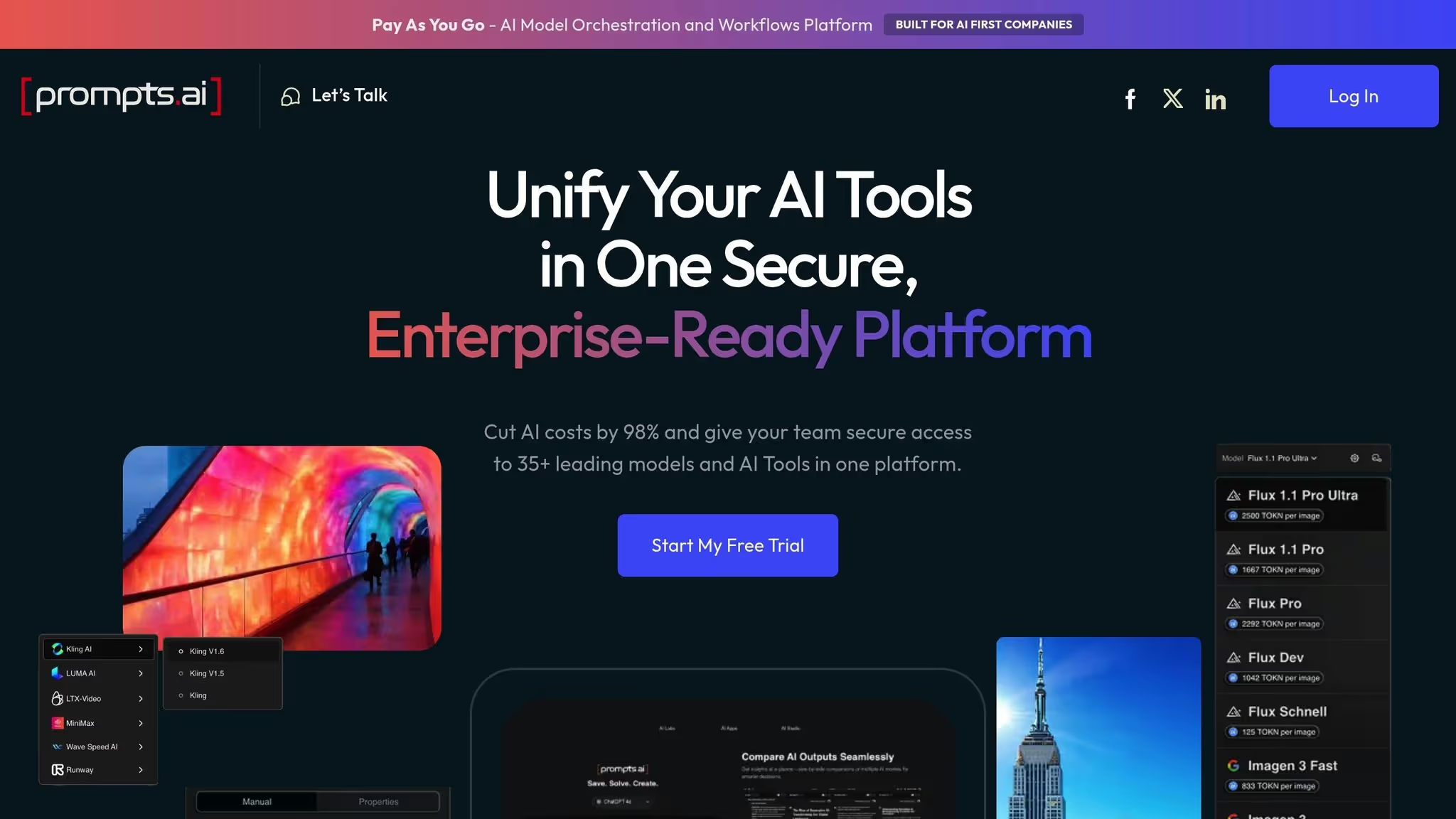

Prompts.ai 是一个强大的企业级平台,旨在简化 AI 管理。它将超过35种领先的大型语言模型(LLM)整合到一个简化的界面中,解决了分散的人工智能工具的问题。通过集中访问模型、工作流程和治理控制,Prompts.ai 帮助组织将人工智能软件成本削减多达 98%。这种统一的方法使集成和管理模型比以往任何时候都更加高效。

Prompts.ai 提供了单一、直观的界面,可与多个 LLM 提供商无缝连接。通过将即时管理与底层代码分开,团队可以在不中断操作的情况下更新 AI 功能。该平台支持与 OpenAI、Anthropic 和 OpenAI 等顶级提供商集成 谷歌 Vertex AI,使用户能够并排比较模型性能。这种灵活性使组织可以毫不费力地在模型之间切换,根据特定需求量身定制解决方案。

Prompts.ai 专为与您的组织共同成长而构建。其集中式界面支持基于环境的工作流程,使企业团队可以轻松高效地管理人工智能运营。添加新模型、用户或团队只需几分钟。无论您是小型企业还是大型企业,该平台的架构都会适应您的使用模式,从而无需固定基础设施投资。

该平台采用即用即付的TOKN信用系统,将成本直接与代币使用量挂钩。借助内置的 FinOps 层,用户可以实时了解跨模型、团队和应用程序的支出。商业套餐的起价为核心级别的每位会员每月99美元,专业版的起价为119美元,精英级别的起价为129美元。对于个人使用,套餐范围从免费的即用即付选项到99美元的家庭使用套餐不等。

Prompts.ai 确保 AI 工作流程的完全控制和透明度。它提供详细的审计记录以保持合规性,并允许组织定义访问策略并监控实时环境中的即时性能。该平台还优先考虑强有力的数据保护措施。为了推广最佳实践,即时工程师认证计划为用户提供结构化指导和培训。

选择正确的编排平台意味着权衡其优势和局限性,因为每个选项都会影响团队的工作流程、预算和适应性。以下是几种热门平台的主要优势和挑战的细分,可帮助您根据具体目标调整选择。

LangChain 以其广泛的灵活性脱颖而出,拥有 1,000 多个集成和一个充满活力的社区。它的月下载量为9000万次,GitHub明星为11.2万次,其受欢迎程度凸显了其实用性和影响力。但是,这种多功能性是有代价的——与直接模型调用相比,预计延迟开销为15-25%。此外,其陡峭的学习曲线需要高水平的开发人员专业知识。

亚马逊基岩 通过自动扩展和安全性来简化操作,通过单个 API 提供对 83 个不同的 LLM 的访问。虽然这消除了许多基础设施方面的担忧,但其基于使用量的定价可能会导致处理大量业务时成本的快速增加。如果需要,团队在脱离 AWS 生态系统时也可能会遇到困难。

Azure AI 代理服务 对于已经投资微软生态系统的组织来说,这是一个不错的选择。它与诸如此类的平台无缝集成 Azure Synapse,使其成为分布式数据工作流程的理想之选。但是,它需要大量的技术专业知识才能有效实施,并且可能会限制希望采用多云战略的团队的灵活性。

Databricks 得益于与 Ray 和 Ray 等工具的集成,可为大规模调度和分布式工作负载提供卓越的性能 气流。也就是说,它的高级功能需要高水平的专业知识和基础设施,这使得小型团队或刚开始使用人工智能的团队难以获得它。

Prompts.ai 提供无与伦比的灵活性,无需更改代码即可在 35 多个模型之间即时切换。其即用即付的TOKN信用系统确保成本与使用量直接挂钩,避免了固定订阅的陷阱。该平台的内置FinOps层提供实时支出见解,帮助团队避免预算意外。此外,其统一接口可以将人工智能软件费用减少多达98%,从而取代了对分散工具的需求。

将分散的人工智能模型整合到一个简化和高效的系统中需要周密的编排。选择正确的平台取决于团队的技术技能、预算限制和运营目标等因素。每个平台都有自己的优势,可根据特定需求量身定制。

LangChain 作为开发基于LLM的应用程序的关键工具脱颖而出。其模块化设计使开发人员能够将各种模型、数据源和 API 连接到无缝工作流程中。对于已经投资微软生态系统的组织, Azure AI 代理服务 提供适用于企业环境的强大自动化和顶级安全功能。另一方面, Prompts.ai 解决了管理多种工具和不可预测费用的复杂性。它通过单一的安全界面提供对超过35种领先语言模型的访问,并由灵活的即用即付TOKN信用系统和实时FinOps跟踪提供支持。

在选择 AI 模型编排平台时,请重点关注其 集成能力。理想的平台应将各种人工智能模型和数据源无缝连接到一个统一的界面中,从而消除兼顾多个工具的麻烦。这简化了操作并确保了更顺畅的工作流程。

可扩展性 是另一个重要因素。选择一个能够高效处理不断增长的工作负载并支持云原生环境的平台,例如 Kubernetes,即使需求增加,也能确保最佳性能。

注意 成本透明度。选择具有灵活的即用即付定价模式的平台,以及允许您有效监控使用情况和管理支出的工具。强大 治理功能 同样重要。寻找基于角色的访问控制、审计日志和数据隐私设置等选项,以确保符合监管标准。

最后,确定优先顺序 易用性。具有简单界面或低代码选项的平台可以简化复杂的工作流程,而可靠的支持和详尽的文档可以帮助简化采用过程。通过考虑这些因素,您可以简化 AI 部署、降低成本并有效降低风险。

AI 模型编排平台为组织提供了一种更智能的方式来管理其 AI 运营,同时削减成本。通过集中监督多个 AI 模型和计算资源,这些平台无需单独的合同或基础架构,简化了工作流程,减少了许可费用和不必要的开销。

一个突出的特点是 实时成本跟踪,这使团队可以密切关注支出,设置预算提醒,并避免将钱浪费在闲置资源上。即用即付定价模式确保您只按实际使用的计算能力付费,从而解决了经常困扰传统系统的过度配置问题。

自动化也起着关键作用,它接管了模型扩展和监控等任务。这减少了手动干预的需求,减少了人工开支,并最大限度地减少了可能导致耗时重新运行的代价高昂的错误。这些组合功能提供了清晰且可预测的成本结构,使美国企业更容易在不超出预算的情况下有效扩展其人工智能工作负载。

AI 编排平台非常重视安全性,采用先进的方法来保护数据、模型和工作流程。主要功能通常包括 基于角色的访问控制 (RBAC),可确保严格管理用户权限,并配以详细的审计日志,以跟踪出于合规目的的所有操作。为了进一步保护敏感信息,这些平台依赖 企业级加密 用于数据保护,无论是在静态还是在传输过程中,经常需要满足诸如此类的认证 你好 和 ISO 27001。

安全性得到进一步加强 治理工具 这有助于跟踪成本,执行组织政策,并提供对使用模式的清晰可见性。许多平台也在利用 隔离机制 来自云提供商,确保客户工作负载保持独立,以保持机密性、完整性和可用性。这些措施使企业能够在不影响安全性的前提下自信地管理其人工智能模型和工作流程。