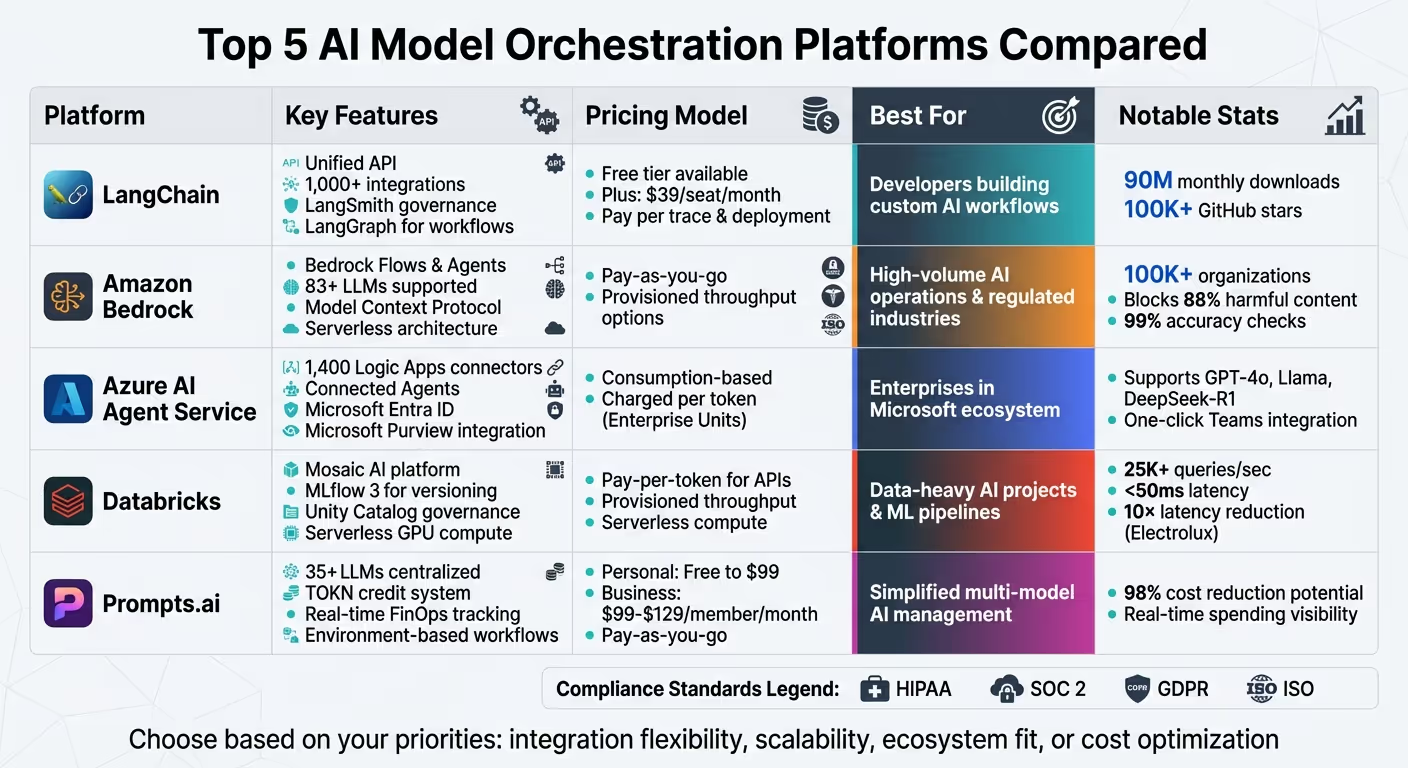

Las plataformas de orquestación de modelos de IA son esenciales para administrar múltiples herramientas, modelos y flujos de trabajo de IA de manera eficiente. Estas plataformas simplifican la integración, automatizan los procesos y garantizan la gobernanza, por lo que son indispensables para las organizaciones que amplían sus operaciones de IA. A continuación, se muestra una descripción general rápida de las cinco plataformas líderes y sus características más destacadas:

Cada plataforma satisface diferentes necesidades, desde herramientas centradas en los desarrolladores hasta soluciones a escala empresarial. Elija en función de las prioridades de su organización, como la integración, la escalabilidad o la rentabilidad.

Estas plataformas optimizan las operaciones de IA, reducen los costos y mejoran la eficiencia del flujo de trabajo, lo que las convierte en herramientas fundamentales para las empresas modernas.

Comparación de plataformas de orquestación de modelos de IA: características, precios y mejores casos de uso

LangChain es el El marco de agentes #1 descargado del mundo, con más de 90 millones de descargas mensuales y más de 100 000 estrellas de GitHub. Es una opción fiable para los desarrolladores que buscan crear flujos de trabajo de IA con rapidez sin tener que depender de un solo proveedor.

LangChain simplifica la integración del modelo con un API unificada que estandariza las interacciones entre los proveedores. Ya sea que esté usando IA abierta, Antrópico, o Gemini de Google, cambiar entre ellos es perfecto. Los desarrolladores pueden conectarse con los principales proveedores y crear agentes funcionales con tan solo 10 líneas de código. La plataforma admite más de 1000 integraciones, que abarcan fuentes de datos, servicios en la nube y herramientas especializadas. Para quienes trabajan en la generación aumentada de recuperación (RAG), LangChain ofrece una integración fluida con bases de datos vectoriales y cargadores de documentos, lo que permite a los modelos procesar datos propietarios o en tiempo real sin necesidad de volver a capacitarse. Esta amplia conectividad es la piedra angular de la escalabilidad de LangChain.

LangChain está diseñado para gestionar operaciones a escala empresarial mediante escalado horizontal, con el apoyo de colas de tareas optimizadas. Su infraestructura se adapta a los flujos de trabajo de los agentes de larga duración, que pueden durar horas o incluso días, con capacidades de escalado automático adaptadas a estas demandas. Como explica LangChain:

La infraestructura estándar no puede gestionar las cargas de trabajo de los agentes de larga duración que requieren la colaboración humana. Implemente con API que gestionen la memoria, el escalado automático y la seguridad empresarial.

La plataforma funciona con Gráfico de largo, lo que garantiza una ejecución duradera y permite establecer puntos de control personalizados para mantener el estado en procesos complejos.

LangChain ofrece precios flexibles para adaptarse a diferentes necesidades. El Plan para desarrolladores es gratuito e incluye 1 asiento y 5000 plazas base al mes. El Plan Plus cuesta 39 USD por puesto al mes, lo que proporciona 10 000 seguimientos básicos, una implementación de desarrollo gratuita y ejecuciones de agentes adicionales a un precio de 0,005 USD por ejecución. Para las implementaciones de producción, el tiempo de actividad tiene un precio de 0,0036 USD por minuto. Los equipos pueden reducir aún más los costos si utilizan los rastreos básicos (retención durante 14 días a razón de 0,50 USD por cada 1000 rastreos) para depurar grandes volúmenes y reservar los rastreos prolongados (retención de 400 días a un precio de 5,00 USD por cada 1000 rastreos) para obtener valiosos datos de retroalimentación utilizados en el ajuste de los modelos. Además de la rentabilidad, LangChain garantiza una gobernanza y una seguridad sólidas.

LangSmith, el sistema de observabilidad e implementación de LangChain, se adhiere a HIPAA, SOC 2 tipo 2 y GDPR estándares de cumplimiento, que ofrecen información detallada sobre el comportamiento de los agentes mediante el seguimiento de la ejecución, las transiciones de estado y las métricas de tiempo de ejecución. LangGraph también admite flujos de trabajo independientes, lo que permite la intervención manual y la aprobación de tareas delicadas. Los clientes empresariales tienen flexibilidad de implementación, con opciones de configuraciones basadas en la nube, híbridas (plano de control SaaS con plano de datos autohospedado) o totalmente autohospedadas dentro de su propia VPC.

Amazon Bedrock admite la IA generativa para más de 100 000 organizaciones, que ofrece una plataforma totalmente gestionada y sin servidores que elimina la necesidad de gestionar la infraestructura. Esto permite a los usuarios escalar las aplicaciones de IA sin problemas, según sea necesario.

Amazon Bedrock ofrece tres métodos distintos para integrar los flujos de trabajo de IA:

El Model Context Protocol (MCP) de Bedrock mejora aún más la integración al convertir las API y funciones Lambda existentes en herramientas compatibles con MCP. Esto permite a los agentes interactuar con sistemas empresariales como Fuerza de ventas, Slack, y JIRA con un mínimo esfuerzo de codificación. Estas opciones de integración proporcionan flexibilidad y adaptabilidad para diversas aplicaciones de IA.

En 2024, Robinhood demostró la escalabilidad de Bedrock al aumentar sus operaciones de IA desde De 500 millones a 5 mil millones de fichas por día en solo seis meses. Modelos destilados alojados en Bedrock run cinco veces más rápido y cuestan hasta 75% menos que sus homólogos originales. Además, el enrutamiento rápido inteligente puede reducir los costos hasta en 30%, todo ello sin dejar de mantener la calidad de salida. Esta escalabilidad se ve respaldada además por el modelo de precios basado en el consumo de Bedrock.

Bedrock opera según un modelo de pago por uso, lo que significa que a los usuarios se les cobra en función del uso de los recursos. Por ejemplo, en Bedrock Flows, los costos están vinculados a los recursos específicos invocados, como el modelo Titan utilizado en un nodo rápido. Las organizaciones con grandes cargas de trabajo pueden optar por un rendimiento aprovisionado, lo que les permite obtener capacidad dedicada a precios reducidos. Robinhood aprovechó la infraestructura de Bedrock para reducir sus costos de inteligencia artificial de la siguiente manera: 80% y reduce el tiempo de desarrollo a la mitad. Dev Tagare, director de IA de Robinhood, destacó los puntos fuertes de Bedrock:

Las funciones de diversidad de modelos, seguridad y cumplimiento de Amazon Bedrock están diseñadas específicamente para los sectores regulados.

Amazon Bedrock prioriza la seguridad y el cumplimiento de los datos. Los datos de los clientes nunca se comparten con proveedores de modelos externos ni se utilizan para entrenar modelos básicos. Las organizaciones mantienen el control total de sus claves de cifrado a través del servicio de administración de claves de AWS. Las medidas de seguridad adicionales incluyen:

La plataforma cumple con estándares rigurosos, como ISO, SOC, GDPR y FedRAMP High, y cumple con los requisitos de la HIPAA. Las políticas de IAM detalladas permiten controlar las acciones de los usuarios y el acceso a los recursos, al mismo tiempo AWS CloudTrail y Amazon CloudWatch la integración permite una supervisión y auditoría detalladas. Estas características hacen de Bedrock una opción segura y confiable para las organizaciones que manejan datos confidenciales.

El servicio Azure AI Agent, que forma parte de Microsoft Foundry, sirve como plataforma de orquestación centralizada que reúne modelos, herramientas y marcos en un sistema unificado. Este servicio simplifica las operaciones al administrar automáticamente los estados de las conversaciones y las llamadas a las herramientas, lo que elimina la necesidad de intervenir manualmente. Microsoft describe su propósito de la siguiente manera:

Foundry Agent Service conecta las piezas principales de Foundry, como modelos, herramientas y marcos, en un único tiempo de ejecución... Estas actividades ayudan a garantizar que los agentes estén seguros, sean escalables y estén preparados para la producción.

Esta plataforma destaca por su capacidad para integrar modelos y herramientas sin esfuerzo. Es compatible con una amplia gama de modelos lingüísticos de gran tamaño, entre los que se incluyen Azure OpenAI (GPT-4o, GPT-4, GPT-3.5), Llama y DeepSeek-R1. A través de 1.400 Aplicaciones Azure Logic conectores, los usuarios pueden conectarse directamente a sistemas como SharePoint, Microsoft Fabricy API personalizadas. Para mejorar la seguridad y la interoperabilidad, la plataforma emplea el Protocolo de contexto modelo (MCP) para conectar agentes a herramientas y API personalizadas.

Una característica destacada es Agentes conectados, que permite a un orquestador principal asignar tareas a subagentes especializados mediante el enrutamiento en lenguaje natural. Esto elimina la necesidad de utilizar una lógica codificada, aunque los agentes principales solo pueden delegar tareas a los subagentes. Para configuraciones más complejas, la creación de subagentes enfocados y reutilizables simplifica el mantenimiento y la depuración, en lugar de sobrecargar a un único agente con múltiples capacidades.

Azure AI Agent Service admite agentes en contenedores creados con marcos como LangGraph, lo que permite operaciones escalables para gestionar cargas de trabajo variables. Los agentes pueden cambiar automáticamente a una región secundaria utilizando las aprovisionadas por el cliente Base de datos Azure Cosmos cuentas si la región principal experimenta un tiempo de inactividad. Microsoft considera que esta capacidad es fundamental para la preparación empresarial:

Implemente y organice agentes de IA a escala: gobernados, observables e integrados para la transformación empresarial.

El servicio también ofrece integración con un solo clic con Equipos de Microsoft y Copiloto de Microsoft 365 para un despliegue rápido. La ejecución desde el servidor con reintentos automáticos para las llamadas a las herramientas reduce las exigencias de procesamiento del lado del cliente durante las operaciones a gran escala.

La plataforma funciona en un modelo de precios basado en el consumo, cobrando en función del número de fichas procesadas por cada acción del agente. Estos costos aparecen como «unidades empresariales» en las facturas. En el caso de los flujos de trabajo creados con Azure Logic Apps, los usuarios solo pagan las tarifas estándar de las aplicaciones lógicas, mientras que el uso del modelo de IA (como Azure OpenAI) conlleva cargos independientes. Esta estructura de precios flexible permite a las organizaciones ampliar sus operaciones de IA sin grandes inversiones iniciales.

A cada agente se le asigna un único ID de agente de Microsoft Entra, lo que permite una gestión precisa de la identidad, el control de acceso y la aplicación de políticas. El servicio se integra con Perspectiva de Microsoft para aplicar políticas de prevención de pérdida de datos, etiquetas de sensibilidad y garantizar el cumplimiento de las normas de residencia de datos. Filtrado en tiempo real Seguridad del contenido de Azure AI ayuda a mitigar riesgos como los intentos rápidos de inyección y fuga de la cárcel.

Para mayor seguridad, las implementaciones se benefician del aislamiento de la red a través de Azure Virtual Networks y terminales privados. El Agente de trabajo en equipo de AI Red permite a las organizaciones simular posibles ataques e identificar las vulnerabilidades antes de la implementación completa. Registro centralizado, impulsado por Análisis de registros de Azure y Perspectivas sobre aplicaciones, garantiza la trazabilidad completa de las conversaciones y el uso de las herramientas con fines de auditoría. El servicio cumple con las principales normas internacionales, que incluyen GDPR, HIPAA, ISO y SOC.

Databricks reúne la ingeniería de datos, el aprendizaje automático y la orquestación de inteligencia artificial a través de su plataforma Mosaic AI. Con Mosaic AI Model Serving, los usuarios pueden implementar modelos clásicos y básicos, así como agentes de IA, a través de una API REST unificada. Lakeflow Jobs simplifica aún más los procesos al automatizar los flujos de trabajo de ETL, análisis e IA mediante una estructura DAG.

Databricks admite más de 25 000 consultas por segundo con una latencia de sobrecarga inferior a 50 milisegundos. Los modelos se pueden integrar en los flujos de trabajo de análisis mediante el SQL de Databricks para la inferencia por lotes o las API REST estándar para aplicaciones en tiempo real. El marco de agentes de IA de Mosaic permite el desarrollo de aplicaciones de generación aumentada y recuperación listas para la producción, mientras que Mosaic AI Gateway gestiona los límites de velocidad y monitorea la calidad de los modelos en proveedores como OpenAI y Anthropic.

Para la administración de modelos, Databricks emplea una versión gestionada de MLFlow 3, que gestiona el seguimiento de los experimentos, el control de versiones de los modelos y la gestión del ciclo de vida de la implementación a través de Deployment Jobs. Además, AI Playground ofrece una interfaz similar a la de un chat para probar y comparar varios modelos lingüísticos de gran tamaño.

«Databricks Model Serving está acelerando nuestros proyectos impulsados por la IA al facilitar el acceso y la administración de forma segura de múltiples modelos abiertos y de SaaS, incluidos los alojados dentro o fuera de Databricks».

- Greg Rokita, vicepresidente ejecutivo de tecnología de Edmunds.com

Este marco de integración garantiza una escalabilidad y adaptabilidad sin interrupciones para diversas necesidades.

Databricks usa procesamiento de GPU sin servidor para admitir tareas de aprendizaje profundo de un solo nodo y de varios nodos, y trabaja con marcos como PyTorch, TensorFlow, y Keras para entrenamiento y puesta a punto a gran escala. Integración con Rayo on Databricks permite que las cargas de trabajo de aprendizaje automático escalen en entornos distribuidos, lo que es particularmente beneficioso para la inferencia y el entrenamiento intensivo de modelos. Los terminales modelo se ajustan automáticamente para satisfacer la demanda, escalando desde cero y volviendo a reducirlos para reducir los costos. Por ejemplo, en 2024, Electrolux unificó su plataforma de datos e inteligencia artificial, logrando una reducción de 10 veces en la latencia de inferencia y reduciendo los gastos de mantenimiento.

Databricks ofrece opciones de precios flexibles para equilibrar el rendimiento y el costo. Su modelo de pago por token para las API de Foundation Model permite a los usuarios acceder a modelos seleccionados como Llama sin compromisos iniciales. Para las cargas de trabajo que requieren garantías de rendimiento específicas o modelos ajustados, está disponible Provisioned Throughput. Las opciones de procesamiento sin servidor permiten fijar precios de pago por uso para el servicio de modelos y los trabajos de Lakeflow, con la posibilidad de escalar a cero para eliminar los costos de inactividad. Los espacios de trabajo pueden gestionar hasta 2000 ejecuciones de tareas simultáneas y ahorrar 12 000 trabajos. Lakeflow Jobs también incluye la función «Reparar y volver a ejecutar», que reintenta solo los nodos fallidos de un flujo de trabajo, lo que ahorra tiempo y recursos. El precio de estos trabajos depende de los recursos informáticos utilizados y varía según el plan, el proveedor de nube y la configuración del clúster.

Catálogo de Unity actúa como una capa de gobierno centralizada para administrar todos los datos y activos de IA, incluidos los datos estructurados y no estructurados, los modelos de aprendizaje automático, los cuadernos y las funciones. Las organizaciones pueden definir políticas de acceso a nivel de cuenta y aplicarlas en todas las cargas de trabajo. El sistema admite filtros a nivel de fila y máscaras de columna mediante ANSI SQL, lo que garantiza que los usuarios solo accedan a los datos autorizados. Los datos están protegidos con el cifrado AES-256 en reposo y el cifrado TLS 1.2+ durante el tránsito.

La plataforma cumple con normativas clave como GDPR, CCPA, HIPAA, BCBS 239 y SOX. Además, el linaje integral rastrea los datos desde su origen hasta su destino final, incluido el linaje del modelo, que identifica la versión específica del conjunto de datos utilizada para el entrenamiento y la evaluación. Este enfoque integral garantiza tanto la seguridad como la transparencia.

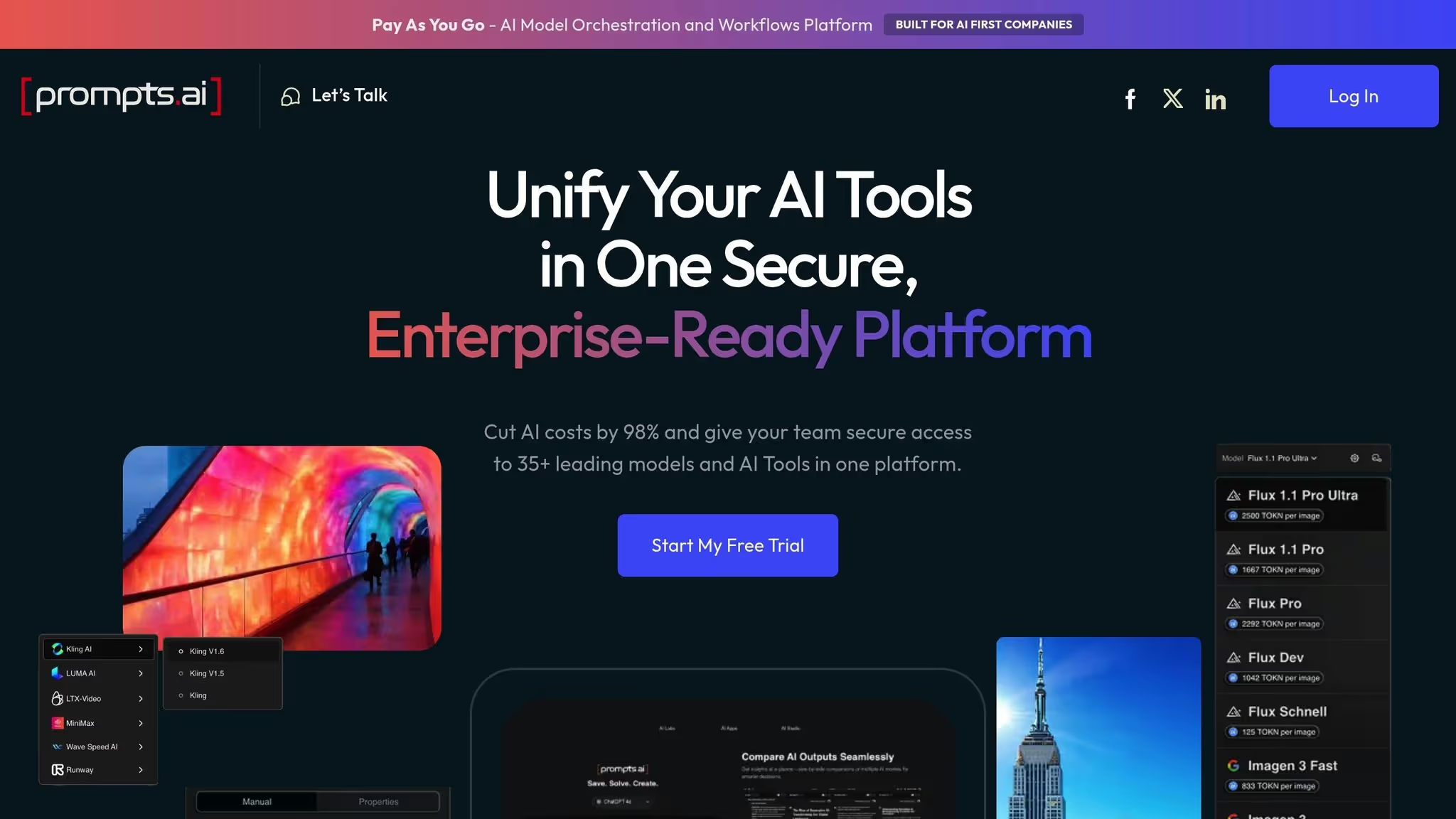

Prompts.ai es una potente plataforma de nivel empresarial diseñada para simplificar la gestión de la IA. Reúne más de 35 modelos de grandes lenguajes (LLM) líderes en una interfaz optimizada, lo que aborda el problema de la dispersión de las herramientas de inteligencia artificial. Al centralizar el acceso a los modelos, los flujos de trabajo y los controles de gobierno, Prompts.ai ayuda a las organizaciones a reducir los costos del software de inteligencia artificial hasta en un 98%. Este enfoque unificado hace que la integración y la gestión de modelos sean más eficientes que nunca.

Prompts.ai proporciona una interfaz única e intuitiva que se conecta sin problemas con varios proveedores de LLM. Al separar la gestión rápida del código subyacente, los equipos pueden actualizar las capacidades de inteligencia artificial sin interrumpir las operaciones. La plataforma admite la integración con los principales proveedores, como OpenAI, Anthropic y Inteligencia artificial de Google Vertex, lo que permite a los usuarios comparar el rendimiento de los modelos en paralelo. Esta flexibilidad permite a las organizaciones cambiar de modelo sin esfuerzo, adaptando las soluciones a las necesidades específicas.

Prompts.ai está diseñado para crecer con su organización. Su interfaz centralizada admite flujos de trabajo basados en el entorno, lo que facilita a los equipos empresariales la gestión eficiente de las operaciones de IA. Añadir nuevos modelos, usuarios o equipos lleva solo unos minutos. Ya sea una pequeña empresa o una gran empresa, la arquitectura de la plataforma se adapta a sus patrones de uso, lo que elimina la necesidad de invertir en infraestructura fija.

La plataforma emplea un sistema de crédito TOKN de pago por uso, que vincula los costos directamente con el uso de los tokens. Con una capa FinOps integrada, los usuarios obtienen una visibilidad en tiempo real de los gastos en todos los modelos, equipos y aplicaciones. Los precios de los planes empresariales comienzan en 99$ por miembro y mes para el nivel Core, 119$ para el Pro y 129$ para el Elite. Para uso personal, los planes van desde la opción gratuita de pago por uso hasta 99$ para el acceso familiar.

Prompts.ai garantiza el control total y la transparencia de los flujos de trabajo de la IA. Proporciona pistas de auditoría detalladas para mantener el cumplimiento y permite a las organizaciones definir políticas de acceso y supervisar el rendimiento rápido en entornos activos. La plataforma también prioriza las medidas sólidas de protección de datos. Para promover las mejores prácticas, el programa de certificación Prompt Engineer ofrece orientación estructurada y capacitación para los usuarios.

Elegir la plataforma de orquestación adecuada significa sopesar sus beneficios con sus limitaciones, ya que cada opción puede influir en el flujo de trabajo, el presupuesto y la adaptabilidad de su equipo. A continuación encontrarás un desglose de los principales puntos fuertes y desafíos de varias plataformas populares, que te ayudarán a alinear tu elección con tus objetivos específicos.

Cadena LANG destaca por su amplia flexibilidad, con más de 1000 integraciones y una comunidad dinámica. Con 90 millones de descargas mensuales y 112.000 estrellas en GitHub, su popularidad destaca su utilidad y alcance. Sin embargo, esta versatilidad tiene un coste: cabe esperar una sobrecarga de latencia del 15 al 25% en comparación con el modelo de llamadas directas. Además, su pronunciada curva de aprendizaje requiere un alto nivel de experiencia de los desarrolladores.

lecho rocoso amazónico simplifica las operaciones al automatizar el escalado y la seguridad, ofreciendo acceso a 83 LLM diferentes a través de una sola API. Si bien esto elimina muchos problemas de infraestructura, sus precios basados en el uso pueden generar rápidos aumentos de costos cuando se gestionan grandes volúmenes. Si es necesario, los equipos también pueden tener dificultades para abandonar el ecosistema de AWS.

Servicio Azure AI Agent es una opción sólida para las organizaciones que ya han invertido en el ecosistema de Microsoft. Se integra a la perfección con plataformas como Azure Synapse, lo que lo hace ideal para flujos de trabajo de datos distribuidos. Sin embargo, su implementación eficaz requiere una gran experiencia técnica y puede limitar la flexibilidad de los equipos que buscan adoptar estrategias de nube múltiple.

Ladrillos de datos ofrece un rendimiento excepcional para la programación a gran escala y las cargas de trabajo distribuidas, gracias a las integraciones con herramientas como Ray y Flujo de aire. Dicho esto, sus capacidades avanzadas exigen un alto nivel de experiencia e infraestructura, lo que las hace menos accesibles para los equipos más pequeños o para aquellos que recién comienzan con la IA.

Prompts.ai ofrece una flexibilidad inigualable con la capacidad de cambiar instantáneamente entre más de 35 modelos sin alterar el código. Su sistema de crédito TOKN de pago por uso garantiza que los costos estén directamente relacionados con el uso, lo que evita las dificultades de las suscripciones fijas. La capa FinOps integrada en la plataforma proporciona información sobre los gastos en tiempo real, lo que ayuda a los equipos a evitar sorpresas presupuestarias. Además, su interfaz unificada puede reducir los gastos de software de IA hasta en un 98%, lo que reemplaza la necesidad de utilizar herramientas fragmentadas.

Reunir modelos de IA dispersos en un sistema eficiente y optimizado requiere una orquestación cuidadosa. La elección de la plataforma adecuada depende de factores como las habilidades técnicas de su equipo, las restricciones presupuestarias y los objetivos operativos. Cada plataforma tiene sus propios puntos fuertes, diseñados para satisfacer necesidades específicas.

Cadena LANG se destaca como una herramienta clave para el desarrollo de aplicaciones basadas en LLM. Su diseño modular permite a los desarrolladores conectar varios modelos, fuentes de datos y API en flujos de trabajo fluidos. Para las organizaciones que ya han invertido en el ecosistema de Microsoft, Servicio Azure AI Agent ofrece funciones sólidas de automatización y seguridad de primer nivel adecuadas para entornos empresariales. Por otro lado, Prompts.ai aborda las complejidades de administrar múltiples herramientas y los gastos impredecibles. Proporciona acceso a más de 35 modelos lingüísticos líderes a través de una interfaz única y segura, respaldada por un sistema de crédito TOKN flexible de pago por uso y un seguimiento de FinOps en tiempo real.

Al seleccionar una plataforma de orquestación de modelos de IA, concéntrese en su capacidades de integración. La plataforma ideal debería conectar sin problemas varios modelos de IA y fuentes de datos en una interfaz única y unificada, lo que eliminaría la molestia de tener que hacer malabares con varias herramientas. Esto simplifica las operaciones y garantiza flujos de trabajo más fluidos.

Escalabilidad es otro factor importante. Elija una plataforma que pueda gestionar las crecientes cargas de trabajo de manera eficiente y que sea compatible con entornos nativos de la nube, como Kubernetes, lo que garantiza un rendimiento óptimo incluso a medida que aumentan las demandas.

Presta atención a transparencia de costos. Opte por plataformas con modelos de precios flexibles de pago por uso, junto con herramientas que le permitan supervisar el uso y gestionar los gastos de forma eficaz. ¿Fuerte funciones de gobierno son igualmente importantes. Busque opciones como los controles de acceso basados en roles, los registros de auditoría y la configuración de privacidad de los datos para garantizar el cumplimiento de las normas reglamentarias.

Por último, priorice facilidad de uso. Una plataforma con una interfaz sencilla u opciones con poco código puede simplificar los flujos de trabajo complejos, mientras que un soporte fiable y una documentación exhaustiva pueden ayudar a facilitar el proceso de adopción. Al tener en cuenta estos factores, puede optimizar las implementaciones de IA, reducir los costos y mitigar los riesgos de manera efectiva.

Las plataformas de orquestación de modelos de IA ofrecen una forma más inteligente para que las organizaciones administren sus operaciones de IA y, al mismo tiempo, reduzcan los costos. Al centralizar la supervisión de varios modelos de IA y recursos informáticos, estas plataformas eliminan la necesidad de contratos o infraestructuras independientes, lo que simplifica los flujos de trabajo y reduce las tarifas de licencia y los gastos generales innecesarios.

Una característica destacada es seguimiento de costos en tiempo real, que permite a los equipos vigilar de cerca los gastos, establecer alertas presupuestarias y evitar desperdiciar dinero en recursos inactivos. El modelo de precios de pago por uso garantiza que solo se le cobre por la potencia de procesamiento que realmente utilice, lo que resuelve el problema del sobreaprovisionamiento que suele afectar a los sistemas tradicionales.

La automatización también desempeña un papel clave, ya que asume tareas como el escalado y la supervisión de modelos. Esto reduce la necesidad de intervención manual, reduce los gastos de mano de obra y minimiza los costosos errores que podrían provocar repeticiones prolongadas. Estas funciones combinadas proporcionan una estructura de costes clara y predecible, lo que facilita a las empresas estadounidenses ampliar sus cargas de trabajo de IA de forma eficaz sin salirse del presupuesto.

Las plataformas de orquestación de IA ponen un gran énfasis en la seguridad y emplean métodos avanzados para proteger los datos, los modelos y los flujos de trabajo. Las características clave suelen incluir control de acceso basado en funciones (RBAC), que garantiza que los permisos de los usuarios se administren de manera estricta, junto con registros de auditoría detallados para realizar un seguimiento de todas las acciones con fines de cumplimiento. Para proteger aún más la información confidencial, estas plataformas se basan en cifrado de nivel empresarial para la protección de datos, tanto en reposo como durante la transmisión, cumpliendo con frecuencia con certificaciones como HIPAA y ISO 27001.

La seguridad se refuerza aún más con herramientas de gobierno que ayudan a rastrear los costos, hacer cumplir las políticas organizacionales y brindar una visibilidad clara de los patrones de uso. Muchas plataformas también aprovechan mecanismos de aislamiento de los proveedores de nube, garantizando que las cargas de trabajo de los clientes permanezcan separadas para mantener la confidencialidad, la integridad y la disponibilidad. Estas medidas permiten a las empresas gestionar con confianza sus modelos y flujos de trabajo de IA sin comprometer la seguridad.