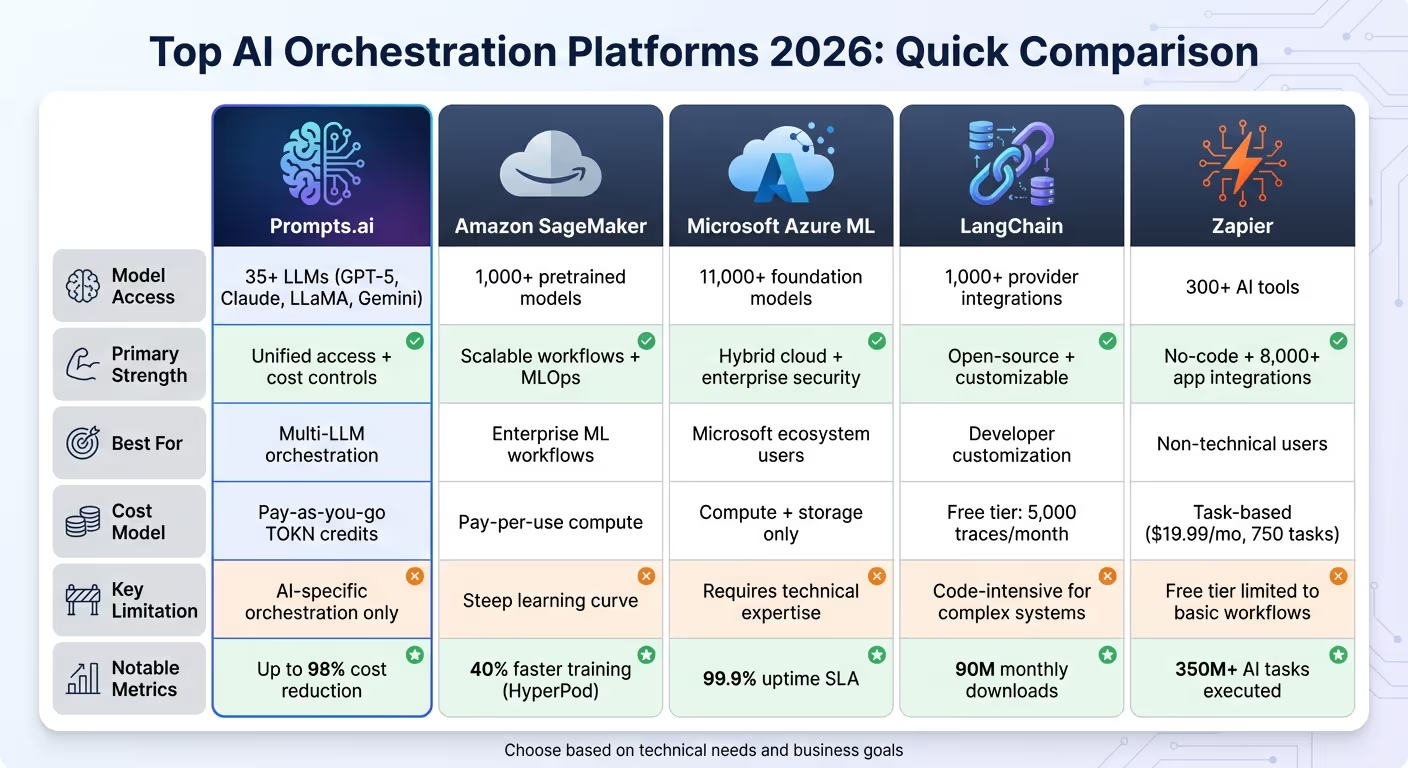

Les plateformes d'orchestration de l'IA transforment la façon dont les entreprises gèrent et déploient des modèles de langage volumineux (LLM) et des systèmes multi-agents. Ces outils simplifient les flux de travail, réduisent les coûts et améliorent la gouvernance en offrant un accès unifié aux principaux modèles d'IA, un routage intelligent et une surveillance en temps réel. À partir de Prompts.aides crédits TOKN économiques à ZapierGrâce à l'automatisation sans code, le marché en 2026 regorge d'options pour les équipes de toutes tailles.

Chaque plateforme répond à des besoins différents, qu'il s'agisse d'évolutivité de niveau entreprise, de personnalisation axée sur les développeurs ou d'automatisation conviviale. Vous trouverez ci-dessous une comparaison rapide de leurs forces et de leurs limites.

Choisissez la plateforme qui correspond à vos besoins techniques et à vos objectifs commerciaux pour rationaliser les flux de travail liés à l'IA, gagner du temps et réduire les coûts.

Plateformes d'orchestration d'IA 2026 : tableau comparatif des fonctionnalités

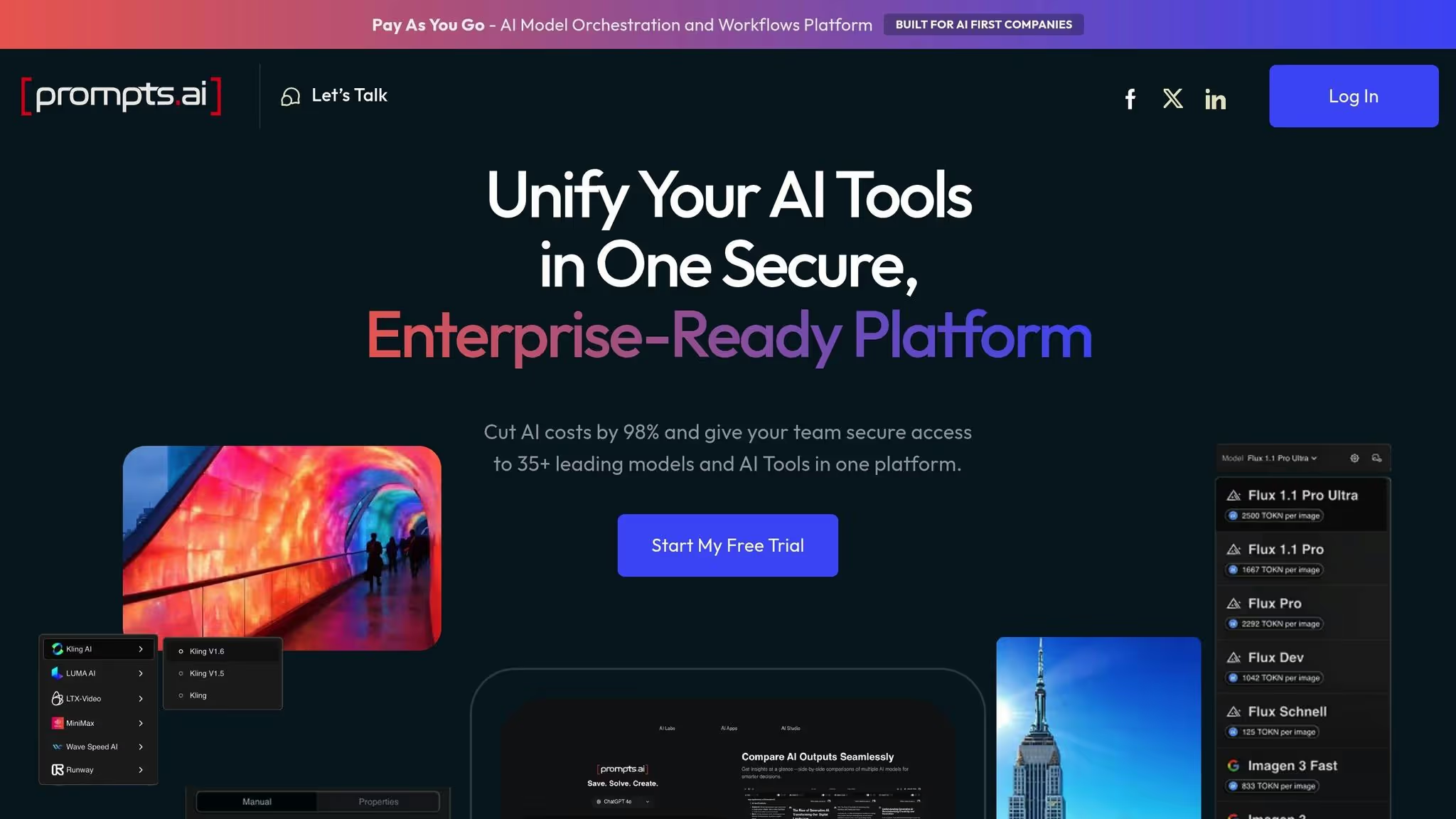

Prompts.ai se distingue en tant que plateforme d'entreprise conçue pour rationaliser les opérations d'IA en réunissant plus de 35 grands modèles de langage (LLM) de premier plan, notamment GPT-5, Claude, Lama, Gémeaux, Grok-4, Flux Pro et Kling, dans une interface cohérente. Fondée par Steven P. Simmons, directeur artistique lauréat d'un Emmy Award, la plateforme répond au besoin croissant des organisations d'unifier des outils d'IA fragmentés tout en maintenant la supervision et en gérant les coûts de manière efficace. Examinons ses caractéristiques remarquables.

Prompts.ai simplifie l'accès à plus de 35 LLM, éliminant ainsi le besoin d'abonnements séparés ou de configurations d'API complexes. Grâce à son interface unifiée, les utilisateurs peuvent comparer des modèles côte à côte, en s'assurant de sélectionner celui qui convient le mieux à leurs tâches, qu'il s'agisse de tirer parti de GPT-5 pour résoudre des problèmes complexes ou d'utiliser Claude pour des conversations engageantes et nuancées. En intégrant diverses fonctionnalités, la plateforme minimise les obstacles techniques, rendant l'adoption de l'IA plus fluide et plus efficace au sein des équipes.

Grâce à une couche FinOps intégrée, Prompts.ai adopte une approche plus intelligente de la gestion des coûts. Son système de crédit TOKN par répartition garantit aux entreprises de ne payer que pour ce qu'elles utilisent, ce qui peut réduire les dépenses liées aux logiciels d'IA de 98 % par rapport à la gestion de plusieurs services autonomes. Les équipes peuvent fixer des limites de dépenses, suivre les tendances d'utilisation et lier directement les dépenses liées à l'IA à des résultats commerciaux mesurables, ce qui permet de clarifier et de contrôler les budgets d'IA.

Prompts.ai donne la priorité à la sécurité et au contrôle à chaque étape. La plateforme garantit que les données sensibles restent dans le domaine de l'organisation tout en proposant des pistes d'audit détaillées pour toutes les interactions avec l'IA. La supervision centralisée favorise la conformité et réduit les risques associés à l'utilisation non autorisée des outils, créant ainsi une base sécurisée pour des flux de travail d'IA fluides et conformes.

Prompts.ai va au-delà de la gestion des outils en favorisant la collaboration entre les équipes. Il prend en charge un réseau croissant d'ingénieurs rapides certifiés, permettant aux entreprises de créer, de tester et de déployer des flux de travail rapides répétables. Cette approche transforme les expériences individuelles en processus standardisés, garantissant des résultats cohérents et fiables dans tous les départements.

Amazon SageMaker propose une plate-forme robuste pour gérer les flux de travail d'IA, en tirant parti de l'évolutivité et de la fiabilité de AWSde l'infrastructure cloud. Il réunit l'accès aux modèles, l'orchestration automatisée et la sécurité de niveau entreprise au sein d'un système cohérent. Cela en fait une solution incontournable pour les équipes travaillant sur tout, des projets d'apprentissage automatique traditionnels aux déploiements de modèles de base à grande échelle.

SageMaker JumpStart ouvre la voie à plus de 1 000 modèles d'IA préentraînés, y compris des modèles de base tels que Llama, Qwen, DeepSeek, GPT-OSS et Amazon Nova. Ces modèles prennent en charge diverses méthodes d'inférence (en temps réel, sans serveur, asynchrone et par lots) sur plus de 80 types d'instances. Pour les utilisateurs de Kubernetes, les opérateurs d'IA rationalisent la formation et l'orchestration des inférences, garantissant ainsi une intégration et une efficacité fluides.

Ces fonctionnalités permettent aux équipes de créer des opérations d'IA évolutives, sécurisées et rentables.

SageMaker utilise un modèle de tarification à l'utilisation, garantissant que les utilisateurs ne paient que pour le calcul, le stockage et le traitement qu'ils utilisent réellement. Son architecture sans serveur élimine les coûts associés aux ressources inutilisées, tandis que la fonction HyperPod réduit le temps de formation des modèles jusqu'à 40 % grâce à une formation sans point de contrôle. Pour des charges de travail prévisibles, les plans d'épargne et la facturation à la milliseconde fournissent des mesures supplémentaires de réduction des coûts. Ces fonctionnalités soulignent l'importance accordée par SageMaker à l'efficacité opérationnelle.

La sécurité est la pierre angulaire de SageMaker. Le gestionnaire de rôles SageMaker crée des politiques IAM spécifiques aux rôles, en imposant l'accès avec le moindre privilège en plus des limites du réseau et du chiffrement. SageMaker Catalog centralise la gouvernance des données et des modèles, tandis que Clarify garantit la conformité en surveillant les biais et les dérives. Des outils supplémentaires permettent d'identifier les informations sensibles (PII) et de filtrer les contenus préjudiciables, renforçant ainsi la confiance et la gouvernance.

« Amazon SageMaker propose une expérience utilisateur prête à l'emploi pour nous aider à déployer un environnement unique au sein de l'entreprise, réduisant ainsi d'environ 50 % le temps nécessaire à nos utilisateurs de données pour accéder aux nouveaux outils. » - Zachery Anderson, CDAO, NatWest Group

Avec SageMaker Pipelines, les utilisateurs peuvent passer à des dizaines de milliers de flux de travail d'apprentissage automatique simultanés. La plateforme ajuste dynamiquement les ressources de calcul pour gérer tout, des petites expériences aux déploiements à l'échelle de l'entreprise. HyperPod accélère encore le développement en utilisant des clusters de milliers d'accélérateurs d'IA pour des tâches d'entraînement intensives.

SageMaker se distingue également par sa capacité à favoriser la collaboration. Le SageMaker Unified Studio combine le traitement des données, l'analyse SQL et le développement de modèles d'IA dans un seul espace de travail. Cette approche unifiée permet aux équipes décentralisées de travailler ensemble de manière fluide sur les données gouvernées et la publication d'actifs d'IA. Des entreprises comme Toyota Motor Amérique du Nord et Carrier ont mis en œuvre avec succès ces capacités pour améliorer leurs opérations.

Microsoft Azure Machine Learning est conçu pour gérer de manière fluide les flux de travail d'IA dans les environnements sur site, en périphérie et multicloud. Cette approche hybride en fait une option hors pair pour répondre aux divers besoins de déploiement de l'IA.

Azure ML Catalogue de modèles sert de hub centralisé pour les modèles de base de Microsoft, IA ouverte, Visage étreignant, Méta, et Cohère. Le Flux rapide Cette fonctionnalité simplifie les flux de travail d'IA génératifs, permettant aux utilisateurs de concevoir, de tester et de déployer des flux de travail de modèles linguistiques sans avoir besoin d'une infrastructure personnalisée. Pour les organisations qui explorent l'IA basée sur les agents, le Service d'agent de fonderie fournit un environnement d'exécution unifié pour gérer les appels d'outils, les états des conversations et renforcer la sécurité du contenu dans les environnements de développement et de production. En outre, Microsoft Foundry donne accès à une bibliothèque complète de plus de 11 000 modèles de base, ouverts, rationnels et multimodaux.

« Sans le flux rapide d'Azure AI, nous aurions été contraints d'investir dans une ingénierie personnalisée assez importante pour fournir une solution. »

- Papinder Dosanjh, responsable de la science des données et de l'apprentissage automatique, ASOS

Azure Machine Learning élimine les frais de service directs en facturant aux utilisateurs uniquement les ressources de calcul et de stockage qu'ils utilisent, telles que les coffres-forts de clés. La plateforme routage intelligent des modèles garantit la rentabilité en sélectionnant automatiquement le modèle le plus adapté à chaque tâche en temps réel. Pour les applications de développement et de périphérie, Fonderie locale permet aux équipes d'exécuter des modèles de langage directement sur les appareils, évitant ainsi les coûts liés au cloud computing. Les terminaux gérés simplifient davantage le déploiement sur les clusters de processeurs et de GPU, réduisant ainsi les frais opérationnels.

Microsoft donne la priorité à la sécurité et à la conformité, employant 34 000 ingénieurs et détenant plus de 100 certifications de conformité. La plateforme s'intègre à Identifiant Microsoft Entra pour l'authentification, en proposant une authentification multifactorielle et un contrôle d'accès basé sur les rôles. Les données sont cryptées à l'aide de Normes AES 256 bits conformes à la norme FIPS 140-2, avec l'option pour les clés gérées par le client via Azure Key Vault. Azure ML gère également des pistes d'audit détaillées pour les actifs tels que les versions des données, les historiques des tâches et les métadonnées d'enregistrement des modèles, afin de garantir la conformité réglementaire. La plateforme garantit un SLA de disponibilité de 99,9 %, gage de fiabilité.

Azure ML s'appuie sur une infrastructure d'IA de pointe, notamment des GPU modernes et InfiniBand, pour gérer même les charges de travail les plus gourmandes en ressources de calcul. Le géant de la distribution Marks & Spencer utilise cette évolutivité pour servir plus de 30 millions de clients, en créant des solutions d'apprentissage automatique qui proposent des offres personnalisées et des services améliorés. Les capacités de calcul gérées de la plateforme permettent aux équipes d'évoluer sans effort, qu'il s'agisse de petites expériences ou de déploiements au niveau de l'entreprise, sans avoir à gérer une infrastructure complexe.

Azure Machine Learning favorise la collaboration en permettant aux équipes de partager et de réutiliser des modèles, des pipelines et d'autres actifs dans les espaces de travail de l'organisation via greffes. Cette fonctionnalité a joué un rôle déterminant pour BRF, où Alexandre Biazin, directeur exécutif de la technologie, a dirigé une équipe de 15 analystes dans la transition des tâches manuelles liées aux données vers des initiatives stratégiques utilisant l'apprentissage automatique automatisé et les MLOps. En outre, l'intégration avec Azure DevOps et Actions sur GitHub garantit une automatisation CI/CD fluide, permettant des pipelines reproductibles et des flux de déploiement efficaces pour les équipes distribuées.

LangChain est devenu un leader de l'orchestration des flux de travail basés sur l'IA, se distinguant comme le framework d'agents le plus téléchargé avec une impressionnante 90 millions de téléchargements mensuels et gagner plus de 100 000 étoiles sur GitHub. Elle est spécialisée dans la simplification des flux de travail complexes d'IA grâce à son cadre polyvalent de bas niveau, LangGraph. Cet outil fournit aux développeurs un contrôle total sur les flux de travail personnalisés des agents, en intégrant des fonctionnalités de mémoire et d'intervention humaine pour une flexibilité accrue. Ci-dessous, nous explorerons les principales fonctionnalités de LangChain, notamment les intégrations de modèles, la gestion des coûts, la sécurité, l'évolutivité et les outils de collaboration.

LangChain s'intègre à Plus de 1 000 meilleurs fournisseurs d'IA, notamment OpenAI, Anthropic, Google, AWS et Microsoft. Ses packages de fournisseurs autonomes simplifient le contrôle des versions et facilitent le passage d'un fournisseur à l'autre. La plateforme prend également en charge une gamme d'architectures cognitives telles que ReACT, Plan-and-Execute et les stratégies de collaboration multi-agents. De plus, son environnement d'exécution intègre des fonctionnalités de persistance, de point de contrôle et de « retour en arrière », garantissant une exécution fluide des tâches de longue durée.

Lang Smith, la suite d'optimisation des coûts de la plateforme, aide les utilisateurs à suivre et à gérer leurs dépenses de manière efficace. Il surveille les coûts, la latence et les taux d'erreur pour les appels LLM au sein des applications. Le niveau gratuit comprend 5 000 traces par mois pour le débogage et la surveillance, permettant aux équipes de contrôler leurs dépenses tout en préservant les performances.

LangChain donne la priorité à la conformité et à la sécurité, en respectant des normes telles que HIPAA, SOC 2 Type 2 et GDPR. Sa fonction « Agent Auth » fournit un contrôle détaillé des autorisations des outils et de l'accès aux données, combiné à un cryptage au repos et à une journalisation configurable. Le registre des agents simplifie davantage la gestion des agents en offrant une supervision centralisée et des approbations humaines.

Le déploiement de LangSmith garantit une évolutivité fluide grâce à des files d'attente de tâches optimisées conçues pour mise à l'échelle horizontale, ce qui lui permet de gérer le trafic au niveau de l'entreprise et les pics de charge de travail soudains sans ralentir. La plateforme prend en charge le déploiement en un clic avec des API qui gèrent automatiquement la mise à l'échelle et la gestion de la mémoire. Les développeurs peuvent empaqueter les applications sous forme de serveurs d'agents, avec des intergiciels, des itinéraires et des événements de cycle de vie personnalisés, garantissant ainsi un fonctionnement fluide dans des environnements à haute concurrence. Des entreprises comme Réplique, Cloudflare, Journée de travail, Rippling et Clay font confiance à LangChain pour sa capacité éprouvée à évoluer efficacement.

LangSmith améliore la collaboration en équipe en proposant des outils d'ingénierie rapide avec contrôle de version et terrains de jeu partagés. Une seule variable d'environnement connecte LangChain à LangSmith, permettant le traçage en temps réel, le suivi de la latence et la surveillance des erreurs. La plateforme s'intègre également parfaitement aux pipelines CI/CD, garantissant des déploiements fluides et fiables.

Zapier est un plateforme d'orchestration sans code qui se connecte via 8 000 applications et plus que 300 outils d'IA, permettant aux équipes d'automatiser des flux de travail complexes sans avoir besoin de ressources d'ingénierie. À ce jour, la plateforme a exécuté plus de 350 millions de tâches d'IA et bénéficie de la confiance de plus de 1 million d'entreprises en utilisant l'IA pour rationaliser leurs opérations. Les utilisateurs peuvent créer des flux de travail automatisés, appelés « Zaps », pour intégrer sans effort des modèles d'IA aux outils commerciaux traditionnels.

L'outil « AI by Zapier » de Zapier intègre les principaux LLM directement dans les flux de travail, offrant des fonctionnalités telles que l'analyse d'images, de sons et de vidéos. Les utilisateurs ont la possibilité d'apporter leurs propres clés d'API ou d'utiliser certains modèles gratuitement. La plateforme a également présenté Zapier MCP (Model Context Protocol), un connecteur sécurisé qui fournit des outils d'IA externes tels que Claude ou Chat GPT accès instantané à plus de 30 000 actions liées à l'application sans nécessiter d'intégrations d'API personnalisées. Pour les besoins avancés, Agents Zapier agissez en tant que coéquipiers IA autonomes, capables de raisonner, de mener des recherches sur le Web et d'exécuter des tâches dans l'ensemble de votre infrastructure technologique en fonction de commandes en langage naturel.

En 2025, Vendasta a tiré parti de Zapier, de ChatGPT et d'outils d'enrichissement des prospects pour automatiser les opérations de vente. Ce système résumait les transcriptions des appels et mettait à jour les CRM, récupérant 1 million de dollars de pertes de revenus tout en sauvant l'équipe commerciale 20 heures par jour. Jacob Sirrs, spécialiste des opérations marketing chez Vendasta, a déclaré :

« Zapier joue un rôle essentiel dans les opérations de Vendasta. Si nous le désactivions, nous devrions reconstruire de A à Z de nombreux flux de travail. »

Cette intégration transparente des modèles d'IA a prouvé qu'elle permettait une automatisation rentable de divers flux de travail.

Zapier fonctionne sur modèle de tarification basé sur les tâches, ne facturant que pour les actions terminées. Les fonctionnalités telles que les filtres et les chemins sont exclues des limites de tâches, offrant une alternative plus économique à la tarification basée sur le crédit. Le plan Professional commence à 19,99 $/mois (facturé annuellement) et comprend 750 tâches/mois, tandis que le plan gratuit fournit 100 tâches/mois. Les utilisateurs peuvent définir des limites de jetons et des alertes de plafonnement des coûts en suivant les étapes de l'IA pour contrôler les coûts d'utilisation du LLM.

Piscine, une société de cartes de visite numériques, a mis en œuvre Zapier et OpenAI pour gérer des centaines de demandes de démonstration quotidiennes. En remplaçant les intégrations manuelles coûteuses par une automatisation pilotée par l'IA, l'entreprise a réalisé des économies 20 000$ par année.

Zapier donne la priorité à la sécurité avec SOC 2 Type II et SOC 3 certifications, en totale conformité avec le RGPD, le RGPD UK et le CCPA. Les données sont protégées par TLS 1.2 chiffrement pour les communications en transit et Chiffrement AES-256 pour les données au repos. Les entreprises clientes sont automatiquement exclues de l'utilisation de leurs données pour la formation de modèles d'IA tiers, tandis que les autres peuvent se désinscrire via un formulaire de demande.

La plateforme fournit des options de contrôle détaillées, notamment RBAC, SSO/SAML et SCIM, ainsi que la capture de domaine pour empêcher toute utilisation informatique non autorisée. Connor Sheffield, responsable des opérations marketing et de l'automatisation chez Zones, a fait remarquer :

« Les clients nous font confiance pour assurer la sécurité de leurs données. Je suis sûr à 100 % que Zapier gère ces données avec la plus grande sécurité. »

Construit sur AWS, Zapier utilise un architecture pilotée par les événements pour garantir une évolutivité horizontale, en gérant différents volumes de flux de travail sans compromettre les performances. La régulation intelligente empêche la perte de données pendant les pics de trafic, tandis que la redondance intégrée garantit une haute disponibilité. Il n'est pas surprenant que 87 % des entreprises du Forbes Cloud 100 faites confiance à Zapier pour l'automatisation.

télécommande, une entreprise avec 1 700 employés, a utilisé les fonctionnalités d'IA de Zapier pour automatiser la réception et le triage du service d'assistance. Leur équipe informatique composée de trois personnes a résolu 28 % des billets automatiquement, en évitant 500 000$ en frais d'embauche supplémentaires. Marcus Saito, responsable de l'automatisation informatique et de l'IA chez Remote, a déclaré :

« Zapier donne à notre équipe de trois l'impression d'être une équipe de dix. »

Avec Toile Zapier, les équipes peuvent concevoir visuellement des flux de travail d'IA complexes avant leur mise en œuvre, garantissant ainsi la clarté de la logique et du flux de données. Le plan Team, au prix de 69$ par mois, inclut des dossiers partagés, des connexions aux applications et des rôles d'utilisateur pour une collaboration rationalisée. En outre, Tables Zapier agit comme une source de données unifiée, éliminant les silos et améliorant la coordination entre les services. Les analyses en temps réel fournissent des informations sur les coûts et la précision des tâches, s'intégrant parfaitement aux flux de travail existants.

Chaque plateforme présente ses propres avantages et défis lorsqu'il s'agit de déployer des flux de travail basés sur l'IA.

Prompts.ai se distingue par sa capacité à fournir un accès unifié à plus de 35 LLM, associé à des outils de gestion des coûts intégrés. Cela en fait un excellent choix pour les organisations qui recherchent la flexibilité entre plusieurs fournisseurs. Cependant, ses capacités sont axées sur l'orchestration de l'IA plutôt que sur la gestion d'une automatisation plus large de l'infrastructure.

Amazon SageMaker est une puissance en termes d'évolutivité et propose une boîte à outils MLOps robuste, ce qui en fait la solution idéale pour les déploiements LLM à grande échelle. Cela dit, sa courbe d'apprentissage abrupte et sa structure tarifaire complexe peuvent compliquer la planification et la budgétisation.

Apprentissage automatique Microsoft Azure fournit des outils de niveau professionnel et s'intègre parfaitement à Microsoft 365, destiné aux entreprises déjà investies dans l'écosystème Microsoft. Cependant, son déploiement et sa gestion nécessitent une expertise technique importante, et ses niveaux de tarification peuvent être complexes à gérer.

Chaîne Lang est le rêve de tout développeur avec son écosystème open source et plus de 1 000 intégrations, offrant une personnalisation sans précédent. Mais ce niveau de flexibilité s'accompagne d'un compromis : il peut être difficile à maîtriser, en particulier pour les systèmes multi-agents plus complexes, ce qui peut entraîner des problèmes de maintenance.

Zapier est leader en matière d'orchestration d'entreprise grâce à son générateur sans code et à plus de 8 000 intégrations d'applications, le rendant accessible aux utilisateurs sans connaissances en programmation. Cependant, son niveau gratuit limite les utilisateurs à des flux de travail de base en deux étapes, ce qui pousse souvent les équipes en pleine croissance à opter pour des forfaits payants. Les outils low-code et no-code devant alimenter environ 70 % des nouvelles applications d'entreprise d'ici 2025, Zapier est bien placé pour tirer parti de cette tendance.

Le tableau ci-dessous fournit une comparaison rapide des principaux points forts et limites de ces plateformes :

Choisir la bonne plateforme d'orchestration de l'IA en 2026 signifie trouver la meilleure adéquation entre vos besoins techniques et vos objectifs commerciaux tout en tirant parti des atouts uniques de chaque plateforme.

Les différentes plateformes s'adressent à des groupes d'utilisateurs distincts. Pour les entreprises profondément intégrées à AWS ou Azure, Sage Maker et Apprentissage automatique Azure offrent évolutivité, conformité et gouvernance avancée, même si elles sont soumises à des exigences techniques considérables. Les équipes de développeurs souhaitant créer des flux de travail multi-LLM personnalisés peuvent préférer Chaîne Lang, grâce à sa flexibilité open source et à ses nombreuses intégrations, malgré une courbe d'apprentissage plus abrupte. D'autre part, Zapier reste l'une des applications préférées des petites entreprises et des utilisateurs non techniques, offrant une automatisation sans code sur plus de 8 000 applications. Cependant, son niveau gratuit est limité aux flux de travail de base en deux étapes.

Prompts.ai se distingue en fournissant un accès fluide à plus de 35 LLM avec gestion intégrée des coûts. Cela en fait un excellent choix pour les équipes qui accordent la priorité à l'optimisation rapide et au contrôle des dépenses liées à l'IA. Son approche tout-en-un en matière d'orchestration, de contrôle des coûts et d'évolutivité reflète l'évolution des priorités de l'écosystème de l'IA.

À mesure que les plateformes évoluent, la coordination multi-agents et l'orchestration sans serveur façonnent l'avenir de l'IA. Que vous vous concentriez sur les MLOP de niveau entreprise, les outils de développement personnalisables ou l'automatisation conviviale sans code, les plateformes de 2026 peuvent évoluer parallèlement à vos initiatives d'IA, à condition qu'elles soient conformes à vos exigences techniques et à vos objectifs stratégiques en matière de création de flux de travail efficaces et rationalisés.

Les plateformes d'orchestration de l'IA remodèlent le mode de fonctionnement des entreprises en 2026, offrant un moyen plus intelligent de gérer les flux de travail d'apprentissage automatique. En fusionnant des tâches telles que l'exécution des modèles, le traitement des données et le déploiement dans un système cohérent, ces plateformes simplifient les opérations, permettent de gagner du temps et de réduire les coûts opérationnels.

Une caractéristique remarquable est leur suivi des coûts en temps réel associé à des outils de budgétisation avancés. Ces fonctionnalités permettent aux entreprises de suivre de près les dépenses liées à l'IA, de garantir une utilisation efficace des ressources et de réaliser des économies substantielles. De plus, des mesures de conformité et de sécurité intégrées aident les entreprises à répondre aux exigences réglementaires sans avoir à effectuer d'efforts manuels supplémentaires.

Grâce à leur capacité à automatiser les tâches, à connecter divers modèles et API et à dimensionner les charges de travail de manière fluide, ces plateformes permettent non seulement de minimiser les erreurs, mais également d'améliorer la productivité. Le résultat ? Les équipes peuvent toujours obtenir des résultats fiables en toute simplicité.

Prompts.ai simplifie la gestion des coûts liés à l'IA avec facturation transparente et basée sur l'utilisation et puissant outils permettant de réduire les coûts. Prenant en charge plus de 35 modèles en langage large, la plateforme dispose d'un tableau de bord des coûts en temps réel, vous permettant de surveiller l'utilisation des crédits symboliques pour chaque flux de travail. Cette visibilité permet d'identifier les inefficacités et de procéder à des ajustements immédiats pour rationaliser les dépenses.

À l'aide d'un modèle de paiement à l'utilisation alimenté par des crédits TOKN, vous ne payez que pour le calcul que vous utilisez réellement. Le moteur d'optimisation de la plateforme réduit encore les coûts en acheminant les demandes vers la variante de modèle la plus économique. De nombreux utilisateurs ont signalé jusqu'à 98 % d'économies par rapport aux méthodes de facturation traditionnelles par API.

Pour les entreprises qui recherchent des dépenses constantes, Prompts.ai propose également un plan d'abonnement compris entre 99$ et 129$ par utilisateur et par mois. Ce plan inclut une orchestration illimitée et un suivi des coûts en temps réel, offrant aux entreprises américaines un moyen prévisible de gérer leurs budgets d'IA. Grâce à cette approche, les organisations peuvent contrôler leurs dépenses, éliminer les frais imprévus tout en continuant à accéder à des fonctionnalités LLM avancées.

Prompts.ai donne la priorité à la protection de vos données grâce à des protocoles de sécurité avancés au niveau de l'entreprise. À travers contrôle d'accès basé sur les rôles (RBAC), la plateforme garantit que seules les personnes autorisées ont la possibilité d'accéder aux modèles et aux flux de travail ou de les ajuster. Pour améliorer la transparence, chaque action est méticuleusement documentée dans pistes d'audit, en créant un enregistrement détaillé indiquant qui a accédé à quoi et quand.

Vos données restent en sécurité avec chiffrement en transit et au repos, répondant aux normes les plus strictes de l'industrie. La plateforme comprend également des outils de gouvernance et de conformité, permettant à votre organisation d'appliquer des politiques, de suivre l'utilisation et de répondre parfaitement aux exigences réglementaires.