Las plataformas de orquestación de IA están transformando la forma en que las empresas gestionan e implementan modelos lingüísticos grandes (LLM) y sistemas multiagente. Estas herramientas simplifican los flujos de trabajo, reducen los costos y mejoran la gobernanza al ofrecer acceso unificado a los principales modelos de IA, enrutamiento inteligente y monitoreo en tiempo real. Desde Prompts.ai, que ahorra costos, TOKN acredita a Zapierde automatización sin código, el mercado en 2026 está repleto de opciones para equipos de todos los tamaños.

Cada plataforma satisface diferentes necesidades, ya sea que se trate de escalabilidad de nivel empresarial, personalización centrada en el desarrollador o automatización fácil de usar. A continuación se muestra una comparación rápida de sus puntos fuertes y limitaciones.

Elija la plataforma que se adapte a sus necesidades técnicas y objetivos empresariales para agilizar los flujos de trabajo de IA, ahorrar tiempo y reducir costos.

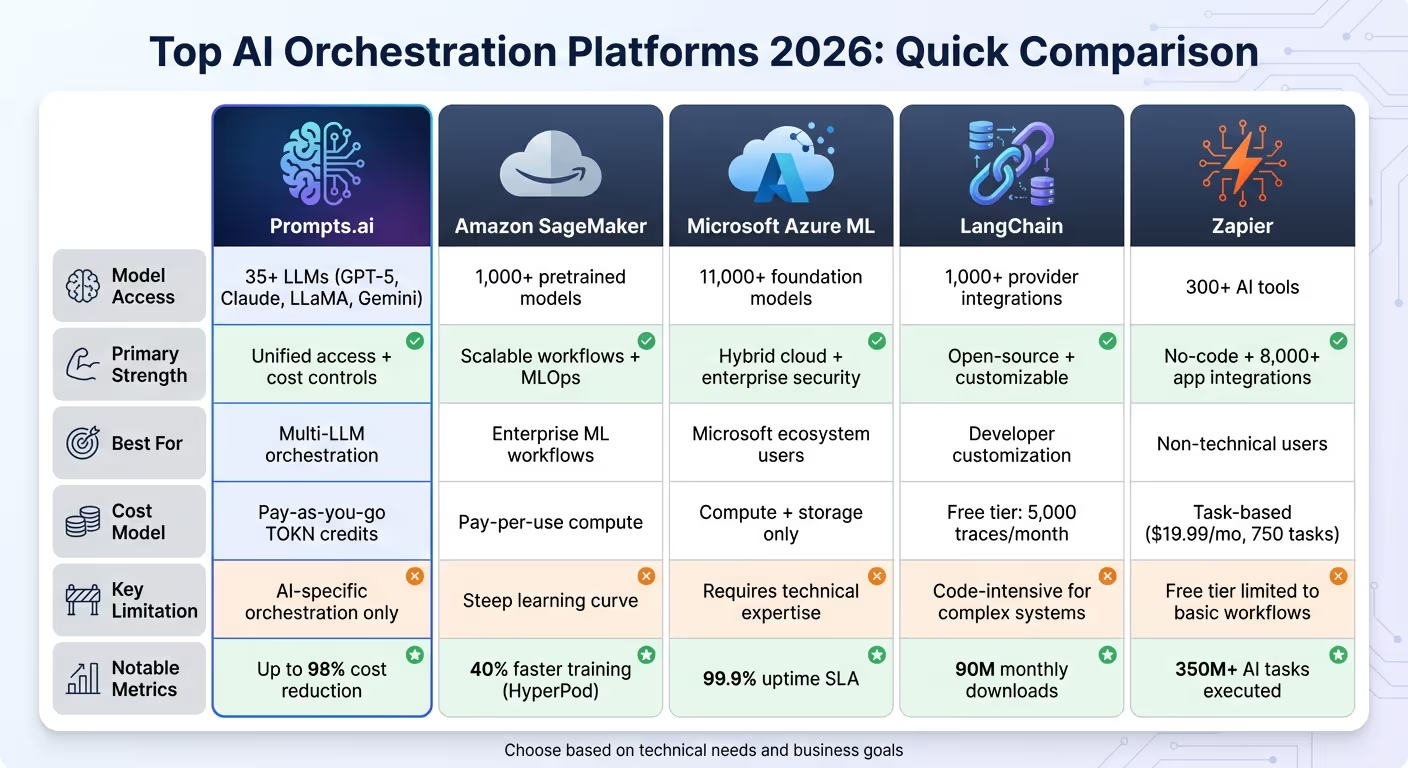

Plataformas de orquestación de IA 2026: cuadro comparativo de funciones

Prompts.ai se destaca como una plataforma de nivel empresarial diseñada para agilizar las operaciones de inteligencia artificial al reunir más de 35 modelos lingüísticos (LLM) de primer nivel, que incluyen GPT-5, Claudio, Llama, Géminis, Grok-4, Flux Pro y Kling, en una interfaz cohesiva. Fundada por Steven P. Simmons, director creativo ganador del premio Emmy, la plataforma responde a la creciente necesidad de las organizaciones de unificar las herramientas de IA fragmentadas y, al mismo tiempo, mantener la supervisión y gestionar los costes de forma eficaz. Analicemos sus características más destacadas.

Prompts.ai simplifica el acceso a más de 35 LLM, lo que elimina la necesidad de suscripciones independientes o configuraciones de API complejas. Gracias a su interfaz unificada, los usuarios pueden comparar los modelos en paralelo y asegurarse de seleccionar el que mejor se adapte a sus tareas, ya sea que utilicen el GPT-5 para resolver problemas complejos o que utilicen Claude para mantener conversaciones interesantes y llenas de matices. Al integrar diversas capacidades, la plataforma minimiza las barreras técnicas, lo que hace que la adopción de la IA sea más fluida y eficiente en todos los equipos.

Con una capa FinOps integrada, Prompts.ai adopta un enfoque más inteligente para administrar los costos. Su sistema de crédito TOKN de pago por uso garantiza que las empresas solo paguen por lo que utilizan, lo que podría reducir los gastos en software de inteligencia artificial hasta en un 98% en comparación con la combinación de varios servicios independientes. Los equipos pueden establecer límites de gastos, hacer un seguimiento de las tendencias de uso y vincular directamente los gastos de inteligencia artificial con resultados empresariales cuantificables, lo que aporta mayor claridad y control a los presupuestos de inteligencia artificial.

Prompts.ai prioriza la seguridad y el control en cada paso. La plataforma garantiza que los datos confidenciales permanezcan dentro del dominio de la organización y, al mismo tiempo, ofrece registros de auditoría detallados para todas las interacciones de la IA. La supervisión centralizada respalda el cumplimiento y reduce los riesgos asociados con el uso no autorizado de herramientas, lo que crea una base segura para flujos de trabajo de IA fluidos y conformes con las normas.

Prompts.ai va más allá de la gestión de herramientas al fomentar la colaboración entre los equipos. Es compatible con una red cada vez mayor de ingenieros de pronta certificados, lo que permite a las organizaciones crear, probar e implementar flujos de trabajo rápidos y repetibles. Este enfoque convierte la experimentación individual en procesos estandarizados, lo que garantiza resultados consistentes y confiables en todos los departamentos.

Amazon SageMaker ofrece una plataforma sólida para administrar los flujos de trabajo de IA, que aprovecha la escalabilidad y la confiabilidad de AWSde la infraestructura en la nube. Reúne el acceso basado en modelos, la orquestación automatizada y la seguridad de nivel empresarial en un sistema cohesivo. Esto lo convierte en la solución ideal para los equipos que trabajan en todo tipo de proyectos, desde proyectos tradicionales de aprendizaje automático hasta implementaciones de modelos básicos a gran escala.

SageMaker JumpStart abre la puerta a más de 1000 modelos de IA previamente entrenados, incluidos modelos básicos como Llama, Qwen, DeepSeek, GPT-OSS y Amazon Nova. Estos modelos admiten varios métodos de inferencia (en tiempo real, sin servidor, asincrónicos y por lotes) en más de 80 tipos de instancias. Para los usuarios de Kubernetes, los operadores de IA simplifican la formación y la organización de las inferencias, lo que garantiza una integración y una eficiencia fluidas.

Estas capacidades permiten a los equipos crear operaciones de IA escalables, seguras y rentables.

SageMaker emplea un modelo de precios de pago por uso, que garantiza que los usuarios solo paguen por la computación, el almacenamiento y el procesamiento que realmente utilizan. Su arquitectura sin servidores elimina los costos asociados a los recursos inactivos, mientras que la función HyperPod reduce el tiempo de entrenamiento del modelo hasta en un 40% mediante un entrenamiento sin puntos de control. Para cargas de trabajo predecibles, los planes de ahorro y la facturación en milisegundos proporcionan medidas adicionales de ahorro de costos. Estas funciones destacan el enfoque de SageMaker en la eficiencia operativa.

La seguridad es la piedra angular de SageMaker. El administrador de funciones de SageMaker crea políticas de IAM específicas para cada rol, lo que garantiza el acceso con privilegios mínimos, además de los límites de la red y el cifrado. El catálogo de SageMaker centraliza la gestión de los datos y los modelos, mientras que Clarify garantiza el cumplimiento mediante la supervisión de los sesgos y las desviaciones. Las herramientas adicionales ayudan a identificar la información confidencial (PII) y a filtrar el contenido perjudicial, lo que refuerza la confianza y la gobernanza.

«Amazon SageMaker ofrece una experiencia de usuario lista para usar que nos ayuda a implementar un entorno único en toda la organización, lo que reduce en aproximadamente un 50% el tiempo necesario para que nuestros usuarios de datos accedan a las nuevas herramientas». - Zachery Anderson, CDAO, NatWest Group

Con SageMaker Pipelines, los usuarios pueden escalar a decenas de miles de flujos de trabajo de aprendizaje automático simultáneos. La plataforma ajusta de forma dinámica los recursos informáticos para gestionar todo tipo de tareas, desde pequeños experimentos hasta despliegues a escala empresarial. HyperPod acelera aún más el desarrollo al utilizar grupos de miles de aceleradores de inteligencia artificial para tareas de entrenamiento intensivas.

SageMaker también destaca por fomentar la colaboración. SageMaker Unified Studio combina el procesamiento de datos, el análisis de SQL y el desarrollo de modelos de IA en un único espacio de trabajo. Este enfoque unificado permite a los equipos descentralizados trabajar juntos sin problemas en la publicación de activos de IA y datos gobernados. Empresas como Toyota Motor Norteamérica y Carrier han implementado con éxito estas capacidades para mejorar sus operaciones.

Microsoft Azure Machine Learning está diseñado para administrar sin problemas los flujos de trabajo de IA en entornos locales, periféricos y multinube. Este enfoque híbrido lo convierte en una opción sobresaliente para gestionar diversas necesidades de implementación de la IA.

Aprendizaje automático de Azure Catálogo de modelos sirve como un centro centralizado para los modelos básicos de Microsoft, IA abierta, Cara abrazada, Meta, y CoHERE. El Flujo rápido La función simplifica los flujos de trabajo generativos de IA, lo que permite a los usuarios diseñar, probar e implementar flujos de trabajo de modelos lingüísticos sin la necesidad de una infraestructura personalizada. Para las organizaciones que exploran la IA basada en agentes, el Servicio de agente de fundición proporciona un tiempo de ejecución unificado para gestionar las llamadas a las herramientas, los estados de las conversaciones y garantizar la seguridad del contenido en los entornos de desarrollo y producción. Además, Microsoft Foundry ofrece acceso a una amplia biblioteca con más de 11 000 modelos básicos, abiertos, razonados y multimodales.

«Sin Azure AI Prompt Flow, nos habríamos visto obligados a invertir en una ingeniería personalizada bastante importante para ofrecer una solución».

- Papinder Dosanjh, director de ciencia de datos y aprendizaje automático de ASOS

Azure Machine Learning elimina las tarifas de servicio directas y cobra a los usuarios solo por los recursos de procesamiento y almacenamiento que utilizan, como los almacenes de claves. La plataforma enrutamiento de modelos inteligentes garantiza la rentabilidad al seleccionar automáticamente el modelo más adecuado para cada tarea en tiempo real. Para aplicaciones de desarrollo y periféricas, Fundición local permite a los equipos ejecutar modelos lingüísticos directamente en los dispositivos, lo que evita los costos de computación en la nube. Los terminales gestionados simplifican aún más la implementación en clústeres de CPU y GPU, lo que reduce la sobrecarga operativa.

Microsoft prioriza la seguridad y el cumplimiento, ya que emplea a 34 000 ingenieros y posee más de 100 certificaciones de cumplimiento. La plataforma se integra con Microsoft Entra ID para la autenticación, que ofrece autenticación multifactorial y control de acceso basado en roles. Los datos se cifran mediante Estándares AES de 256 bits que cumplen con FIPS 140-2, con la opción de claves administradas por el cliente a través de Azure Key Vault. Azure ML también mantiene registros de auditoría detallados para activos como las versiones de datos, los historiales de trabajos y los metadatos de registro de modelos, lo que contribuye al cumplimiento de las normativas. La plataforma garantiza un SLA con un tiempo de actividad del 99,9%, lo que garantiza la fiabilidad.

Azure ML aprovecha la infraestructura de inteligencia artificial de vanguardia, que incluye GPU modernas y InfiniBand, para gestionar incluso las cargas de trabajo con un uso más intensivo de recursos informáticos. El gigante minorista Marks & Spencer utiliza esta escalabilidad para atender a más de 30 millones de clientes, creando soluciones de aprendizaje automático que ofrecen ofertas personalizadas y servicios mejorados. Las capacidades informáticas gestionadas de la plataforma permiten a los equipos escalar sin esfuerzo, desde pequeños experimentos hasta despliegues de nivel empresarial, sin la carga de gestionar infraestructuras complejas.

Azure Machine Learning fomenta la colaboración al permitir a los equipos compartir y reutilizar modelos, canalizaciones y otros activos en los espacios de trabajo de la organización a través de registros. Esta función fue fundamental para BRF, donde Alexandre Biazin, director ejecutivo de tecnología, dirigió un equipo de 15 analistas en la transición de las tareas manuales de datos a las iniciativas estratégicas mediante el aprendizaje automático y los MLOP automatizados. Además, la integración con Azure DevOps y Acciones de GitHub garantiza una automatización de CI/CD sin interrupciones, lo que permite canalizaciones reproducibles y flujos de trabajo de implementación eficientes para los equipos distribuidos.

LangChain se ha convertido en líder en la orquestación de flujos de trabajo de IA, destacándose como el marco de agentes más descargado con una impresionante 90 millones de descargas mensuales y ganando más 100 000 estrellas de GitHub. Se especializa en simplificar los flujos de trabajo complejos de IA a través de su versátil marco de bajo nivel, Gráfico de largo. Esta herramienta proporciona a los desarrolladores un control total sobre los flujos de trabajo personalizados de los agentes, al integrar la memoria y las capacidades de intervención humana para mejorar la flexibilidad. A continuación, analizaremos las principales funciones de LangChain, incluidas las integraciones de modelos, la gestión de costes, la seguridad, la escalabilidad y las herramientas de colaboración.

LangChain se integra con Más de 1000 proveedores principales de IA, incluidos OpenAI, Anthropic, Google, AWS y Microsoft. Sus paquetes de proveedores independientes simplifican el control de versiones y facilitan el cambio de proveedor. La plataforma también admite una variedad de arquitecturas cognitivas, como ReAct, Plan-and-Execute y estrategias de colaboración entre múltiples agentes. Además, su motor de ejecución incorpora funciones de persistencia, control y «rebobinado», lo que garantiza una ejecución fluida de las tareas de larga duración.

Lang Smith, la suite de optimización de costos de la plataforma, ayuda a los usuarios a rastrear y administrar los gastos de manera efectiva. Supervisa los costos, la latencia y las tasas de error de las llamadas de LLM dentro de las aplicaciones. La capa gratuita incluye 5000 trazas al mes para la depuración y la supervisión, lo que permite a los equipos controlar los gastos y, al mismo tiempo, mantener el rendimiento.

LangChain prioriza el cumplimiento y la seguridad, adhiriéndose a estándares como HIPAA, SOC 2 tipo 2 y GDPR. Su función de «autenticación de agente» proporciona un control detallado sobre los permisos de las herramientas y el acceso a los datos, junto con el cifrado en reposo y el registro configurable. El registro de agentes simplifica aún más la administración de los agentes al ofrecer una supervisión centralizada y aprobaciones personalizadas.

LangSmith Deployment garantiza un escalado perfecto con colas de tareas optimizadas diseñadas para escalado horizontal, lo que la hace capaz de gestionar el tráfico de nivel empresarial y los picos repentinos de carga de trabajo sin ralentizarse. La plataforma admite la implementación con un solo clic con API que gestionan automáticamente el escalado automático y la administración de la memoria. Los desarrolladores pueden empaquetar las aplicaciones como servidores de agentes, con middleware personalizado, rutas y eventos del ciclo de vida, lo que garantiza un funcionamiento fluido en entornos de alta concurrencia. Empresas como Réplica, Cloudflare, Jornada laboral, Rippling y Clay confían en LangChain por su capacidad comprobada para escalar de forma eficaz.

LangSmith mejora la colaboración en equipo al ofrecer herramientas para una ingeniería rápida con control de versiones y áreas de juego compartidas. Una única variable de entorno conecta LangChain con LangSmith, lo que permite el rastreo en tiempo real, el seguimiento de la latencia y la supervisión de errores. La plataforma también se integra perfectamente con las canalizaciones de CI/CD, lo que garantiza implementaciones fluidas y confiables.

Zapier es un plataforma de orquestación sin código que se conecta 8.000 aplicaciones y más de 300 herramientas de IA, lo que permite a los equipos automatizar flujos de trabajo complejos sin necesidad de recursos de ingeniería. Hasta la fecha, la plataforma ha superado 350 millones de tareas de IA y cuenta con la confianza de más de 1 millón de empresas utilizan la IA para agilizar sus operaciones. Los usuarios pueden crear flujos de trabajo automatizados, conocidos como «Zaps», para integrar sin esfuerzo los modelos de IA con las herramientas empresariales tradicionales.

La herramienta «AI by Zapier» de Zapier incorpora los principales LLM directamente en los flujos de trabajo y ofrece capacidades como el análisis de imágenes, audio y vídeo. Los usuarios tienen la flexibilidad de traer sus propias claves de API o usar modelos seleccionados sin costo alguno. La plataforma también presentó Zapier MCP (protocolo de contexto modelo), un conector seguro que proporciona herramientas de IA externas como Claude o Chat GPT acceso instantáneo a más de 30 000 acciones de aplicaciones sin necesidad de integraciones de API personalizadas. Para necesidades avanzadas, Agentes de Zapier actúa como compañeros de equipo de IA autónomos, capaces de razonar, realizar investigaciones web y ejecutar tareas en todo tu conjunto tecnológico basándose en comandos de lenguaje natural.

En 2025, Vendasta utilizó Zapier junto con ChatGPT y las herramientas de enriquecimiento de clientes potenciales para automatizar las operaciones de ventas. Este sistema resumió las transcripciones de llamadas y actualizó los CRM, recuperando 1 millón de dólares en ingresos perdidos al tiempo que ahorra al equipo de ventas 20 horas diarias. Jacob Sirrs, especialista en operaciones de marketing de Vendasta, compartió:

«Zapier es fundamental para las operaciones de Vendasta; si lo desactiváramos, tendríamos que reconstruir muchos flujos de trabajo desde cero».

Esta perfecta integración de los modelos de IA ha demostrado que impulsa la automatización rentable en diversos flujos de trabajo.

Zapier opera en un modelo de precios basado en tareas, cobrando solo por las acciones completadas. Funciones como los filtros y las rutas están excluidas de los límites de tareas, lo que ofrece una alternativa más económica a los precios basados en créditos. El plan Professional comienza en 19,99 €/mes (facturado anualmente) e incluye 750 tareas/mes, mientras que el plan gratuito ofrece 100 tareas/mes. Los usuarios pueden establecer límites de tokens y alertas de límites de costos dentro de las etapas de la IA para mantener bajo control los costos de uso de la LLM.

Piscina, una empresa de tarjetas de presentación digitales, implementó Zapier y OpenAI para gestionar cientos de solicitudes de demostración diarias. Al cambiar las costosas integraciones manuales por la automatización basada en la inteligencia artificial, la empresa ahorró 20 000$ al año.

Zapier prioriza la seguridad con SOC 2 tipo II y SOC 3 certificaciones, cumpliendo plenamente con el RGPD, el RGPD del Reino Unido y la CCPA. Los datos están protegidos mediante TLS 1.2 cifrado para las comunicaciones en tránsito y Cifrado AES-256 para datos en reposo. Los clientes empresariales quedan automáticamente excluidos del uso de sus datos para entrenar modelos de IA de terceros, mientras que otros pueden optar por no participar mediante un formulario de solicitud.

La plataforma ofrece opciones de control detalladas, que incluyen RBAC, SSO/SAML y SCIM, junto con la captura de dominios para evitar el uso no autorizado de la TI. Connor Sheffield, director de operaciones de marketing y automatización de Zonos, comentó:

«Los clientes confían en nosotros para mantener sus datos seguros y protegidos. Tengo el 100% de confianza en que Zapier maneja esos datos con la máxima seguridad».

Basado en AWS, Zapier usa un arquitectura basada en eventos para garantizar la escalabilidad horizontal, gestionando volúmenes de flujo de trabajo variables sin comprometer el rendimiento. La regulación inteligente evita la pérdida de datos durante los picos de tráfico, mientras que la redundancia integrada garantiza una alta disponibilidad. No es de extrañar que El 87% de las empresas Forbes Cloud 100 confíe en Zapier para la automatización.

Remoto, una empresa con 1.700 empleados, utilizó las funciones de inteligencia artificial de Zapier para automatizar la admisión y la clasificación del servicio de asistencia. Su equipo de TI compuesto por tres personas resolvió 28% de las entradas de forma automática, evitando 500 000$ en costos de contratación adicionales. Marcus Saito, director de automatización de TI e IA de Remote, señaló:

«Zapier hace que nuestro equipo de tres se sienta como un equipo de diez».

Con Lienzo Zapier, los equipos pueden diseñar visualmente flujos de trabajo de IA complejos antes de la implementación, lo que garantiza la claridad de la lógica y el flujo de datos. El plan Team, con un precio de 69$ al mes, incluye carpetas compartidas, conexiones a aplicaciones y funciones de usuario para agilizar la colaboración. Además, Mesas Zapier actúa como una fuente de datos unificada, eliminando los silos y mejorando la coordinación entre los departamentos. Los análisis en tiempo real proporcionan información sobre los costos y la precisión de las tareas, y se integran perfectamente con los flujos de trabajo existentes.

Cada plataforma aporta su propio conjunto de ventajas y desafíos a la hora de implementar flujos de trabajo de IA.

Prompts.ai destaca por su capacidad de proporcionar acceso unificado a más de 35 LLM, junto con herramientas integradas de administración de costos. Esto lo convierte en una excelente opción para las organizaciones que buscan flexibilidad con varios proveedores. Sin embargo, sus capacidades se centran en la orquestación de la IA en lugar de gestionar una automatización más amplia de la infraestructura.

Amazon SageMaker es una fuente inagotable de escalabilidad y ofrece un sólido conjunto de herramientas de mLOps, lo que lo hace ideal para despliegues de LLM a gran escala. Dicho esto, su pronunciada curva de aprendizaje y su intrincada estructura de precios pueden dificultar la planificación y la elaboración de presupuestos.

Aprendizaje automático de Microsoft Azure ofrece herramientas de nivel empresarial y una integración perfecta con Microsoft 365, para empresas que ya han invertido en el ecosistema de Microsoft. Sin embargo, su implementación y administración requieren una gran experiencia técnica, y sus niveles de precios pueden resultar complejos de manejar.

Cadena LANG es el sueño de todo desarrollador con su ecosistema de código abierto y más de 1000 integraciones, que ofrecen una personalización sin igual. Sin embargo, este nivel de flexibilidad tiene un inconveniente: puede resultar difícil dominarlo, especialmente en el caso de sistemas multiagente más complejos, lo que puede provocar cuellos de botella en el mantenimiento.

Zapier lidera la orquestación empresarial con su generador sin código y más de 8000 integraciones de aplicaciones, lo que hace que sea accesible para los usuarios sin conocimientos de programación. Sin embargo, su nivel gratuito limita a los usuarios a flujos de trabajo básicos de dos pasos, lo que a menudo empuja a los equipos en crecimiento a optar por planes de pago. Dado que se espera que las herramientas con bajo o sin código sirvan para alrededor del 70% de las nuevas aplicaciones empresariales de aquí a 2025, Zapier está bien posicionada para beneficiarse de esta tendencia.

La siguiente tabla ofrece una comparación rápida de las principales fortalezas y limitaciones de estas plataformas:

Elegir la plataforma de orquestación de IA adecuada en 2026 significa encontrar la mejor opción entre sus necesidades técnicas y sus objetivos empresariales y, al mismo tiempo, aprovechar las fortalezas únicas de cada plataforma.

Las diferentes plataformas se adaptan a distintos grupos de usuarios. Para empresas profundamente integradas con AWS o Azure, Creador de salvia y Aprendizaje automático de Azure ofrecen escalabilidad, cumplimiento y gobierno avanzado, aunque conllevan considerables exigencias técnicas. Es posible que los equipos de desarrolladores que deseen crear flujos de trabajo personalizados de varios LLM prefieran Cadena LANG, gracias a su flexibilidad de código abierto y a sus amplias integraciones, a pesar de la curva de aprendizaje más pronunciada. Por otro lado, Zapier sigue siendo una de las favoritas de las pequeñas empresas y los usuarios sin conocimientos técnicos, ya que ofrece automatización sin código en más de 8000 aplicaciones. Sin embargo, su nivel gratuito se limita a los flujos de trabajo básicos de dos pasos.

Prompts.ai se destaca por proporcionar un acceso sin interrupciones a más de 35 LLM con una gestión de costos integrada. Esto lo convierte en una excelente opción para los equipos que priorizan la optimización rápida y controlan los gastos de inteligencia artificial. Su enfoque integral para la orquestación, el control de costos y la escalabilidad refleja las prioridades cambiantes del ecosistema de la IA.

A medida que las plataformas evolucionan, la coordinación entre múltiples agentes y la orquestación sin servidores están configurando el futuro de la IA. Ya sea que se centre en los MLOP de nivel empresarial, en las herramientas de desarrollo personalizables o en la automatización sin código fácil de usar, las plataformas de 2026 pueden escalar junto con sus iniciativas de inteligencia artificial, siempre que se ajusten a sus requisitos técnicos y objetivos estratégicos para crear flujos de trabajo eficientes y optimizados.

Las plataformas de orquestación de IA están transformando la forma en que operan las empresas en 2026, ofreciendo una forma más inteligente de gestionar los flujos de trabajo de aprendizaje automático. Al combinar tareas como la ejecución de modelos, el procesamiento de datos y la implementación en un sistema cohesivo, estas plataformas simplifican las operaciones, ahorran tiempo y reducen los costos operativos.

Una característica destacada es su seguimiento de costos en tiempo real junto con herramientas avanzadas de presupuestación. Estas capacidades permiten a las organizaciones vigilar de cerca los gastos de inteligencia artificial, garantizar que los recursos se utilicen de manera eficiente y generar ahorros sustanciales. Además, las medidas integradas de cumplimiento y seguridad ayudan a las empresas a cumplir los requisitos reglamentarios sin necesidad de realizar un esfuerzo manual adicional.

Con la capacidad de automatizar tareas, conectar diversos modelos y API y escalar las cargas de trabajo sin problemas, estas plataformas no solo minimizan los errores sino que también mejoran la productividad. ¿Cuál es el resultado? Los equipos pueden ofrecer resultados fiables de forma constante y con menos complicaciones.

Prompts.ai simplifica la gestión de costes de la IA con facturación transparente y basada en el uso y poderoso herramientas que ahorran costes. La plataforma, que admite más de 35 modelos que hablan muchos idiomas, cuenta con un panel de costes en tiempo real, que te permite supervisar el uso de créditos simbólicos en cada flujo de trabajo. Esta visibilidad ayuda a identificar las ineficiencias y a realizar ajustes inmediatos para optimizar los gastos.

Uso de un modelo de pago por uso con créditos TOKN, solo pagas por la computación que realmente utilizas. El motor de optimización de la plataforma reduce aún más los costos al dirigir las solicitudes a la variante de modelo más económica. Muchos usuarios han informado de hasta Ahorro del 98% en comparación con los métodos tradicionales de facturación por API.

Para las empresas que buscan gastos constantes, Prompts.ai también ofrece un plan de suscripción con un precio de entre 99 y 129 USD por usuario al mes. Este plan incluye una orquestación ilimitada y un seguimiento de los costes en tiempo real, lo que proporciona a las empresas estadounidenses una forma predecible de gestionar los presupuestos de IA. Con este enfoque, las organizaciones pueden controlar los gastos, eliminar los cargos inesperados y seguir accediendo a capacidades avanzadas de LLM.

Prompts.ai prioriza la protección de sus datos con protocolos de seguridad avanzados de nivel empresarial. A través de control de acceso basado en funciones (RBAC), la plataforma garantiza que solo las personas autorizadas tengan la capacidad de acceder o ajustar modelos y flujos de trabajo. Para mejorar la transparencia, cada acción se documenta meticulosamente en registros de auditoría, creando un registro detallado de quién accedió a qué y cuándo.

Sus datos permanecen seguros con cifrado tanto en tránsito como en reposo, cumpliendo con los estándares más importantes de la industria. La plataforma también incluye funciones integradas herramientas de gobierno y cumplimiento, lo que permite a su organización hacer cumplir las políticas, realizar un seguimiento del uso y cumplir sin problemas los requisitos reglamentarios.