Les outils de comparaison des LLM vous aident à évaluer de grands modèles linguistiques (LLM) tels que TPT, Claude, Gémeaux, et Lama en analysant leurs performances sur les mêmes tâches et instructions. Ces outils se concentrent sur des indicateurs pratiques tels que coût par million de jetons (USD), la latence, la précision du raisonnement et les taux d'hallucination dans les environnements de production. Leur objectif est d'aider les entreprises à sélectionner les meilleurs modèles pour des flux de travail spécifiques, en équilibrant qualité, rapidité et coût.

Les principaux avantages sont les suivants :

Les meilleurs outils :

Astuce rapide: commencez par les classements pour obtenir des informations générales, puis utilisez des outils tels que Prompts.ai pour des évaluations personnalisées avec des tâches réelles. Cette approche à plusieurs niveaux vous permet de sélectionner la solution la mieux adaptée à vos besoins tout en gérant les coûts et la conformité.

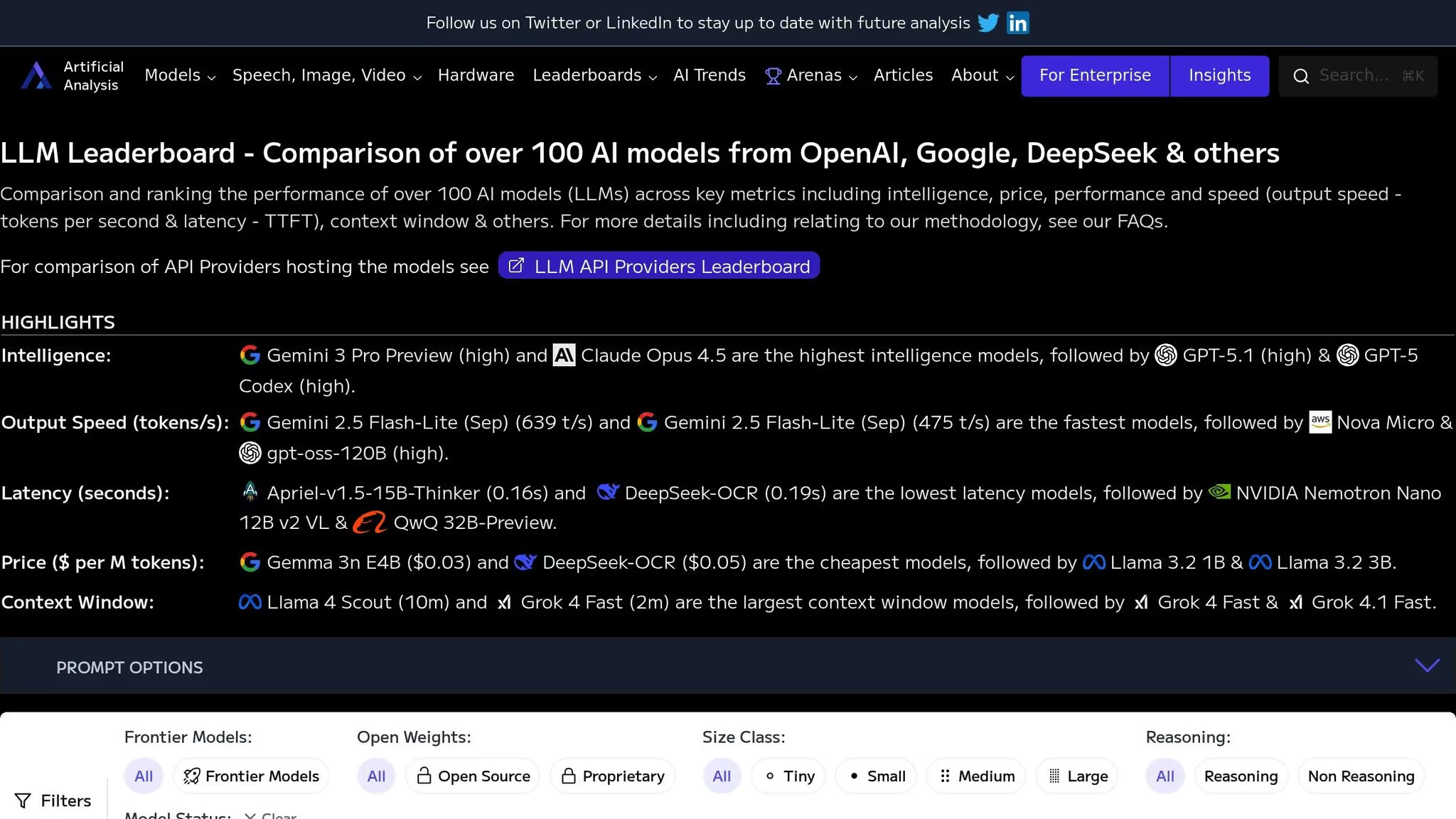

Les classements publics pour les grands modèles linguistiques (LLM) classent différents modèles en appliquant des critères de référence standardisés. Ces plateformes évaluent les modèles à l'aide de métriques cohérentes sur des entrées identiques, puis présentent les résultats dans un format classé. Les principaux critères d'évaluation incluent l'exactitude des réponses, la similitude sémantique et les taux d'hallucination. Par exemple, Visage étreignant héberge un classement LLM ouvert largement utilisé, qui suit des indicateurs tels que MMLU (Compréhension approfondie du langage multitâche), GPQA (Réponse aux questions de niveau supérieur), vitesse de traitement, coût par million de jetons (en dollars américains) et taille de la fenêtre contextuelle sur de nombreux modèles open source.

Le processus de classement consiste à fournir des entrées identiques à tous les modèles, à évaluer leurs réponses sur la base de mesures prédéfinies et à générer des scores en conséquence. Bien que cette méthode donne un aperçu clair des fonctionnalités générales, elle reflète principalement les préférences agrégées des utilisateurs et la standardisation des performances des tâches. Cependant, il ne tient pas compte des performances des modèles dans des scénarios spécifiques du monde réel. Cette approche standardisée est utile pour des comparaisons générales, mais elle n'offre pas l'adaptabilité requise pour des applications de niche ou spécifiques à un secteur.

Les classements publics s'appuient sur des tests fixes pour évaluer les modèles en utilisant des critères généraux. Bien qu'elle soit utile pour les évaluations générales, cette configuration offre une flexibilité limitée aux organisations qui ont besoin de mesurer les performances des modèles dans des cas d'utilisation spécialisés ou de répondre à des exigences spécifiques au secteur. Des facteurs tels que la démographie des utilisateurs, la rapidité de formulation et les tendances en matière de vote peuvent également influencer le classement. Pour les entreprises nécessitant des évaluations précises basées sur la précision ou la conformité spécifiques à un domaine, ces classements généraux peuvent ne pas fournir le niveau de détail nécessaire.

Les classements LLM sont principalement conçus comme des outils de référence pour guider la recherche initiale de modèles plutôt que comme des composants interactifs des flux de travail d'IA. Ils fournissent des classements statiques qui aident à affiner les options, mais ne facilitent pas la sélection ou le déploiement automatisés. Pour combler cette lacune, des plateformes spécialisées permettent de réaliser des tests côte à côte, d'utiliser des métriques personnalisées, de fournir un feedback humain et de rationaliser la gestion de la transition des modèles. Ces outils permettent de transformer les données de référence en informations exploitables. En outre, des outils de suivi des classements peuvent être intégrés aux flux de travail pour surveiller les performances après le déploiement. Cela est particulièrement utile pour des tâches telles que l'évaluation du sentiment de marque ou de la visibilité du contenu généré par l'IA.

Cette approche innovante va au-delà des classements publics traditionnels en utilisant un grand modèle linguistique (LLM) pour évaluer d'autres modèles. Les classements des modèles d'analyse artificielle s'appuient sur LLM en tant que juge méthode, dans laquelle un puissant LLM évalue et note les résultats en fonction de critères prédéfinis, rationalisant ainsi le processus d'évaluation [12, 16, 11, 17, 18]. Examinons le fonctionnement de cette méthodologie, ses options de personnalisation et la manière dont elle s'intègre aux flux de travail.

Le LLM en tant que juge Cette méthode simplifie l'évaluation de plusieurs modèles en tirant parti des capacités d'un LLM hautement performant. Ce modèle passe en revue les résultats d'autres LLM et attribue des scores en fonction de facteurs tels que la cohérence, la pertinence et le ton. Cette approche est particulièrement utile pour les évaluations contenant beaucoup de texte où les qualités subjectives sont importantes, ce qui réduit considérablement la nécessité d'une implication humaine importante.

Le classement des modèles d'analyse artificielle propose plusieurs options de filtrage pour personnaliser les comparaisons de modèles. Les utilisateurs peuvent trier les modèles selon des attributs tels que « Modèles frontières », « Poids ouverts », « Classe de taille », « Raisonnement » et « État du modèle ». Cependant, il ne dispose actuellement pas de fonctionnalités permettant d'intégrer des métriques personnalisées, des ensembles de données spécifiques au secteur ou des méthodes d'évaluation axées sur les tâches. Cette limitation peut poser des problèmes aux organisations ayant des besoins d'évaluation spécialisés.

Les capacités d'intégration varient en fonction de la conception de l'outil. Certains systèmes permettent des intégrations d'API simples, tandis que d'autres proposent des solutions plus robustes, basées sur un proxy, qui fonctionnent sur plusieurs terminaux LLM. Le succès de ces intégrations dépend en grande partie de la capacité de l'outil à gérer divers fournisseurs de LLM et à prendre en charge des mesures d'évaluation personnalisées adaptées à des flux de travail spécifiques.

Les agrégateurs de classements basés sur l'IA collectent et organisent des données de référence standardisées pour mesurer les performances des grands modèles linguistiques (LLM). Ces plateformes utilisent des ensembles de données avec des réponses prédéfinies pour évaluer les modèles et les classer en fonction de leurs scores. Ce système centralisé fournit un moyen clair de comparer les LLM côte à côte, offrant transparence et cohérence dans les évaluations des performances.

Les agrégateurs s'appuient sur des tests de référence qui évaluent diverses compétences, telles que le raisonnement, le codage et la résolution de problèmes mathématiques. Les performances de chaque modèle sont notées par rapport aux bonnes réponses, et ces scores sont ensuite compilés dans des classements. Ce processus standardisé garantit une comparaison équitable entre les modèles, en éliminant le recours aux réclamations fournies par les fournisseurs et en offrant un cadre d'évaluation neutre.

Des plateformes comme Classement Vellum AI et Statistiques LLM vont au-delà des classements de base, en incluant des indicateurs tels que la vitesse et les coûts dans leurs évaluations. Pour les utilisateurs qui ont besoin de plus de flexibilité, des outils avancés proposent des options de personnalisation. Par exemple, Nexla propose plus de 20 connecteurs LLM prédéfinis et un concepteur visuel de pipeline, permettant aux ingénieurs de gérer facilement les appels parallèles vers plusieurs modèles. Ces ajustements peuvent être effectués par le biais de simples mises à jour de configuration, évitant ainsi de devoir réécrire le code de manière approfondie. De même, Hélicone permet aux utilisateurs de tester leurs instructions de production réelles sur différents modèles, en suivant l'utilisation, les coûts et les mesures de performance en temps réel.

Les meilleurs agrégateurs vont encore plus loin en s'intégrant parfaitement aux flux de développement existants. Des plateformes comme Helicone fournissent des interfaces unifiées compatibles avec les principales API LLM, nécessitant un minimum de modifications de code. Cela permet aux équipes d'enregistrer les performances de référence, d'effectuer des comparaisons côte à côte, de transférer progressivement le trafic entre les modèles et de surveiller les résultats, le tout sans perturber leurs flux de travail. En simplifiant ce qui est souvent un processus complexe, ces outils permettent d'évaluer et de passer d'un modèle à l'autre aussi simplement que de modifier quelques paramètres, garantissant ainsi des opérations fluides et efficaces.

Prompts.ai offre une nouvelle perspective sur l'évaluation des modèles d'IA, en s'éloignant des classements traditionnels axés sur les benchmarks. Au contraire, il met l'accent tests rapides et directs parmi plus de 35 LLM de premier plan, dont GPT, Claude, LLama et Gemini. En permettant aux équipes de tester leurs instructions de production réelles (des tâches du monde réel plutôt que des benchmarks synthétiques), il fournit des informations sur le modèle le mieux adapté à des flux de travail spécifiques. Cette approche pratique permet aux équipes de produits américaines de prendre des décisions éclairées sur la base de performances pratiques plutôt que de classements génériques.

Le processus de comparaison de Prompts.ai est construit autour de exécution rapide standardisée, en veillant à ce que les tests soient équitables et reflètent une utilisation dans le monde réel. Les équipes créent des instructions qui imitent leurs tâches de production réelles et les exécutent avec des entrées identiques sur plusieurs modèles. Cette configuration garantit que toute différence de sortie est purement dictée par le modèle. Les résultats sont affichés côte à côte, ce qui permet aux utilisateurs de les évaluer en fonction de critères importants pour leur organisation, tels que l'exactitude des faits, le respect du ton ou la conformité à la voix de la marque. Cette approche personnalisée garantit que les évaluations vont au-delà des indicateurs génériques pour répondre à des normes de qualité spécifiques.

La plateforme propose de nombreux options de personnalisation pour répondre aux besoins variés des différentes organisations. Les équipes peuvent créer et organiser rapidement des bibliothèques adaptées à des projets ou à des services spécifiques, tels que l'assistance au commerce ou la conformité des soins de santé. Des variables telles que {{customer_name}} ou {{account_tier}} peuvent être ajoutées pour simuler des scénarios du monde réel, tandis que les paramètres spécifiques au modèle peuvent être ajustés pour chaque cas d'utilisation. Pour les équipes travaillant sur des projets avancés, Prompts.ai prend également en charge la formation et le réglage des modèles LoRa. Cette flexibilité est essentielle car l'efficacité des instructions et des modèles peut varier considérablement en fonction de la tâche. Un modèle qui excelle en écriture créative peut rencontrer des difficultés avec la documentation technique.

Prompts.ai simplifie également l'intégration, en veillant à ce qu'il s'intègre parfaitement aux flux de travail existants.

La plateforme est conçue à la fois pour tests préalables au déploiement et optimisation continue. Les équipes d'ingénierie peuvent évaluer les modèles candidats à l'aide d'instructions similaires à celles de la production, en comparant des facteurs tels que la qualité, le temps de réponse et les coûts estimés pour 1 000 000 de jetons (calculés en dollars américains). Une fois les applications déployées, les invites anonymisées peuvent être exportées et testées sur des modèles mis à jour. Les configurations gagnantes peuvent ensuite être intégrées de manière fluide dans le système à l'aide de pipelines CI/CD ou de drapeaux de fonctionnalités. L'évaluation humaine garantit que tous les changements sont conformes aux normes organisationnelles, ce qui permet une intégration fluide sans perturber les flux de travail DevOps établis.

Prompts.ai fournit des informations détaillées transparence des coûts, affichant des estimations pour les dépenses par demande et par jeton. Les tarifs actuels des fournisseurs sont indiqués en dollars américains, par exemple « X $ par million de jetons d'entrée/Y $ par million de jetons de sortie ». Les équipes peuvent également analyser les coûts agrégés pour des tâches spécifiques, comme le coût par ticket d'assistance, et réaliser des scénarios hypothétiques simples en ajustant les limites des jetons ou en passant à des modèles plus économiques. Cette fonctionnalité aide les équipes financières et d'ingénierie à collaborer efficacement, en équilibrant les besoins de performance avec les contraintes budgétaires. Le coût par million de jetons variant de plus de 10 fois entre les modèles de raisonnement haut de gamme et les alternatives plus économiques, cette visibilité est inestimable pour prendre des décisions rentables.

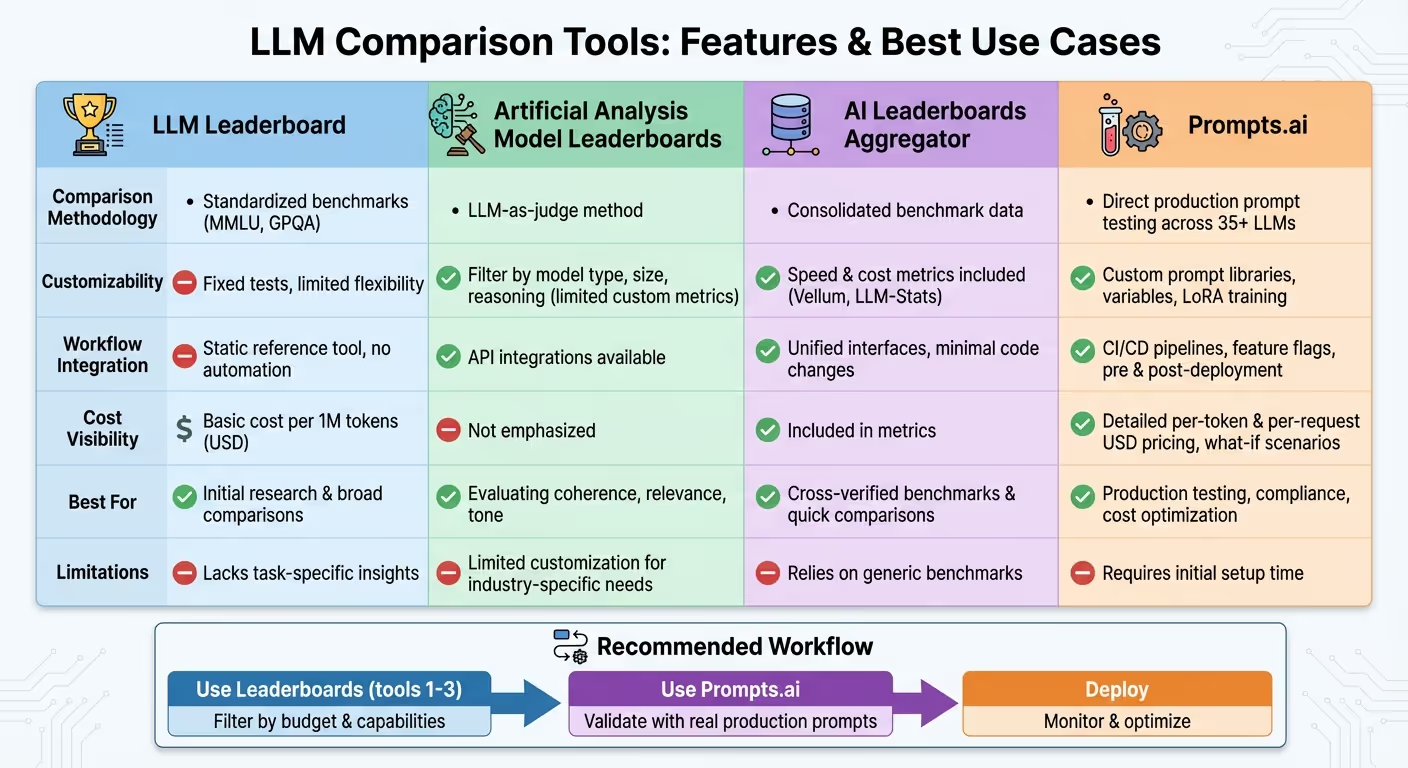

Comparaison des 4 meilleurs outils d'évaluation LLM : fonctionnalités, méthodologie et cas d'utilisation

Chaque outil de comparaison LLM a ses propres avantages et inconvénients, et il est essentiel de comprendre ces nuances pour sélectionner celui qui convient à vos besoins. Vous trouverez ci-dessous un aperçu de ce que chaque plateforme propose et des domaines dans lesquels elle pourrait ne pas être à la hauteur des applications pratiques.

Classement LLM propose une large gamme de modèles avec des scores de référence standardisés, ce qui en fait une excellente ressource pour évaluer rapidement les performances générales. Cependant, ces critères de référence sont généraux et peuvent ne pas refléter avec précision les performances d'un modèle sur des tâches spécifiques de votre environnement de production.

Classements des modèles d'analyse artificielle se distingue par ses indicateurs détaillés tels que la latence et le débit, qui sont particulièrement utiles pour les équipes qui se concentrent sur la rapidité et l'efficacité. En revanche, ces indicateurs sont basés sur des scénarios génériques, qui peuvent négliger des facteurs critiques tels que les nuances de qualité, en particulier pour les tâches créatives ou les exigences de conformité strictes.

Agrégateur de classements IA simplifie le processus de recherche en combinant des points de référence provenant de différentes sources en une seule vue consolidée. Cela permet de gagner du temps lors de l'évaluation des capacités du modèle. Cela dit, s'appuyer uniquement sur des benchmarks agrégés peut être risqué, étant donné le grand nombre de LLM disponibles et leurs performances incohérentes dans les différents domaines. Tester les modèles à l'aide de vos instructions de production spécifiques reste une étape cruciale pour garantir la compatibilité et l'efficacité.

Prompts.ai offre un avantage unique en permettant de tester directement les instructions de production sur plus de 35 modèles haut de gamme. Cela garantit que les évaluations sont fondées sur des performances réelles. La plateforme propose également une tarification transparente par jeton en dollars américains et s'intègre parfaitement aux flux de travail des entreprises, aidant ainsi les équipes à équilibrer les coûts, les performances et la conformité. Bien que la mise en place d'instructions de test représentatives nécessite un investissement initial en temps, les informations obtenues sont directement alignées sur vos objectifs opérationnels, vos normes de qualité et vos besoins budgétaires. Cette approche personnalisée la rend particulièrement utile pour les environnements axés sur la production.

L'étape de votre parcours vers l'IA joue un rôle clé dans la détermination des meilleurs outils pour comparer les modèles. Pour l'exploration initiale, des outils tels que Classement LLM et Classements des modèles d'analyse artificielle constituent d'excellents points de départ. Ils fournissent des aperçus rapides des performances du modèle, de la taille des fenêtres contextuelles et de la tarification en dollars américains, vous aidant à créer une première liste d'options. Lorsque vos besoins s'étendent à des benchmarks vérifiés par recoupement ou à des fonctionnalités d'évaluation allant au-delà de la génération de texte, le Agrégateur de classements IA devient une ressource précieuse. Ces outils vous aident à affiner vos choix, jetant ainsi les bases d'évaluations plus approfondies et plus pratiques.

Une fois que vous avez filtré les options à l'aide de critères de référence plus larges, il est essentiel de tester les modèles avec de véritables instructions de production. Cette approche pratique garantit que les modèles peuvent gérer des tâches spécifiques, notamment des formats spécifiques à une région et un langage lié à la conformité. Les tests pratiques sont essentiels pour identifier le bon ajustement.

Prompts.ai va encore plus loin dans ce processus d'évaluation en vous permettant de tester des modèles côte à côte en utilisant des instructions de production réelles. Grâce à l'accès à plus de 35 modèles, vous pouvez comparer des indicateurs clés tels que la qualité, le coût par jeton en dollars américains et la latence pour les tâches les plus importantes pour votre entreprise, qu'il s'agisse de gérer les tickets d'assistance client, de créer des documents réglementaires ou de rédiger des documents de vente. La plateforme inclut également des fonctionnalités telles que la gestion rapide des versions, des outils de collaboration en équipe et des fonctionnalités de gouvernance adaptées aux normes des entreprises américaines. Prompts.ai est notamment conforme aux attentes en matière de conformité, avec un processus d'audit actif SOC 2 de type 2 lancé le 19 juin 2025.

En combinant ces outils, vous pouvez établir un flux de travail efficace. Commencez par les classements pour filtrer les modèles en fonction de leur budget et de leurs capacités, puis tirez parti de Prompts.ai pour valider leurs performances sur des données réelles et les intégrer à vos opérations. Cette approche à plusieurs niveaux garantit que vous ne vous contentez pas de sélectionner le modèle le mieux classé, mais aussi celui qui répond à votre cas d'utilisation spécifique, à vos besoins de conformité et à vos considérations de coûts.

Si les benchmarks publics sont utiles pour les analyses de marché périodiques, des plateformes telles que Prompts.ai deviennent indispensables pour les tâches courantes telles que l'affinement des instructions, la sélection de modèles et la mise à l'échelle des déploiements. Cela est particulièrement vrai lorsque des priorités telles que l'auditabilité, la sécurité des données et une intégration opérationnelle fluide sont essentielles pour atteindre vos objectifs.

Les outils de comparaison LLM aident à évaluer et à contraster les grands modèles linguistiques en se concentrant sur des aspects critiques tels que précision, temps de réponse, rapport coût-efficacité, et adéquation spécifique au domaine. Ils offrent une vision claire des capacités et des limites de chaque modèle, ce qui permet de déterminer plus facilement celui qui convient le mieux à vos besoins spécifiques.

En examinant les données de performance et les applications du monde réel, ces outils rationalisent la prise de décision, garantissant que le modèle sélectionné soutient vos objectifs commerciaux et permet d'obtenir les meilleurs résultats possibles.

UNE classement offre un aperçu des performances des modèles linguistiques en les classant sur la base de critères de référence standardisés et de mesures agrégées. C'est un moyen rapide d'identifier les modèles qui se démarquent en termes de capacités globales.

Tests rapides et directs adopte une approche plus ciblée, en explorant la façon dont un modèle répond à des tâches ou à des requêtes spécifiques. Cette méthode fournit des informations détaillées sur sa précision, son comportement et sa capacité à répondre à des exigences particulières, ce qui la rend particulièrement utile pour personnaliser les solutions en fonction de vos besoins.

Ces méthodes se complètent : les classements sont parfaits pour les comparaisons générales, tandis que les tests rapides visent à trouver le modèle adapté à des flux de travail spécifiques.

Prompts.ai simplifie le monde complexe de la sélection des LLM en proposant une plateforme sécurisée et prête à l'emploi qui consolide l'accès à plus de 35 modèles d'IA en un seul endroit. Cette approche unifiée réduit non seulement les tracas liés à la gestion de plusieurs outils, mais garantit également une gouvernance rationalisée, aidant ainsi les entreprises à rester conformes et efficaces.

Grâce à des flux de travail d'IA optimisés, Prompts.ai permet de réaliser des économies substantielles, jusqu'à 98 % - sans compromettre les performances ou la fiabilité. C'est un choix judicieux pour les entreprises qui souhaitent progresser tout en maîtrisant leurs dépenses.