تساعدك أدوات مقارنة LLM على تقييم نماذج اللغات الكبيرة (LLMs) مثل GPT، كلود، الجوزاء، و لاما من خلال تحليل أدائهم في نفس المهام والمطالبات. تركز هذه الأدوات على المقاييس العملية مثل التكلفة لكل مليون رمز (دولار أمريكي)ووقت الاستجابة ودقة التفكير ومعدلات الهلوسة في إعدادات الإنتاج. والغرض منها هو مساعدة الشركات في اختيار أفضل النماذج لسير عمل معين، وتحقيق التوازن بين الجودة والسرعة والتكلفة.

تشمل الفوائد الرئيسية ما يلي:

أفضل الأدوات:

نصيحة سريعة: ابدأ بلوحات المتصدرين للحصول على رؤى عامة، ثم استخدم أدوات مثل Prompts.ai للتقييمات المخصصة للمهام الواقعية. يضمن لك هذا النهج متعدد الطبقات اختيار الأنسب لاحتياجاتك أثناء إدارة التكاليف والامتثال.

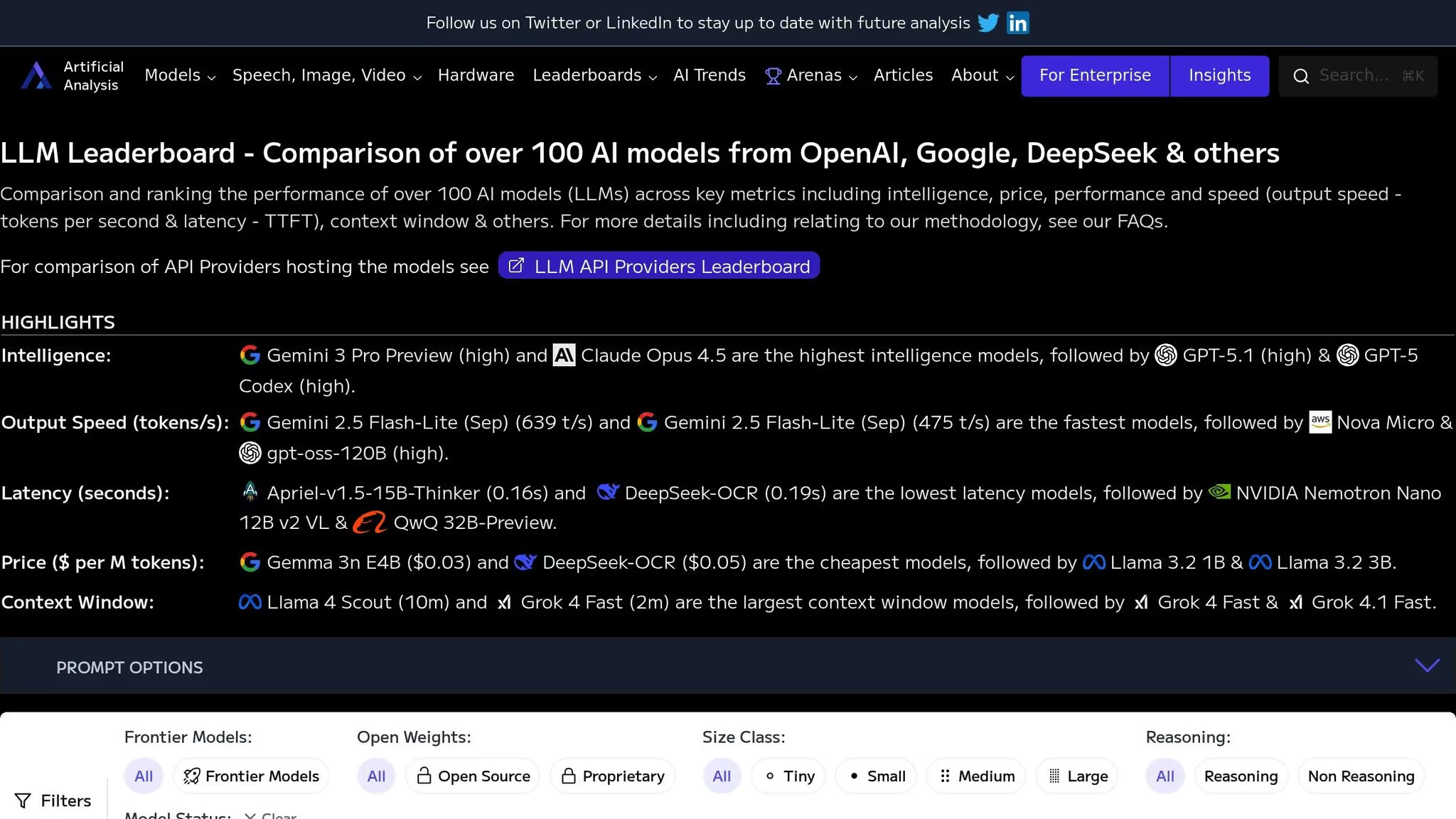

تصنف قوائم المتصدرين العامة لنماذج اللغات الكبيرة (LLMs) النماذج المختلفة من خلال تطبيق معايير موحدة. تقوم هذه المنصات بتقييم النماذج باستخدام مقاييس متسقة على مدخلات متطابقة، ثم تقدم النتائج في شكل مرتب. تشمل معايير التقييم الرئيسية دقة الإجابات والتشابه الدلالي ومعدلات الهلوسة. على سبيل المثال، وجه معانق يستضيف لوحة صدارة LLM المفتوحة المستخدمة على نطاق واسع، والتي تتعقب مقاييس مثل ململو (فهم هائل للغات متعددة المهام)، GPQA (الإجابة على الأسئلة على مستوى الدراسات العليا) وسرعة المعالجة والتكلفة لكل مليون رمز (بالدولار الأمريكي) وحجم نافذة السياق عبر العديد من النماذج مفتوحة المصدر.

تتضمن عملية التصنيف تقديم مدخلات متطابقة لجميع النماذج، وتقييم إجاباتها بناءً على مقاييس محددة مسبقًا، وتوليد الدرجات وفقًا لذلك. على الرغم من أن هذه الطريقة تعطي لمحة واضحة عن القدرات العامة، إلا أنها تعكس بشكل أساسي تفضيلات المستخدم المجمعة وأداء المهام الموحد. ومع ذلك، فإنه لا يأخذ في الاعتبار مدى جودة أداء النماذج في سيناريوهات محددة في العالم الحقيقي. هذا النهج الموحد مفيد لإجراء مقارنات واسعة ولكنه يفتقر إلى القدرة على التكيف اللازمة للتطبيقات المتخصصة أو الخاصة بالصناعة.

تعتمد قوائم المتصدرين العامة على الاختبارات الثابتة لتقييم النماذج باستخدام المعايير العامة. في حين أن هذا الإعداد مفيد للتقييمات الواسعة، إلا أنه يوفر مرونة محدودة للمؤسسات التي تحتاج إلى قياس كيفية أداء النماذج في حالات الاستخدام المتخصصة أو تلبية المتطلبات الخاصة بالصناعة. يمكن لعوامل مثل التركيبة السكانية للمستخدم والصياغة السريعة واتجاهات التصويت أن تؤثر أيضًا على التصنيفات. بالنسبة للشركات التي تتطلب تقييمات دقيقة استنادًا إلى الدقة أو الامتثال الخاصين بالمجال، قد لا توفر تصنيفات الأغراض العامة هذه المستوى الضروري من التفاصيل.

تم تصميم لوحات صدارة LLM بشكل أساسي كأدوات مرجعية لتوجيه البحث الأولي عن النماذج بدلاً من المكونات التفاعلية لسير عمل الذكاء الاصطناعي. إنها توفر تصنيفات ثابتة تساعد في تضييق الخيارات ولكنها لا تسهل الاختيار التلقائي أو النشر. ولسد هذه الفجوة، تسمح المنصات المتخصصة بإجراء الاختبارات جنبًا إلى جنب، واستخدام المقاييس المخصصة، وردود الفعل البشرية في الحلقة، وإدارة انتقال النماذج المبسطة. تساعد هذه الأدوات في تحويل البيانات المعيارية إلى رؤى قابلة للتنفيذ. بالإضافة إلى ذلك، يمكن دمج أدوات تتبع الرتب في عمليات سير العمل لمراقبة أداء ما بعد النشر. هذا مهم بشكل خاص لمهام مثل تقييم المشاعر التجارية أو الرؤية في المحتوى الذي تم إنشاؤه بواسطة الذكاء الاصطناعي.

يأخذ هذا النهج المبتكر خطوة تتجاوز قوائم المتصدرين العامة التقليدية باستخدام نموذج اللغة الكبيرة (LLM) لتقييم النماذج الأخرى. تعتمد قوائم المتصدرين لنموذج التحليل الاصطناعي على ماجستير في القانون كقاض الطريقة، حيث يقوم برنامج LLM القوي بتقييم وتسجيل المخرجات بناءً على معايير محددة مسبقًا، مما يبسط عملية التقييم [12، 16، 11، 17، 18]. دعونا نتعمق في كيفية عمل هذه المنهجية وخيارات التخصيص الخاصة بها وكيفية دمجها في عمليات سير العمل.

ال ماجستير في القانون كقاض تعمل الطريقة على تبسيط تقييم نماذج متعددة من خلال الاستفادة من قدرات LLM عالية الأداء. يقوم هذا النموذج بمراجعة المخرجات من LLMs الأخرى وتعيين الدرجات بناءً على عوامل مثل التماسك والملاءمة والنبرة. هذا النهج مفيد بشكل خاص للتقييمات المليئة بالنصوص حيث تكون الصفات الذاتية مهمة، مما يقلل بشكل كبير من الحاجة إلى مشاركة بشرية واسعة النطاق.

توفر لوحة المتصدرين لنموذج التحليل الاصطناعي العديد من خيارات التصفية لتخصيص مقارنات النماذج. يمكن للمستخدمين فرز النماذج حسب سمات مثل «نماذج الحدود» و «الأوزان المفتوحة» و «فئة الحجم» و «المنطق» و «حالة النموذج». ومع ذلك، فإنه يفتقر حاليًا إلى ميزات لدمج المقاييس المخصصة أو مجموعات البيانات الخاصة بالصناعة أو طرق التقييم التي تركز على المهام. قد يشكل هذا القيد تحديات للمنظمات ذات احتياجات التقييم المتخصصة.

تختلف إمكانات التكامل وفقًا لتصميم الأداة. تسمح بعض الأنظمة بتكامل واجهة برمجة التطبيقات بشكل مباشر، بينما يقدم البعض الآخر حلولًا أكثر قوة قائمة على البروكسي تعمل عبر نقاط نهاية LLM المتعددة. يتوقف نجاح عمليات الدمج هذه إلى حد كبير على قدرة الأداة على التعامل مع موفري LLM المتنوعين ودعم مقاييس التقييم المخصصة المصممة خصيصًا لسير العمل المحدد.

يقوم مجمّعو لوحة المتصدرين بالذكاء الاصطناعي بجمع وتنظيم بيانات معيارية لقياس أداء نماذج اللغات الكبيرة (LLMs). تستخدم هذه المنصات مجموعات بيانات بإجابات محددة مسبقًا لتقييم النماذج وترتيبها بناءً على درجاتها. يوفر هذا النظام المركزي طريقة واضحة لمقارنة LLMs جنبًا إلى جنب، مما يوفر الشفافية والاتساق في تقييمات الأداء.

يعتمد المجمعون على الاختبارات المعيارية التي تقيم المهارات المختلفة، مثل التفكير والترميز وحل المشكلات الرياضية. يتم تسجيل أداء كل نموذج مقابل الإجابات الصحيحة، ثم يتم تجميع هذه الدرجات في قوائم المتصدرين. تضمن هذه العملية الموحدة المقارنة العادلة بين النماذج، والقضاء على الاعتماد على المطالبات المقدمة من البائع وتقديم إطار تقييم محايد.

منصات مثل لوحة المتصدرين بتقنية الذكاء الاصطناعي Vellum و إحصائيات LLM تجاوز التصنيفات الأساسية، بما في ذلك مقاييس مثل السرعة والتكلفة في تقييماتهم. بالنسبة للمستخدمين الذين يحتاجون إلى مزيد من المرونة، توفر الأدوات المتقدمة خيارات التخصيص. على سبيل المثال، نيكسلا يوفر أكثر من 20 موصل LLM مُصمم مسبقًا ومصممًا مرئيًا لخطوط الأنابيب، مما يمكّن المهندسين من إدارة المكالمات المتوازية لنماذج متعددة بسهولة. يمكن إجراء هذه التعديلات من خلال تحديثات التكوين البسيطة، وتجنب الحاجة إلى إعادة كتابة التعليمات البرمجية الشاملة. وبالمثل، هيليكون يسمح للمستخدمين باختبار مطالبات الإنتاج الفعلية عبر نماذج مختلفة، وتتبع الاستخدام والتكاليف ومقاييس الأداء في الوقت الفعلي.

يخطو أفضل المجمعين خطوة إلى الأمام من خلال الاندماج بسلاسة في عمليات سير عمل التطوير الحالية. توفر منصات مثل Helicone واجهات موحدة متوافقة مع واجهات برمجة تطبيقات LLM الرئيسية، مما يتطلب الحد الأدنى من التغييرات في التعليمات البرمجية. يتيح ذلك للفرق تسجيل الأداء الأساسي وإجراء مقارنات جنبًا إلى جنب وتحويل حركة المرور تدريجيًا بين النماذج ومراقبة النتائج - كل ذلك دون تعطيل سير العمل. من خلال تبسيط العملية التي غالبًا ما تكون معقدة، تجعل هذه الأدوات التقييم والتبديل بين النماذج أمرًا سهلاً مثل تعديل بعض الإعدادات، مما يضمن عمليات سلسة وفعالة.

يقدم Prompts.ai منظورًا جديدًا لتقييم نماذج الذكاء الاصطناعي، والابتعاد عن قوائم المتصدرين التقليدية التي تركز على المعايير. وبدلاً من ذلك، فإنها تؤكد اختبار سريع مباشر عبر أكثر من 35 شركة رائدة في مجال LLM، بما في ذلك GPT و Claude و Llama و Gemini. من خلال السماح للفرق باختبار مطالبات الإنتاج الفعلية - مهام العالم الحقيقي بدلاً من المعايير الاصطناعية - فإنه يوفر رؤى حول النموذج الذي يتوافق بشكل أفضل مع عمليات سير العمل المحددة. يضمن هذا النهج العملي أن فرق المنتجات الأمريكية يمكنها اتخاذ قرارات مستنيرة بناءً على الأداء العملي بدلاً من التصنيفات العامة.

تم بناء عملية المقارنة في Prompts.ai حول التنفيذ الفوري الموحد، مما يضمن أن الاختبارات عادلة وتعكس الاستخدام في العالم الحقيقي. تقوم الفرق بإنشاء مطالبات تحاكي مهام الإنتاج الفعلية الخاصة بها وتشغيلها بمدخلات متطابقة عبر نماذج متعددة. يضمن هذا الإعداد أن أي اختلافات في المخرجات تعتمد فقط على النموذج. يتم عرض النتائج جنبًا إلى جنب، مما يسمح للمستخدمين بتقييمها استنادًا إلى المعايير التي تهم مؤسستهم، مثل الدقة الواقعية أو الالتزام بالنبرة أو الامتثال لصوت العلامة التجارية. يضمن هذا النهج المصمم أن تتجاوز التقييمات المقاييس العامة لتلبية معايير الجودة المحددة.

تقدم المنصة مجموعة واسعة خيارات التخصيص لتلبية الاحتياجات المتنوعة للمنظمات المختلفة. يمكن للفرق إنشاء وتنظيم مكتبات سريعة مصممة خصيصًا لمشاريع أو أقسام محددة، مثل دعم البيع بالتجزئة أو الامتثال للرعاية الصحية. يمكن إضافة متغيرات مثل {{customer_name}} أو {{account_tier}} لمحاكاة سيناريوهات العالم الحقيقي، بينما يمكن تعديل الإعدادات الخاصة بالنموذج لكل حالة استخدام. بالنسبة للفرق التي تعمل على المشاريع المتقدمة، تدعم Prompts.ai أيضًا التدريب وضبط نماذج LoRa. هذه المرونة ضرورية لأن فعالية المطالبات والنماذج يمكن أن تختلف بشكل كبير اعتمادًا على المهمة - النموذج الذي يتفوق في الكتابة الإبداعية قد يواجه صعوبة في التوثيق الفني.

يعمل Prompts.ai أيضًا على تبسيط التكامل، مما يضمن ملاءمته بسلاسة لعمليات سير العمل الحالية.

تم تصميم المنصة لكليهما اختبار ما قبل النشر و التحسين المستمر. يمكن للفرق الهندسية تقييم النماذج المرشحة باستخدام مطالبات تشبه الإنتاج، ومقارنة عوامل مثل الجودة ووقت الاستجابة والتكاليف المقدرة لكل مليون رمز (محسوبة بالدولار الأمريكي). بمجرد نشر التطبيقات، يمكن تصدير المطالبات المجهولة واختبارها على النماذج المحدثة. يمكن بعد ذلك دمج التكوينات الفائزة بسلاسة مرة أخرى في النظام باستخدام خطوط أنابيب CI/CD أو علامات الميزات. تضمن المراجعة البشرية توافق أي تغييرات مع المعايير التنظيمية، مما يتيح التكامل السلس دون تعطيل سير عمل DevOps المعمول به.

يوفر Prompts.ai التفاصيل شفافية التكلفة، مع عرض تقديرات لكل من النفقات لكل طلب ولكل رمز. يتم عرض أسعار الموفر الحالية بالدولار الأمريكي، مثل «X دولار لكل مليون رمز إدخال/دولار Y لكل مليون رمز إخراج». يمكن للفرق أيضًا تحليل التكاليف المجمعة لمهام محددة، مثل تكلفة تذكرة الدعم، وتنفيذ سيناريوهات «ماذا لو» البسيطة عن طريق تعديل حدود الرمز المميز أو التبديل إلى نماذج أكثر ملاءمة للميزانية. تساعد هذه الميزة الفرق المالية والهندسية على التعاون بفعالية، وتحقيق التوازن بين احتياجات الأداء وقيود الميزانية. نظرًا لأن التكلفة لكل مليون رمز تختلف بأكثر من 10 أضعاف بين نماذج التفكير المتميزة والبدائل الأكثر اقتصادا، فإن هذه الرؤية لا تقدر بثمن لاتخاذ قرارات فعالة من حيث التكلفة.

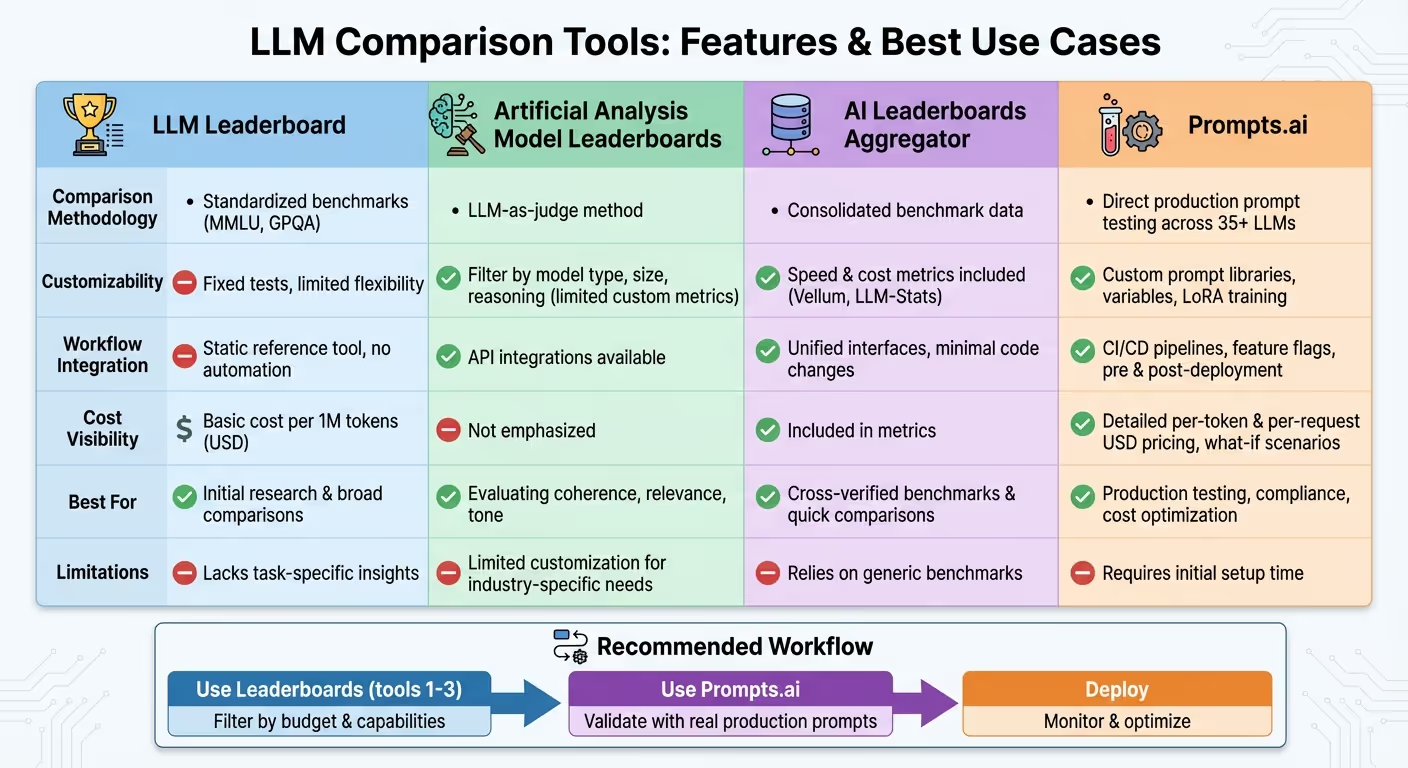

مقارنة بين أفضل 4 أدوات لتقييم LLM: الميزات والمنهجية وحالات الاستخدام

تحتوي كل أداة مقارنة LLM على مجموعة نقاط القوة والعيوب الخاصة بها، وفهم هذه الفروق الدقيقة هو المفتاح لاختيار الأداة المناسبة لاحتياجاتك. فيما يلي نظرة فاحصة على ما تقدمه كل منصة وأين قد تفشل في التطبيقات العملية.

ليدربورد LLM يوفر مجموعة واسعة من النماذج ذات الدرجات المعيارية القياسية، مما يجعله موردًا ممتازًا لقياس الأداء العام بسرعة. ومع ذلك، فإن هذه المعايير واسعة النطاق وقد لا تعكس بدقة كيفية أداء النموذج في مهام محددة في بيئة الإنتاج الخاصة بك.

قوائم المتصدرين لنموذج التحليل الاصطناعي تتميز بتقديم مقاييس مفصلة مثل زمن الوصول والإنتاجية، والتي تعد مفيدة بشكل خاص للفرق التي تركز على السرعة والكفاءة. على الجانب السلبي، تستند هذه المقاييس إلى سيناريوهات عامة، والتي قد تتجاهل عوامل مهمة مثل الفروق الدقيقة في الجودة، خاصة بالنسبة للمهام الإبداعية أو متطلبات الامتثال الثقيلة.

مُجمِّع قوائم المتصدرين بالذكاء الاصطناعي يبسط عملية البحث من خلال الجمع بين المعايير من مصادر مختلفة في عرض واحد موحد. يمكن أن يوفر هذا الوقت عند تقييم قدرات النموذج. ومع ذلك، فإن الاعتماد فقط على المعايير المجمعة يمكن أن يكون محفوفًا بالمخاطر، نظرًا للعدد الهائل من LLMs المتاحة وأدائها غير المتسق عبر المجالات المختلفة. يظل اختبار النماذج مع مطالبات الإنتاج المحددة خطوة حاسمة لضمان التوافق والفعالية.

Prompts.ai يوفر ميزة فريدة من خلال السماح بالاختبار المباشر لمطالبات الإنتاج عبر أكثر من 35 طرازًا رائعًا. وهذا يضمن أن التقييمات ترتكز على الأداء في العالم الحقيقي. توفر المنصة أيضًا تسعيرًا شفافًا لكل رمز بالدولار الأمريكي وتتكامل بسلاسة مع سير عمل المؤسسة، مما يساعد الفرق على تحقيق التوازن بين التكلفة والأداء والامتثال. في حين أن إعداد موجهات الاختبار التمثيلية يتطلب استثمارًا أوليًا للوقت، فإن الأفكار المكتسبة تتماشى بشكل مباشر مع أهدافك التشغيلية ومعايير الجودة واحتياجات الميزانية. هذا النهج المصمم يجعله ذا قيمة خاصة للبيئات التي تركز على الإنتاج.

تلعب مرحلة رحلة الذكاء الاصطناعي دورًا رئيسيًا في تحديد أفضل الأدوات لمقارنة النماذج. للاستكشاف الأولي، أدوات مثل ليدربورد LLM و قوائم المتصدرين لنموذج التحليل الاصطناعي هي نقاط انطلاق ممتازة. وهي توفر لمحات عامة سريعة عن أداء النموذج وأحجام نوافذ السياق وأسعار الدولار الأمريكي، مما يساعدك على إنشاء قائمة مختصرة أولية من الخيارات. عندما تمتد احتياجاتك إلى المعايير التي تم التحقق منها أو تقييم القدرات بما يتجاوز إنشاء النص، فإن مُجمِّع قوائم المتصدرين بالذكاء الاصطناعي يصبح موردًا قيمًا. تساعدك هذه الأدوات على تضييق نطاق الخيارات ووضع الأساس لتقييمات أعمق وأكثر عملية.

بمجرد تصفية الخيارات باستخدام معايير أوسع، من الضروري اختبار النماذج باستخدام مطالبات الإنتاج الحقيقية. يضمن هذا النهج العملي قدرة النماذج على التعامل مع مهام محددة، بما في ذلك التنسيقات الخاصة بالمنطقة واللغة المتعلقة بالامتثال. يعد الاختبار العملي أمرًا حيويًا لتحديد الملاءمة المناسبة.

Prompts.ai يأخذ عملية التقييم هذه خطوة إلى الأمام من خلال السماح لك باختبار النماذج جنبًا إلى جنب باستخدام مطالبات الإنتاج الفعلية. من خلال الوصول إلى أكثر من 35 طرازًا، يمكنك مقارنة المقاييس الرئيسية مثل الجودة والتكلفة لكل رمز مميز بالدولار الأمريكي ووقت الاستجابة للمهام الأكثر أهمية لنشاطك التجاري - سواء كانت إدارة تذاكر دعم العملاء أو إنشاء مستندات تنظيمية أو صياغة نسخة المبيعات. تتضمن المنصة أيضًا ميزات مثل الإصدار الفوري وأدوات التعاون الجماعي وقدرات الحوكمة المصممة لتلبية معايير المؤسسات الأمريكية. والجدير بالذكر أن Prompts.ai يتماشى مع توقعات الامتثال، مع بدء عملية تدقيق SOC 2 Type 2 النشطة في 19 يونيو 2025.

من خلال الجمع بين هذه الأدوات، يمكنك إنشاء سير عمل فعال. ابدأ باستخدام لوحات الصدارة لتصفية النماذج بناءً على الميزانية والإمكانيات، ثم استفد من Prompts.ai للتحقق من أدائها على بيانات العالم الحقيقي ودمجها في عملياتك. يضمن هذا النهج متعدد الطبقات أنك لا تختار فقط النموذج الأعلى تصنيفًا، ولكن النموذج الذي يلبي حالة الاستخدام المحددة واحتياجات الامتثال واعتبارات التكلفة.

في حين أن المعايير العامة مفيدة لمراجعات السوق الدورية، فإن المنصات مثل Prompts.ai تصبح لا غنى عنها للمهام الجارية مثل تحسين المطالبات واختيار النماذج وتوسيع نطاق عمليات النشر. وينطبق هذا بشكل خاص عندما تكون الأولويات مثل قابلية التدقيق وأمن البيانات والتكامل التشغيلي السلس ضرورية لتحقيق أهدافك.

تساعد أدوات مقارنة LLM في تقييم نماذج اللغات الكبيرة ومقارنتها من خلال التركيز على الجوانب الحرجة مثل صحة، وقت الاستجابة، الكفاءة من حيث التكلفة، و الملاءمة الخاصة بالنطاق. إنها توفر رؤية واضحة لإمكانيات وقيود كل نموذج، مما يجعل من السهل تحديد الملاءمة المناسبة لاحتياجاتك الخاصة.

من خلال فحص بيانات الأداء والتطبيقات الواقعية، تعمل هذه الأدوات على تبسيط عملية صنع القرار، مما يضمن أن النموذج المحدد يدعم أهداف عملك ويحقق أفضل النتائج الممكنة.

أ لوحة المتصدرين يقدم لمحة سريعة عن كيفية أداء نماذج اللغة من خلال ترتيبها بناءً على المعايير القياسية والمقاييس المجمعة. إنها طريقة سريعة لتحديد النماذج البارزة من حيث القدرات الإجمالية.

اختبار فوري مباشر يتبع نهجًا أكثر تركيزًا، ويغوص في كيفية استجابة النموذج لمهام أو استفسارات محددة. تكشف هذه الطريقة عن رؤى تفصيلية حول دقتها وسلوكها ومدى توافقها مع متطلبات معينة، مما يجعلها مفيدة بشكل خاص لتخصيص الحلول لتناسب احتياجاتك.

هذه الأساليب تكمل بعضها البعض: تعد قوائم المتصدرين رائعة لإجراء مقارنات واسعة، بينما يركز الاختبار الفوري على العثور على النموذج المناسب لعمليات سير عمل محددة.

يجلب Prompts.ai البساطة إلى العالم المعقد لاختيار LLM من خلال تقديم منصة آمنة وجاهزة للمؤسسات تعزز الوصول إلى أكثر من 35 نموذجًا للذكاء الاصطناعي في مكان واحد. لا يقلل هذا النهج الموحد من متاعب التوفيق بين الأدوات المتعددة فحسب، بل يضمن أيضًا الحوكمة المبسطة، مما يساعد الشركات على الحفاظ على الامتثال والكفاءة.

من خلال عمليات سير العمل المحسّنة بالذكاء الاصطناعي، توفر Prompts.ai وفورات كبيرة في التكاليف - تصل إلى 98% - دون المساومة على الأداء أو الموثوقية. إنه اختيار ذكي للشركات التي تهدف إلى دفع التقدم مع الحفاظ على النفقات تحت السيطرة.