Las herramientas de comparación de LLM lo ayudan a evaluar modelos lingüísticos grandes (LLM) como GPT, Claudio, Géminis, y Llama analizando su desempeño en las mismas tareas e indicaciones. Estas herramientas se centran en métricas prácticas como coste por 1 millón de fichas (USD), latencia, precisión del razonamiento y tasas de alucinaciones en los entornos de producción. Su objetivo es ayudar a las empresas a seleccionar los mejores modelos para flujos de trabajo específicos, equilibrando la calidad, la velocidad y el costo.

Los beneficios clave incluyen:

Las mejores herramientas:

Consejo rápido: Comience con tablas de clasificación para obtener información general y, a continuación, utilice herramientas como Prompts.ai para realizar evaluaciones personalizadas con tareas del mundo real. Este enfoque escalonado garantiza que seleccione la opción que mejor se adapte a sus necesidades y, al mismo tiempo, gestione los costes y el cumplimiento.

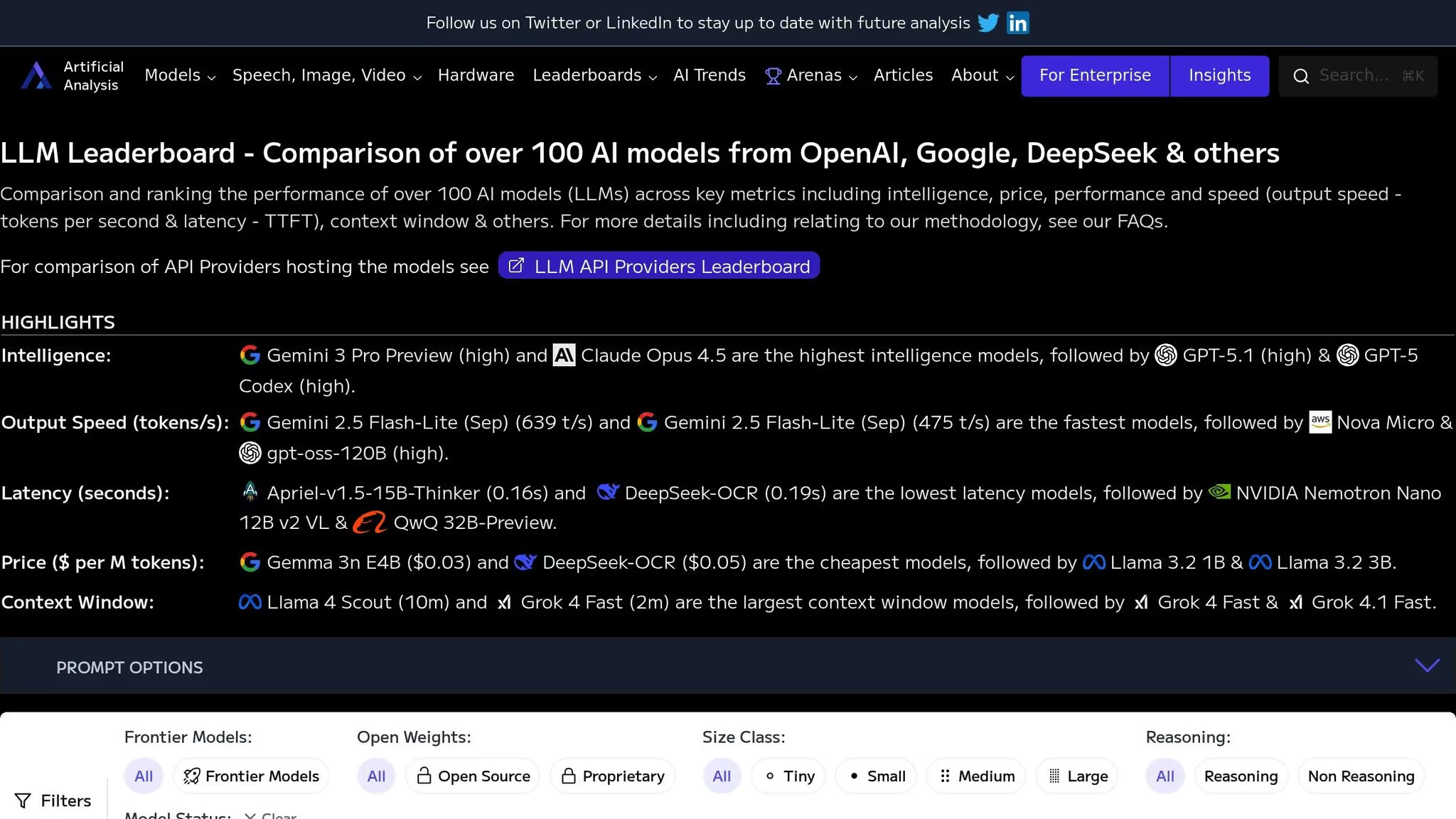

Las tablas de clasificación públicas para modelos lingüísticos extensos (LLM) clasifican varios modelos mediante la aplicación de puntos de referencia estandarizados. Estas plataformas evalúan los modelos utilizando métricas consistentes en entradas idénticas y, a continuación, presentan los resultados en un formato clasificado. Los criterios clave de evaluación incluyen la precisión de las respuestas, la similitud semántica y las tasas de alucinaciones. Por ejemplo, Cara abrazada alberga una tabla de clasificación de LLM abierta ampliamente utilizada, que rastrea métricas como MMLU (Comprensión masiva del lenguaje multitarea), GPQA (Respuesta a preguntas de nivel de posgrado), la velocidad de procesamiento, el costo por millón de tokens (en USD) y el tamaño de la ventana de contexto en numerosos modelos de código abierto.

El proceso de clasificación implica proporcionar entradas idénticas a todos los modelos, evaluar sus respuestas en función de métricas predefinidas y generar puntuaciones en consecuencia. Si bien este método ofrece una imagen clara de las capacidades generales, refleja principalmente las preferencias agregadas de los usuarios y el desempeño estandarizado de las tareas. Sin embargo, no tiene en cuenta el rendimiento de los modelos en escenarios específicos del mundo real. Este enfoque estandarizado es útil para realizar comparaciones amplias, pero carece de la adaptabilidad necesaria para aplicaciones específicas de un sector o de un sector específico.

Las tablas de clasificación públicas se basan en pruebas fijas para evaluar los modelos utilizando criterios generales. Si bien es útil para evaluaciones amplias, esta configuración ofrece una flexibilidad limitada para las organizaciones que necesitan medir el rendimiento de los modelos en casos de uso especializados o cumplir con los requisitos específicos de la industria. Factores como la demografía de los usuarios, la rapidez en la redacción y las tendencias de votación también pueden influir en las clasificaciones. En el caso de las empresas que requieren evaluaciones precisas basadas en la precisión o el cumplimiento de un dominio específico, estas clasificaciones de uso general pueden no proporcionar el nivel de detalle necesario.

Las tablas de clasificación de LLM están diseñadas principalmente como herramientas de referencia para guiar la investigación inicial del modelo, más que como componentes interactivos de los flujos de trabajo de IA. Proporcionan clasificaciones estáticas que ayudan a reducir las opciones, pero no facilitan la selección o el despliegue automatizados. Para colmar esta brecha, las plataformas especializadas permiten realizar pruebas paralelas, utilizar métricas personalizadas, obtener comentarios personalizados y gestionar la transición de modelos de forma simplificada. Estas herramientas ayudan a transformar los datos de referencia en información práctica. Además, las herramientas de seguimiento de la clasificación se pueden integrar en los flujos de trabajo para supervisar el rendimiento posterior a la implementación. Esto es especialmente útil para tareas como la evaluación del sentimiento de marca o la visibilidad en el contenido generado por la IA.

Este enfoque innovador va un paso más allá de las tablas de clasificación públicas tradicionales al utilizar un modelo de lenguaje amplio (LLM) para evaluar otros modelos. Las tablas de clasificación de los modelos de análisis artificial se basan en LLM como juez método, en el que un poderoso LLM evalúa y califica los resultados en función de criterios predefinidos, lo que agiliza el proceso de evaluación [12, 16, 11, 17, 18]. Analicemos cómo funciona esta metodología, sus opciones de personalización y cómo se integra en los flujos de trabajo.

El LLM como juez El método simplifica la evaluación de múltiples modelos al aprovechar las capacidades de un LLM de alto rendimiento. Este modelo revisa los resultados de otros LLM y asigna puntajes en función de factores como la coherencia, la relevancia y el tono. Este enfoque es particularmente útil para las evaluaciones con mucho texto en las que las cualidades subjetivas son importantes, ya que reduce significativamente la necesidad de una amplia participación humana.

La tabla de clasificación de modelos de análisis artificial proporciona varias opciones de filtrado para personalizar las comparaciones de modelos. Los usuarios pueden ordenar los modelos por atributos como «modelos de frontera», «pesos abiertos», «clase de tamaño», «razonamiento» y «estado del modelo». Sin embargo, actualmente carece de funciones para incorporar métricas personalizadas, conjuntos de datos específicos de la industria o métodos de evaluación centrados en las tareas. Esta limitación puede plantear desafíos para las organizaciones con necesidades de evaluación especializadas.

Las capacidades de integración varían según el diseño de la herramienta. Algunos sistemas permiten integraciones de API sencillas, mientras que otros ofrecen soluciones más sólidas basadas en proxies que funcionan en varios puntos finales de LLM. El éxito de estas integraciones depende en gran medida de la capacidad de la herramienta para gestionar diversos proveedores de LLM y respaldar métricas de evaluación personalizadas adaptadas a flujos de trabajo específicos.

Los agregadores de tablas de clasificación de IA recopilan y organizan datos de referencia estandarizados para medir el rendimiento de los grandes modelos lingüísticos (LLM). Estas plataformas utilizan conjuntos de datos con respuestas predefinidas para evaluar los modelos y los clasifican en función de sus puntuaciones. Este sistema centralizado proporciona una forma clara de comparar los LLM en paralelo, lo que ofrece transparencia y coherencia en las evaluaciones de desempeño.

Los agregadores se basan en pruebas comparativas que evalúan diversas habilidades, como el razonamiento, la codificación y la resolución de problemas matemáticos. El rendimiento de cada modelo se puntúa en función de las respuestas correctas y, a continuación, estas puntuaciones se compilan en tablas de clasificación. Este proceso estandarizado garantiza una comparación justa entre los modelos, lo que elimina la dependencia de las afirmaciones presentadas por los proveedores y ofrece un marco de evaluación neutral.

Plataformas como Tabla de clasificación de Vellum AI y Estadísticas de LLM van más allá de las clasificaciones básicas e incluyen métricas como la velocidad y el costo en sus evaluaciones. Para los usuarios que necesitan más flexibilidad, las herramientas avanzadas ofrecen opciones de personalización. Por ejemplo, Nexla ofrece más de 20 conectores LLM prediseñados y un diseñador visual de canalizaciones, lo que permite a los ingenieros gestionar las llamadas en paralelo a varios modelos con facilidad. Estos ajustes se pueden realizar mediante sencillas actualizaciones de configuración, lo que evita la necesidad de reescribir el código de forma exhaustiva. Del mismo modo, Helicón permite a los usuarios probar sus instrucciones de producción reales en diferentes modelos, realizando un seguimiento del uso, los costos y las métricas de rendimiento en tiempo real.

Los mejores agregadores van un paso más allá al integrarse sin problemas en los flujos de trabajo de desarrollo existentes. Las plataformas como Helicone proporcionan interfaces unificadas compatibles con las principales API de LLM y requieren cambios de código mínimos. Esto permite a los equipos registrar el rendimiento de referencia, realizar comparaciones paralelas, cambiar gradualmente el tráfico entre los modelos y supervisar los resultados, todo ello sin interrumpir sus flujos de trabajo. Al simplificar lo que suele ser un proceso complejo, estas herramientas hacen que la evaluación y el cambio entre modelos sean tan sencillos como modificar algunos ajustes, lo que garantiza operaciones fluidas y eficientes.

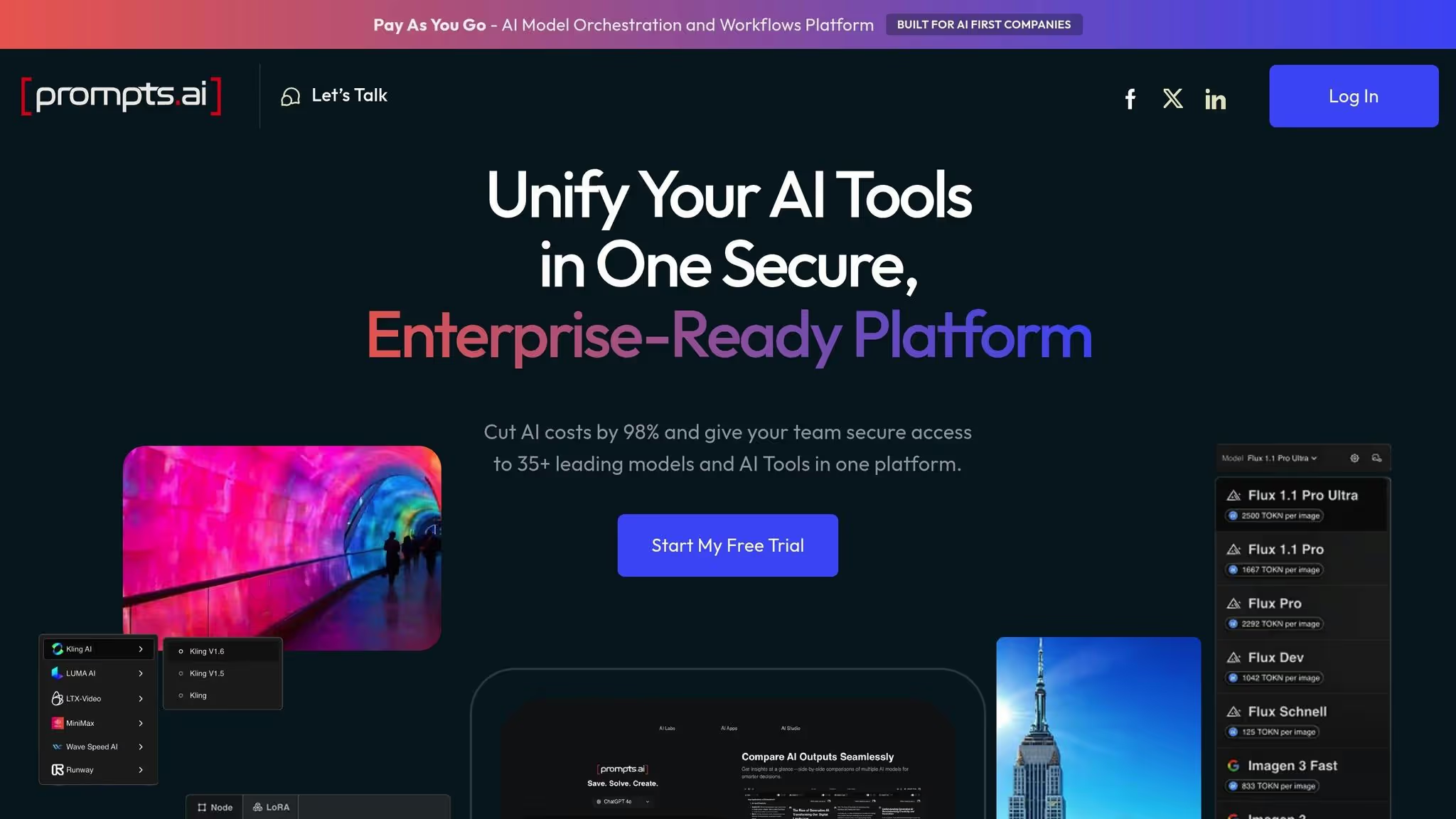

Prompts.ai ofrece una nueva perspectiva sobre la evaluación de los modelos de IA, alejándose de las tablas de clasificación tradicionales centradas en los puntos de referencia. En cambio, hace hincapié pruebas rápidas directas en más de 35 LLM líderes, incluidos GPT, Claude, LLama y Gemini. Al permitir a los equipos probar sus instrucciones de producción reales (tareas del mundo real en lugar de puntos de referencia sintéticos), se obtiene información sobre qué modelo se ajusta mejor a los flujos de trabajo específicos. Este enfoque práctico garantiza que los equipos de productos de EE. UU. puedan tomar decisiones informadas basadas en el rendimiento práctico y no en clasificaciones genéricas.

El proceso de comparación de Prompts.ai se basa en ejecución rápida estandarizada, garantizando que las pruebas sean justas y reflejen el uso en el mundo real. Los equipos crean instrucciones que imitan sus tareas de producción reales y las ejecutan con entradas idénticas en varios modelos. Esta configuración garantiza que cualquier diferencia en las salidas esté basada exclusivamente en el modelo. Los resultados se muestran uno al lado del otro, lo que permite a los usuarios evaluarlos en función de criterios que son importantes para su organización, como la precisión de los hechos, la fidelidad al tono o el cumplimiento de la voz de la marca. Este enfoque personalizado garantiza que las evaluaciones vayan más allá de las métricas genéricas para cumplir con estándares de calidad específicos.

La plataforma ofrece una amplia opciones de personalización para satisfacer las diversas necesidades de las diferentes organizaciones. Los equipos pueden crear y organizar bibliotecas rápidas adaptadas a proyectos o departamentos específicos, como el soporte minorista o el cumplimiento de las normas sanitarias. Se pueden agregar variables como {{customer_name}} o {{account_tier}} para simular escenarios del mundo real, mientras que la configuración específica del modelo se puede ajustar para cada caso de uso. Para los equipos que trabajan en proyectos avanzados, Prompts.ai también permite entrenar y ajustar los modelos de LoRa. Esta flexibilidad es esencial porque la eficacia de las instrucciones y los modelos puede variar mucho según la tarea; un modelo que destaque en la escritura creativa puede tener dificultades con la documentación técnica.

Prompts.ai también simplifica la integración, garantizando que se adapte perfectamente a los flujos de trabajo existentes.

La plataforma está diseñada para ambos pruebas previas a la implementación y optimización continua. Los equipos de ingeniería pueden evaluar los modelos candidatos utilizando indicaciones similares a las de producción, comparando factores como la calidad, el tiempo de respuesta y los costes estimados por cada 1 000 000 de fichas (calculados en USD). Una vez implementadas las aplicaciones, las solicitudes anonimizadas se pueden exportar y probar en modelos actualizados. Las configuraciones ganadoras se pueden volver a integrar sin problemas en el sistema mediante canalizaciones de CI/CD o indicadores de funciones. La revisión humana garantiza que cualquier cambio se ajuste a los estándares de la organización, lo que permite una integración fluida sin interrumpir los flujos de trabajo de DevOps establecidos.

Prompts.ai proporciona información detallada transparencia de costos, que muestra las estimaciones de los gastos por solicitud y por token. Los precios actuales de los proveedores se muestran en USD, por ejemplo: «X $ por cada 1 millón de fichas de entrada/Y $ por cada 1 millón de fichas de salida». Los equipos también pueden analizar los costos agregados de tareas específicas, como el costo por ticket de soporte, y analizar situaciones hipotéticas sencillas ajustando los límites de los tokens o cambiando a modelos más económicos. Esta función ayuda a los equipos de finanzas e ingeniería a colaborar de manera eficaz, equilibrando las necesidades de rendimiento con las restricciones presupuestarias. Dado que el coste por cada 1 millón de fichas varía en más de 10 veces entre los modelos de razonamiento de primera calidad y las alternativas más económicas, esta visibilidad tiene un valor incalculable para tomar decisiones rentables.

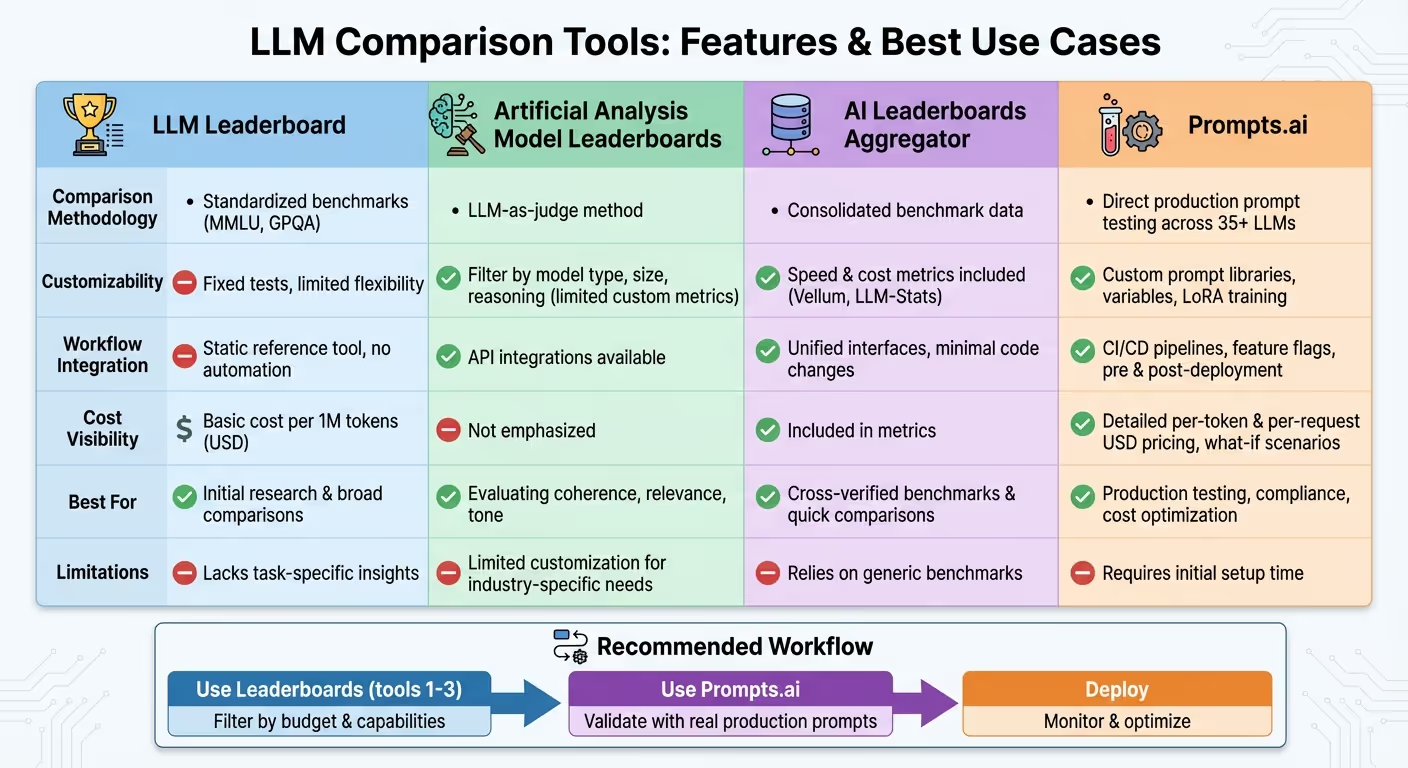

Comparación de las 4 principales herramientas de evaluación de LLM: características, metodología y casos de uso

Cada herramienta de comparación de LLM tiene su propio conjunto de puntos fuertes e inconvenientes, y comprender estos matices es clave para seleccionar la más adecuada para sus necesidades. A continuación se muestra más de cerca lo que ofrece cada plataforma y los aspectos en los que puede resultar insuficiente en aplicaciones prácticas.

Tabla de clasificación de LLM ofrece una amplia gama de modelos con puntuaciones de referencia estandarizadas, lo que lo convierte en un recurso excelente para medir rápidamente el rendimiento general. Sin embargo, estos puntos de referencia son amplios y es posible que no reflejen con precisión el rendimiento de un modelo en tareas específicas de su entorno de producción.

Tablas de clasificación de modelos de análisis artificial destaca por ofrecer métricas detalladas como la latencia y el rendimiento, que son especialmente útiles para los equipos que se centran en la velocidad y la eficiencia. Por el lado negativo, estas métricas se basan en escenarios genéricos, que pueden pasar por alto factores críticos como los matices de calidad, especialmente en el caso de las tareas creativas o los requisitos que exigen un alto grado de cumplimiento.

Agregador de tablas de clasificación con IA simplifica el proceso de investigación al combinar puntos de referencia de varias fuentes en una visión consolidada. Esto puede ahorrar tiempo al evaluar las capacidades del modelo. Dicho esto, confiar únicamente en puntos de referencia agregados puede ser arriesgado, dada la gran cantidad de LLM disponibles y su rendimiento desigual en los diferentes dominios. Probar los modelos con sus instrucciones de producción específicas sigue siendo un paso crucial para garantizar la compatibilidad y la eficacia.

Prompts.ai ofrece una ventaja única al permitir probar directamente las instrucciones de producción en más de 35 modelos principales. Esto garantiza que las evaluaciones se basen en el rendimiento real. La plataforma también ofrece precios transparentes por token en USD y se integra sin problemas con los flujos de trabajo empresariales, lo que ayuda a los equipos a equilibrar los costos, el rendimiento y el cumplimiento. Si bien establecer pautas de prueba representativas requiere una inversión inicial de tiempo, la información obtenida está directamente alineada con sus objetivos operativos, estándares de calidad y necesidades presupuestarias. Este enfoque personalizado lo hace especialmente valioso para los entornos centrados en la producción.

La etapa de su viaje hacia la IA desempeña un papel clave a la hora de determinar las mejores herramientas para comparar modelos. Para la exploración inicial, se utilizan herramientas como Tabla de clasificación de LLM y Tablas de clasificación de modelos de análisis artificial son excelentes puntos de partida. Proporcionan una visión general rápida del rendimiento del modelo, los tamaños de las ventanas contextuales y los precios en USD, lo que le ayuda a crear una lista inicial de opciones. Cuando sus necesidades se extienden a puntos de referencia con verificación cruzada o a la evaluación de capacidades que van más allá de la generación de texto, Agregador de tablas de clasificación con IA se convierte en un recurso valioso. Estas herramientas ayudan a reducir las opciones, sentando las bases para evaluaciones más profundas y prácticas.

Una vez que haya filtrado las opciones utilizando puntos de referencia más amplios, es crucial probar los modelos con instrucciones de producción reales. Este enfoque práctico garantiza que los modelos puedan gestionar tareas específicas, incluidos los formatos específicos de cada región y el lenguaje relacionado con el cumplimiento. Las pruebas prácticas son fundamentales para identificar la opción adecuada.

Prompts.ai lleva este proceso de evaluación un paso más allá al permitirle probar los modelos uno al lado del otro utilizando las instrucciones de producción reales. Con acceso a más de 35 modelos, puedes comparar métricas clave como la calidad, el coste por token en USD y la latencia para las tareas que más importan a tu empresa, ya sea gestionar los tickets de atención al cliente, crear documentos normativos o elaborar copias de venta. La plataforma también incluye funciones como el control rápido de versiones, herramientas de colaboración en equipo y funciones de gobierno diseñadas para cumplir con los estándares empresariales de EE. UU. Cabe destacar que Prompts.ai cumple con las expectativas de cumplimiento, con un proceso activo de auditoría de tipo 2 del SOC 2 que se inició el 19 de junio de 2025.

Al combinar estas herramientas, puede establecer un flujo de trabajo eficiente. Comience con tablas de clasificación para filtrar los modelos en función del presupuesto y las capacidades y, a continuación, aproveche Prompts.ai para validar su rendimiento con datos reales e integrarlos en sus operaciones. Este enfoque por capas garantiza que no solo seleccione el modelo mejor clasificado, sino el que mejor se adapte a su caso de uso específico, a sus necesidades de cumplimiento y a sus consideraciones de costo.

Si bien los puntos de referencia públicos son útiles para las revisiones periódicas del mercado, plataformas como Prompts.ai se vuelven indispensables para tareas continuas como refinar las instrucciones, seleccionar modelos y escalar las implementaciones. Esto es especialmente cierto cuando prioridades como la auditabilidad, la seguridad de los datos y una integración operativa perfecta son fundamentales para lograr sus objetivos.

Las herramientas de comparación de LLM ayudan a evaluar y contrastar modelos lingüísticos de gran tamaño al centrarse en aspectos críticos como exactitud, tiempo de respuesta, rentabilidad, y idoneidad específica del dominio. Ofrecen una visión clara de las capacidades y limitaciones de cada modelo, lo que facilita la identificación del modelo adecuado para sus necesidades específicas.

Al examinar los datos de rendimiento y las aplicaciones del mundo real, estas herramientas agilizan la toma de decisiones y garantizan que el modelo seleccionado respalde sus objetivos empresariales y logre los mejores resultados posibles.

UN tabla de clasificación ofrece una instantánea del rendimiento de los modelos lingüísticos clasificándolos en función de puntos de referencia estandarizados y métricas agregadas. Es una forma rápida de identificar qué modelos destacan en términos de capacidades generales.

Pruebas rápidas y directas adopta un enfoque más centrado, profundizando en la forma en que un modelo responde a tareas o consultas específicas. Este método revela información detallada sobre su precisión, su comportamiento y su grado de alineación con los requisitos particulares, lo que lo hace especialmente útil para personalizar las soluciones para que se ajusten a sus necesidades.

Estos métodos se complementan entre sí: las tablas de clasificación son excelentes para realizar comparaciones amplias, mientras que las pruebas rápidas se centran en encontrar el modelo correcto para flujos de trabajo específicos.

Prompts.ai aporta simplicidad al complejo mundo de la selección de LLM al ofrecer una plataforma segura y preparada para la empresa que consolida el acceso a más de 35 modelos de IA en un solo lugar. Este enfoque unificado no solo reduce la molestia de tener que hacer malabares con múltiples herramientas, sino que también garantiza una gobernanza simplificada, lo que ayuda a las empresas a cumplir con las normas y ser eficientes.

Con flujos de trabajo de IA optimizados, Prompts.ai ofrece ahorros de costos sustanciales, hasta 98% - sin comprometer el rendimiento ni la fiabilidad. Es una opción inteligente para las empresas que desean impulsar el progreso y, al mismo tiempo, mantener los gastos bajo control.