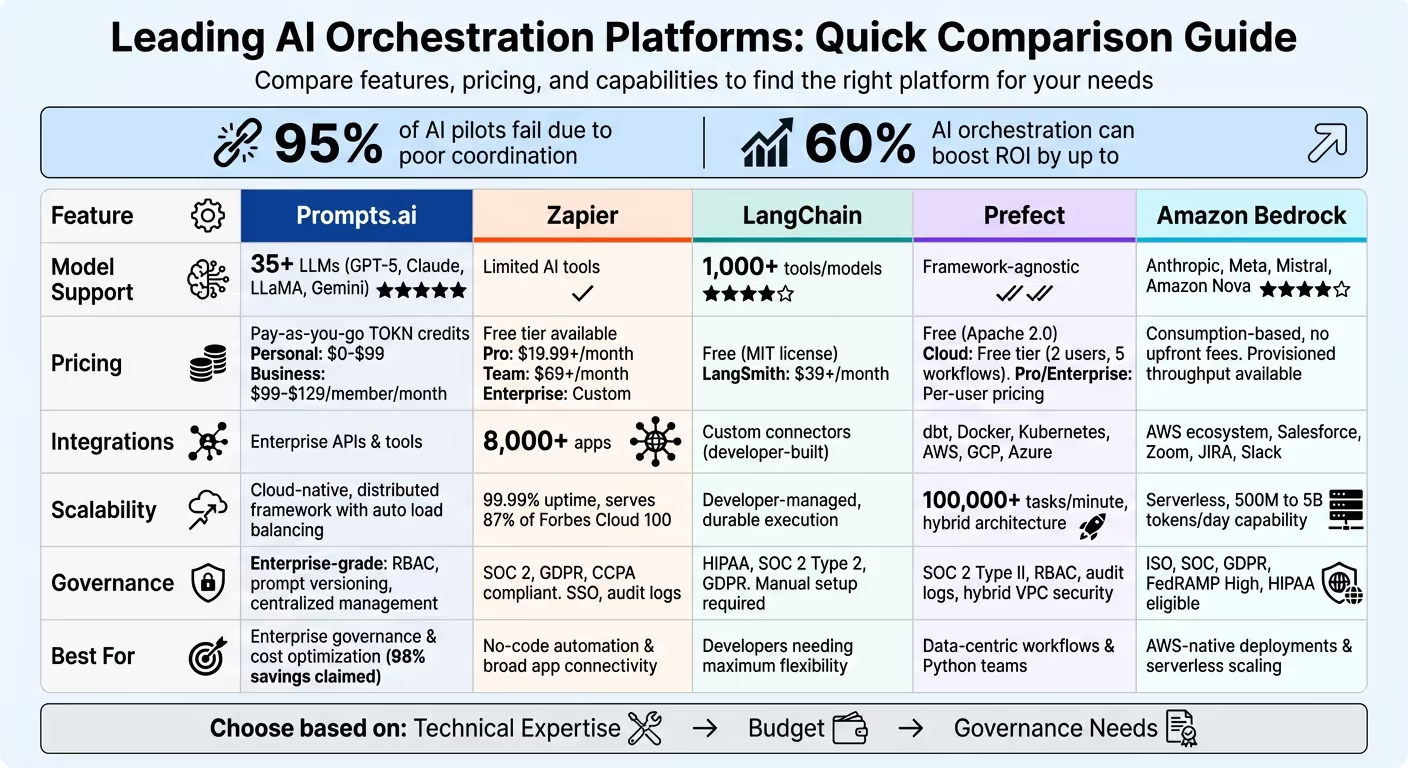

Les plateformes d'orchestration de l'IA simplifient et gèrent les flux de travail à travers de multiples outils et modèles, aidant ainsi les entreprises à gagner en efficacité et en évolutivité. Avec 95 % des pilotes d'IA échouent en raison d'une mauvaise coordination, une orchestration efficace de l'IA peut augmenter le retour sur investissement en jusqu'à 60 %. Ce guide met en lumière cinq plateformes de premier plan : Prompts.ai, Zapier, Chaîne Lang, Préfet, et Substrat rocheux d'Amazon - chacun offrant des atouts uniques en termes d'intégration, d'évolutivité et de gouvernance.

Chaque plateforme répond à des besoins spécifiques :

Commencez par un flux de travail défini pour déterminer quelle plateforme correspond à vos objectifs, à l'expertise de votre équipe et à vos besoins en matière de conformité.

Comparaison des plateformes d'orchestration d'IA : fonctionnalités, prix et fonctionnalités

Prompts.ai est une plate-forme robuste conçue pour rationaliser les opérations d'IA des entreprises en consolidant l'accès à plus de 35 modèles linguistiques de premier plan, notamment GPT-5, Claude, Lama, et Gémeaux, au sein d'une interface unifiée et sécurisée. En éliminant la complexité liée à la gestion de plusieurs fournisseurs d'IA et d'abonnements, il simplifie les flux de travail et améliore la transparence opérationnelle.

Prompts.ai fournit un accès transparent à un large éventail de LLM avancés, offrant des fonctionnalités telles que l'équilibrage de charge automatique et le basculement. Cette configuration élimine les tracas liés à la gestion de plusieurs comptes ou API. Si un fournisseur rencontre des problèmes de temps d'arrêt ou de performances, les tâches sont automatiquement redirigées vers d'autres modèles, garantissant ainsi des flux de travail ininterrompus et une fiabilité constante.

La plateforme repose sur un framework distribué natif du cloud, ce qui lui permet d'évoluer sans effort pour répondre à des demandes croissantes. En tirant parti du traitement asynchrone et de l'équilibrage de charge dynamique, Prompts.ai garantit des performances stables, même en période de forte utilisation. Les tâches sont réparties de manière uniforme entre plusieurs fournisseurs, ce qui permet de maintenir l'efficacité et la réactivité malgré les pics de charge de travail.

Prompts.ai intègre de puissants outils de gouvernance pour faire respecter les normes de l'entreprise et garantir la conformité. Les principales caractéristiques sont les suivantes :

Ensemble, ces outils améliorent la sécurité, la traçabilité et la cohérence opérationnelle des initiatives d'IA des entreprises.

La plateforme utilise un modèle flexible de paiement à l'utilisation avec Crédits TOKN, éliminant les frais récurrents. Les plans tarifaires sont structurés pour répondre à différents besoins :

Prompts.ai affirme que les entreprises peuvent réduire les dépenses liées aux logiciels d'IA jusqu'à 98 % par rapport à la gestion de plusieurs abonnements autonomes, ce qui en fait une solution rentable pour les entreprises de toutes tailles.

Zapier connecte plus de 8 000 applications à plus de 300 outils d'IA, notamment Chat GPT et Claude, via une plateforme d'orchestration sans code. À ce jour, il a automatisé plus de 300 millions de tâches d'IA, au service de plus d'un million d'entreprises. Sa polyvalence en fait un outil précieux dans un large éventail de secteurs.

Les capacités d'intégration de Zapier permettent aux entreprises de connecter de manière fluide les modèles d'IA à leurs infrastructures logicielles existantes. Avec l'accès à plus de 8 000 applications, les utilisateurs peuvent créer des flux de travail automatisés à l'aide de fonctionnalités telles que Zaps pour les tâches en plusieurs étapes, Agents Zapier pour des opérations autonomes, Toile Zapier pour visualiser les processus, Tables Zapier pour gérer les données, et Interfaces Zapier pour les formulaires personnalisés qui activent les flux de travail basés sur l'IA.

Par exemple, en août 2025, Piscine a automatisé plus de 100 flux de travail pour la qualification et le routage des prospects à l'aide de Zapier. Cela a permis d'éliminer une intégration manuelle coûteuse, ce qui a permis à l'entreprise d'économiser 20 000 dollars par an tout en rationalisant son pipeline de ventes. De même, en 2024, Remote.comL'équipe informatique composée de trois personnes a utilisé Zapier pour automatiser plus de 11 millions de tâches, 28 % des tickets informatiques étant résolus automatiquement. Marcus Saito, responsable de l'automatisation informatique et de l'IA chez Remote, a déclaré :

« Zapier donne à notre équipe de trois l'impression d'être une équipe de dix ».

Construit sur une architecture native du cloud, Zapier garantit l'évolutivité grâce à des fonctionnalités telles que la haute disponibilité automatisée et la régulation intelligente. La plateforme offre une garantie de disponibilité de 99,99 % et prend en charge le peering VPC pour des connexions d'entreprise sécurisées aux sources de données internes. Les plans d'entreprise sont assortis de limites de tâches annuelles au lieu de plafonds mensuels, ce qui permet aux entreprises de gérer plus facilement les pics saisonniers de la demande. Zapier dessert actuellement 87 % des entreprises du Forbes Cloud 100 et bénéficie de la confiance de 3,4 millions d'entreprises dans le monde entier.

Zapier fournit des outils de gouvernance robustes adaptés aux utilisateurs professionnels. Il s'agit notamment des autorisations basées sur les rôles, de l'authentification unique (SSO) basée sur SAML et du provisionnement SCIM. La plateforme est conforme aux normes SOC 2 Type II, SOC 3, GDPR et CCPA, garantissant la sécurité des données grâce au cryptage TLS 1.2 pour les données en transit et au cryptage AES-256 pour les données au repos. Les entreprises clientes peuvent restreindre l'accès à des outils d'IA spécifiques et sont automatiquement exclues de l'utilisation de leurs données pour entraîner des modèles d'IA tiers. Des fonctionnalités supplémentaires telles que les journaux d'audit en temps réel, les journaux d'exécution et l'analyse des performances améliorent la transparence opérationnelle.

LangChain est un framework open source conçu pour fonctionner parfaitement avec n'importe quel fournisseur de modèles, permettant aux développeurs de basculer entre les modèles, les outils et les bases de données sans modifier la logique de base de l'application. Contrairement aux plateformes propriétaires, sa nature open source offre une flexibilité inégalée. Avec plus de 90 millions de téléchargements par mois et plus que 100 000 étoiles sur GitHub, il est devenu un choix incontournable pour créer des flux de travail basés sur l'IA. LangChain propose deux frameworks principaux : Chaîne Lang, conçu pour créer des agents dotés d'architectures prédéfinies, et LangGraph, idéal pour les flux de travail personnalisés, dynamiques et de longue durée. Cette flexibilité open source fait de LangChain une plateforme hors pair pour divers modèles et flux de travail d'IA.

La conception neutre du framework de LangChain s'intègre à plus de 1 000 modèles, outils et bases de données. Il prend en charge diverses architectures cognitives, notamment ReACT, Plan-and-Execute, Multi-agent, Critique Revise et Self-Ask. Les développeurs peuvent travailler avec les deux Python et TypeScript, le rendant accessible à un large éventail d'utilisateurs. Garrett Spong, ingénieur logiciel principal, a souligné son impact :

« LangChain a une longueur d'avance grâce à ce qu'elle a proposé avec LangGraph. LangGraph jette les bases de la création et de la mise à l'échelle de charges de travail basées sur l'IA, qu'il s'agisse d'agents conversationnels, d'automatisation de tâches complexes ou d'expériences personnalisées basées sur le LLM qui « fonctionnent tout simplement ». »

La plate-forme LangGraph est conçue pour être évolutive, en utilisant files d'attente de tâches dédiées pour gérer le trafic au niveau de l'entreprise et les pics de charge de travail soudains sans ralentir. Il fournit exécution durable, en veillant à ce que les flux de travail puissent reprendre après des interruptions. Ses API sont conçues pour une mise à l'échelle automatique et incluent des fonctionnalités telles que le point de contrôle personnalisé, la gestion de la mémoire et les fils de conversation, ce qui en fait la solution idéale pour les charges de travail basées sur des agents. Andres Torres, architecte de solutions senior, a partagé son expérience :

« LangGraph a joué un rôle déterminant dans le développement de notre IA. Son cadre robuste pour créer des applications multi-acteurs dynamiques avec des LLM a transformé la façon dont nous évaluons et optimisons les performances de nos solutions d'IA destinées aux clients ».

Lang Smith adhère à des normes de conformité strictes, notamment HIPAA, SOC 2 Type 2 et RGPD. Il offre une authentification et des contrôles d'accès granulaires, permettant aux équipes de gérer les autorisations et de sécuriser les données de manière efficace pour répondre aux besoins de l'entreprise. Les fonctionnalités Human-in-the-Loop fournissent une supervision manuelle, permettant des contrôles de sécurité, des dérogations et des étapes d'approbation avant l'exécution des actions d'IA. Les déploiements d'entreprise incluent un chiffrement au repos et des en-têtes personnalisables pour une sécurité accrue.

Prefect est une plateforme d'orchestration basée sur Python conçue pour transformer les flux de travail d'IA en systèmes fiables grâce à son architecture hybride. Avec plus de 6,5 millions de téléchargements par mois et plus de 21 200 étoiles GitHub, il simplifie la création de flux de travail en utilisant des décorateurs Python tels que @flow et @task, éliminant ainsi le besoin de fichiers de configuration complexes. Cette approche garantit une intégration parfaite avec les flux de travail Python existants et simplifie le développement pour les utilisateurs.

Prefect est bien équipé pour gérer les boucles LLM et les agents d'IA tout en intégrant des contrôles humains. La plateforme prend en charge la création dynamique de tâches au moment de l'exécution, ce qui permet aux flux de travail de s'ajuster et de se ramifier en fonction de données en temps réel. Sa fonction d'exécution durable garantit la reprise des charges de travail coûteuses liées à l'IA dès le point de défaillance, évitant ainsi de devoir réexécuter des pipelines entiers. En outre, Prefect propose un serveur MCP pour fournir un contexte aux assistants IA tels que Claude et Cursor.

Prefect se distingue par ses capacités d'intégration robustes, qui s'harmonisent avec sa conception conviviale. Il offre un support natif pour des outils et des plateformes tels que dbt, Docker, Kubernetes, AWS ECS, Google Cloud Run, Azure ACI et Modal. Son architecture Work Pools sépare les flux de travail de l'infrastructure, permettant aux équipes de changer d'environnement d'exécution sans modifier le code. Cette architecture suit également automatiquement le lignage des données, améliorant ainsi la visibilité du pipeline. Alex Welch, responsable des données chez dbt Labs, a souligné cette flexibilité :

« Nous utilisons Prefect pour orchestrer les tâches dbt Cloud en même temps que d'autres outils de données. Cela donne de la visibilité à l'ensemble de notre pipeline. »

Le modèle d'exécution hybride de Prefect sépare le plan de contrôle de l'exécution du flux de travail, permettant ainsi une capacité de calcul évolutive tout en protégeant les données sensibles au sein d'une infrastructure sécurisée. La plateforme gère plus de 100 000 tâches par minute et utilise un modèle de tarification par utilisateur au lieu de facturer en fonction de l'exécution des flux de travail. En 2024, Plongée avec tuba AI a adopté Prefect OSS sur Kubernetes, ce qui a considérablement amélioré les performances. Smit Shah, directeur de l'ingénierie chez Plongée avec tuba AI, a partagé :

« Nous avons multiplié par 20 le débit grâce à Prefect. C'est notre cheval de bataille en matière de traitement asynchrone. Nous gérons environ un millier de flux par heure avec des performances stables, car la plupart des tâches sont liées au réseau. »

Snorkel AI exécute désormais plus de 1 000 flux par heure, et des dizaines de milliers de flux de travail sont traités quotidiennement. De même, Point final a réduit les coûts de facturation de 73,78 % et a triplé la capacité de production après la migration de 72 pipelines d'Airflow vers Prefect Cloud.

Prefect Cloud donne la priorité à la sécurité et à la conformité, détient la certification SOC 2 Type II et propose un contrôle d'accès granulaire basé sur les rôles pour les comptes, les espaces de travail et les objets. La plateforme tient à jour des journaux d'audit détaillés pour chaque action, ce qui facilite les examens de conformité et les enquêtes de sécurité. L'architecture hybride de Prefect garantit que les données sensibles de l'IA restent dans le VPC de l'utilisateur, seules les métadonnées telles que l'historique des exécutions et l'état de planification étant envoyées au plan de contrôle. Les fonctionnalités d'entreprise incluent la compatibilité SSO avec n'importe quel fournisseur d'identité, le provisionnement SCIM, la liste des adresses IP autorisées et le suivi du lignage des données natif pour une transparence totale des résultats des flux de travail.

Prefect Core est disponible en tant que logiciel open source sous licence Apache 2.0, permettant aux utilisateurs de s'auto-héberger avec un contrôle complet du VPC. Prefect Cloud propose une plateforme gérée avec un niveau de loisirs gratuit pouvant accueillir jusqu'à 2 utilisateurs et 5 flux de travail. Les forfaits Pro et Enterprise proposent une tarification prévisible par utilisateur, permettant ainsi des exécutions de flux de travail illimitées.

Amazon Bedrock est une plateforme sans serveur entièrement gérée qui permet d'accéder aux modèles de base d'Anthropic, Meta, IA Mistral, et la série Nova d'Amazon. Reconnu par plus de 100 000 organisations dans le monde entier, il élimine le besoin de gestion de l'infrastructure, permettant une mise à l'échelle fluide des flux de travail d'IA, des prototypes initiaux à la production à grande échelle. Examinons ses principales fonctionnalités, notamment la prise en charge des modèles, les intégrations, l'évolutivité, la gouvernance et la tarification.

Amazon Bedrock rationalise l'accès à plusieurs modèles de fondation grâce à un API unique, permettant aux utilisateurs de passer facilement d'une version de modèle à l'autre avec un minimum d'ajustements de code. Les développeurs peuvent tirer parti d'Amazon Bedrock AgentCore pour travailler avec des frameworks open source tels que IA de l'équipage, LangGraph, Indice de lamaet Strands Agents. L'environnement d'exécution AgentCore prend en charge les tâches asynchrones d'une durée maximale de 8 heures, assurant la persistance et un accès sécurisé aux outils via la passerelle. De plus, les garde-corps Bedrock renforcent la sécurité en bloquant jusqu'à 88 % des contenus préjudiciables et en détectant les hallucinations des modèles avec une précision impressionnante de 99 %.

Amazon Bedrock s'intègre facilement aux services AWS et aux outils tiers à l'aide de sa passerelle AgentCore. Cette fonctionnalité convertit les API, les fonctions Lambda et les services en outils compatibles MCP. Il se connecte également à des applications d'entreprise populaires telles que Salesforce, Zoom, JIRA, et Slack. Pour la gestion des identités, Bedrock prend en charge l'intégration native avec Okta, identifiant Microsoft Azure Entra, Auteur 0, et Amazon Cognito. Emre Caglar, responsable de l'ingénierie des produits chez Thomson Reuters, a souligné l'impact de la plateforme :

« AgentCore réduit la charge cognitive de nos ingénieurs en supprimant la complexité de l'infrastructure (temps d'exécution des agents, observabilité, gestion du cycle de vie) afin qu'ils puissent se concentrer sur la résolution des problèmes commerciaux importants. »

Amazon Bedrock a prouvé sa capacité à faire évoluer efficacement les opérations d'IA. Entre 2024 et 2025, Robinhood a étendu ses opérations d'IA, passant du traitement de 500 millions à 5 milliards de jetons par jour en seulement six mois. Cette transition, menée par Tagare, responsable de l'IA, a entraîné une réduction de 80 % des coûts de l'IA et une réduction du temps de développement de 50 %. Les modèles distillés de la plateforme fonctionnent jusqu'à 500 % plus rapidement tout en réduisant les coûts jusqu'à 75 %. En outre, le routage rapide intelligent peut réduire les dépenses jusqu'à 30 %. Epsilon, par exemple, a utilisé AgentCore pour automatiser les flux de travail marketing, réduisant ainsi les délais de configuration des campagnes de 30 % et permettant aux équipes de gagner 8 heures par semaine.

Amazon Bedrock respecte des normes de conformité strictes, notamment les normes ISO, SOC, GDPR, FedRAMP High et HIPAA. Il offre un contrôle d'accès robuste basé sur les rôles et s'intègre à Amazon CloudWatch et OpenTelemetry pour une surveillance en temps réel de l'utilisation des jetons, de la latence et des taux d'erreur. Son architecture sans serveur garantit une observabilité complète des flux de travail, améliorant ainsi la transparence et le contrôle.

Amazon Bedrock emploie un modèle de tarification basé sur la consommation, ce qui signifie qu'il n'y a pas de frais initiaux. Les utilisateurs peuvent opter pour un débit provisionné afin de garantir une capacité dédiée à des tarifs réduits. Les fonctionnalités permettant de réduire les coûts, telles que la mise en cache rapide et la distillation des modèles, contribuent à réduire les dépenses opérationnelles.

Zapier se distingue avec plus de 8 000 intégrations d'applications, ce qui en fait une référence pour une connectivité étendue. LangChain se distingue par son architecture hautement modulaire, qui offre une grande flexibilité aux développeurs, mais elle nécessite des compétences techniques avancées et une gouvernance manuelle. Prefect, quant à elle, excelle dans l'orchestration des données mais peine à gérer les déploiements en périphérie : les orchestrateurs centralisés traditionnels peuvent être confrontés à des temps de démarrage à froid de 2 à 5 secondes, tandis que les solutions natives à la périphérie peuvent atteindre des temps de démarrage inférieurs à 50 millisecondes.

Lorsque l'on compare ces plateformes, il apparaît clairement que leurs points forts répondent à des besoins différents. La montée en puissance de IA agentique, où des agents autonomes planifient et exécutent des tâches, redéfinit ce que les utilisateurs attendent des plateformes d'orchestration. Les développeurs qui souhaitent créer des flux de travail personnalisés se tournent souvent vers LangChain pour sa flexibilité, tandis que les entreprises axées sur la conformité et la rentabilité se tournent vers des plateformes telles que Prompts.ai, qui offrent une gouvernance intégrée et un suivi transparent de l'utilisation.

En fin de compte, le bon choix dépend de trois facteurs clés : expertise technique, étendue de l'intégration, et besoins en matière de gouvernance. Par exemple, Zapier offre une simplicité et de larges intégrations, ce qui en fait la solution idéale pour les utilisateurs professionnels disposant d'une expertise technique minimale. LangChain, avec ses outils destinés aux développeurs, se situe à l'opposé du spectre. Prefect répond aux besoins des équipes centrées sur les données grâce à ses puissantes capacités d'orchestration, mais peut nécessiter une gestion plus pratique.

Pour trouver la solution la mieux adaptée, les organisations devraient commencer par piloter un flux de travail unique et bien défini. Cette approche permet d'évaluer la manière dont chaque plateforme s'aligne sur ses compétences techniques, ses exigences d'intégration et ses priorités de gouvernance.

Le choix de la bonne plateforme d'orchestration de l'IA dépend de trois considérations clés : l'expertise technique de votre équipe, votre budget et le niveau de gouvernance requis. Pour les équipes dont les compétences en matière de codage sont limitées, les plateformes dotées d'interfaces glisser-déposer peuvent permettre aux utilisateurs non techniques de concevoir des flux de travail sans recourir trop à des ressources d'ingénierie. D'un autre côté, les équipes soucieuses de leur budget et dotées de solides capacités de développement peuvent se tourner vers des options open source telles que LangChain ou Prefect. Ces frameworks éliminent les frais de licence mais nécessitent une gestion auto-hébergée et une maintenance continue.

La gouvernance est un autre facteur essentiel, en particulier dans des secteurs tels que la finance ou la santé, où la conformité n'est pas négociable. Les plateformes proposant des fonctionnalités telles que des pistes d'audit et des contrôles d'accès basés sur les rôles sont essentielles pour maintenir la responsabilité et garantir la sécurité des opérations, renforçant ainsi les avantages de l'orchestration évoqués précédemment.

Les coûts restent un défi majeur pour de nombreuses organisations. Selon Gartner, plus de 90 % des DSI citent le coût comme un obstacle majeur à l'adoption de l'IA. Des modèles de tarification flexibles, tels que la facturation à l'utilisation ou la facturation basée sur les tâches, permettent aux équipes d'augmenter leur utilisation sans avoir à payer de frais d'abonnement initiaux importants. Pour ceux qui gèrent plusieurs grands modèles linguistiques, l'attribution stratégique des tâches, par exemple en utilisant Claude pour l'analyse des documents et ChatGPT pour le raisonnement logique, peut contribuer à optimiser les dépenses. Une période d'essai peut vous permettre de savoir quelle plateforme correspond le mieux à vos besoins opérationnels uniques.

En fin de compte, l'objectif est de faire correspondre les points forts d'une plateforme aux priorités de votre organisation. Tester un flux de travail clair peut confirmer si les fonctionnalités d'intégration, d'évolutivité et de gouvernance d'une plateforme correspondent à vos objectifs. Qu'il s'agisse de rationaliser les processus de vente, de traiter des ensembles de données volumineux ou de déployer des solutions d'IA avancées, la bonne plateforme doit simplifier vos opérations, et non les compliquer.

Lors de la sélection d'une plateforme d'orchestration d'IA, il est important de donner la priorité aux fonctionnalités qui simplifient l'intégration, soutiennent la croissance et améliorent l'efficacité globale de vos flux de travail d'IA.

Choisissez une plateforme qui propose intégration facile avec une variété d'outils, de modèles et de sources de données, ce qui réduit le besoin d'un codage personnalisé approfondi. Robuste gouvernance et conformité les fonctionnalités, telles que les autorisations basées sur les rôles et le suivi prêt à être audité, sont essentielles pour maintenir la responsabilité et respecter les exigences réglementaires. Assurez-vous que la plateforme est conçue pour évolutivité et fiabilité, afin qu'il puisse gérer efficacement les charges de travail les plus exigeantes, même pendant les périodes de pointe.

Plateformes équipées de surveillance en temps réel et des tableaux de bord conviviaux peuvent vous aider à identifier et à résoudre rapidement tout problème de performance. Optez pour une tarification transparente et basée sur l'utilisation pour maîtriser les coûts. Enfin, la plateforme doit correspondre à l'expertise de votre équipe et offrir de la flexibilité grâce à des options sans code et basées sur le code, afin de simplifier le développement et le déploiement. En vous concentrant sur ces fonctionnalités, vous pouvez trouver une solution qui stimule la productivité et s'aligne sur les objectifs de votre organisation en matière d'IA.

Les plateformes d'orchestration de l'IA s'appuient souvent sur deux structures tarifaires principales : modèles basés sur l'utilisation et abonnements à plusieurs niveaux. Ces approches répondent à une variété de besoins, qu'il s'agisse de petits projets ou d'opérations d'entreprise à grande échelle.

Avec la tarification basée sur l'utilisation, les coûts sont déterminés par des indicateurs tels que les appels d'API, les heures de calcul ou la consommation de jetons. Ce modèle fonctionne bien pour les charges de travail qui fluctuent ou qui sont saisonnières, car vous ne payez que pour ce que vous utilisez. Les abonnements échelonnés, quant à eux, proposent des tarifs mensuels ou annuels fixes qui incluent des fonctionnalités groupées, des limites d'utilisation et parfois des avantages tels qu'une assistance premium ou des outils de surveillance avancés.

De nombreuses plateformes combinent ces modèles pour offrir de la flexibilité. Par exemple, ils peuvent proposer des essais gratuits ou des plans d'entrée de gamme pour aider les utilisateurs à explorer la plateforme avec un minimum d'engagement. À mesure que les entreprises se développent, elles peuvent facilement passer à des forfaits offrant une capacité accrue et des fonctionnalités supplémentaires. Cette flexibilité vous permet de trouver une structure de prix adaptée à la fois à votre budget et à vos besoins opérationnels.

L'orchestration de l'IA dans des secteurs fortement réglementés tels que la finance, la santé et l'énergie exige de mettre l'accent sur la gouvernance afin de maintenir la conformité et de garantir la sécurité. Les plateformes les plus efficaces intègrent la gouvernance directement dans leurs flux de travail, en fournissant traçabilité, auditabilité et application des politiques à chaque étape, de la gestion des données à l'exécution du modèle.

Les principaux outils de gouvernance incluent application des politiques pour bloquer les activités non autorisées, contrôles d'accès basés sur les rôles (RBAC) pour limiter les autorisations, et journaux d'audit immuables qui capturent chaque action à des fins de reporting réglementaire. Des couches de protection supplémentaires, telles que chiffrement des données, gestion des versions du modèle, et surveillance en temps réel, protégez les informations sensibles et aidez à identifier les irrégularités. En intégrant ces contrôles, les organisations peuvent répondre en toute confiance aux normes réglementaires tout en utilisant pleinement les capacités de l'IA.