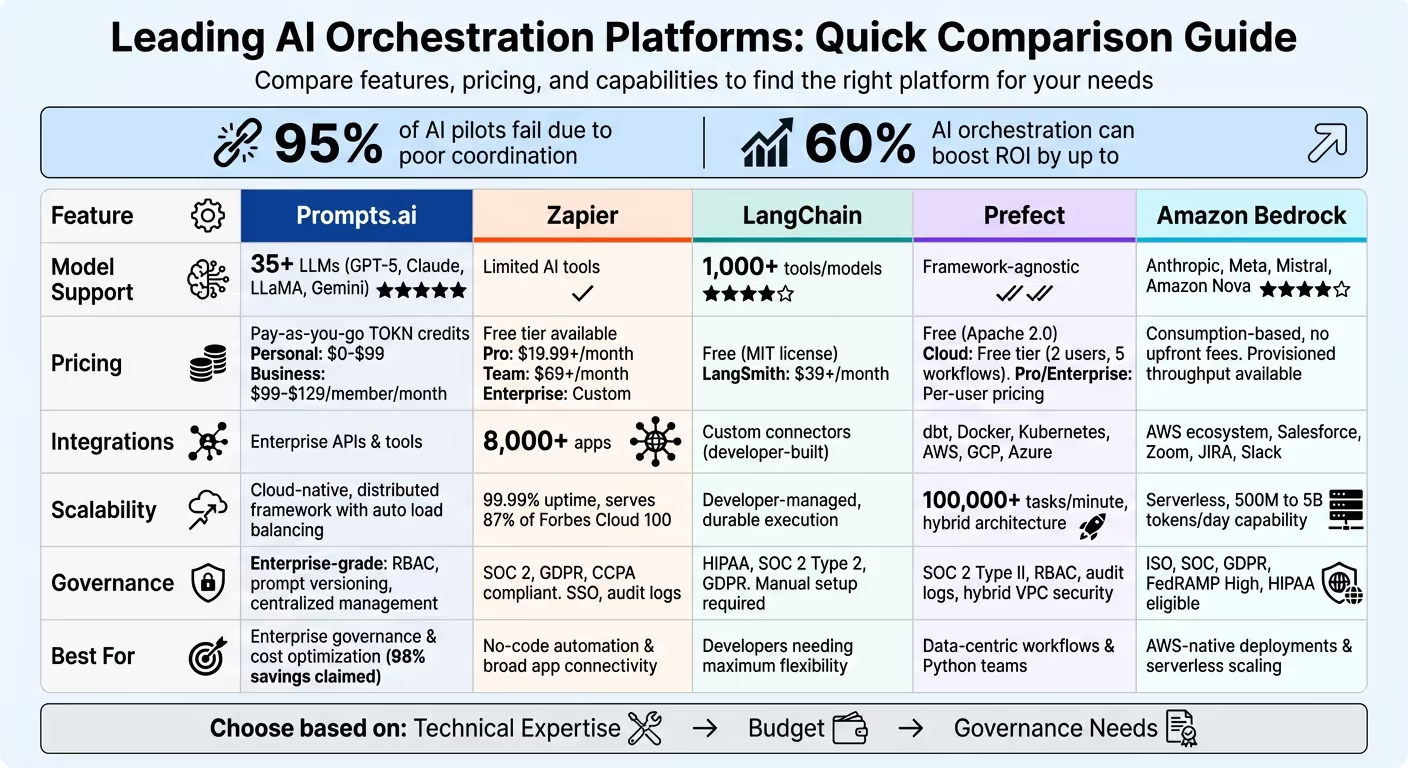

Las plataformas de orquestación de IA simplifican y administran los flujos de trabajo en múltiples herramientas y modelos, lo que ayuda a las empresas a lograr eficiencia y escalabilidad. Con El 95% de los pilotos de IA fallan debido a una mala coordinación, la organización eficaz de la IA puede aumentar el ROI al hasta un 60%. Esta guía destaca cinco plataformas líderes: Prompts.ai, Zapier, Cadena LANG, Prefecto, y lecho rocoso amazónico - cada una de ellas ofrece puntos fuertes únicos en integración, escalabilidad y gobernanza.

Cada plataforma satisface necesidades específicas:

Comience con un flujo de trabajo definido para determinar qué plataforma se alinea con sus objetivos, la experiencia del equipo y las necesidades de cumplimiento.

Comparación de plataformas de orquestación de IA: características, precios y capacidades

Prompts.ai es una plataforma sólida diseñada para agilizar las operaciones de IA empresarial mediante la consolidación del acceso a más de 35 modelos lingüísticos líderes, que incluyen GPT-5, Claudio, Llama, y Géminis, dentro de una interfaz segura y unificada. Al eliminar la complejidad de combinar varios proveedores y suscripciones de IA, simplifica los flujos de trabajo y mejora la transparencia operativa.

Prompts.ai proporciona un acceso sin interrupciones a una amplia gama de LLM avanzadas y ofrece funciones como el equilibrio de carga automatizado y la conmutación por error. Esta configuración elimina la molestia de administrar varias cuentas o API. Si un proveedor tiene problemas de rendimiento o tiempo de inactividad, las tareas se redirigen automáticamente a modelos alternativos, lo que garantiza flujos de trabajo ininterrumpidos y una fiabilidad constante.

La plataforma se basa en un marco distribuido nativo de la nube, lo que le permite escalar sin esfuerzo para satisfacer las crecientes demandas. Al aprovechar el procesamiento asincrónico y el equilibrio de carga dinámico, Prompts.ai garantiza un rendimiento estable, incluso durante períodos de uso intensivo. Las tareas se distribuyen de manera uniforme entre varios proveedores, lo que mantiene la eficiencia y la capacidad de respuesta independientemente de los picos de carga de trabajo.

Prompts.ai incorpora herramientas de gobierno sólidas para mantener los estándares empresariales y garantizar el cumplimiento. Las características clave incluyen:

Estas herramientas mejoran colectivamente la seguridad, la trazabilidad y la coherencia operativa en todas las iniciativas de IA empresarial.

La plataforma utiliza un modelo flexible de pago por uso con Créditos TOKN, eliminando las comisiones recurrentes. Los planes de precios están estructurados para satisfacer diversas necesidades:

Prompts.ai afirma que las organizaciones pueden reducir los gastos de software de IA hasta en 98% en comparación con la administración de varias suscripciones independientes, lo que la convierte en una solución rentable para empresas de todos los tamaños.

Zapier conecta más de 8000 aplicaciones con más de 300 herramientas de inteligencia artificial, que incluyen Chat GPT y Claude, a través de una plataforma de orquestación sin código. Hasta la fecha, ha automatizado más de 300 millones de tareas de IA y ha prestado servicios a más de 1 millón de empresas. Su versatilidad la convierte en una herramienta valiosa en una amplia gama de industrias.

Las capacidades de integración de Zapier permiten a las empresas conectar sin problemas los modelos de IA con sus marcos de software existentes. Con acceso a más de 8000 aplicaciones, los usuarios pueden crear flujos de trabajo automatizados mediante funciones como Zaps para tareas de varios pasos, Agentes de Zapier para operaciones autónomas, Lienzo Zapier para visualizar procesos, Mesas Zapier para administrar datos, y Interfaces Zapier para formularios personalizados que activan los flujos de trabajo de IA.

Por ejemplo, en agosto de 2025, Piscina automatizó más de 100 flujos de trabajo para la calificación y el enrutamiento de clientes potenciales con Zapier. Esto eliminó una costosa integración manual, lo que permitió a la empresa ahorrar 20 000 dólares al año y, al mismo tiempo, racionalizar su cartera de ventas. Del mismo modo, en 2024, Remote.comEl equipo de TI de tres personas usó Zapier para automatizar más de 11 millones de tareas, y el 28% de los tickets de TI se resolvieron automáticamente. Marcus Saito, director de automatización de TI e IA de Remote, comentó:

«Zapier hace que nuestro equipo de tres se sienta como un equipo de diez».

Basado en una arquitectura nativa de la nube, Zapier garantiza la escalabilidad con funciones como la alta disponibilidad automatizada y la regulación inteligente. La plataforma ofrece una garantía de tiempo de actividad del 99,99% y admite la interconexión de VPC para garantizar las conexiones empresariales a las fuentes de datos internas. Los planes empresariales incluyen límites de tareas anuales en lugar de límites mensuales, lo que facilita a las empresas gestionar los picos de demanda estacionales. En la actualidad, Zapier presta servicios al 87% de las 100 empresas de Forbes Cloud y 3,4 millones de empresas de todo el mundo confían en él.

Zapier proporciona herramientas de gobierno sólidas diseñadas para usuarios empresariales. Estas incluyen los permisos basados en roles, el inicio de sesión único (SSO) basado en SAML y el aprovisionamiento de SCIM. La plataforma cumple con los estándares SOC 2 de tipo II, SOC 3, GDPR y CCPA, y garantiza la seguridad de los datos mediante el cifrado TLS 1.2 para los datos en tránsito y el cifrado AES-256 para los datos en reposo. Los clientes empresariales pueden restringir el acceso a herramientas de IA específicas y se les excluye automáticamente de la posibilidad de que sus datos se utilicen para entrenar modelos de IA de terceros. Las funciones adicionales, como los registros de auditoría en tiempo real, los registros de ejecución y los análisis de rendimiento, mejoran la transparencia operativa.

LangChain es un marco de código abierto diseñado para funcionar sin problemas con cualquier proveedor de modelos, lo que permite a los desarrolladores cambiar entre modelos, herramientas y bases de datos sin alterar la lógica principal de la aplicación. A diferencia de las plataformas propietarias, su naturaleza de código abierto proporciona una flexibilidad sin igual. Con más de 90 millones de descargas al mes y más de 100 000 estrellas de GitHub, se ha convertido en la opción ideal para crear flujos de trabajo de IA. LangChain ofrece dos marcos principales: Cadena LANG, diseñado para crear agentes con arquitecturas prediseñadas, y Gráfico de largo, ideal para flujos de trabajo personalizados, con estado y de larga duración. Esta flexibilidad de código abierto convierte a LangChain en una plataforma destacada para diversos modelos y flujos de trabajo de IA.

El diseño neutral del marco de LangChain se integra con más de 1000 modelos, herramientas y bases de datos. Es compatible con varias arquitecturas cognitivas, incluidas ReAct, Plan-and-Execute, Multi-Agent, Critique Revise y Self-ask. Los desarrolladores pueden trabajar con ambas Python y TypeScript, lo que lo hace accesible a una amplia gama de usuarios. Garrett Spong, ingeniero principal de software, destacó su impacto:

«LangChain está muy por delante con lo que ha presentado con LangGraph. LangGraph sienta las bases para crear y escalar las cargas de trabajo de inteligencia artificial, desde agentes conversacionales y la automatización de tareas complejas hasta experiencias personalizadas respaldadas por un LLM que «simplemente funcionan».

La plataforma LangGraph está diseñada para la escalabilidad, utilizando colas de tareas dedicadas para gestionar el tráfico de nivel empresarial y los picos repentinos de carga de trabajo sin reducir la velocidad. Proporciona ejecución duradera, garantizando que los flujos de trabajo puedan reanudarse después de las interrupciones. Sus API están diseñadas para escalarse automáticamente e incluyen funciones como puntos de control personalizados, administración de memoria e hilos de conversación, lo que las hace ideales para cargas de trabajo basadas en agentes. Andrés Torres, arquitecto sénior de soluciones, compartió su experiencia:

«LangGraph ha sido fundamental para nuestro desarrollo de la IA. Su sólida estructura para crear aplicaciones dinámicas y de múltiples actores con sistemas de aprendizaje automático (LLM) ha transformado la forma en que evaluamos y optimizamos el rendimiento de nuestras soluciones de IA orientadas a los clientes».

Lang Smith se adhiere a normas de cumplimiento estrictas, que incluyen HIPAA, SOC 2 tipo 2 y GDPR. Ofrece controles de acceso y autenticación granulares, lo que permite a los equipos administrar los permisos y proteger los datos de manera efectiva para las necesidades empresariales. Las funciones Human-in-the-Loop proporcionan una supervisión manual, lo que permite realizar comprobaciones de seguridad, anulaciones y pasos de aprobación antes de ejecutar las acciones de inteligencia artificial. Las implementaciones empresariales incluyen cifrado en reposo y encabezados personalizables para mayor seguridad.

Prefect es una plataforma de orquestación basada en Python diseñada para transformar los flujos de trabajo de IA en sistemas confiables mediante su arquitectura híbrida. Con más de 6,5 millones de descargas al mes y más de 21 200 estrellas de GitHub, simplifica la creación de flujos de trabajo al utilizar decoradores de Python como @flow y @task, lo que elimina la necesidad de complicados archivos de configuración. Este enfoque garantiza una integración perfecta con los flujos de trabajo de Python existentes y simplifica el desarrollo para los usuarios.

Prefect está bien equipado para gestionar los bucles de LLM y los agentes de IA, al tiempo que incorpora controles interpersonales. La plataforma admite la creación dinámica de tareas durante el tiempo de ejecución, lo que permite que los flujos de trabajo se ajusten y se ramifiquen en función de los datos en tiempo real. Su función de ejecución duradera garantiza que las costosas cargas de trabajo de inteligencia artificial puedan reanudarse desde el punto en que se produce el error, lo que evita la necesidad de volver a ejecutar procesos completos. Además, Prefect ofrece un servidor MCP para proporcionar contexto a los asistentes de IA, como Claude y Cursor.

Prefect destaca por sus sólidas capacidades de integración, que se alinean con su diseño fácil de usar. Ofrece soporte nativo para herramientas y plataformas como deuda, Estibador, Kubernetes, AWS ECS, Google Cloud Run, Azure ACI y Modal. Su arquitectura de grupos de trabajo separa los flujos de trabajo de la infraestructura, lo que permite a los equipos cambiar de entorno de ejecución sin alterar el código. Esta arquitectura también rastrea automáticamente el linaje de datos, lo que mejora la visibilidad de los procesos. Alex Welch, director de datos de dbt Labs, destacó esta flexibilidad:

«Usamos Prefect para organizar los trabajos de dbt Cloud junto con otras herramientas de datos. Aporta visibilidad a toda nuestra cartera de proyectos».

El modelo de ejecución híbrida de Prefect separa el plano de control de la ejecución del flujo de trabajo, lo que permite una capacidad informática escalable y, al mismo tiempo, protege los datos confidenciales dentro de una infraestructura segura. La plataforma gestiona más de 100 000 tareas por minuto y emplea un modelo de precios por usuario en lugar de cobrar en función de la ejecución del flujo de trabajo. En 2024, Snorkel AI adoptó Prefect OSS en Kubernetes, lo que aumentó significativamente el rendimiento. Smit Shah, director de ingeniería de Snorkel AI, compartió:

«Hemos mejorado el rendimiento 20 veces con Prefect. Es nuestro motor de batalla para el procesamiento asincrónico. Ejecutamos alrededor de mil flujos por hora con un rendimiento estable, ya que la mayoría de las tareas están vinculadas a la red».

Snorkel AI ahora ejecuta más de 1000 flujos por hora, con decenas de miles de flujos de trabajo procesados a diario. Del mismo modo, Punto final redujo los costos de facturación en un 73,78% y triplicó la capacidad de producción tras migrar 72 canalizaciones de Airflow a Prefect Cloud.

Prefect Cloud prioriza la seguridad y el cumplimiento, cuenta con la certificación SOC 2 de tipo II y ofrece un control de acceso granular basado en roles en todas las cuentas, espacios de trabajo y objetos. La plataforma mantiene registros de auditoría detallados para cada acción, lo que contribuye a las revisiones de cumplimiento y a las investigaciones de seguridad. La arquitectura híbrida de Prefect garantiza que los datos confidenciales de la IA permanezcan en la VPC del usuario y que solo se envíen al plano de control los metadatos, como el historial de ejecución y el estado de programación. Entre las funciones empresariales se incluyen la compatibilidad del SSO con cualquier proveedor de identidad, el aprovisionamiento mediante SCIM, la creación de listas de direcciones IP permitidas y el seguimiento del linaje de datos nativo para garantizar una transparencia total en los resultados del flujo de trabajo.

Prefect Core está disponible como software de código abierto bajo la licencia Apache 2.0, lo que permite a los usuarios autohospedarse con un control total de la VPC. Prefect Cloud ofrece una plataforma gestionada con un nivel de afición gratuito para hasta 2 usuarios y 5 flujos de trabajo. Los planes Pro y Enterprise ofrecen precios predecibles por usuario, lo que permite ejecutar flujos de trabajo de forma ilimitada.

Amazon Bedrock es una plataforma totalmente gestionada y sin servidores que proporciona acceso a los modelos básicos de Anthropic, Meta, Mistral IA, y la serie Nova de Amazon. Con la confianza de más de 100 000 organizaciones de todo el mundo, elimina la necesidad de gestionar la infraestructura, lo que permite escalar sin problemas los flujos de trabajo de la IA desde los prototipos iniciales hasta la producción a gran escala. Analicemos sus funciones clave, que incluyen el soporte de modelos, las integraciones, la escalabilidad, la gobernanza y los precios.

Amazon Bedrock agiliza el acceso a varios modelos básicos a través de un API única, lo que facilita a los usuarios el cambio entre versiones de modelos con mínimos ajustes de código. Los desarrolladores pueden aprovechar Amazon Bedrock AgentCore para trabajar con marcos de código abierto como Tripulación AI, Long Graph, Índice Llamay Strands Agents. El AgentCore Runtime admite tareas asincrónicas que duran hasta 8 horas, lo que proporciona persistencia y un acceso seguro a las herramientas a través del Gateway. Además, las barandillas Bedrock mejoran la seguridad al bloquear hasta el 88% del contenido dañino y detectar las alucinaciones de las modelos con una impresionante precisión del 99%.

Amazon Bedrock se integra fácilmente con los servicios de AWS y las herramientas de terceros mediante su puerta de enlace AgentCore. Esta función convierte las API, las funciones y los servicios de Lambda en herramientas compatibles con MCP. También se conecta con aplicaciones empresariales populares, como Fuerza de ventas, Zoom, JIRA, y Slack. Para la gestión de identidades, Bedrock admite la integración nativa con Okta, ID de entrada de Microsoft Azure, Autor0, y Amazon Cognito. Emre Caglar, director de ingeniería de productos de Thomson Reuters, destacó el impacto de la plataforma:

«AgentCore reduce la carga cognitiva de nuestros ingenieros al reducir la complejidad de la infraestructura (tiempos de ejecución de los agentes, observabilidad y gestión del ciclo de vida) para que puedan centrarse en resolver los problemas empresariales más importantes».

Amazon Bedrock ha demostrado su capacidad para escalar las operaciones de IA de manera eficaz. Entre 2024 y 2025, Robinhood amplió sus operaciones de inteligencia artificial para que pasaran de procesar 500 millones a 5000 millones de tokens al día en solo seis meses. Esta transición, dirigida por Tagare, jefe de desarrollo de IA, se tradujo en una reducción del 80% en los costos de inteligencia artificial y en una reducción del tiempo de desarrollo en un 50%. Los modelos destilados de la plataforma funcionan hasta un 500% más rápido y, al mismo tiempo, reducen los costos hasta un 75%. Además, el enrutamiento rápido inteligente puede reducir los gastos hasta en un 30%. Épsilon, por ejemplo, utilizó AgentCore para automatizar los flujos de trabajo de marketing, reduciendo los tiempos de preparación de las campañas en un 30% y ahorrando a los equipos 8 horas por semana.

Amazon Bedrock cumple con estrictos estándares de cumplimiento, incluidos los requisitos para cumplir con las normas ISO, SOC, GDPR, FedRAMP High e HIPAA. Ofrece un sólido control de acceso basado en roles y se integra con Amazon CloudWatch y Telemetría abierta para monitorear en tiempo real el uso de los tokens, la latencia y las tasas de error. Su arquitectura sin servidores garantiza una total observabilidad en todos los flujos de trabajo, lo que mejora la transparencia y el control.

Amazon Bedrock emplea un modelo de precios basado en el consumo, lo que significa que no hay comisiones por adelantado. Los usuarios pueden optar por un rendimiento aprovisionado para garantizar una capacidad dedicada a precios reducidos. Las funciones que permiten ahorrar costes, como el almacenamiento rápido en caché y la destilación de modelos, ayudan a reducir aún más los gastos operativos.

Zapier destaca con más de 8.000 integraciones de aplicaciones, lo que lo convierte en una opción ideal para una amplia conectividad. LangChain destaca por su arquitectura altamente modular, que ofrece una amplia flexibilidad para los desarrolladores, pero requiere conocimientos técnicos avanzados y una gestión manual. Prefect, por otro lado, sobresale en la orquestación de datos, pero tiene dificultades con las implementaciones periféricas: los orquestadores centralizados tradicionales pueden tener tiempos de arranque en frío de 2 a 5 segundos, mientras que las soluciones nativas periféricas pueden alcanzar tiempos de inicio inferiores a 50 milisegundos.

Al comparar estas plataformas, queda claro que sus puntos fuertes se adaptan a diferentes necesidades. El auge de IA de agencia, donde los agentes autónomos planifican y ejecutan las tareas, está redefiniendo lo que los usuarios esperan de las plataformas de orquestación. Los desarrolladores que desean crear flujos de trabajo personalizados suelen decantarse por LangChain por su flexibilidad, mientras que las empresas que se centran en el cumplimiento y la rentabilidad se decantan por plataformas como Prompts.ai, que ofrecen una gobernanza integrada y un seguimiento transparente del uso.

En última instancia, la elección correcta depende de tres factores clave: experiencia técnica, amplitud de integración, y necesidades de gobernanza. Por ejemplo, Zapier ofrece simplicidad y amplias integraciones, lo que lo hace ideal para usuarios empresariales con una experiencia técnica mínima. LangChain, con sus herramientas centradas en los desarrolladores, se encuentra en el extremo opuesto del espectro. Prefect atiende a los equipos centrados en los datos con sus sólidas capacidades de orquestación, pero puede requerir una gestión más práctica.

Para encontrar la mejor opción, las organizaciones deben empezar por poner a prueba un flujo de trabajo único y bien definido. Este enfoque ayuda a evaluar cómo cada plataforma se alinea con sus habilidades técnicas, requisitos de integración y prioridades de gobierno.

La selección de la plataforma de orquestación de IA adecuada depende de tres consideraciones clave: la experiencia técnica de su equipo, su presupuesto y el nivel de gobierno requerido. Para los equipos con conocimientos de codificación limitados, las plataformas con interfaces de arrastrar y soltar pueden permitir a los usuarios sin conocimientos técnicos diseñar flujos de trabajo sin depender en gran medida de los recursos de ingeniería. Por otro lado, los equipos que se preocupan por su presupuesto y cuentan con sólidas capacidades de desarrollo pueden optar por opciones de código abierto como LangChain o Prefect. Estos marcos eliminan las tarifas de licencia, pero requieren una administración autohospedada y un mantenimiento continuo.

La gobernanza es otro factor crítico, especialmente en sectores como el financiero o el sanitario, donde el cumplimiento no es negociable. Las plataformas que ofrecen funciones como los registros de auditoría y los controles de acceso basados en funciones son esenciales para mantener la responsabilidad y garantizar la seguridad de las operaciones, lo que refuerza los beneficios de la orquestación comentados anteriormente.

El costo sigue siendo un desafío importante para muchas organizaciones. De acuerdo con Gartner, más del 90% de los CIO citan el costo como un obstáculo importante para la adopción de la IA. Los modelos de precios flexibles, como el pago por uso o la facturación basada en tareas, permiten a los equipos ampliar el uso sin tener que comprometerse a pagar grandes cuotas de suscripción por adelantado. Para aquellos que gestionan varios modelos lingüísticos de gran tamaño, la asignación estratégica de tareas (por ejemplo, utilizar Claude para el análisis de documentos y ChatGPT para el razonamiento lógico) puede ayudar a optimizar los gastos. Un período de prueba puede proporcionar claridad sobre qué plataforma se adapta mejor a sus necesidades operativas únicas.

En última instancia, el objetivo es hacer coincidir las fortalezas de una plataforma con las prioridades de su organización. Probar un flujo de trabajo claro puede confirmar si las capacidades de integración, la escalabilidad y las funciones de gobierno de una plataforma se alinean con sus objetivos. Ya sea que esté optimizando los procesos de ventas, procesando conjuntos de datos masivos o implementando soluciones de inteligencia artificial avanzadas, la plataforma adecuada debería simplificar sus operaciones, no complicarlas.

Al seleccionar una plataforma de orquestación de IA, es importante priorizar las funciones que simplifican la integración, respaldan el crecimiento y mejoran la eficiencia general de los flujos de trabajo de IA.

Elige una plataforma que ofrezca fácil integración con una variedad de herramientas, modelos y fuentes de datos, lo que reduce la necesidad de una amplia codificación personalizada. Robusto gobierno y cumplimiento las capacidades, como los permisos basados en funciones y el seguimiento listo para la auditoría, son cruciales para mantener la responsabilidad y cumplir con los requisitos reglamentarios. Asegúrese de que la plataforma esté diseñada para escalabilidad y confiabilidad, por lo que puede gestionar de manera eficiente las cargas de trabajo de alta demanda, incluso durante las horas punta.

Plataformas equipadas con monitoreo en tiempo real y los paneles de control fáciles de usar pueden ayudarlo a identificar y abordar rápidamente cualquier problema de rendimiento. Busque precios transparentes y basados en el uso para mantener los costos bajo control. Por último, la plataforma debe estar a la altura de la experiencia de su equipo y ofrecer flexibilidad con opciones que no requieren código o que se centran en el código para simplificar el desarrollo y la implementación. Si te centras en estas funciones, puedes encontrar una solución que aumente la productividad y se alinee con los objetivos de inteligencia artificial de tu organización.

Las plataformas de orquestación de IA suelen basarse en dos estructuras de precios principales: modelos basados en el uso y suscripciones escalonadas. Estos enfoques se adaptan a una variedad de necesidades, desde proyectos pequeños hasta operaciones empresariales a gran escala.

Con los precios basados en el uso, los costos se determinan en función de métricas como las llamadas a la API, las horas de procesamiento o el consumo de tokens. Este modelo funciona bien para las cargas de trabajo que fluctúan o son estacionales, ya que solo pagas por lo que usas. Las suscripciones escalonadas, por otro lado, ofrecen tarifas fijas mensuales o anuales que incluyen funciones agrupadas, límites de uso y, a veces, ventajas como soporte premium o herramientas de supervisión avanzadas.

Muchas plataformas combinan estos modelos para ofrecer flexibilidad. Por ejemplo, pueden ofrecer pruebas gratuitas o planes básicos para ayudar a los usuarios a explorar la plataforma con un compromiso mínimo. A medida que las empresas crecen, pueden hacer la transición sin problemas a planes con mayor capacidad y funciones adicionales. Esta flexibilidad garantiza que pueda encontrar una estructura de precios que se adapte tanto a su presupuesto como a sus necesidades operativas.

La orquestación de la IA en sectores muy regulados, como las finanzas, la atención médica y la energía, exige un fuerte enfoque en la gobernanza para mantener el cumplimiento y garantizar la seguridad. Las plataformas más eficaces incorporan la gobernanza directamente a sus flujos de trabajo, lo que proporciona trazabilidad, auditabilidad y aplicación de políticas en cada etapa, desde la gestión de datos hasta la ejecución del modelo.

Las herramientas clave de gobierno incluyen aplicación de políticas para bloquear actividades no autorizadas, controles de acceso basados en funciones (RBAC) para limitar los permisos, y registros de auditoría inmutables que capturan todas las acciones para la presentación de informes reglamentarios. Capas de protección adicionales, como cifrado de datos, control de versiones de modelos, y monitoreo en tiempo real, protegen la información confidencial y ayudan a identificar las irregularidades. Al integrar estos controles, las organizaciones pueden cumplir con confianza las normas reglamentarias y, al mismo tiempo, utilizar al máximo las capacidades de la IA.