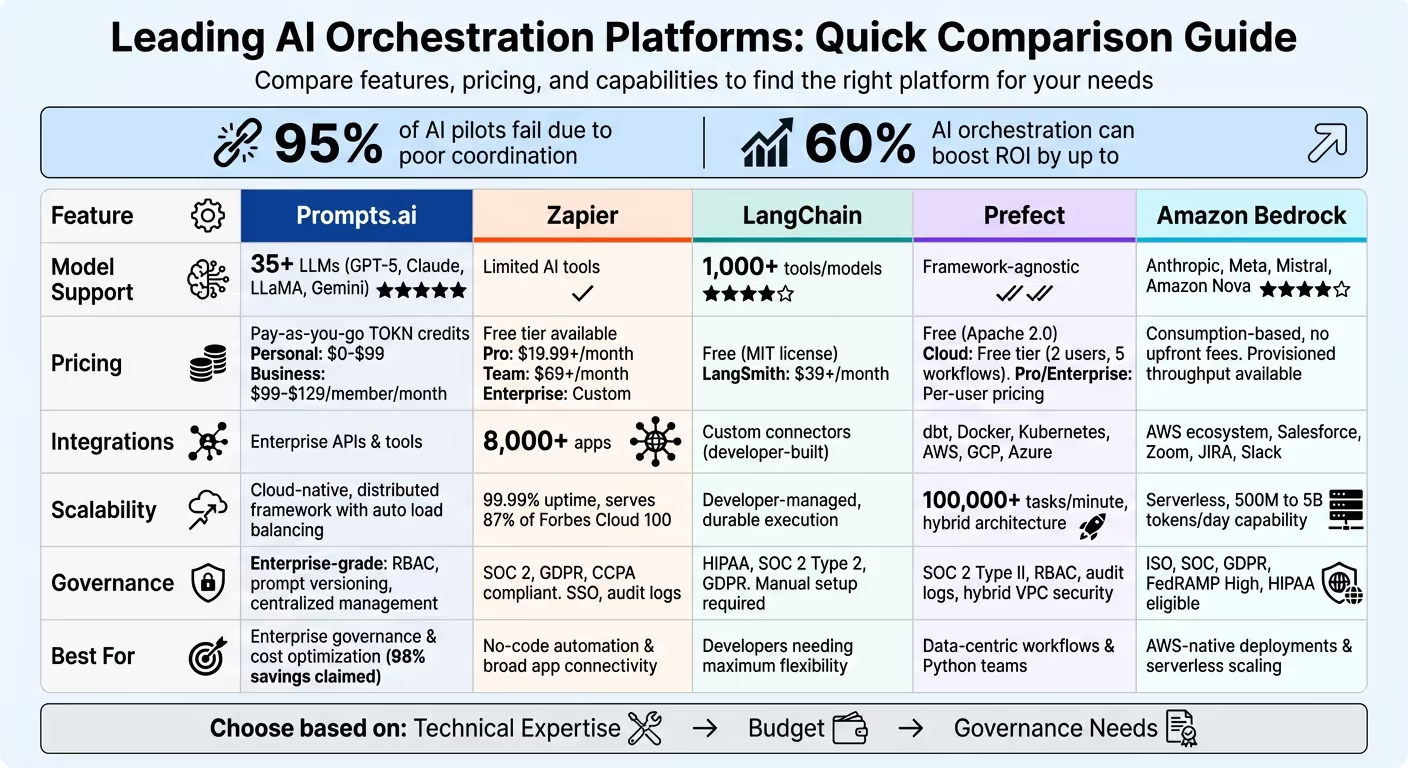

AI 编排平台可简化和管理多个工具和模型的工作流程,帮助企业实现效率和规模。和 95% 的人工智能飞行员因协调不佳而失败,有效协调人工智能可以通过以下方式提高投资回报率 高达 60%。本指南重点介绍了五个领先平台- Prompts.ai, 扎皮尔, LangChain, 学长,以及 亚马逊基岩 -每种产品在集成、可扩展性和治理方面都具有独特的优势。

每个平台都能满足特定的需求:

从定义的工作流程开始,确定哪个平台符合您的目标、团队专业知识和合规需求。

AI 编排平台对比:功能、定价和功能

Prompts.ai 是一个强大的平台,旨在通过整合对超过 35 种领先语言模型的访问来简化企业 AI 运营,包括 GPT-5, 克劳德, 美洲驼,以及 双子座,在安全、统一的接口中。通过消除兼顾多个 AI 供应商和订阅的复杂性,它简化了工作流程并提高了运营透明度。

Prompts.ai 提供对各种高级 LLM 的无缝访问,提供自动负载平衡和故障转移等功能。这种设置消除了管理多个账户或 API 的麻烦。如果一家提供商遇到停机时间或性能问题,任务会自动重新路由到替代模型,从而确保不间断的工作流程和稳定的可靠性。

该平台建立在云原生分布式框架之上,使其能够轻松扩展以满足不断增长的需求。通过利用异步处理和动态负载平衡,Prompts.ai 即使在高使用率时期也能确保稳定的性能。任务均匀地分布在多个提供商之间,无论工作量激增如何,都能保持效率和响应能力。

Prompts.ai 整合了强大的治理工具,以维护企业标准并确保合规性。主要功能包括:

这些工具共同增强了企业 AI 计划之间的安全性、可追溯性和运营一致性。

该平台使用灵活的即用即付模式 代币积分,取消经常性费用。定价计划的结构旨在满足各种需求:

Prompts.ai 声称组织最多可以削减人工智能软件开支 98% 与管理多个独立订阅相比,它成为各种规模企业的经济高效的解决方案。

Zapier 将超过 8,000 个应用程序与 300 多个 AI 工具连接起来,其中包括 ChatGPT 还有克劳德,通过一个无代码编排平台。迄今为止,它已经自动化了超过3亿个人工智能任务,为超过100万家公司提供服务。它的多功能性使其成为各行各业的宝贵工具。

Zapier的集成功能使企业能够将人工智能模型与其现有软件框架无缝连接起来。通过访问 8,000 多个应用程序,用户可以使用以下功能创建自动化工作流程 Zaps 对于多步任务, Zapier 特工 用于自主操作, Zapier 帆布 用于可视化流程, Zapier 桌子 用于管理数据,以及 Zapier 接口 用于激活 AI 工作流程的自定义表单。

例如,在 2025 年 8 月, Popl 使用Zapier自动化了100多个工作流程进行潜在客户资格鉴定和路由。这消除了昂贵的手动集成,每年为公司节省20,000美元,同时简化了销售渠道。同样,在 2024 年, Remote.com由三人组成的IT团队使用Zapier自动化了超过1100万个任务,其中28%的IT票证是自动解决的。Remote IT 和 AI 自动化主管 Marcus Saito 分享了:

“Zapier 让我们的三人团队感觉像一支由十人组成的团队”。

Zapier 建立在云原生架构之上,通过自动高可用性和智能节流等功能确保可扩展性。该平台提供 99.99% 的正常运行时间保证,并支持 VPC 对等互连,以实现与内部数据源的安全企业连接。企业计划有年度任务限额而不是月度上限,这使企业更容易管理季节性需求激增。目前,Zapier为87%的福布斯云100强公司提供服务,并受到全球340万家企业的信任。

Zapier 提供为企业用户量身定制的强大治理工具。其中包括基于角色的权限、基于 SAML 的单点登录 (SSO) 和 SCIM 配置。该平台符合 SOC 2 II 类、SOC 3、GDPR 和 CCPA 标准,通过传输数据的 TLS 1.2 加密和静态数据的 AES-256 加密确保数据安全。企业客户可以限制对特定 AI 工具的访问权限,并自动将其数据排除在训练第三方 AI 模型之外。实时审计日志、执行日志和性能分析等其他功能增强了运营透明度。

LangChain 是一个开源框架,旨在与之无缝协作 任何模型提供商,使开发人员能够在不改变核心应用程序逻辑的情况下在模型、工具和数据库之间切换。与专有平台不同,其开源性质提供了无与伦比的灵活性。结束了 每月下载量达9000万次 而且不止于 10万颗GitHub,它已成为构建 AI 工作流程的首选。LangChain 提供两个主要框架: LangChain,专为使用预建架构创建代理而量身定制,以及 LangGrap,非常适合自定义、有状态和长时间运行的工作流程。这种开源灵活性使得 LangChain 成为各种人工智能模型和工作流程的出色平台。

LangChain 的框架中立设计集成了 超过 1,000 个模型、工具和数据库。它支持各种认知架构,包括React、计划与执行、多代理、批评修订和自我提问。开发人员可以同时使用这两者 Python 和打字稿,使其可供广泛的用户使用。首席软件工程师 Garrett Spong 强调了其影响:

“LangChain在LangGraph上提出的建议要好得多。LangGraph 为我们如何构建和扩展 AI 工作负载奠定了基础——从对话代理、复杂的任务自动化到由 LLM 支持的 “行之有效” 的自定义体验。”

LangGraph 平台专为可扩展性而构建,利用 专用的任务队列 在不减慢速度的情况下处理企业级流量和突然的工作负载高峰。它提供了 持久执行,确保工作流程在中断后可以恢复。其 API 专为自动扩展而设计,包括自定义检查点、内存管理和对话线程等功能,非常适合基于代理的工作负载。高级解决方案架构师安德烈斯·托雷斯分享了他的经验:

“LangGraph 为我们的人工智能开发发挥了重要作用。其使用 LLM 构建有状态的多参与者应用程序的强大框架改变了我们评估和优化面向访客的 AI 解决方案性能的方式”。

朗·史密斯 遵守严格的合规标准,包括 HIPAA、SOC 2 类型 2 和 GDPR。它提供精细的身份验证和访问控制,使团队能够有效地管理权限和保护数据,以满足企业需求。Human-in-the-Loop 功能提供手动监督,允许在执行 AI 操作之前进行安全检查、替代和批准步骤。企业部署包括静态加密和可自定义标头,以提高安全性。

Prefect 是一个基于 Python 的编排平台,旨在使用其混合架构将 AI 工作流程转变为可靠的系统。它每月的下载量超过 650 万次,GitHub 明星超过 21,200 个,它通过使用 Python 装饰器来简化工作流程创建,例如 @flow 和 @task,无需复杂的配置文件。这种方法可确保与现有 Python 工作流程的无缝集成,并简化用户的开发。

Prefect 设备齐全,可以管理 LLM 循环和 AI 代理,同时整合了人为环控制。该平台支持在运行时动态创建任务,允许工作流程根据实时数据进行调整和分支。其持久的执行功能可确保昂贵的人工智能工作负载可以从故障点恢复,从而无需重新运行整个管道。此外,Prefect 还提供了 MCP 服务器,为 Claude 和 Cursor 等人工智能助手提供背景信息。

Prefect 以其强大的集成功能脱颖而出,这与其用户友好的设计相一致。它为工具和平台提供原生支持,例如 债务, 搬运工人, Kubernetes、AWS ECS、谷歌云运行、Azure ACI 和 Modal。其工作池架构将工作流程与基础架构分开,允许团队在不更改代码的情况下切换执行环境。该架构还会自动跟踪数据沿袭情况,从而提高管道的可见性。dbt Labs数据主管亚历克斯·韦尔奇强调了这种灵活性:

“我们使用 Prefect 与其他数据工具一起编排 dbt Cloud 任务。它为我们的整个管道带来了可见性。”

Prefect 的混合执行模型将控制平面与工作流程执行分开,从而实现可扩展的计算能力,同时保护安全基础设施中的敏感数据。该平台每分钟管理超过100,000个任务,并采用每用户定价模式,而不是根据工作流程运行收费。在 2024 年, 浮潜人工智能 在 Kubernetes 上采用了 Prefect OSS,显著提高了性能。Smit Shah,工程总监 浮潜人工智能,分享了:

“使用 Prefect,我们将吞吐量提高了 20 倍。它是我们异步处理的主力军。由于大多数任务受网络限制,我们每小时运行大约一千个流量,性能稳定。”

Snorkel AI 现在每小时可执行 1,000 多个流程,每天处理数万个工作流程。同样, 端点 将72条管道从Airflow迁移到Prefect Cloud后,发票成本降低了73.78%,生产能力提高了三倍。

Prefect Cloud 将安全性和合规性放在首位,持有 SOC 2 II 类认证,并对账户、工作空间和对象提供基于角色的精细访问控制。该平台保留每项操作的详细审计日志,为合规性审查和安全调查提供帮助。Prefect 的混合架构确保敏感的 AI 数据保留在用户的 VPC 中,仅将运行历史记录和调度状态等元数据发送到控制平面。企业功能包括与任何身份提供商的 SSO 兼容、SCIM 配置、IP 许可清单和原生数据沿袭跟踪,以完全透明地了解工作流程输出。

Prefect Core 在 Apache 2.0 许可证下以开源软件的形式提供,使用户能够在完全的 VPC 控制下自行托管。Prefect Cloud 提供了一个具有免费爱好等级的托管平台,最多可容纳 2 个用户和 5 个工作流程。专业版和企业版计划提供可预测的每位用户定价,允许无限次执行工作流程。

Amazon Bedrock 是一个完全托管的无服务器平台,可访问来自 Anthropic、Meta 的基础模型 Mistral AI,以及亚马逊的Nova系列。它受到全球超过100,000个组织的信任,无需进行基础设施管理,从而实现了从初始原型到全面生产的AI工作流程的无缝扩展。让我们深入了解其主要功能,包括模型支持、集成、可扩展性、治理和定价。

Amazon Bedrock 通过以下方式简化了对多个基础模型的访问 单个 API,使用户只需最少的代码调整即可轻松地在模型版本之间切换。开发人员可以利用 Amazon Bedrock AgentCore 来使用开源框架,例如 CrewAI,LangGraph, llaMaindex和 Strands 代理人。AgentCore 运行时支持持续长达 8 小时的异步任务,通过网关提供持久性和安全工具访问。此外,基岩护栏可阻挡高达 88% 的有害内容,并以惊人的 99% 准确率检测模型幻觉,从而增强安全性。

亚马逊基岩使用其AgentCore网关轻松地与AWS服务和第三方工具集成。此功能将 API、Lambda 函数和服务转换为与 MCP 兼容的工具。它还可以连接流行的企业应用程序,例如 销售部队, 缩放, 吉拉,以及 Slack。对于身份管理,Bedrock 支持与的原生集成 Okta,微软 Azure Entra ID, Auth0,以及 亚马逊 Cognito。Emre Caglar,产品工程主管 汤森路透,强调了该平台的影响:

“AgentCore通过抽出基础设施的复杂性——代理运行时间、可观测性、生命周期管理——来减少工程师的认知负担,这样他们就可以专注于解决重要的业务问题。”

亚马逊基岩已经证明了其有效扩展人工智能运营的能力。在 2024 年到 2025 年之间, 罗宾汉 在短短六个月内将其人工智能业务从每天处理5亿个代币扩大到50亿个。这一过渡由人工智能开发主管塔加雷领导,使人工智能成本降低了80%,并将开发时间缩短了50%。该平台的蒸馏模型运行速度最多可提高 500%,同时将成本降低多达 75%。此外,智能提示路由可以将开支降低多达30%。 艾普西隆例如,使用AgentCore自动化了营销工作流程,将活动设置时间缩短了30%,每周为团队节省了8个小时。

亚马逊 Bedrock 遵守严格的合规标准,包括 ISO、SOC、GDPR、FedRAMP High 和 HIPAA 资格。它提供了强大的基于角色的访问控制,并集成了 亚马逊云观察 和 打开遥测 用于实时监控令牌使用情况、延迟和错误率。其无服务器架构确保了整个工作流程的完全可观察性,从而增强了透明度和控制力。

亚马逊 Bedrock 雇用了 基于消费的定价模型,这意味着没有预付费用。用户可以选择预置吞吐量,以折扣费率确保专用容量。快速缓存和模型蒸馏等节省成本的功能进一步有助于降低运营开支。

Zapier 脱颖而出 8,000 个应用程序集成,使其成为广泛连接的首选。LangChain 以其高度模块化的架构大放异彩,为开发人员提供了广泛的灵活性,但它需要高级技术技能和手动治理。另一方面,Prefect在数据编排方面表现出色,但在边缘部署方面却困难重重——传统的集中式协调器可能面临2-5秒的冷启动时间,而边缘原生解决方案可以实现不到50毫秒的启动时间。

比较这些平台时,很明显,它们的优势可以满足不同的需求。的崛起 代理人工智能,自主代理计划和执行任务,正在重塑用户对编排平台的期望。旨在构建自定义工作流程的开发人员通常倾向于 LangChain 的灵活性,而注重合规性和成本效益的企业则倾向于 Prompts.ai 等提供内置管理和透明使用情况跟踪的平台。

归根结底,正确的选择取决于三个关键因素: 技术专长, 集成广度,以及 治理需求。例如,Zapier提供简单性和广泛的集成功能,使其成为技术专业知识最少的商业用户的理想之选。LangChain凭借其以开发人员为中心的工具,则处于另一端。Prefect 凭借其强大的协调能力迎合以数据为中心的团队的需求,但可能需要更多的动手管理。

为了找到最合适的方案,组织应首先试行一个明确定义的单一工作流程。这种方法有助于评估每个平台如何与其技术技能、集成要求和治理优先事项保持一致。

选择合适的人工智能编排平台取决于三个关键考虑因素:团队的技术专业知识、预算和所需的治理水平。对于编程技能有限的团队来说,具有拖放界面的平台可以让非技术用户在不依赖工程资源的情况下设计工作流程。另一方面,精打细算、具有强大开发能力的团队可能会倾向于使用像LangChain或Prefect这样的开源选项。这些框架免除了许可费,但需要自托管管理和持续维护。

治理是另一个关键因素,尤其是在金融或医疗保健等行业,在这些行业中,合规性是不可谈判的。提供审计跟踪和基于角色的访问控制等功能的平台对于维持问责制和确保安全运营,增强前面讨论的协调优势至关重要。

成本仍然是许多组织面临的重大挑战。根据 Gartner,超过90%的首席信息官认为成本是采用人工智能的主要障碍。灵活的定价模式,例如即用即付或基于任务的计费,允许团队扩展使用量,而无需支付大量的预付订阅费。对于那些管理多个大型语言模型的人来说,战略性地分配任务(例如,使用Claude进行文档分析,使用ChatGPT进行逻辑推理)可以帮助优化支出。试用期可以明确哪个平台最适合您的独特运营需求。

最终,目标是将平台的优势与组织的优先事项相匹配。测试清晰的工作流程可以确认平台的集成能力、可扩展性和治理功能是否与您的目标一致。无论你是在简化销售流程、处理海量数据集还是部署先进的人工智能解决方案,合适的平台都应该简化你的运营,而不是使它们复杂化。

在选择 AI 编排平台时,务必要优先考虑可简化集成、支持增长和提高 AI 工作流程整体效率的功能。

选择一个能提供服务的平台 易于集成 使用各种工具、模型和数据源,减少了对大量自定义编码的需求。坚固 治理与合规 基于角色的权限和审计就绪跟踪等功能对于维持问责制和遵守监管要求至关重要。确保该平台专为以下目的而构建 可扩展性和可靠性,因此即使在高峰时段,它也可以高效地管理高需求的工作负载。

平台配备 实时监控 用户友好的仪表板可以帮助您快速查明和解决任何性能问题。寻求透明的、基于使用量的定价,以控制成本。最后,该平台应与您的团队的专业知识相匹配,通过无代码和代码优先选项提供灵活性,以简化开发和部署。通过专注于这些功能,您可以找到一种能够提高生产力并符合组织人工智能目标的解决方案。

AI 编排平台通常依赖两个主要的定价结构: 基于使用情况的模型 和 分层订阅。这些方法可以满足从小型项目到大型企业运营的各种需求。

对于基于使用量的定价,成本由 API 调用、计算时长或代币消耗等指标决定。此模型适用于波动或季节性工作负载,因为您只需为实际使用量付费。另一方面,分层订阅提供固定的月度或年费率,其中包括捆绑功能、使用限制,有时还包括高级支持或高级监控工具等福利。

许多平台混合了这些模型以提供灵活性。例如,他们可能会提供免费试用或入门级计划,以帮助用户以最少的承诺探索该平台。随着企业的发展,他们可以无缝过渡到具有更高容量和附加功能的计划。这种灵活性确保您可以找到适合您的预算和运营需求的定价结构。

金融、医疗保健和能源等受到严格监管的行业的人工智能协调需要高度关注治理,以保持合规性并确保安全。最有效的平台将治理直接纳入其工作流程,从而实现 可追溯性、可审计性和策略执行 在每个阶段——从数据管理到模型执行。

关键治理工具包括 政策执行 阻止未经授权的活动, 基于角色的访问控制 (RBAC) 限制权限,以及 不可变的审计日志 这记录了监管报告的每一项行动。额外的保护层,例如 数据加密, 模型版本控制,以及 实时监控,保护敏感信息并帮助识别违规行为。通过整合这些控制措施,组织可以自信地满足监管标准,同时充分利用人工智能的能力。