L'intelligence artificielle est en train de transformer les industries, mais la gestion de ses risques nécessite une gouvernance robuste. Les entreprises qui déploient l'IA sont confrontées à des défis tels que la conformité, la surveillance des biais et la supervision opérationnelle. Cet article évalue cinq principales plateformes de gouvernance de l'IA : Credo AI, IBM Watson X. Gouvernance, Apprentissage automatique Microsoft Azure, Robot de données, et Prompts.ai - pour vous aider à trouver la solution la mieux adaptée à vos besoins. Voici ce que chacun propose :

Chaque plateforme aborde les questions de conformité, de détection des biais, d'intégration et d'évolutivité, mais ses objectifs et ses points forts diffèrent. Que vous gériez un écosystème unique ou que vous jongliez avec plusieurs modèles d'IA, le bon choix dépend de vos besoins opérationnels, de vos exigences réglementaires et de vos priorités budgétaires.

Credo AI est une plateforme conçue pour simplifier la gouvernance, la conformité et la surveillance des systèmes d'IA. En traduisant des exigences réglementaires complexes en flux de travail exploitables, il aide les organisations à déployer l'IA de manière responsable et efficace. Les principales fonctionnalités incluent l'alignement de la conformité, la surveillance des biais, la flexibilité d'intégration et l'évolutivité.

Il peut être difficile de relever les défis réglementaires, mais Credo AI vous permet de les gérer grâce à son moteur de conformité. Cet outil met en correspondance les systèmes d'IA avec les principaux cadres réglementaires tels que Loi sur l'IA de l'UE, Cadre de gestion des risques liés à l'IA du NIST, et des normes spécifiques à l'industrie dans des secteurs tels que la santé et la finance. Au lieu de s'appuyer sur l'interprétation manuelle des réglementations, les équipes peuvent utiliser des modèles d'évaluation prédéfinis adaptés à ces cadres. Cela garantit que les organisations documentent leurs pratiques en matière d'IA dans un format attendu par les auditeurs et les régulateurs, ce qui permet de gagner du temps et d'économiser des efforts lors des examens de conformité.

Pour les entreprises opérant dans plusieurs juridictions, Credo AI propose une bibliothèque réglementaire automatisée qui reste à jour. Il signale les modèles concernés par les nouvelles règles et guide les équipes tout au long du processus de documentation nécessaire. Cela est particulièrement crucial pour les secteurs où la non-conformité peut entraîner de lourdes sanctions financières.

Credo AI va au-delà des vérifications de biais superficielles en évaluant les modèles par rapport à des indicateurs d'équité tels que l'égalité des chances, la parité prédictive et l'impact disparate. Les utilisateurs peuvent définir des seuils de biais spécifiques et la plateforme émet des alertes lorsque les modèles dépassent ces limites.

Ce qui distingue Credo AI, c'est son approche de surveillance continue. Au fur et à mesure que les modèles interagissent avec les nouvelles données en cours de production, la plateforme suit les performances en fonction des groupes démographiques et des cas d'utilisation. Cela permet d'identifier les biais susceptibles d'apparaître au fil du temps en raison de facteurs tels que la dérive des données ou l'évolution des populations d'utilisateurs. Des rapports détaillés indiquent exactement où se produisent les problèmes d'équité, ce qui permet de retracer plus facilement les problèmes jusqu'à leur source, qu'il s'agisse des données d'entraînement, de la sélection des fonctionnalités ou de la conception du modèle.

Credo AI s'intègre parfaitement aux systèmes existants Chaînes d'outils MLOps, éliminant ainsi la nécessité pour les organisations de remanier leur infrastructure. Il se connecte aux registres de modèles, aux pipelines de données et aux plateformes de déploiement les plus populaires à l'aide d'API et de connecteurs prédéfinis. Cela permet aux data scientists de continuer à travailler avec leurs outils préférés pendant que les processus de gouvernance s'exécutent en arrière-plan.

La plateforme intègre des informations clés telles que les métadonnées des modèles, le lignage des données de formation et les mesures de performance directement dans ses flux de travail. En évitant la duplication de la documentation et les transferts manuels de données, Credo AI minimise les frictions et garantit que les pratiques de gouvernance sont respectées sans être considérées comme une charge bureaucratique.

À mesure que les portefeuilles d'IA se développent, Credo AI contribue à maintenir l'ordre en organisant les modèles en couches de gouvernance structurées en fonction de facteurs tels que l'unité commerciale, le niveau de risque ou les exigences réglementaires. Cela permet d'éviter que la supervision ne devienne ingérable.

Grâce aux contrôles d'accès basés sur les rôles, les responsables de la conformité peuvent se concentrer sur les audits et les cartographies réglementaires, tandis que les data scientists se concentrent sur les performances techniques. Cette division des responsabilités garantit que la gouvernance peut évoluer efficacement au sein de grandes équipes distribuées sans provoquer de blocages ni de retards.

IBM Watsonx.Governance applique les politiques de gouvernance de l'IA de manière fluide sur les systèmes IBM et tiers dans des configurations multicloud. Il prend en charge les modèles propres à IBM et ceux hébergés sur AWS ou des plateformes Microsoft, garantissant une intégration fluide. Le système automatise les flux de travail de conformité et assure la transparence tout au long du cycle de vie de l'IA. Grâce à des fonctionnalités d'IA génératives, il simplifie les évaluations des risques et les résumés d'audit, offrant ainsi une base solide pour la gestion de la conformité, de l'intégration et de l'évolutivité.

IBM Watsonx.Governance fournit un accès direct aux cadres de conformité mondiaux tels que Loi sur l'IA de l'UE, Cadre de gestion des risques liés à l'IA du NIST (AI RMF), et NORME ISO 42001. Sa bibliothèque réglementaire intégrée élimine le besoin d'interprétation manuelle de documents réglementaires complexes. Tirant parti de l'apprentissage automatique, la plateforme fournit des recommandations intelligentes, aligne les tendances émergentes sur les exigences réglementaires spécifiques et suggère des mesures concrètes. Cette approche accélère les efforts de conformité tout en réduisant les charges de travail manuelles.

Comprenant le besoin de flexibilité dans les environnements multifournisseurs, Watsonx.Governance garantit une application cohérente des politiques sur toutes les plateformes, notamment IBM, AWS et Microsoft Azure. Il applique automatiquement les politiques de gouvernance, permettant aux data scientists de continuer à utiliser leurs outils préférés sans interruption. En séparant la gouvernance du développement, la plateforme garantit que les processus de conformité n'entravent pas l'innovation ou la créativité.

Pour répondre aux demandes croissantes des organisations déployant de nombreux modèles d'IA, IBM Watsonx.Governance étend ses capacités de surveillance et de sécurité pour inclure des agents d'IA générative. Cela garantit une supervision complète des modèles autonomes et traditionnels. Grâce à des flux de travail automatisés et à des recommandations intelligentes, la plateforme aide les équipes à gérer des opérations complexes tout en fournissant la transparence et la documentation requises par les régulateurs.

Microsoft Azure Machine Learning fournit une base solide pour gérer l'ensemble du cycle de vie de l'IA, en combinant une infrastructure puissante avec des outils de gouvernance intégrés. Son tableau de bord d'IA responsable agit comme un hub central où les équipes peuvent évaluer le comportement des modèles, repérer les problèmes potentiels et documenter les efforts de conformité. Cette configuration permet aux organisations de garder le contrôle de leurs systèmes d'IA tout en adaptant les opérations à des équipes et à des environnements diversifiés. Vous trouverez ci-dessous un aperçu de la manière dont Azure prend en charge la conformité, la surveillance des biais, la gestion des coûts, l'intégration et l'évolutivité au sein de son cadre de gouvernance.

Azure Machine Learning simplifie la conformité réglementaire en proposant des modèles qui s'alignent sur des frameworks tels que GDPR, HIPAA, et les réglementations émergentes axées sur l'IA. La plateforme crée automatiquement des pistes d'audit détaillées, capturant des éléments clés tels que les itérations des modèles, les données de formation et les décisions de déploiement, aidant ainsi les équipes à répondre facilement aux exigences de documentation.

UNE registre des modèles suit le lignage des données, montre comment elles circulent dans les pipelines et note les transformations appliquées en cours de route. Cette transparence permet aux organisations de répondre rapidement aux demandes réglementaires, offrant ainsi une vision claire du processus de développement. En outre, les rapports de conformité peuvent être exportés dans des formats normalisés, ce qui réduit considérablement le temps nécessaire à la préparation des audits.

Le tableau de bord de l'IA responsable comprend des outils permettant d'évaluer l'équité entre les différents groupes démographiques. Ces outils mesurent les disparités dans les résultats et identifient les scénarios dans lesquels les prévisions pourraient désavantager injustement certaines populations. La plateforme prend en charge une variété de mesures d'équité, permettant des évaluations approfondies adaptées à des besoins spécifiques.

D'Azure Analyse des erreurs L'outil approfondit les performances des modèles, en les répartissant par sous-groupe afin de découvrir des modèles que des indicateurs plus larges pourraient ignorer. Ce niveau de détail aide les équipes à identifier les domaines dans lesquels les modèles peuvent être moins performants et les groupes concernés. Les graphiques interactifs facilitent le partage de ces résultats avec les parties prenantes non techniques, garantissant ainsi la transparence à tous les niveaux.

Pour maintenir l'équité, les organisations peuvent définir seuils qui déclenchent des alertes lorsque les modèles dépassent les niveaux de biais acceptables. Ces contrôles automatisés surveillent en permanence le comportement des modèles, en s'adaptant à l'évolution de la distribution des données au fil du temps. Des notifications sont envoyées lorsqu'une intervention est nécessaire, empêchant ainsi les prévisions biaisées d'atteindre les environnements de production.

Azure Machine Learning propose un suivi complet des coûts, offrant aux équipes une vision claire des dépenses liées aux expériences, aux modèles et aux espaces de travail. Ce tableau de bord unifié met en évidence les tendances en matière d'utilisation du calcul, de stockage et d'appels d'API, aidant ainsi les organisations à allouer leurs budgets de manière judicieuse. Les alertes budgétaires informent les administrateurs lorsque les dépenses approchent des limites prédéfinies, évitant ainsi les dépassements imprévus.

La plateforme prend également en charge la mise à l'échelle automatique des ressources, en ajustant la capacité en fonction des demandes de charge de travail. Pour des raisons de rentabilité, les tâches de formation peuvent utiliser des instances ponctuelles, qui sont nettement moins chères que les options de calcul dédiées. Si la capacité du spot devient indisponible, le système passe automatiquement aux instances standard, garantissant ainsi la fiabilité. Ces mesures de réduction des coûts s'intègrent parfaitement aux flux de travail, en équilibrant l'efficacité avec les besoins opérationnels.

Azure Machine Learning intègre la gouvernance dans les flux de travail quotidiens, en prenant en charge des frameworks populaires tels que TensorFlow, PyTorch, scikit-learn et XGBoost. Il fournit également des kits SDK pour les interfaces Python, R et CLI. La plateforme fonctionne parfaitement avec Azure DevOps, Actions sur GitHub, et API REST, permettant des pipelines CI/CD automatisés qui incluent des examens de gouvernance avant le déploiement des modèles.

Cette flexibilité s'étend aux architectures hybrides, permettant à certains composants de s'exécuter sur Azure tandis que d'autres fonctionnent sur site ou dans d'autres environnements cloud. Quel que soit l'endroit où les modèles sont déployés, des politiques de gouvernance cohérentes sont maintenues, garantissant des opérations fluides et sécurisées.

Azure Machine Learning est conçu pour gérer tout, des petites expériences aux déploiements à grande échelle impliquant des milliers de modèles. Cette évolutivité garantit que même les portefeuilles d'IA les plus étendus restent soumis à une gouvernance stricte, répondant à des préoccupations telles que le contrôle des versions des modèles et la gestion des risques.

La plateforme capacités de formation distribuées répartissez les tâches volumineuses sur plusieurs nœuds, accélérant ainsi le processus de formation pour les modèles complexes. Les ressources sont allouées de manière dynamique en fonction des exigences du poste, ce qui garantit l'efficacité.

Pour le déploiement, terminaux gérés évolutivité automatique pour gérer les pics de trafic et les inférences par lots volumineux, éliminant ainsi la nécessité d'une gestion manuelle de l'infrastructure. Pipelines d'inférence par lots peut traiter des millions de prévisions tout en conservant des pistes d'audit, en ajustant dynamiquement les ressources de calcul pour équilibrer vitesse et coûts à mesure que les charges de travail évoluent.

DataRobot fournit une plate-forme robuste pour gérer la gouvernance de l'IA au niveau de l'entreprise. Il simplifie la conformité, surveille les performances des modèles et documente l'ensemble du cycle de vie de l'IA. En relevant les principaux défis de gouvernance, elle garantit la transparence du fonctionnement des modèles en production tout en respectant les normes réglementaires et éthiques. Conçue à la fois pour les experts techniques et les professionnels, la plateforme minimise les défis souvent liés au maintien de pratiques d'IA responsables. Vous trouverez ci-dessous un aperçu de la manière dont DataRobot gère la conformité, les biais, l'intégration et l'évolutivité dans la gouvernance de l'IA.

DataRobot conserve des pistes d'audit détaillées qui documentent chaque étape du processus de développement du modèle. Des sources de données de formation aux paramètres de déploiement, chaque décision est enregistrée automatiquement, ce qui rend les examens réglementaires plus rapides et plus efficaces.

La plateforme propose modèles de conformité prédéfinis adapté à des secteurs et à des réglementations spécifiques. Par exemple, les équipes des services financiers peuvent utiliser des modèles conformes à ANNÉES 11 À 7 directives de la Réserve fédérale, tandis que les organisations de santé bénéficient de cadres conçus pour HIPAA conformité. Ces modèles simplifient le processus de traduction des exigences réglementaires en tâches techniques réalisables.

Avec ses cartes modèles, DataRobot fournit une ressource centralisée aux équipes juridiques, techniques et de conformité. Ces cartes consolident toutes les informations relatives à la gouvernance, permettant aux parties prenantes de générer des rapports complets pour les auditeurs sans extraire manuellement les données de plusieurs systèmes.

La plateforme assure également la conformité grâce à des règles automatisées. Les organisations peuvent définir des critères tels que des niveaux de précision minimaux, un biais maximal autorisé ou la documentation requise. Les modèles qui ne répondent pas à ces normes sont signalés automatiquement, ce qui empêche les modèles non conformes d'entrer en production et garantit une gouvernance cohérente entre les projets.

DataRobot inclut des outils d'évaluation de l'équité qui évaluent les modèles pour détecter les biais potentiels entre les attributs protégés. Lors de la validation du modèle, la plateforme calcule automatiquement des indicateurs d'équité, tels que l'impact disparate, en comparant les résultats entre les groupes démographiques pour identifier les problèmes potentiels. Les équipes peuvent personnaliser ces indicateurs en fonction de leurs cas d'utilisation spécifiques et de leurs besoins de conformité.

Les fonctionnalités de la plateforme visualisations interactives qui permettent d'analyser facilement les performances des modèles dans différents sous-groupes. Les graphiques montrant les distributions de prédiction, les taux d'erreur et les limites de décision aident les équipes à identifier des modèles susceptibles d'indiquer un biais. Ces outils sont accessibles aux parties prenantes non techniques, ce qui permet des discussions constructives sur l'équité entre les différents départements.

Une surveillance continue garantit que tout changement dans les indicateurs d'équité est détecté au fur et à mesure de l'évolution de la distribution des données. Les alertes peuvent être configurées pour informer les équipes par e-mail, Slack ou des outils de gestion des incidents, garantissant ainsi des réponses rapides aux problèmes émergents.

Pour corriger les biais détectés, DataRobot propose stratégies d'atténuation intégrées. Les équipes peuvent tester des techniques telles que la repondération des données d'entraînement, l'ajustement des seuils de décision ou l'application de corrections après traitement directement depuis la plateforme. En comparant les compromis entre équité et précision, les équipes peuvent choisir la solution la plus efficace pour leurs besoins spécifiques. Ces fonctionnalités soulignent l'engagement de DataRobot à rendre la gouvernance de l'IA à la fois rigoureuse et conviviale.

DataRobot est conçu pour s'intégrer parfaitement à un large éventail d'outils et de systèmes. Il fonctionne nativement avec Flocon de neige, Databricks, Amazon Redshift, Google BigQuery, et d'autres bases de données SQL, permettant aux équipes d'utiliser les données directement là où elles se trouvent. Les options de déploiement incluent API REST pour les prévisions en temps réel, la notation par lots pour les grands ensembles de données et les serveurs de prédiction intégrés. La plateforme s'intègre également à des outils de développement tels que Jenkins, GitLab CI/CD, et Azure DevOps, en intégrant les contrôles de gouvernance directement dans le flux de développement.

Pour les data scientists, DataRobot propose des SDK pour Python, R et Java, leur permettant d'interagir avec la plateforme à l'aide de leurs langages de programmation préférés. Ces SDK conservent des fonctionnalités de gouvernance complètes, garantissant une supervision cohérente des modèles développés par le biais du code ou de l'interface visuelle de la plateforme.

DataRobot est conçu pour gérer des portefeuilles allant de quelques modèles à des milliers, sans compromettre la gouvernance. Son architecture répartit efficacement les charges de travail et s'adapte automatiquement pour répondre à des demandes accrues. Cela permet aux organisations de surveiller des centaines de modèles de production simultanément, chaque modèle faisant l'objet d'une supervision continue.

La plateforme registre des modèles agit comme un hub central, organisant les modèles par projet, unité commerciale ou cas d'utilisation. Cette structure est inestimable à mesure que les portefeuilles se développent, car elle permet aux équipes de localiser rapidement des modèles spécifiques et de comprendre leurs liens avec d'autres composants. Le contrôle de version est intégré, ce qui permet de revenir facilement aux itérations précédentes si nécessaire.

Les prévisions par lots sont optimisées pour l'évolutivité, la répartition des charges de travail et la mise en cache des données afin de conserver les pistes d'audit tout en garantissant une exécution efficace des tâches. Les organisations qui exécutent des tâches de notation quotidiennes à grande échelle, par exemple sur les bases de données clients, bénéficient de manière significative de ces fonctionnalités.

DataRobot prend également en charge multilocation, permettant à différentes équipes ou unités commerciales de fonctionner dans des espaces de travail isolés avec leurs propres politiques de gouvernance. Cela garantit que les modèles développés à des fins distinctes ou dans des environnements réglementaires différents restent séparés. Les administrateurs conservent une visibilité à l'échelle de l'organisation tandis que les équipes individuelles gardent le contrôle de leurs projets spécifiques.

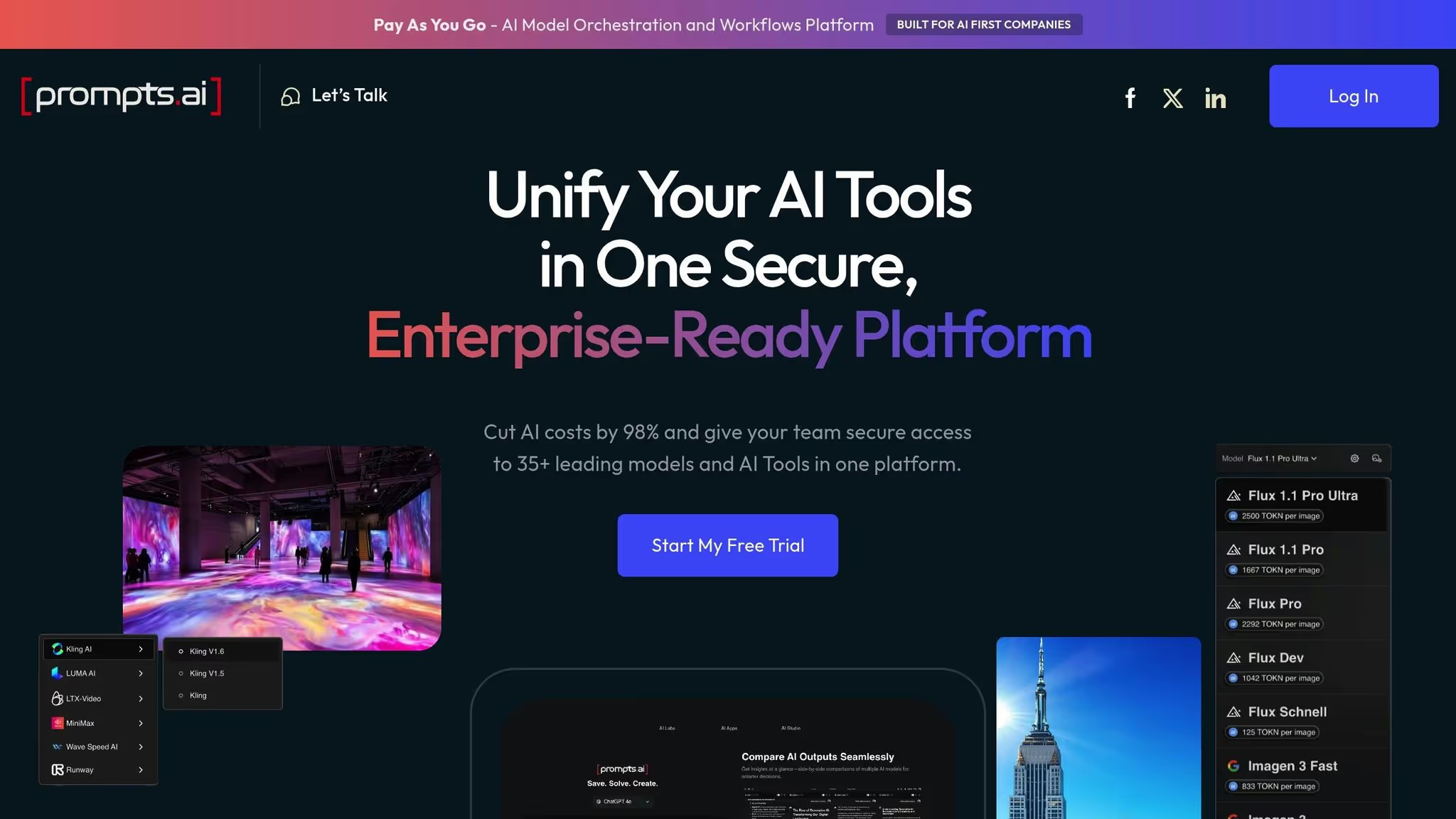

Prompts.ai propose une nouvelle approche de la gestion des modèles d'IA, en se concentrant sur la couche d'orchestration où les organisations interagissent avec plus de 35 grands modèles de langage de premier plan. Au lieu de gérer les complexités du cycle de vie d'un seul modèle, la plateforme s'attaque aux défis de gouvernance qui surviennent lorsque plusieurs modèles d'IA sont déployés dans différents cas d'utilisation. En fournissant un accès unifié à des modèles tels que GPT-5, Claude, LLama et Gemini, Prompts.ai comble les lacunes en matière de gouvernance, suit les interactions, gère les coûts et garantit la cohérence de la conformité. Cette approche élimine le besoin d'abonnements, de contrôles d'accès et de pistes d'audit distincts pour chaque fournisseur de modèles, offrant ainsi aux organisations un point de supervision unique et rationalisé. Ce système unifié ouvre la voie à des discussions sur des domaines critiques tels que la conformité, les biais, la gestion des coûts, l'intégration et l'évolutivité.

Prompts.ai intègre la conformité à son cœur de métier, en suivant les meilleures pratiques décrites dans SOC 2 type II, HIPAA, et GDPR cadres. La plateforme a lancé son SOC 2 Type 2 processus d'audit sur 19 juin 2025, démontrant une sécurité au niveau de l'entreprise. Par le biais du Trust Center à l'adresse https://trust.prompts.ai/, les entreprises peuvent suivre leur état de conformité en temps réel, en accédant à des informations sur les politiques de sécurité, les contrôles et les progrès réalisés.

Des pistes d'audit détaillées capturent chaque interaction de l'IA, documentant les modèles utilisés, les invites soumises et les résultats générés. Ce niveau de transparence est particulièrement précieux pour des secteurs tels que les services financiers et les soins de santé, où la preuve d'une utilisation responsable de l'IA est souvent une exigence réglementaire.

Les deux Plans personnels et professionnels incluent des fonctionnalités de surveillance de la conformité, garantissant l'accessibilité pour les organisations de toutes tailles. Le système fonctionne parfaitement avec Vanta pour une surveillance continue des contrôles, en maintenant les mesures de sécurité efficaces au fur et à mesure de l'évolution de la plateforme. Cette supervision automatisée réduit le besoin d'interventions manuelles, aidant ainsi les entreprises à maintenir leur niveau de conformité sans effort.

Pour les applications d'IA destinées aux clients, Prompts.ai minimise les risques réglementaires en surveillant les instructions relatives aux informations sensibles telles que les informations personnelles identifiables (PII), les informations d'identification et les données propriétaires. Ce filtrage préalable à la soumission agit comme une garantie, empêchant l'exposition des données qui pourrait entraîner des violations du RGPD ou de la HIPAA.

Prompts.ai suit activement les données d'entrée et de sortie afin de détecter et de corriger les biais dans les réponses de l'IA. En analysant la manière dont les différentes instructions génèrent des résultats variés selon les données démographiques, la plateforme aide les équipes à identifier les incohérences ou les tendances discriminatoires dans le comportement de l'IA. Cette fonctionnalité est particulièrement importante pour des applications telles que le service client ou le recrutement, où des résultats biaisés peuvent entraîner des risques juridiques ou de réputation.

Les équipes peuvent examiner les données historiques pour déterminer si une formulation spécifique entraîne des réponses problématiques. Par exemple, si une requête d'assistance client génère des réponses moins utiles en raison de sa formulation, les équipes peuvent ajuster les modèles pour garantir une qualité de service constante. Cette approche proactive permet aux organisations de lutter contre les préjugés avant qu'ils ne dégénèrent en problèmes plus importants.

Les tableaux de bord en temps réel fournissent une visibilité sur les indicateurs de biais, ce qui permet aux responsables de la conformité et aux équipes de science des données d'intervenir rapidement. Les alertes informent les membres de l'équipe désignés lorsque les réponses révèlent un traitement incohérent sur la base de caractéristiques protégées, garantissant ainsi une action rapide pour atténuer les biais dans les environnements de production.

La gestion des dépenses est un défi majeur dans les déploiements d'IA multimodèles, et Prompts.ai excelle dans le contrôle des coûts entre les fournisseurs ayant des structures de prix différentes. Le couche FinOps suit l'utilisation des jetons sur plus de 35 modèles, en attribuant les coûts à des équipes et à des projets spécifiques pour une budgétisation précise.

La plateforme Système de crédit TOKN Pay-As-You-Go remplace les frais mensuels traditionnels, réduisant les coûts jusqu'à 98 %. Ce modèle basé sur l'utilisation garantit que les entreprises ne paient que pour ce qu'elles utilisent, ce qui rend les déploiements d'IA plus efficaces.

Prompts.ai identifie les problèmes d'efficacité, tels que les instructions trop longues qui font gonfler les coûts inutilement. Il signale ces modèles et suggère des optimisations, par exemple en utilisant des instructions plus courtes ou en passant à des modèles moins coûteux pour certaines tâches. Ces petits ajustements peuvent permettre de réaliser d'importantes économies, en particulier pour les organisations dont les interactions quotidiennes avec l'IA sont nombreuses.

Les alertes budgétaires aident à prévenir les dépenses imprévues en informant les administrateurs lorsque les dépenses approchent des seuils définis. Les équipes peuvent fixer des limites à différents niveaux (organisation, département ou projet) pour s'assurer que les initiatives expérimentales n'épuisent pas les ressources destinées à des applications critiques.

Prompts.ai s'intègre parfaitement aux principaux fournisseurs de cloud tels que LES PATTES, Plateforme Google Cloud, et Microsoft Azure, permettant aux organisations de maintenir leur infrastructure existante tout en ajoutant une gouvernance centralisée de l'IA. Son architecture axée sur les API permet des intégrations personnalisées avec des systèmes propriétaires, garantissant ainsi l'alignement des flux de gouvernance sur les processus informatiques établis.

Pour les développeurs, SDK Python fournissent un accès programmatique aux fonctionnalités de gouvernance, permettant les contrôles de conformité, le suivi des coûts et la surveillance des biais directement dans leur code. Cela garantit que la supervision de la gouvernance n'empêche pas les équipes techniques de travailler sur des applications d'IA personnalisées.

La plateforme se connecte également aux entreprises Systèmes SIEM (gestion des informations et des événements de sécurité), centralisant la surveillance de la sécurité. Les équipes de sécurité peuvent corréler les événements de gouvernance de l'IA avec des données de sécurité plus larges, identifiant ainsi rapidement les menaces potentielles. Par exemple, les modèles de messages suspects peuvent être signalés en même temps que d'autres indicateurs de sécurité, ce qui permet de répondre plus rapidement.

Prompts.ai prend en charge plusieurs fournisseurs LLM, notamment IA ouverte et Anthropique, avec un cadre de gouvernance unique. Il n'est donc plus nécessaire de créer des politiques distinctes pour chaque fournisseur, ce qui simplifie la gestion de la conformité et réduit les charges administratives.

Prompts.ai est conçu pour évoluer parallèlement à la croissance des initiatives d'IA, offrant une visibilité et une auditabilité complètes de chaque interaction. Son architecture prend en charge des volumes croissants d'utilisateurs et de demandes sans compromettre les performances, ce qui la rend adaptée aux moyennes et grandes entreprises.

Contrôles d'accès basés sur les rôles assurez-vous que les membres de l'équipe interagissent avec les fonctionnalités de gouvernance pertinentes à leurs rôles. Les data scientists peuvent accéder aux métriques et aux données sur les coûts de leurs projets, les responsables de la conformité peuvent surveiller le respect des règles à l'échelle de l'organisation, et les utilisateurs professionnels peuvent se concentrer sur les résultats sans avoir à parcourir les détails techniques. Les administrateurs assurent la supervision de l'ensemble du système, garantissant ainsi le bon fonctionnement.

Le registre de modèles centralisé organise les politiques de gouvernance par département, cas d'utilisation ou exigence réglementaire. Les équipes opérant selon différents cadres de conformité peuvent travailler dans des environnements isolés avec leurs propres règles, tandis que les administrateurs conservent la possibilité de surveiller toutes les activités. Cette configuration permet d'éviter les conflits entre les politiques des différentes unités commerciales.

À mesure que les nouvelles équipes adoptent des modèles d'IA, les administrateurs peuvent rapidement fournir des accès et appliquer des politiques de gouvernance, ce qui permet une intégration rapide. Ce processus rationalisé aide les organisations qui souhaitent étendre l'utilisation de l'IA tout en maintenant un contrôle centralisé de la conformité, de la sécurité et des coûts. En évoluant horizontalement, Prompts.ai garantit que la gouvernance reste efficace, quelle que soit l'ampleur de l'adoption de l'IA par l'organisation.

Les plateformes de gouvernance de l'IA présentent chacune leurs avantages et leurs limites, répondant ainsi à différents besoins organisationnels. Le tableau ci-dessous résume une analyse approfondie de cinq critères d'évaluation critiques.

Cette comparaison met en évidence l'importance de trouver un équilibre entre les forces et les limites en fonction des besoins organisationnels spécifiques. Des plateformes comme IBM Watsonx.Governance et Microsoft Azure Machine Learning permettent une intégration fluide au sein de leurs écosystèmes, tandis que Credo AI et DataRobot se concentrent sur des fonctionnalités de gouvernance spécialisées.

Prompts.ai propose une solution distincte en unifiant les opérations dans plus de 35 modèles linguistiques, réduisant ainsi la fragmentation souvent observée avec de multiples services. Son modèle de tarification basé sur l'utilisation et son intégration rationalisée le rendent particulièrement utile pour les organisations qui gèrent divers flux de travail d'IA.

Lors de l'évaluation de ces plateformes, tenez compte de votre configuration opérationnelle. Les équipes déjà profondément intégrées à un seul fournisseur de cloud peuvent tirer le meilleur parti des outils natifs, tandis que celles qui gèrent plusieurs modèles d'IA pourraient constater que la plateforme unifiée de Prompts.ai réduit la complexité administrative et améliore la flexibilité. En tenant compte de ces facteurs, les organisations peuvent mettre en œuvre des stratégies de gouvernance qui correspondent à leurs objectifs et à leurs exigences opérationnelles.

Il est essentiel de sélectionner le bon service de gouvernance des modèles d'IA pour répondre aux besoins uniques de votre organisation. Des options telles qu'IBM Watsonx.Governance et Microsoft Azure Machine Learning permettent une intégration fluide dans leurs écosystèmes, tandis que des plateformes telles que Credo AI et DataRobot répondent à des exigences spécifiques en matière de conformité et de documentation.

Les considérations budgétaires jouent un rôle important dans cette décision. Les modèles de tarification fixe sont idéaux pour des charges de travail prévisibles, tandis que les plans basés sur l'utilisation conviennent mieux aux organisations dont les demandes fluctuent ou dont les activités concernent plusieurs départements. Ces facteurs financiers soulignent l'importance des solutions unifiées, en particulier lorsqu'il s'agit de gérer de nombreux modèles au sein de différentes équipes.

Pour les organisations qui gèrent divers flux de travail d'IA, jongler avec plusieurs cadres de gouvernance peut entraîner une complexité et des contraintes administratives inutiles. Prompts.ai simplifie cela en fournissant un accès à plus de 35 modèles linguistiques de premier plan au sein d'un système de gouvernance unique. Sa structure de crédit TOKN sur paiement à l'utilisation garantit que les coûts correspondent directement à l'utilisation tout en préservant la sécurité et la conformité au niveau de l'entreprise.

Les secteurs soumis à des réglementations strictes ont besoin de solutions de gouvernance qui fournissent des pistes d'audit détaillées et garantissent une conformité rigoureuse. À l'inverse, les secteurs qui évoluent rapidement ont besoin d'outils qui permettent une itération rapide des modèles sans introduire de retards. En fonction de vos priorités, vous pouvez avoir besoin d'une surveillance approfondie des biais pour les applications destinées aux clients ou mettre davantage l'accent sur le contrôle des versions et la gestion des risques.

Alors que les besoins technologiques et industriels continuent d'évoluer, concentrez-vous sur des plateformes qui répondent aux défis actuels tout en laissant de la place à la croissance future. Que vous choisissiez des outils d'écosystème natifs, des plateformes de gouvernance spécialisées ou des solutions d'orchestration unifiées, votre décision doit répondre aux exigences de conformité et à l'efficacité opérationnelle. Un cadre de gouvernance solide permet non seulement d'atténuer les risques, mais également de déployer l'IA en toute confiance et d'ouvrir la voie à des progrès durables.

Prompts.ai suit normes de haut niveau tels que le SOC 2 Type II, l'HIPAA et le RGPD pour assurer une protection renforcée des données et répondre aux exigences réglementaires. Ces cadres sont en place pour protéger les informations sensibles tout en favorisant la transparence des opérations d'IA.

Pour renforcer la confiance et la responsabilité, Prompts.ai collabore avec Vanta pour surveillance continue des contrôles et a officiellement entamé son processus d'audit SOC 2 de type II le 19 juin 2025. Cette stratégie avant-gardiste permet à Prompts.ai de rester en phase avec l'évolution des besoins en matière de conformité tout en proposant des solutions d'IA responsables.

Prompts.ai permet aux entreprises de réduire considérablement leurs dépenses en fusionnant plus de 35 outils d'IA en une seule plateforme efficace, réduisant ainsi les coûts de 95 %. Grâce à sa couche FinOps intégrée, vous obtenez des informations en temps réel sur l'utilisation, les dépenses et le retour sur investissement, garantissant ainsi le suivi et l'optimisation de chaque interaction. Ce niveau de transparence facilite la gestion des budgets tout en tirant le meilleur parti de vos flux de travail d'IA.

Prompts.ai joue un rôle actif dans l'identification et la réduction des biais dans les modèles d'IA afin de promouvoir l'équité et la prise de décisions éthiques. À l'aide d'algorithmes avancés et de méthodes d'évaluation continue, la plateforme examine attentivement les ensembles de données, les prévisions des modèles et les flux de prise de décision afin d'identifier les biais potentiels.

Pour relever ces défis, Prompts.ai utilise des méthodes telles que l'équilibrage des ensembles de données, le déploiement d'outils de détection des biais et la transparence grâce à des rapports détaillés. Ces mesures contribuent à garantir que les modèles d'IA respectent les directives éthiques tout en produisant des résultats précis et équitables dans un large éventail d'utilisations.