Les plateformes de flux de travail basées sur l'IA simplifient et automatisent les processus complexes, permettant aux équipes de se concentrer sur la création de solutions plutôt que sur la gestion de l'infrastructure. Avec des fonctionnalités telles que intégration d'un grand modèle de langage (LLM), des outils permettant de réduire les coûts et des conceptions évolutives, ces plateformes deviennent essentielles pour les entreprises. Voici ce que vous devez savoir :

Plats à emporter rapides:

Choisissez Prompts.ai pour une intégration parfaite du LLM et une transparence des coûts, TFX pour les pipelines spécifiques à Tensorflow, ou Débit d'air pour une orchestration flexible basée sur Python. Chaque plateforme répond à des besoins distincts, alors alignez votre choix en fonction de l'expertise et des objectifs de votre équipe en matière de flux de travail.

Prompts.ai sert de plateforme complète d'orchestration de l'IA, regroupant plus de 35 grands modèles de langage de premier plan, notamment GPT-5, Claude, Lama, et Gémeaux, sous une seule interface sécurisée et unifiée. En consolidant l'accès à ces modèles, il rationalise l'intégration et élimine les tracas liés à la gestion de plusieurs abonnements. Ce système centralisé fournit un cadre solide pour une intégration parfaite du LLM.

Prompts.ai transforme les flux de travail LLM fragiles en systèmes fiables et prêts pour la production en intégrant des contrôles humains directement dans le processus. Ces contrôles permettent aux équipes de suspendre les opérations d'IA à des points de décision critiques pour une révision manuelle, garantissant ainsi que les tâches sensibles sont traitées avec soin. Le système de contrôle unifié de la plateforme supervise les agents de données, de machine learning et d'IA, permettant ainsi aux flux de travail de passer facilement d'un Docker, Kuberneteset environnements sans serveur : aucune modification de code n'est requise.

Prompts.ai utilise un modèle flexible de paiement à l'utilisation utilisant Crédits TOKN, qui lie directement les dépenses à l'utilisation. Sa couche FinOps intégrée permet de suivre en temps réel la consommation de jetons sur tous les modèles, offrant ainsi aux équipes une visibilité complète des dépenses. Cette configuration peut aider les organisations à réduire les coûts des logiciels d'IA jusqu'à 98 %, tandis que les comparaisons de performances côte à côte permettent aux équipes de sélectionner le modèle le plus rentable pour chaque tâche spécifique.

Conçu pour soutenir la croissance, Prompts.ai s'adapte aussi bien aux utilisateurs individuels qu'aux opérations d'entreprise à grande échelle. Les équipes peuvent ajouter rapidement des modèles, des utilisateurs et des flux de travail en quelques minutes seulement. Le Certification d'ingénieur rapide Le programme établit les meilleures pratiques et permet aux experts internes de promouvoir l'adoption évolutive de l'IA. Les flux de travail rapides préconçus proposent des modèles réutilisables, ce qui accélère le déploiement pour les tâches courantes. Pour les entreprises, des fonctionnalités telles que les pistes d'audit détaillées garantissent la sécurité et la conformité à mesure que les organisations étendent leurs capacités d'IA, une considération essentielle dans le paysage commercial en évolution rapide d'aujourd'hui.

TensorFlow Extended (TFX) est un framework open source robuste conçu pour créer des pipelines d'apprentissage automatique complets. Conçu pour les environnements de production, il fonctionne sous la licence Apache 2.0 et prend en charge un large éventail de tâches, de l'ingestion de données au déploiement de modèles sur des systèmes distribués. De nombreuses grandes entreprises font confiance à TFX pour rationaliser et gérer efficacement leurs flux de travail de production en machine learning.

L'une des forces de TFX réside dans sa capacité à standardiser à la fois le déploiement et le prétraitement. Il permet de répondre à diverses cibles de déploiement, notamment Service TensorFlow pour les opérations côté serveur, TensorFlow Lite pour les appareils mobiles et IoT, et TensorFlow.js pour les applications basées sur le Web. Pour assurer la cohérence entre la formation et le service, le TF.Transform la bibliothèque exporte les étapes de prétraitement sous forme de graphes TensorFlow, éliminant ainsi les incohérences dans les transformations de données.

Le cadre comprend également le InfraValidateur composant, qui vérifie la compatibilité du modèle avec les infrastructures cibles, telles que des images Docker spécifiques ou des configurations Kubernetes, avant le déploiement. Cela garantit que les modèles sont prêts à être servis sans problème. Par exemple, en mars 2023, Vodafone en partenariat avec Google Cloud pour intégrer la validation des données TensorFlow (TFDV) dans leurs contrats de données. Cette décision a amélioré leurs capacités de gouvernance des données dans un lac de données mondial de télécommunications, en s'alignant sur leurs stratégies d'IA et de ML. Ces fonctionnalités mettent en évidence les capacités d'intégration fluide de TFX, en particulier avec les grands modèles de langage (LLM).

TFX est bien équipé pour gérer le déploiement de modèles d'IA génératifs, notamment Diffusion stable, en tirant parti de TensorFlow Serving et de GKE pour un déploiement efficace. Ses capacités de traitement de données multimodales le rendent idéal pour des tâches telles que le sous-titrage d'images et la modélisation du langage visuel, soutenues par des composants dédiés. En octobre 2023, Spotify a utilisé TFX aux côtés d'agents TF pour créer des modèles d'apprentissage par renforcement pour les recommandations musicales, transformant ainsi avec succès les modèles de recherche en pipelines de production. Ces cas d'utilisation démontrent la capacité d'adaptation de TFX à répondre aux exigences des applications d'IA modernes.

TFX est conçu pour évoluer sans effort, qu'il s'agisse de configurations à processus unique ou de grands systèmes distribués. Il s'intègre à des outils tels que Flux d'air Apache et Canalisations Kubeflow pour coordonner les tâches entre plusieurs collaborateurs. Sa conception modulaire inclut des bibliothèques spécialisées telles que TensorFlow Transform et TensorFlow Data Validation, toutes deux optimisées pour un apprentissage automatique performant à grande échelle.

La plateforme offre également des fonctionnalités de mise en cache pour réduire les frais de calcul. En utilisant le enable_cache=True paramètre, TFX évite de réexécuter des composants coûteux lorsque les entrées restent inchangées. En outre, il permet aux utilisateurs de réexécuter uniquement les tâches ayant échoué au lieu de réexécuter l'ensemble du pipeline, ce qui permet d'économiser du temps et des ressources. Cette efficacité fait de TFX un choix pratique pour les entreprises qui cherchent à optimiser leurs flux de travail de machine learning.

Apache Airflow est une plateforme open source pour orchestrer les flux de travail, publiée sous licence Apache. La sortie d'Airflow 3.0 le 22 avril 2025 a marqué une étape importante, car elle est devenue une solution incontournable pour gérer les flux de travail d'IA sur les systèmes distribués. Sa caractéristique la plus remarquable est sa conception native de Python, qui permet aux développeurs de définir les flux de travail sous forme de code sans être liés à un langage propriétaire.

Airflow excelle dans la connexion de divers outils d'IA grâce à son architecture flexible et extensible. Il fournit des packages de fournisseurs spécialisés pour les principaux services d'IA, tels que IA ouverte, Cohère, Pomme de pin, Tisser, Qdrant, et Databricks. Cette adaptabilité permet aux utilisateurs de créer des flux de travail qui intègrent de manière fluide plusieurs composants. Par exemple, vous pouvez concevoir un pipeline qui extrait les données d'un compartiment S3, les traite à l'aide d'un cluster Spark, les envoie à un grand modèle de langage via une API et stocke les intégrations dans une base de données vectorielle, le tout au sein d'un flux de travail unique et coordonné.

« Le framework Python extensible d'Airflow vous permet de créer des flux de travail connectés à pratiquement toutes les technologies. »

- Documentation sur Apache Airflow

La plateforme rationalise l'échange de données entre les tâches à l'aide de XCOMs pour le partage des métadonnées et de l'API TaskFlow pour la transmission automatique des données. Cette conception garantit une intégration fluide avec les bibliothèques d'apprentissage automatique les plus populaires telles que PyTorch et TensorFlow. De plus, sa capacité à réexécuter uniquement les tâches ayant échoué réduit le temps et les coûts de calcul associés à des processus complexes de formation ou d'inférence en matière d'IA. Ces fonctionnalités font d'Airflow un choix fiable pour gérer des flux de travail d'IA complexes.

L'architecture d'Airflow est conçue pour gérer des charges de travail de toutes tailles, en s'adaptant sans effort aux diverses demandes. À l'aide de files d'attente de messages, il coordonne les travailleurs sur les systèmes distribués, ce qui permet une évolutivité pratiquement illimitée. La plate-forme prend en charge plusieurs exécuteurs, notamment le CeleryExecutor pour gérer les tâches de longue durée et le KubernetesExecutor pour exécuter des tâches dans des pods isolés. Pour les flux de travail d'IA nécessitant différentes ressources de calcul, tels que les GPU pour l'entraînement et les processeurs pour le prétraitement, KubernetesExecutor peut lancer dynamiquement des pods spécifiques à des tâches qui sont automatiquement réduits une fois les tâches terminées.

Le déploiement sur Kubernetes est simplifié grâce au Helm Chart officiel d'Airflow, qui favorise une allocation efficace des ressources et permet aux grandes équipes de gérer efficacement les flux de travail. Pour éviter l'engorgement des ressources, les administrateurs peuvent utiliser des fonctionnalités telles que les pools pour contrôler la simultanéité des tâches, garantissant ainsi un fonctionnement fluide même lorsque les flux de travail impliquent des API externes ou des magasins de données partagés. De plus, en avril 2025, la communauté Apache Airflow a introduit un nouveau SDK de tâches, qui dissocie la création de DAG des principaux composants internes de la plate-forme. Cette mise à jour améliore la stabilité et garantit une meilleure compatibilité pour les développeurs.

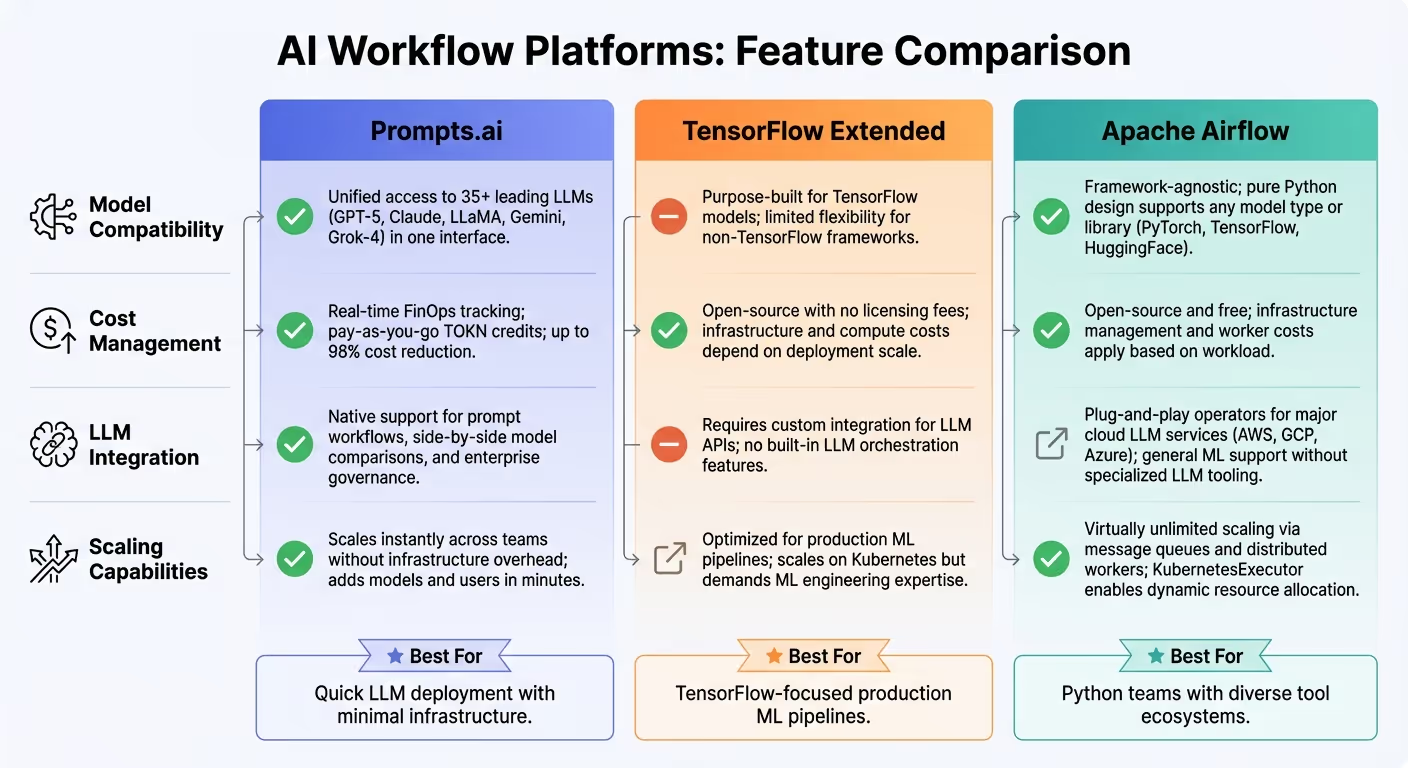

Comparaison des plateformes de flux de travail IA : Prompts.ai, TensorFlow Extended et Apache Airflow

Lors de l'évaluation des plateformes de flux de travail basées sur l'IA, il est clair que chaque option comporte ses propres atouts et compromis. Le tableau ci-dessous met en évidence les principales caractéristiques de trois plateformes, suivi d'un examen plus approfondi de leurs principaux aspects.

Prompts.ai se distingue en consolidant l'accès à plusieurs LLM de premier plan, en permettant de réaliser des économies grâce à ses crédits TOKN payables à l'utilisation et en éliminant les frais d'abonnement. En revanche, TensorFlow Extended (TFX) et Apache Airflow reportent les coûts vers la gestion de l'infrastructure et des opérations. La nature open source d'Airflow attire les équipes disposant de ressources DevOps établies, mais le temps d'ingénierie nécessaire à la maintenance des systèmes distribués peut être important.

Pour les flux de travail spécifiques à LLM, Prompts.ai fournit des fonctionnalités telles que la gestion rapide des versions et le suivi des coûts en temps réel, ce qui en fait un choix judicieux pour les équipes qui se concentrent sur des modèles linguistiques de grande taille. Apache Airflow, bien que ne proposant pas d'orchestration LLM native, propose des intégrations cloud robustes, et TensorFlow Extended reste dédié aux pipelines ML traditionnels.

Les capacités de mise à l'échelle diffèrent également. Prompts.ai propose un service géré qui évolue sans effort, permettant aux équipes d'ajouter des modèles ou des utilisateurs en quelques minutes. Apache Airflow prend en charge la mise à l'échelle dynamique via des exécuteurs configurables et des files de messages, mais nécessite une configuration supplémentaire. TensorFlow Extended, optimisé pour les pipelines de production ML, s'appuie sur une expertise approfondie des systèmes distribués pour une mise à l'échelle efficace.

En fin de compte, votre choix dépendra de l'expertise technique de votre équipe et des besoins spécifiques en matière de flux de travail. Prompts.ai est idéal pour les équipes qui recherchent un déploiement rapide de LLM avec une complexité d'infrastructure minimale. Apache Airflow s'adresse à ceux qui possèdent de solides compétences en ingénierie Python et des écosystèmes d'outils diversifiés, tandis que TensorFlow Extended convient parfaitement aux équipes déjà ancrées dans l'écosystème TensorFlow et concentrées sur les pipelines ML de niveau production. Ces comparaisons fournissent une base pour prendre des décisions éclairées lorsque vous évaluez vos options.

Pour sélectionner la bonne plateforme de flux de travail IA, vous devez aligner les compétences de votre équipe sur vos objectifs d'automatisation. Si votre priorité est une intégration parfaite du LLM, Prompts.ai se distingue par un accès instantané à plus de 35 modèles de pointe et un suivi des coûts en temps réel via Crédits TOKN, et des fonctionnalités de gouvernance prêtes à l'emploi conçues pour évoluer sans effort entre les équipes.

D'autres plateformes peuvent toutefois exiger un engagement technique plus important. TensorFlow étendu est un excellent choix pour les équipes profondément ancrées dans l'écosystème TensorFlow, mais il nécessite une connaissance approfondie des systèmes distribués et manque de flexibilité pour les frameworks autres que TensorFlow. D'autre part, Flux d'air Apache se distingue dans le domaine des flux de travail orientés par lots grâce à sa philosophie des « flux de travail en tant que code », même si cela s'accompagne d'une charge supplémentaire liée à la gestion des coûts d'infrastructure et d'exploitation.

En fin de compte, votre décision dépend de l'affectation de vos ressources d'ingénierie. Prompts.ai réduit le besoin de support DevOps en proposant un versionnage rapide intégré et des comparaisons de modèles côte à côte, ce qui en fait une option intéressante pour les entreprises qui recherchent un déploiement rapide et une rentabilité optimale. Les équipes possédant une solide expertise en Python et des configurations Kubernetes peuvent se tourner vers Apache Airflow pour sa flexibilité, tandis que celles qui souhaitent consolider les outils apprécieront la simplicité de paiement à l'utilisation de Prompts.ai.

Pour faire le meilleur choix, commencez par un projet pilote axé sur vos principales priorités, telles que la transparence des coûts, l'évolutivité et l'orchestration du LLM. La plateforme qui simplifie l'intégration des modèles, améliore la collaboration entre les équipes et garantit la conformité sera celle qui favorisera la croissance durable de vos initiatives d'IA. Utilisez cette approche stratégique pour orienter les prochaines étapes de l'optimisation des flux de travail liés à l'IA.

Prompts.ai fournit une solution simple pour intégrer grands modèles de langage (LLM) dans vos flux de travail. Conçue dans un souci de facilité d'utilisation, la plateforme simplifie les processus d'IA, permettant un déploiement et une gestion des modèles sans tracas.

Equipé d'une solide fonctionnalités d'interopérabilité et conçu pour prendre en charge des flux de travail d'IA avancés, Prompts.ai vous permet d'exploiter toute la puissance des LLM tout en économisant du temps et des ressources. Son intégration parfaite à vos systèmes actuels en fait un choix judicieux pour les entreprises qui souhaitent étendre leurs capacités d'IA sans complications inutiles.

Prompts.ai transforme la façon dont les organisations gèrent les flux de travail liés à l'IA en simplifiant les processus et en éliminant les inefficacités. Grâce à son automatisation intelligente et à son intégration fluide avec de grands modèles de langage, il réduit les tâches manuelles, économisant ainsi un temps et des ressources précieux.

La conception intuitive de la plateforme permet aux équipes de déployer et de gérer les flux de travail sans effort, sans nécessiter de formation approfondie ni d'infrastructure coûteuse. Cela permet aux entreprises d'atteindre leurs objectifs de manière efficace tout en maîtrisant leurs coûts.

Prompts.ai est une plateforme cloud native conçue pour répondre facilement aux exigences des flux de travail d'IA au niveau de l'entreprise. Soutenant plus de 35 grands modèles linguistiques, y compris des noms connus tels que GPT-4 et Claude, il simplifie les opérations en donnant accès à tous ces modèles via une API unique. Cette configuration permet aux entreprises de passer facilement d'un modèle à l'autre ou d'en ajouter de nouveaux sans avoir besoin d'infrastructure supplémentaire, ce qui garantit une mise à l'échelle horizontale fluide pour gérer des charges de travail croissantes.

La plateforme propose suivi des coûts en temps réel, fournissant aux équipes les outils nécessaires pour suivre efficacement l'utilisation et les dépenses. Cette fonctionnalité aide les organisations à augmenter leurs ressources tout en maîtrisant leurs budgets, certains clients signalant des résultats impressionnants des économies de coûts allant jusqu'à 98 %. Pour les industries soumises à des réglementations strictes, Prompts.ai garantit sécurité de niveau professionnel grâce à des fonctionnalités telles que l'accès basé sur les rôles, les journaux d'audit et les contrôles de conformité, pour une mise à l'échelle sécurisée en toute tranquillité.

Son architecture dynamique est conçue pour ajuster automatiquement les ressources de calcul, s'adaptant ainsi sans effort aux charges de travail à haut débit. Cela permet à la plateforme de gérer des milliers de demandes d'IA simultanées sans nécessiter d'ajustements manuels, ce qui en fait un choix fiable pour les entreprises qui souhaitent rationaliser leurs opérations d'IA.