Las plataformas de flujo de trabajo de IA simplifican y automatizan los procesos complejos, lo que permite a los equipos centrarse en crear soluciones en lugar de gestionar la infraestructura. Con funciones como integración de modelos de lenguaje grande (LLM), herramientas que ahorran costos y diseños escalables, estas plataformas se están volviendo esenciales para las empresas. Esto es lo que necesita saber:

Comida rápida para llevar:

Elige Prompts.ai para una integración perfecta de LLM y transparencia de costos, TFX para tuberías específicas de TensorFlow, o Flujo de aire para una orquestación flexible basada en Python. Cada plataforma responde a necesidades distintas, así que alinea tu elección con los objetivos de flujo de trabajo y experiencia de tu equipo.

Prompts.ai sirve como una plataforma integral de orquestación de IA, que reúne más de 35 modelos lingüísticos de gran tamaño de primer nivel, que incluyen GPT-5, Claudio, Llama, y Géminis, bajo una interfaz segura y unificada. Al consolidar el acceso a estos modelos, agiliza la integración y elimina la molestia de administrar varias suscripciones. Este sistema centralizado proporciona un marco sólido para una integración perfecta de la LLM.

Prompts.ai convierte los frágiles flujos de trabajo de LLM en sistemas confiables y listos para la producción al incorporar controles interpersonales directamente en el proceso. Estos controles permiten a los equipos pausar las operaciones de IA en los puntos de decisión críticos para revisarlas manualmente, lo que garantiza que las tareas delicadas se gestionen con cuidado. El sistema de control unificado de la plataforma supervisa los agentes de datos, aprendizaje automático e inteligencia artificial, lo que permite que los flujos de trabajo se transfieran sin esfuerzo Estibador, Kubernetesy entornos sin servidor, sin necesidad de modificar el código.

Prompts.ai emplea un modelo flexible de pago por uso que utiliza Créditos TOKN, que vincula los gastos directamente con el uso. Su capa FinOps integrada proporciona un seguimiento en tiempo real del consumo de tokens en todos los modelos, lo que ofrece a los equipos una visibilidad total del gasto. Esta configuración puede ayudar a las organizaciones a reducir los costos del software de inteligencia artificial hasta en 98%, mientras que las comparaciones paralelas del desempeño garantizan que los equipos seleccionen el modelo más rentable para cada tarea específica.

Creado para soportar el crecimiento, Prompts.ai se adapta de usuarios individuales a operaciones empresariales a gran escala. Los equipos pueden añadir rápidamente modelos, usuarios y flujos de trabajo en cuestión de minutos. El Certificación inmediata de ingeniero El programa establece las mejores prácticas y capacita a los expertos internos para que promuevan la adopción escalable de la IA. Los flujos de trabajo rápidos y prediseñados ofrecen plantillas reutilizables, lo que acelera la implementación de tareas comunes. Para las empresas, funciones como los registros de auditoría detallados garantizan la seguridad y el cumplimiento a medida que las organizaciones amplían sus capacidades de inteligencia artificial, una consideración esencial en el panorama empresarial actual, en rápida evolución.

TensorFlow Extended (TFX) es un marco sólido de código abierto diseñado para crear canales integrales de aprendizaje automático. Diseñado para entornos de producción, funciona bajo la licencia Apache 2.0 y admite una amplia gama de tareas, desde la ingestión de datos hasta la implementación de modelos en sistemas distribuidos. Muchas empresas líderes dependen de TFX para optimizar y gestionar sus flujos de trabajo de aprendizaje automático de producción de forma eficaz.

Uno de los puntos fuertes de TFX reside en su capacidad para estandarizar tanto el despliegue como el preprocesamiento. Se adapta a varios objetivos de despliegue, entre los que se incluyen Servicio de TensorFlow para operaciones del lado del servidor, TensorFlow Lite para dispositivos móviles y de IoT, y TensorFlow.js para aplicaciones basadas en la web. Para garantizar la coherencia entre la formación y el servicio, el tf.Transform la biblioteca exporta los pasos de preprocesamiento como gráficos de TensorFlow, lo que elimina los desajustes en las transformaciones de datos.

El marco también incluye Validador de infrarrojos componente, que comprueba la compatibilidad del modelo con las infraestructuras de destino, como imágenes específicas de Docker o configuraciones de Kubernetes, antes de la implementación. Esto garantiza que los modelos estén listos para funcionar sin problemas. Por ejemplo, en marzo de 2023, Vodafone se asoció con Google Cloud para integrar la validación de datos de TensorFlow (TFDV) en sus contratos de datos. Esta medida mejoró sus capacidades de gobierno de datos en un lago de datos de telecomunicaciones global, alineándose con sus estrategias de inteligencia artificial y aprendizaje automático. Estas características destacan las capacidades de integración sin fisuras de TFX, especialmente con los grandes modelos lingüísticos (LLM).

TFX está bien equipado para gestionar el despliegue de modelos de IA generativos, que incluyen Difusión estable, aprovechando TensorFlow Serving y GKE para una implementación eficiente. Sus capacidades de procesamiento de datos multimodales lo hacen adecuado para tareas como la subtitulación de imágenes y el modelado con lenguaje visual, y cuenta con componentes dedicados. En octubre de 2023, Spotify utilizó TFX junto con TF-Agents para crear modelos de aprendizaje por refuerzo para las recomendaciones musicales, con lo que los modelos de investigación pasaron con éxito a los canales de producción. Estos casos de uso demuestran la adaptabilidad de TFX a la hora de satisfacer las exigencias de las aplicaciones de IA modernas.

TFX está diseñado para escalar sin esfuerzo, desde configuraciones de un solo proceso hasta grandes sistemas distribuidos. Se integra con herramientas como Flujo de aire Apache y Canalizaciones de Kubeflow para coordinar las tareas entre varios trabajadores. Su diseño modular incluye bibliotecas especializadas, como TensorFlow Transform y TensorFlow Data Validation, ambas optimizadas para un aprendizaje automático de alto rendimiento a gran escala.

La plataforma también ofrece capacidades de almacenamiento en caché para reducir la sobrecarga computacional. Mediante el uso del ENABLE_CACHE=Verdadero parámetro, TFX evita volver a ejecutar componentes costosos cuando las entradas permanecen sin cambios. Además, permite a los usuarios volver a ejecutar solo las tareas fallidas en lugar de volver a ejecutar todo el proceso, lo que ahorra tiempo y recursos. Esta eficiencia convierte a TFX en una opción práctica para las empresas que buscan optimizar sus flujos de trabajo de aprendizaje automático.

Apache Airflow es una plataforma de código abierto para organizar flujos de trabajo, publicada bajo la licencia Apache. El lanzamiento de Airflow 3.0 el 22 de abril de 2025 marcó un hito importante, ya que se ha convertido en la solución de referencia para gestionar los flujos de trabajo de IA en sistemas distribuidos. Su característica más destacada es su diseño nativo de Python, que permite a los desarrolladores definir los flujos de trabajo como código sin estar vinculados a un lenguaje propietario.

Airflow se destaca en la conexión de varias herramientas de IA a través de su arquitectura flexible y extensible. Proporciona paquetes de proveedores especializados para los principales servicios de IA, como IA abierta, CoHERE, Piña, Aviamos, Qarant, y Ladrillos de datos. Esta adaptabilidad permite a los usuarios crear flujos de trabajo que integran sin problemas varios componentes. Por ejemplo, puedes diseñar una canalización que recupere datos de un bucket de S3, los procese con un clúster de Spark, los envíe a un modelo lingüístico de gran tamaño mediante una API y almacene las incrustaciones en una base de datos vectorial, todo ello dentro de un único flujo de trabajo coordinado.

«El marco extensible de Python de Airflow permite crear flujos de trabajo que se conecten con prácticamente cualquier tecnología».

- Documentación de Apache Airflow

La plataforma agiliza el intercambio de datos entre tareas mediante XCOM para compartir metadatos y la API TaskFlow para el paso automático de datos. Este diseño garantiza una integración fluida con bibliotecas de aprendizaje automático populares, como PyTorch y TensorFlow. Además, su capacidad de volver a ejecutar solo las tareas fallidas reduce el tiempo y los costos informáticos asociados a los complejos procesos de inferencia o entrenamiento de la IA. Estas funciones convierten a Airflow en una opción fiable para gestionar los intrincados flujos de trabajo de IA.

La arquitectura de Airflow está diseñada para gestionar cargas de trabajo de todos los tamaños y escalar sin esfuerzo para satisfacer diversas demandas. Mediante colas de mensajes, coordina a los trabajadores en todos los sistemas distribuidos, lo que permite una escalabilidad prácticamente ilimitada. La plataforma admite varios ejecutores, incluidos el CeleryExecutor para gestionar tareas de larga duración y el KubernetesExecutor para ejecutar tareas en módulos aislados. En el caso de los flujos de trabajo de IA que requieren diferentes recursos informáticos, como las GPU para el entrenamiento y las CPU para el preprocesamiento, el KubernetesExecutor puede lanzar de forma dinámica pods específicos para cada tarea que se reducen automáticamente una vez finalizadas las tareas.

La implementación en Kubernetes se simplifica con el Helm Chart oficial de Airflow, que permite una asignación eficiente de los recursos y permite a los equipos grandes gestionar los flujos de trabajo de forma eficaz. Para evitar cuellos de botella en los recursos, los administradores pueden usar funciones como los grupos para controlar la simultaneidad de las tareas, lo que garantiza un funcionamiento fluido incluso cuando los flujos de trabajo incluyan API externas o almacenes de datos compartidos. Además, en abril de 2025, la comunidad de Apache Airflow presentó un nuevo SDK de tareas, que desvincula la creación de los DAG de los componentes internos principales de la plataforma. Esta actualización mejora la estabilidad y garantiza una mejor compatibilidad para los desarrolladores.

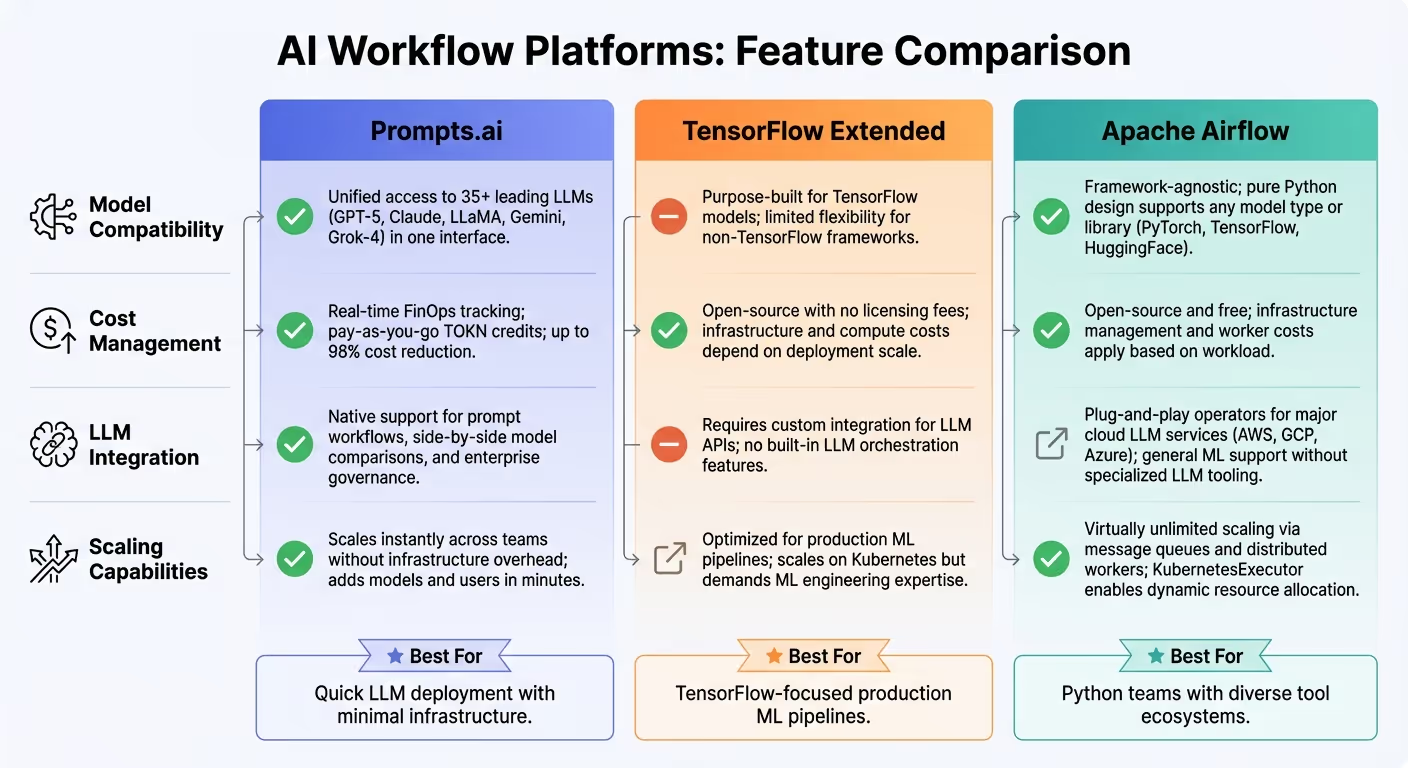

Comparación de plataformas de flujo de trabajo de IA: Prompts.ai frente a TensorFlow Extended frente a Apache Airflow

Al evaluar las plataformas de flujo de trabajo de IA, queda claro que cada opción aporta su propio conjunto de puntos fuertes y compromisos. La siguiente tabla destaca las características principales de las tres plataformas, seguida de un análisis más detallado de sus aspectos clave.

Prompts.ai se destaca por consolidar el acceso a varios LLM líderes, ofrecer ahorros de costos a través de sus créditos TOKN de pago por uso y eliminar las tarifas de suscripción. Por el contrario, TensorFlow Extended (TFX) y Apache Airflow transfieren los costos a la administración operativa y de infraestructura. La naturaleza de código abierto de Airflow atrae a los equipos con recursos de DevOps establecidos, pero el tiempo de ingeniería necesario para mantener los sistemas distribuidos puede ser considerable.

Para los flujos de trabajo específicos de LLM, Prompts.ai proporciona funciones como el control rápido de versiones y el seguimiento de costos en tiempo real, lo que lo convierte en una opción sólida para los equipos que se centran en modelos lingüísticos de gran tamaño. Apache Airflow, si bien no ofrece una organización nativa de LLM, ofrece integraciones sólidas en la nube, y TensorFlow Extended sigue dedicándose a las canalizaciones de aprendizaje automático tradicionales.

Las capacidades de escalado también son diferentes. Prompts.ai ofrece un servicio gestionado que se amplía sin esfuerzo, lo que permite a los equipos añadir modelos o usuarios en cuestión de minutos. Apache Airflow admite el escalado dinámico mediante ejecutores configurables y colas de mensajes, pero requiere una configuración adicional. TensorFlow Extended, optimizado para las canalizaciones de aprendizaje automático de producción, se basa en una amplia experiencia en sistemas distribuidos para lograr un escalado eficaz.

En última instancia, su elección dependerá de la experiencia técnica de su equipo y de las necesidades específicas de flujo de trabajo. Prompts.ai es ideal para los equipos que buscan una implementación rápida de la LLM con una complejidad de infraestructura mínima. Apache Airflow es ideal para aquellos que tienen sólidas habilidades de ingeniería en Python y diversos ecosistemas de herramientas, mientras que TensorFlow Extended es la opción ideal para los equipos que ya están arraigados en el ecosistema de TensorFlow y que se centran en los procesos de aprendizaje automático de nivel de producción. Estas comparaciones proporcionan una base para tomar decisiones informadas a la hora de sopesar las opciones.

La selección de la plataforma de flujo de trabajo de IA adecuada requiere alinear las habilidades de su equipo con sus objetivos de automatización. Si su prioridad es una integración perfecta de la LLM, Prompts.ai destaca por su acceso instantáneo a más de 35 modelos líderes y un seguimiento de costos en tiempo real a través de Créditos TOKN, y funciones de gobierno listas para la empresa diseñadas para escalar sin esfuerzo entre equipos.

Sin embargo, otras plataformas pueden exigir un compromiso de ingeniería más importante. TensorFlow extendido es una excelente opción para los equipos profundamente integrados en el ecosistema de TensorFlow, pero requiere conocimientos avanzados de los sistemas distribuidos y carece de flexibilidad para los marcos que no son de TensorFlow. Por otro lado, Flujo de aire Apache brilla en los flujos de trabajo orientados a lotes con su filosofía de «flujos de trabajo como código», aunque conlleva la carga adicional de administrar los costos operativos y de infraestructura.

En última instancia, su decisión depende de dónde quiera asignar sus recursos de ingeniería. Prompts.ai reduce la necesidad de soporte de DevOps al ofrecer versiones rápidas integradas y comparaciones de modelos en paralelo, lo que la convierte en una opción sólida para las empresas que se centran en la implementación rápida y la rentabilidad. Los equipos con una sólida experiencia en Python y configuraciones de Kubernetes podrían decantarse por Apache Airflow por su flexibilidad, mientras que aquellos que busquen consolidar las herramientas apreciarán la sencillez de Prompts.ai con la opción de pagar por uso.

Para tomar la mejor decisión, comience con un proyecto piloto que se centre en sus principales prioridades, como la transparencia de los costos, la escalabilidad y la organización del LLM. La plataforma que simplifica la integración de modelos, mejora la colaboración en equipo y garantiza el cumplimiento será la que impulsará el crecimiento sostenible de sus iniciativas de inteligencia artificial. Utilice este enfoque estratégico para guiar sus próximos pasos en la optimización de los flujos de trabajo de la IA.

Prompts.ai proporciona una solución sencilla para incorporar modelos lingüísticos extensos (LLM) en sus flujos de trabajo. Diseñada pensando en la facilidad de uso, la plataforma elimina la complejidad de los procesos de IA, lo que permite implementar y gestionar los modelos sin problemas.

Equipado con fuertes funciones de interoperabilidad y diseñado para soportar flujos de trabajo de IA avanzados, Prompts.ai le permite aprovechar toda la potencia de los LLM y, al mismo tiempo, ahorrar tiempo y recursos. Su perfecta integración con sus sistemas actuales lo convierte en una opción inteligente para las empresas que desean ampliar sus capacidades de inteligencia artificial sin complicaciones innecesarias.

Prompts.ai transforma la forma en que las organizaciones gestionan los flujos de trabajo de la IA al simplificar los procesos y eliminar las ineficiencias. Gracias a su automatización inteligente y a su integración fluida con modelos lingüísticos de gran tamaño, reduce las tareas manuales y ahorra tiempo y recursos valiosos.

El diseño intuitivo de la plataforma permite a los equipos implementar y gestionar los flujos de trabajo sin esfuerzo, sin necesidad de una amplia formación ni de una infraestructura costosa. Esto garantiza que las empresas puedan cumplir sus objetivos de manera eficiente y, al mismo tiempo, mantener los costos bajo control.

Prompts.ai es una plataforma nativa de la nube creada para gestionar con facilidad las demandas de los flujos de trabajo de IA de nivel empresarial. Apoyando más de 35 modelos lingüísticos de gran tamaño, incluidos nombres conocidos como GPT-4 y Claude, simplifica las operaciones al proporcionar acceso a todos estos modelos a través de una única API. Esta configuración permite a las organizaciones cambiar fácilmente de un modelo a otro o añadir otros nuevos sin necesidad de infraestructura adicional, lo que garantiza una escalabilidad horizontal fluida para gestionar el aumento de las cargas de trabajo.

La plataforma ofrece seguimiento de costos en tiempo real, lo que brinda a los equipos las herramientas para monitorear el uso y los gastos de manera efectiva. Esta función ayuda a las organizaciones a ampliar sus recursos y, al mismo tiempo, a mantener los presupuestos bajo control. Algunos clientes afirman que es impresionante ahorro de costes de hasta un 98%. Para las industrias con regulaciones estrictas, Prompts.ai garantiza seguridad de nivel empresarial mediante funciones como el acceso basado en roles, los registros de auditoría y los controles de cumplimiento, lo que brinda la tranquilidad de poder escalar de forma segura.

Su arquitectura dinámica está diseñada para ajustar los recursos informáticos de forma automática y adaptarse sin esfuerzo a cargas de trabajo de alto rendimiento. Esto permite que la plataforma gestione miles de solicitudes de IA simultáneas sin necesidad de ajustes manuales, lo que la convierte en una opción fiable para las empresas que desean optimizar sus operaciones de IA.