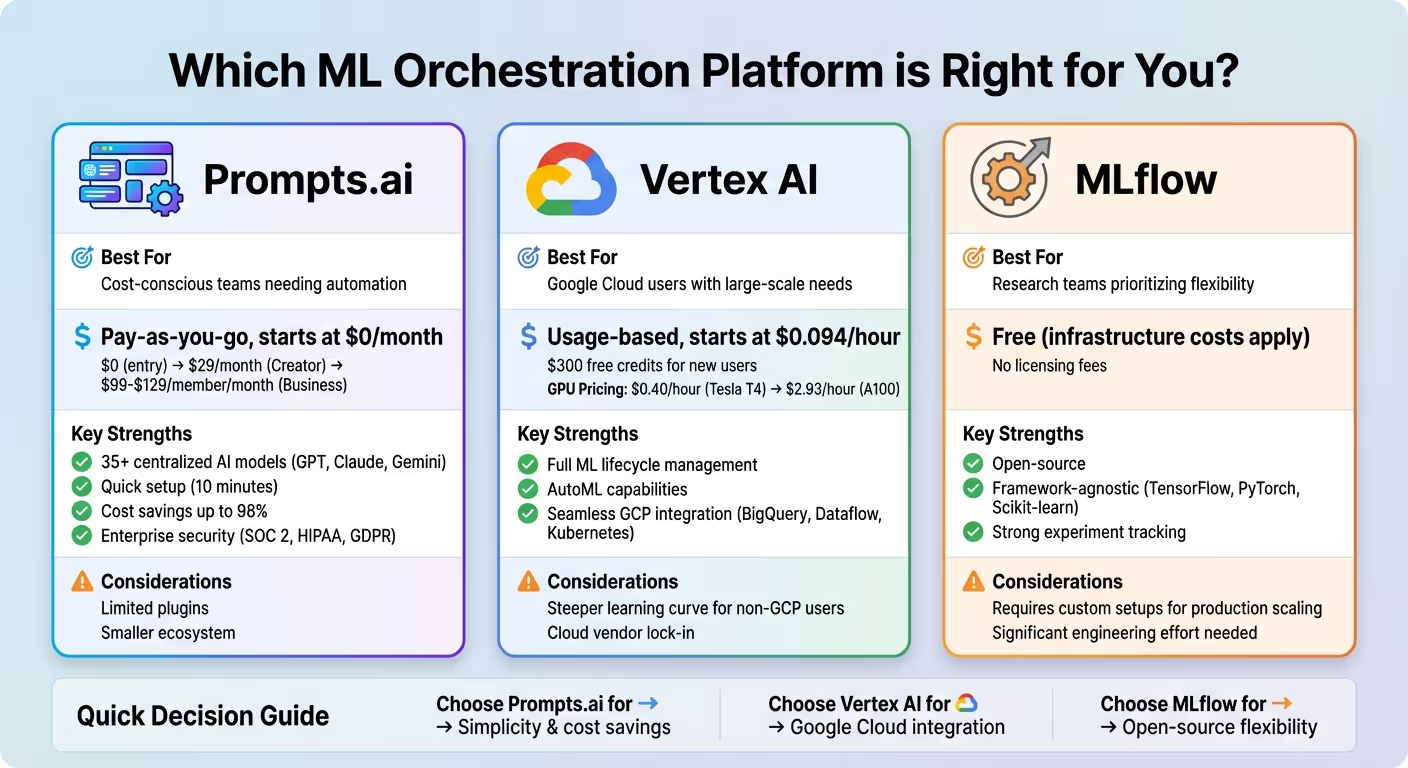

Prompts.ai, Vertex AI, et Débit ML sont trois plateformes remarquables pour l'orchestration de l'apprentissage automatique, chacune offrant des avantages uniques en fonction des objectifs, de l'expertise et de l'infrastructure de votre équipe. Voici un résumé rapide :

Principaux plats à emporter: choisissez Prompts.ai pour plus de simplicité et de réduction des coûts, Vertex AI pour l'intégration à Google Cloud, ou MLflow pour une flexibilité open source. Chacun possède des atouts adaptés à des besoins spécifiques, alors adaptez votre choix à l'expertise et à l'infrastructure de votre équipe.

Comparaison des plateformes d'orchestration de machine learning : Prompts.ai, Vertex AI et MLflow

Prompts.ai regroupe plus de 35 grands modèles de langage (LLM) de premier plan, dont GPT, Claude, Lamaet Gemini, dans un tableau de bord sécurisé et convivial. En consolidant ces outils, les équipes peuvent remplacer plus de 35 plateformes individuelles, réduisant ainsi les coûts jusqu'à 98 % en moins de 10 minutes.

La plateforme simplifie la gestion de l'IA en centralisant l'accès aux principaux LLM et en s'intégrant parfaitement aux outils de travail tels que Slack, Gmail, et Trello. Les utilisateurs peuvent comparer les modèles côte à côte au sein d'une interface unique, ce qui permet d'identifier facilement les plus performants pour des tâches spécifiques sans avoir à passer d'une plateforme à l'autre. Cette configuration rationalisée permet aux équipes d'apprentissage automatique et d'IA de connecter leurs applications existantes directement à la couche d'intégration de Prompts.ai, permettant ainsi des connexions fluides aux microservices, aux pipelines de données ou aux outils de business intelligence.

Prompts.ai utilise un Système de crédit TOKN Pay-As-You-Go, à partir de 0$ par mois, éliminant ainsi les frais d'abonnement récurrents. Les coûts sont directement liés à l'utilisation réelle, ce qui garantit transparence et contrôle. Les outils FinOps en temps réel suivent la consommation de jetons, donnant aux équipes un aperçu complet des dépenses, quels que soient les modèles et les utilisateurs. Pour les entreprises basées aux États-Unis, les prix commencent à 29$ par mois pour les créateurs individuels et vont de 99$ à 129$ par membre et par mois pour les équipes commerciales. Les plans de niveau supérieur incluent le pool TOKN et le pool de stockage, permettant une gestion efficace des ressources de calcul à grande échelle.

Conçu pour répondre aux besoins des entreprises, Prompts.ai facilite l'extension en ajoutant des modèles, des utilisateurs et des équipes supplémentaires. Les forfaits de niveau supérieur offrent un nombre illimité d'espaces de travail et de collaborateurs, tandis que le plan Problem Solver peut accueillir jusqu'à 99 collaborateurs et permet de créer un flux de travail illimité. La plateforme fournit également une gouvernance centralisée, garantissant une visibilité et une auditabilité complètes de toutes les activités d'IA. Ces fonctionnalités sont essentielles pour gérer les opérations à grande échelle tout en maintenant la conformité. En outre, les flux de travail automatisés améliorent l'efficacité opérationnelle, permettant aux entreprises d'évoluer rapidement et efficacement.

« Un directeur artistique lauréat d'un Emmy avait l'habitude de passer des semaines à réaliser des rendus dans 3D Studio et un mois à rédiger des propositions commerciales. Grâce aux LoRas et aux flux de travail de Prompts.ai, il réalise désormais des rendus et des propositions en une seule journée. » - Steven Simmons, PDG et fondateur

Prompts.ai transforme les tâches répétitives en processus efficaces et évolutifs grâce à Automatisation des tâches alimentée par l'IA fonctionnalité. Cet outil fonctionne 24 heures sur 24, ce qui élimine le besoin de travail manuel. En 2025, Frank Buscemi, PDG et CCO, a redéfini son processus de création de contenu en automatisant les flux de travail stratégiques, libérant ainsi du temps pour les priorités de haut niveau. De même, Mohamed Sakr, fondateur de The AI Business, a utilisé « Time Savers » de Prompts.ai pour automatiser les ventes, le marketing et les opérations. Cette automatisation a aidé son entreprise à générer des prospects, à améliorer sa productivité et à accélérer sa croissance grâce à des stratégies basées sur l'IA.

Prompts.ai se concentre sur la simplification de la gestion des modèles d'IA et fournit des informations claires sur les coûts, tandis que Vertex AI se distingue par la gestion de l'ensemble du cycle de vie de l'apprentissage automatique (ML) au sein de l'écosystème Google Cloud. Vertex AI propose une plateforme centralisée pour superviser les flux de travail du machine learning, du développement initial au déploiement. Il permet à la fois la création automatique de modèles avec AutoML et la formation personnalisée à l'aide de frameworks populaires, donnant aux équipes la liberté de choisir les outils qui répondent le mieux à leurs besoins.

Vertex AI se connecte de manière fluide aux frameworks de machine learning existants via des blocs-notes gérés. Il regroupe des outils de développement et propose une intégration native avec les services Google Cloud tels que BigQuery, Flux de données, et Moteur Kubernetes. Cette intégration garantit un flux de travail fluide et un accès rationalisé aux ressources essentielles.

Vertex AI utilise un modèle de tarification à l'utilisation, avec des coûts de formation commençant à 0,094$ par heure pour les configurations de base et atteignant plus de 11$ par heure pour les configurations hautes performances. L'utilisation du GPU est facturée à 0,40 dollar de l'heure pour les GPU Tesla T4 et à 2,93 dollars de l'heure pour les GPU A100. Cette tarification flexible permet aux équipes d'adapter les dépenses à leurs besoins informatiques, même si les coûts peuvent augmenter pour les tâches gourmandes en ressources.

La plate-forme prend en charge le déploiement de machine learning à grande échelle et les flux de données, offrant un accès à une variété d'options GPU pour les tâches de calcul exigeantes. La fonctionnalité de pipeline de Vertex AI permet aux équipes de gérer des flux de travail complexes sur des systèmes distribués. Son intégration parfaite aux services Google Cloud facilite les opérations de dimensionnement à mesure que les volumes de données augmentent ou que les modèles deviennent plus complexes.

Vertex AI Pipelines fournit des fonctionnalités MLOps avancées, automatisant l'ensemble du cycle de vie du machine learning. Les équipes peuvent concevoir des flux de travail en plusieurs étapes qui gèrent tout, de la préparation des données à la formation, à l'évaluation et au déploiement. Grâce à l'intégration intégrée de Google Cloud, les flux de travail peuvent automatiquement extraire des données de BigQuery, les traiter à l'aide de Dataflow et déployer des modèles sur Kubernetes Engine, le tout sans nécessiter de connecteurs personnalisés ni d'étapes manuelles. Cette automatisation met en évidence la capacité de Vertex AI à rationaliser et à faire évoluer efficacement les opérations de machine learning.

MLflow se distingue en tant que solution open source gratuite pour gérer les expériences d'apprentissage automatique et le versionnement des modèles. Contrairement aux plateformes propriétaires, elle évite de verrouiller les équipes dans une infrastructure spécifique, ce qui en fait une option intéressante pour les petites équipes ou les organisations qui préfèrent une plus grande flexibilité dans la gestion de leurs flux de travail de machine learning.

L'un des points forts de MLflow est sa capacité à fonctionner sur différents frameworks, notamment TensorFlow, PyTorch, et SciKit Learn. Les équipes peuvent enregistrer les expériences, suivre les indicateurs de performance et gérer les versions des modèles à l'aide de divers outils tels que la CLI, Python, R, Java ou une API REST. Son registre de modèles sert de centre centralisé pour contrôler les versions des modèles et gérer les transitions d'étapes. Bien que cette polyvalence constitue un avantage clé, elle fonctionne selon une structure de coûts différente de celle des plateformes intégrées payantes.

MLflow lui-même est gratuit, les coûts étant liés uniquement à la puissance de calcul et aux ressources de stockage nécessaires pour le prendre en charge.

Bien que MLflow soit bien adapté aux expériences à plus petite échelle, la gestion de charges de travail de production plus importantes peut nécessiter une infrastructure cloud supplémentaire. Malgré cela, il simplifie efficacement certaines tâches d'automatisation au cours du cycle de vie du machine learning.

MLflow automatise plusieurs aspects essentiels du flux de travail de machine learning. Il suit les paramètres, les métriques et les artefacts au cours des expériences ; regroupe le code et les dépendances à des fins de reproductibilité grâce à sa fonction Projets ; et utilise le registre des modèles pour gérer les déploiements. Cependant, il se concentre principalement sur le suivi des expériences plutôt que sur la gestion d'une orchestration complexe de pipelines.

Pour fournir une comparaison claire, le tableau ci-dessous présente les compromis entre les principaux critères d'évaluation pour trois plateformes : Prompts.ai, Vertex AI, et Débit ML. Ces critères incluent fonctionnalités et couverture du flux de travail, intégration et interopérabilité, coût et évolutivité, et facilité d'utilisation et maturité opérationnelle. Ce résumé vise à aider les équipes américaines à choisir la meilleure option pour leurs besoins d'orchestration de l'apprentissage automatique.

Prompts.ai se distingue par son déploiement rapide, son accès unifié aux modèles et ses coûts prévisibles, ce qui en fait un choix judicieux pour les équipes qui souhaitent simplifier les opérations sans gérer une infrastructure complexe. Vertex AI offre une intégration fluide avec Google Cloud et une automatisation avancée, mais nécessite l'expertise de GCP et peut associer les équipes à un seul fournisseur de cloud. Débit ML offre une flexibilité maximale sans frais de licence, mais nécessite des efforts d'ingénierie supplémentaires pour mettre en place une orchestration, une surveillance et une gouvernance au niveau de la production. Ces comparaisons jettent les bases de la section suivante, où les besoins opérationnels et la rentabilité orienteront les recommandations finales.

Le choix de la bonne plateforme d'orchestration de machine learning dépend de l'expertise technique, de l'infrastructure cloud et des objectifs opérationnels de votre équipe. Prompts.ai se distingue par sa configuration rapide, son accès à plus de 35 modèles d'IA et sa tarification flexible à l'utilisation à partir de 0$ par mois. Cela en fait une solution idéale pour les agences de création et les entreprises qui cherchent à simplifier les flux de travail et à réduire les coûts jusqu'à 98 %. Son interface sécurisée, dotée de fonctionnalités de gouvernance intégrées, convient aux organisations qui recherchent l'efficacité sans avoir à gérer une infrastructure étendue.

Chaque plateforme possède des atouts uniques adaptés à différents besoins. Vertex AI est un excellent choix pour les entreprises qui ont déjà investi dans Google Cloud, car il offre des fonctionnalités AutoML et une intégration fluide avec BigQuery. Il fournit 300$ de crédits gratuits aux nouveaux utilisateurs, ce qui facilite le démarrage des projets initiaux. Ses outils MLOps gérés, tels que Vertex AI Pipelines, permettent des flux de travail évolutifs et reproductibles. Cependant, les équipes qui ne sont pas familiarisées avec Google Cloud peuvent être confrontées à une courbe d'apprentissage plus ardue, et les organisations dotées de stratégies multicloud peuvent avoir besoin de solutions d'orchestration supplémentaires.

Pour les équipes axées sur la recherche, Débit ML brille en donnant la priorité au suivi des expériences, au contrôle des versions et à la reproductibilité. Sa nature open source supprime les coûts initiaux et la compatibilité avec les API Python, R, Java et REST garantit la flexibilité entre les frameworks. Cela dit, la mise à l'échelle de MLflow pour la production nécessite souvent une ingénierie supplémentaire pour intégrer les pipelines CI/CD, les magasins de fonctionnalités et les systèmes de surveillance. Les fonctionnalités au niveau de l'entreprise, telles que l'authentification unique ou les tableaux de bord de gouvernance, peuvent également nécessiter des distributions commerciales ou des solutions personnalisées.

Lorsque vous choisissez une plateforme d'orchestration d'apprentissage automatique (ML), priorisez évolutivité, facilité d'utilisation, et sans faille intégration avec vos outils et flux de travail actuels. Il est essentiel que la plateforme corresponde à vos préférences en matière d'infrastructure, que vous utilisiez des services cloud, des configurations sur site ou des systèmes conteneurisés tels que Kubernetes.

Vous souhaiterez également évaluer dans quelle mesure la plateforme gère les flux de travail complexes, ses fonctionnalités de surveillance et de débogage, ainsi que le niveau de support fourni par les fournisseurs. Ces aspects sont essentiels pour garantir que la plateforme gère et automatise efficacement vos processus de machine learning avec un minimum de tracas.

Prompts.ai fonctionne sur un Payez à l'utilisation système de tarification, conçu pour offrir à la fois flexibilité et économies de coûts. Au lieu de vous enfermer dans des frais mensuels fixes comme les plans d'abonnement traditionnels, vous ne payez que pour les ressources d'IA que vous utilisez réellement.

Cette approche est particulièrement utile pour les entreprises dont les exigences en matière d'IA varient, car elle vous permet de gérer efficacement les dépenses sans vous engager dans un budget fixe. Il s'agit d'une option évolutive et claire qui s'adapte à vos besoins uniques.

Intégrer Vertex AI accéder à des environnements extérieurs à Google Cloud peut comporter ses propres obstacles. Vertex AI étant conçu pour fonctionner parfaitement au sein de l'écosystème de Google, son utilisation avec d'autres plateformes peut réduire la flexibilité. Il se peut également que vous rencontriez une complexité supplémentaire lorsque vous le connectez à des outils ou à des services tiers qui ne font pas partie de Google Cloud.

Un autre défi à prendre en compte est coûts de transfert de données, qui peuvent s'accumuler lors du transfert d'informations entre différents environnements. En outre, une configuration supplémentaire peut être nécessaire pour garantir une compatibilité optimale avec les systèmes extérieurs à Google Cloud. Ces facteurs peuvent influencer l'efficacité et l'efficience de vos flux de travail.