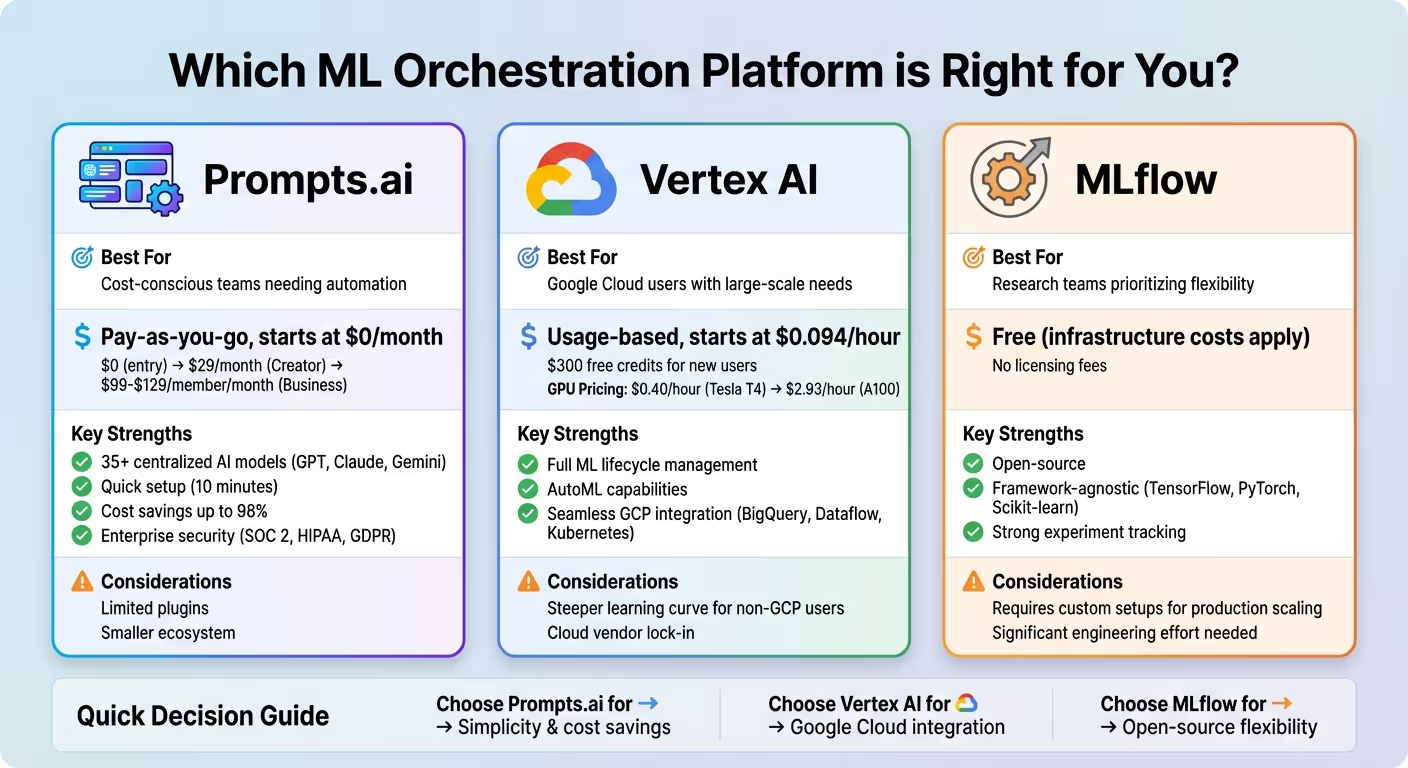

Prompts.ai، فيرتيكس إيه آي، و إم إل فلو هي ثلاث منصات متميزة لتنسيق التعلم الآلي، تقدم كل منها مزايا فريدة اعتمادًا على أهداف فريقك وخبراته وبنيته التحتية. فيما يلي تفصيل سريع:

الوجبات الجاهزة الرئيسية: اختر Prompts.ai للبساطة وتوفير التكاليف، أو Vertex AI للتكامل مع Google Cloud، أو MLFlow لمرونة المصدر المفتوح. لكل منها نقاط قوة مصممة خصيصًا لتلبية احتياجات محددة، لذا قم بمواءمة اختيارك مع خبرة فريقك وبنيته التحتية.

مقارنة منصة تنسيق التعلم الآلي: Prompts.ai مقابل Vertex AI مقابل MLFlow

يجمع Prompts.ai أكثر من 35 نموذجًا للغات الكبيرة من الدرجة الأولى (LLMs)، بما في ذلك GPT و Claude و لاما، و Gemini، في لوحة تحكم واحدة آمنة وسهلة الاستخدام. من خلال دمج هذه الأدوات، يمكن للفرق استبدال أكثر من 35 منصة فردية، مما يقلل التكاليف بنسبة تصل إلى 98٪ في أقل من 10 دقائق.

تعمل المنصة على تبسيط إدارة الذكاء الاصطناعي من خلال الوصول المركزي إلى LLMs الرئيسية والتكامل بسلاسة مع أدوات مكان العمل مثل سلاك، Gmail، و تريلو. يمكن للمستخدمين مقارنة النماذج جنبًا إلى جنب داخل واجهة واحدة، مما يجعل من السهل تحديد الأفضل أداءً لمهام محددة دون الحاجة إلى التبديل بين الأنظمة الأساسية. يسمح هذا الإعداد المبسط لفرق التعلم الآلي والذكاء الاصطناعي بتوصيل تطبيقاتهم الحالية مباشرة بطبقة تكامل Prompts.ai، مما يتيح الاتصالات السلسة بالخدمات المصغرة أو خطوط أنابيب البيانات أو أدوات ذكاء الأعمال.

يستخدم ملف Prompts.ai ملف نظام ائتمان TOKN للدفع أولاً بأول، بدءًا من 0 دولارًا أمريكيًا في الشهر، مما يلغي الحاجة إلى رسوم الاشتراك المتكررة. ترتبط التكاليف مباشرة بالاستخدام الفعلي، مما يوفر الشفافية والتحكم. تتعقب أدوات FinOps في الوقت الفعلي استهلاك الرموز، مما يمنح الفرق رؤية كاملة للإنفاق عبر النماذج والمستخدمين. بالنسبة للمؤسسات التي تتخذ من الولايات المتحدة مقراً لها، تبدأ الأسعار من 29 دولارًا شهريًا لمنشئي المحتوى الفرديين وتتراوح من 99 دولارًا إلى 129 دولارًا لكل عضو شهريًا لفرق الأعمال. تتضمن الخطط ذات المستوى الأعلى تجميع TOKN وتجميع التخزين، مما يسمح بالإدارة الفعالة للموارد الحسابية على نطاق واسع.

تم تصميم Prompts.ai لتلبية الاحتياجات على مستوى المؤسسة، مما يجعل من السهل التوسع عن طريق إضافة المزيد من النماذج والمستخدمين والفرق. توفر الخطط ذات المستوى الأعلى مساحات عمل ومتعاونين غير محدودين، مع خطة حل المشكلات التي تستوعب ما يصل إلى 99 متعاونًا وإنشاء سير عمل غير محدود. توفر المنصة أيضًا حوكمة مركزية، مما يضمن الرؤية الكاملة وقابلية التدقيق لجميع أنشطة الذكاء الاصطناعي. هذه الميزات ضرورية لإدارة العمليات واسعة النطاق مع الحفاظ على الامتثال. بالإضافة إلى ذلك، تعمل عمليات سير العمل الآلية على تعزيز الكفاءة التشغيلية، مما يسمح للمؤسسات بالتوسع بسرعة وفعالية.

«مخرجة إبداعية حائزة على جائزة إيمي، اعتادت أن تقضي أسابيع في العرض في 3D Studio وشهرًا في كتابة مقترحات الأعمال. من خلال LoRas وسير العمل الخاص بـ Prompts.ai، يقوم الآن بإكمال العروض والمقترحات في يوم واحد.» - ستيفن سيمونز، الرئيس التنفيذي والمؤسس

يقوم Prompts.ai بتحويل المهام المتكررة إلى عمليات فعالة وقابلة للتطوير من خلال التشغيل الآلي للمهام المدعومة بالذكاء الاصطناعي ميزة. تعمل هذه الأداة على مدار الساعة، مما يلغي الحاجة إلى العمل اليدوي. في عام 2025، أعاد فرانك بوسكيمي، الرئيس التنفيذي والمدير التنفيذي، تعريف عملية إنشاء المحتوى الخاصة به من خلال التشغيل الآلي لسير العمل الاستراتيجي، مما يوفر الوقت للأولويات عالية المستوى. وبالمثل، استخدم محمد صقر، مؤسس The AI Business، برنامج «Time Savers» الخاص بـ Prompts.ai لأتمتة المبيعات والتسويق والعمليات. ساعدت هذه الأتمتة شركته على توليد العملاء المحتملين وتحسين الإنتاجية وتسريع النمو من خلال الاستراتيجيات القائمة على الذكاء الاصطناعي.

يركز Prompts.ai على تبسيط إدارة نماذج الذكاء الاصطناعي وتوفير رؤى واضحة للتكلفة، بينما تتألق Vertex AI في إدارة دورة حياة التعلم الآلي (ML) بالكامل داخل نظام Google Cloud البيئي. تقدم شركة Vertex AI منصة مركزية للإشراف على عمليات سير عمل ML، من التطوير الأولي إلى النشر. إنه يلبي كلاً من إنشاء النماذج الآلية باستخدام AutoML والتدريب المخصص باستخدام أطر العمل الشائعة، مما يمنح الفرق حرية اختيار الأدوات التي تناسب احتياجاتهم على أفضل وجه.

يتصل Vertex AI بسلاسة مع أطر تعلم الآلة الحالية من خلال أجهزة الكمبيوتر المحمولة المُدارة. فهو يجمع أدوات التطوير ويوفر التكامل الأصلي مع خدمات Google Cloud مثل بيج كويري، تدفق البيانات، و محرك كوبيرنيتيس. يضمن هذا التكامل سير العمل السلس والوصول المبسط إلى الموارد الأساسية.

تستخدم Vertex AI نموذج تسعير الدفع أولاً بأول، حيث تبدأ تكاليف التدريب من 0.094 دولارًا في الساعة للإعدادات الأساسية وتصل إلى أكثر من 11 دولارًا في الساعة للتكوينات عالية الأداء. يبلغ سعر استخدام GPU 0.40 دولارًا في الساعة لوحدات معالجة الرسومات Tesla T4 و 2.93 دولارًا في الساعة لوحدات معالجة الرسومات A100. يسمح هذا التسعير المرن للفرق بمطابقة النفقات مع احتياجاتهم الحسابية، على الرغم من أن التكاليف يمكن أن تتصاعد للمهام كثيفة الموارد.

تدعم المنصة نشر ML على نطاق واسع وسير عمل البيانات، مما يوفر الوصول إلى مجموعة متنوعة من خيارات GPU للمهام الحسابية الصعبة. تتيح وظيفة خط أنابيب Vertex AI للفرق إدارة عمليات سير العمل المعقدة عبر الأنظمة الموزعة. إن تكاملها السلس مع خدمات Google Cloud يجعل عمليات التوسع بسيطة مع زيادة أحجام البيانات أو زيادة تعقيد النماذج.

توفر خطوط أنابيب Vertex AI إمكانات MLOPs المتقدمة، مما يؤدي إلى أتمتة دورة حياة ML بأكملها. يمكن للفرق تصميم عمليات سير عمل متعددة الخطوات تتعامل مع كل شيء بدءًا من إعداد البيانات وحتى التدريب والتقييم والنشر. من خلال تكامل Google Cloud المدمج، يمكن لعمليات سير العمل سحب البيانات تلقائيًا من BigQuery ومعالجتها باستخدام Dataflow ونشر النماذج على Kubernetes Engine - كل ذلك دون الحاجة إلى موصلات مخصصة أو خطوات يدوية. تسلط هذه الأتمتة الضوء على قدرة Vertex AI على تبسيط عمليات ML وتوسيع نطاقها بكفاءة.

يبرز MLFlow كحل مجاني ومفتوح المصدر لإدارة تجارب التعلم الآلي وإصدار النماذج. وعلى عكس المنصات الاحتكارية، فإنها تتجنب حصر الفرق في بنية تحتية محددة، مما يجعلها خيارًا جذابًا للفرق الصغيرة أو المؤسسات التي تفضل قدرًا أكبر من المرونة في التعامل مع عمليات سير عمل تعلم الآلة.

تتمثل إحدى نقاط قوة MLFlow في قدرتها على العمل عبر أطر عمل مختلفة، بما في ذلك تينسورفلو، PyTorch، و سكيكيت ليرن. يمكن للفرق تسجيل التجارب وتتبع مقاييس الأداء وإدارة إصدارات النماذج باستخدام مجموعة متنوعة من الأدوات مثل CLI أو Python أو R أو Java أو REST API. يعمل السجل النموذجي الخاص به كمحور مركزي للتحكم في إصدارات النماذج وإدارة انتقالات المرحلة. في حين أن هذا التنوع يعد ميزة أساسية، إلا أنه يعمل وفقًا لهيكل تكلفة مختلف مقارنة بالمنصات المدفوعة والمتكاملة.

MLFlow نفسها مجانية للاستخدام، حيث تنشأ التكاليف فقط من طاقة الحوسبة وموارد التخزين اللازمة لدعمها.

في حين أن MLFlow مناسب تمامًا للتجارب على نطاق أصغر، فإن التعامل مع أعباء عمل الإنتاج الأكبر قد يتطلب بنية تحتية سحابية إضافية. على الرغم من ذلك، فإنه يبسط بشكل فعال بعض مهام الأتمتة في دورة حياة ML.

يقوم MLFlow بأتمتة العديد من الجوانب الأساسية لسير عمل ML. يتتبع المعلمات والمقاييس والقطع الأثرية أثناء التجارب؛ ويحزم التعليمات البرمجية والتبعيات من أجل التكرار من خلال ميزة المشاريع الخاصة به؛ ويستخدم السجل النموذجي لإدارة عمليات النشر. ومع ذلك، يظل تركيزها الأساسي على تتبع التجربة بدلاً من إدارة تنسيق خطوط الأنابيب المعقدة.

لتوفير مقارنة واضحة، يوضح الجدول أدناه المقايضات عبر معايير التقييم الرئيسية لثلاث منصات: Prompts.ai، فيرتيكس إيه آي، و إم إل فلو. تشمل هذه المعايير تغطية القدرات وسير العمل، التكامل وقابلية التشغيل البيني، التكلفة وقابلية التوسع، و سهولة الاستخدام والنضج التشغيلي. يهدف هذا الملخص إلى مساعدة الفرق الأمريكية على اختيار الخيار الأفضل لاحتياجات تنسيق التعلم الآلي.

Prompts.ai تتميز بالنشر السريع والوصول الموحد إلى النماذج والتكاليف المتوقعة، مما يجعلها خيارًا قويًا للفرق التي تهدف إلى تبسيط العمليات دون إدارة البنية التحتية المعقدة. فيرتيكس إيه آي يوفر تكاملاً سلسًا مع Google Cloud والأتمتة المتقدمة ولكنه يتطلب خبرة GCP وقد يربط الفرق بموفر سحابة واحد. إم إل فلو يوفر أقصى قدر من المرونة وبدون رسوم ترخيص ولكنه يتطلب المزيد من الجهد الهندسي لبناء التنسيق والمراقبة والحوكمة على مستوى الإنتاج. تضع هذه المقارنات الأساس للقسم التالي، حيث ستوجه الاحتياجات التشغيلية وكفاءة التكلفة التوصيات النهائية.

يعتمد اتخاذ قرار بشأن منصة تنسيق ML المناسبة على الخبرة الفنية لفريقك والبنية التحتية السحابية والأهداف التشغيلية. Prompts.ai تتميز بإعدادها السريع، والوصول إلى أكثر من 35 نموذجًا للذكاء الاصطناعي، وأسعار الدفع حسب الاستخدام المرنة بدءًا من 0 دولار شهريًا. وهذا يجعلها مناسبة تمامًا للوكالات الإبداعية والمؤسسات التي تتطلع إلى تبسيط سير العمل وخفض التكاليف بنسبة تصل إلى 98٪. فواجهته الآمنة، المكتملة بميزات الحوكمة المدمجة، تجذب المؤسسات التي تسعى إلى تحقيق الكفاءة دون عبء إدارة البنية التحتية الشاملة.

تتمتع كل منصة بنقاط قوة فريدة مصممة خصيصًا لتلبية الاحتياجات المختلفة. فيرتيكس إيه آي يعد خيارًا قويًا للمؤسسات التي استثمرت بالفعل في Google Cloud، حيث يوفر إمكانات AutoML والتكامل السلس مع BigQuery. يوفر 300 دولار من الائتمانات المجانية للمستخدمين الجدد، مما يسهل البدء في المشاريع الأولية. تتيح أدوات MLops المُدارة الخاصة بها، مثل Vertex AI Pipelines، تدفقات عمل قابلة للتطوير والتكرار. ومع ذلك، قد تواجه الفرق غير المألوفة بـ Google Cloud منحنى تعليمي أكثر حدة، وقد تحتاج المؤسسات التي تستخدم استراتيجيات السحابة المتعددة إلى حلول تنسيق إضافية.

بالنسبة للفرق التي تركز على البحث، إم إل فلو يتألق من خلال إعطاء الأولوية لتتبع التجربة والتحكم في الإصدار وقابلية التكرار. تزيل طبيعته مفتوحة المصدر التكاليف الأولية، ويضمن التوافق مع واجهات برمجة تطبيقات Python و R و Java و REST المرونة عبر الأطر. ومع ذلك، فإن توسيع نطاق MLFlow للإنتاج غالبًا ما يتطلب هندسة إضافية لدمج خطوط أنابيب CI/CD ومخازن الميزات وأنظمة المراقبة. قد تتطلب الميزات على مستوى المؤسسة، مثل تسجيل الدخول الأحادي أو لوحات معلومات الحوكمة، أيضًا توزيعات تجارية أو حلولًا مخصصة.

عند اختيار منصة تنسيق التعلم الآلي (ML)، حدد الأولويات القابلية للتطوير، سهولة الاستخدام، وسلس التكامل باستخدام أدواتك الحالية وسير العمل. من الضروري أن تتوافق المنصة مع تفضيلات البنية التحتية الخاصة بك، سواء كنت تعتمد على الخدمات السحابية أو الإعدادات المحلية أو الأنظمة الحاوية مثل Kubernetes.

ستحتاج أيضًا إلى تقييم مدى جودة تعامل النظام الأساسي مع عمليات سير العمل المعقدة وميزات المراقبة وتصحيح الأخطاء ومستوى دعم البائع المقدم. تعد هذه الجوانب بالغة الأهمية في ضمان إدارة النظام الأساسي لعمليات ML وأتمتتها بشكل فعال بأقل قدر من المتاعب.

تعمل Prompts.ai على الدفع أولاً بأول نظام التسعير، المصمم لتوفير المرونة وتوفير التكاليف. بدلاً من فرض رسوم شهرية ثابتة مثل خطط الاشتراك التقليدية، فإنك تدفع فقط مقابل موارد الذكاء الاصطناعي التي تستخدمها بالفعل.

هذا النهج مفيد بشكل خاص للشركات ذات المتطلبات المختلفة للذكاء الاصطناعي، مما يتيح لك إدارة النفقات بفعالية دون الالتزام بميزانية محددة. إنه خيار قابل للتطوير وواضح يتكيف مع متطلباتك الفريدة.

دمج فيرتيكس إيه آي يمكن أن تأتي في بيئات خارج Google Cloud بمجموعة من العقبات الخاصة بها. نظرًا لأن Vertex AI مصمم للعمل بسلاسة داخل نظام Google البيئي، فإن استخدامه جنبًا إلى جنب مع الأنظمة الأساسية الأخرى قد يقلل المرونة. قد تواجه أيضًا تعقيدًا إضافيًا عند توصيله بأدوات أو خدمات تابعة لجهات خارجية ليست جزءًا من Google Cloud.

التحدي الآخر الذي يجب مراعاته هو تكاليف نقل البيانات، والتي يمكن أن تتراكم عند نقل المعلومات بين البيئات المختلفة. علاوة على ذلك، قد يكون التكوين الإضافي ضروريًا لضمان التوافق السلس مع الأنظمة خارج Google Cloud. يمكن أن تؤثر هذه العوامل على مدى كفاءة وفعالية سير العمل.