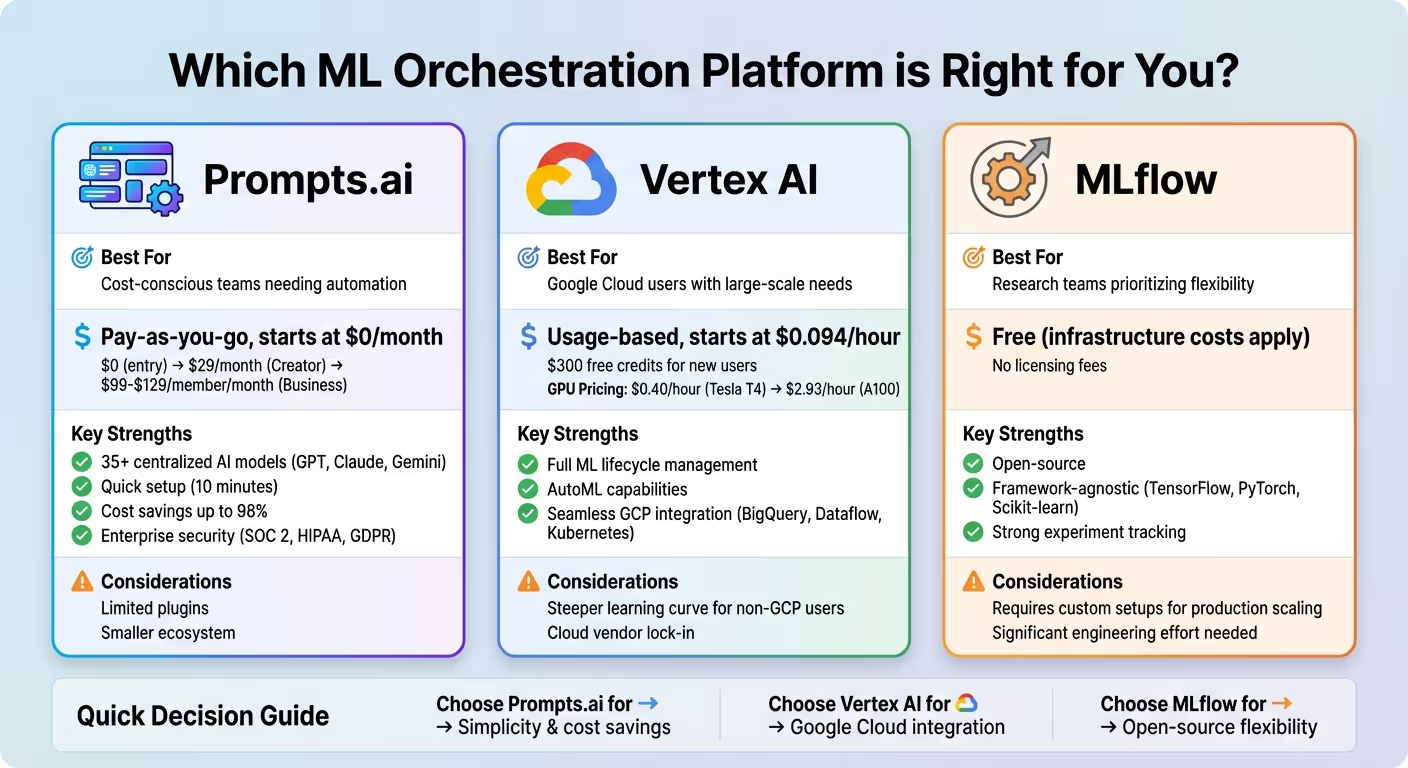

Prompts.ai, Vertex AI, y MLFlow son tres plataformas destacadas para la orquestación del aprendizaje automático, cada una de las cuales ofrece ventajas únicas en función de los objetivos, la experiencia y la infraestructura de su equipo. He aquí un desglose rápido:

Conclusión clave: Elija Prompts.ai para simplificar y ahorrar costos, Vertex AI para la integración con Google Cloud o MLFlow para obtener flexibilidad de código abierto. Cada uno tiene puntos fuertes adaptados a las necesidades específicas, así que alinea tu elección con la experiencia y la infraestructura de tu equipo.

Comparación de plataformas de orquestación de ML: Prompts.ai frente a Vertex AI frente a MLFlow

Prompts.ai reúne más de 35 modelos de grandes lenguajes (LLM) de primer nivel, incluidos GPT, Claude, Llamay Gemini, en un panel de control seguro y fácil de usar. Al consolidar estas herramientas, los equipos pueden reemplazar más de 35 plataformas individuales, lo que reduce los costos hasta en un 98% en menos de 10 minutos.

La plataforma simplifica la gestión de la IA al centralizar el acceso a los principales LLM e integrarse sin problemas con las herramientas del lugar de trabajo, como Slack, Gmail, y Trello. Los usuarios pueden comparar los modelos en paralelo dentro de una única interfaz, lo que facilita la identificación del mejor desempeño para tareas específicas sin la molestia de cambiar de plataforma. Esta configuración simplificada permite a los equipos de aprendizaje automático e inteligencia artificial conectar sus aplicaciones existentes directamente a la capa de integración de Prompts.ai, lo que permite establecer conexiones fluidas a microservicios, canales de datos o herramientas de inteligencia empresarial.

Prompts.ai usa un Sistema de crédito TOKN Pay-As-You-Go, a partir de 0 USD al mes, lo que elimina la necesidad de pagar cuotas de suscripción recurrentes. Los costos están directamente relacionados con el uso real, lo que ofrece transparencia y control. Las herramientas de FinOps en tiempo real rastrean el consumo de tokens, lo que brinda a los equipos una visión completa del gasto según los modelos y los usuarios. Para las empresas con sede en EE. UU., los precios comienzan en 29 dólares al mes para los creadores individuales y oscilan entre 99 y 129 dólares por miembro al mes para los equipos empresariales. Los planes de nivel superior incluyen TOKN Pooling y Storage Pooling, que permiten una administración eficiente de los recursos computacionales a escala.

Creado para las necesidades de nivel empresarial, Prompts.ai facilita la expansión al agregar más modelos, usuarios y equipos. Los planes de nivel superior ofrecen espacios de trabajo y colaboradores ilimitados, mientras que el plan Problem Solver tiene capacidad para hasta 99 colaboradores y permite crear flujos de trabajo ilimitados. La plataforma también proporciona una gobernanza centralizada, lo que garantiza la total visibilidad y auditabilidad de todas las actividades de inteligencia artificial. Estas funciones son cruciales para gestionar operaciones a gran escala y, al mismo tiempo, mantener el cumplimiento. Además, los flujos de trabajo automatizados mejoran la eficiencia operativa, lo que permite a las empresas escalar de forma rápida y eficaz.

«Un director creativo ganador de un Emmy, solía pasar semanas renderizando en 3D Studio y un mes escribiendo propuestas de negocios. Con los LoRAs y los flujos de trabajo de Prompts.ai, ahora completa renderizados y propuestas en un solo día». - Steven Simmons, director ejecutivo y fundador

Prompts.ai transforma las tareas repetitivas en procesos eficientes y escalables a través de su Automatización de tareas impulsada por IA función. Esta herramienta funciona las 24 horas del día, lo que elimina la necesidad de trabajo manual. En 2025, Frank Buscemi, director ejecutivo y CCO, redefinió su proceso de creación de contenido mediante la automatización de los flujos de trabajo estratégicos, lo que le permitió dedicar tiempo a las prioridades de alto nivel. Del mismo modo, Mohamed Sakr, fundador de The AI Business, utilizó «Time Savers» de Prompts.ai para automatizar las ventas, el marketing y las operaciones. Esta automatización ayudó a su empresa a generar clientes potenciales, mejorar la productividad y acelerar el crecimiento mediante estrategias impulsadas por la inteligencia artificial.

Prompts.ai se centra en simplificar la gestión del modelo de IA y en proporcionar información clara sobre los costes, mientras que Vertex AI destaca en la gestión de todo el ciclo de vida del aprendizaje automático (ML) dentro del ecosistema de Google Cloud. Vertex AI ofrece una plataforma centralizada para supervisar los flujos de trabajo de aprendizaje automático, desde el desarrollo inicial hasta la implementación. Se adapta tanto a la creación automatizada de modelos con AutoML como a la formación personalizada con marcos populares, lo que brinda a los equipos la libertad de elegir las herramientas que mejor se adapten a sus necesidades.

Vertex AI se conecta sin problemas con los marcos de aprendizaje automático existentes a través de cuadernos gestionados. Reúne herramientas de desarrollo y ofrece una integración nativa con los servicios de Google Cloud, como BigQuery, Flujo de datos, y Motor Kubernetes. Esta integración garantiza un flujo de trabajo fluido y un acceso simplificado a los recursos esenciales.

Vertex AI utiliza un modelo de precios de pago por uso, con costes de formación que comienzan en 0,094 USD por hora para las configuraciones básicas y superan los 11 USD por hora para las configuraciones de alto rendimiento. El uso de la GPU tiene un precio de 0,40 USD por hora para las GPU Tesla T4 y de 2,93 USD por hora para las GPU A100. Estos precios flexibles permiten a los equipos adaptar los gastos a sus necesidades informáticas, aunque los costes pueden aumentar si se realizan tareas que consumen muchos recursos.

La plataforma admite la implementación de aprendizaje automático a gran escala y los flujos de trabajo de datos, y ofrece acceso a una variedad de opciones de GPU para tareas computacionales exigentes. La funcionalidad de canalización de Vertex AI permite a los equipos gestionar flujos de trabajo complejos en sistemas distribuidos. Su perfecta integración con los servicios de Google Cloud facilita las operaciones de escalado a medida que aumentan los volúmenes de datos o los modelos se vuelven más complejos.

Las canalizaciones de IA de Vertex ofrecen capacidades avanzadas de MLOps y automatizan todo el ciclo de vida del aprendizaje automático. Los equipos pueden diseñar flujos de trabajo de varios pasos que se ocupen de todo, desde la preparación de los datos hasta la capacitación, la evaluación y la implementación. Gracias a la integración integrada con Google Cloud, los flujos de trabajo pueden extraer datos de BigQuery de forma automática, procesarlos con Dataflow e implementar modelos en Kubernetes Engine, todo ello sin necesidad de conectores personalizados ni pasos manuales. Esta automatización destaca la capacidad de Vertex AI para optimizar y escalar las operaciones de aprendizaje automático de manera eficiente.

MLFlow se destaca como una solución gratuita y de código abierto para administrar experimentos de aprendizaje automático y versiones de modelos. A diferencia de las plataformas propietarias, evita que los equipos queden confinados en una infraestructura específica, lo que la convierte en una opción atractiva para los equipos u organizaciones más pequeños que prefieren una mayor flexibilidad a la hora de gestionar sus flujos de trabajo de aprendizaje automático.

Uno de los puntos fuertes de MLFlow es su capacidad para trabajar en varios marcos, incluidos TensorFlow, PyTorch, y Scikit-learn. Los equipos pueden registrar experimentos, realizar un seguimiento de las métricas de rendimiento y administrar las versiones de los modelos mediante una variedad de herramientas como CLI, Python, R, Java o una API REST. Su registro de modelos sirve como un centro centralizado para controlar las versiones de los modelos y gestionar las transiciones de las etapas. Si bien esta versatilidad es una ventaja clave, funciona con una estructura de costos diferente a la de las plataformas integradas y de pago.

MLflow en sí mismo es de uso gratuito, y los costos se derivan únicamente de la potencia de procesamiento y los recursos de almacenamiento necesarios para respaldarlo.

Si bien MLFlow es adecuado para experimentos a menor escala, el manejo de cargas de trabajo de producción más grandes puede requerir una infraestructura de nube adicional. A pesar de esto, simplifica de manera efectiva ciertas tareas de automatización dentro del ciclo de vida del aprendizaje automático.

MLflow automatiza varios aspectos esenciales del flujo de trabajo de ML. Realiza un seguimiento de los parámetros, las métricas y los artefactos durante los experimentos; empaqueta el código y las dependencias para que sean reproducibles a través de su función de proyectos; y utiliza el registro modelo para gestionar las implementaciones. Sin embargo, se centra principalmente en el seguimiento de los experimentos, más que en gestionar la compleja orquestación de los procesos.

Para ofrecer una comparación clara, la siguiente tabla describe las ventajas y desventajas de los criterios de evaluación clave para tres plataformas: Prompts.ai, Vertex AI, y MLFlow. Estos criterios incluyen capacidades y cobertura del flujo de trabajo, integración e interoperabilidad, costo y escalabilidad, y facilidad de uso y madurez operativa. Este resumen tiene como objetivo ayudar a los equipos estadounidenses a elegir la mejor opción para sus necesidades de orquestación del aprendizaje automático.

Prompts.ai destaca por su rápida implementación, su modelo de acceso unificado y sus costos predecibles, lo que la convierte en una opción sólida para los equipos que buscan simplificar las operaciones sin administrar una infraestructura compleja. Vertex AI ofrece una integración perfecta con Google Cloud y una automatización avanzada, pero exige experiencia en GCP y puede vincular a los equipos a un único proveedor de nube. MLFlow ofrece la máxima flexibilidad y no requiere tarifas de licencia, pero requiere más esfuerzo de ingeniería para desarrollar la orquestación, la supervisión y la gobernanza a nivel de producción. Estas comparaciones sientan las bases para la siguiente sección, en la que las recomendaciones finales se basarán en las necesidades operativas y la rentabilidad.

La decisión sobre la plataforma de orquestación de aprendizaje automático adecuada depende de la experiencia técnica, la infraestructura de nube y los objetivos operativos de su equipo. Prompts.ai destaca por su rápida configuración, acceso a más de 35 modelos de IA y precios flexibles de pago por uso a partir de 0 USD al mes. Esto lo convierte en una opción ideal para las agencias creativas y las empresas que buscan simplificar los flujos de trabajo y reducir los costos hasta en un 98%. Su interfaz segura, completa con funciones de gobierno integradas, atrae a las organizaciones que buscan eficiencia sin la carga de una administración exhaustiva de la infraestructura.

Cada plataforma tiene puntos fuertes únicos adaptados a las diferentes necesidades. Vertex AI es una opción sólida para las empresas que ya han invertido en Google Cloud, ya que ofrece funciones de AutoML y una integración perfecta con BigQuery. Proporciona 300$ en créditos gratuitos para los nuevos usuarios, lo que facilita la puesta en marcha de los proyectos iniciales. Sus herramientas mLOps administradas, como Vertex AI Pipelines, permiten flujos de trabajo escalables y repetibles. Sin embargo, los equipos que no estén familiarizados con Google Cloud pueden enfrentarse a una curva de aprendizaje más pronunciada, y las organizaciones con estrategias de nube múltiple pueden necesitar soluciones de orquestación adicionales.

Para equipos centrados en la investigación, MLFlow brilla al priorizar el seguimiento de los experimentos, el control de versiones y la reproducibilidad. Su naturaleza de código abierto elimina los costos iniciales, y la compatibilidad con las API de Python, R, Java y REST garantiza la flexibilidad en todos los marcos. Dicho esto, escalar MLFlow para la producción a menudo requiere ingeniería adicional para incorporar canales de CI/CD, almacenes de funciones y sistemas de monitoreo. Las funciones de nivel empresarial, como el inicio de sesión único o los paneles de control, también pueden requerir distribuciones comerciales o soluciones personalizadas.

Al elegir una plataforma de orquestación de aprendizaje automático (ML), priorice escalabilidad, facilidad de uso, y sin fisuras integración con sus herramientas y flujos de trabajo actuales. Es fundamental que la plataforma se alinee con tus preferencias de infraestructura, ya sea que dependas de los servicios en la nube, las configuraciones locales o los sistemas en contenedores como Kubernetes.

También querrá evaluar qué tan bien la plataforma maneja los flujos de trabajo complejos, sus funciones de monitoreo y depuración, y el nivel de soporte de los proveedores brindado. Estos aspectos son fundamentales para garantizar que la plataforma gestione y automatice de forma eficaz sus procesos de aprendizaje automático con un mínimo de complicaciones.

Prompts.ai funciona en un paga sobre la marcha sistema de precios, diseñado para proporcionar flexibilidad y ahorro de costos. En lugar de limitarte a pagar tarifas mensuales fijas como en los planes de suscripción tradicionales, solo pagas por los recursos de IA que realmente utilizas.

Este enfoque es particularmente útil para las empresas con diferentes demandas de IA, ya que les permite gestionar los gastos de forma eficaz sin comprometerse con un presupuesto establecido. Es una opción escalable y clara que se adapta a sus requisitos únicos.

Integrando Vertex AI entrar en entornos fuera de Google Cloud puede tener sus propios obstáculos. Como la IA de Vertex está diseñada para funcionar sin problemas en el ecosistema de Google, usarla junto con otras plataformas puede reducir la flexibilidad. También es posible que te encuentres con una complejidad adicional al conectarla a herramientas o servicios de terceros que no forman parte de Google Cloud.

Otro desafío a tener en cuenta es costos de transferencia de datos, que pueden acumularse al mover información entre diferentes entornos. Además, es posible que sea necesaria una configuración adicional para garantizar una compatibilidad fluida con sistemas ajenos a Google Cloud. Estos factores pueden influir en la eficiencia y eficacia de sus flujos de trabajo.