Les plateformes d'apprentissage automatique simplifient l'automatisation en gérant l'ensemble du cycle de vie de l'IA, de la préparation des données au déploiement. Voici une liste des trois principales plateformes qui vous aideront à choisir celle qui convient le mieux à votre entreprise :

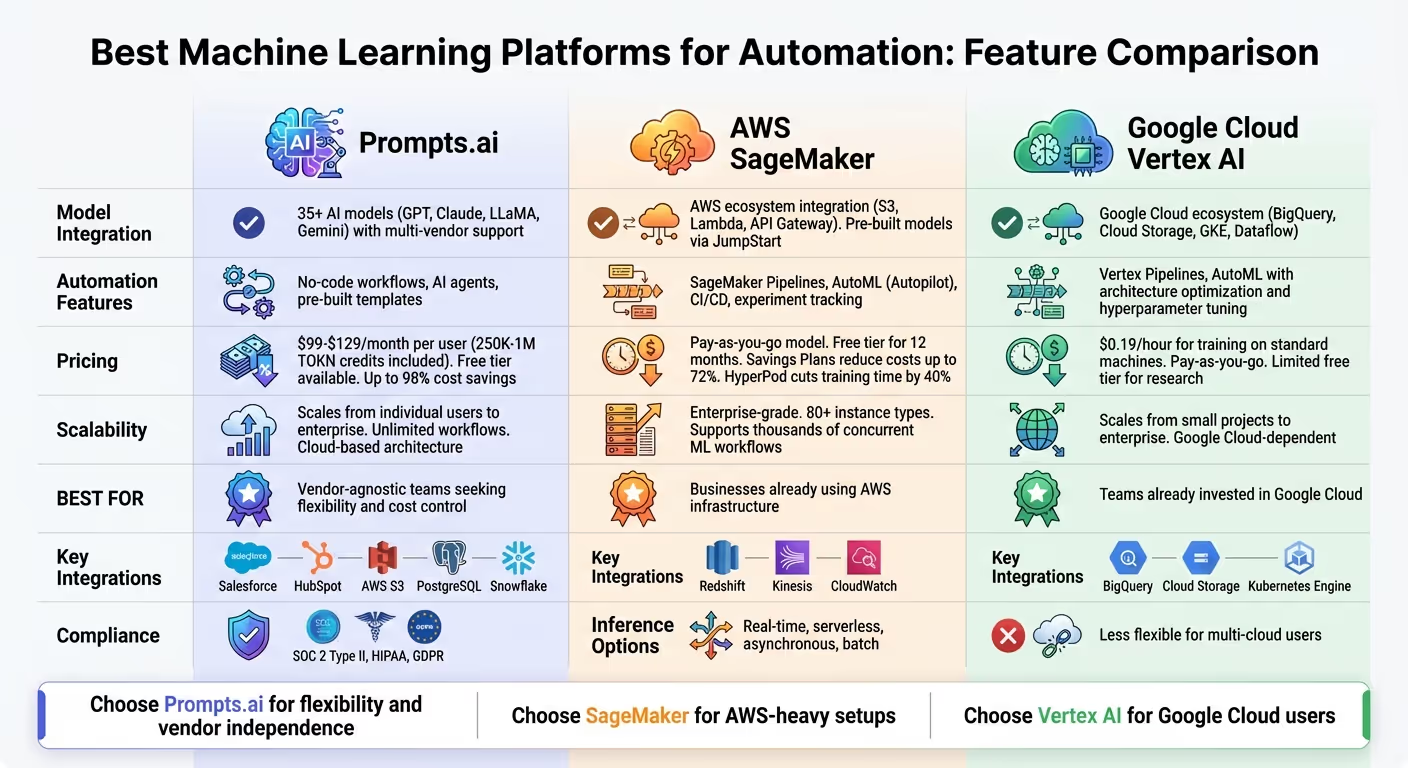

Choisissez Prompts.ai pour plus de flexibilité, Sage Maker pour les configurations utilisant AWS intensivement, ou Vertex AI pour les utilisateurs de Google Cloud. Chaque plateforme prend en charge la mise à l'échelle et l'automatisation, mais votre choix dépend de votre infrastructure existante et de vos objectifs.

Comparaison des plateformes d'apprentissage automatique : Prompts.ai, AWS SageMaker et Google Vertex AI

Prompts.ai simplifie la gestion de l'IA en consolidant l'accès à plus de 35 modèles, dont GPT, Claude, LLama et Gémeaux, sur une seule plateforme. Il n'est donc plus nécessaire de jongler entre plusieurs comptes fournisseurs, clés d'API ou systèmes de facturation. Il se connecte parfaitement aux fournisseurs LLM externes via des API et des SDK standard, tout en intégrant des outils tels que Salesforce, HubSpot, AWS S3, PostgreSQL, et Flocon de neige à l'aide de clés OAuth ou API. Les données se synchronisent automatiquement, rationalisant les flux de travail de formation et d'inférence. Par exemple, une entreprise de vente au détail basée aux États-Unis pourrait relier sa base de données de commerce électronique à la plateforme pour générer sans effort des descriptions de produits en temps réel et des campagnes par e-mail personnalisées. Ce cadre d'intégration jette les bases de flux de travail efficaces et automatisés.

Prompts.ai propose un générateur de flux de travail sans code ou à faible code qui permet aux utilisateurs d'automatiser des processus tels que l'ingestion de données, le prétraitement, les appels de modèles et le post-traitement. Les flux de travail peuvent être déclenchés selon un calendrier ou par des événements spécifiques. Par exemple, la plateforme peut extraire automatiquement les données de vente quotidiennes, les nettoyer, générer des prévisions de demande, mettre à jour les outils de BI et informer les parties prenantes via Slack - le tout sans effort manuel. En outre, les agents IA peuvent être configurés avec des rôles, des outils et des instructions spécifiques pour gérer les tâches en cours, telles que la surveillance des e-mails ou la mise à jour des CRM. Des modèles prédéfinis pour des domaines tels que les ventes, le marketing, le support et les opérations accélèrent encore le déploiement en proposant des solutions personnalisées répondant aux divers besoins des entreprises.

Prompts.ai propose une tarification flexible en dollars américains ($), en commençant par des plans exploratoires gratuits et en passant à des niveaux commerciaux dont le prix varie entre 99$ et 129$ par membre et par mois. Ces plans incluent 250 000 à 1 000 000 de crédits TOKN. Les coûts sont influencés par des facteurs tels que le volume d'inférence, le stockage et le temps de calcul. Les tableaux de bord intégrés assurent la transparence en suivant les dépenses liées à l'IA pour chaque flux de travail et modèle. Les équipes peuvent affecter des modèles haut de gamme à des tâches hautement prioritaires et opter pour des choix plus économiques pour les opérations de routine. Des fonctionnalités telles que les limites de débit, les demandes par lots et les politiques de dimensionnement automatique permettent de mieux contrôler les coûts. Par exemple, une entreprise de taille moyenne qui gère 500 000 invites automatisées monthly peut surveiller l'utilisation des jetons en temps réel et ajuster les paramètres pour respecter le budget.

L'architecture basée sur le cloud de Prompts.ai est conçue pour évoluer sans effort, en gérant des charges de travail accrues, telles que des campagnes sortantes de grande envergure, sans aucun ajustement manuel. Il prend en charge le traitement distribué et les appels d'API à haut débit pour garantir des performances constantes, même en période de pointe. L'hébergement régional dans des centres de données américains garantit une faible latence et le respect des réglementations locales. Qu'il s'agisse de gérer un flux de travail unique ou de répondre à des millions de demandes mensuelles, la conception multi-tenant de la plateforme, ses contrôles d'accès basés sur les rôles et ses journaux d'audit en font un outil puissant pour les data scientists, les ingénieurs et les équipes commerciales.

AWS SageMaker rationalise le processus de création, de formation et de déploiement de modèles d'apprentissage automatique (ML) en se connectant de manière fluide à Amazon S3, AWS Lambda, et Passerelle d'API Amazon. Avec SageMaker Studio, les utilisateurs ont accès à un environnement de développement unifié dans lequel ils peuvent créer des pipelines de machine learning et surveiller les performances à l'aide de CloudWatch. Pour les entreprises qui utilisent déjà AWS, cette intégration simplifie les opérations en éliminant les problèmes liés à la connexion de systèmes distincts. En outre, SageMaker JumpStart propose des modèles prédéfinis qui peuvent être déployés rapidement, réduisant ainsi le délai de rentabilisation.

SageMaker Pipelines automatise les flux de travail de machine learning en incorporant des fonctionnalités telles que le suivi des expériences, le CI/CD et l'AutoML via Pilote automatique SageMaker, minimisant l'effort manuel. Ce service d'orchestration sans serveur est conçu pour gérer des dizaines de milliers de flux de travail ML simultanés dans des environnements de production. Grâce à la prise en charge de nombreux algorithmes et modèles prédéfinis, SageMaker accélère le processus de développement. Son intégration à des services tels que Redshift et Kinesis garantit une circulation fluide des données au sein de l'écosystème AWS. Ces fonctionnalités d'automatisation s'harmonisent parfaitement avec les fonctionnalités complètes d'intégration et de gestion des ressources de SageMaker.

SageMaker fonctionne selon un modèle de tarification à l'utilisation en dollars américains, garantissant que les utilisateurs ne paient que pour les ressources qu'ils utilisent. Un niveau gratuit est disponible pendant 12 mois, permettant aux utilisateurs d'explorer la plateforme dans des limites définies. Les mesures d'économie telles que les plans d'épargne peuvent réduire les dépenses jusqu'à 72 %, tandis que la technologie HyperPod réduit le temps de formation de 40 %. Elastic Training optimise davantage les coûts en adaptant automatiquement les tâches en fonction de la demande.

L'infrastructure robuste de SageMaker permet de passer de petits projets à des charges de travail au niveau de l'entreprise. Tirant parti du réseau mondial à hautes performances d'AWS, la plateforme peut gérer facilement des modèles et des ensembles de données à grande échelle. Il prend en charge le déploiement sur plus de 80 types d'instances et propose des options d'inférence en temps réel, sans serveur, asynchrone et par lots. Pour des performances améliorées, du matériel spécialisé comme les puces Inferentia permet une inférence efficace et un entraînement optimisé. Cette évolutivité garantit que SageMaker est équipé pour gérer tout, des projets expérimentaux aux applications d'entreprise à grande échelle.

Google Cloud Vertex AI est une plateforme unifiée qui se connecte parfaitement à l'écosystème Google Cloud dans son ensemble, notamment à des outils tels que BigQuery, Stockage dans le cloud, Moteur Google Kubernetes, et Flux de données. Cette configuration interconnectée permet aux entreprises de gérer le traitement des données, la formation des modèles et le déploiement au sein d'un seul espace de travail. En proposant une interface rationalisée pour des tâches telles que la formation, la validation et la prédiction, Vertex AI simplifie le processus d'apprentissage automatique, en particulier pour les équipes déjà investies dans Google Cloud.

Vertex AI se distingue par ses fonctionnalités d'automatisation, notamment grâce à Vertex Pipelines, qui supervise l'ensemble du flux de travail d'apprentissage automatique. Ses outils AutoML prennent en charge des tâches telles que la sélection de modèles, l'optimisation de l'architecture et le réglage des hyperparamètres, réduisant ainsi considérablement l'effort manuel requis pour créer des modèles précis. Cette automatisation permet aux équipes de former rapidement des modèles d'apprentissage automatique personnalisés, souvent avec un minimum de codage.

Vertex AI suit un modèle de tarification à l'utilisation, à partir de 0,19 dollar de l'heure pour les modèles de formation sur des machines standard. Bien que la tarification soit intéressante pour les projets de petite envergure ou d'entrée de gamme, les coûts peuvent grimper à mesure que des services supplémentaires ou des charges de travail plus importantes sont ajoutés. Google Cloud AutoML, une fonctionnalité clé de Vertex AI, inclut un niveau gratuit limité à des fins de recherche, l'utilisation commerciale nécessitant un paiement. Les organisations doivent surveiller attentivement l'utilisation de leurs services, car des déploiements plus complexes ou des ensembles de données plus volumineux peuvent entraîner des dépenses plus élevées. Cette structure tarifaire reste toutefois suffisamment flexible pour répondre aux besoins d'évolutivité.

Vertex AI est conçu pour évoluer en fonction de vos besoins, en offrant une évolutivité allant des petits projets expérimentaux aux déploiements d'entreprise à grande échelle. Son intégration étroite avec les autres services Google Cloud garantit un flux de données efficace à mesure que les charges de travail augmentent. Cependant, cette dépendance à l'égard de l'écosystème de Google pourrait poser des défis aux équipes qui recherchent des solutions plus indépendantes du cloud.

Après avoir examiné les caractéristiques de chaque plateforme, analysons leurs points forts et leurs limites potentielles afin de vous aider à faire un choix éclairé.

prompts.ai donne accès à plus de 35 modèles d'IA via une interface sécurisée unique, conforme à la norme SOC 2 Type II, à la HIPAA et au RGPD pour garantir des normes élevées en matière de sécurité et de confidentialité. Il simplifie les flux de travail et propose des options de tarification flexibles, allant d'un modèle gratuit de paiement à l'utilisation à des forfaits d'entreprise à partir de 99$ par membre et par mois. Cette configuration peut réduire les coûts liés à l'IA jusqu'à 98 %. Cependant, pour les équipes profondément intégrées dans un écosystème cloud spécifique, prompts.ai peut ne pas s'intégrer aussi facilement que les alternatives cloud natives.

AWS SageMaker propose une suite robuste d'outils d'apprentissage automatique, mettant l'accent sur l'automatisation par le biais de services gérés. Son intégration étroite à l'écosystème AWS en fait un choix naturel pour les entreprises qui exécutent déjà des charges de travail sur Amazon Web Services. Cela dit, les organisations opérant dans des environnements multicloud peuvent être confrontées à des défis en matière d'intégration.

Google Cloud Vertex AI propose une gamme complète de services gérés, y compris des fonctionnalités AutoML qui réduisent le besoin d'un codage manuel approfondi. Son intégration approfondie avec les services Google Cloud constitue un avantage majeur pour les utilisateurs existants, mais pour les entreprises qui recherchent des solutions indépendantes du cloud, ce couplage étroit peut présenter certaines contraintes.

Voici une comparaison côte à côte pour vous aider à visualiser les principales différences :

Le choix de la bonne plateforme dépend de vos besoins spécifiques. Si vous recherchez un accès centralisé à l'IA et une indépendance vis-à-vis des fournisseurs, prompts.ai se démarque. D'autre part, les entreprises qui ont déjà investi dans AWS ou Google Cloud peuvent trouver leurs plateformes respectives mieux adaptées à leur infrastructure et à leurs flux de travail existants.

Lorsque vous choisissez la bonne plateforme d'apprentissage automatique (ML), il s'agit en fin de compte d'aligner vos exigences techniques sur les objectifs généraux de votre organisation. Le meilleur choix dépendra de vos priorités et de votre infrastructure uniques.

Prompts.ai se distingue par son approche indépendante des fournisseurs, offrant un accès à plus de 35 modèles d'IA via une interface unique et unifiée. Sa tarification flexible et ses forfaits d'entreprise à partir de 99$ en font une option intéressante pour les équipes qui cherchent à tirer parti de l'IA avancée sans trop dépenser. D'autre part, AWS SageMaker s'intègre parfaitement aux configurations AWS existantes, fournissant des services gérés qui simplifient la création et le déploiement de modèles. Pour les équipes déjà intégrées à Google Cloud, Vertex AI propose des outils AutoML qui minimisent le codage manuel et rationalisent les flux de travail avec Vertex Pipelines. Bien que sa conception s'intègre parfaitement à l'écosystème de Google, cette orientation peut sembler limitée pour les organisations qui recherchent une plus grande flexibilité.

Pour les entreprises qui ont besoin d'une prise en charge complète du cycle de vie du machine learning et d'une intégration dans divers systèmes, éviter la dépendance vis-à-vis d'un fournisseur peut s'avérer un facteur essentiel. La plateforme idéale doit non seulement répondre à vos exigences techniques actuelles, mais également offrir l'évolutivité nécessaire pour évoluer parallèlement à vos besoins d'automatisation. Alors que la technologie ML continue d'évoluer, votre plateforme doit être prête à s'adapter, afin de garantir que vos flux de travail restent efficaces et prêts pour l'avenir.

Lorsque vous sélectionnez une plateforme d'apprentissage automatique pour l'automatisation, priorisez caractéristiques clés qui correspondent aux besoins de votre entreprise. Recherchez des plateformes qui s'intègrent parfaitement à vos systèmes actuels, offrent une évolutivité adaptée à la croissance et incluent des outils intuitifs pour rationaliser les flux de travail. Garantir sécurité et conformité est tout aussi crucial pour protéger les données sensibles et respecter les normes du secteur.

Il est également judicieux d'évaluer la plateforme rapport coût-efficacité par rapport à votre budget tout en évaluant sa capacité à atteindre vos objectifs d'automatisation spécifiques. Un support client fiable et des mises à jour régulières jouent un rôle essentiel pour garantir une configuration fluide et un succès continu dans le temps.

Prompts.ai permet aux entreprises de réduire leurs coûts et de se développer efficacement grâce à modèle de tarification à l'utilisation qui peut réduire les dépenses liées à l'IA jusqu'à 98 %. La plateforme offre un accès sécurisé à plus de 35 outils et modèles d'IA de premier plan, tous parfaitement intégrés dans un système prêt à l'emploi.

Conçu dans un souci d'évolutivité, Prompts.ai s'adresse aux organisations de toutes tailles, des startups aux grandes entreprises, en proposant une automatisation efficace et des flux de travail personnalisés pour répondre à vos besoins uniques.

Ces plateformes facilitent la gestion des flux de travail liés à l'IA en automatisant des processus complexes. Ils gèrent des tâches telles que prétraitement des données, ingénierie des fonctionnalités, sélection d'algorithmes, et réglage des hyperparamètres, ce qui réduit le besoin de travaux pratiques.

Ils offrent également des fonctionnalités avancées telles que assemblage de modèles, comparaison, et interprétabilité, garantissant des résultats à la fois précis et faciles à comprendre. Au-delà de cela, ils simplifient déploiement et fournir des outils pour surveillance continue, aidant les utilisateurs à gérer et à affiner les modèles d'IA au fil du temps. Conçus dans un souci d'efficacité, ces outils permettent une automatisation complète avec un minimum d'effort.