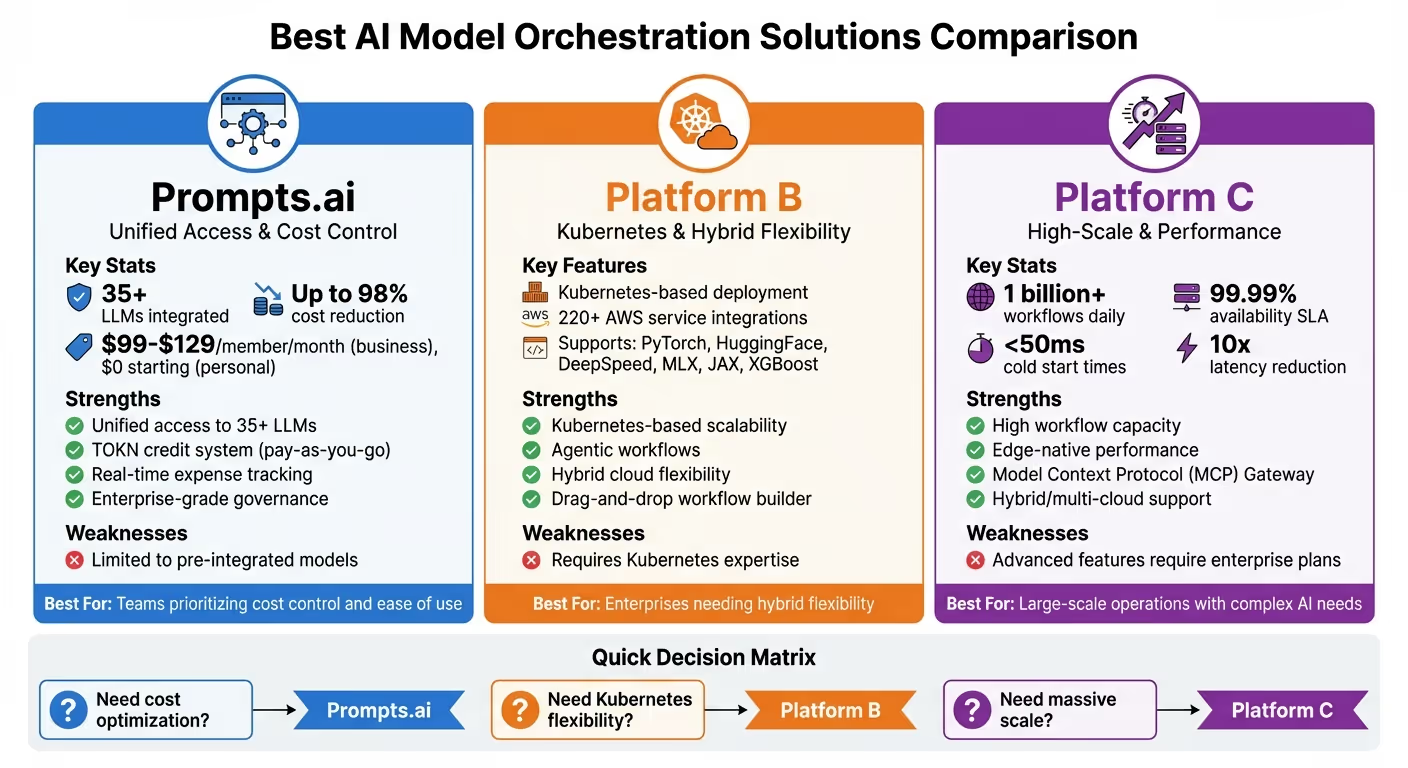

Les plateformes d'orchestration de l'IA simplifient la façon dont les entreprises gèrent plusieurs modèles, outils et flux de travail d'IA. Cet article explore trois solutions de pointe conçues pour relever des défis tels que la fragmentation des systèmes, l'imprévisibilité des coûts et les besoins de conformité. Voici ce que vous devez savoir :

Chaque plateforme aborde l'intégration, l'automatisation, la gestion des coûts et la gouvernance de manière unique. Vous trouverez ci-dessous une comparaison rapide qui vous aidera à choisir la solution la mieux adaptée à vos besoins.

Le choix de la bonne plateforme dépend de vos exigences techniques, de votre budget et de vos objectifs opérationnels. Qu'il s'agisse de développer l'IA, d'améliorer la gouvernance ou d'optimiser les coûts, ces solutions peuvent vous aider à rationaliser votre écosystème d'IA.

Comparaison des plateformes d'orchestration de modèles d'IA : fonctionnalités, points forts et meilleurs cas d'utilisation

Prompts.ai est un plateforme d'orchestration de l'IA au niveau de l'entreprise conçu pour rationaliser l'accès à plus de 35 grands modèles linguistiques (LLM) de premier plan, notamment GPT-5, Claude, Lama, Gémeaux, Grok-4, Flux Pro, et Kling. Développée sous la direction du directeur artistique Steven P. Simmons, la plateforme aborde le problème de la surcharge d'outils d'IA en consolidant plusieurs systèmes d'abonnement, de connexion et de facturation en une seule solution fluide.

Avec un accès à plus de 35 LLM en un seul endroit, Prompts.ai permet aux équipes de passer facilement d'un modèle à l'autre, éliminant ainsi le besoin de clés d'API distinctes ou de gérer plusieurs comptes fournisseurs. Cette intégration simplifie les flux de travail et améliore l'efficacité des opérations d'IA.

Prompts.ai va au-delà de l'accès de base aux modèles en proposant des flux de travail « permettant de gagner du temps » qui aident les équipes à mettre en œuvre les meilleures pratiques de manière efficace. La plateforme comprend également un Programme de certification Prompt Engineer, en dotant les individus des compétences nécessaires pour transformer les efforts expérimentaux en processus structurés et reproductibles. Ces flux de travail peuvent être déployés rapidement et la plateforme permet une évolutivité facile, qu'il s'agisse d'ajouter de nouveaux modèles, de nouveaux utilisateurs ou de nouvelles équipes.

Prompts.ai intègre un couche FinOps qui fournit un suivi en temps réel de l'utilisation des jetons, reliant directement les dépenses aux résultats. La plate-forme prétend réduire les coûts des logiciels d'IA de jusqu'à 98 % grâce à son système de crédit TOKN, un modèle de paiement à l'utilisation qui élimine les frais d'abonnement récurrents. Des fonctionnalités telles que le contrôle des coûts en temps réel et les comparaisons de performances côte à côte fournissent aux équipes les outils nécessaires pour affiner à la fois les dépenses et les performances. Les tarifs commencent entre 99$ et 129$ par membre et par mois pour les forfaits professionnels, tandis que les forfaits personnels avec paiement à l'utilisation commencent à 0$.

Prompts.ai intègre une gouvernance et des pistes d'audit au niveau de l'entreprise dans chaque flux de travail, offrant aux entreprises une visibilité et un contrôle complets sur leurs activités d'IA. Les données sensibles sont traitées en toute sécurité, évitant ainsi toute exposition par des tiers, et la plateforme répond aux exigences de conformité dans divers secteurs. Les rapports détaillés sur l'utilisation, les dépenses et les performances garantissent la transparence, ce qui facilite l'évaluation et l'optimisation des opérations d'IA. Ces fonctionnalités robustes permettent aux organisations de comparer directement les forces et les faiblesses des modèles, garantissant ainsi une prise de décision éclairée.

La plate-forme B combine des outils open source avec des frameworks natifs du cloud pour créer une solution hybride. Centré sur les déploiements basés sur Kubernetes, il offre aux équipes la flexibilité nécessaire pour gérer les charges de travail liées à l'IA dans diverses configurations d'infrastructure. Cela garantit des opérations standardisées tout en prenant en charge des processus d'IA évolutifs et interopérables adaptés aux besoins de l'entreprise.

Utilisations de la plateforme B Entraîneur Kubeflow pour faciliter une formation et un ajustement évolutifs et distribués dans une gamme de cadres d'IA, notamment PyTorch, Visage étreignant, Vitesse profonde, MLX, JAX, et XG Boost. Pour le déploiement, il s'appuie sur K Serve, une plateforme d'inférence distribuée conçue pour Kubernetes. Cela permet aux équipes de déployer des modèles sur plusieurs frameworks, que ce soit pour des tâches d'IA génératives ou prédictives. La possibilité de suivre une formation dans un cadre et de le déployer de manière fluide dans un autre garantit des transitions fluides des flux de travail et une efficacité opérationnelle.

Grâce aux générateurs de flux de travail par glisser-déposer, la plate-forme B simplifie la création d'une logique complexe dans des interfaces conviviales. Il automatise également les intégrations avec plus de 220 services AWS, éliminant ainsi la nécessité d'une maintenance manuelle du code. La plateforme prend en charge Flux de travail des agences, permettant aux systèmes d'IA de prendre des décisions et d'exécuter des tâches de manière indépendante sur des terminaux publics et privés.

Pour garantir la sécurité, la plate-forme B utilise Contrôle d'accès basé sur les rôles (RBAC) pour gérer l'accès des utilisateurs et surveiller les activités du flux de travail. Il tient à jour des journaux d'audit détaillés qui enregistrent chaque action et chaque exécution, garantissant ainsi la transparence à des fins de conformité et de sécurité. En outre, la plateforme intègre de manière sécurisée plusieurs modèles d'IA et bases de données vectorielles, offrant ainsi une approche gouvernée pour gérer ces connexions.

La plate-forme C est conçue pour répondre aux demandes des entreprises qui gèrent des flux de travail d'IA à grande échelle. Il traite plus de 1 milliard de flux de travail par jour et garantit la fiabilité grâce à un SLA de disponibilité atteignant 99,99 %. Grâce à ses configurations Edge natives, il atteint des temps de démarrage à froid inférieurs à 50 ms et réduit la latence jusqu'à 10x grâce à la mise en cache multicouche, offrant des performances et une fiabilité exceptionnelles.

Platform C donne la priorité à l'intégration fluide des modèles, en proposant des tâches prédéfinies pour les opérations courantes telles que la génération d'intégrations de texte, la réalisation d'interactions par chat et l'indexation de documents dans des bases de données vectorielles, le tout sans nécessiter de code personnalisé. Au cœur de cette capacité se trouve le Passerelle MCP (Model Context Protocol), qui convertit les API et les microservices internes en outils que les agents d'IA et les grands modèles linguistiques (LLM) peuvent utiliser instantanément. Cela permet de combler le fossé entre l'infrastructure existante d'une entreprise et ses besoins en matière d'IA.

Les développeurs peuvent travailler avec des SDK natifs en Python, Java, JavaScript, C# et Go, tandis que la plateforme se connecte en toute sécurité à plusieurs modèles d'IA, notamment Google Gemini et IA ouverte GPT, ainsi que des bases de données vectorielles comme Pomme de pin et Tisser. Pour plus de flexibilité, AI Prompt Studio propose un espace dédié pour affiner, tester et gérer les modèles d'invite sur tous les modèles, garantissant ainsi des résultats cohérents et de haute qualité.

La plate-forme C simplifie également la création et la gestion des flux de travail. Les équipes non techniques peuvent concevoir des flux de travail à l'aide d'interfaces glisser-déposer, tandis que les développeurs ont la possibilité de configurer des processus plus complexes à l'aide de JSON. La plateforme comprend gestion automatique de l'état, qui garantit que les états des flux de travail sont préservés et récupérables en cas de panne, protégeant ainsi contre la perte de données. Cette double fonctionnalité permet la collaboration entre les équipes techniques et non techniques sur des projets partagés.

La sécurité et la gouvernance font partie intégrante de la plateforme C. Le contrôle d'accès granulaire basé sur les rôles (RBAC) protège le modèle et l'accès aux données. La plateforme prend en charge le déploiement dans des environnements hybrides et multicloud, notamment AWS, Azure, GCP, et des configurations sur site, offrant aux entreprises la flexibilité de choisir l'endroit où leurs charges de travail sensibles liées à l'IA sont exploitées. Un niveau gratuit permet aux développeurs de démarrer rapidement, tandis que les plans d'entreprise ajoutent un support essentiel et des outils de gouvernance avancés.

Lorsque vous choisissez une plateforme d'orchestration, il est important d'évaluer les points forts et les limites de chaque option par rapport à vos compétences techniques, votre budget et vos exigences en matière d'intégration. Le tableau ci-dessous donne un aperçu rapide de la situation de certaines plateformes populaires en termes de capacités d'intégration, de convivialité et d'évolutivité.

Cette comparaison met en évidence les avantages et les défis uniques de chaque plateforme, vous aidant à identifier celle qui correspond le mieux à vos besoins.

Le choix de la plateforme d'orchestration d'IA idéale dépend de vos besoins uniques, qu'il s'agisse d'une gouvernance stricte pour les secteurs réglementés ou d'une solution simplifiée pour un déploiement rapide. Prompts.ai regroupe plus de 35 modèles linguistiques de pointe au sein d'un écosystème sécurisé et efficace qui simplifie les flux de travail, garantit la conformité et assure une gestion FinOps en temps réel.

Sa conception intuitive et son cadre évolutif le rendent accessible à tous les utilisateurs, même ceux qui ont une expertise technique limitée. Grâce à ses fonctionnalités d'orchestration avancées, Prompts.ai est bien placé pour devenir le leader de l'orchestration agentique, une approche transformatrice qui Futurum Research prévoit que la croissance économique pourrait atteindre des milliards de dollars d'ici 2028.

En fin de compte, le bon choix est celui qui correspond à vos objectifs techniques, à votre budget et à vos exigences d'intégration, créant ainsi un environnement d'IA unifié et évolutif.

« L'orchestration de l'IA transforme les composants déconnectés en systèmes cohérents, évolutifs et fiables » - Emmanuel Ohiri, Cudo Compute

Les fichiers Prompts.ai Système de crédit TOKN propose une approche flexible, de type portefeuille, pour gérer les coûts de l'IA. Au lieu d'avoir à payer par appel d'API pour les fournisseurs individuels, vous pouvez acheter un bloc de crédits qui fonctionne parfaitement sur plus de 35 modèles intégrés en langage large. Ce système unifié simplifie la facturation et élimine la confusion liée à la fragmentation des prix.

Avec suivi FinOps en temps réel, vous bénéficiez d'une visibilité complète sur la manière dont les crédits sont utilisés pour chaque flux de travail. Vous pouvez allouer des budgets, définir des limites de dépenses et même laisser le système rediriger automatiquement les tâches vers des modèles plus rentables, le cas échéant. Cette optimisation intelligente peut réduire les dépenses jusqu'à 98 % par rapport à la tarification traditionnelle à la demande. En rationalisant la facturation et en améliorant le contrôle des coûts, Prompts.ai garantit que vos opérations d'IA sont à la fois efficaces et économiques.

Aucune information détaillée n'est disponible concernant les fonctionnalités de sécurité de Plateforme B pour gérer les flux de travail d'IA dans le contexte fourni. En l'absence de détails supplémentaires ou d'une source décrivant ses capacités de sécurité, il est difficile de fournir un résumé précis. Si vous pouvez partager plus de détails ou indiquer la documentation pertinente, je serais heureuse de vous aider à clarifier davantage.

La plate-forme C s'appuie sur un moteur d'orchestration piloté par Python pour rationaliser la gestion des flux de travail d'IA à grande échelle. À l'aide de graphes acycliques dirigés (DAG), les développeurs peuvent définir la séquence, les dépendances et la logique conditionnelle des tâches directement en Python. Cette approche garantit que les flux de travail peuvent être personnalisés pour répondre facilement aux exigences complexes des pipelines d'IA.

Conçue pour gérer les charges de travail au niveau de l'entreprise, la plate-forme C présente une architecture modulaire. Les composants clés tels que l'interface Web, la base de données de métadonnées et les backends d'exécution sont séparés, ce qui permet une mise à l'échelle horizontale. Cela signifie que des nœuds de travail ou des pods supplémentaires peuvent être ajoutés selon les besoins pour gérer les tâches à haut débit. La plateforme comprend également des outils de surveillance en temps réel, offrant des informations claires sur l'avancement et les performances des tâches. Ces outils aident les équipes à identifier et à résoudre rapidement les problèmes qui surviennent.

Grâce à sa capacité d'évolutivité, à son architecture adaptable et à ses fonctionnalités de planification avancées, Platform C est conçue pour gérer efficacement les flux de travail d'IA les plus complexes.