La orquestación de la IA es la clave para ampliar las operaciones empresariales de IA. Dado que el 95% de los pilotos de IA fracasan debido a una mala coordinación, las empresas necesitan herramientas para unificar, automatizar y gestionar flujos de trabajo complejos de IA. El panorama de 2025 presenta plataformas que integran varios modelos, protegen los flujos de trabajo y optimizan los costos, ofreciendo hasta ROI un 60% más alto para adoptantes.

He aquí un rápido desglose de las principales soluciones:

Cada plataforma ofrece puntos fuertes únicos en cuanto a escalabilidad, interoperabilidad, gobierno y administración de costos. Ya sea que necesite flexibilidad de código abierto o cumplimiento de nivel empresarial, estas herramientas pueden transformar los sistemas de IA fragmentados en ecosistemas unificados y escalables.

Elija la plataforma adecuada para ampliar sus iniciativas de IA, mejorar la coordinación y maximizar el ROI.

Comparación de plataformas de orquestación de IA: escalabilidad, interoperabilidad, gobernanza y costo

Prompts.ai es una plataforma empresarial de vanguardia diseñada para simplificar y agilizar las operaciones de IA. Reúne más de 35 modelos lingüísticos de gran tamaño de primer nivel, incluidos GPT-5, Claude, LLama, Gemini, Grok-4, Flux Pro y Kling, en una interfaz unificada y segura. Al centralizar el acceso a estos modelos, la plataforma elimina el caos que supone gestionar múltiples herramientas, lo que ayuda a las organizaciones a ampliar sus iniciativas de IA con facilidad.

Prompts.ai funciona con un sistema flexible de pago por uso que utiliza créditos TOKN, lo que elimina la necesidad de pagar tarifas recurrentes. Este enfoque permite a los equipos agregar rápidamente modelos, usuarios o flujos de trabajo sin la carga de una infraestructura adicional. La interfaz unificada de la plataforma actúa como un centro de comando, coordinando las tareas y asignando los recursos de manera eficiente en todos los modelos integrados. Este diseño escalable garantiza una integración fluida entre modelos y apoya a las empresas a medida que aumentan sus necesidades de inteligencia artificial.

Como centro centralizado, Prompts.ai garantiza que todos los procesos impulsados por la IA dependan de plantillas de mensajes autorizadas y controladas por versiones, en lugar de cadenas dispersas y codificadas de forma rígida. Su arquitectura permite seleccionar modelos sin esfuerzo y comparar el rendimiento en paralelo, lo que permite a los equipos identificar e implementar el modelo de lenguaje extenso (LLM) más eficaz para cada tarea. Todo esto se logra sin la necesidad de reescribir el código o ajustar los procesos, lo que ahorra tiempo y esfuerzo.

Prompts.ai prioriza la seguridad y el control mediante un sólido control de acceso basado en roles (RBAC). Esto permite a las organizaciones definir permisos precisos sobre quién puede crear, modificar o implementar solicitudes en los entornos de producción. Cada interacción se registra meticulosamente con registros de auditoría y seguimiento de versiones, lo que ofrece una transparencia total. Este marco de gobierno ayuda a las empresas a cumplir con los estándares de cumplimiento y, al mismo tiempo, a mantener la visibilidad y el control de las operaciones de inteligencia artificial. Al combinar medidas de seguridad estrictas con la eficiencia operativa, la plataforma ayuda a las organizaciones a gestionar la IA de forma segura y eficaz.

La plataforma incluye una capa FinOps que rastrea el uso de los tokens, conectando directamente el gasto en IA con los resultados empresariales. Muchas organizaciones han informado de que han reducido los costes hasta en un 98% mediante la consolidación de las relaciones con los proveedores y la reducción de las suscripciones innecesarias. Gracias a las métricas de uso y rendimiento en tiempo real, los equipos pueden supervisar y optimizar los gastos de forma continua, evitando gastos inesperados al final del mes. Este nivel de transparencia financiera hace que la IA deje de ser una incertidumbre presupuestaria para convertirse en una inversión mensurable con retornos claros.

LangChain se destaca como un poderoso marco para aplicaciones de IA, con una impresionante 90 millones de descargas mensuales y más 100 000 estrellas de GitHub. Su diseño modular divide la funcionalidad en paquetes livianos, como langchain-core para abstracciones fundamentales y comunidad langchain para integraciones de terceros. Este enfoque garantiza flujos de trabajo de IA simplificados sin gastos innecesarios, lo que lo convierte en la opción ideal para gestionar tanto la complejidad como la escala.

LangChain emplea Gráfico de largo para gestionar flujos de control complejos, utilizando colas de tareas y servidores escalables horizontalmente. Esta arquitectura garantiza una ejecución duradera, lo que permite a los agentes persistir en caso de errores y reanudar las tareas sin interrupciones. Entre finales de 2024 y principios de 2025, Elipsis escaló sus operaciones para procesar 500 000 solicitudes y 80 millones de fichas diarias, a la vez que se reduce el tiempo de depuración en un 90% gracias a las capacidades de orquestación de LangChain. Del mismo modo, durante un lanzamiento viral en 2025, Meticulado logró manejar 1,5 millones de solicitudes en solo 24 horas, aprovechando las herramientas de monitoreo compatibles con Langchain.

Con más de 1000 integraciones LangChain, que abarca proveedores de modelos, bases de datos vectoriales y API, destaca por su flexibilidad. Su API de herramientas simplifica las interacciones con sistemas externos al generar automáticamente esquemas JSON, lo que permite que los modelos lingüísticos de gran tamaño se conecten sin problemas con bases de datos y CRM. La capa de observabilidad de la plataforma, Lang Smith, es independiente del marco, lo que permite a los equipos rastrear y monitorear los agentes de IA creados con cualquier base de código, no solo con las bibliotecas de LangChain. Por ejemplo, ParentLab utilizó este marco modular para permitir al personal no técnico actualizar e implementar más de 70 mensajes, ahorrando 400 horas de ingeniería.

LangSmith se adhiere a los estrictos estándares de cumplimiento, que incluyen HIPAA, SOC 2 tipo 2 y GDPR. Ofrece un seguimiento detallado de la ejecución y crea un registro de auditoría completo para la depuración y las revisiones de cumplimiento. LangGraph mejora este aspecto con funciones que permiten realizar tareas personalizadas, como la capacidad de «viajar en el tiempo» para inspeccionar, revertir y corregir en tiempo real.

Garrett Spong, director de SWE, destaca: «LangGraph sienta las bases para crear y escalar las cargas de trabajo de IA, desde agentes conversacionales y automatización de tareas complejas hasta experiencias personalizadas respaldadas por LLM que 'simplemente funcionan'».

LangSmith ofrece un nivel gratuito con 5000 rastreos al mes para depurar y supervisar. En los entornos de producción, se escala automáticamente y, al mismo tiempo, mantiene la eficiencia de la memoria y la seguridad de nivel empresarial. Por ejemplo, Gorgias llevado a cabo durante 1000 iteraciones rápidas y 500 valoraciones en un plazo de cinco meses, automatizando el 20% de sus interacciones con el servicio de atención al cliente. Lo lograron manteniendo los costos bajo control mediante un seguimiento detallado del uso. La capacidad de LangChain para escalar de manera asequible lo convierte en una herramienta esencial para las operaciones coordinadas de inteligencia artificial.

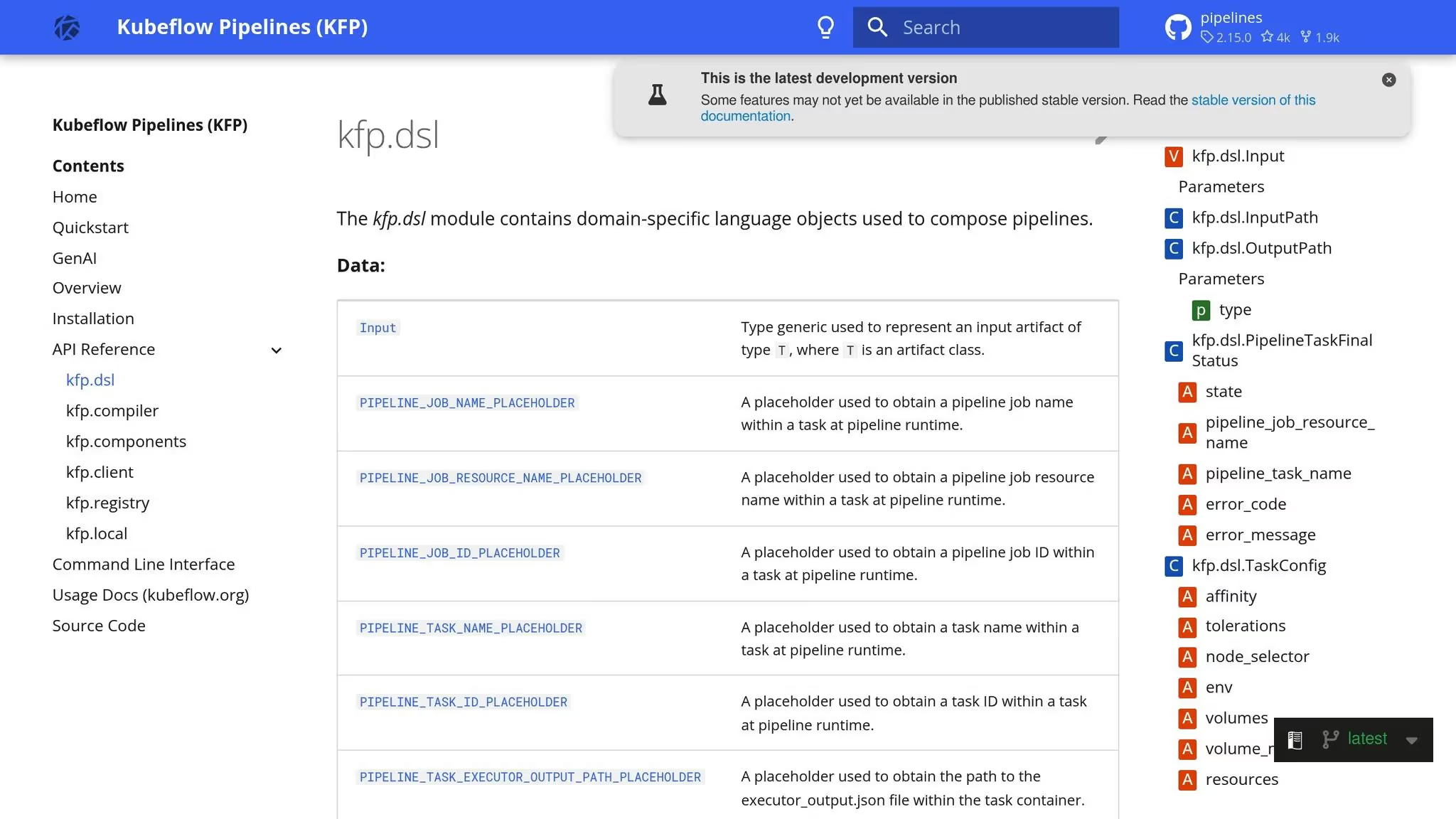

Kubeflow Pipelines (KFP) destaca por su impresionante historial: 258 millones de descargas de PyPI, 33.100 estrellas de GitHub y una próspera comunidad de más de 3000 colaboradores. Diseñada para ejecutarse de forma nativa en Kubernetes, KFP ejecuta cada paso de una canalización como un pod independiente, lo que le permite escalar dinámicamente los recursos informáticos de todo el clúster según sea necesario. Su arquitectura se basa en una estructura de gráfico acíclico dirigido (DAG), que permite la ejecución en paralelo de tareas en contenedores, a menos que se definan dependencias de datos específicas [18, 19]. Esta configuración es clave para su capacidad de gestionar flujos de trabajo complejos de manera eficiente.

KFP está diseñado para ofrecer un alto rendimiento, ya que aprovecha la ejecución en paralelo y la gestión automatizada de datos para maximizar el rendimiento [18, 19]. Los usuarios pueden definir los requisitos de recursos precisos (como la CPU, la memoria y la GPU) para cada tarea, lo que permite al programador de Kubernetes asignar los recursos de manera eficaz. Por ejemplo, las tareas computacionales más pesadas se pueden dirigir a los nodos de la GPU, mientras que las más ligeras se pueden asignar a los nodos de la CPU. Además, KFP reduce la redundancia al almacenar en caché los resultados de las tareas que no han cambiado, lo que reduce el uso innecesario de recursos informáticos [18, 19]. Algunas organizaciones han registrado aumentos de rendimiento de hasta un 300% en comparación con los métodos tradicionales de flujo de trabajo de aprendizaje automático.

KFP garantiza la flexibilidad y la portabilidad a través de su formato IR YAML, que permite que las canalizaciones se ejecuten sin problemas en los diferentes backends de KFP, desde configuraciones de código abierto hasta servicios gestionados como Google Cloud Vertex AI Pipelines. Esto significa que puedes desarrollar localmente e implementarlo a escala en la nube sin tener que volver a escribir el código. La plataforma también se integra con herramientas populares como Chispa, Rayo, y Dask para la preparación de datos, así como K Serve para la inferencia de modelos escalables. Con su SDK de Python, los científicos de datos pueden definir flujos de trabajo complejos utilizando prácticas de codificación conocidas, mientras que el backend los traduce automáticamente en operaciones de Kubernetes.

La seguridad y la gobernanza son fundamentales para KFP. Utiliza las funciones integradas de Kubernetes, como el control de acceso basado en roles (RBAC), los espacios de nombres para el aislamiento y las políticas de red, para garantizar la ejecución segura del flujo de trabajo. La plataforma rastrea los metadatos y los artefactos de forma centralizada, creando un registro de auditoría detallado para cada ejecución del proceso [8, 22]. Al ejecutar cada paso del proceso en un contenedor aislado, KFP mantiene el aislamiento de los procesos y la gestión segura de los datos. Los administradores pueden establecer límites de recursos para las tareas individuales, garantizando una distribución justa de los recursos entre los equipos y evitando su uso excesivo. En el caso de cargas de trabajo o datos confidenciales, los selectores de nodos se pueden usar para restringir las tareas a un hardware seguro y específico.

Si bien KFP en sí es de código abierto y de uso gratuito, los costos asociados con la infraestructura subyacente de Kubernetes, ya sea en AWS EKS, Google GKE o en las instalaciones, siguen siendo aplicables. Las versiones gestionadas, como Google Cloud Vertex AI Pipelines, funcionan con un modelo de precios de pago por uso [19, 20]. KFP también incluye funciones como los mecanismos de reintento en caso de fallos transitorios, que ayudan a evitar el gasto que supone reiniciar procesos de larga duración, y controladores de salida que garantizan que las tareas de limpieza se ejecuten incluso si las etapas anteriores no funcionan correctamente. Estas funciones contribuyen a un uso más eficiente de los recursos y al control de los costos.

Argo Workflows es un popular motor de ejecución de flujos de trabajo diseñado específicamente para Kubernetes, con más de 200 organizaciones que confían en él en los entornos de producción. Como solución nativa de contenedores, organiza trabajos paralelos ejecutando cada paso del flujo de trabajo en un pod aislado. Esta arquitectura permite un escalado dinámico en función de la capacidad disponible de su clúster de Kubernetes, lo que la hace especialmente eficaz para las tareas de IA que exigen una gestión flexible de los recursos.

Argo Workflows admite el escalado mediante la optimización vertical y la fragmentación. Al aumentar la --trabajadores del flujo de trabajo parámetro, puede asignar más núcleos de CPU para acelerar la reconciliación del flujo de trabajo. Para operaciones más grandes, la fragmentación se puede implementar mediante la implementación de instalaciones independientes por espacio de nombres o la ejecución de varias instancias de controlador dentro del mismo clúster mediante los ID de instancia. Para proteger el servidor de API de Kubernetes, Argo emplea un límite de velocidad por parte del cliente (predeterminado: 20 consultas por segundo con una ráfaga de 30) y limita la concurrencia de los pasos de foreach a 100 tareas. Este enfoque escalable garantiza una integración fluida con sistemas externos, incluso con grandes cargas de trabajo.

Como definición de recursos personalizados (CRD) de Kubernetes, Argo se integra a la perfección con cualquier clúster de Kubernetes y potencia importantes plataformas de IA como Kubeflow Pipelines y Netflix Metaflow, Seldon, y Kedro. Los desarrolladores pueden definir los flujos de trabajo mediante los SDK oficiales para Python (Hera), Java y Go, que ofrecen flexibilidad en la elección del idioma. Para la gestión de artefactos, Argo admite varias soluciones de almacenamiento, como AWS S3, Google Cloud Storage, Azure Blob Storage, Artifativoy Alibaba Cloud OSS. Esta compatibilidad garantiza un flujo de datos fluido en diversos entornos. Además, los flujos de trabajo pueden activarse mediante señales externas, como webhooks o cambios en el almacenamiento, utilizando Eventos Argo. Según la documentación de Metaflow, Argo Workflows es el único orquestador de producción que admite la activación de eventos a través de Eventos Argo. Esta combinación de flexibilidad y funcionalidad la convierte en una opción sólida para la automatización del flujo de trabajo.

Argo Workflows aprovecha las funciones nativas de Kubernetes para garantizar una seguridad sólida. El control de acceso basado en roles (RBAC) administra los permisos del controlador de flujo de trabajo, los usuarios y los módulos individuales. Para mejorar el aislamiento, el controlador se puede restringir a un único espacio de nombres mediante el modo «namespace-install». En los entornos de producción, Argo admite el inicio de sesión único (SSO) mediante OAuth2 y OIDC, al tiempo que protege los datos en tránsito con el cifrado TLS. Los administradores pueden imponer restricciones de flujo de trabajo, lo que permite a los usuarios enviar únicamente plantillas previamente aprobadas, y los contextos de seguridad de los pods ayudan a evitar que los pods se ejecuten como root. Las políticas de red regulan el tráfico tanto del servidor Argo como del controlador de flujo de trabajo, y un límite de profundidad de recursión predeterminado de 100 llamadas evita los bucles infinitos.

Argo Workflows es una herramienta de código abierto disponible bajo la licencia Apache 2.0, por lo que es de uso gratuito. Para gestionar los costes, emplea estrategias de TTL y de recolección de basura en módulos (PodGC) para eliminar automáticamente los flujos de trabajo finalizados y limpiar los módulos no utilizados, lo que reduce el desperdicio de recursos. Las tareas se pueden programar en una infraestructura rentable, como las instancias puntuales, mediante selectores de nodos y reglas de afinidad. Además, el uso de los recursos se monitoriza paso a paso, lo que ayuda a los usuarios a controlar los gastos. Si observa una «limitación del lado del cliente» en los registros del controlador, lo que aumenta la --qps y --ráfaga los valores pueden mejorar la eficiencia de la comunicación con la API de Kubernetes. Este diseño cuidadoso ayuda a equilibrar el rendimiento con la rentabilidad.

Apache Airflow se ha convertido en un actor clave en la gestión de los flujos de trabajo de la IA, ya que ofrece un marco flexible y basado en código para organizar operaciones complejas. Es especialmente importante en las operaciones de aprendizaje automático (MLOps), donde lo aplica el 23% de sus usuarios, y en los proyectos de IA generativa, utilizados por el 9% de su comunidad. Airflow, publicado bajo la licencia Apache 2.0, permite a los desarrolladores definir los flujos de trabajo en Python, integrándose perfectamente con cualquier biblioteca de aprendizaje automático.

El diseño modular de Airflow garantiza que pueda gestionar cargas de trabajo de cualquier tamaño. Al utilizar una cola de mensajes, admite el escalamiento ilimitado de los trabajadores, lo que permite un escalado horizontal eficiente para tareas intensivas. La plataforma proporciona tres ejecutores principales adaptados a las diferentes necesidades:

El KubernetesExecutor es especialmente útil para gestionar cargas de trabajo impredecibles que consumen muchos recursos. Funciones como el mapeo dinámico de tareas permiten escalar las tareas en función de los datos en tiempo real, lo que lo hace perfecto para grandes conjuntos de datos y flujos de trabajo multimodelo. Mientras tanto, los operadores aplazables mejoran la eficiencia al gestionar los períodos de espera prolongados, por ejemplo, supervisando la formación de modelos, sin ocupar puestos de trabajo. Este enfoque aumenta considerablemente el rendimiento y la utilización de los recursos.

La amplia interoperabilidad de Airflow garantiza que se adapte perfectamente a diversos ecosistemas de IA. Con más de 80 paquetes de proveedores versionados de forma independiente, ofrece operadores prediseñados para plataformas como IA abierta, AWS SageMaker, Azure ML y Ladrillos de datos. Su naturaleza independiente de las herramientas le permite coordinar los servicios con las API, incluidas bases de datos vectoriales como Piña, Aviamos, y Qarant, y herramientas especializadas como CoHERE y LangChain.

El API TaskFlow simplifica la creación de flujos de trabajo mediante el uso de decoradores de Python para transformar los scripts en tareas de Airflow, gestionando automáticamente las transferencias de datos a través de XCOM. Los equipos pueden dirigir las tareas a los entornos apropiados, como los pods de Kubernetes para el entrenamiento intensivo de la GPU o los clústeres de Spark para el preprocesamiento de datos. Además, la API REST y flujo de aire ctl La CLI permite una integración segura con las canalizaciones de CI/CD, lo que garantiza una gestión del flujo de trabajo fluida y auditable.

La arquitectura de Airflow prioriza la seguridad y la gobernanza. Al separar el procesador DAG del planificador, se garantiza que este no pueda acceder a código no autorizado ni ejecutarlo. El control de acceso basado en roles (RBAC) asigna funciones específicas (administrador de implementación, autor del DAG y usuario de operaciones) para limitar los permisos de manera adecuada.

Para la gobernanza de datos, Airflow se integra con Open Lineage, un estándar para rastrear el linaje de datos, que ayuda a cumplir requisitos de cumplimiento como el RGPD y la HIPAA. El flujo de aire ctl La CLI interactúa exclusivamente con la API REST, lo que evita el acceso directo a la base de datos de metadatos para mayor seguridad. Los equipos también pueden gestionar entornos reproducibles mediante tareas de configuración y desmontaje, tratando la infraestructura como un código para una mejor supervisión y coherencia.

Airflow apoya las operaciones rentables a través de servicios gestionados como COMO MAA, Google Cloud Composer, y Astrónomo, que ofrecen modelos de precios basados en el uso. Los equipos pueden asignar las tareas a los recursos adecuados, redirigiendo los flujos de trabajo de IA, que requieren un uso intensivo de recursos informáticos, a instancias de GPU y, al mismo tiempo, ejecutar operaciones más ligeras en nodos de CPU más asequibles. Los sensores diferibles reducen aún más los costos al reemplazar las versiones sincrónicas, lo que reduce el uso de recursos cuando se espera la disponibilidad de datos o API externas. Con unos costes de inferencia tan bajos como 0,40 USD por millón de tokens de entrada, la eficiente organización de Airflow es una herramienta fundamental para gestionar los presupuestos de forma eficaz.

Azure Machine Learning ofrece una solución eficaz para las necesidades empresariales de inteligencia artificial, con GPU avanzadas, redes InfiniBand, un tiempo de actividad del 99,9% y más de 100 certificaciones de cumplimiento. Con el respaldo de un equipo de 34 000 ingenieros y 15 000 expertos en seguridad, garantiza la fiabilidad y la seguridad a gran escala.

La plataforma está diseñada para gestionar cargas de trabajo de cualquier tamaño gracias a su compatibilidad con la computación distribuida entre datos, modelos y canalizaciones, lo que maximiza la eficiencia de los recursos. Los terminales en línea gestionados permiten una implementación perfecta de modelos con escalamiento automático para adaptarse a los picos de demanda. Por ejemplo, Marks & Spencer utilizó Azure ML para procesar los datos de más de 30 millones de clientes y, al mismo tiempo, aprovechó el almacenamiento en caché y los registros en proceso para reducir el tiempo y los costos de capacitación. Del mismo modo, en BRF, el aprendizaje automático automático y los procesos multifuncionales automatizados eliminaron las tareas manuales de 15 analistas, lo que les permitió centrarse en trabajos de mayor valor.

Estas funciones de escalado se integran fácilmente con el ecosistema más amplio de Azure ML y proporcionan una solución integral para la IA empresarial.

Azure Machine Learning se conecta sin problemas con herramientas como Apache Spark, Microsoft Fabric, Azure DevOps y GitHub Actions, lo que simplifica la preparación de datos y automatiza los flujos de trabajo de IA. Su catálogo de modelos incluye modelos básicos de OpenAI, Meta, Hugging Face y Cohere, lo que permite a los equipos afinar los modelos previamente entrenados en lugar de crearlos desde cero. Papinder Dosanjh, director de ciencia de datos y aprendizaje automático de ASOS, destacó la eficacia de la plataforma:

«Sin Azure AI Prompt Flow, nos habríamos visto obligados a invertir en una ingeniería personalizada bastante importante para ofrecer una solución. En cambio, pudimos lograr una gran velocidad al integrar fácilmente nuestros microservicios existentes en la solución Prompt Flow».

Azure ML también admite el entrenamiento distribuido que preserva la privacidad, como lo demostró Johan Bryssinck, de Swift, quien usó la plataforma para entrenar modelos en dispositivos periféricos locales en lugar de centralizar los datos, lo que garantiza tanto la escalabilidad como la privacidad de los datos. Su contrato de API unificado, junto con las integraciones con Azure Logic Apps y Azure Functions, mejoran aún más la conectividad con herramientas externas.

Azure Machine Learning prioriza la seguridad con funciones como Microsoft Entra ID para el control de acceso basado en roles (RBAC) y las redes virtuales para aislar los recursos y limitar el acceso a las API. Los datos están protegidos con el cifrado TLS 1.2/1.3 durante el tránsito y con el doble cifrado en reposo, con opciones de claves administradas por el cliente para un mayor control. Las defensas en tiempo real, como Prompt Shields, evitan los jailbreaks y los ataques por inyección inmediata, mientras que Customer Lockbox requiere una aprobación administrativa para que Microsoft pueda acceder a los datos de los clientes. Otras herramientas permiten rastrear las versiones de los activos, el linaje de datos y las cuotas, y Microsoft Defender for Cloud ofrece protección contra las amenazas en tiempo de ejecución.

Azure Machine Learning funciona según un modelo de precios de pago por uso, que solo cobra por los recursos informáticos, como las CPU y las GPU especializadas. Los servicios de soporte, como Blob Storage, Key Vault, Container Registry y Application Insights, también se facturan en función del uso. Los equipos pueden elegir un hardware adaptado a tareas específicas, mientras que funciones como el almacenamiento en caché por canalización reducen los cálculos redundantes. La infraestructura como código garantiza una implementación uniforme y una gestión eficiente de los recursos.

Google Vertex AI Pipelines elimina las complicaciones de la administración de la infraestructura al automatizar los flujos de trabajo de aprendizaje automático (ML). Organiza las tareas en Gráfico acíclico dirigido (DAG) de componentes en contenedores, lo que permite a los equipos centrarse en el desarrollo de modelos en lugar de en la administración de servidores.

Vertex AI Pipelines utiliza un enfoque sin servidor para gestionar las cargas de trabajo y delega las tareas de procesamiento intensivo a herramientas como BigQuery, Flujo de datosy Cloud Serverless para Apache Spark. Para los cálculos distribuidos de Python y ML, se integra perfectamente con Ray on Vertex AI.

La plataforma admite los nodos de las series A3 y A3 Mega equipados con GPU NVIDIA H100/H200. Los nodos A3 Mega, con 8 GPU H100, ofrecen una impresionante 1600 Gbps ancho de banda entre nodos. Por ejemplo, Vectra analizó 300 000 llamadas mensuales de clientes mediante la IA de Gemini y Vertex, y logró 500% aumento de la velocidad de análisis.

La rentabilidad está integrada en el almacenamiento en caché de ejecución, que reutiliza los resultados para minimizar los gastos. Los metadatos de Vertex ML garantizan la reproducibilidad al rastrear el linaje de artefactos, parámetros y métricas a escala. Este diseño escalable se integra sin esfuerzo con una variedad de herramientas, lo que lo convierte en una solución versátil para los flujos de trabajo de aprendizaje automático.

El Componentes de Google Cloud Pipeline (GCPC) El SDK simplifica la integración al ofrecer componentes prediseñados que conectan los servicios de inteligencia artificial de Vertex, como AutoML, los trabajos de formación personalizados y la implementación de modelos, directamente en las canalizaciones.

La administración de canalizaciones es flexible, con opciones como Cloud Composer (Apache Airflow administrado) y Cloud Data Fusion activadores para organizar los flujos de trabajo en todos los servicios. Conexiones nativas a BigQuery, Cloud Storage y Dataproc agilizar el procesamiento de datos, mientras que los metadatos se pueden sincronizar con Dataplex Catálogo universal para el seguimiento del linaje entre proyectos. Además, el Jardín Modelo ofrece acceso a más de 200 modelos, incluido Gemini de Google, Antrópicoes Claude y Llama de Meta.

Las definiciones de canalización se compilan en un formato YAML estandarizado, lo que garantiza la portabilidad entre repositorios como Artifact Registry.

Vertex AI Pipelines está diseñado teniendo en cuenta la gobernanza y la seguridad. Las cuentas de servicio garantizan que cada componente funcione únicamente con los permisos necesarios. Controles de servicio de VPC establezca un perímetro seguro, evitando que los datos confidenciales, como los conjuntos de datos de entrenamiento, los modelos y los resultados de predicción por lotes, salgan del límite de la red.

Para las organizaciones con necesidades de cumplimiento estrictas, la plataforma admite Claves de cifrado administradas por el cliente (CMEK) además del cifrado en reposo predeterminado de Google Cloud. Los metadatos de Vertex ML proporcionan un registro de auditoría detallado al registrar automáticamente los parámetros, los artefactos y las métricas de cada ejecución del proceso.

Las funciones de seguridad, como Model Armor, protegen contra la inyección rápida y la filtración de datos. Las canalizaciones se pueden configurar para que se ejecuten en redes de VPC interconectadas, y Cloud Logging permite a los equipos supervisar los eventos de canalización para detectar cualquier anomalía de seguridad.

Vertex AI Pipelines opera en un modelo de pago por uso, con etiquetas de facturación que se aplican automáticamente para el seguimiento de los costos mediante las exportaciones de Cloud Billing a BigQuery. El almacenamiento en caché de la ejecución reduce aún más los costos al reutilizar los resultados.

Para reducir los gastos de los trabajos de formación tolerantes a las interrupciones, las máquinas virtuales Spot están disponibles a precios reducidos. Para los compromisos de infraestructura a largo plazo, los descuentos por uso comprometido (CUD) permiten ahorrar costos y garantizar la capacidad. El Programador dinámico de cargas de trabajo (DWS) ofrece capacidad para cargas de trabajo flexibles a precios de lista más bajos, mientras que los clústeres de formación dedicados garantizan una capacidad de aceleración reservada para trabajos a gran escala.

IBM watsonx Orchestrate actúa como un centro central que coordina los agentes de IA al funcionar como supervisor, enrutador y planificador para herramientas especializadas y modelos básicos. La plataforma admite varios enfoques de orquestación: Reacciona para tareas exploratorias, Planificar-actuar para flujos de trabajo estructurados y orquestación determinista para procesos empresariales predecibles.

Diseñado para operaciones a gran escala, watsonx Orchestrate utiliza orquestación de múltiples agentes para dirigir las solicitudes de manera eficiente a las herramientas y modelos lingüísticos de gran tamaño (LLM) apropiados en tiempo real. Las organizaciones pueden optar por implementar watsonx Orchestrate como un servicio gestionado en IBM Cloud o AWS, o instalarlo localmente para alinearlo con su infraestructura existente.

La plataforma ya ha arrojado resultados mensurables. Por ejemplo, IBM resolvió El 94% de los 10 millones de solicitudes anuales de recursos humanos al instante a través de watsonx Orchestrate, lo que permite a los equipos de RRHH centrarse en tareas de mayor valor. Del mismo modo, Dun & Bradstreet redujo el tiempo de adquisición en hasta un 20% con evaluaciones de riesgo de proveedores impulsadas por la IA, lo que permite a los clientes ahorrar 10% en tiempo de evaluación.

Para permitir una implementación rápida, la plataforma incluye un sistema sin código Creador de agentes y un Kit de desarrollo de agentes (ADK) para crear herramientas personalizadas basadas en Python. Además, un catálogo con más de 100 agentes de IA específicos de un dominio y más de 400 herramientas prediseñadas ofrece componentes escalables para satisfacer diversas necesidades operativas.

Esta escalabilidad garantiza una integración fluida con los sistemas existentes, lo que la hace adaptable a una amplia gama de entornos empresariales.

La plataforma Puerta de enlace de IA facilita el enrutamiento sin problemas entre varios modelos básicos, incluidos IBM Granite, OpenAI, Anthropic, Google Gemini, Mistraly Llama, que ayudan a las organizaciones a evitar la dependencia de un solo proveedor. El kit de desarrollo de agentes permite crear herramientas personalizadas utilizando las especificaciones de OpenAPI para servicios web remotos y Python para ampliar la funcionalidad.

Integración con Langflow añade una interfaz visual de arrastrar y soltar para diseñar aplicaciones de IA, que luego se pueden importar al entorno de Orchestrate. Además, watsonx Orchestrate se conecta sin esfuerzo con sistemas empresariales como Fuerza de ventas, SAVIA, Jornada laboral, y Microsoft 365, lo que elimina la necesidad de realizar grandes cambios en la infraestructura.

Con Agente PS, la plataforma monitorea las actividades de los agentes de IA y aplica políticas en tiempo real para garantizar la confiabilidad y el cumplimiento. Las barandillas integradas y la supervisión centralizada ayudan a mantener el cumplimiento de las normas internas.

«Con AgentOps, todas las acciones se supervisan y controlan, lo que permite marcar y corregir las anomalías en tiempo real». - IBM Newsroom

IBM Guardian la integración mejora la seguridad al identificar las implementaciones de IA no autorizadas y exponer las vulnerabilidades o los errores de configuración. La plataforma también implementa control de acceso basado en funciones (RBAC), que incluye cuatro funciones principales (administrador, creador, usuario y experto en productos) para proteger la configuración del entorno. Las empresas que utilizan watsonx.governance han informado de un 30% de aumento del ROI de sus iniciativas de IA.

La plataforma ofrece precios flexibles para satisfacer las diferentes necesidades de la organización:

Para aquellos que buscan explorar la plataforma, hay un Prueba gratuita de 30 días, y las suscripciones anuales del plan Essentials vienen con un 10% de descuento si se compra antes del 31 de enero de 2026.

UiPath AI Center reúne a agentes de IA, bots de RPA y trabajadores humanos dentro de los flujos de trabajo empresariales, creando un ecosistema escalable diseñado para satisfacer las demandas de 2025. En esencia, la plataforma aprovecha UiPath Maestro como su centro de control inteligente, para gestionar procesos de larga duración en operaciones empresariales complejas.

UiPath AI Center ofrece dos opciones de implementación para adaptarse a las diferentes necesidades empresariales: Nube de automatización, que proporciona una formación elástica instantánea, y Suite de automatización, diseñado para la implementación local. Su sistema mLOps cuenta con una interfaz de arrastrar y soltar fácil de usar para implementar y monitorear modelos, lo que les permite escalar sin problemas en un número ilimitado de robots. Por ejemplo, SunExpress Airlines informó de que ahorró más de 200 000 dólares y, al mismo tiempo, redujo los atrasos en dos meses. La plataforma también garantiza la precisión de los modelos gracias a la continua capacitación continua de las personas, lo que la convierte en una herramienta poderosa para integrar la inteligencia artificial en diversos sistemas.

La plataforma adopta una estrategia de «Bring Your Own Model» (BYOM), que permite la integración con marcos de terceros como LangChain, Anthropic y Microsoft. Además, el protocolo Agent2Agent (A2A), desarrollado en colaboración con Google Cloud, facilita una comunicación fluida entre los agentes de IA en todas las plataformas empresariales.

Harrison Chase, director ejecutivo de LangChain, comentó: «Nuestra colaboración con UiPath en el protocolo de agentes garantiza que los agentes de LangGraph puedan participar sin problemas en las automatizaciones de UiPath, ampliando su alcance y permitiendo a los desarrolladores crear flujos de trabajo multiplataforma más cohesivos».

UiPath AI Center se conecta a cientos de aplicaciones SaaS a través de API estandarizadas, es compatible con BPMN 2.0 para el modelado de procesos y utiliza Decision Model and Notation (DMN) para gestionar las reglas empresariales. Un ejemplo notable es Heritage Bank, el banco de inversión más grande de Australia, que utilizó AI Center para automatizar su proceso de revisión de préstamos, mejorando la experiencia de los clientes y reduciendo las tareas administrativas manuales.

UiPath AI Center prioriza la gobernanza y la seguridad, y ofrece controles de acceso a nivel de proyecto y de inquilino para mantener la trazabilidad y el cumplimiento. Sus funciones de agencia controlada garantizan que los agentes de IA no puedan realizar acciones no autorizadas o inseguras de forma autónoma.

Brian Lucas, director sénior de automatización de Abercrombie & Fitch, señaló: «UiPath Maestro es la capa de orquestación que conecta todo (robots, agentes de IA y sistemas dentro y fuera de UiPath), lo que garantiza una coordinación perfecta entre varios procesos automatizados complejos».

El centro de comando mLOps de la plataforma proporciona una visibilidad completa del uso de los datos, las versiones de los modelos, las métricas de rendimiento y las acciones de los usuarios, lo que garantiza un registro de auditoría claro. Para las empresas que requieren el máximo control, la suite de automatización autohospedada ofrece una supervisión total de la infraestructura y la administración de datos.

UiPath AI Center emplea un modelo de licencias basado en el consumo que utiliza Unidades de IA, que miden actividades como el entrenamiento de modelos, el alojamiento y las predicciones. Se integran a la perfección en el sistema de licencias más amplio de UiPath mediante Unidades de plataforma, que cubre las necesidades de orquestación y ejecución. Para ayudar a las organizaciones a explorar sus capacidades, hay disponible una prueba gratuita de 60 días para las versiones de Automation Cloud y Automation Suite, lo que facilita la evaluación de su valor y, al mismo tiempo, mantiene los costos bajo control.

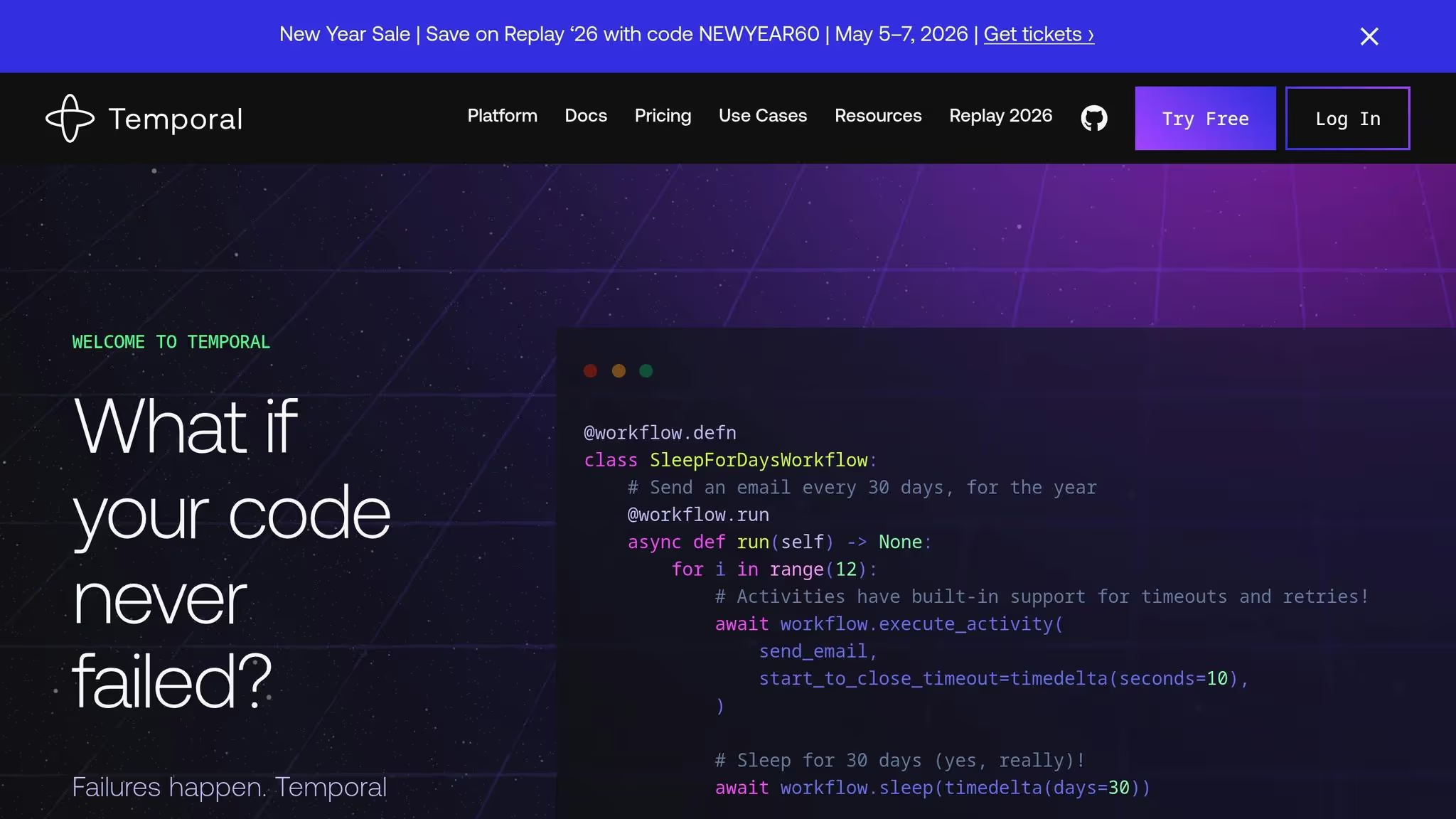

Temporal adopta un enfoque único al usar código duradero y reanudable en lugar de depender de los archivos de configuración. Captura cada paso del flujo de trabajo en un historial de eventos inmutable, lo que garantiza que los procesos puedan continuar exactamente donde se detuvieron después de una interrupción. Un buen ejemplo de esto es Replit, que hizo la transición del plano de control de su agente de codificación a Temporal, lo que mejoró significativamente la confiabilidad y la experiencia del usuario.

La arquitectura de Temporal separa el motor de orquestación de los procesos de trabajo, lo que permite que cada uno escale de forma independiente. Temporal Cloud puede gestionar más 200 millones de ejecuciones por segundo, y los flujos de trabajo en estado de espera no incurren en gastos de procesamiento. Su capacidad de recuperación a mitad del proceso elimina los costos redundantes de las API, lo que permite a los equipos de ingeniería centrarse en la lógica empresarial e implementar las funciones De 2 a 10 veces más rápido.

«Pudimos lanzar Retool Agents en cuestión de meses y ofrecer una experiencia realmente sólida desde el principio con un equipo muy pequeño... No habría sido posible sin Temporal».

- Lizzie Siegrist, directora de productos de Retool

Esta escalabilidad garantiza una integración perfecta con diversas herramientas y sistemas.

Los desarrolladores pueden escribir flujos de trabajo como código en lenguajes populares como Python, Go, Java, TypeScript, .NET y PHP. Temporal también se integra sin esfuerzo con los principales marcos de IA, como OpenAI Agents SDK, Pydantic AI, LangGraph y Crew AI. Su compatibilidad con el Model Context Protocol (MCP) mejora la fiabilidad de los agentes. La observabilidad se mejora mediante las conexiones con herramientas de monitoreo específicas para la IA, como Langfuse. Por ejemplo, Gorgias utiliza esta flexibilidad para ayudar a 15 000 marcas de comercio electrónico administre agentes de servicio al cliente impulsados por IA.

El historial de eventos de Temporal proporciona un registro de auditoría completo e inalterable de cada cambio de estado en los flujos de trabajo de IA. Esta función contribuye a la gobernanza interdisciplinaria, lo que permite pausar los flujos de trabajo para su validación externa antes de ejecutar decisiones autónomas. Esta protección es particularmente útil en los entornos de producción para evitar problemas como las alucinaciones de la LLM. En las implementaciones de nube temporal, el proveedor no puede acceder al código de la aplicación, mientras que la opción de servidor de código abierto con licencia del MIT permite a las organizaciones alojar la plataforma dentro de su propia infraestructura segura. Los ingenieros de Netflix han destacado cómo este diseño minimiza el mantenimiento y simplifica la gestión de fallos.

Temporal Cloud funciona con un modelo de pago por uso, mientras que el servidor temporal de código abierto se puede autohospedar de forma gratuita. Los nuevos usuarios pueden explorar la plataforma con 1000$ en créditos gratuitos para Temporal Cloud. Al suspender los flujos de trabajo sin consumir recursos informáticos, los usuarios pueden reducir significativamente los costos operativos y de infraestructura. El diseño de Temporal no solo mejora la eficiencia y la confiabilidad, sino que también mantiene los gastos bajo control a medida que aumentan las operaciones de inteligencia artificial.

La selección de la plataforma de orquestación de IA ideal requiere equilibrar la flexibilidad con la facilidad de uso. Las opciones de código abierto, como Apache Airflow y LangChain, ofrecen independencia del proveedor y una personalización profunda, pero exigen conocimientos técnicos avanzados y configuraciones manuales para la seguridad y la gobernanza. Por otro lado, las plataformas empresariales, como IBM watsonx Orchestrate y UiPath, incluyen funciones integradas, como el control de acceso basado en roles (RBAC), los registros de auditoría y el cumplimiento de la HIPAA, aunque conllevan tasas de licencia y una flexibilidad reducida.

Las estrategias de escalabilidad varían mucho de una plataforma a otra. Las herramientas nativas de Kubernetes, como Kubeflow y Argo Workflows, destacan por su portabilidad en contenedores, mientras que la programación basada en gráficos acíclicos dirigidos (DAG) de Apache Airflow es eficaz para gestionar dependencias complejas en configuraciones híbridas y multinube. Temporal es conocida por su alto rendimiento, mientras que Azure Machine Learning y Google Vertex AI Pipelines aprovechan sus ecosistemas de nube principales para asignar recursos de forma dinámica durante los picos de demanda. Estas variaciones ponen de relieve las ventajas y desventajas que las organizaciones deben tener en cuenta al evaluar las soluciones.

La interoperabilidad es otro factor crítico para garantizar flujos de trabajo unificados. LangChain permite a los desarrolladores conectar varios modelos de lenguaje de gran tamaño (LLM) y API sin necesidad de revisar los sistemas existentes, y Kubeflow admite marcos como PyTorch, TensorFlow y JAX en un único canal. Plataformas como Prompts.ai tienen como objetivo reducir la fragmentación unificando varios modelos, mientras que las plataformas específicas de los proveedores, como Azure Machine Learning e IBM watsonx Orchestrate, proporcionan integraciones nativas perfectas, pero pueden requerir conectores adicionales para una compatibilidad más amplia.

Las compensaciones operativas también desempeñan un papel clave en las decisiones de implementación y en el retorno de la inversión (ROI). La gobernanza y la gestión de costos son áreas en las que las plataformas difieren significativamente. Las soluciones de nivel empresarial, como IBM watsonx Orchestrate y UiPath, proporcionan paneles centralizados y funciones de seguridad sólidas, lo que las hace adecuadas para sectores regulados, como la sanidad y las finanzas. Por el contrario, las herramientas de código abierto suelen requerir una configuración manual para lograr una supervisión comparable. Desde el punto de vista de los costos, si bien Apache Airflow, LangChain y Kubeflow se pueden implementar de forma gratuita, pueden generar gastos ocultos relacionados con el tiempo y la experiencia de ingeniería. Temporal Cloud ofrece precios de pago por uso con 1000$ en créditos gratuitos, mientras que Prompts.ai reduce significativamente los costos del software de IA (hasta un 98%) gracias a su sistema de crédito TOKN unificado, que elimina las tarifas recurrentes.

La siguiente tabla proporciona una comparación detallada de cada plataforma en las dimensiones operativas clave:

La selección de la mejor plataforma de orquestación de IA depende de las capacidades técnicas, las necesidades de cumplimiento y los planes de crecimiento de su organización. Las opciones de código abierto, como Apache Airflow y LangChain, ofrecen una flexibilidad inigualable sin comisiones de licencia, lo que las convierte en la opción ideal para los equipos impulsados por desarrolladores de empresas emergentes de tecnología y de rápido crecimiento que valoran las configuraciones modulares. Sin embargo, estos marcos exigen conocimientos de ingeniería avanzados para configurar funciones críticas como la seguridad, la gobernanza y la escalabilidad. Por otro lado, las plataformas empresariales, como IBM watsonx Orchestrate, se adaptan a sectores como la sanidad y las finanzas, donde las medidas de cumplimiento integradas (como los controles de acceso basados en roles, los registros de auditoría y las certificaciones, como la HIPAA y el SOC 2) no son negociables. Estas plataformas suelen demostrar beneficios tangibles al optimizar los flujos de trabajo y vincular las funciones de gobierno con la mejora de los resultados empresariales.

Para las grandes empresas, las plataformas con gran capacidad de gobierno son esenciales, pero las empresas medianas a menudo necesitan soluciones que equilibren los costos y el rendimiento. Prompts.ai simplifica esta ecuación al integrar más de 35 modelos en una sola interfaz, lo que ofrece controles FinOps en tiempo real y créditos TOKN de pago por uso para minimizar la fragmentación de las herramientas y los gastos inesperados. Mientras tanto, las herramientas nativas de Kubernetes, como Kubeflow Pipelines y Argo Workflows, brillan cuando la portabilidad y las implementaciones de nube híbrida son fundamentales, especialmente para los equipos de ciencia de datos que gestionan procesos complejos de aprendizaje automático en sistemas distribuidos.

Como se mencionó anteriormente, la aparición de la IA agencial, en la que los agentes autónomos colaboran en un razonamiento de varios pasos, destaca la creciente importancia de una orquestación perfecta. Para citar a Domo:

«El éxito en la IA ya no consiste en tener la mayor cantidad de modelos, sino en orquestarlos de manera efectiva».

Para las organizaciones estadounidenses, es crucial elegir plataformas que se ajusten a su madurez técnica actual y, al mismo tiempo, que ofrezcan espacio para escalar a medida que la IA se integre más en todos los departamentos. Un punto de partida inteligente es un proyecto piloto centrado en un flujo de trabajo específico, en el que se hace un seguimiento de las entradas, las salidas y los errores a fin de establecer una base de observabilidad para una futura ampliación. La plataforma de orquestación adecuada hace más que simplemente conectar las herramientas de inteligencia artificial: redefine la forma en que los equipos colaboran, resuelven problemas y crean valor a mayor escala.

Las plataformas de orquestación de IA simplifican los flujos de trabajo complejos al reunir varios modelos, fuentes de datos y procesos de IA en un solo sistema automatizado. Gestionan tareas como la programación, la distribución de recursos y la integración de API, lo que minimiza el esfuerzo manual y reduce significativamente el tiempo de desarrollo y los gastos operativos.

Estas plataformas están diseñadas para escalarse sin esfuerzo, lo que permite a las empresas pasar de gestionar un puñado de tareas a gestionar miles sin tener que revisar su infraestructura. Se destacan por procesar grandes volúmenes de datos, hacer que el uso de los recursos sea más eficiente y mantener una supervisión constante. Esto se traduce en despliegues más rápidos, una productividad mejorada y soluciones de inteligencia artificial mejor equipadas para satisfacer las necesidades dinámicas de las empresas.

Las plataformas de orquestación de IA suelen gestionar los gastos mediante modelos de precios basados en el uso, lo que permite a las empresas pagar solo por lo que utilizan en lugar de comprometerse con licencias fijas. Muchas de estas plataformas vienen equipadas con herramientas financieras en tiempo real, incluidos paneles para monitorear los gastos por modelo o flujo de trabajo, sistemas de alertas presupuestarias y etiquetado de cargas de trabajo para un análisis detallado de los costos. Estas herramientas garantizan que las empresas tengan una visión clara de sus gastos relacionados con la IA y mantengan el control sobre sus presupuestos.

Qué conjuntos prompts.ai aparte es su interfaz intuitiva combinada con las funciones integradas de seguimiento de costes, que pueden reducir los gastos de IA hasta 98%. Planes de suscripción, que van desde 99 a 129 USD por usuario al mes, ofrecen un monitoreo en tiempo real del uso de los tokens y los precios específicos del modelo, lo que permite a los equipos gestionar los costos de manera proactiva. A diferencia de otras plataformas que dependen de las integraciones de facturación en la nube o de las exportaciones de uso manual, lo que a menudo provoca retrasos y requiere un esfuerzo de ingeniería adicional, prompts.ai ofrece una visibilidad inmediata de los costos, lo que ahorra tiempo y recursos.

Prompts.ai está estableciendo el estándar para la orquestación segura de la IA en 2025, ofreciendo a las empresas una plataforma fiable para escalar sus operaciones de IA sin esfuerzo. Su panel de control unificado está diseñado para simplificar la administración e incluye herramientas de gobierno integradas, un seguimiento de los costos en tiempo real y registros de auditoría inmutables. Estas funciones garantizan que las empresas cumplan con las normas y, al mismo tiempo, mantengan una supervisión completa de sus flujos de trabajo de inteligencia artificial.

Equipado con medidas de seguridad de nivel empresarial, como el control de acceso basado en roles, el cifrado de extremo a extremo y la supervisión continua del cumplimiento, Prompts.ai protege los datos confidenciales en cada etapa de la operación. Gracias a la integración de más de 35 de los principales programas de aprendizaje en línea en un único marco seguro, reduce los riesgos y permite a las empresas ampliar sus capacidades de inteligencia artificial con confianza y eficiencia.