تنسيق الذكاء الاصطناعي هو المفتاح لتوسيع نطاق عمليات الذكاء الاصطناعي للمؤسسات. مع فشل 95٪ من برامج الذكاء الاصطناعي التجريبية بسبب ضعف التنسيق، تحتاج الشركات إلى أدوات لتوحيد وأتمتة وإدارة تدفقات عمل الذكاء الاصطناعي المعقدة. يقدم مشهد عام 2025 منصات تدمج نماذج متعددة، وتؤمن سير العمل، وتحسن التكاليف، وتوفر ما يصل إلى عائد استثمار أعلى بنسبة 60% للمتبنين.

فيما يلي تفصيل سريع لأفضل الحلول:

توفر كل منصة نقاط قوة فريدة في قابلية التوسع وقابلية التشغيل البيني والحوكمة وإدارة التكاليف. سواء كنت بحاجة إلى مرونة المصدر المفتوح أو الامتثال على مستوى المؤسسة، يمكن لهذه الأدوات تحويل أنظمة الذكاء الاصطناعي المجزأة إلى أنظمة بيئية موحدة وقابلة للتطوير.

اختر النظام الأساسي المناسب لتوسيع نطاق مبادرات الذكاء الاصطناعي الخاصة بك وتحسين التنسيق وزيادة عائد الاستثمار.

مقارنة منصات تنسيق الذكاء الاصطناعي: قابلية التوسع وقابلية التشغيل البيني والحوكمة والتكلفة

Prompts.ai عبارة عن منصة مؤسسية متطورة مصممة لتبسيط عمليات الذكاء الاصطناعي وتبسيطها. فهو يجمع أكثر من 35 نموذجًا للغات الكبيرة من الدرجة الأولى - بما في ذلك GPT-5 وكلود ولاما وجيميني وغروك-4 وفلوكس برو وكلينج - في واجهة واحدة آمنة وموحدة. من خلال الوصول المركزي إلى هذه النماذج، تقضي المنصة على فوضى إدارة الأدوات المتعددة، مما يساعد المؤسسات على توسيع نطاق جهود الذكاء الاصطناعي الخاصة بها بسهولة.

تعمل Prompts.ai على نظام مرن للدفع أولاً بأول باستخدام أرصدة TOKN، مما يلغي الحاجة إلى الرسوم المتكررة. يسمح هذا الأسلوب للفرق بإضافة النماذج أو المستخدمين أو عمليات سير العمل بسرعة دون عبء البنية التحتية الإضافية. تعمل الواجهة الموحدة للمنصة كمركز قيادة، حيث تقوم بتنسيق المهام وتخصيص الموارد بكفاءة عبر جميع النماذج المتكاملة. يضمن هذا التصميم القابل للتطوير تكاملًا سلسًا عبر النماذج، ويدعم الشركات مع نمو احتياجات الذكاء الاصطناعي الخاصة بها.

كمحور مركزي، يضمن Prompts.ai أن جميع العمليات التي تعتمد على الذكاء الاصطناعي تعتمد على قوالب المطالبة المعتمدة والتي يتم التحكم فيها بالإصدار بدلاً من السلاسل المتناثرة والمشفرة. تتيح بنيتها اختيار النماذج بسهولة ومقارنات الأداء جنبًا إلى جنب، مما يمكّن الفرق من تحديد ونشر نموذج اللغة الكبيرة الأكثر فعالية (LLM) لكل مهمة. يتم تحقيق كل هذا دون الحاجة إلى إعادة كتابة التعليمات البرمجية أو ضبط خطوط الأنابيب، مما يوفر الوقت والجهد.

يعطي Prompts.ai الأولوية للأمان والتحكم من خلال التحكم القوي في الوصول المستند إلى الأدوار (RBAC). يتيح ذلك للمؤسسات تحديد الأذونات الدقيقة لمن يمكنه إنشاء المطالبات أو تعديلها أو نشرها في بيئات الإنتاج. يتم تسجيل كل تفاعل بدقة من خلال مسارات التدقيق وتتبع الإصدار، مما يوفر الشفافية الكاملة. يساعد إطار الحوكمة هذا الشركات على تلبية معايير الامتثال مع الحفاظ على الرؤية والتحكم في عمليات الذكاء الاصطناعي. من خلال الجمع بين الإجراءات الأمنية الصارمة والكفاءة التشغيلية، تساعد المنصة المؤسسات على إدارة الذكاء الاصطناعي بأمان وفعالية.

تتضمن المنصة طبقة FinOps التي تتعقب استخدام الرموز، وتربط بشكل مباشر إنفاق الذكاء الاصطناعي بنتائج الأعمال. أبلغت العديد من المؤسسات عن خفض التكاليف بنسبة تصل إلى 98٪ من خلال توحيد علاقات البائعين وخفض الاشتراكات غير الضرورية. من خلال مقاييس الاستخدام والأداء في الوقت الفعلي، يمكن للفرق مراقبة الإنفاق وتحسينه باستمرار، وتجنب النفقات غير المتوقعة في نهاية الشهر. هذا المستوى من الشفافية المالية يحول الذكاء الاصطناعي من حالة عدم اليقين المتعلقة بالميزانية إلى استثمار قابل للقياس بعوائد واضحة.

تبرز LangChain كإطار قوي لتطبيقات الذكاء الاصطناعي، بشكل مثير للإعجاب 90 مليون عملية تنزيل شهرية وأكثر 100 ألف نجمة على جيت هاب. يعمل تصميمه المعياري على تقسيم الوظائف إلى حزم خفيفة الوزن، مثل نواة اللانج تشين للتجريدات التأسيسية و مجتمع لانجتشين لعمليات تكامل الطرف الثالث. يضمن هذا النهج سير عمل الذكاء الاصطناعي المبسط دون أعباء غير ضرورية، مما يجعله خيارًا مثاليًا لإدارة كل من التعقيد والحجم.

توظف لانج تشين لانغ غراف للتعامل مع تدفقات التحكم المعقدة، باستخدام خوادم قابلة للتطوير أفقيًا وقوائم انتظار المهام. تضمن هذه البنية التنفيذ الدائم، مما يسمح للوكلاء بالاستمرار في حالات الفشل واستئناف المهام دون انقطاع. بين أواخر عام 2024 وأوائل عام 2025، إيليبسيس وسّعت نطاق عملياتها لتنتهي من المعالجة 500,000 طلب و 80 مليون رمز يومي، كل ذلك مع تقليل وقت تصحيح الأخطاء بنسبة 90٪ بفضل إمكانات تنسيق LangChain. وبالمثل، خلال الإطلاق الفيروسي في عام 2025، قم بالدقة تمكنت من التعامل 1.5 مليون طلب في غضون 24 ساعة فقط، مع الاستفادة من أدوات المراقبة المتوافقة مع LangChain.

مع أكثر من 1,000 عملية تكامل تتفوق LangChain في المرونة عبر موفري النماذج وقواعد البيانات المتجهة وواجهات برمجة التطبيقات. تعمل واجهة برمجة تطبيقات الأدوات الخاصة بها على تبسيط التفاعلات مع الأنظمة الخارجية عن طريق إنشاء مخططات JSON تلقائيًا، مما يتيح لنماذج اللغات الكبيرة الاتصال بسلاسة بقواعد البيانات وأنظمة إدارة علاقات العملاء. طبقة قابلية الملاحظة للمنصة، لانج سميث، محايد من حيث الإطار، مما يسمح للفرق بتتبع ومراقبة وكلاء الذكاء الاصطناعي الذين تم إنشاؤهم باستخدام أي قاعدة بيانات - وليس فقط مكتبات LangChain. على سبيل المثال، مختبر الوالدين استخدم هذا الإطار المعياري لتمكين الموظفين غير التقنيين من التحديث والنشر لأكثر من 70 مطالبة، التوفير 400 ساعة هندسية.

تلتزم LangSmith بمعايير الامتثال الصارمة، بما في ذلك HIPAA و SOC 2 من النوع 2 واللائحة العامة لحماية البيانات. يوفر تتبعًا تفصيليًا للتنفيذ، مما يؤدي إلى إنشاء مسار تدقيق شامل لمراجعة التصحيح والامتثال. يعمل LangGraph على تحسين ذلك بميزات الإنسان في الحلقة، بما في ذلك إمكانات «السفر عبر الزمن» للفحص والتراجع والتصحيح في الوقت الفعلي.

يسلط غاريت سبونج، مدير SWE، الضوء على ما يلي: «يضع LangGraph الأساس لكيفية بناء أحمال عمل الذكاء الاصطناعي وتوسيع نطاقها - بدءًا من وكلاء المحادثة وأتمتة المهام المعقدة وحتى التجارب المخصصة المدعومة بتقنية LLM والتي «تعمل فقط».

يوفر لانغ سميث فئة مجانية مع 5,000 أثر شهريًا لتصحيح الأخطاء والمراقبة. وفي بيئات الإنتاج، يتم تطويرها تلقائيًا مع الحفاظ على كفاءة الذاكرة والأمان على مستوى المؤسسات. على سبيل المثال، جورجياس أجريت أكثر من 1,000 تكرار سريع و 500 تقييم في غضون خمسة أشهر، تعمل على تشغيل 20% من تفاعلات دعم العملاء تلقائيًا. لقد حققوا ذلك مع الحفاظ على التكاليف تحت السيطرة من خلال تتبع الاستخدام التفصيلي. إن قدرة LangChain على التوسع بتكلفة معقولة تجعلها أداة أساسية لعمليات الذكاء الاصطناعي المنسقة.

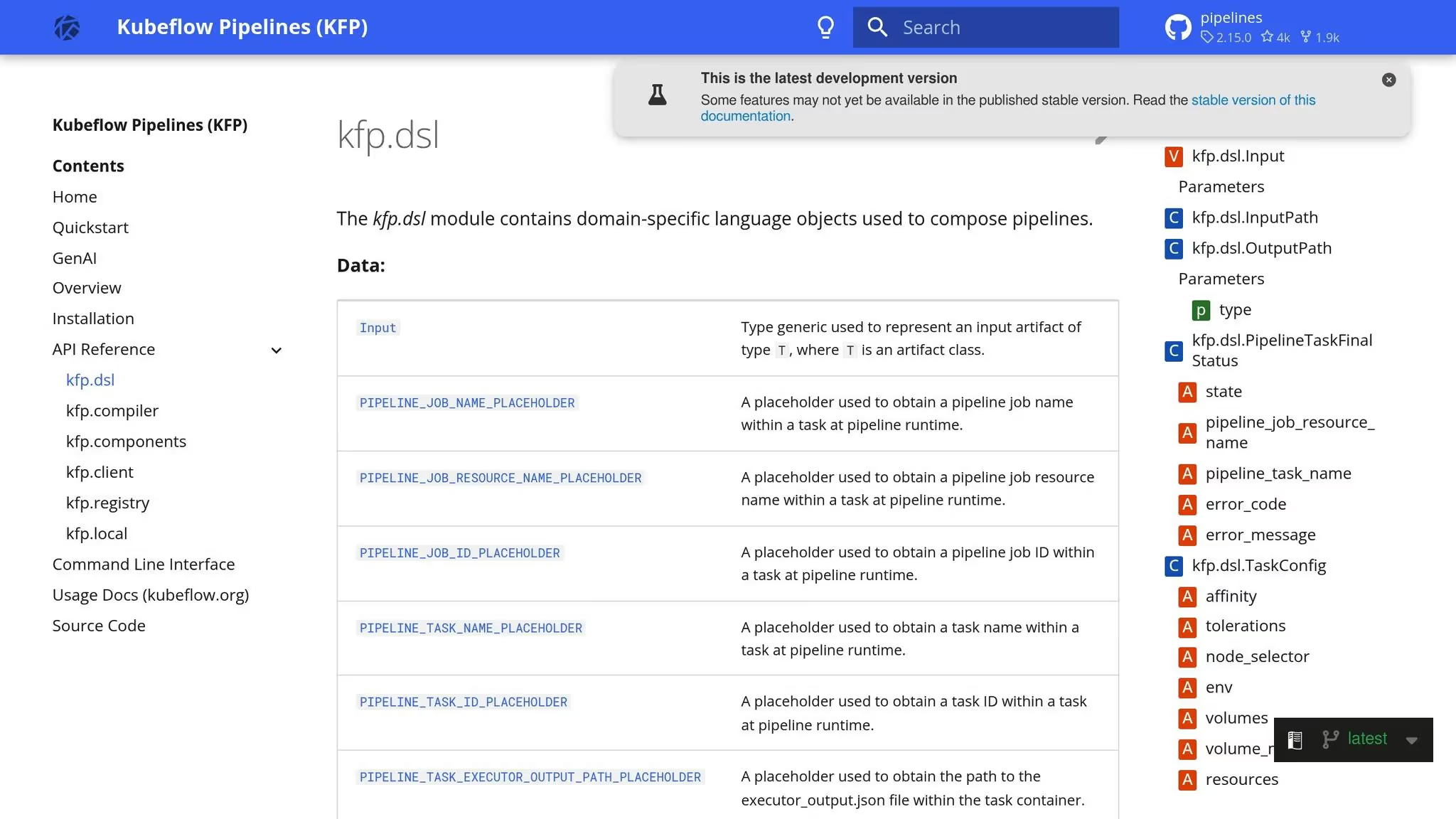

تتميز Kubeflow Pipelines (KFP) بسجل حافل: 258 مليون عملية تنزيل لـ PyPI، و 33100 من نجوم GitHub، ومجتمع مزدهر يضم أكثر من 3000 مساهم. تم تصميم KFP للتشغيل محليًا على Kubernetes، ويقوم بتنفيذ كل خطوة من خطوات خط الأنابيب كجراب منفصل، مما يسمح له بتوسيع موارد الحوسبة ديناميكيًا عبر مجموعتك حسب الحاجة. تعتمد بنيتها على بنية الرسم البياني غير الدوري الموجه (DAG)، مما يتيح التنفيذ المتوازي للمهام الحاوية ما لم يتم تحديد تبعيات بيانات محددة [18، 19]. يعد هذا الإعداد مفتاحًا لقدرته على التعامل مع عمليات سير العمل المعقدة بكفاءة.

تم تصميم KFP لتحقيق الأداء العالي، والاستفادة من التنفيذ المتوازي وإدارة البيانات الآلية لزيادة الإنتاجية [18، 19]. يمكن للمستخدمين تحديد متطلبات الموارد الدقيقة - مثل وحدة المعالجة المركزية والذاكرة ووحدة معالجة الرسومات - لكل مهمة، مما يسمح لجدولة Kubernetes بتخصيص الموارد بفعالية. على سبيل المثال، يمكن توجيه المهام الحسابية الثقيلة إلى عقد GPU، بينما يتم تخصيص المهام الأخف إلى عقد وحدة المعالجة المركزية. بالإضافة إلى ذلك، يقلل KFP من التكرار عن طريق التخزين المؤقت للنتائج للمهام التي لم تتغير، مما يقلل من استخدام الحوسبة غير الضرورية [18، 19]. سجلت بعض المؤسسات مكاسب في الأداء تصل إلى 300% عند مقارنتها بأساليب سير عمل التعلم الآلي التقليدية.

تضمن KFP المرونة وقابلية النقل من خلال تنسيق IR YAML الخاص به، والذي يسمح لخطوط الأنابيب بالعمل بسلاسة عبر خلفيات KFP المختلفة، من الإعدادات مفتوحة المصدر إلى الخدمات المُدارة مثل خطوط أنابيب Google Cloud Vertex AI. هذا يعني أنه يمكنك التطوير محليًا والنشر على نطاق واسع في السحابة دون إعادة كتابة التعليمات البرمجية. تتكامل المنصة أيضًا مع الأدوات الشائعة مثل سبارك، شعاع، و داسك لإعداد البيانات، وكذلك خدمة للاستدلال النموذجي القابل للتطوير. باستخدام Python SDK، يمكن لعلماء البيانات تحديد عمليات سير العمل المعقدة باستخدام ممارسات الترميز المألوفة، بينما تقوم الواجهة الخلفية تلقائيًا بترجمتها إلى عمليات Kubernetes.

الأمن والحوكمة جزء لا يتجزأ من KFP. يستخدم ميزات Kubernetes المضمنة، مثل التحكم في الوصول المستند إلى الأدوار (RBAC)، ومساحات الأسماء للعزل، وسياسات الشبكة، لضمان التنفيذ الآمن لسير العمل. تتعقب المنصة البيانات الوصفية والتحف مركزيًا، مما يؤدي إلى إنشاء مسار تدقيق مفصل لكل خط أنابيب [8، 22]. من خلال تشغيل كل خطوة من خطوات خط الأنابيب في حاوية معزولة، تحافظ KFP على عزل العمليات والتعامل الآمن مع البيانات. يتمتع المسؤولون بالقدرة على تعيين حدود الموارد للمهام الفردية، مما يضمن التوزيع العادل للموارد عبر الفرق ويمنع الإفراط في الاستخدام. بالنسبة للبيانات الحساسة أو أحمال العمل، يمكن استخدام محددات العقدة لتقييد المهام على أجهزة محددة وآمنة.

في حين أن KFP نفسها مفتوحة المصدر ومجانية الاستخدام، إلا أن التكاليف المرتبطة بالبنية التحتية الأساسية لـ Kubernetes - سواء على AWS EKS أو Google GKE أو المحلية - لا تزال سارية. تعمل الإصدارات المُدارة، مثل خطوط أنابيب Google Cloud Vertex AI، على نموذج تسعير الدفع أولاً بأول [19، 20]. يتضمن KFP أيضًا ميزات مثل آليات إعادة المحاولة للفشل العابر، والتي تساعد على تجنب تكلفة إعادة تشغيل خطوط الأنابيب طويلة المدى، ومعالجات الخروج التي تضمن تنفيذ مهام التنظيف حتى في حالة فشل الخطوات السابقة. تساهم هذه الميزات في زيادة كفاءة استخدام الموارد والتحكم في التكلفة.

Argo Workflawks هو محرك شائع لتنفيذ سير العمل مصمم خصيصًا لـ Kubernetes، حيث تعتمد عليه أكثر من 200 منظمة في بيئات الإنتاج. وكحل أصلي للحاوية، فإنه ينظم المهام المتوازية من خلال تشغيل كل خطوة من خطوات سير العمل في جراب معزول. تتيح هذه البنية التوسع الديناميكي استنادًا إلى السعة المتاحة لمجموعة Kubernetes الخاصة بك، مما يجعلها فعالة بشكل خاص لمهام الذكاء الاصطناعي التي تتطلب إدارة مرنة للموارد.

تدعم Argo Workflow التوسع من خلال التحسين الرأسي والتقسيم. من خلال زيادة -- عمال سير العمل المعلمة، يمكنك تخصيص المزيد من أنوية وحدة المعالجة المركزية لتسريع تسوية سير العمل. بالنسبة للعمليات الكبيرة، يمكن تنفيذ التقسيم عن طريق نشر عمليات تثبيت منفصلة لكل مساحة اسم أو تشغيل مثيلات وحدة تحكم متعددة داخل نفس المجموعة باستخدام معرفات المثيل. لحماية خادم Kubernetes API، تستخدم Argo تحديد المعدل من جانب العميل (الافتراضي: 20 استعلامًا في الثانية مع دفعة من 30) وتحد من تزامن خطوات foreach عند 100 مهمة. يضمن هذا النهج القابل للتطوير التكامل السلس مع الأنظمة الخارجية، حتى في ظل أعباء العمل الثقيلة.

بصفته تعريفًا مخصصًا للموارد (CRD) من Kubernetes، يتكامل Argo بسلاسة مع أي مجموعة Kubernetes ويعمل على تشغيل منصات الذكاء الاصطناعي البارزة مثل Kubeflow Pipelines و Netflix ميتافلو، سيلدون، و كيدرو. يمكن للمطورين تحديد عمليات سير العمل باستخدام حزم SDK الرسمية لـ Python (هيرا) و Java و Go، مما يوفر المرونة في اختيار اللغة. بالنسبة لإدارة القطع الأثرية، تدعم Argo العديد من حلول التخزين، بما في ذلك AWS S3 و Google Cloud Storage و Azure Blob Storage قطعة أثرية، وشركة علي بابا كلاود أو إس. يضمن هذا التوافق التدفق السلس للبيانات عبر البيئات المتنوعة. بالإضافة إلى ذلك، يمكن تشغيل عمليات سير العمل من خلال إشارات خارجية مثل webhooks أو تغييرات التخزين باستخدام أحداث آرغو. وفقًا لوثائق Metaflow، فإن Argo Workflows هو منظم الإنتاج الوحيد الذي يدعم تشغيل الأحداث من خلال أحداث آرغو. هذا المزيج من المرونة والوظائف يجعله خيارًا قويًا لأتمتة سير العمل.

تستفيد Argo Workflowks من ميزات Kubernetes الأصلية لضمان الأمان القوي. يقوم التحكم في الوصول المستند إلى الأدوار (RBAC) بإدارة الأذونات لوحدة التحكم في سير العمل والمستخدمين والبودات الفردية. لتعزيز العزل، يمكن أن تقتصر وحدة التحكم على مساحة اسم واحدة باستخدام وضع «namespace-install». في بيئات الإنتاج، تدعم Argo تسجيل الدخول الأحادي (SSO) عبر OAuth2 وOIDC، مع تأمين البيانات أثناء النقل باستخدام تشفير TLS. يمكن للمسؤولين فرض قيود سير العمل، مما يسمح للمستخدمين بإرسال النماذج المعتمدة مسبقًا فقط، وتساعد سياقات أمان Pod على منع تشغيل البودات كجذر. تعمل سياسات الشبكة على تنظيم حركة المرور لكل من Argo Server و Workflow Controller، كما أن حد عمق التكرار الافتراضي البالغ 100 مكالمة يمنع الحلقات اللانهائية.

Argo Workflow هي أداة مفتوحة المصدر متاحة بموجب ترخيص Apache 2.0، مما يجعلها مجانية للاستخدام. لإدارة التكاليف، تستخدم استراتيجيات TTL ومجموعة Pod Garbage Collection (PoDGC) لحذف عمليات سير العمل المكتملة تلقائيًا وتنظيف الكبسولات غير المستخدمة، مما يقلل من هدر الموارد. يمكن جدولة المهام على بنية أساسية فعالة من حيث التكلفة، مثل مثيلات Spot، باستخدام محددات العقدة وقواعد التقارب. بالإضافة إلى ذلك، يتم تتبع استخدام الموارد في كل خطوة، مما يساعد المستخدمين على مراقبة الإنفاق. إذا لاحظت «اختناقًا من جانب العميل» في سجلات وحدة التحكم، فقم بزيادة --تطبيقات و --انفجار يمكن للقيم تحسين كفاءة الاتصال باستخدام Kubernetes API. يساعد هذا التصميم المدروس على تحقيق التوازن بين الأداء والفعالية من حيث التكلفة.

أصبح Apache Airflow لاعبًا رئيسيًا في إدارة تدفقات عمل الذكاء الاصطناعي، حيث يقدم إطارًا مرنًا قائمًا على التعليمات البرمجية لتنظيم العمليات المعقدة. وهي بارزة بشكل خاص في عمليات التعلم الآلي (MLOPs)، حيث يطبقها 23٪ من مستخدميها، وفي مشاريع الذكاء الاصطناعي التوليدية، التي يستخدمها 9٪ من مجتمعها. تم إصدار Airflow بموجب ترخيص Apache 2.0، وهو يسمح للمطورين بتحديد سير العمل في Python، والتكامل بسلاسة مع أي مكتبة للتعلم الآلي.

يضمن التصميم المعياري لـ Airflow قدرته على التعامل مع أعباء العمل من أي حجم. وباستخدام قائمة انتظار الرسائل، فإنها تدعم التحجيم غير المحدود للعمال، مما يتيح التحجيم الأفقي الفعال للمهام المكثفة. توفر المنصة ثلاثة منفذين رئيسيين مصممين لتلبية الاحتياجات المختلفة:

يعد KubernetExecutor مفيدًا بشكل خاص للتعامل مع أعباء العمل غير المتوقعة والثقيلة بالموارد. تسمح ميزات مثل تعيين المهام الديناميكي للمهام بالتوسع بناءً على بيانات الوقت الفعلي، مما يجعلها مثالية لمجموعات البيانات الكبيرة وعمليات سير العمل متعددة النماذج. وفي الوقت نفسه، يعمل المشغلون المؤجلون على تعزيز الكفاءة من خلال إدارة حالات الانتظار الطويلة، مثل مراقبة التدريب النموذجي، دون شغل أماكن عمل. يعزز هذا النهج بشكل كبير الإنتاجية واستخدام الموارد.

تضمن قابلية التشغيل البيني الواسعة لـ Airflow أنها تتناسب بسلاسة مع أنظمة الذكاء الاصطناعي المتنوعة. مع أكثر من 80 حزمة مزود تم إصدارها بشكل مستقل، فإنها توفر مشغلين تم تصميمهم مسبقًا لمنصات مثل أوبن إيه آي، AWS إيج ميكر، أزور إم إل، و قواعد البيانات. تسمح طبيعتها الحيادية للأدوات بتنسيق الخدمات مع واجهات برمجة التطبيقات، بما في ذلك قواعد بيانات المتجهات مثل كوز الصنوبر، ويفاييت، و أمر، والأدوات المتخصصة مثل كوهير ولانج تشين.

ال واجهة برمجة تطبيقات تاسكفلو يبسط إنشاء سير العمل باستخدام أدوات تزيين Python لتحويل البرامج النصية إلى مهام Airflow، وإدارة عمليات نقل البيانات تلقائيًا من خلال XComs. يمكن للفرق توجيه المهام إلى البيئات المناسبة، مثل كبسولات Kubernetes للتدريب المكثف على وحدة معالجة الرسومات أو مجموعات Spark للمعالجة المسبقة للبيانات. بالإضافة إلى ذلك، فإن واجهة برمجة تطبيقات REST و تدفق الهواء ctl تتيح CLI التكامل الآمن مع خطوط أنابيب CI/CD، مما يضمن إدارة سير العمل بسلاسة وقابلية للتدقيق.

تعطي بنية Airflow الأولوية للأمان والحوكمة. من خلال فصل معالج DAG عن المجدول، فإنه يضمن أن المجدول لا يمكنه الوصول إلى التعليمات البرمجية غير المصرح بها أو تنفيذها. يقوم التحكم في الوصول المستند إلى الأدوار (RBAC) بتعيين أدوار محددة - مدير النشر ومؤلف DAG ومستخدم العمليات - لتقييد الأذونات بشكل مناسب.

لحوكمة البيانات، يتكامل Airflow مع أوبن لينياج، وهو معيار لتتبع نسب البيانات، مما يساعد على تلبية متطلبات الامتثال مثل GDPR و HIPAA. ال تدفق الهواء ctl يتفاعل CLI حصريًا مع REST API، ويتجنب الوصول المباشر إلى قاعدة بيانات البيانات الوصفية لمزيد من الأمان. يمكن للفرق أيضًا إدارة البيئات القابلة للتكرار باستخدام مهام الإعداد والتفكيك، والتعامل مع البنية التحتية ككود لتحسين الإشراف والاتساق.

يدعم Airflow العمليات الفعالة من حيث التكلفة من خلال الخدمات المُدارة مثل أوس ماوا، غوغل كلاود كومبوسر، و عالم الفلك، التي تقدم نماذج تسعير قائمة على الاستخدام. يمكن للفرق تخصيص المهام للموارد المناسبة - توجيه تدفقات عمل الذكاء الاصطناعي كثيفة الحوسبة إلى مثيلات GPU أثناء تشغيل عمليات أخف على عقد وحدة المعالجة المركزية (CPU) ذات الأسعار المعقولة. تعمل المستشعرات القابلة للتأجيل على خفض التكاليف عن طريق استبدال الإصدارات المتزامنة، مما يقلل من استخدام الموارد عند انتظار واجهات برمجة التطبيقات الخارجية أو توفر البيانات. نظرًا لتكاليف الاستدلال التي تصل إلى 0.40 دولارًا لكل مليون رمز إدخال، فإن التنسيق الفعال لـ Airflow يعد أداة مهمة لإدارة الميزانيات بفعالية.

تقدم Azure Machine Learning حلاً قويًا لاحتياجات الذكاء الاصطناعي للمؤسسات، حيث تتميز بوحدات معالجة الرسومات المتقدمة وشبكات InfiniBand ووقت تشغيل بنسبة 99.9٪ وأكثر من 100 شهادة امتثال. وبدعم من فريق مكون من 34,000 مهندس و 15,000 خبير أمني، فإنه يضمن الموثوقية والأمان على نطاق واسع.

تم تصميم المنصة للتعامل مع أعباء العمل من أي حجم من خلال دعمها للحوسبة الموزعة عبر البيانات والنماذج وخطوط الأنابيب، مما يزيد من كفاءة الموارد. تتيح نقاط النهاية المُدارة عبر الإنترنت النشر السلس للنموذج مع القياس التلقائي لاستيعاب الزيادات في الطلب. على سبيل المثال، استخدمت Marks & Spencer Azure ML لمعالجة البيانات لأكثر من 30 مليون عميل مع الاستفادة من التخزين المؤقت لخطوط الأنابيب والسجلات لتقليل وقت التدريب وتكاليفه. وبالمثل، في BRF، ألغت ML الآلية و MLOPs المهام اليدوية لـ 15 محللًا، مما سمح لهم بالتركيز على العمل ذي القيمة الأعلى.

تتكامل ميزات التوسع هذه بسهولة مع النظام البيئي الأوسع لـ Azure ML، مما يوفر حلاً شاملاً للذكاء الاصطناعي للمؤسسات.

ويتصل التعلم الآلي من Azure بسلاسة بأدوات مثل Apache Spark وMicrosoft Fabric وAzure DevOps وGitHub Actions، مما يعمل على تبسيط عملية إعداد البيانات وأتمتة عمليات سير عمل الذكاء الاصطناعي. يتضمن كتالوج النماذج الخاص بها نماذج أساسية من OpenAI و Meta و Hugging Face و Cohere، مما يمكّن الفرق من ضبط النماذج المدربة مسبقًا بدلاً من بنائها من الصفر. سلط Papinder Dosanjh، رئيس علوم البيانات والتعلم الآلي في ASOS، الضوء على كفاءة المنصة:

«بدون التدفق الفوري لـ Azure AI، كنا سنضطر إلى الاستثمار في هندسة مخصصة مهمة جدًا لتقديم حل. وبدلاً من ذلك، تمكنا من تحقيق سرعة كبيرة من خلال دمج خدماتنا المصغرة الحالية بسهولة في حل التدفق الفوري».

يدعم Azure ML أيضًا التدريب الموزع الذي يحافظ على الخصوصية، كما أوضح يوهان بريسينك من Swift، الذي استخدم المنصة لتدريب النماذج على الأجهزة المتطورة المحلية بدلاً من تركيز البيانات، مما يضمن قابلية التوسع وخصوصية البيانات. يعمل عقد API الموحد الخاص به، جنبًا إلى جنب مع عمليات الدمج مع تطبيقات Azure Logic ووظائف Azure، على تعزيز الاتصال بالأدوات الخارجية.

يعطي Azure Machine Learning الأولوية للأمان من خلال ميزات مثل Microsoft Entra ID للتحكم في الوصول المستند إلى الأدوار (RBAC) والشبكات الافتراضية لعزل الموارد وتقييد الوصول إلى API. يتم حماية البيانات باستخدام تشفير TLS 1.2/1.3 أثناء النقل والتشفير المزدوج في حالة السكون، مع خيارات المفاتيح التي يديرها العميل لمزيد من التحكم. تعمل الدفاعات في الوقت الفعلي، مثل Prompt Shields، على منع عمليات الهروب من السجن وهجمات الحقن الفوري، بينما يتطلب Customer Lockbox موافقة إدارية لـ Microsoft للوصول إلى بيانات العميل. تتعقب الأدوات الإضافية إصدارات الأصول ونسب البيانات والحصص، ويوفر Microsoft Defender for Cloud الحماية من تهديدات وقت التشغيل.

يعمل Azure Machine Learning وفقًا لنموذج تسعير الدفع أولاً بأول، حيث يتم تحصيل الرسوم فقط مقابل موارد الحوسبة مثل وحدات المعالجة المركزية ووحدات معالجة الرسومات المتخصصة. تتم أيضًا محاسبة الخدمات الداعمة مثل Blob Storage و Key Vault وسجل الحاويات وإحصاءات التطبيقات بناءً على الاستخدام. يمكن للفرق اختيار الأجهزة المصممة خصيصًا لمهام محددة، بينما تعمل ميزات مثل التخزين المؤقت لخطوط الأنابيب على تقليل الحسابات الزائدة عن الحاجة. تضمن البنية التحتية ككود النشر المتسق والإدارة الفعالة للموارد.

تعمل خطوط أنابيب Google Vertex AI على التخلص من متاعب إدارة البنية التحتية من خلال أتمتة عمليات سير عمل التعلم الآلي (ML). ينظم المهام في الرسم البياني غير الدوري الموجه (DAG) للمكونات الحاوية، مما يمكّن الفرق من التركيز على تطوير النموذج بدلاً من إدارة الخادم.

تستخدم Vertex AI Pipelines نهجًا بدون خادم للتعامل مع أعباء العمل، وتفويض مهام المعالجة المكثفة لأدوات مثل بيج كويري، تدفق البيانات، وسحابة بدون خادم لأباتشي سبارك. بالنسبة لحسابات Python و ML الموزعة، فإنها تتكامل بسلاسة مع راي أون فيرتيكس بالذكاء الاصطناعي.

تدعم المنصة عقد سلسلة A3 و A3 Mega المجهزة بوحدات معالجة الرسومات NVIDIA H100/H200. توفر عُقد A3 Mega، التي تتميز بـ 8 وحدات معالجة رسومات H100، مظهرًا رائعًا 1,600 جيجابت في الثانية عرض النطاق الترددي عبر العقد. على سبيل المثال، قامت شركة Vectra بتحليل 300,000 مكالمة شهرية للعملاء باستخدام Gemini و Vertex AI، وحققت 500% زيادة سرعة التحليل.

كفاءة التكلفة مضمنة في التخزين المؤقت للتنفيذ، والذي يعيد استخدام المخرجات لتقليل النفقات. تضمن Vertex ML Metadata إمكانية التكرار من خلال تتبع سلالة القطع الأثرية والمعلمات والمقاييس على نطاق واسع. يتكامل هذا التصميم القابل للتطوير بسهولة مع مجموعة متنوعة من الأدوات، مما يجعله حلاً متعدد الاستخدامات لسير عمل ML.

ال مكونات خطوط الأنابيب السحابية من Google (GCPC) تعمل SDK على تبسيط عملية التكامل من خلال تقديم مكونات تم إنشاؤها مسبقًا تربط خدمات Vertex AI، مثل AutoML، ومهام التدريب المخصصة، ونشر النماذج، مباشرةً في خطوط الأنابيب.

تتسم إدارة خطوط الأنابيب بالمرونة، مع خيارات مثل Cloud Composer (تدفق Apache Airflow المُدار) ومشغلات Cloud Data Fusion لتنظيم سير العمل عبر الخدمات. اتصالات أصلية إلى BigQuery والتخزين السحابي و داتابروك تبسيط معالجة البيانات، بينما يمكن مزامنة البيانات الوصفية مع داتابلكس كتالوج عالمي لتتبع النسب عبر المشاريع. بالإضافة إلى ذلك، توفر الحديقة النموذجية الوصول إلى أكثر من 200 موديل، بما في ذلك جيميني من غوغل، أنثروبيهو كلود، ولاما ميتا.

يتم تجميع تعريفات خطوط الأنابيب في تنسيق YAML القياسي، مما يضمن قابلية النقل عبر المستودعات مثل Artifact Registry.

تم تصميم خطوط أنابيب Vertex AI مع وضع الحوكمة والأمان في الاعتبار. تضمن حسابات الخدمة أن كل مكون يعمل بالأذونات الضرورية فقط. عناصر التحكم في خدمة VPC إنشاء محيط آمن ومنع البيانات الحساسة - مثل مجموعات بيانات التدريب والنماذج ونتائج التنبؤ بالدفعات - من مغادرة حدود الشبكة.

بالنسبة للمؤسسات ذات احتياجات الامتثال الصارمة، تدعم المنصة مفاتيح التشفير التي يديرها العميل (CMEK) بالإضافة إلى التشفير الافتراضي لـ Google Cloud في حالة الراحة. توفر Vertex ML Metadata مسارًا تفصيليًا للتدقيق عن طريق تسجيل المعلمات والتحف والمقاييس تلقائيًا من كل خط أنابيب.

تحمي ميزات الأمان مثل Model Armor من الحقن الفوري واستخراج البيانات. يمكن تكوين خطوط الأنابيب لتعمل داخل شبكات VPC ذات النظراء، ويسمح Cloud Logging للفرق بمراقبة أحداث خطوط الأنابيب بحثًا عن أي أخطاء أمنية.

تعمل خطوط أنابيب Vertex AI على نموذج الدفع أولاً بأول، مع تطبيق ملصقات الفواتير تلقائيًا لتتبع التكاليف من خلال عمليات تصدير Cloud Billing إلى BigQuery. يعمل التخزين المؤقت للتنفيذ على تقليل التكاليف عن طريق إعادة استخدام المخرجات.

ولخفض نفقات وظائف التدريب التي تتحمل الاضطرابات، تتوفر أجهزة Spot VMs بأسعار مخفضة. بالنسبة لالتزامات البنية التحتية طويلة الأجل، توفر خصومات الاستخدام الملتزم (CUDs) وفورات في التكاليف وسعة مضمونة. ال برنامج جدولة عبء العمل الديناميكي (DWS) يوفر القدرة على تحمل أعباء العمل المرنة بأسعار قائمة منخفضة، بينما تضمن مجموعات التدريب المخصصة قدرة تسريع محجوزة للوظائف واسعة النطاق.

يعمل IBM watsonx Orchestrate كمحور مركزي يقوم بتنسيق وكلاء الذكاء الاصطناعي من خلال العمل كمشرف وجهاز توجيه ومخطط للأدوات المتخصصة والنماذج الأساسية. تدعم المنصة أساليب التنسيق المختلفة: تتفاعل للمهام الاستكشافية، قانون الخطة لسير العمل المنظم، والتنسيق الحتمي لعمليات الأعمال التي يمكن التنبؤ بها.

مصمم للعمليات واسعة النطاق، يستخدم watsonx Orchestrate تنسيق متعدد الوكلاء لتوجيه الطلبات بكفاءة إلى الأدوات المناسبة ونماذج اللغات الكبيرة (LLMs) في الوقت الفعلي. يمكن للمؤسسات اختيار نشر watsonx Orchestrate كخدمة مُدارة على IBM Cloud أو AWS، أو تثبيتها محليًا للتوافق مع البنية التحتية الحالية.

لقد حققت المنصة بالفعل نتائج قابلة للقياس. على سبيل المثال، قامت IBM بحل 94% من 10 ملايين طلب موارد بشرية سنوي على الفور من خلال watsonx Orchestrate، مما يسمح لفرق الموارد البشرية بالتركيز على المهام ذات القيمة الأعلى. وبالمثل، خفضت شركة Dun & Bradstreet وقت الشراء بمقدار ما يصل إلى 20% من خلال تقييمات مخاطر الموردين القائمة على الذكاء الاصطناعي، مما يؤدي إلى إنقاذ العملاء 10٪ في وقت التقييم.

لدعم النشر السريع، تتضمن المنصة عدم وجود كود عامل البناء و مجموعة تطوير الوكيل (ADK) لإنشاء أدوات مخصصة تستند إلى Python. بالإضافة إلى ذلك، كتالوج يحتوي على أكثر من 100 من وكلاء الذكاء الاصطناعي الخاصين بالمجال وأكثر من 400 أداة مسبقة الصنع تقدم مكونات قابلة للتطوير لتلبية الاحتياجات التشغيلية المتنوعة.

تضمن قابلية التوسع هذه التكامل السلس مع الأنظمة الحالية، مما يجعلها قابلة للتكيف مع مجموعة واسعة من بيئات المؤسسات.

المنصة بوابة الذكاء الاصطناعي يسهل التوجيه السلس بين نماذج التأسيس المختلفة، بما في ذلك IBM Granite و OpenAI و Anthropic و Google Gemini، الميسترال ريح شمالية، ولاما، مما يساعد المؤسسات على تجنب حبس البائعين. تدعم مجموعة تطوير الوكلاء إنشاء أدوات مخصصة باستخدام مواصفات OpenAPI لخدمات الويب عن بُعد وPython للوظائف الموسعة.

التكامل مع لانغفلو يضيف واجهة سحب وإسقاط مرئية لتصميم تطبيقات الذكاء الاصطناعي، والتي يمكن استيرادها بعد ذلك إلى بيئة Orchestrate. علاوة على ذلك، يتصل watsonx Orchestrate بسهولة بأنظمة المؤسسات مثل سالسفورس، SAP، يوم العمل، و ميكروسوفت 365مما يلغي الحاجة إلى تغييرات واسعة النطاق في البنية التحتية.

مع AgentOps، تراقب المنصة أنشطة وكلاء الذكاء الاصطناعي وتفرض سياسات في الوقت الفعلي لضمان الموثوقية والامتثال. تساعد حواجز الحماية المدمجة والرقابة المركزية في الحفاظ على الالتزام باللوائح الداخلية.

«باستخدام AgentOps، تتم مراقبة كل إجراء وإدارته، مما يسمح بوضع علامة على الحالات الشاذة وتصحيحها في الوقت الفعلي». - IBM Newsroom

آي بي إم جوارديوم يعزز التكامل الأمان من خلال تحديد عمليات نشر الذكاء الاصطناعي غير المصرح بها وكشف نقاط الضعف أو التكوينات الخاطئة. تنفذ المنصة أيضًا التحكم في الوصول المستند إلى الأدوار (RBAC)، والتي تتضمن أربعة أدوار رئيسية - المسؤول والباني والمستخدم وخبير المنتج - لحماية إعدادات البيئة. أبلغت الشركات التي تستخدم watsonx.governance عن زيادة بنسبة 30% في العائد على الاستثمار من مبادرات الذكاء الاصطناعي الخاصة بهم.

تقدم المنصة أسعارًا مرنة لتلبية الاحتياجات التنظيمية المختلفة:

بالنسبة لأولئك الذين يتطلعون إلى استكشاف المنصة، هناك إصدار تجريبي مجاني لمدة 30 يومًا، وتأتي الاشتراكات السنوية لخطة Essentials مع خصم 10% إذا تم شراؤها بحلول 31 يناير 2026.

يجمع مركز UiPath AI بين وكلاء الذكاء الاصطناعي وروبوتات RPA والعاملين البشريين ضمن تدفقات عمل المؤسسة، مما يخلق نظامًا بيئيًا قابلاً للتطوير مصممًا لتلبية متطلبات عام 2025. في جوهرها، تستفيد المنصة من UiPath Maestro كمركز تحكم ذكي، حيث تدير العمليات طويلة الأمد عبر العمليات التجارية المعقدة.

يقدم UiPath AI Center خيارين للنشر لتناسب احتياجات الأعمال المختلفة: سحابة الأتمتة، الذي يوفر تحجيمًا مرنًا فوريًا، و مجموعة التشغيل الآلي، مصممة للنشر في أماكن العمل. يتميز نظام MLops الخاص به بواجهة سحب وإسقاط سهلة الاستخدام لنشر النماذج ومراقبتها، مما يسمح لها بالتوسع بسلاسة عبر عدد غير محدود من الروبوتات. على سبيل المثال، أبلغت شركة SunExpress Airlines عن توفير أكثر من 200,000 دولار مع تقليل التراكمات لمدة شهرين. تضمن المنصة أيضًا بقاء النماذج دقيقة من خلال إعادة التدريب المستمر بين الإنسان والحلقة، مما يجعلها أداة قوية لدمج الذكاء الاصطناعي عبر أنظمة متنوعة.

تتبنى المنصة استراتيجية «أحضر نموذجك الخاص» (BYOM)، مما يتيح التكامل مع أطر عمل الطرف الثالث مثل LangChain و Anthropic و Microsoft. بالإضافة إلى ذلك، يعمل بروتوكول Agent2Agent (A2A)، الذي تم تطويره بالتعاون مع Google Cloud، على تسهيل التواصل السلس بين وكلاء الذكاء الاصطناعي عبر منصات المؤسسات.

قال هاريسون تشيس، الرئيس التنفيذي لشركة LangChain: «يضمن تعاوننا مع UiPath بشأن بروتوكول الوكيل أن وكلاء LangGraph يمكنهم المشاركة بسلاسة في عمليات التشغيل الآلي لـ UiPath، وتوسيع نطاق وصولهم وتمكين المطورين من بناء تدفقات عمل أكثر تماسكًا ومتعددة المنصات.»

يتصل UiPath AI Center بمئات تطبيقات SaaS من خلال واجهات برمجة التطبيقات القياسية، ويدعم BPMN 2.0 لنمذجة العمليات، ويستخدم نموذج القرار والترميز (DMN) لإدارة قواعد الأعمال. ومن الأمثلة البارزة على ذلك Heritage Bank، أكبر بنك مشترك في أستراليا، والذي استخدم مركز الذكاء الاصطناعي لأتمتة عملية مراجعة القروض، وتحسين تجارب العملاء مع تقليل المهام الخلفية اليدوية.

يعطي مركز UiPath AI الأولوية للحوكمة والأمن، ويقدم ضوابط الوصول على مستوى المشروع والمستأجر للحفاظ على إمكانية التتبع والامتثال. تضمن ميزات الوكالة الخاضعة للرقابة أن وكلاء الذكاء الاصطناعي لا يمكنهم تنفيذ إجراءات غير مصرح بها أو غير آمنة بشكل مستقل.

قال بريان لوكاس، المدير الأول للأتمتة في شركة Abercrombie & Fitch: «UiPath Maestro هي طبقة التنسيق التي تربط كل شيء - الروبوتات ووكلاء الذكاء الاصطناعي والأنظمة داخل وخارج UiPath - مما يضمن التنسيق السلس عبر العديد من العمليات الآلية المعقدة».

يوفر مركز قيادة MLops الخاص بالمنصة رؤية كاملة لاستخدام البيانات وإصدارات النماذج ومقاييس الأداء وإجراءات المستخدم، مما يضمن مسارات تدقيق واضحة. بالنسبة للشركات التي تتطلب أقصى قدر من التحكم، توفر Automation Suite المستضافة ذاتيًا الإشراف الكامل على البنية التحتية وإدارة البيانات.

يستخدم مركز UiPath AI نموذج ترخيص قائم على الاستهلاك باستخدام وحدات الذكاء الاصطناعي، والتي تقيس الأنشطة مثل التدريب النموذجي والاستضافة والتنبؤات. تتكامل هذه بسلاسة في نظام ترخيص UiPath الأوسع عبر وحدات المنصة، تغطي احتياجات التنسيق والتنفيذ. لمساعدة المؤسسات على استكشاف إمكاناتها، تتوفر نسخة تجريبية مجانية مدتها 60 يومًا لكل من إصدارات Automation Cloud وAutomation Suite، مما يسهل تقييم قيمتها مع إبقاء التكاليف تحت السيطرة.

يتخذ Temporal نهجًا فريدًا باستخدام كود دائم وقابل للاستئناف بدلاً من الاعتماد على ملفات التكوين. فهو يلتقط كل خطوة من خطوات سير العمل في سجل الأحداث غير القابل للتغيير، مما يضمن أن العمليات يمكن أن تبدأ من حيث توقفت تمامًا بعد الانقطاع. وخير مثال على ذلك هو Replit، الذي نقل مستوى التحكم في عامل الترميز الخاص به إلى Temporal، مما أدى إلى تحسين الموثوقية وتجربة المستخدم بشكل كبير.

تفصل بنية Temporal محرك التنسيق عن عمليات العمال، مما يسمح لكل منها بالتوسع بشكل مستقل. يمكن للسحابة المؤقتة التعامل معها 200 مليون عملية إعدام في الثانية، ولا تتحمل عمليات سير العمل في حالات الانتظار أي رسوم حسابية. تعمل قدرتها على التعافي في منتصف العملية على التخلص من تكاليف API الزائدة، مما يمكّن الفرق الهندسية من التركيز على منطق الأعمال وطرح الميزات أسرع من 2 إلى 10 مرات.

«تمكنا من إخراج Retool Agents في غضون أشهر ودعم تجربة قوية حقًا مع فريق صغير حقًا... لم يكن ذلك ممكنًا بدون Temporal.»

- ليزي سيجريست، مديرة المنتج، Retool

تضمن قابلية التوسع هذه التكامل السلس مع الأدوات والأنظمة المختلفة.

يمكن للمطورين كتابة عمليات سير العمل كتعليمات برمجية باللغات الشائعة مثل Python و Go و Java و TypeScript و .NET و PHP. يتكامل Temporal أيضًا بسهولة مع أطر الذكاء الاصطناعي الرائدة، بما في ذلك OpenAI Agents SDK و Pydantic AI و LangGraph و Crew AI. يعزز دعمها لبروتوكول السياق النموذجي (MCP) موثوقية الوكيل. تم تحسين إمكانية المراقبة من خلال الاتصالات بأدوات المراقبة الخاصة بالذكاء الاصطناعي مثل Langfuse. على سبيل المثال، يستخدم Gorgias هذه المرونة للمساعدة 15,000 علامة تجارية إلكترونية إدارة وكلاء خدمة العملاء الذين يعتمدون على الذكاء الاصطناعي.

يوفر سجل أحداث Temporal مسار تدقيق كامل وغير قابل للتغيير لكل تغيير في حالة سير عمل الذكاء الاصطناعي. تدعم هذه الميزة حوكمة الإنسان في الحلقة، مما يتيح لعمليات سير العمل التوقف مؤقتًا للتحقق الخارجي قبل تنفيذ القرارات المستقلة. هذه الحماية مفيدة بشكل خاص في بيئات الإنتاج لمنع حدوث مشكلات مثل هلوسات LLM. في عمليات نشر Temporal Cloud، لا يمكن للموفر الوصول إلى رمز التطبيق، بينما يتيح خيار الخادم مفتوح المصدر والمرخص من MIT للمؤسسات استضافة النظام الأساسي داخل البنية التحتية الآمنة الخاصة بها. لقد أبرز مهندسو Netflix كيف يقلل هذا التصميم من الصيانة ويبسط معالجة الأعطال.

تعمل Temporal Cloud على نموذج الدفع أولاً بأول، في حين أن خادم Temporal Server مفتوح المصدر مجاني للاستضافة الذاتية. يمكن للمستخدمين الجدد استكشاف المنصة باستخدام 1,000 دولار في شكل ائتمانات مجانية للسحابة المؤقتة. من خلال تعليق عمليات سير العمل دون استهلاك موارد الحوسبة، يمكن للمستخدمين تقليل البنية التحتية والتكاليف التشغيلية بشكل كبير. لا يعمل تصميم Temporal على تحسين الكفاءة والموثوقية فحسب، بل يحافظ أيضًا على النفقات تحت السيطرة مع نمو عمليات الذكاء الاصطناعي.

يتطلب اختيار منصة تنسيق الذكاء الاصطناعي المثالية موازنة المرونة مع سهولة الاستخدام. توفر خيارات المصدر المفتوح مثل Apache Airflow و LangChain استقلالية البائع والتخصيص العميق ولكنها تتطلب مهارات فنية متقدمة وتكوينات يدوية للأمان والحوكمة. من ناحية أخرى، تشتمل منصات المؤسسات مثل IBM watsonx Orchestrate و UiPath على ميزات مضمنة مثل التحكم في الوصول المستند إلى الأدوار (RBAC) ومسارات التدقيق والامتثال لقانون HIPAA، على الرغم من أنها تأتي مع رسوم ترخيص ومرونة منخفضة.

تختلف استراتيجيات قابلية التوسع بشكل كبير عبر المنصات. تتفوق أدوات Kubernetes الأصلية مثل Kubeflow و Argo Workflowks في قابلية النقل بالحاويات، في حين أن الجدولة المستندة إلى الرسم البياني غير الدوري الموجه من Apache Airflow (DAG) فعالة لإدارة التبعيات المعقدة في الإعدادات المختلطة والمتعددة السحابات. تشتهر شركة Temporal بإنتاجيتها العالية، بينما تستفيد Azure Machine Learning و Google Vertex AI Pipelines من النظم البيئية السحابية الأصلية لتخصيص الموارد ديناميكيًا أثناء ذروة الطلب. تسلط هذه الاختلافات الضوء على المقايضات التي يجب على المنظمات مراعاتها عند تقييم الحلول.

تعد قابلية التشغيل البيني عاملاً مهمًا آخر لضمان سير العمل الموحد. يمكّن LangChain المطورين من ربط العديد من نماذج اللغات الكبيرة (LLMs) وواجهات برمجة التطبيقات دون إصلاح الأنظمة الحالية، ويدعم Kubeflow أطر عمل مثل PyTorch و TensorFlow و JAX ضمن خط أنابيب واحد. تهدف المنصات مثل Prompts.ai إلى تقليل التجزئة من خلال توحيد نماذج متعددة، في حين أن المنصات الخاصة بالموردين مثل Azure Machine Learning و IBM watsonx Orchestrate توفر عمليات تكامل أصلية سلسة ولكنها قد تتطلب موصلات إضافية للتوافق على نطاق أوسع.

تلعب المقايضات التشغيلية أيضًا دورًا رئيسيًا في قرارات النشر وعائد الاستثمار (ROI). الحوكمة وإدارة التكاليف هي المجالات التي تختلف فيها المنصات بشكل كبير. توفر الحلول على مستوى المؤسسات مثل IBM watsonx Orchestrate و UiPath لوحات معلومات مركزية وميزات أمان قوية، مما يجعلها مناسبة للصناعات المنظمة مثل الرعاية الصحية والتمويل. في المقابل، غالبًا ما تتطلب الأدوات مفتوحة المصدر إعدادًا يدويًا لتحقيق إشراف مماثل. من منظور التكلفة، في حين يمكن نشر Apache Airflow و LangChain و Kubeflow مجانًا، إلا أنها يمكن أن تتحمل نفقات خفية تتعلق بالوقت الهندسي والخبرة. تقدم Temporal Cloud تسعير الدفع أولاً بأول مع 1,000 دولار في شكل أرصدة مجانية، بينما تقلل Prompts.ai بشكل كبير من تكاليف برامج الذكاء الاصطناعي - حتى 98٪ - من خلال نظام ائتمان TOKN الموحد الذي يلغي الرسوم المتكررة.

يقدم الجدول أدناه مقارنة تفصيلية لكل منصة عبر الأبعاد التشغيلية الرئيسية:

يعتمد اختيار أفضل منصة لتنسيق الذكاء الاصطناعي على القدرات الفنية لمؤسستك واحتياجات الامتثال وخطط النمو. توفر خيارات المصدر المفتوح مثل Apache Airflow و LangChain مرونة لا مثيل لها بدون رسوم ترخيص، مما يجعلها خيارًا مثاليًا للفرق التي يقودها المطورون في الشركات الناشئة في مجال التكنولوجيا والشركات سريعة النمو التي تقدر الإعدادات المعيارية. ومع ذلك، تتطلب هذه الأطر مهارات هندسية متقدمة لتكوين الميزات الهامة مثل الأمان والحوكمة وقابلية التوسع. من ناحية أخرى، تلبي منصات المؤسسات مثل IBM watsonx Orchestrate صناعات مثل الرعاية الصحية والتمويل، حيث تكون تدابير الامتثال المضمنة - مثل ضوابط الوصول القائمة على الأدوار ومسارات التدقيق والشهادات مثل HIPAA و SOC 2 - غير قابلة للتفاوض. غالبًا ما تُظهر هذه المنصات عوائد ملموسة من خلال تبسيط سير العمل وربط ميزات الحوكمة بنتائج الأعمال المحسنة.

بالنسبة للمؤسسات الكبيرة، تعد المنصات التي تعتمد على الحوكمة أمرًا ضروريًا، ولكن الشركات متوسطة الحجم غالبًا ما تحتاج إلى حلول توازن بين التكلفة والأداء. يبسط Prompts.ai هذه المعادلة من خلال دمج أكثر من 35 نموذجًا في واجهة واحدة، مما يوفر عناصر تحكم FinOps في الوقت الفعلي وائتمانات TOKN للدفع أولاً بأول لتقليل تجزئة الأدوات والنفقات غير المتوقعة. وفي الوقت نفسه، تتألق أدوات Kubernetes الأصلية مثل Kubeflow Pipelines و Argo Workflowses عندما تكون قابلية النقل وعمليات النشر السحابية المختلطة أمرًا أساسيًا، خاصة لفرق علوم البيانات التي تدير خطوط أنابيب التعلم الآلي المعقدة عبر الأنظمة الموزعة.

كما تمت مناقشته سابقًا، فإن ظهور الذكاء الاصطناعي الفعال - حيث يتعاون الوكلاء المستقلون في التفكير متعدد الخطوات - يسلط الضوء على الأهمية المتزايدة للتنسيق السلس. على حد تعبير دومو:

«لم يعد النجاح في الذكاء الاصطناعي يتعلق بامتلاك معظم النماذج - بل يتعلق بتنظيمها بفعالية».

بالنسبة للمؤسسات الأمريكية، من الضروري اختيار منصات تتناسب مع نضجها التقني الحالي مع توفير مساحة للتوسع حيث يصبح الذكاء الاصطناعي أكثر تكاملاً عبر الأقسام. نقطة البداية الذكية هي مشروع تجريبي يركز على سير عمل محدد وتتبع المدخلات والمخرجات والأخطاء لإنشاء خط أساس للملاحظة للتوسع المستقبلي. تقوم منصة التنسيق الصحيحة بأكثر من مجرد توصيل أدوات الذكاء الاصطناعي - فهي تعيد تعريف كيفية تعاون الفرق وحل المشكلات وخلق القيمة على نطاق أوسع.

تعمل منصات تنسيق الذكاء الاصطناعي على تبسيط عمليات سير العمل المعقدة من خلال الجمع بين نماذج الذكاء الاصطناعي المختلفة ومصادر البيانات والعمليات في نظام آلي واحد. إنهم يديرون مهام مثل الجدولة وتوزيع الموارد وتكامل واجهة برمجة التطبيقات، مما يقلل من الجهد اليدوي مع تقليل وقت التطوير والنفقات التشغيلية بشكل كبير.

تم تصميم هذه المنصات للتوسع دون عناء، مما يمكّن الشركات من التوسع من التعامل مع عدد قليل من المهام إلى إدارة الآلاف دون إصلاح بنيتها التحتية. إنهم يتفوقون في معالجة كميات كبيرة من البيانات، مما يجعل استخدام الموارد أكثر كفاءة، ويحافظ على الإشراف المتسق. وهذا يؤدي إلى عمليات نشر أسرع وإنتاجية محسنة وحلول ذكاء اصطناعي مجهزة بشكل أفضل لتلبية الاحتياجات الديناميكية للمؤسسات.

غالبًا ما تتعامل منصات تنسيق الذكاء الاصطناعي مع النفقات من خلال نماذج التسعير القائمة على الاستخدام، مما يسمح للشركات بالدفع مقابل ما تستخدمه فقط بدلاً من الالتزام بالتراخيص الثابتة. تأتي العديد من هذه المنصات مجهزة بـ أدوات مالية في الوقت الفعلي، بما في ذلك لوحات المعلومات لمراقبة الإنفاق حسب النموذج أو سير العمل، وأنظمة تنبيه الميزانية، وعلامات عبء العمل لتحليل التكلفة التفصيلي. تضمن هذه الأدوات للشركات رؤية واضحة للنفقات المتعلقة بالذكاء الاصطناعي والحفاظ على السيطرة على ميزانياتها.

ما هي المجموعات prompts.ai بصرف النظر عن واجهته البديهية جنبًا إلى جنب مع إمكانات تتبع التكاليف المضمنة، والتي يمكن أن تخفض نفقات الذكاء الاصطناعي بنسبة تصل إلى 98%. خطط الاشتراك، التي تتراوح من 99 دولارًا - 129 دولارًا لكل مستخدم شهريًا، توفر المراقبة في الوقت الفعلي لاستخدام الرمز المميز والتسعير الخاص بالنموذج، مما يمكّن الفرق من إدارة التكاليف بشكل استباقي. على عكس المنصات الأخرى التي تعتمد على تكامل الفواتير السحابية أو صادرات الاستخدام اليدوي - غالبًا ما تتسبب في تأخيرات وتتطلب جهدًا هندسيًا إضافيًا - prompts.ai يوفر رؤية فورية للتكلفة، مما يوفر الوقت والموارد.

Prompts.ai يضع معيارًا للتنسيق الآمن للذكاء الاصطناعي في عام 2025، مما يوفر للشركات منصة موثوقة لتوسيع نطاق عمليات الذكاء الاصطناعي الخاصة بها دون عناء. تم تصميم لوحة التحكم الموحدة لتبسيط الإدارة، حيث تتميز بأدوات الحوكمة المضمنة وتتبع التكاليف في الوقت الفعلي ومسارات التدقيق غير القابلة للتغيير. تضمن هذه الميزات بقاء الشركات متوافقة مع الحفاظ على الإشراف الكامل على سير عمل الذكاء الاصطناعي.

نظرًا لأنه مزود بتدابير أمان على مستوى المؤسسة مثل التحكم في الوصول المستند إلى الأدوار والتشفير من طرف إلى طرف ومراقبة الامتثال المستمرة، فإن Prompts.ai يحمي البيانات الحساسة في كل مرحلة من مراحل التشغيل. من خلال دمج أكثر من 35 شركة LLMs رائدة في إطار واحد آمن، فإنها تقلل المخاطر وتمكن الشركات من توسيع قدرات الذكاء الاصطناعي الخاصة بها بثقة وكفاءة.